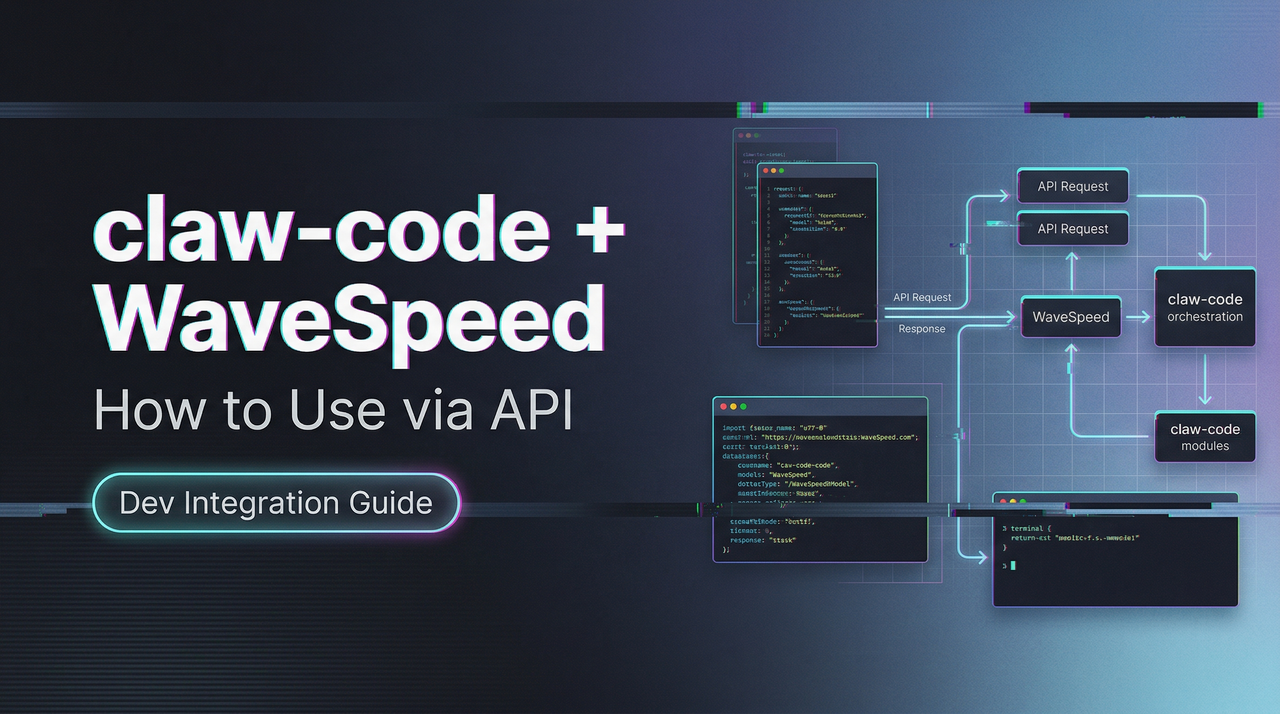

如何通过API将claw-code与WaveSpeed AI模型结合使用

了解如何使用统一的模型API将图像和视频生成模型集成到claw-code智能体工作流中。

想象一下:你的 AI 智能体不只是思考——它还能创造。

它逐步推理,然后无缝调用强大的图像生成模型生成精美视觉内容,切换到视频模型添加动效,分析结果,继续工作流——全程无需你动一根手指或修改一行代码。

这正是现在通过 WaveSpeed AI 模型与 claw-code 所能实现的——这是一个由韩国开发者在Claude Code 泄露事件之后,以 Python 全新洁净室风格重写并开源的项目。

在本指南中,你将了解如何利用这一强大组合,构建不只是聊天的智能体……而是能在单一智能循环中创作、迭代并输出真实多媒体内容的智能体。

无论你是创作者、开发者,还是厌倦了在多个工具之间切换的 AI 爱好者,这里是你通往真正 Agentic 多媒体工作流的捷径。

准备好让你的 AI 智能体具备视觉创造力了吗?让我们开始吧。

前置条件:开始前你需要准备的内容

在动任何一行配置之前,先把这两件事搞定。跳过任何一件都会让你花上数小时排查莫名其妙的错误信息。

claw-code 安装与环境配置

claw-code 运行在 Python 3.11+ 环境下。截至 2026 年 3 月,主分支以 Python 为主(根据项目自身的语言统计,72.9% Rust,27.1% Python,但你日常实际使用的 CLI 入口是 Python)。从官方仓库安装:

git clone https://github.com/instructkr/claw-code.git

cd claw-code

pip install -e .你还需要将 Anthropic 密钥设置为环境变量——claw-code 同时支持 ANTHROPIC_API_KEY 和 ANTHROPIC_AUTH_TOKEN,与 Anthropic API 认证模式官方文档保持一致。

export ANTHROPIC_API_KEY="your-key-here"有一点值得注意:Rust 移植版本仍在独立分支上进行中。对于视频/图像工作流,Python 版本已足够稳定。Rust 迁移的目标是性能关键的运行时路径——目前这个使用场景暂不需要考虑。

API 密钥与模型提供商访问权限

新账户可获得 $1 免费试用额度——足以测试几次图像生成,在花费真实费用之前确认你的完整流程可以正常运行。

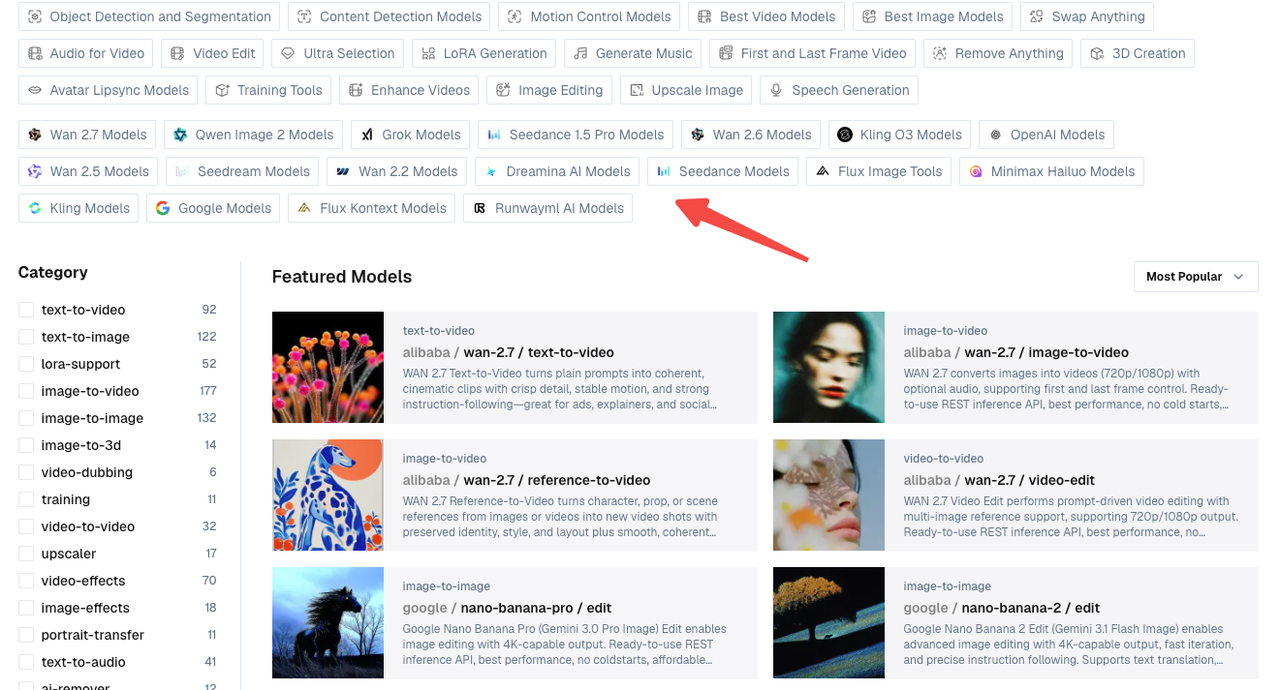

截至 2026 年 3 月,WaveSpeed 的模型目录涵盖 700+ 个模型,涉及图像、视频、音频和 3D 生成,全部通过单一统一的 API 密钥访问。这一点在你开始构建多模型智能体工作流时至关重要——你不会想要管理五个不同的认证头信息。

在 claw-code 工作流中接入外部模型 API

真正有趣的部分从这里开始。claw-code 不仅仅是一个编码助手——它实现了一个完整的工具执行层,包含 19 个权限控制工具和可扩展的插件模型。正是这一点让接入 WaveSpeed 等外部 API 成为切实可行的事情。

claw-code 如何处理外部工具调用

claw-code 的工具系统通过 Rust 层生成的 JSON Schema 定义运作,Python 负责智能体编排部分。每个工具都在 permissions.py 中定义了自己的访问控制。当你添加自定义工具时,智能体可以根据任务上下文自主决定何时调用——这正是你希望的效果:当一个”写个脚本并生成对应缩略图”的提示词应该同时触发文本任务和图像生成调用时。

claw-code 的 Anthropic API 客户端内置的重试逻辑对 408、429 和 5xx 响应使用指数退避策略。你将为 WaveSpeed 调用复用相同的模式。

将模型 API 作为工具添加到 Harness 中

在 claw-code 的 tools 目录中创建一个名为 wavespeed_tool.py 的文件:

import httpx

import os

import time

WAVESPEED_API_KEY = os.environ.get("WAVESPEED_API_KEY")

BASE_URL = "https://api.wavespeed.ai/api/v3"

TOOL_SCHEMA = {

"name": "generate_image",

"description": "Generate an image using WaveSpeed AI given a text prompt.",

"input_schema": {

"type": "object",

"properties": {

"prompt": {"type": "string", "description": "Image generation prompt"},

"model": {"type": "string", "default": "wavespeed-ai/flux-dev"},

},

"required": ["prompt"],

},

}

def generate_image(prompt: str, model: str = "wavespeed-ai/flux-dev") -> dict:

headers = {"Authorization": f"Bearer {WAVESPEED_API_KEY}"}

payload = {"inputs": {"prompt": prompt}, "enable_safety_checker": True}

response = httpx.post(f"{BASE_URL}/{model}/run", json=payload, headers=headers)

response.raise_for_status()

return response.json()在 claw-code 的工具注册表中注册后,智能体就可以在任何涉及图像创建的会话中调用 generate_image。

在智能体工作流内部调用图像和视频生成模型

这一节正是我最初搭建环境时一直想找却找不到的内容。所以现在我尽可能清晰地写在这里。

REST API 调用模式

WaveSpeed 在所有模型上使用一致的 REST 调用模式。基本调用如下(以 WAN 2.7 文本转视频为例):

import httpx

def call_wavespeed(model_id: str, inputs: dict) -> dict:

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {"inputs": inputs}

response = httpx.post(

f"https://api.wavespeed.ai/api/v3/{model_id}/run",

json=payload,

headers=headers,

timeout=30,

)

response.raise_for_status()

return response.json()对于图像模型(如 Flux Dev 或 Seedream v4.5),响应会同步返回一个输出 URL。对于视频模型——WAN 2.7、Kling 2.6、Hailuo 2.3——是异步的,这意味着你需要轮询。

处理异步生成与轮询

WaveSpeed 上的视频生成通常需要 30 秒到几分钟不等,具体取决于模型和视频时长。API 会立即返回一个 request_id;你需要轮询状态端点,直到任务完成。

def poll_until_done(request_id: str, max_wait: int = 300) -> dict:

headers = {"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}"}

start = time.time()

while time.time() - start < max_wait:

resp = httpx.get(

f"https://api.wavespeed.ai/api/v3/predictions/{request_id}/status",

headers=headers,

)

data = resp.json()

status = data.get("status")

if status == "completed":

return data

elif status == "failed":

raise RuntimeError(f"Generation failed: {data.get('error')}")

time.sleep(5) # 每5秒轮询一次

raise TimeoutError("Generation timed out")在 claw-code 智能体循环中,你需要将此轮询逻辑封装到工具的 execute 函数中,让智能体等待结果后再继续下一步。

在 Agentic 场景下管理速率限制与回退策略

智能体循环中的速率限制比简单脚本中更难处理——如果任务可以并行化,智能体可能会快速连续触发多个工具调用。以下是我正在使用的回退模式,改编自 claw-code 自身的重试逻辑:

import time

def call_with_retry(model_id: str, inputs: dict, retries: int = 3) -> dict:

fallback_models = {

"wavespeed-ai/wan-2.7-t2v": "wavespeed-ai/wan-2.6-t2v",

}

for attempt in range(retries):

try:

return call_wavespeed(model_id, inputs)

except httpx.HTTPStatusError as e:

if e.response.status_code == 429:

wait = 2 ** attempt # 指数退避

time.sleep(wait)

elif e.response.status_code >= 500:

# 如果有可用的回退模型则切换

model_id = fallback_models.get(model_id, model_id)

time.sleep(2)

else:

raise

raise RuntimeError(f"All retries exhausted for {model_id}")WaveSpeed API 文档详细说明了按账户等级划分的速率限制——Silver 账户(一次性充值 $100)获得的并发限制远高于默认的 Bronze 等级,这一点在你运行每次会话触发多个生成请求的智能体时至关重要。

多模型模式:聚合访问为何在 Agentic 管道中至关重要

我想花一点时间解释为什么这个架构值得花时间搭建——因为在你真正遇到为每个想要测试的模型管理独立 API 账户的麻烦之前,这并不显而易见。

无需重写工作流即可切换模型

WaveSpeed 的统一 API 意味着你只需修改一个字符串,就能将 wavespeed-ai/flux-dev 替换为 wavespeed-ai/seedream-v4-5。无需新的认证流程,无需解析不同的响应 Schema,无需切换 SDK。对于希望智能体根据任务选择合适模型的 Agentic 工作流(写实缩略图 vs. 风格化插图 vs. 短视频片段),这一点真的很有用——你可以将模型 ID 作为变量传入,让智能体自行推断哪个更合适。

以下是根据 WaveSpeed 目录中 2026 年 3 月生成规格整理的简单模型对比表:

| 模型 | 类型 | 输出分辨率 | 最适合场景 |

|---|---|---|---|

| Flux Dev | 图像 | 最高 4K | 写实风格,生成速度快 |

| Seedream v4.5 | 图像 | 最高 4K | 艺术风格,风格化表达 |

| WAN 2.7 T2V | 视频 | 720p/1080p | 文本转视频,电影感 |

| Kling 2.6 Pro | 视频 | 720p | 运动控制,动画制作 |

| Hailuo 2.3 Fast | 视频 | 720p | 速度优化的图像转视频 |

统一计费与密钥管理

这一点超出了我的预期。分别管理 Runway、Kling、FLUX 和 WAN 的独立 API 密钥——各自有不同的计费面板、不同的速率限制行为、不同的错误格式——在构建 Agentic 工作流时是一笔可观的运维成本。单一密钥、单一计费面板,以及所有模型一致的错误 Schema,是实实在在能改善生活质量的特性,它的价值会随着时间推移体现在你的智能体代码的可维护性上。

在将任何第三方智能体部署到生产环境之前,OWASP 软件供应链安全指南值得一读——尤其是考虑到 2026 年 3 月影响基于 npm 的 Claude Code 安装的供应链事件(claw-code 本身未受影响,但更广泛的生态系统值得警惕)。

局限性与需要验证的事项

如果跳过这些粗糙的边角,我就遗漏了这篇评测中最有价值的部分。

claw-code 稳定性注意事项

截至 2026 年 4 月,claw-code 尚未达到与 Claude Code 的功能对等。Rust 移植版本仍在进行中。IDE 集成不存在——这是纯终端工具。多智能体编排在架构文档中有所描述,但尚未经过大规模实战检验。该项目拥有 48k+ GitHub Stars 且迭代速度很快,但”有趣的架构”和”生产就绪”确实是两个不同的标准。

该项目的法律状态也尚未解决。claw-code 声称洁净室状态是其对抗 Anthropic DMCA 施压的防线——它是重写版,而非泄露源代码的副本——但这一法律问题尚未定论。如果你在为客户或大规模场景构建项目,请将这一不确定性纳入考量。

需要手动验证的内容

在将此工作流用于生产环境之前,你应该手动验证以下内容:

- 轮询超时行为:我使用的 5 秒轮询间隔是保守设置。请使用你实际的视频模型和时长进行测试,以调整

max_wait的值。 - 工具注册:claw-code 的工具注册表仍在积极开发中。具体注册 API 可能在不同提交之间发生变化——在锁定版本之前请检查仓库的

CHANGELOG。 - 权限上下文:claw-code 实现了权限控制的工具执行机制。请确认你的

generate_image和generate_video工具在permissions.py中被授予了正确的访问级别。 - 响应 Schema 变更:WaveSpeed 偶尔会更新模型输出 Schema。请对输出 URL 字段添加验证,而不是假设其结构固定不变。

常见问题

问:claw-code 能原生调用图像生成 API 吗?

开箱即用的话不行——默认安装中没有内置的 WaveSpeed 或图像生成工具。但工具系统正是为这类扩展而设计的。一旦你按照上述方式注册了带有正确 JSON Schema 的自定义工具,智能体就可以在任意会话中自主调用它。

问:claw-code 支持异步工具调用吗?

Python 版本在智能体循环中同步执行工具。对于异步生成(如视频模型),我推荐的模式是:触发初始请求,获取 request_id,然后在工具的 execute 函数内轮询直到完成,再返回给智能体。这样可以保持智能体推理的线性流程,避免会话状态中的竞争条件。

问:这套工作流是否已达到生产就绪状态?

说实话?对大多数团队而言,目前还没有。claw-code 迭代速度很快,但存在法律不确定性,且尚未针对生产规模的 Agentic 使用进行加固。WaveSpeed API 这一侧已经生产就绪——99.99% 可用性 SLA、无冷启动、按秒计费——但包裹它的 claw-code 框架仍处于早期阶段。我目前会将其用于内部工具、原型开发和探索性场景,等项目趋于稳定后再考虑用于面向客户的生产环境。

往期文章: