Claude Opus 4.7: Почему командам ИИ нужен единый уровень API для моделей

Claude Opus 4.7 уже на подходе. Вот почему частые обновления моделей обнажают реальную стоимость прямых API-интеграций — и что команды ИИ делают с этим.

Начнём с главного: самое сложное в Claude Opus 4.7 — не сама модель. Это миграция.

Я — Дора — управляю конвейерами AI-генерации для производственного контента. Изображения, видео, многомодельная оркестрация. Когда Anthropic выпустил Opus 4.6 в феврале, моя команда потратила четыре дня на повторную валидацию промптов, корректировку бюджетов токенов и исправление одного расхождения в счёте, которое всплыло лишь на третий день. Теперь, едва спустя два месяца, Anthropic выпустил Opus 4.7 с новым токенизатором, критическими изменениями API и новым уровнем усилий. Если вы тот человек в команде, который поддерживает слой интеграции с моделями, вы уже чувствуете весомость этого предложения.

В этой статье задокументировано всё подтверждённое об Opus 4.7 на данный момент, реальная стоимость цикла обновлений для инженерных команд и момент, когда математика начинает склоняться в пользу агрегационного слоя вместо прямых API провайдеров.

Что мы знаем о Claude Opus 4.7 (и что пока не подтверждено)

Информация: подтверждённое vs. слухи

Opus 4.7 стал общедоступным 16 апреля 2026 года. Идентификатор модели — claude-opus-4-7. Цены остались прежними: $5 за миллион входных токенов и $25 за миллион выходных токенов — как и у Opus 4.6. Контекстное окно в 1M токенов не изменилось. Максимальный вывод остаётся 128k токенов.

Что изменилось: поддержка высокого разрешения изображений до 3,75 мегапикселей (более чем втрое больше лимита 1,15 МП в 4.6), новый уровень усилий xhigh между high и max, и бюджеты задач для агентных циклов — бета-функция, дающая модели обратный отсчёт токенов на весь многошаговый рабочий процесс.

Критические изменения важнее новых функций. Расширенные бюджеты на размышление удалены. Параметры сэмплирования исчезли. Новый токенизатор обрабатывает тот же текст приблизительно в 1,0–1,35 раза большим числом токенов в зависимости от типа контента. Цена за токен фиксирована, но ваш реальный счёт может вырасти до 35%, даже если вы не изменили ни одного промпта.

Что изменилось с Opus 4.6 на 4.7 — почему это важно для разработчиков

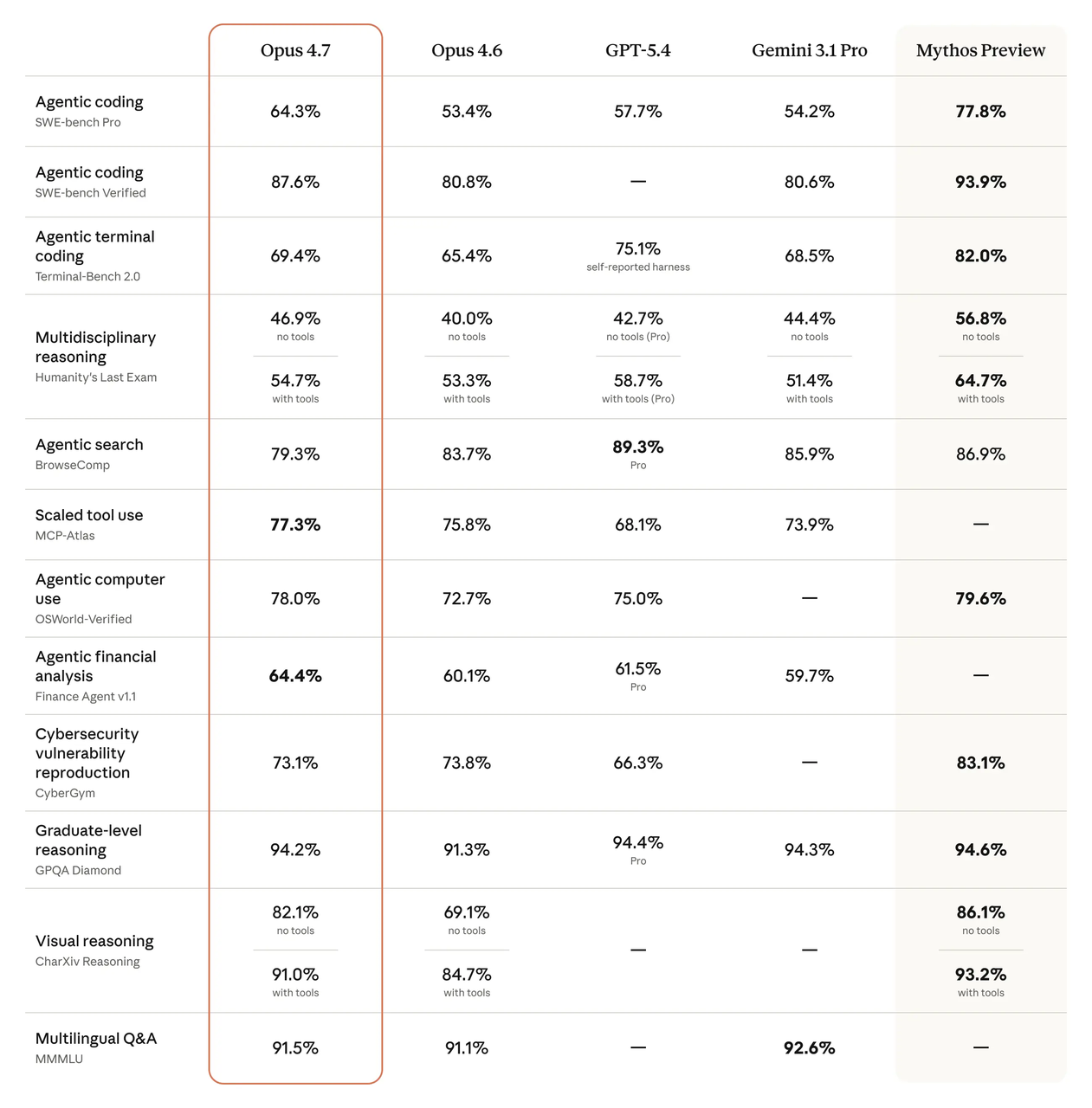

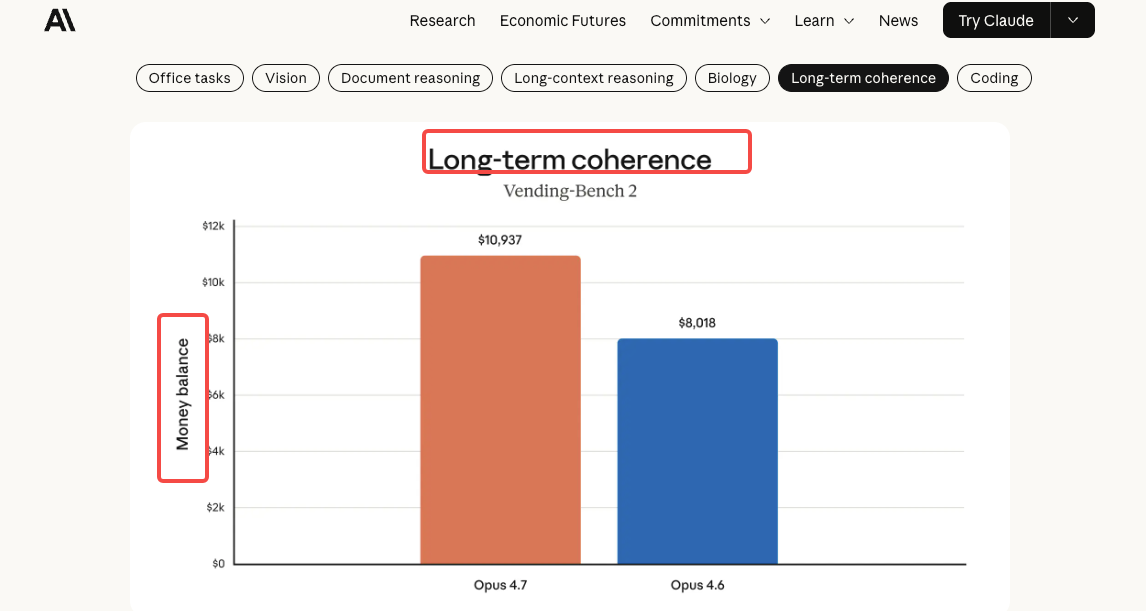

Цифры бенчмарков реальны. SWE-bench Verified вырос с 80,8% до 87,6%. CursorBench — с 58% до 70%. На SWE-bench Pro Opus 4.7 набирает 64,3% — против 53,4% у 4.6 и выше GPT-5.4 с 57,7%.

Но вот что реально влияет на производственные команды: Opus 4.7 следует инструкциям буквальнее. Промпты, которые были «свободными» или разговорными с 4.6, могут давать жёсткие или неожиданные результаты. Если вы неделями настраивали библиотеки промптов, это поведенческое смещение означает повторное тестирование — а не просто замену строки с названием модели.

Настоящая проблема не в новой модели — а в цикле обновлений

Что «новый Claude каждый месяц» реально стоит инженерной команде

Anthropic выпустил Opus 4.5 в ноябре 2025 года. Opus 4.6 — в феврале 2026-го. Opus 4.7 — в апреле 2026-го. Это три основных версии модели за пять месяцев. Каждая принесла изменения параметров, поведенческие сдвиги или критические обновления API.

Инженерная стоимость каждого обновления — не в замене модели. Это цикл валидации. Регрессионное тестирование промптов. Перекалибровка бюджетов токенов. Обновление прогнозов расходов. Интеграционные дымовые тесты на staging и production. В моих рабочих процессах каждая миграция съедает от трёх до пяти инженерных дней — и это у команды, которая проходила через это раньше.

Риск версионирования: когда промпты ломаются после обновления модели

Руководство по миграции для Opus 4.7 открыто об этом. Обновлённый токенизатор означает, что /v1/messages/count_tokens возвращает разные числа для одного и того же ввода. Если в вашей системе жёстко заданы лимиты max_tokens, они теперь могут преждевременно обрезать вывод. Если вы полагались на prefill или параметры сэмплирования — их больше нет.

Я видела, как команды относятся к обновлениям моделей как к обновлению зависимостей — изменяют строку версии, прогоняют тесты, выпускают. Этот подход перестал работать примерно с Opus 4.5.

Кто страдает больше всех: команды с прямым API vs. команды с агрегационным слоем

Команды, вызывающие Anthropic API напрямую, сами поглощают каждое критическое изменение. Команды за агрегационным слоем — middleware, нормализующим API провайдеров в единый интерфейс — поглощают это один раз, централизованно. Разница накапливается. Три обновления провайдера в год у двух-трёх провайдеров — это шесть-девять событий миграции. Агрегационные слои превращают это в обновление конфигурации.

Это не гипотетически. Я поддерживаю интеграции с несколькими провайдерами моделей. Те, что маршрутизируются через единый слой, обновлялись за часы. Прямые — за дни.

Как AI-продуктовые команды структурируют доступ к моделям в 2026 году

Прямой API провайдера: когда это всё ещё имеет смысл

Прямой API выигрывает, когда вам нужен немедленный доступ к новым функциям в день выхода, когда ваша нагрузка использует специфические возможности провайдера (например, бюджеты задач Opus 4.7), или когда вы настолько глубоко погружены в одного провайдера, что стоимость переключения фактически равна нулю — потому что вы не переключаетесь.

Если весь ваш продукт построен на Claude и только Claude, и у вас есть инженерная пропускная способность, чтобы поглощать квартальные критические изменения, прямой API — всё ещё прямолинейный путь.

Агрегационный слой: когда математика переворачивается

Точка перегиба — многомодельное использование в сочетании с частыми обновлениями провайдеров. Как только вы вызываете Claude для рассуждений, другую модель для классификации и третью для эмбеддингов — и каждый провайдер выпускает критические изменения по собственному расписанию — накладные расходы на координацию начинают съедать реальное инженерное время.

По прогнозу Gartner, около 40% корпоративных приложений внедрят специализированных AI-агентов к концу 2026 года. Каждый агент может вызывать разную модель. Управление этим через прямые API провайдеров не ошибочно — просто дорого в тех деньгах, которые отображаются как инженерные часы, а не в счёте.

Чеклист оценки перед миграцией на любую новую версию Claude

Перед заменой claude-opus-4-6 на claude-opus-4-7 в production у меня есть короткий список: тестирование влияния токенизатора (прогоните реальные промпты через count_tokens на обеих версиях и сравните), регрессия поведения промптов (изменение в буквальных инструкциях проявится здесь), обновление прогноза расходов (увеличение токенов в 1,0–1,35 раза зависит от контента — измеряйте на своих данных, не на средних значениях Anthropic) и аудит зависимостей от функций (проверьте, используете ли вы что-то из удалённого или изменённого).

Если ваша команда не может сделать это меньше чем за день — это сигнал о вашей архитектуре, а не о модели.

За чем следить после официального выхода Opus 4.7

График доступности API и уровни доступа

Opus 4.7 уже работает через API Claude, Amazon Bedrock, Google Cloud Vertex AI и Microsoft Foundry. Планы Claude Pro, Max, Team и Enterprise имеют доступ. Лимиты запросов объединены между версиями Opus, так что вы можете запускать трафик 4.6 и 4.7 параллельно во время миграции.

Цены по сравнению с 4.6 — подтверждённое vs. предположительное

Прайс-лист идентичен. $5/$25 за миллион токенов. Кэширование промптов по-прежнему даёт экономию до 90%; пакетная обработка — скидку 50%. Но изменение токенизатора означает, что фактическая стоимость промпта выше — насколько выше, зависит от вашего контент-микса. Плотный код? Ожидайте ближе к 1,35x. Короткие разговорные промпты? Ближе к 1,0x.

Одно из того, за чем я всё ещё слежу: сообщается, что новый токенизатор Opus 4.7 по-другому обрабатывает многоязычный контент. Для команд, массово обрабатывающих текст не на английском языке, раздувание токенов может быть даже выше 35%. Пока у меня недостаточно данных по этому вопросу.

Сигналы совместимости: контекстное окно, использование инструментов, структурированный вывод

Контекстное окно: 1M токенов, без изменений. Использование инструментов: тот же набор, что в 4.6 — bash, выполнение кода, управление компьютером, текстовый редактор, веб-поиск, коннектор MCP. Структурированный вывод: поддерживается. В системной карте Opus 4.7 отмечено, что модель тщательнее самостоятельно проверяет выводы, а значит, часть существующих каркасов промптов («проверь макет слайда перед возвратом») можно убрать.

Стоит отметить связь с Claude Mythos: Opus 4.7 явно позиционируется как испытательный стенд для средств защиты, которые Anthropic в конечном итоге хочет развернуть на моделях класса Mythos. Opus 4.7 несёт автоматизированное обнаружение кибер-использования, которого в Mythos Preview нет в той же форме. Это не имеет прямого отношения к API-интеграции — но сигнализирует о направлении дорожной карты моделей Anthropic.

Часто задаваемые вопросы

Доступен ли Claude Opus 4.7 через API уже сейчас?

Да. Он стал общедоступным 16 апреля 2026 года. Идентификатор модели — claude-opus-4-7. Доступен через прямой API Anthropic, Amazon Bedrock, Google Vertex AI и Microsoft Foundry.

Как цены на Opus 4.7 соотносятся с Opus 4.6?

Прайс-лист идентичен: $5 за миллион входных токенов, $25 за миллион выходных токенов. Но обновлённый токенизатор может увеличить фактическое число токенов до 35%, то есть одинаковый промпт может стоить дороже при запуске на 4.7, чем на 4.6.

Могу ли я запускать Claude Opus 4.7 через сторонний inference API?

Да. Несколько агрегационных платформ и маршрутизационных слоёв поддерживают Opus 4.7. Ключевой вопрос — открывает ли сторонний слой специфические для 4.7 функции, такие как бюджеты задач и уровень усилий xhigh, или только пропускает стандартные завершения.

В чём разница между Claude Opus 4.7 и Claude Mythos?

Mythos Preview — самая мощная модель Anthropic, ограниченная избранными партнёрами в рамках Project Glasswing для работ по защитной кибербезопасности. Opus 4.7 находится в общем доступе и несёт автоматизированные средства защиты, которые Anthropic тестирует перед возможным расширением доступа к моделям класса Mythos. Это разные уровни возможностей с разными моделями доступа.

Должна ли моя команда ждать Opus 4.7 или оставаться на 4.6 для production?

Если ваши промпты проверены боем на 4.6 и система работает хорошо — не торопитесь. Тестируйте 4.7 на небольшой части трафика, измеряйте влияние токенизатора и изменения в поведении промптов, затем мигрируйте поэтапно. Модель лучше — но миграция не бесплатна.

Я всё ещё запускаю 4.6 и 4.7 параллельно в своих конвейерах. Выигрыш в бенчмарках реален — но и повторная настройка промптов тоже. Через одну-две недели у меня будет больше данных о том, компенсирует ли дополнительная нагрузка от токенизатора выигрыш в эффективности от меньшего числа вызовов инструментов. Этот вопрос пока открыт.

Предыдущие публикации: