Tarifs GPT Image 2 en 2026 : Ce que paient les équipes

Comprenez les tarifs de GPT Image 2 en 2026, notamment les coûts par image, la tarification des images basée sur les tokens, les coûts d'édition et ce que les équipes doivent prévoir pour une utilisation en production.

J’ai reconstruit ma feuille de calcul de tarification trois fois la semaine dernière. À chaque fois, le coût par image était différent, et à chaque fois j’utilisais le même modèle — gpt-image-2. Le problème n’était pas le calcul. Le problème, c’est que je continuais à traiter GPT Image 2 comme s’il avait un prix fixe, alors qu’il possède en réalité un système de facturation. Il y a une différence significative entre ces deux choses, et c’est dans cet écart que les budgets de la plupart des équipes commencent à fuir en silence.

Je m’appelle Dora. Je passe plus de temps que je ne le voudrais à lire des pages de tarification. La plupart de ce que j’écris découle d’une tentative de répondre à une seule question pour une équipe produit ou un partenaire financier : combien ça va réellement nous coûter à notre volume ? Cet article est la version de cette réponse que j’aurais aimé avoir il y a deux semaines, quand une designer de mon équipe m’a demandé si nous pouvions nous permettre de générer 200 variantes de publicités par semaine et que j’ai répondu “probablement” — ce qui s’est avéré être une erreur de 40 % dans un sens ou dans l’autre selon le jour.

Si vous essayez de chiffrer la “génération d’images” dans une ligne budgétaire 2026, voici comment le modèle facture réellement, où les coûts se cachent, et ce que les équipes en production ont tendance à payer.

Fonctionnement de la tarification de GPT Image 2

Tarification par image vs tarification d’images basée sur les tokens

GPT Image 2 est vendu de deux façons, et les confondre est la méthode la plus rapide pour faire exploser vos prévisions.

La première façon est celle destinée aux consommateurs : ChatGPT Plus à 20 $/mois, Pro à 200 $/mois, ou le niveau gratuit avec des limites de débit. C’est forfaitaire. Vous ne pensez pas au coût par image. Vous atteignez une limite d’utilisation ou non.

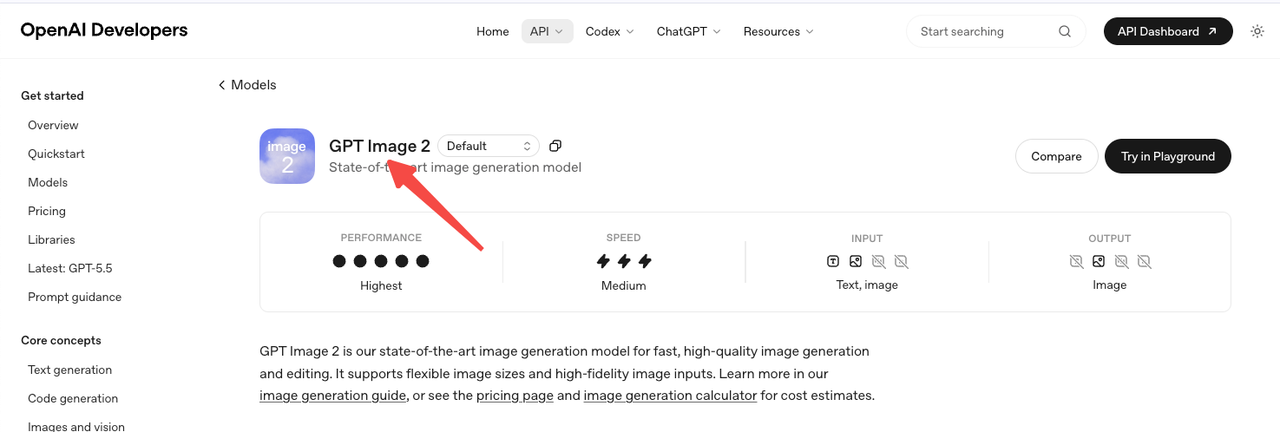

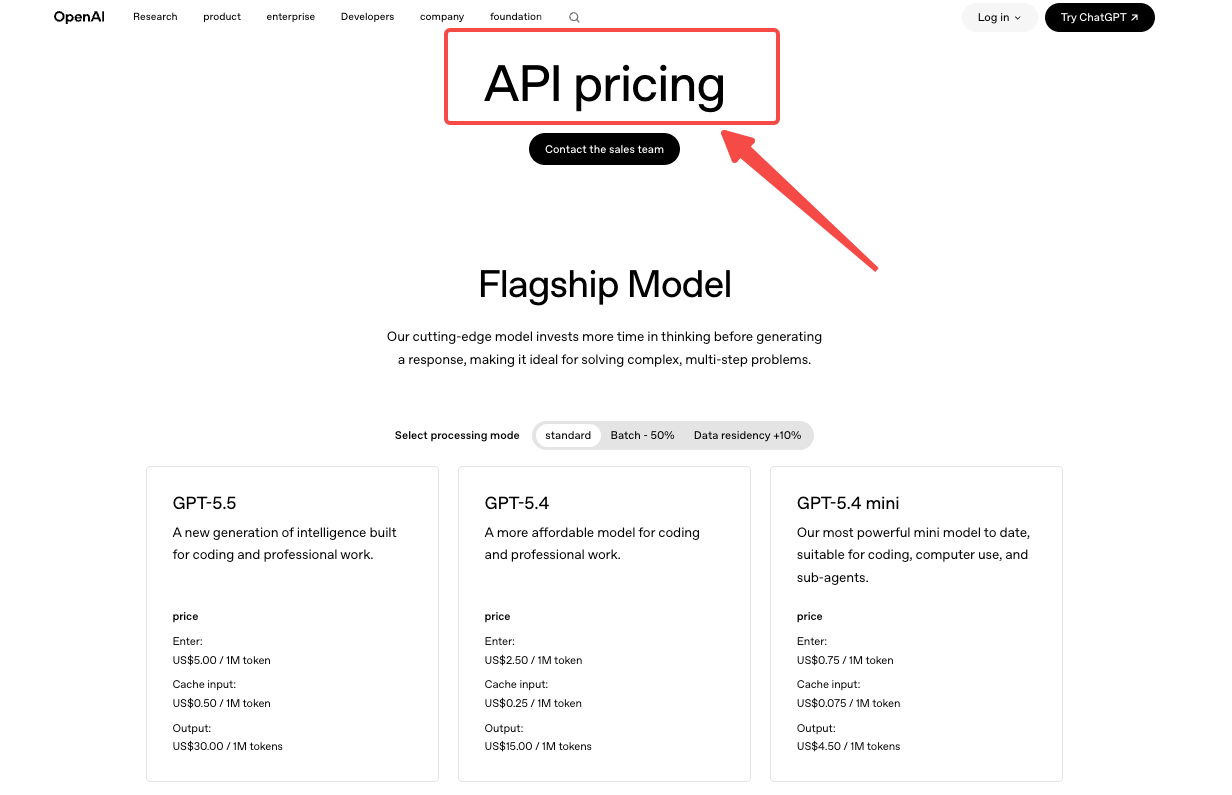

La deuxième façon est l’API, et l’API est basée sur les tokens, pas sur les images. Selon la page de tarification de l’API OpenAI, gpt-image-2 facture 8,00 $ par million de tokens d’entrée d’image, 2,00 $ par million de tokens d’entrée d’image mis en cache, 30,00 $ par million de tokens de sortie d’image, plus 5,00 $ par million de tokens d’entrée de texte. Les chiffres “par image” que vous voyez cités dans les articles — 0,006 $, 0,053 $, 0,211 $ — sont des estimations dérivées de la calculatrice, et non des prix catalogue.

Cette distinction est importante car la consommation de tokens n’est pas constante. Elle varie selon la taille, la qualité, les modifications et la précision de votre prompt. Une équipe qui pense payer 0,05 $ par image découvre souvent, trois semaines plus tard, que son coût moyen réel est de 0,11 $.

Ce qui change avec les paramètres de taille et de qualité

La qualité est le principal levier. Selon la calculatrice référencée dans le guide de génération d’images OpenAI, une sortie 1024×1024 coûte environ 0,006 $ en qualité basse, 0,053 $ en qualité moyenne et 0,211 $ en haute qualité. C’est un écart de 35x pour la même taille de canvas. Passez à 1024×1536 (portrait) et les mêmes niveaux de qualité donnent environ 0,005 $, 0,041 $ et 0,165 $ — légèrement moins cher, ce qui semble contre-intuitif jusqu’à ce qu’on l’accepte.

La taille ne fait pas non plus évoluer la facture de manière prévisible. La 4K via des hébergeurs tiers comme fal.ai grimpe à environ 0,41 $ par image en haute qualité. Ce sont des chiffres réels, mais pas des chiffres “officiels OpenAI” — surface différente, contrat différent.

Les vrais facteurs de coût que les équipes manquent

Entrées de modification, nouvelles tentatives et grandes tailles de sortie

Voici la partie dont la page de tarification ne parle pas ouvertement, et qui m’a coûté deux jours de confusion.

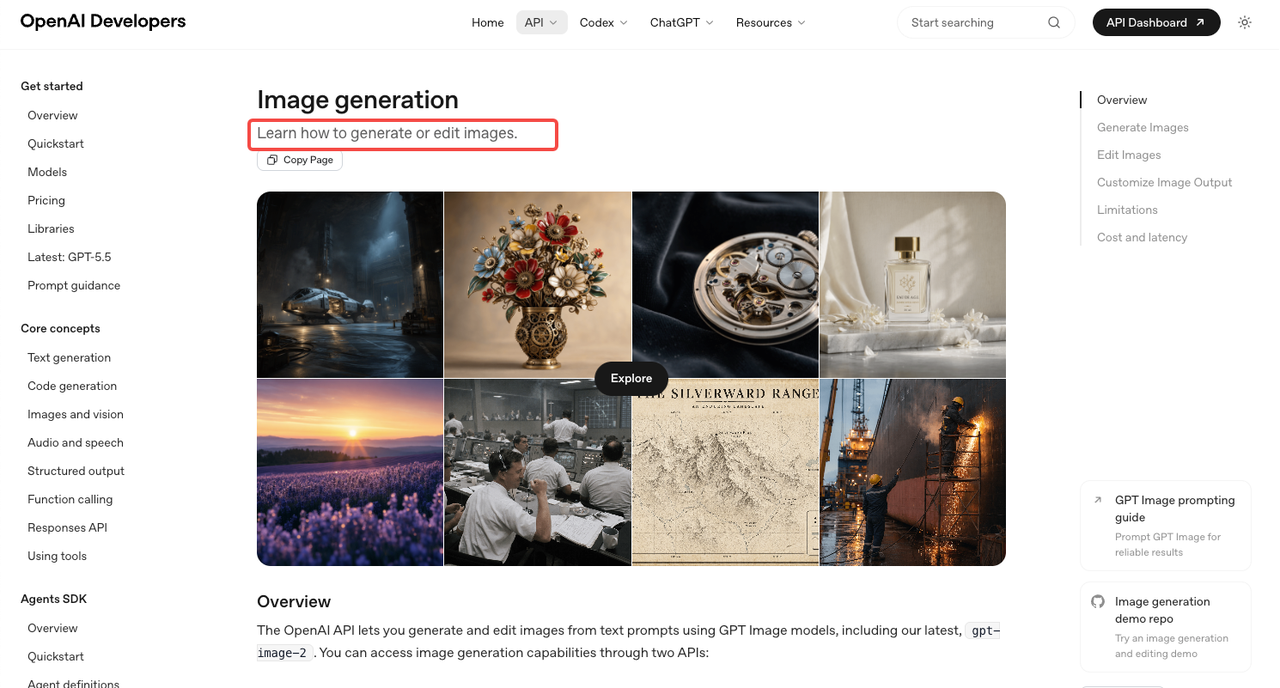

Lorsque vous envoyez une demande de modification — c’est-à-dire que vous transmettez une image de référence — gpt-image-2 traite cette entrée en haute fidélité. Vous ne pouvez pas désactiver cela. Le guide officiel de génération d’images est explicite : le paramètre input_fidelity est verrouillé, et chaque image de référence est facturée au tarif d’entrée haute fidélité, quel que soit le niveau de qualité défini pour la sortie.

Traduction pratique : si votre flux de travail ressemble à “générer, puis modifier quatre fois jusqu’à obtenir le bon résultat”, votre coût réel par actif final est plus proche de 2 à 3 fois le prix par image annoncé. Une équipe qui fait des maquettes de produits, du travail de cohérence de personnages ou des variantes de publicités — quiconque itère sur des références téléchargées — entre dans cette catégorie, qu’elle en soit consciente ou non.

Les nouvelles tentatives s’accumulent de la même façon. Une image de qualité moyenne à 0,053 $ est bon marché. Le même prompt exécuté cinq fois parce que les quatre premières tentatives étaient ratées coûte 0,265 $, et vous n’en avez gardé qu’une. Le taux d’échec est un vrai poste de dépense que personne ne place dans sa comparaison de tarification.

Génération d’ébauches vs génération d’actifs finaux

La façon la plus efficace de contrôler les coûts que j’ai trouvée est de séparer l’exploration de la livraison. Utilisez la qualité basse pour l’idéation — à 0,006 $ par image, vous pouvez tester 30 variations de prompts pour moins de vingt centimes. Puis générez uniquement les gagnants en haute qualité. Selon la couverture du lancement par The Decoder, le bond de qualité du modèle par rapport à GPT Image 1.5 est réel mais inégal selon les tailles, ce qui rend l’approche “ébauche économique, finalisation coûteuse” réellement viable plutôt qu’un argument marketing.

L’autre levier : l’API Batch réduit de 50 % les tarifs des tokens d’entrée et de sortie si vous pouvez tolérer jusqu’à 24 heures de latence. Pour les publications de contenu hebdomadaires, c’est de l’argent gratuit. Pour les flux produit en temps réel, ce n’est pas une option.

Budgétiser GPT Image 2 pour les flux de travail d’équipe

Je ne fais pas confiance aux projections de coûts mensuels qui proviennent uniquement d’une calculatrice. Le calcul que je fais réellement ressemble à ceci :

- Coût de base par image à la qualité et la taille que vous utiliserez en production

- Multiplié par votre taux de nouvelles tentatives (le mien tourne autour de 1,4x pour la qualité moyenne, 1,8x pour la haute qualité)

- Ajout des frais de modification si des images de référence font partie du flux — prévoir 30 à 60 % supplémentaires

- Soustraction des économies Batch pour toute charge de travail ne nécessitant pas de réponse synchrone

Une petite équipe marketing générant 200 images sociales de qualité moyenne par mois, avec peu de modifications, se retrouve quelque part entre 15 et 25 $/mois en coût API brut. Le même volume en haute qualité avec une forte itération donne entre 80 et 140 $/mois. Aucun de ces chiffres n’est le chiffre de la calculatrice, et aucun n’apparaît sur la page de tarification. Ce sont les chiffres que je vois quand j’exporte la facturation.

L’important n’est pas les chiffres spécifiques — votre flux de travail les fera bouger. L’important est que le “coût par image” tel que publié est une ligne de départ, pas une ligne d’arrivée.

Quand la tarification directe est suffisamment simple et quand elle ne l’est pas

Pour un usage occasionnel, ChatGPT Plus à 20 $/mois est probablement la bonne réponse et vous pouvez arrêter de lire. Les calculs ne favorisent pas l’API avant d’avoir dépassé environ 400 images de qualité moyenne par mois, ou d’intégrer la génération d’images dans un produit où l’accès par abonnement ne s’applique pas.

Là où la tarification directe cesse d’être simple : tout flux de travail avec des entrées d’images de référence, tout flux produit avec un volume d’utilisateurs imprévisible, tout ce qui implique le mode Thinking (qui ajoute une charge variable de tokens de raisonnement non publiée comme un chiffre net par image), et tout ce que vous prévoyez d’héberger via un tiers comme l’endpoint gpt-image-2 de fal.ai, où la tarification appartient au fournisseur et est structurellement différente de la facturation d’OpenAI.

Pour toute personne dans ces catégories, la démarche budgétaire honnête est un pilote d’une semaine avec journalisation des coûts à chaque appel. La calculatrice convient pour une vérification de cohérence. Elle ne convient pas pour s’engager sur un trimestre de dépenses.

FAQ

Combien coûte GPT Image 2 par image ?

Il n’y a pas un seul chiffre. Via l’API, une image 1024×1024 en qualité basse coûte environ 0,006 $, en qualité moyenne environ 0,053 $, et en haute qualité environ 0,211 $ — ce sont des estimations de la calculatrice d’OpenAI, pas des prix catalogue. Le coût réel dépend de la taille, des modifications et des nouvelles tentatives.

Les modifications sont-elles plus coûteuses que les générations fraîches ?

Oui, souvent substantiellement. gpt-image-2 traite toujours les images de référence en haute fidélité, ce qui ajoute des tokens d’entrée d’image à chaque demande de modification. Les flux de travail à forte modification peuvent coûter 2 à 3 fois le tarif de base par image.

Quels paramètres augmentent les coûts le plus rapidement ?

Dans l’ordre : le niveau de qualité (écart de 35x du bas vers le haut), la taille de sortie en haut de gamme (la 4K via des tiers atteint environ 0,41 $/image), et les entrées d’images de référence lors des modifications. Les paramètres output_format et de compression ne font pas bouger la facture.

Comment les équipes doivent-elles estimer leurs dépenses mensuelles ?

Faites un pilote d’une semaine à la qualité et à la taille que vous utiliserez réellement. Journalisez chaque appel. Multipliez le coût hebdomadaire par 4,3 et ajoutez une marge pour les nouvelles tentatives. La page du modèle gpt-image-2 renvoie vers la calculatrice officielle, qui convient pour la planification mais sous-estime les frais de modification.

Puis-je réduire les coûts sans changer la qualité ?

Oui — l’API Batch divise par deux les tarifs des tokens si vous pouvez tolérer une latence de 24 heures, et les entrées de texte mises en cache passent de 5,00 $ à 1,25 $ par million de tokens lorsque les prompts sont réutilisés. Les deux s’additionnent.

Conclusion

GPT Image 2 n’est pas cher. C’est simplement facturé d’une façon qui pénalise quiconque le traite comme un produit à prix fixe. Les chiffres par image dans les titres sont réels, mais ils décrivent une requête spécifique — synchrone, sans modifications, sans nouvelles tentatives, taille intermédiaire. La facture que vous payez réellement est façonnée par le flux de travail que vous utilisez réellement.

La seule habitude qui vaut la peine d’acquérir : journalisez une vraie semaine d’appels avant de vous engager sur un budget. La calculatrice vous mettra dans le bon quartier. Votre export de facturation vous dira l’adresse exacte.

Articles précédents :