Intercambio de Rostros en Video Explicado: Cómo Funciona + Guía de API

Cómo funciona el intercambio de rostros en video por dentro — y cómo llamarlo mediante API. Cubre el pipeline completo, los requisitos de entrada y los modos de fallo más comunes.

Hola, soy Dora. Seré honesta — la primera vez que intenté llamar a una API de intercambio de caras en video, obtuve una respuesta que parecía casi correcta. La cara estaba ahí. El tiempo estaba desfasado medio segundo. La iluminación hacía que el sujeto pareciera que brillaba levemente desde dentro, como un fantasma de descuento.

Eso es lo que tiene la tecnología de intercambio de caras en video. Parece simple desde afuera — intercambiar la cara A en el cuerpo B, listo — pero en el momento en que vas más allá de los clips de demostración e intentas construir algo real, te das cuenta de cuántas piezas en movimiento están ocurriendo bajo el capó. Entender esas piezas es la diferencia entre un resultado que se ve pulido y uno que hace que tus usuarios se estremezcan.

Esta guía cubre cómo funciona realmente el intercambio de caras en video, los diferentes enfoques que existen, qué necesita tu API antes de poder hacer algo útil, y cómo manejar los modos de falla que inevitablemente te encontrarás tarde o temprano.

Qué Hace Realmente el Intercambio de Caras en Video

Déjame explicar esto con claridad, porque muchos tutoriales omiten la parte que realmente importa.

El intercambio de caras en video no es un filtro. No es una máscara superpuesta sobre el metraje. Lo que hace — a un nivel bastante profundo — es detectar una cara en cada fotograma de un video, mapear su geometría, extraer la identidad de una cara fuente, y mezclar la identidad fuente sobre la estructura facial del objetivo mientras preserva el movimiento, la iluminación y la expresión del objetivo.

Son tres problemas distintos que ocurren en secuencia.

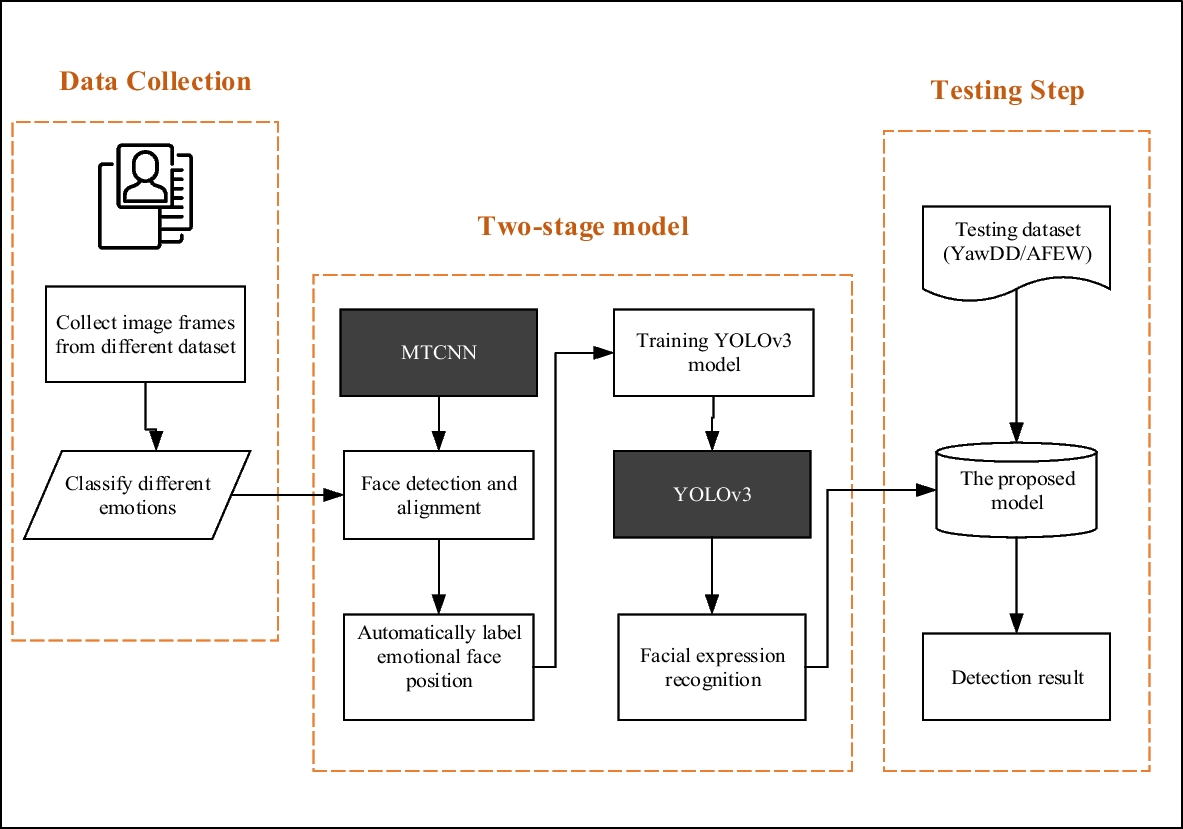

Pipeline de Detección → Alineación → Fusión

La detección es donde el modelo encuentra caras en el fotograma. Esto suena fácil. No lo es. Las caras que están parcialmente ocluidas, giradas en ángulos pronunciados, o moviéndose rápidamente generan fallos de detección. La mayoría de los sistemas de producción usan variantes de redes convolucionales en cascada multitarea — puedes leer sobre el enfoque fundamental MTCNN en esta guía de aprendizaje profundo para detección de caras — aunque arquitecturas más recientes han mejorado significativamente esos primeros benchmarks.

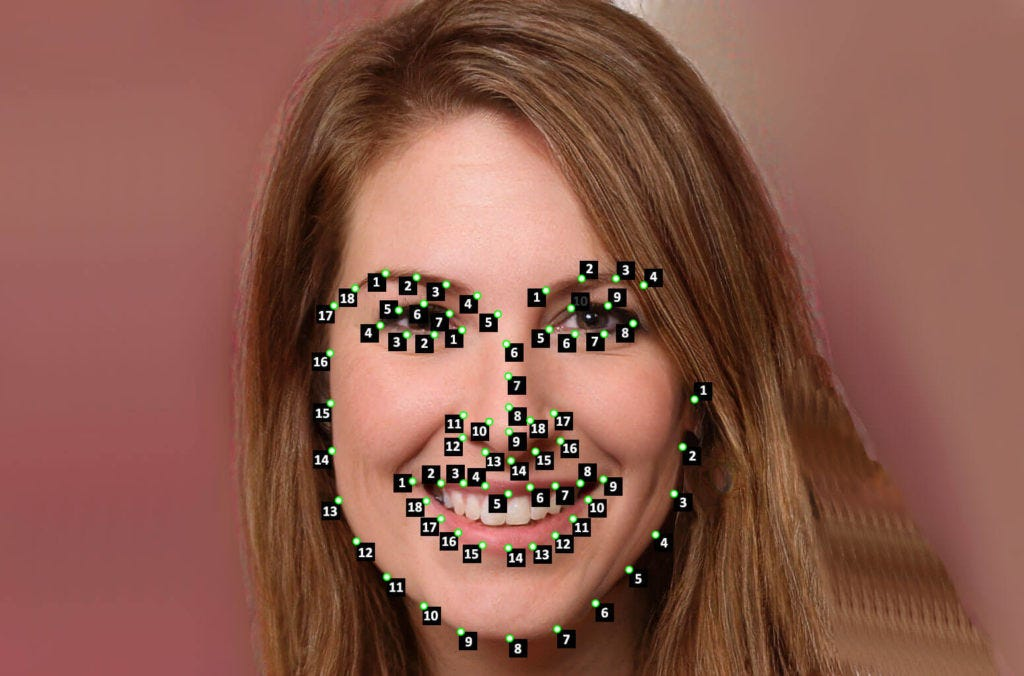

La alineación es el paso en el que la mayoría de la gente no piensa, pero es genuinamente crítico. Una vez que se detecta una cara, el modelo identifica los puntos de referencia faciales — ojos, punta de la nariz, comisuras de la boca — y los usa para normalizar la cara a una posición y escala canónicas. Sin esto, el intercambio parece que alguien puso una cara en un ángulo ligeramente incorrecto y esperó que nadie lo notara. Siempre lo notan.

La fusión es donde ocurre la transferencia de identidad real. El modelo toma las características de identidad de la cara fuente, las proyecta sobre la geometría de la cara objetivo, y compone el resultado de vuelta en el fotograma. Los enfoques modernos usan redes generativas adversariales (GANs) para esto — un generador que crea la cara fusionada y un discriminador que evalúa el realismo — por eso entender cómo funciona la generación de deepfakes basada en GANs es un contexto genuinamente útil antes de empezar a depurar el resultado.

Qué Significa Realmente la Calidad del Resultado

Aquí hay algo que me confundió al principio: la “calidad” en el resultado del intercambio de caras no es un solo número. Son al menos tres cosas separadas.

Preservación de identidad — ¿el resultado realmente se parece a la cara fuente, y no solo a un promedio borroso de ambas?

Consistencia temporal — ¿la cara se ve igual en todos los fotogramas, o parpadea sutilmente?

Fotorrealismo — ¿el resultado parece pertenecer a la escena, o parece compuesto?

Puedes tener una excelente preservación de identidad y una terrible consistencia temporal. Puedes tener un fotorrealismo hermoso con una transferencia de identidad deficiente. La mayoría de las APIs exponen configuraciones o niveles de calidad que intercambian entre estas. Saber cuál importa para tu caso de uso te ahorrará mucha confusión.

Tipos de Enfoques de Intercambio de Caras en Video

No todos los modelos de intercambio de caras en video funcionan de la misma manera. Existen diferencias arquitectónicas similares en modelos modernos de generación de video con IA como Seedance 2.0, donde la consistencia temporal y el modelado de movimiento se manejan de manera muy diferente según el enfoque. Hay dos ejes importantes que entender antes de elegir una herramienta o API.

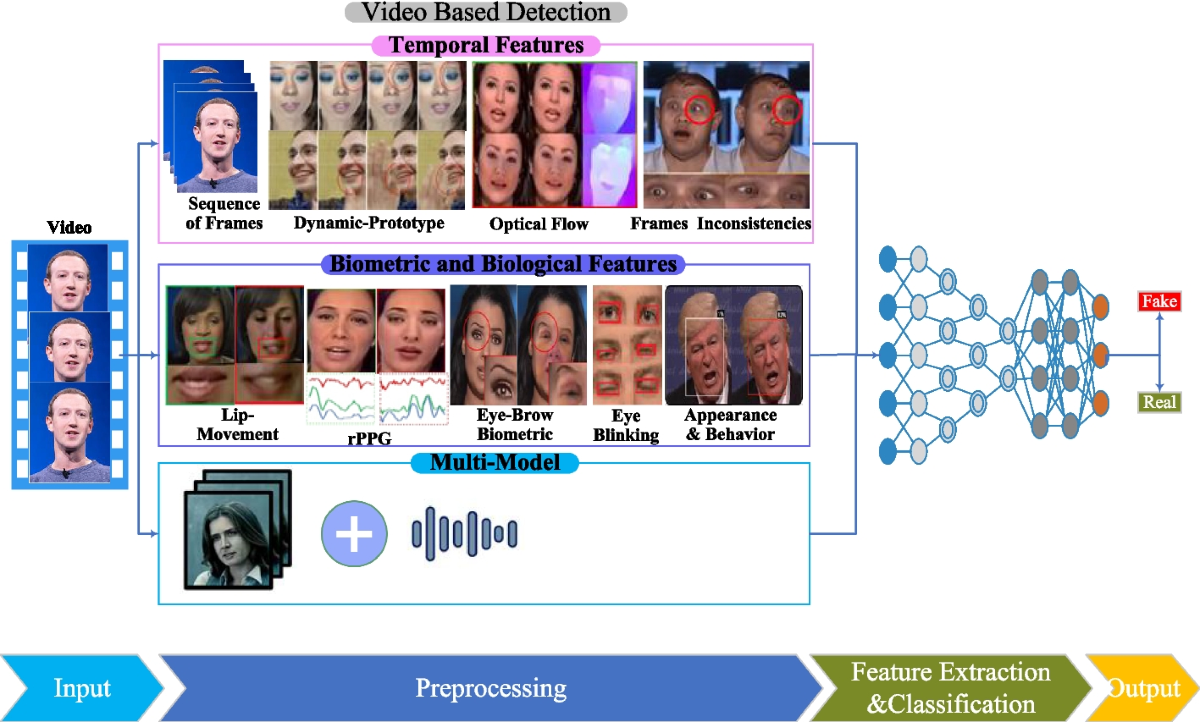

Modelos Fotograma a Fotograma vs. Modelos con Consciencia Temporal

Los modelos fotograma a fotograma tratan cada fotograma del video de forma independiente. Generalmente son más rápidos y simples de implementar, pero no tienen en cuenta el hecho de que el video es una secuencia de imágenes relacionadas. El resultado: parpadeo sutil entre fotogramas, especialmente alrededor de los bordes de la cara o en condiciones de poca luz.

Los modelos con consciencia temporal procesan los fotogramas con conocimiento de lo que vino antes y después — esencialmente comprendiendo el movimiento y manteniendo la consistencia a lo largo del clip. Compensaciones similares aparecen en comparaciones entre los modelos de video con IA líderes, donde la estabilidad y el realismo del movimiento son grandes diferenciadores — esencialmente comprendiendo el movimiento y manteniendo la consistencia a lo largo del clip. El resultado es más suave y estable, pero estos modelos son más pesados y lentos. Para cualquier cosa de más de unos pocos segundos o destinada a visualizarse en pantalla completa, el costo de latencia de los modelos con consciencia temporal vale la pena.

Mi experiencia honesta: si estás prototipando o generando miniaturas, fotograma a fotograma está bien. Si estás construyendo algo que la gente verá en una pantalla de tamaño completo, te arrepentirás del parpadeo.

Cara Única vs. Múltiples Caras

Los modelos de cara única son más simples y generalmente de mayor calidad para su tarea específica. Si tu caso de uso involucra una cara claramente visible en el fotograma — lo que cubre la mayoría de los escenarios de producción — este es el punto de partida correcto.

Los modelos de múltiples caras pueden detectar e intercambiar varias caras en un solo fotograma. Son útiles para tomas de conjunto, metraje de grupo, o escenarios donde no controlas completamente el video de entrada. La compensación es que son computacionalmente más costosos y más propensos a la asignación incorrecta de caras — es decir, el modelo intercambia la cara equivocada en el cuerpo equivocado. Vale la pena saberlo antes de enviar un clip de cuatro personas y recibir algo involuntariamente surrealista.

Antes de Llamar a la API: Lo que Necesitas

Aquí es donde la mayoría de la gente pierde tiempo. No porque la API sea difícil, sino porque los requisitos de entrada son más específicos de lo que la documentación generalmente deja claro.

Requisitos de Entrada (Formato, Resolución, Duración del Clip)

La mayoría de las APIs de intercambio de caras en video esperan:

- Formato de video: MP4 con codificación H.264 es el valor predeterminado más seguro. Algunas APIs también aceptan WebM o MOV, pero H.264/MP4 es el más universalmente compatible.

- Resolución: 720p es el mínimo práctico para una calidad de intercambio aceptable. 1080p le da al modelo más detalle facial con qué trabajar. Por debajo de 480p, la mayoría de los modelos comienzan a producir artefactos visibles — la región de la cara simplemente no tiene suficientes píxeles para una fusión limpia.

- Duración del clip: Muchas APIs limitan el procesamiento síncrono a 30–60 segundos. Los clips más largos requieren envío de trabajos asíncronos con callbacks de webhook. Sabe en qué categoría caen tus clips antes de diseñar el manejo de solicitudes.

- Imagen fuente: Para la cara que estás intercambiando, una sola foto frontal bien iluminada suele ser suficiente. Algunos modelos también aceptan fuentes de video, pero una imagen fija clara con iluminación uniforme típicamente produce una transferencia de identidad más consistente.

Restricciones de Ángulo Facial e Iluminación

Una verificación rápida de la realidad aquí: los modelos no son magia.

Ángulo facial: La mayoría de los modelos funcionan bien hasta aproximadamente 30–35 grados fuera del eje desde una vista frontal. Más allá de eso, empiezas a perder precisión en los puntos de referencia, lo que se traduce en errores de alineación, que producen artefactos de fusión. Los perfiles generalmente no son compatibles o producen resultados inutilizables. Si tu metraje fuente tiene sujetos que frecuentemente miran hacia otro lado de la cámara, modera tus expectativas de calidad en consecuencia.

Iluminación: La iluminación direccional intensa — caras iluminadas lateralmente, iluminación cenital fuerte que crea sombras profundas en los ojos — es más difícil de manejar de manera convincente en el paso de fusión. El modelo necesita reconciliar la iluminación en la cara fuente con la iluminación en el fotograma objetivo, y cuanto menos coincidan, más visible será la costura.

No digo que evites el metraje oscuro. Digo: si estás generando material fuente y tienes algún control sobre él, la iluminación uniforme mejorará significativamente tu resultado.

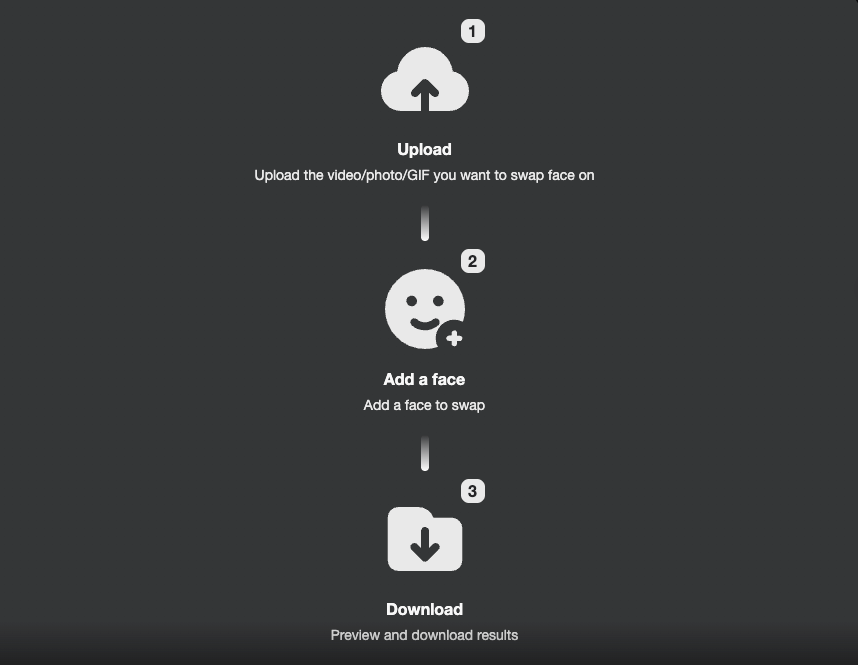

Flujo de Trabajo de la API Paso a Paso

Seamos prácticos. Este es el flujo típico para una llamada a la API de intercambio de caras en video.

Autenticación

Casi todas las APIs de producción usan autenticación con token de portador. Recibirás una clave API en el registro, y la pasas como encabezado:

Authorization: Bearer YOUR_API_KEYEsta es una práctica estándar y se alinea con las pautas de seguridad de recursos como el OWASP REST Security Cheat Sheet. Algunas cosas que vale la pena hacer desde el principio:

- Almacena tu clave API como variable de entorno, nunca codificada en tu base de código

- Configura la rotación de claves — la mayoría de las APIs te permiten regenerar claves sin perder el acceso a la cuenta

- Si está disponible, usa claves con alcance que solo tengan los permisos que tu integración realmente necesita

Enviando la Solicitud

Un cuerpo de solicitud típico se ve algo así:

{

"source_image_url": "https://your-storage.com/source-face.jpg",

"target_video_url": "https://your-storage.com/target-video.mp4",

"output_format": "mp4",

"quality": "high"

}Algunas APIs aceptan cargas de archivos binarios directamente a través de formularios multipart. Otras solo aceptan URLs que apuntan a archivos de acceso público. Verifica con cuidado la documentación de tu API al respecto — es una fuente común de fallos silenciosos donde la API devuelve 200 pero no procesa nada porque la URL del archivo era inaccesible.

Para clips más largos, normalmente recibirás un ID de trabajo en lugar del resultado directamente:

{

"job_id": "fswap_a3b92f",

"status": "processing",

"estimated_time_seconds": 45

}Manejo del Resultado

Sondea el endpoint de estado del trabajo o configura un webhook para recibir el resultado cuando el procesamiento se complete. La respuesta incluirá una URL de descarga para el video procesado. Estas URLs generalmente tienen un tiempo limitado — descarga y almacena el resultado en tu propio almacenamiento dentro de la ventana de vencimiento, que generalmente es de 1–24 horas según el proveedor.

No asumas que el resultado es perfecto solo porque el estado es completado. Siempre verifica algunos fotogramas al azar. El estado completado significa que el pipeline se ejecutó sin fallar. No significa que el intercambio se vea bien.

Para sistemas de producción, construir una integración sólida con la API REST alrededor de estos patrones asíncronos — manejo adecuado de errores, lógica de reintentos, verificación de webhooks — te ahorrará una dolorosa sesión de depuración más adelante.

Modos de Falla Comunes y Soluciones

Aquí es donde las cosas se ponen reales. He experimentado los tres.

Problemas de Movimiento

Cómo se ve: La cara intercambiada tiembla o “salta” entre fotogramas, un problema muy similar a los problemas discutidos en guías sobre cómo los creadores corrigen el parpadeo y el temblor en video generado por IA.

Por qué ocurre: Procesamiento fotograma a fotograma sin suavizado temporal. Cada fotograma se resuelve de forma independiente, por lo que ligeras variaciones en la detección de puntos de referencia crean inconsistencia.

Solución: Cambia a un modelo con consciencia temporal si está disponible. Si estás limitado a una API fotograma a fotograma, algunos proveedores ofrecen un paso de estabilización de postprocesamiento — búscalo en tus opciones. Alternativamente, preprocesar tu video de entrada con estabilización de movimiento antes de enviarlo a la API puede ayudar.

Deriva de Identidad

Cómo se ve: La cara del resultado gradualmente empieza a parecerse menos a la fuente y más a alguna mezcla de fuente y objetivo — o simplemente a alguien de aspecto promedio.

Por qué ocurre: Generalmente un problema de calidad de la imagen fuente. Si la foto de la cara fuente es de baja resolución, está mal iluminada o fue capturada en un ángulo no frontal, el modelo no puede extraer características de identidad confiables. Rellena los huecos con lo que puede inferir, lo que a menudo deriva hacia la cara objetivo.

Solución: Usa una imagen fuente de mayor calidad. Frontal, iluminación uniforme, al menos 512×512px en la región de la cara. Este único cambio resuelve la deriva de identidad en quizás el 80% de los casos en mi experiencia.

Desajuste de Iluminación

Cómo se ve: La cara intercambiada parece “pegada” — la dirección de la iluminación o la temperatura del color de la cara no coincide con la escena circundante.

Por qué ocurre: El modelo de fusión intenta armonizar la iluminación pero solo puede hacer tanto. Las grandes diferencias entre la iluminación en la imagen fuente y el video objetivo desafían el paso de composición.

Soluciones:

- Si tienes control sobre la imagen fuente, fotografíala en condiciones de iluminación similares a tu metraje objetivo

- Algunas APIs ofrecen normalización de iluminación explícita como parámetro — actívala

- Para desajustes severos, postprocesar el resultado con un paso de corrección de color puede ayudar a fusionar la cara en la escena de manera más convincente

¿Entonces cuál es la conclusión?

El intercambio de caras en video es una tecnología genuinamente poderosa cuando entiendes qué necesita para tener éxito. La mayoría de los problemas de calidad no son misteriosos — se remontan a la calidad de entrada, la selección del modelo para el caso de uso, y expectativas realistas sobre lo que el pipeline puede y no puede manejar. Consigue hacer eso bien, y pasarás mucho menos tiempo depurando resultados que se veían bien en la demostración pero se desmoronaron en producción.