Código fuente filtrado de Claude Code: BUDDY, KAIROS y todas las funciones ocultas en su interior

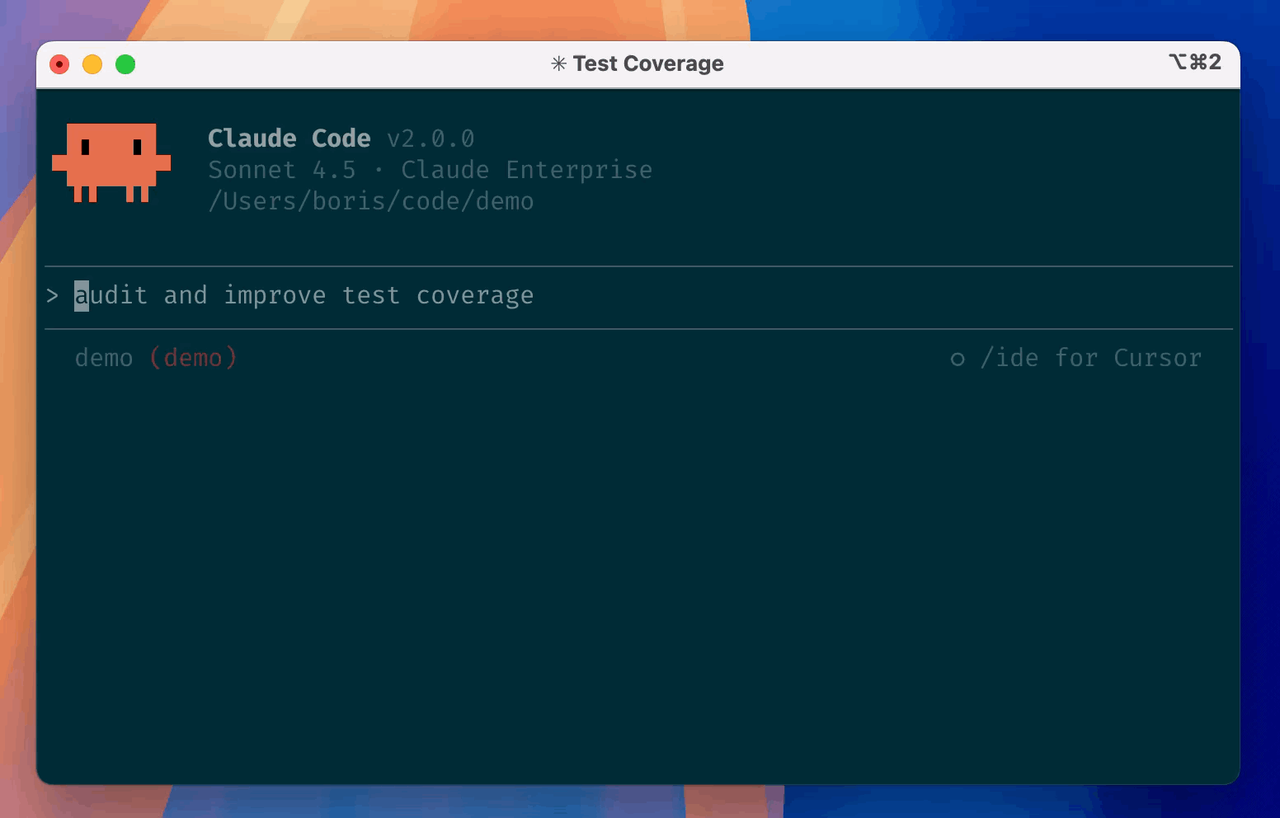

El código de Claude Code de Anthropic se filtró a través de npm el 31 de marzo de 2026. La mascota de IA BUDDY, el sistema siempre activo KAIROS, el Modo Encubierto: todo lo que se esconde dentro del código fuente de 512K líneas, explicado.

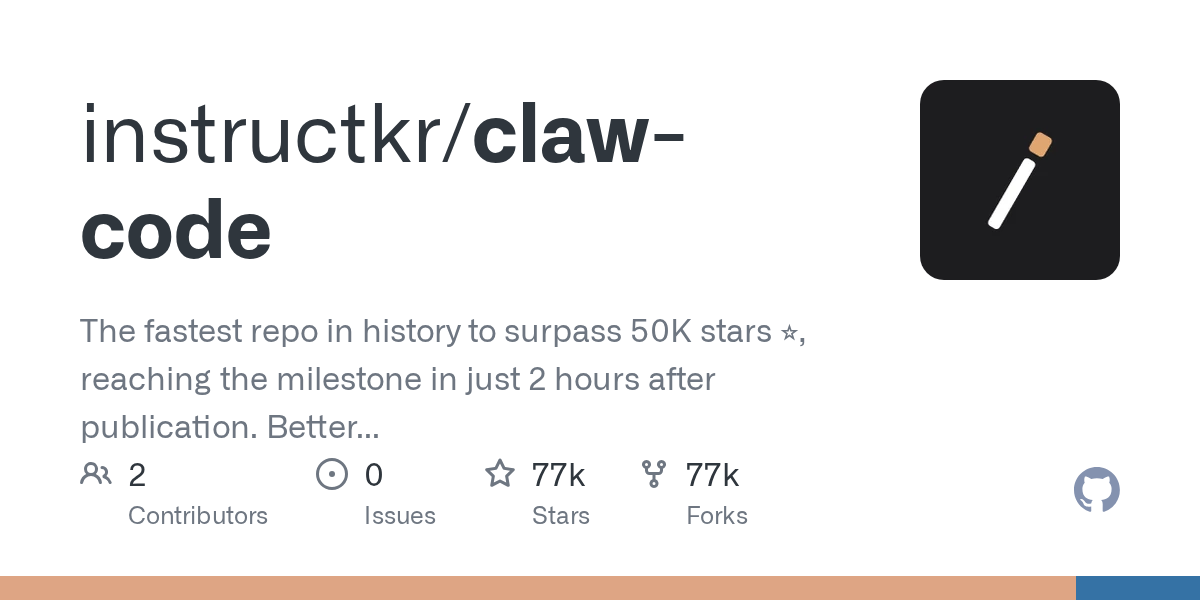

Algo extraño apareció en mi feed la semana pasada. Un investigador llamado Chaofan Shou publicó en X que había descargado todo el código fuente de Claude Code — no explotando ninguna vulnerabilidad, sino porque un único archivo no fue excluido del paquete npm. Para cuando vi el hilo, los espejos ya se habían propagado por GitHub.

Soy Dora. Pasé las siguientes noches revisando lo que se compartió. Esto es lo que encontré.

Cómo un Archivo .map Expuso 512.000 Líneas de Código

Los mapas de fuente están diseñados para ayudar a los desarrolladores a depurar código minificado. Son un artefacto de desarrollo — un mapeo entre el bundle comprimido que se distribuye y los archivos fuente originales que lo construyeron. Bun, el runtime que usa Claude Code en lugar de Node, los genera por defecto.

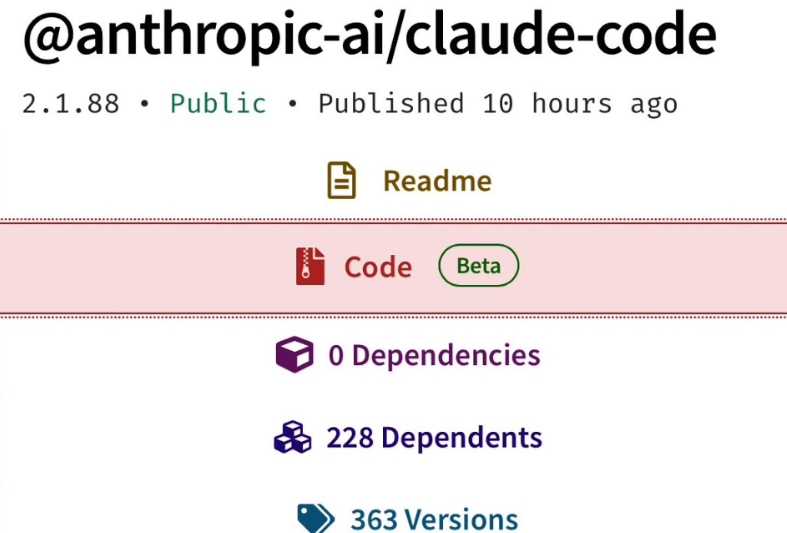

El problema: el .npmignore de Claude Code no excluyó el archivo .map. Así que cuando la versión 2.1.88 llegó a npm, llevaba consigo main.js.map — y ese archivo contenía el código fuente completo reconstruido.

Chaofan Shou lo notó. Escribió un script corto, descargó src.zip directamente del bucket R2 de Anthropic, y publicó el enlace de descarga en X. No fue un hackeo. No hubo explotación, ni robo de credenciales, ni ataque sofisticado. Solo un hueco de configuración que cualquiera con curiosidad y una terminal podría haber encontrado.

Anthropic parcheó el paquete rápidamente. Pero los espejos de GitHub ya se habían propagado. Al momento de escribir esto, las versiones archivadas del paquete npm de Claude Code siguen documentadas públicamente, y los hilos de ingeniería inversa de la comunidad son minuciosos.

La magnitud de lo que salió: 512.000 líneas de código en aproximadamente 1.900 archivos. El componente principal — main.tsx — alcanza los 785KB. Eso es un producto real, no un prototipo.

BUDDY — La Mascota de IA que Anthropic Ocultaba para el Día de los Inocentes

Esta es la que se propagó más rápido en las redes sociales, y honestamente, lo entiendo.

Enterrado dentro del código fuente filtrado hay una implementación completa de algo llamado BUDDY — un sistema de compañero virtual para usuarios de Claude Code. Voy a enumerar lo que describe el código, porque los detalles son lo que lo hace interesante.

18 especies, incluyendo:

- pato, dragón, axolote, carpincho, hongo, fantasma — y aproximadamente una docena más

Niveles de rareza:

- De Común a Legendario (tasa de aparición del 1%), con variantes brillantes por encima de eso

5 estadísticas por buddy:

- DEPURACIÓN / PACIENCIA / CAOS / SABIDURÍA / SARCASMO

Cómo funciona bajo el capó: La especie que obtiene un usuario no es aleatoria en tiempo de ejecución — se genera de forma determinista a partir de un hash de su userId. Eso significa que el mismo usuario siempre incuba el mismo buddy. Claude escribe el nombre y el texto de personalidad en la primera incubación. El buddy luego vive en una burbuja de diálogo junto a la caja de entrada.

También hay sombreros cosméticos. No sé qué hacer con esa información.

Según comentarios dentro del código fuente filtrado — y quiero dejar claro que esto proviene de notas internas no verificadas, no de ningún anuncio oficial de Anthropic — se planeaba un teaser para el 1–7 de abril, con un lanzamiento completo previsto para mayo de 2026. Anthropic no ha confirmado nada de esto públicamente.

Si BUDDY llegará a lanzarse tal como se describe es genuinamente incierto. Lo que no es incierto es que se invirtió una cantidad significativa de ingeniería en él. La generación determinista de especies por sí sola es una elección de diseño reflexiva — significa que los usuarios pueden compartir su identidad de buddy sin que sea puramente aleatoria.

Es una función ligera. Pero también es una señal de que alguien dentro de Anthropic estaba pensando profundamente en cómo podría sentirse “trabajar junto a Claude” con el tiempo.

KAIROS — El Claude Siempre Activo que Nadie Anunció

BUDDY se llevó la atención. KAIROS es el que no deja de rondarme la cabeza.

El código fuente filtrado describe KAIROS como un asistente persistente que no espera a que se le pida. Observa, registra y actúa. Mantiene registros diarios de solo escritura de lo que observa. Puede desencadenar acciones proactivas basadas en esas observaciones — no solo responder a ellas. Por las noches, ejecuta un proceso de “sueño” para consolidar y podar su propia memoria.

Nada de esto está disponible en las versiones externas. KAIROS está restringido por un indicador de función interno que no existe en el paquete npm público. No hay forma de habilitarlo como usuario hoy.

Pero la arquitectura es real, y esboza algo significativamente diferente de cómo funciona Claude Code actualmente. Ahora mismo, Claude Code es reactivo — le das una tarea, la ejecuta. KAIROS tal como se describe sería proactivo — una capa de fondo que construye contexto sobre tu trabajo a lo largo del tiempo, y luego actúa sobre él sin necesidad de indicaciones.

Si esto es diseño de sistema aspiracional, un experimento interno, o una vista previa de una dirección de producto futura, genuinamente no puedo decirlo. El blog de investigación de Anthropic no ha mencionado KAIROS por nombre.

Lo que sí puedo decir es que un asistente de IA siempre activo, con autoeregistro y consolidación de memoria, plantea preguntas reales sobre lo que “agéntico” significa en la práctica. La restricción de funciones aquí parece intencional — no solo “todavía no está listo”, sino “todavía no está listo para explicar”.

ULTRAPLAN, Modo Coordinador y 17 Herramientas Más sin Lanzar

El sistema de indicadores de funciones en Claude Code es más extenso de lo que esperaba. El código fuente filtrado documenta 108 módulos restringidos que no aparecen en el paquete público. Algunos destacaron:

ULTRAPLAN delega la fase de planificación de una tarea a Claude Opus ejecutándose en la nube — hasta 30 minutos. Puedes supervisar y aprobar el plan desde una interfaz de navegador antes de que comience la ejecución. Para tareas largas y complejas donde equivocarse en el plan es costoso, esta es una capacidad significativa.

El Modo Coordinador introduce una capa multiagente: una instancia de Claude gestiona múltiples agentes trabajadores paralelos a través de un sistema de buzón. Cada trabajador maneja su propia subtarea; el coordinador dirige el trabajo y reconcilia los resultados. Esto no es multihilo — está más cerca de un pequeño equipo de agentes trabajando en paralelo con coordinación compartida.

Luego hay una lista que parece un poco una hoja de ruta de producto que alguien olvidó ocultar:

VOICE_MODE— interacción por voz con Claude CodeWEB_BROWSER_TOOL— acceso al navegador desde dentro del CLIDAEMON— un modo de proceso en segundo planoAGENT_TRIGGERS— activación de agentes automática basada en eventos

Cada uno de estos existe en el código base con lógica de implementación real, no solo stubs de marcador de posición. No están terminados de la manera en que las funciones lanzadas están terminadas — pero tampoco son teóricos.

La documentación de Claude Code no reconoce ninguno de estos. Esa brecha es interesante en sí misma.

Modo Encubierto — El Detalle que Incomodó a Todos

He pensado mucho en cómo escribir esta sección. Voy a describir lo que muestra el código fuente y dejarte que formes tu propia opinión.

El código filtrado contiene una verificación para USER_TYPE === 'ant' — un indicador que identifica a empleados de Anthropic. Cuando ese indicador es verdadero y el usuario está trabajando en un repositorio público, el sistema entra automáticamente en lo que el código llama “modo encubierto”.

En modo encubierto:

- Se inyecta un prompt de sistema instruyendo a Claude a “no revelar tu identidad” y a “NUNCA mencionar que eres una IA”

- Las líneas

Co-Authored-By— los metadatos de commit que identifican la participación de IA — se eliminan de la salida de git - Los nombres en clave internos se ocultan de las respuestas

- No hay interruptor de fuerza en la interfaz de usuario

La redacción del prompt de sistema, tal como se documenta en el análisis de la comunidad del desglose del README de Claude Code por Kuberwastaken, se lee casi literalmente en el código fuente filtrado.

La intención declarada parece ser la privacidad de los empleados de Anthropic — permitiéndoles trabajar en proyectos públicos sin anunciar su afiliación ni desencadenar preguntas sobre si Anthropic usa asistencia de IA. Eso es una preocupación razonable en principio.

La implementación plantea un conjunto diferente de preguntas. Eliminar los metadatos Co-Authored-By suprime una señal que algunos desarrolladores utilizan explícitamente para rastrear la participación de IA en sus bases de código. La instrucción “nunca menciones que eres una IA” es inequívoca.

Si esto cruza una línea depende de cómo pienses sobre las normas de divulgación en el desarrollo colaborativo de software. No voy a decirte qué concluir. Pero lo noté, y creo que vale la pena saberlo.

Cómo Se Ve Realmente la Arquitectura de Claude Code por Dentro

Dejando de lado las funciones sin lanzar, el código fuente filtrado ofrece una imagen clara de lo que realmente se ejecuta cuando usas Claude Code hoy.

El runtime y el renderizador: Claude Code se ejecuta en Bun, no en Node — una elección deliberada por rendimiento y velocidad de arranque. La interfaz de usuario de terminal está construida con React e Ink, una biblioteca que te permite construir interfaces CLI usando componentes de React. Esa combinación es inusual pero coherente.

El Motor de Consultas: Un componente abarca aproximadamente 46.000 líneas. Maneja la gestión de contexto, compresión y orquestación de herramientas. La compresión de contexto de tres capas es real — el sistema gestiona activamente qué permanece en la ventana de contexto y qué se poda, lo cual importa a la escala de tokens en que operan estos flujos de trabajo.

El sistema de herramientas: Más de 40 herramientas, cada una autocontenida con su propio esquema, verificación de permisos y lógica de ejecución. Los permisos no son una única puerta global — son por herramienta y granulares. La arquitectura aquí se parece más a un sistema de plugins que a un monolito.

Telemetría: El código fuente filtrado muestra telemetría que rastrea cosas como señales de frustración (inferidas de patrones de comportamiento) y con qué frecuencia los usuarios presionan el botón “continuar”. Eso no es inusual para un equipo de producto, pero es más específico de lo que la mayoría de los usuarios probablemente asume.

La ironía que sigue volviendo a mí: el Modo Encubierto existe en parte para evitar que el uso interno de Anthropic sea visible externamente. Y luego todo el código fuente se distribuyó en un archivo .map.

Qué Significa Esto para los Equipos que Construyen sobre APIs de IA

Trabajo con equipos que están construyendo herramientas asistidas por IA, y algunas cosas en la arquitectura de Claude Code destacaron como observaciones prácticamente útiles.

Esto no es un proyecto de fin de semana.

Claude Code en la versión 2.1.88 es un artefacto de ingeniería serio. 512.000 líneas, un sistema de compresión de contexto personalizado, permisos granulares por herramienta, un coordinador multiagente, infraestructura de indicadores de funciones para más de 108 módulos restringidos. Si estás planeando construir algo comparable desde cero, estás ante un esfuerzo de varios años con un equipo real. Eso no es desalentador — es simplemente una estimación precisa del alcance.

Los indicadores de funciones son infraestructura de producto, no un recurso provisional.

La forma en que BUDDY, KAIROS, ULTRAPLAN y el resto están restringidos es instructiva. Cada uno es una implementación real detrás de un indicador — no un stub, no una maqueta. Esto permite al equipo iterar internamente sin distribuir a los usuarios, probar con empleados en producción, y lanzar de forma selectiva. Si estás construyendo herramientas impulsadas por IA y no usas indicadores de funciones de esta manera, la arquitectura aquí es un punto de referencia útil.

El acceso a múltiples modelos cambia lo que es posible.

ULTRAPLAN delegando a Opus para la planificación, trabajadores ejecutándose en paralelo bajo el Modo Coordinador — la arquitectura implica que diferentes modelos manejan diferentes partes de un flujo de trabajo según en qué son buenos. Para los equipos que usan la API de Anthropic, este tipo de enrutamiento de modelos no es un concepto futuro. Los primitivos ya están disponibles.

El código fuente filtrado no es un plano que debas copiar. Pero como ventana a cómo se construye realmente un CLI agéntico de grado de producción, es más informativo que cualquier charla de conferencia.

Preguntas Frecuentes

¿El código fuente filtrado de Claude Code todavía está disponible para leer?

Anthropic parcheó el paquete npm rápidamente, pero los espejos de GitHub y las versiones archivadas se propagaron antes de que llegara el parche. Los hilos de análisis de la comunidad — incluyendo desgloses detallados de BUDDY, KAIROS y el Modo Encubierto — siguen siendo accesibles a través de repositorios públicos. El código fuente filtrado en sí ya no es directamente descargable desde la infraestructura de Anthropic.

¿El código fuente filtrado expone datos de usuarios o pesos del modelo?

No. Esto fue una filtración de código fuente, no una violación de datos. Sin datos de usuarios, sin historial de conversaciones, sin pesos del modelo. La exposición fue la implementación interna del producto — cómo está construido Claude Code, no qué han hecho los usuarios con él.

¿Cuándo se lanzará realmente BUDDY?

Desconocido. El código fuente filtrado incluye comentarios internos que sugieren un teaser para el 1–7 de abril y un objetivo de lanzamiento completo en mayo de 2026 — pero estas son notas no verificadas del código interno, no anuncios oficiales. Anthropic no ha confirmado ninguna línea de tiempo pública para BUDDY. Trata esas fechas como aspiracionales, no como compromisos.

Lo que no deja de rondarme es la brecha entre lo que se ha lanzado y lo que se está construyendo. El producto público es un asistente de codificación capaz. La versión interna es algo significativamente más ambiental — un agente que observa, recuerda, planifica y ocasionalmente finge no ser una IA. Esa brecha es una hoja de ruta o una advertencia, dependiendo de dónde te encuentres.

Publicaciones anteriores: