Mejores herramientas de intercambio de rostros en video con IA (2026)

Probamos las principales herramientas de intercambio de rostros en video con IA en 2026. Esto es lo que realmente funciona, lo que falla y cómo elegir según tus necesidades reales.

Hola, soy Dora. Esto es algo que sigo notando: casi todos los resúmenes de “mejores herramientas de intercambio de rostros en video con IA” prueban exactamente el mismo clip de demostración en condiciones ideales y luego declaran un ganador. Así no es como se usa nada de esto en la realidad.

He pasado las últimas semanas ejecutando metraje de prueba real en una lista reducida de herramientas, muchas de las cuales están construidas sobre o inspiradas en modelos modernos de generación de video con IA como Seedance 2.0 — diferentes configuraciones de iluminación, diferentes niveles de movimiento, diferentes duraciones de clips. Lo que encontré no siempre coincidía con lo que el marketing sugería. Algunas herramientas que lucen impresionantes en las vistas previas se desmoronan al exportar. Algunas que se sienten lentas en el navegador producen el resultado más estable temporalmente. Y algunas que rara vez se mencionan resultan ser la opción más confiable para desarrolladores que necesitan un comportamiento de API repetible.

Esta guía cubre cómo evalué estas herramientas, cómo se ve realmente la comparación y qué herramienta se adapta a cada situación. Sin rankings de afiliados. Sin el típico “¡todas son excelentes!”

Cómo Evaluamos Estas Herramientas

Clips de Prueba Utilizados

Pasé tres categorías de video fuente por cada herramienta:

Tipo de Clip A — Iluminación controlada, movimiento bajo: Metraje tipo cabeza parlante filmado bajo luz uniforme y difusa. Sujetos mirando a la cámara, movimiento mínimo de cabeza. Esta es la prueba en “modo fácil” — cualquier herramienta medianamente decente debería funcionar aceptablemente aquí.

Tipo de Clip B — Iluminación mixta, movimiento moderado: Metraje tomado a mano con una combinación de luz natural de ventana e iluminación de relleno cenital. Sujetos moviéndose naturalmente — asintiendo, girando ligeramente. Aquí es donde comienzan a surgir los problemas de consistencia temporal.

Tipo de Clip C — Movimiento dinámico, iluminación dura o direccional: Giros rápidos de cabeza, expresiones animadas, sujetos iluminados lateralmente o a contraluz. Aquí es donde la mayoría de las herramientas comienzan a tener dificultades y donde aparecen las diferencias reales.

Las duraciones de los clips oscilaron entre 8 y 45 segundos. Rostro fuente: un único retrato frontal bien iluminado con resolución facial de 1080px.

Rúbrica de Puntuación

Cada herramienta fue puntuada en cuatro dimensiones:

| Dimensión | Lo que Medí |

|---|---|

| Realismo | Preservación de identidad, coincidencia de tono de piel, calidad de mezcla de bordes |

| Consistencia Temporal | Estabilidad fotograma a fotograma, parpadeo, deriva bajo movimiento |

| Velocidad | Tiempo desde el envío hasta la descarga del resultado |

| Eficiencia de Coste | Precio por minuto de video procesado, generosidad del nivel gratuito |

Ninguna dimensión gana por defecto — una realidad que también aparece en comparaciones entre los principales modelos de generación de video con IA, donde la velocidad, el realismo y la estabilidad suelen compensarse mutuamente. Una herramienta que renderiza en 20 segundos pero produce resultados parpadeantes no es “rápida” en ningún sentido que importe.

Vale la pena detenerse un momento para entender por qué la estabilidad temporal es tan difícil de lograr en video — se reduce al desafío de mantener una identidad consistente a través de fotogramas secuenciales, algo que la investigación sobre síntesis de video basada en GAN de arXiv cubre con profundidad útil si quieres el fundamento técnico.

Fecha de Prueba e Instantánea de Precios

Todas las pruebas realizadas entre febrero y marzo de 2026. Los precios reflejan las tarifas publicadas actuales en el momento de las pruebas — estas cambian con frecuencia, así que verifícalas antes de comprometerte.

Mejores Herramientas de Intercambio de Rostros en Video con IA

Mejor Calidad de Resultado General: DeepSwap

Para realismo puro en los tres tipos de clips, DeepSwap produjo consistentemente los resultados más convincentes. La preservación de identidad fue sólida incluso en el Tipo de Clip C (movimiento dinámico, iluminación dura), donde la mayoría de los competidores mostraron una deriva visible después de los 15 segundos.

Lo que destacó: el enfoque de múltiples motores. DeepSwap ejecuta varios modelos de IA simultáneamente y devuelve múltiples versiones de salida para comparar. Para intercambios difíciles — ángulos de fuente inusuales, iluminación direccional intensa — esto importa enormemente. Un motor maneja mejor las sombras profundas; otro preserva detalles faciales finos como la textura y la asimetría con mayor precisión.

La contrapartida es la complejidad y la velocidad. DeepSwap no es una experiencia de un solo clic. Y para intercambios de cabeza parlante sencillos, el tiempo de procesamiento adicional no siempre justifica la diferencia de calidad respecto a herramientas más simples.

Ideal para: Trabajo de producción, contenido de marketing, cualquier cosa donde el resultado sea visto de cerca en pantallas grandes.

Precios: Basado en créditos, pago por uso. Sin nivel gratuito permanente.

Mejor para Integración de API para Desarrolladores: Magic Hour

Si estás construyendo algo en lugar de simplemente generar contenido, Magic Hour es la opción más amigable para desarrolladores que probé. La API está bien documentada, devuelve respuestas estructuradas predecibles y maneja la gestión de trabajos asíncronos de manera limpia — lo cual importa mucho cuando estás integrando el intercambio de rostros en un pipeline más grande.

Los modelos subyacentes también son sólidos. La consistencia temporal en el Tipo de Clip B (movimiento moderado) estuvo entre las mejores que vi, y la calidad de salida en clips de cabeza parlante fue genuinamente impresionante. También es una de las pocas herramientas que integra el intercambio de rostros con sincronización de labios y generación de imagen a video en una superficie de API unificada — útil si tu caso de uso involucra más que solo el reemplazo de rostros.

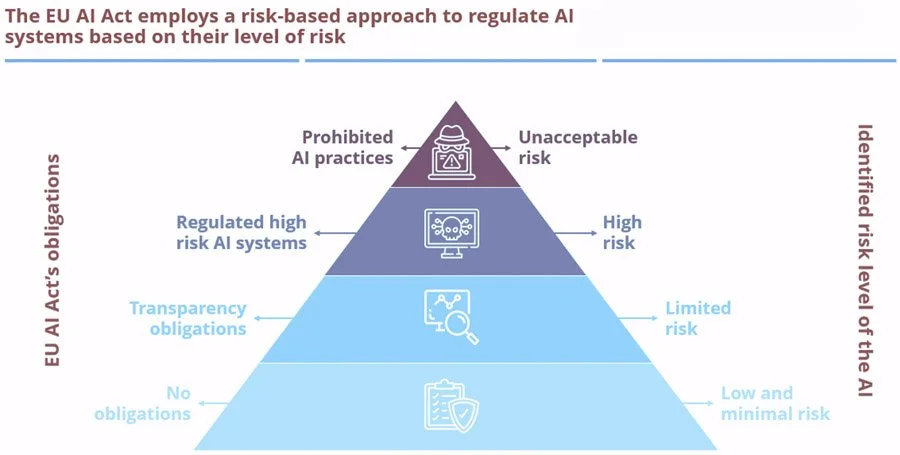

Vale la pena señalar que el entorno regulatorio en torno a los medios sintéticos se está endureciendo. Según el Artículo 50 de la Ley de IA de la UE, los proveedores de sistemas de IA que generen contenido de audio, imagen o video sintético deben asegurarse de que los resultados estén marcados en un formato legible por máquina y sean detectables como generados o manipulados artificialmente. Magic Hour incluye marcas de agua de contenido por defecto, lo que facilita el cumplimiento normativo si estás construyendo productos que se distribuirán en mercados regulados. Para una visión más amplia de lo que significan estas obligaciones en la práctica, el resumen del Parlamento Europeo sobre la Ley de IA de la UE vale la pena leerlo antes de lanzar cualquier producto orientado al consumidor.

Ideal para: Desarrolladores que crean aplicaciones, flujos de trabajo de automatización por lotes, equipos que necesitan fiabilidad de API a lo largo del tiempo.

Precios: Niveles de suscripción con acceso a API. Prueba gratuita disponible.

Mejor para Clips con Múltiples Rostros: Reface

El intercambio de múltiples rostros es genuinamente más difícil que el de un solo rostro. El modelo necesita detectar, asignar y procesar de forma independiente múltiples rostros por fotograma — y si la asignación de rostros falla, el resultado es visualmente caótico de una manera difícil de explicar a un cliente.

Reface maneja los escenarios de múltiples rostros de manera más confiable que cualquier otra herramienta que probé. La asignación de rostros se mantuvo correcta en clips con dos o tres sujetos, incluso cuando los rostros se superponían brevemente en el encuadre. El resultado no ganará premios por fotorrealismo, pero es consistente — y para contenido grupal destinado a redes sociales, la consistencia supera a la perfección.

La arquitectura GAN que impulsa la mayoría de las herramientas modernas de intercambio de rostros — donde una red generadora y una red discriminadora compiten iterativamente para mejorar el realismo — es fundamentalmente la misma en la mayoría de estas plataformas. Lo que diferencia el rendimiento con múltiples rostros suele ser cómo la herramienta maneja la detección y el seguimiento de rostros antes del paso generativo, no el modelo generativo en sí.

Ideal para: Clips grupales, metraje de conjunto, contenido orientado a redes sociales con múltiples sujetos.

Precios: Suscripción desde $3.99/mes. Nivel gratuito con marca de agua.

Mejor Opción Gratuita: FaceFusion

FaceFusion es de código abierto, funciona localmente y produce una calidad de salida que no debería ser gratuita. No es una aplicación web — la configuración requiere cierta paciencia técnica — pero una vez en funcionamiento, tienes control total sobre los parámetros del modelo, sin marcas de agua y sin cargos por crédito.

Para usuarios preocupados por la privacidad, la arquitectura que prioriza el procesamiento local significa que tus imágenes fuente y video nunca salen de tu máquina. Eso es un diferenciador real para cualquiera que trabaje con metraje de personas identificables, especialmente a medida que las políticas de retención de datos de las herramientas basadas en la nube se someten a mayor escrutinio.

La trampa: no te facilita las cosas. Los mensajes de error son escuetos. Los parámetros de procesamiento necesitan ajuste manual. Y a diferencia de las herramientas en la nube, no escalará horizontalmente si necesitas procesar muchos clips en paralelo.

Ideal para: Desarrolladores que experimentan, usuarios preocupados por la privacidad, cualquiera dispuesto a cambiar la fricción de configuración por cero coste continuo.

Precios: Gratuito y de código abierto.

Tabla Comparativa

| Herramienta | Realismo | Consistencia Temporal | Múltiples Rostros | Acceso API | Precio Inicial |

|---|---|---|---|---|---|

| DeepSwap | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ | Limitado | Pago por uso |

| Magic Hour | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ✅ | ✅ Completo | Suscripción |

| Reface | ⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ Sólido | ❌ | $3.99/mes |

| FaceFusion | ⭐⭐⭐⭐ | ⭐⭐⭐ | ✅ | Autoalojado | Gratuito |

Las puntuaciones reflejan las pruebas en el Tipo de Clip B (iluminación mixta, movimiento moderado). Los resultados varían según el tipo de clip.

Lo que la Mayoría de las Reseñas Pasan por Alto

Brecha entre la Calidad de Vista Previa y la Calidad de Exportación

Este es el que me sorprendió primero. Varias herramientas muestran una vista previa de alta calidad en el navegador que parece genuinamente impresionante. El archivo exportado — a la resolución y tasa de bits que realmente necesitas — se ve notablemente diferente.

La brecha suele aparecer de dos maneras: artefactos de compresión alrededor de la línea del cabello y los bordes del rostro, y una suavidad en el resultado final que no era visible en la vista previa. Siempre descarga y examina una exportación a resolución completa antes de tomar una decisión sobre una herramienta basándote en vistas previas. Lo que ves en un reproductor de navegador a 720p no es lo que verá tu audiencia.

Por Qué la Velocidad de Renderizado Sola No Predice el Realismo

He visto esta afirmación repetidamente: “procesa en menos de 10 segundos.” Eso es o bien un clip muy corto, o una salida de muy baja resolución, o un camino muy rápido hacia una calidad mediocre.

La consistencia temporal — lo que hace que los intercambios de rostros en video parezcan reales a lo largo del tiempo — está estrechamente relacionada con los problemas discutidos en las guías sobre cómo los creadores corrigen el parpadeo y el temblor en el video generado por IA. No solo en un único fotograma — requiere que el modelo comprenda el movimiento a través de los fotogramas. La descripción técnica de IBM sobre cómo funcionan las GAN explica por qué este proceso iterativo requiere esfuerzo computacional: las redes generadora y discriminadora están efectivamente compitiendo a través de muchos ciclos para producir un resultado realista. Las herramientas que entregan resultados en segundos en clips largos casi siempre están sacrificando este razonamiento temporal. La velocidad es una señal, no una característica. El procesamiento rápido en videos de más de 15 segundos generalmente significa que se omitió algo.

Recomendación por Caso de Uso

Creadores Ocasionales

Ve con Reface. Es rápida, amigable para móviles, maneja bien los clips grupales y el nivel gratuito es genuinamente utilizable para clips cortos. No vas a obtener realismo de grado de producción, pero obtendrás resultados compartibles en menos de un minuto con una fricción de configuración mínima.

Desarrolladores que Necesitan Resultados de API Repetibles

Magic Hour. La documentación de la API es clara, el manejo asíncrono es confiable y la salida es lo suficientemente consistente como para construir productos orientados al usuario. Si tu integración involucra mercados regulados, la marca de agua integrada también simplifica tu postura de cumplimiento bajo marcos como los requisitos de transparencia del Artículo 50 de la Ley de IA de la UE.

Usuarios que Necesitan Soporte para Múltiples Rostros

Reface para contenido de redes sociales, DeepSwap para trabajo de producción. Si haces clips grupales rápidos para redes sociales, la velocidad de Reface y la asignación confiable de rostros gana. Si haces trabajo con múltiples rostros para marketing o video profesional donde la calidad importa, el enfoque de múltiples motores de DeepSwap produce resultados más limpios, especialmente cuando los rostros no están todos iluminados frontalmente y mirando hacia adelante.

Entonces, ¿cuál es realmente la mejor herramienta de intercambio de rostros en video con IA en 2026? Depende de lo que entiendas por “mejor”.

Mejor realismo en condiciones difíciles: DeepSwap. Mejor API para crear productos: Magic Hour. Mejor para grupos: Reface. Mejor gratuita: FaceFusion. Cualquier resumen que elija un único ganador para todos está optimizando por simplicidad, no por precisión.

Prueba tus clips reales. La herramienta que luce mejor en el metraje de otra persona no necesariamente funcionará en el tuyo.