SeedVR2 Online: So verwendest du es

Erfahre, wie SeedVR2 online funktioniert, welche Workflows es unterstützt und was du vor der Verwendung für Upscaling-Aufgaben wissen solltest.

Hallo, ich bin Dora. Jemand erwähnte SeedVR2 in einem Discord-Thread, dem ich folgte. Sie sagten, sie hätten es „online benutzt.” Also suchte ich. Und stieß sofort auf eine Wand aus Gradio-Demos, Drittanbieter-Wrappern, API-Playgrounds und mindestens einer zwielichtigen Website, die definitiv nichts mit ByteDances Forschungsteam zu tun hatte.

Folgendes sagt niemand von vornherein: Es gibt kein einzelnes „SeedVR2 Online”-Produkt. Dieser Begriff bedeutet mindestens drei verschiedene Dinge, je nachdem, wo man landet. Und wenn man nicht weiß, welches man tatsächlich verwendet, werden die Ergebnisse – und die Erwartungen – falsch sein.

Lass mich das entwirren.

Was „SeedVR2 Online” normalerweise bedeutet

SeedVR2 ist ein Video-Restaurierungsmodell, das vom ByteDance Seed-Team entwickelt wurde. Es wurde auf der ICLR 2026 angenommen und der Forschungscode ist öffentlich verfügbar. Es ist ein einstufiger Diffusion Transformer für die allgemeine Videorestaurierung, der hochauflösende Eingaben durch einen adaptiven Fenster-Attention-Mechanismus verarbeiten kann. Das ist das eigentliche Ding.

Aber „SeedVR2 online” als Suchbegriff liefert etwas anderes als das Modell selbst. Ähnliche Verwirrung entsteht bei neueren KI-Videogenerierungsmodellen wie Seedance 2.0, wo Menschen oft nach einer „Online-Version” statt nach dem zugrundeliegenden Modell suchen. Es liefert Zugangspunkte zum Modell. Und das ist nicht dasselbe.

Gehostete Demo, Wrapper oder Workflow-Service

Wenn jemand sagt, er habe SeedVR2 online verwendet, meint er wahrscheinlich eines davon:

Eine gehostete Gradio-Demo. ByteDance veröffentlichte eine offizielle Demo auf Hugging Face Spaces. Sie führt das SeedVR2-3B-Modell aus und unterstützt sowohl Bild- als auch Videoeingaben über eine API-ähnliche Oberfläche. Das ist das Nächste, was einer „offiziellen” Online-Version entspricht – aber es ist eine Forschungsdemo, kein Produkt. Die Wartezeiten können lang sein. Die Verfügbarkeit ist nicht garantiert.

Ein Drittanbieter-Wrapper. Entwickler haben ComfyUI-Nodes, Replicate-Deployments und eigenständige Tools rund um dasselbe zugrundeliegende Modell gebaut. Diese laufen auf der Infrastruktur anderer, manchmal kostenlos, manchmal mit Credits oder Bezahlschranken. Sie können poliert aussehen. Sie sind keine ByteDance-Produkte.

Eine Plattformintegration. Einige KI-Generierungsplattformen haben SeedVR2 als eine Option in ihrem Modellkatalog hinzugefügt. Man verwendet dieselben Modellgewichte, aber über die Oberfläche und das Abrechnungssystem eines anderen.

Warum Nutzer verwirrt sind, was „offiziell” ist

Die Verwirrung ist verständlich. Ähnliche Unsicherheit entsteht, wenn Menschen Vergleiche zwischen modernen KI-Videomodellen lesen und annehmen, dass jedes eine einzige offizielle Oberfläche hat. Das Modell ist Open Source unter Apache 2.0. Das bedeutet, dass es jeder hosten, einbetten und SeedVR2 nennen kann. Es gibt keine Markenrechtskontrolle oder Zertifizierungsprozess.

Wenn man also nach „SeedVR2 online” sucht, landet man möglicherweise auf:

- Dem echten Hugging Face Space von ByteDance-Seed

- Einem Community-ComfyUI-Deployment

- Einem Drittanbieter-Video-Upscaling-Dienst, der zufällig SeedVR2 als Engine verwendet

- Etwas, das SeedVR2 im Namen hat, aber nichts damit zu tun hat

Bevor man Filmmaterial hochlädt, lohnt es sich, 30 Sekunden zu prüfen, auf welchem man sich tatsächlich befindet.

Wann es sich lohnt, SeedVR2 Online auszuprobieren

Ich bin direkt. Online-Zugang zu SeedVR2 macht in bestimmten Situationen Sinn. Außerhalb dieser kann es mehr frustrieren als helfen.

Schnelles Testen

Wenn man Ausgabebeispiele gesehen hat und wissen möchte, ob der Stil des Modells zum eigenen Filmmaterial passt – zuerst online ausprobieren. Man muss nichts installieren. Man braucht keine GPU. Man kann einen kurzen Clip hochladen und sehen, was zurückkommt.

Das ist wirklich nützlich. Ich habe die Hugging Face-Demo an einem kurzen Stück degradiertem Filmmaterial getestet, das ich schon länger bereinigen wollte. Die Bearbeitungszeit war langsam, aber das Ergebnis hat mir alles gesagt, was ich vor einem lokalen Setup wissen musste.

Kein lokales Setup erforderlich

SeedVR2 lokal auszuführen erfordert ernsthafte Hardware. Die offizielle Dokumentation weist darauf hin, dass eine H100-80GB-GPU 720p-Videos mit bis zu 100 Frames verarbeiten kann, und vier H100-80GB-Karten für 1080p oder 2K-Auflösung benötigt werden. Die meisten Menschen haben das nicht. Online-Zugang überbrückt diese Lücke – auf Kosten von Flexibilität, Geschwindigkeit und Kontrolle.

Wenn man ein Creator ist, der nur gelegentlich Videos bereinigen muss, ohne eine lokale Pipeline aufzubauen, sind Online-Optionen durchaus zu erkunden.

So verwendet man SeedVR2 Online

Grundlagen zu Ein- und Ausgabe

Die meisten Online-Zugangspunkte folgen demselben allgemeinen Muster:

- Quellvideo hochladen (normalerweise MP4, manchmal Frames)

- Zielauflösung oder Upscale-Multiplikator festlegen

- Einreichen und warten

Die Ausgabe ist eine restaurierte Version des Clips – schärfer, mit reduziertem Rauschen und Kompressionsartefakten, skaliert auf die Zielauflösung.

Was man online wahrscheinlich nicht kontrollieren wird: Batch-Größe, Attention-Fenstergröße, Modellvariante (3B vs. 7B) oder Nachbearbeitungsoptionen wie Wavelet-Farbkorrektur. Diese Einstellungen befinden sich in den lokalen Tools.

Einstellungen, auf die man achten sollte

Wenn die Oberfläche Optionen bietet, sind einige es wert zu verstehen:

Auflösungsziel. Das Modell ist für hochauflösende Ausgabe ausgelegt. Kein Ziel eingeben, das niedriger als die Quelle ist – man erhält unnötige Verarbeitung ohne visuellen Gewinn.

Farbkorrekturmodus. Einige Wrapper stellen diesen bereit. Die ComfyUI-Implementierung bietet mehrere Farbabgleichsoptionen, einschließlich eines „Lab”-Modus, der als vollständiger perzeptueller Farbabgleich für höchste Originaltreue beschrieben wird, und eines „Wavelet”-Modus für frequenzbasierte natürliche Farben. Wenn man diese sieht, ist „Wavelet” normalerweise die sicherere Wahl für unbekanntes Filmmaterial.

Cliplänge. Testclips kurz halten – unter 30 Sekunden wenn möglich. Lange Clips verlangsamen die Warteschlange für alle und sind schwieriger zu debuggen, wenn etwas falsch aussieht.

Was man davon erwarten kann und was nicht

Leistungsgrenzen

Online-Tools drosseln. Besonders kostenlose. Wenn man sich auf einer gemeinsam genutzten Demo mit begrenzter Rechenkapazität befindet, sollte man Folgendes erwarten:

- Warteschlangen zu Stoßzeiten

- Verarbeitungszeiten von mehreren Minuten, selbst für kurze Clips

- Gelegentliche Timeouts oder abgebrochene Jobs

Das ist ein Warteschlangen- und Infrastrukturproblem, kein Modellproblem.

Qualitätserwartungen

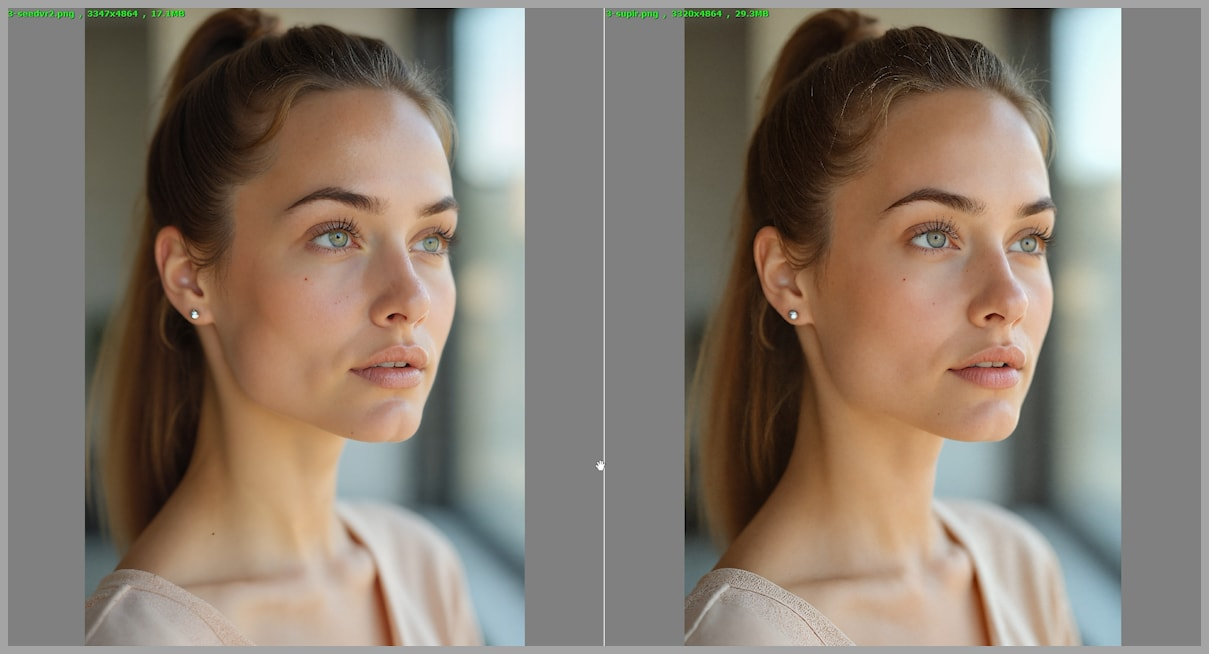

Das Modell selbst ist leistungsfähig. ByteDance-Seeds eigene Modellkarte weist darauf hin, dass es bei Eingaben mit sehr leichten Degradierungen – zum Beispiel 720p-AIGC-Videos – manchmal zu viele Details generieren kann, was gelegentlich zu überschärften Ergebnissen führt. Bewegungsartefakte können auch in generativen Video-Pipelines auftreten, weshalb viele Creators lernen, wie Creators Flimmern und Jitter in KI-generiertem Video beheben, wenn sie mit Restaurierungsmodellen arbeiten. Das ist eine reale Einschränkung, die man kennen sollte, bevor man etwas Wichtiges verarbeitet.

Für Filmmaterial mit echter Degradierung – Rauschen, Unschärfe, Kompressionsartefakte – sind die Ergebnisse oft merklich besser. Für bereits sauberes Filmmaterial könnte das Modell die Dinge tatsächlich weniger natürlich aussehen lassen.

Warum Online-Nutzung nicht dasselbe ist wie vollständige Workflow-Nutzung

Die Lücke ist erheblich. Lokale Deployments über ComfyUI zum Beispiel ermöglichen die Kontrolle über Batch-Größe, Wechsel zwischen 3B- und 7B-Modellvarianten, Aktivierung der GGUF-Quantisierung für niedrigeren VRAM-Verbrauch und die Verkettung von SeedVR2 mit anderen Nodes in einer Pipeline. Dieses Maß an Kontrolle existiert in den meisten Online-Oberflächen nicht.

Wenn man einen wiederholbaren Prozess aufbaut – zum Beispiel die Verarbeitung von Filmmaterial von regelmäßigen Drehs – wird der Online-Zugang schnell an seine Grenzen stoßen.

SeedVR2 Online vs. API vs. Workflow-Setup

| Kategorie | Online-Demo | API / Plattform | Lokaler Workflow |

|---|---|---|---|

| Erforderliches Setup | Keins | Minimal | Erheblich |

| Geschwindigkeit | Langsam (geteilt) | Mittel | Schnell (eigene GPU) |

| Kontrolle | Gering | Mittel | Hoch |

| Kosten | Kostenlos / Credits | Nutzungsbasiert | Hardwarekosten |

| Zuverlässigkeit | Variabel | Stabiler | Stabil |

| Batch-Verarbeitung | Nein | Manchmal | Ja |

Am besten für schnelle Nutzung

Online-Demos und gehostete Plattformen machen Sinn für einmalige Tests, schnelle Vergleiche und Situationen ohne Zugang zu einer leistungsfähigen lokalen Maschine. Der SeedVR2-3B Hugging Face Space, der von ByteDance-Seed gehostet wird, ist das Nächste zu einem offiziellen Berührungspunkt, wenn man das Modell ausprobieren möchte, ohne sich auf irgendetwas festzulegen.

Am besten für wiederholbare Produktionsnutzung

Wenn man Filmmaterial regelmäßig verarbeitet, ist der ComfyUI-SeedVR2_VideoUpscaler-Node das Tool, auf das die meisten Creators gesetzt haben. Er ist von der Community gebaut, wird aber aktiv gepflegt, mit GGUF-Quantisierungsunterstützung, die ihn auf Consumer-GPUs zugänglich macht. Als Referenz sind die offiziellen Modellgewichte und Architekturdetails im ByteDance-Seed/SeedVR-Repository auf GitHub dokumentiert.

Persönliches Fazit

Ich habe SeedVR2 sowohl über die Hugging Face-Demo als auch lokal über ComfyUI ausgeführt. Das ist nicht dieselbe Erfahrung.

Die Online-Demo ist für genau eine Sache nützlich: zu entscheiden, ob SeedVR2 die eigene Zeit wert ist. Sie hat mir diese Frage in einer Sitzung beantwortet. Aber ich würde sie nicht für etwas verwenden, das ich tatsächlich liefern müsste.

Wer es ausprobieren sollte

Du, wenn:

- Du testen möchtest, ob das Modell zu deinem Filmmaterial passt, bevor du irgendetwas installierst

- Du gelegentlich einen Clip restaurierst und keine wiederholbare Pipeline benötigst

- Du keine lokalen GPU-Ressourcen hast und mit langsamerem Durchsatz einverstanden bist

Wer es überspringen sollte

Du, wenn:

- Du mehr als eine Handvoll Clips pro Woche verarbeitest

- Du konsistente, reproduzierbare Ergebnisse benötigst

- Dir die Kontrolle über Ausgabeschärfe, Farbabgleich oder Modellgröße wichtig ist

Für alle, die ernsthaft daran interessiert sind, wo dieses Modell in der Forschungslandschaft steht, ist das originale SeedVR2-Paper auf arXiv (2506.05301) eine Lektüre wert – es ist zugänglicher als die meisten akademischen Paper und erklärt den einstufigen Restaurierungsansatz klar.

Der Begriff „SeedVR2 online” wird die Menschen wahrscheinlich noch eine Weile verwirren. Es gibt kein einzelnes Produkt, auf das man zeigen könnte. Es gibt ein Modell, ein paar offizielle Demos und eine wachsende Zahl von Community-Tools, die darum herum gebaut wurden. Das ist keine schlechte Sache – es bedeutet nur, dass man wissen muss, durch welche Tür man tatsächlich geht, bevor man entscheidet, ob es die eigene Zeit wert ist. Tschüss, meine Lieben~