Claude Code Geleakter Quellcode: BUDDY, KAIROS & Alle Versteckten Features

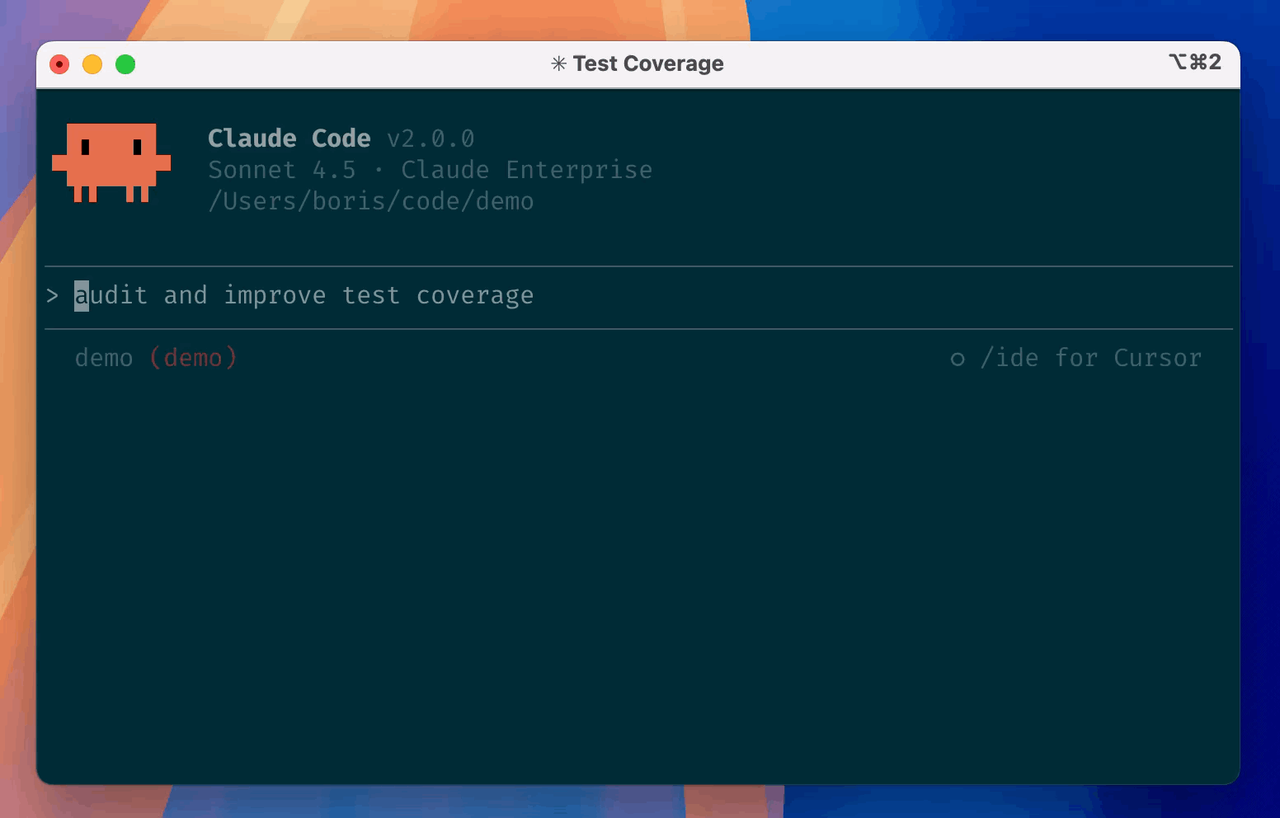

Anthropics Claude Code wurde am 31. März 2026 über npm geleakt. KI-Begleiter BUDDY, dauerhaft aktiver KAIROS, Undercover-Modus — alles Versteckte im 512.000-Zeilen-Quellcode, erklärt.

Letzte Woche ist mir etwas Seltsames in meinem Feed aufgefallen. Ein Forscher namens Chaofan Shou postete auf X, dass er Claude Codes gesamten Quellcode heruntergeladen hatte — nicht durch einen Exploit, sondern weil eine einzige Datei nicht aus dem npm-Paket ausgeschlossen wurde. Als ich den Thread sah, hatten sich Mirrors bereits auf GitHub verbreitet.

Ich bin Dora. Ich verbrachte die nächsten Abende damit, das Geteilte durchzugehen. Das habe ich gefunden.

Wie eine .map-Datei 512.000 Zeilen Code enthüllte

Source Maps sollen Entwicklern helfen, minimierten Code zu debuggen. Sie sind ein Entwicklungsartefakt — eine Zuordnung zwischen dem komprimierten Bundle, das ausgeliefert wird, und den ursprünglichen Quelldateien, die es aufgebaut haben. Bun, die Runtime, die Claude Code anstelle von Node verwendet, generiert sie standardmäßig.

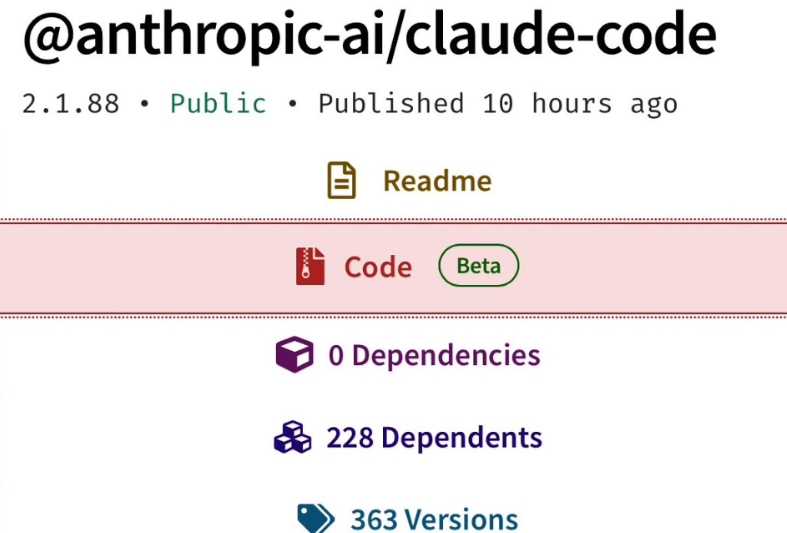

Das Problem: Claude Codes .npmignore hat die .map-Datei nicht ausgeschlossen. Als Version 2.1.88 bei npm landete, enthielt sie also main.js.map — und diese Datei enthielt den vollständig rekonstruierten Quellcode.

Chaofan Shou bemerkte es. Er schrieb ein kurzes Skript, rief src.zip direkt aus Anthropics R2-Bucket ab und postete den Download-Link auf X. Es war kein Hack. Keine Exploitation, kein Credential-Diebstahl, kein ausgefeilter Angriff. Nur eine Konfigurationslücke, die jeder mit Neugier und einem Terminal hätte finden können.

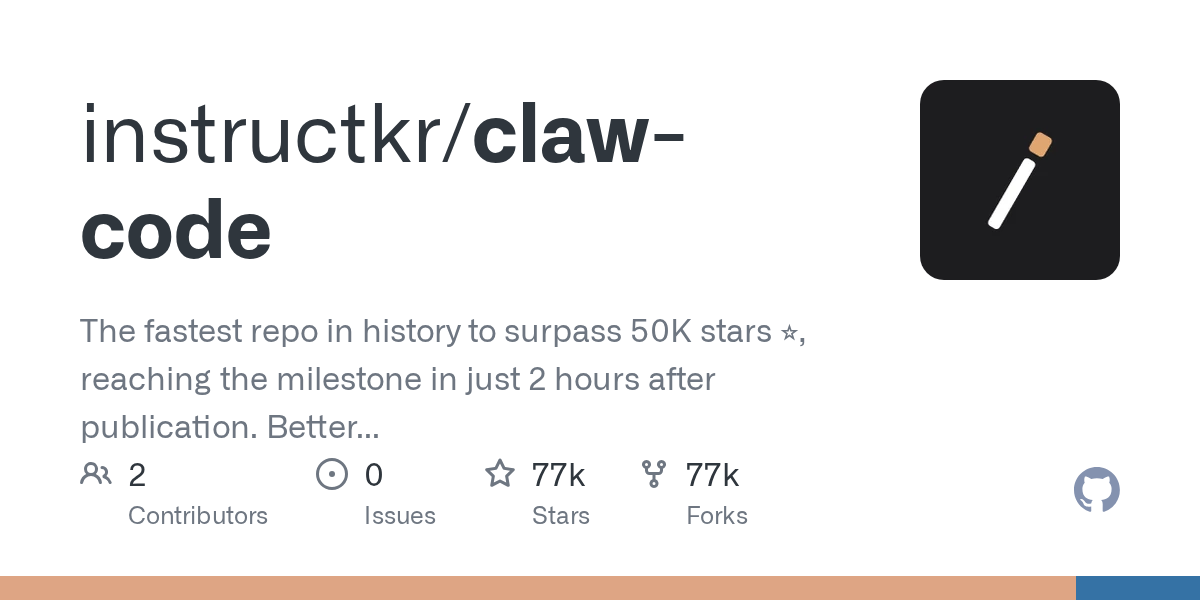

Anthropic patchte das Paket schnell. Aber GitHub-Mirrors hatten sich bereits verbreitet. Zum Zeitpunkt dieses Artikels sind archivierte Versionen des Claude Code npm-Pakets öffentlich dokumentiert, und die Community-Reverse-Engineering-Threads sind ausführlich.

Das Ausmaß des Lecks: 512.000 Zeilen Code in etwa 1.900 Dateien. Die Hauptkomponente allein — main.tsx — umfasst 785 KB. Das ist ein echtes Produkt, kein Prototyp.

BUDDY — Das KI-Haustier, das Anthropic für den Aprilscherz versteckte

Das ist das, was in sozialen Medien am schnellsten kursierte, und ehrlich gesagt verstehe ich warum.

Tief im geleakten Quellcode steckt eine vollständige Implementierung von etwas namens BUDDY — einem virtuellen Begleiter-System für Claude Code-Nutzer. Ich liste auf, was der Code beschreibt, denn die Details machen es interessant.

18 Spezies, darunter:

- Ente, Drache, Axolotl, Capybara, Pilz, Geist — und etwa ein Dutzend mehr

Seltenheitsstufen:

- Von Common bis Legendary (1% Drop-Rate), mit Shiny-Varianten obendrauf

5 Stats pro Buddy:

- DEBUGGING / PATIENCE / CHAOS / WISDOM / SNARK

Wie es unter der Haube funktioniert: Die Spezies, die ein Nutzer bekommt, ist zur Laufzeit nicht zufällig — sie wird deterministisch aus einem Hash der userId generiert. Das bedeutet: Derselbe Nutzer schlüpft immer denselben Buddy. Claude schreibt den Namen und den Persönlichkeitstext beim ersten Schlüpfen. Der Buddy lebt dann in einer Sprechblase neben dem Eingabefeld.

Es gibt auch kosmetische Hüte. Ich weiß nicht, was ich mit dieser Information anfangen soll.

Laut Kommentaren im geleakten Quellcode — und ich möchte klarstellen, dass dies aus nicht verifizierten internen Notizen stammt, nicht aus einer offiziellen Anthropic-Ankündigung — war ein Teaser für April 1–7 geplant, mit einem vollständigen Launch-Ziel für Mai 2026. Anthropic hat nichts davon öffentlich bestätigt.

Ob BUDDY jemals wie beschrieben ausgeliefert wird, ist wirklich unklar. Was nicht unklar ist: Eine beträchtliche Menge Engineering floss hinein. Die deterministische Spezies-Generierung allein ist eine durchdachte Design-Entscheidung — sie bedeutet, dass Nutzer ihre Buddy-Identität teilen können, ohne dass sie rein zufällig ist.

Es ist ein leichtes Feature. Aber es ist auch ein Signal, dass jemand bei Anthropic ernsthaft darüber nachgedacht hat, wie sich „an der Seite von Claude arbeiten” im Laufe der Zeit anfühlen könnte.

KAIROS — Der Always-On-Claude, den niemand ankündigte

BUDDY bekam die Aufmerksamkeit. KAIROS ist das, worüber ich weiter nachdenke.

Der geleakte Quellcode beschreibt KAIROS als einen persistenten Assistenten, der nicht darauf wartet, gefragt zu werden. Er beobachtet, protokolliert und handelt. Er pflegt append-only-Tageslogbücher dessen, was er beobachtet. Er kann proaktive Aktionen basierend auf diesen Beobachtungen auslösen — nicht nur auf sie reagieren. Nachts führt er einen „Träumen”-Prozess durch, um sein eigenes Gedächtnis zu konsolidieren und zu bereinigen.

Nichts davon ist in den externen Builds verfügbar. KAIROS ist hinter einem internen Feature-Flag gesperrt, das im öffentlichen npm-Paket nicht existiert. Es gibt keine Möglichkeit, es als Nutzer heute zu aktivieren.

Aber die Architektur ist real und skizziert etwas, das sich deutlich davon unterscheidet, wie Claude Code derzeit funktioniert. Aktuell ist Claude Code reaktiv — du gibst ihm eine Aufgabe, es läuft. KAIROS, wie beschrieben, wäre proaktiv — eine Hintergrundschicht, die über Zeit Kontext über deine Arbeit aufbaut und dann ohne Aufforderung handelt.

Ob dies ein angestrebtes System-Design, ein internes Experiment oder eine Vorschau auf eine kommende Produktrichtung ist, kann ich wirklich nicht sagen. Der Anthropic-Forschungsblog hat KAIROS nicht namentlich erwähnt.

Was ich sagen kann: Ein always-on, selbst-protokollierender, gedächtniskonsolidierender KI-Assistent wirft echte Fragen darüber auf, was „agentisch” in der Praxis bedeutet. Das Feature-Gating hier fühlt sich absichtlich an — nicht nur „noch nicht bereit”, sondern „noch nicht bereit, es zu erklären”.

ULTRAPLAN, Coordinator Mode & 17 weitere unveröffentlichte Tools

Das Feature-Flag-System in Claude Code ist umfangreicher, als ich erwartet hatte. Der geleakte Quellcode dokumentiert 108 gesperrte Module, die nicht im öffentlichen Paket erscheinen. Ein paar fielen auf:

ULTRAPLAN lagert die Planungsphase einer Aufgabe an Claude Opus aus, der in der Cloud läuft — bis zu 30 Minuten lang. Du kannst den Plan über eine Browser-Oberfläche überwachen und genehmigen, bevor die Ausführung beginnt. Für lange, komplexe Aufgaben, bei denen ein falscher Plan teuer ist, ist das eine bedeutende Fähigkeit.

Coordinator Mode führt eine Multi-Agenten-Schicht ein: Eine Claude-Instanz verwaltet mehrere parallele Worker-Agenten über ein Postfach-System. Jeder Worker bearbeitet seine eigene Teilaufgabe; der Koordinator leitet die Arbeit weiter und reconciliert die Ergebnisse. Das ist kein Multi-Threading — es ist eher ein kleines Team von Agenten, das parallel mit gemeinsamer Koordination arbeitet.

Dann gibt es eine Liste, die sich ein bisschen wie eine Produkt-Roadmap liest, die jemand vergessen hat zu verstecken:

VOICE_MODE— Sprachinteraktion mit Claude CodeWEB_BROWSER_TOOL— Browser-Zugriff von innerhalb der CLIDAEMON— ein Hintergrundprozess-ModusAGENT_TRIGGERS— automatisierte ereignisbasierte Agentenaktivierung

Jedes davon existiert im Codebase mit echter Implementierungslogik, nicht nur Platzhalter-Stubs. Sie sind nicht in der Art fertig, wie ausgelieferte Features fertig sind — aber sie sind auch nicht theoretisch.

Die Claude Code-Dokumentation erwähnt keines davon. Diese Lücke ist an sich interessant.

Undercover Mode — Das Detail, das alle unwohl fühlte

Ich habe eine Weile darüber nachgedacht, wie ich diesen Abschnitt schreiben soll. Ich werde beschreiben, was der Quellcode zeigt, und dir überlassen, deine eigene Meinung zu bilden.

Der geleakte Code enthält eine Prüfung für USER_TYPE === 'ant' — ein Flag, das Anthropic-Mitarbeiter identifiziert. Wenn dieses Flag true ist und der Nutzer in einem öffentlichen Repository arbeitet, tritt das System automatisch in den sogenannten „Undercover Mode” ein.

Im Undercover Mode:

- Ein System-Prompt wird eingefügt, der Claude anweist, „not blow your cover” und „NEVER mention you are an AI”

Co-Authored-By-Zeilen — die Commit-Metadaten, die KI-Beteiligung identifizieren — werden aus der Git-Ausgabe entfernt- Interne Codenamen werden aus Antworten verborgen

- Es gibt keinen Force-Off-Schalter in der nutzerorientierten Oberfläche

Der System-Prompt-Wortlaut, wie in der Community-Analyse von Kuberwastakens Claude Code README-Analyse dokumentiert, liest sich nahezu wörtlich im geleakten Quellcode.

Die erklärte Absicht scheint Privatsphäre für Anthropic-Mitarbeiter zu sein — damit sie an öffentlichen Projekten arbeiten können, ohne ihre Zugehörigkeit zu bewerben oder Fragen auszulösen, ob Anthropic KI-unterstützt ist. Das ist im Prinzip ein vernünftiges Anliegen.

Die Implementierung wirft eine andere Reihe von Fragen auf. Das Entfernen von Co-Authored-By-Metadaten beseitigt ein Signal, das einige Entwickler explizit verwenden, um KI-Beteiligung in ihren Codebases zu verfolgen. Die Anweisung „never mention you are an AI” ist eindeutig.

Ob das eine Grenze überschreitet, hängt davon ab, wie du über Offenlegungsnormen in der kollaborativen Softwareentwicklung denkst. Ich werde dir nicht sagen, was du schlussfolgern sollst. Aber ich habe es bemerkt, und ich denke, es ist es wert, es zu wissen.

Wie die Claude Code-Architektur tatsächlich von innen aussieht

Abgesehen von den unveröffentlichten Features bietet der geleakte Quellcode ein klares Bild davon, was tatsächlich läuft, wenn du Claude Code heute verwendest.

Die Runtime und der Renderer: Claude Code läuft auf Bun, nicht Node — eine bewusste Entscheidung für Performance und Startgeschwindigkeit. Die Terminal-UI ist mit React und Ink gebaut, einer Bibliothek, die es erlaubt, CLI-Oberflächen mit React-Komponenten zu bauen. Diese Kombination ist ungewöhnlich, aber kohärent.

Die Query Engine: Eine Komponente umfasst etwa 46.000 Zeilen. Sie behandelt Kontext-Management, Kompression und Tool-Orchestrierung. Drei-Schichten-Kontextkompression ist real — das System verwaltet aktiv, was im Kontextfenster bleibt und was beschnitten wird, was bei der Token-Größenordnung dieser Workflows wichtig ist.

Das Tool-System: 40+ Tools, jedes eigenständig mit eigenem Schema, Berechtigungsprüfung und Ausführungslogik. Berechtigungen sind kein einzelnes globales Gate — sie sind pro Tool und granular. Die Architektur hier ist eher einem Plugin-System als einem Monolithen ähnlich.

Telemetrie: Der geleakte Quellcode zeigt Telemetrie, die Dinge wie Frustrationssignale (aus Verhaltensmustern abgeleitet) und wie oft Nutzer den „Weiter”-Button drücken, verfolgt. Das ist für ein Produktteam nicht ungewöhnlich, aber spezifischer, als die meisten Nutzer wahrscheinlich annehmen.

Die Ironie, die mich immer wieder beschäftigt: Undercover Mode existiert teilweise, um Anthropics interne Nutzung von außen unsichtbar zu machen. Und dann wurde der gesamte Quellcode in einer .map-Datei ausgeliefert.

Was das für Teams bedeutet, die auf KI-APIs aufbauen

Ich arbeite mit Teams, die KI-gestützte Tools bauen, und ein paar Dinge in der Claude Code-Architektur stachen als praktisch nützliche Beobachtungen heraus.

Das ist kein Wochenend-Projekt.

Claude Code in Version 2.1.88 ist ein ernstes Engineering-Artefakt. 512.000 Zeilen, ein benutzerdefiniertes Kontextkompressionssystem, granulare Per-Tool-Berechtigungen, ein Multi-Agenten-Koordinator, Feature-Flag-Infrastruktur für 108+ gesperrte Module. Wenn du planst, etwas Vergleichbares von Grund auf zu bauen, blickst du auf eine mehrjährige Bemühung mit einem echten Team. Das ist nicht entmutigend — es ist nur eine genaue Größeneinschätzung.

Feature Flags sind Produkt-Infrastruktur, kein Workaround.

Die Art und Weise, wie BUDDY, KAIROS, ULTRAPLAN und der Rest gesperrt sind, ist lehrreich. Jedes ist eine echte Implementierung hinter einem Flag — kein Stub, kein Mockup. Das lässt das Team intern iterieren, ohne an Nutzer auszuliefern, mit Mitarbeitern in der Produktion zu testen und selektiv auszurollen. Wenn du KI-gestützte Tools baust und Feature Flags nicht auf diese Weise verwendest, ist die Architektur hier ein nützlicher Referenzpunkt.

Multi-Modell-Zugriff verändert, was möglich ist.

ULTRAPLAN, das für die Planung an Opus auslagert, Worker, die parallel unter Coordinator Mode laufen — die Architektur impliziert, dass verschiedene Modelle verschiedene Teile eines Workflows basierend darauf behandeln, wofür sie gut sind. Für Teams, die die Anthropic API verwenden, ist diese Art von Modell-Routing kein Zukunftskonzept. Die Primitiven sind bereits verfügbar.

Der geleakte Quellcode ist kein Blueprint, den du kopieren solltest. Aber als Fenster darin, wie ein produktionsreifes agentisches CLI tatsächlich gebaut wird, ist er informativer als jeder Konferenzvortrag.

FAQ

Ist der geleakte Claude Code-Quellcode noch lesbar?

Anthropic patchte das npm-Paket schnell, aber GitHub-Mirrors und archivierte Versionen verbreiteten sich, bevor der Patch ankam. Community-Analyse-Threads — darunter detaillierte Aufschlüsselungen von BUDDY, KAIROS und Undercover Mode — bleiben über öffentliche Repositories zugänglich. Der geleakte Quellcode selbst ist nicht mehr direkt aus Anthropics Infrastruktur herunterladbar.

Enthüllt der geleakte Quellcode Nutzerdaten oder Modellgewichte?

Nein. Das war ein Quellcode-Leak, kein Datenleck. Keine Nutzerdaten, keine Gesprächsverläufe, keine Modellgewichte. Die Exposition war die interne Implementierung des Produkts — wie Claude Code gebaut ist, nicht was Nutzer damit gemacht haben.

Wann wird BUDDY tatsächlich launchen?

Unbekannt. Der geleakte Quellcode enthält interne Kommentare, die einen Teaser für April 1–7 und ein vollständiges Launch-Ziel im Mai 2026 nahelegen — aber das sind unbestätigte Notizen aus internem Code, keine offiziellen Ankündigungen. Anthropic hat keine öffentlichen Zeitpläne für BUDDY bestätigt. Behandle diese Daten als angestrebt, nicht als verbindlich.

Was mich immer wieder beschäftigt, ist die Lücke zwischen dem, was ausgeliefert wird, und dem, was gebaut wird. Das öffentliche Produkt ist ein fähiger Coding-Assistent. Die interne Version ist etwas deutlich Ambient-eres — ein Agent, der beobachtet, sich erinnert, plant und gelegentlich vorgibt, keine KI zu sein. Diese Lücke ist entweder eine Roadmap oder eine Warnung, je nachdem, wo du stehst.

Vorherige Beiträge: