Was ist GPT-5.5 für Entwickler im Jahr 2026?

Verstehen Sie, was GPT-5.5 offiziell eingeführt hat, wo es heute verfügbar ist und was Entwickler überprüfen sollten, bevor sie die Produktionseinführung planen.

OpenAI hat GPT-5.5 am 23. April 2026 veröffentlicht. Während ich dies schreibe, ist das Modell seit weniger als einem Tag verfügbar.

Wenn du einen Coding-Agenten betreibst, ein Produkt auf Basis eines Modells entwickelst oder einen Workflow hast, der auf API-Zugriff angewiesen ist, lautet die eigentliche Schlagzeile nicht „neues Modell ist schlauer.” Die Schlagzeile ist: wo du es tatsächlich nutzen kannst und wo noch nicht. Das sind zwei verschiedene Geschichten, und die meisten Presseberichte vermischen sie.

Dieser Beitrag ist ein kurzes, datiertes Protokoll dessen, was veröffentlicht wurde, was noch aussteht und wo ich abwarten würde, bevor ich irgendetwas umschreibe.

Was OpenAI offiziell am 23. April 2026 veröffentlicht hat

Laut OpenAIs eigenem Ankündigungsbeitrag wird GPT-5.5 heute für Plus-, Pro-, Business- und Enterprise-Nutzer in ChatGPT und Codex ausgerollt. GPT-5.5 Pro steht Pro-, Business- und Enterprise-Nutzern in ChatGPT zur Verfügung. Das ist der vollständige Umfang der heutigen Veröffentlichung.

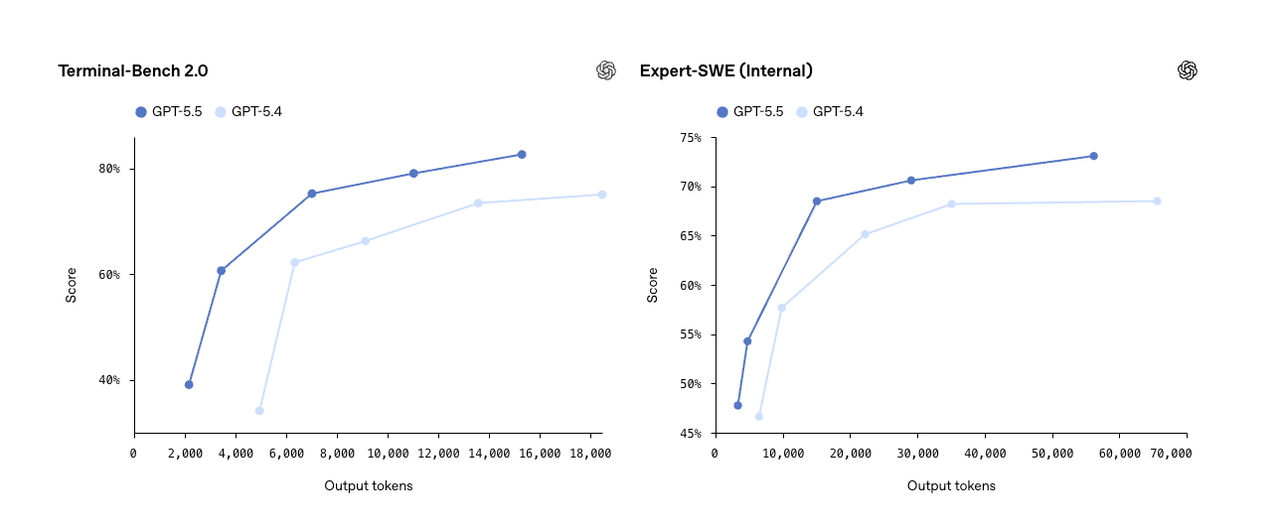

Das Versprechen: „agentisches Coding, Computernutzung, Wissensarbeit, frühe wissenschaftliche Forschung.” Gleiche Latenz wie GPT-5.4, weniger Token pro Aufgabe. OpenAI gibt an, dass GPT-5.5 in der realen Auslieferung die gleiche Token-Latenz wie GPT-5.4 erreicht.

GPT-5.5 in ChatGPT und Codex

Zwei Varianten sind heute in ChatGPT live: GPT-5.5 Thinking (Plus und höher) und GPT-5.5 Pro (Pro / Business / Enterprise).

In Codex ist GPT-5.5 für Plus, Pro, Business, Enterprise, Edu und Go verfügbar, mit einem 400K-Kontextfenster und einem Fast-Modus, der Token etwa 1,5× schneller bei 2,5× den Kosten generiert. Die Codex-Integration ist das, worauf es sich zu achten lohnt. NVIDIA schrieb in ihrem eigenen Engineering-Beitrag, der am selben Tag veröffentlicht wurde, dass über 10.000 ihrer Mitarbeiter über Codex frühen Zugriff hatten und es in den Bereichen Engineering, Recht, Finanzen und Operations einsetzten. Nicht nur Ingenieure. Das ist ein Signal dafür, wohin dieses Modell gedrängt wird — hin zur allgemeinen Computerarbeit, nicht nur zur Code-Vervollständigung.

Notiert. Wir befinden uns aber noch im Day-Zero-Bereich.

Was OpenAI noch nicht veröffentlicht hat

Das ist der Teil, den Entwickler unterstreichen müssen.

Die API ist nicht live. OpenAI sagte, das Modell werde „sehr bald zur API kommen” und dass API-Deployments „andere Sicherheitsvorkehrungen erfordern.” Das ist ein direktes Zitat laut CNBCs Briefing-Berichterstattung. Kein Datum. Kein ETA-Fenster.

Angegebene API-Preise kursieren: $5 pro Million Eingabe-Token, $30 pro Million Ausgabe-Token — ungefähr das Doppelte von GPT-5.4. Diese Zahl habe ich in mehreren sekundären Berichten gesehen, aber OpenAI hat sie noch nicht auf der offiziellen Preisseite veröffentlicht, Stand jetzt. Betrachte sie als verifikationsbedürftig. Wenn du planst, plane nicht auf Basis einer Zahl, die nicht in den Docs steht.

Rate Limits, Tier-Berechtigung, Responses API vs. Chat Completions Verfügbarkeit, Verhalten bei strukturierter Ausgabe, Tool-Calling-Schemata — nichts davon ist für GPT-5.5 bisher dokumentiert. Das bekommst du, wenn die API verfügbar ist.

Warum GPT-5.5 für Entwickler und Produktteams wichtig ist

Kurz gesagt: Wenn du Entwickler bist, ändert die heutige Veröffentlichung nichts an deinem Stack. Sie verändert deinen Planungskalender.

Implikationen für Coding, Computernutzung und Workflow-Automatisierung

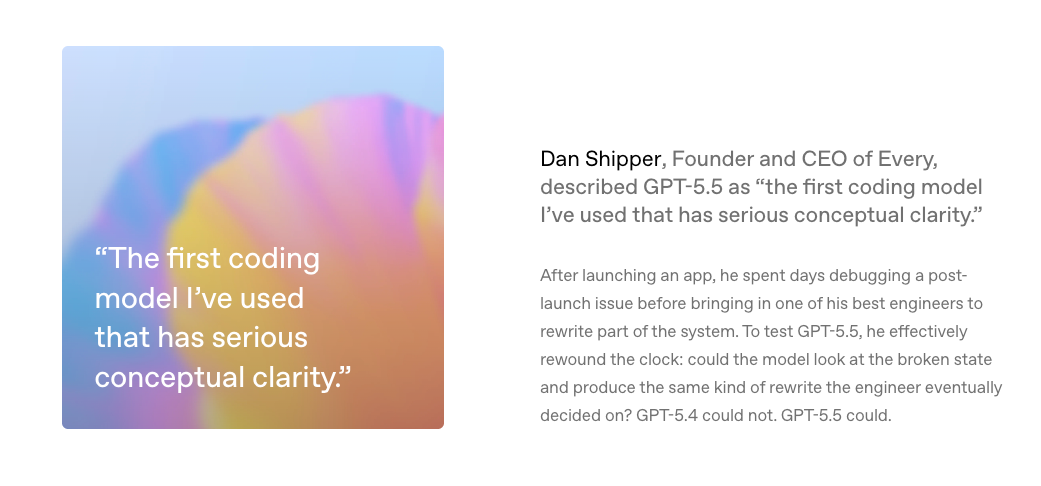

Die Fähigkeitsstory ist real — vorausgesetzt, die Benchmarks halten sich außerhalb von OpenAIs eigenen Evals, was immer eine separate Frage ist. Was OpenAI behauptet, ist ein schärferes Modell bei gleicher Latenz, mit stärkerem Verhalten bei mehrstufigen, mehrdeutigen Aufgaben: Kontext über eine Codebasis hinweg halten, durch einen Fehler denken, die eigene Arbeit überprüfen, weitermachen.

Wenn du einen Coding-Agenten betreibst und bereits Plus oder Pro nutzt, kannst du das jetzt gleich in Codex testen. Das ist der günstigste Weg, einen ersten Eindruck zu gewinnen, bevor du irgendetwas dagegen programmierst.

Wenn du einen Computer-Use-Agenten betreibst — Browser-Automatisierung, Desktop-RPA, alles, was durch Interfaces klickt — ist das der Bereich, den ich genau beobachten würde. OpenAIs Framing rund um „unübersichtliche, mehrteilige Aufgaben” und reduziertes schritt-für-schritt-Prompten ist speziell ein Computer-Use-Anspruch. Aber Computer-Use-Agenten sind der Bereich, in dem Benchmarks und Produktionsverhalten am stärksten auseinanderfallen. Ich würde kein Urteil allein auf Basis von OpenAIs Blog-Beitrag bilden. Ich würde auf Third-Party-Traces warten.

Warum API-getriebene Teams auf den Rollout-Zeitplan achten sollten

Wenn dein Produkt die API aufruft, ist die heutige Veröffentlichung ein Auslöser für drei Fragen:

Erstens: wann muss deine Eval-Suite bereit sein? Wenn die API nächste Woche live geht, willst du, dass deine Evals bereits darauf ausgerichtet sind, und nicht in der Hektik geschrieben werden. OpenAIs jüngste Kadenz — GPT-5.2 kam im Dezember 2025, GPT-5.4 im März, GPT-5.5 Ende April — ist jetzt ein Rhythmus von unter zwei Monaten. Du kannst nicht jede Veröffentlichung als einmalige Integration behandeln.

Zweitens: Was ist dein Fallback, wenn der Preis wirklich 2× ist? Die Verdoppelung deiner Token-Kosten verschiebt den Break-Even bei vielen Features. Das lohnt es sich zu modellieren, bevor die API live geht, nicht danach.

Drittens: Wie unterscheiden sich die „anderen Sicherheitsvorkehrungen”? Dieser Satz trägt viel. Wenn die API-Version mit strengeren Standard-Ablehnungen als ChatGPT ausgeliefert wird, könnte alles Consumer-facing oder Dual-Use regredieren. Teste vor dem Deployment.

Ich habe auf keine dieser Fragen noch Antworten. Niemand außerhalb von OpenAI hat sie. Aber das sind die Fragen, die ich bis Montag auf einem Whiteboard stehen haben möchte.

Was bestätigt ist vs. was noch verifiziert werden muss

Da die Berichterstattung am ersten Tag bestätigte Fakten mit Erwartungen vermischt, hier die Aufteilung, wie ich sie ziehen würde:

| Punkt | Status |

|---|---|

| Veröffentlichungsdatum: 23. April 2026 | Bestätigt — OpenAI offiziell |

| Live in ChatGPT (Plus/Pro/Business/Enterprise) | Bestätigt — OpenAI offiziell |

| Live in Codex (Plus/Pro/Business/Enterprise/Edu/Go) | Bestätigt — OpenAI offiziell |

| 400K Kontext in Codex | Bestätigt — OpenAI offiziell |

| GPT-5.5 Pro nur in ChatGPT verfügbar (Pro/Business/Enterprise) | Bestätigt — OpenAI offiziell |

| Token-Latenz entspricht GPT-5.4 | Von OpenAI behauptet — nicht unabhängig verifiziert |

| Benchmark-Werte (SWE-Bench Pro, BrowseComp, etc.) | Von OpenAI berichtet — noch keine Third-Party-Replikation |

| API-Verfügbarkeit | Noch nicht — „sehr bald”, kein Datum |

| API-Preise (5 $ / 30 $ pro Million Token) | Weit verbreitet berichtet, nicht auf Docs bestätigt, Stand 24. April |

| Rate Limits und Tier-Berechtigung für API | Unbekannt — muss verifiziert werden |

| Ablehnungs-/Sicherheitsverhalten im Vergleich zum ChatGPT-Deployment | Unbekannt — muss verifiziert werden |

Wenn ein Artikel Benchmark-Zahlen zitiert, ohne die erste Zeile von den späteren zu trennen, liest du Marketing. Behalte die Aufteilung bei.

Wer GPT-5.5 genau beobachten sollte und wer warten sollte

Nicht jedes Team muss heute alles stehen und liegen lassen.

Jetzt genau beobachten, wenn: du einen Coding-Agenten oder eine IDE-Integration betreibst, deine Nutzer bereits für Plus oder Pro zahlen (du kannst über die bestehende Oberfläche testen), oder du Computer-Use- / Browser-Automatisierungs-Tooling entwickelst, bei dem die Fähigkeitsbehauptungen am meisten zählen.

Vorbereiten, aber nicht migrieren: du lieferst ein API-basiertes Produkt und deine Roadmap hängt von diesem Modell ab. Bereite deine Evals vor. Modelliere die Preise. Plane ein Testfenster für den Moment, wenn die API freigeschaltet wird.

Warten: du bist in einem Nicht-Coding-Team ohne einen spezifischen Workflow, den das hier entblockt. Eine Woche Benchmarks von Menschen, die nicht OpenAI sind, wird dir mehr sagen als jede heutige Berichterstattung. Die Veröffentlichungskadenz ist so schnell, dass das Hinterherjagen nach jedem Drop ein Vollzeitjob mit niedrigem ROI ist.

Dieser letzte Punkt verdient Beachtung. TechCrunchs Bericht rahmte diese Veröffentlichung als einen Schritt in Richtung von OpenAIs „Super-App”-Ambitionen — die Idee, ChatGPT, Codex und Browsing in ein Produkt zu konsolidieren. Das ist ein strategischer Hinweis, keine Produktentscheidung, die du diese Woche treffen musst.

FAQ

Ist GPT-5.5 in der API verfügbar?

Nein. Nicht Stand 24. April 2026. OpenAI sagt, API-Zugriff komme „sehr bald”, ohne ein Datum zu nennen. Plane nicht auf Basis einer Preis- oder Rate-Limit-Zahl, die noch nicht in den offiziellen Docs steht.

Ist GPT-5.5 live in ChatGPT und Codex?

Ja. In ChatGPT für Plus-, Pro-, Business- und Enterprise-Nutzer. In Codex für Plus-, Pro-, Business-, Enterprise-, Edu- und Go-Pläne. GPT-5.5 Pro ist nur in ChatGPT verfügbar und ab Pro-Tier aufwärts.

Was sollten Teams vor der Adoptionsplanung verifizieren?

Drei Dinge, sobald die API verfügbar ist: tatsächliche Preise auf der offiziellen Preisseite, Rate Limits und Tier-Berechtigung für deinen Plan sowie das Ablehnungsverhalten bei allen Dual-Use- oder agentischen Workloads, die du betreibst. OpenAI hat explizit „andere Sicherheitsvorkehrungen” für das API-Serving erwähnt, was es wert ist, zu testen statt anzunehmen.

Ist GPT-5.5 für Nicht-Coding-Teams relevant?

Wahrscheinlich, aber nicht dringend. Die Fähigkeitsgewinne, die OpenAI bewirbt, sind am stärksten beim agentischen Coding und der Computernutzung. Wissensarbeitsgewinne sind real, aber inkrementell. Wenn dein Team nicht bereits durch Modellqualität bei mehrstufigen Aufgaben gebremst wird, reicht GPT-5.4 für jetzt.

Fazit

GPT-5.5 ist heute erschienen. Es ist in ChatGPT und Codex. Es ist nicht in der API. Das ist die gesamte Geschichte für Entwickler in einem Satz.

Alles andere — die Benchmarks, die Preise, das „Super-App”-Framing, die Vergleiche mit konkurrierenden Labs — ist entweder unverifiziert oder noch nicht umsetzbar. Das Sinnvolle diese Woche ist, deine Evals vorzubereiten und deine Fallback-Pläne zu modellieren, sodass du, wenn die API freigeschaltet wird, in wenigen Stunden dein eigenes Urteil bilden kannst, anstatt eine Woche voller Thread-Stürme hinterherzujagen.

Dort enden meine Daten. Fortsetzung nächste Woche, sobald die API-Oberfläche live ist und jemand außerhalb von OpenAI echte Workloads damit ausgeführt hat.

Vorherige Beiträge: