SeedVR2 en ligne : Comment l'utiliser

Découvrez comment SeedVR2 en ligne fonctionne, quels flux de travail il prend en charge et à quoi vous attendre avant de l'utiliser pour des tâches d'upscaling.

Bonjour, je m’appelle Dora. Quelqu’un a mentionné SeedVR2 dans un fil Discord que je suivais. Ils ont dit qu’ils l’avaient « utilisé en ligne ». J’ai donc cherché. Et je me suis immédiatement retrouvée face à une multitude de démos Gradio, d’interfaces tierces, de playgrounds API, et au moins un site suspect qui n’avait visiblement aucun lien avec l’équipe de recherche de ByteDance.

Voici ce que personne ne dit d’emblée : il n’existe pas de produit unique appelé « SeedVR2 Online ». Cette expression désigne au moins trois choses différentes selon l’endroit où vous atterrissez. Et si vous ne savez pas lequel vous utilisez réellement, vos résultats — et vos attentes — seront faussés.

Laissez-moi démêler tout ça.

Ce que « SeedVR2 Online » signifie généralement

SeedVR2 est un modèle de restauration vidéo développé par l’équipe ByteDance Seed. Il a été accepté à ICLR 2026 et le code de recherche est disponible publiquement. C’est un Diffusion Transformer en une seule étape conçu pour la restauration vidéo générique, capable de traiter des entrées haute résolution grâce à un mécanisme d’attention par fenêtre adaptative. Voilà le vrai produit.

Mais « SeedVR2 online » en tant que requête de recherche renvoie à quelque chose de différent du modèle lui-même. Une confusion similaire se produit avec les nouveaux modèles de génération vidéo IA comme Seedance 2.0, où les gens cherchent souvent une « version en ligne » plutôt que le modèle sous-jacent. Cela fait apparaître des points d’accès au modèle. Et ce n’est pas la même chose.

Démo hébergée, interface ou service de workflow

Quand quelqu’un dit avoir utilisé SeedVR2 en ligne, il désigne probablement l’un de ces cas :

Une démo Gradio hébergée. ByteDance a publié une démo officielle sur Hugging Face Spaces. Elle exécute le modèle SeedVR2-3B et prend en charge les entrées images et vidéos via une interface de type API. C’est ce qui se rapproche le plus d’une version « officielle » en ligne — mais c’est une démo de recherche, pas un produit. Les temps d’attente peuvent être longs. La disponibilité n’est pas garantie.

Une interface tierce. Des développeurs ont créé des nœuds ComfyUI, des déploiements Replicate et des outils autonomes autour du même modèle sous-jacent. Ceux-ci fonctionnent sur l’infrastructure de quelqu’un d’autre, parfois gratuitement, parfois avec des crédits ou des abonnements payants. Ils peuvent sembler soignés. Ce ne sont pas des produits ByteDance.

Une intégration de plateforme. Certaines plateformes de génération IA ont ajouté SeedVR2 comme option dans leur catalogue de modèles. Vous utilisez les mêmes poids de modèle, mais via l’interface et le système de facturation de quelqu’un d’autre.

Pourquoi les utilisateurs sont confus sur ce qui est « officiel »

La confusion est compréhensible. Une incertitude similaire apparaît lorsque les gens lisent des comparaisons entre les modèles vidéo IA modernes et supposent que chacun dispose d’une interface officielle unique. Le modèle est open-source sous licence Apache 2.0. Cela signifie que n’importe qui peut l’héberger, l’encapsuler et l’appeler SeedVR2. Il n’y a pas de processus de certification ou de contrôle de marque.

Ainsi, quand vous cherchez « SeedVR2 online », vous pouvez atterrir sur :

- Le vrai Hugging Face Space géré par ByteDance-Seed

- Un déploiement ComfyUI communautaire

- Un service tiers de mise à l’échelle vidéo qui utilise SeedVR2 comme moteur

- Quelque chose qui porte SeedVR2 dans son nom mais qui n’y est pas lié

Avant d’uploader vos vidéos, ça vaut la peine de passer 30 secondes à vérifier lequel vous utilisez vraiment.

Quand SeedVR2 Online vaut la peine d’être testé

Je vais être directe. L’accès en ligne à SeedVR2 a du sens dans des situations précises. En dehors de celles-ci, il peut frustrer plus qu’il n’aide.

Test rapide

Si vous avez vu des exemples de résultats et voulez savoir si le style du modèle convient à vos vidéos — essayez-le en ligne d’abord. Vous n’avez rien à installer. Vous n’avez pas besoin d’un GPU. Vous pouvez uploader un court clip et voir ce qui revient.

C’est vraiment utile. J’ai testé la démo Hugging Face sur un court extrait de vidéo dégradée que j’avais prévu de nettoyer. Le temps de traitement était lent, mais le résultat m’a dit tout ce que j’avais besoin de savoir avant de m’engager dans une installation locale.

Aucune configuration locale requise

Exécuter SeedVR2 en local nécessite du matériel sérieux. La documentation officielle indique qu’un GPU H100-80GB peut traiter des vidéos 720p jusqu’à 100 images, et que quatre cartes H100-80GB sont nécessaires pour une résolution 1080p ou 2K. La plupart des gens ne disposent pas de ça. L’accès en ligne comble cette lacune — au prix de la flexibilité, de la vitesse et du contrôle.

Si vous êtes un créateur qui a juste besoin d’un nettoyage vidéo occasionnel sans construire un pipeline local, les options en ligne sont raisonnables à explorer.

Comment utiliser SeedVR2 en ligne

Bases des entrées et sorties

La plupart des points d’accès en ligne suivent le même schéma général :

- Uploadez votre vidéo source (généralement MP4, parfois des frames)

- Définissez une résolution cible ou un multiplicateur de mise à l’échelle

- Soumettez et attendez

La sortie est une version restaurée de votre clip — plus nette, avec moins de bruit et d’artefacts de compression, mise à l’échelle selon votre résolution cible.

Ce que vous ne contrôlerez probablement pas en ligne : la taille des lots, la taille de la fenêtre d’attention, la variante du modèle (3B vs 7B), ou les options de post-traitement comme la correction des couleurs par ondelettes. Ces réglages se trouvent dans les outils locaux.

Paramètres auxquels prêter attention

Si l’interface vous offre des options, quelques-unes méritent d’être comprises :

La résolution cible. Le modèle est conçu pour une sortie haute résolution. N’entrez pas une cible inférieure à votre source — vous obtiendrez un traitement inutile sans gain visuel.

Le mode de correction des couleurs. Certaines interfaces exposent ce paramètre. L’implémentation ComfyUI offre plusieurs options de correspondance des couleurs, dont un mode « lab » décrit comme une correspondance colorimétrique perceptuelle complète pour la plus haute fidélité à l’original, et un mode « wavelet » pour des couleurs naturelles basées sur les fréquences. Si vous voyez ces options, « wavelet » est généralement le choix le plus sûr pour des vidéos inconnues.

La durée du clip. Gardez vos clips de test courts — moins de 30 secondes si possible. Les clips longs ralentissent la file d’attente pour tout le monde et sont plus difficiles à déboguer si quelque chose semble incorrect.

Ce que vous pouvez et ne pouvez pas en attendre

Limites de performance

Les outils en ligne sont bridés. Surtout les gratuits. Si vous êtes sur une démo partagée hébergée sur des ressources de calcul limitées, attendez-vous à :

- Des files d’attente aux heures de pointe

- Des temps de traitement de plusieurs minutes même pour de courts clips

- Des timeouts ou des tâches abandonnées occasionnels

C’est un problème de file d’attente et d’infrastructure, pas un problème de modèle.

Attentes en matière de qualité

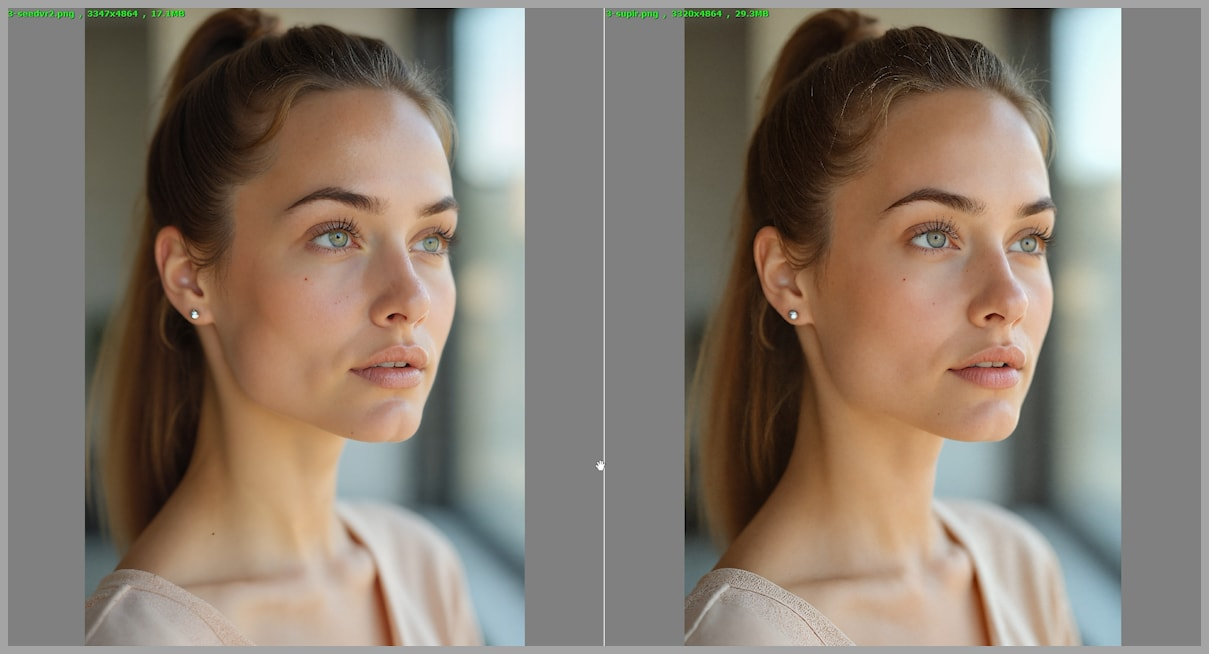

Le modèle lui-même est capable. La fiche modèle de ByteDance-Seed note qu’il peut parfois générer excessivement des détails sur des entrées avec des dégradations très légères — par exemple, des vidéos AIGC en 720p — entraînant occasionnellement des résultats sur-accentués. Des artefacts de mouvement peuvent également apparaître dans les pipelines vidéo génératifs, c’est pourquoi de nombreux créateurs apprennent comment corriger les scintillements et les saccades dans les vidéos générées par IA lorsqu’ils travaillent avec des modèles de restauration. C’est une vraie limitation à connaître avant de traiter quoi que ce soit qui compte pour vous.

Pour des vidéos avec une dégradation réelle — bruit, flou, artefacts de compression — les résultats sont souvent nettement meilleurs. Pour des vidéos déjà propres, le modèle pourrait en réalité rendre les choses moins naturelles.

Pourquoi l’utilisation en ligne n’est pas équivalente à une utilisation en workflow complet

L’écart est significatif. Les déploiements locaux via ComfyUI, par exemple, vous permettent de contrôler la taille des lots, de passer entre les variantes de modèle 3B et 7B, d’activer la quantification GGUF pour une utilisation VRAM réduite, et d’enchaîner SeedVR2 avec d’autres nœuds dans un pipeline. Ce niveau de contrôle n’existe pas dans la plupart des interfaces en ligne.

Si vous construisez un processus répétable — disons, traiter des vidéos d’une prise de vue régulière — l’accès en ligne atteindra rapidement ses limites.

SeedVR2 en ligne vs API vs configuration en workflow

| Catégorie | Démo en ligne | API / Plateforme | Workflow local |

|---|---|---|---|

| Configuration requise | Aucune | Minimale | Significative |

| Vitesse | Lente (partagée) | Moyenne | Rapide (votre GPU) |

| Contrôle | Faible | Moyen | Élevé |

| Coût | Gratuit / Crédits | Paiement à l’usage | Coût matériel |

| Fiabilité | Variable | Plus stable | Stable |

| Traitement par lots | Non | Parfois | Oui |

Idéal pour une utilisation rapide

Les démos en ligne et les plateformes hébergées sont adaptées aux tests ponctuels, aux comparaisons rapides et aux situations où vous n’avez pas accès à une machine locale performante. Le SeedVR2-3B Hugging Face Space hébergé par ByteDance-Seed est ce qui se rapproche le plus d’un point de contact officiel si vous voulez essayer le modèle sans vous engager dans quoi que ce soit.

Idéal pour une utilisation en production répétable

Si vous traitez des vidéos régulièrement, le nœud ComfyUI-SeedVR2_VideoUpscaler est l’outil sur lequel la plupart des créateurs se sont arrêtés. Il est construit par la communauté mais activement maintenu, avec un support de quantification GGUF qui le rend accessible sur les GPU grand public. Pour référence, les poids officiels du modèle et les détails d’architecture sont documentés dans le dépôt ByteDance-Seed/SeedVR sur GitHub.

Verdict personnel

J’ai utilisé SeedVR2 à la fois via la démo Hugging Face et en local via ComfyUI. Ce n’est pas la même expérience.

La démo en ligne est utile pour exactement une chose : décider si SeedVR2 vaut votre temps. Elle a répondu à cette question pour moi en une seule session. Mais je ne l’utiliserais pas pour quelque chose que j’aurais réellement besoin de livrer.

Qui devrait l’essayer

Vous, si :

- Vous voulez tester si le modèle convient à vos vidéos avant d’installer quoi que ce soit

- Vous restaurez occasionnellement un clip et n’avez pas besoin d’un pipeline répétable

- Vous n’avez pas de ressources GPU locales et acceptez un délai de traitement plus long

Qui devrait l’éviter

Vous, si :

- Vous traitez plus d’une poignée de clips par semaine

- Vous avez besoin de résultats cohérents que vous pouvez reproduire

- Vous tenez à contrôler la netteté de la sortie, la correspondance des couleurs ou la taille du modèle

Pour toute personne sérieusement intéressée par la place de ce modèle dans le paysage de la recherche, le papier original SeedVR2 sur arXiv (2506.05301) vaut la peine d’être lu — il est plus accessible que la plupart des articles académiques et explique clairement l’approche de restauration en une seule étape.

L’expression « SeedVR2 online » va probablement continuer à semer la confusion pendant un moment. Il n’y a pas de produit unique à désigner. Il y a un modèle, quelques démos officielles, et un nombre croissant d’outils communautaires construits autour de lui. Ce n’est pas une mauvaise chose — cela signifie simplement que vous devez savoir par quelle porte vous entrez réellement avant de décider si ça vaut votre temps. Au revoir, mes chers~