Téléchargement de Real-ESRGAN : Guide d'installation et d'utilisation

Apprenez à télécharger Real-ESRGAN, à l'installer en toute sécurité et à commencer à l'utiliser pour le suréchantillonnage avec moins d'erreurs de configuration.

Bonjour, je m’appelle Dora. La première fois que j’ai tapé “real-esrgan download”, je ne cherchais pas un miracle. Je voulais simplement nettoyer une photo de produit floue sans ouvrir une dizaine d’onglets ni me battre avec une interface graphique qui essaie d’être utile. J’avais vu Real-ESRGAN mentionné pendant des années, mais je le passais toujours, car chaque guide sonnait plus fort que l’outil. Début mars 2026, je me suis enfin assise avec un objectif tranquille : l’installer en toute sécurité, traiter quelques images et voir où il s’intègre.

Voici ce que j’ai appris, ce que Real-ESRGAN fait encore bien, où le télécharger sans complications, et les petits pièges de configuration qui m’ont fait trébucher avant de devenir des automatismes.

À quoi Real-ESRGAN excelle

Bases du suréchantillonnage d’image

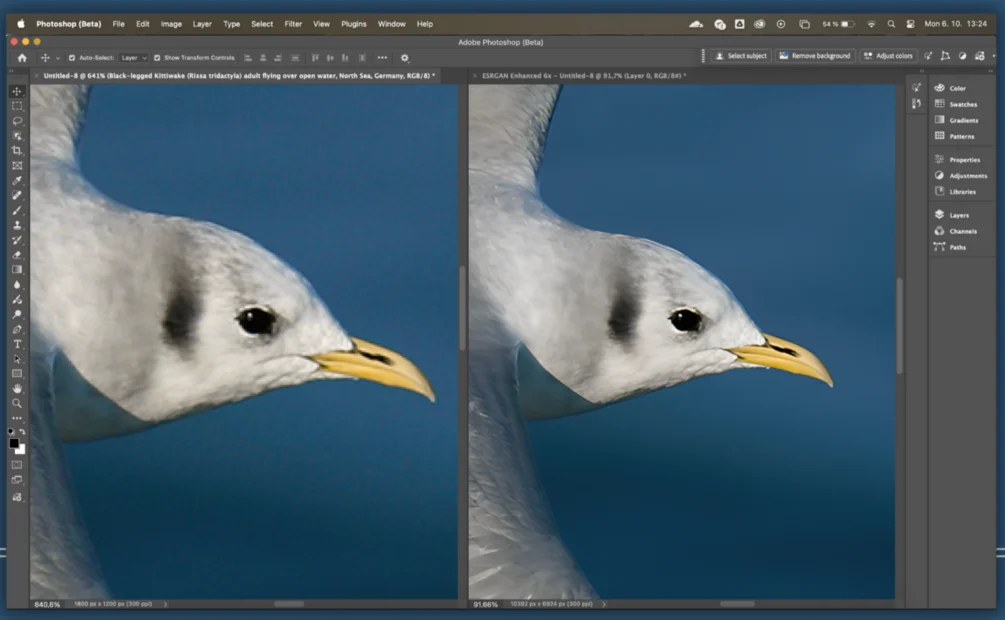

Je considère le suréchantillonnage comme une réparation plutôt que comme de la magie. Real-ESRGAN prend une image en basse résolution et prédit les détails manquants afin que vous puissiez l’utiliser à une échelle de 2× ou 4× sans bords craquants. Il est entraîné sur des dégradations du monde réel (pas seulement du bruit de laboratoire soigné), ce qui importe lorsque votre source est une capture d’écran d’un blog de 2017 ou une photo WhatsApp compressée que vous ne pouvez pas reprendre.

Lors de mes tests en mars 2026 sur un ordinateur portable Windows 11 (RTX 3060) et un MacBook Air (M2), Real-ESRGAN a produit des résultats solides et constants sur :

- Les anciennes captures d’écran d’interface utilisateur et les graphiques de présentation

- Les étiquettes de produits, les emballages et les textures simples

- Les logos sans texte minuscule

Ce n’est pas un outil “wow”, c’est un outil fiable. C’est un compliment.

Là où il tient encore la route

Je l’ai comparé à quelques options payantes et enveloppes que j’utilise déjà. Real-ESRGAN s’en sort quand :

- L’entrée est relativement propre mais petite. Il remplit les bords sans inventer de détails tape-à-l’œil.

- Vous vous souciez de la cohérence sur un lot (bannières pour les réseaux sociaux, images de documentation) plutôt que de la perfection par image.

- Vous voulez un processus scriptable qui ne changera pas d’avis chaque mois. Les développeurs qui préfèrent les pipelines API explorent souvent des guides sur comment utiliser l’API Z-Image Turbo pour les flux de travail de génération d’images automatisés.

Là où il peine : les textes très fins, les visages et les scènes naturelles chargées (feuillage, cheveux). Vous pouvez l’associer à un outil de correction de visage, mais je préfère garder des attentes simples : suréchantillonner d’abord, puis décider si cela nécessite une seconde passe ailleurs.

Où télécharger Real-ESRGAN en toute sécurité

Sources officielles ou de confiance

Cette partie est importante. Les résultats de recherche sont bruyants, et les versions miroir peuvent réserver des surprises. Ce qui a fonctionné pour moi :

- Dépôt officiel : Real-ESRGAN sur GitHub (xinntao)

- Idéal pour l’implémentation Python/PyTorch, la documentation et le script d’inférence.

- CLI précompilé (rapide, sans Python) : les versions realesrgan-ncnn-vulkan et le dépôt binaire maintenu par nihui qui y est lié. Ce sont de petits outils en ligne de commande pour Windows, macOS et Linux.

- PyPI (si vous préférez pip) : realesrgan sur PyPI, vérifiez le mainteneur et les notes de version par rapport au readme GitHub avant de lui faire confiance sur un serveur de production.

- Pour les spécificités CUDA/PyTorch : installez depuis le site officiel PyTorch pour correspondre à vos pilotes GPU.

Une règle simple que je suis : si une page ne renvoie pas vers le dépôt GitHub principal ou le profil du mainteneur, je fais demi-tour.

Les fichiers dont vous avez réellement besoin

Cela dépend de votre approche :

- Binaires ncnn-vulkan (démarrage rapide) : téléchargez l’archive pour votre système d’exploitation depuis la page des versions. Elle inclut l’exécutable et les fichiers de modèles. Décompressez-la quelque part que vous contrôlez (par exemple, un dossier outils, pas Téléchargements).

- Route Python/PyTorch : clonez le dépôt depuis GitHub, puis récupérez les poids du modèle. Les plus courants sont :

- RealESRGAN_x4plus.pth (général 4×)

- RealESRGAN_x4plus_anime_6B.pth (anime/art au trait)

Si un téléchargement demande un installateur avec des modifications à l’échelle du système pour un simple CLI, je marque une pause. Les archives portables et les dépôts clonés m’ont suffi.

Comment installer Real-ESRGAN

Chemin d’installation de base

J’ai essayé deux chemins en mars 2026 :

- ncnn-vulkan (zéro Python, le plus rapide pour obtenir un premier résultat)

- Téléchargez le dernier zip realesrgan-ncnn-vulkan pour votre système d’exploitation.

- Décompressez-le dans quelque chose comme C:/tools/realesrgan ou ~/tools/realesrgan.

- Optionnel : ajoutez le dossier au PATH pour pouvoir exécuter la commande de n’importe où. Au début, je ne l’ai pas fait : je naviguais simplement dans le dossier avec cd. Les deux fonctionnent.

- Python/PyTorch (plus flexible, scriptable)

- Installez PyTorch avec la bonne version CUDA (sur Windows avec NVIDIA) depuis le sélecteur officiel. Mon 3060 avait besoin des pilotes CUDA 12.x : les incompatibilités provoquent des erreurs cryptiques.

- Clonez le dépôt Real-ESRGAN depuis GitHub.

- Installez les dépendances avec pip dans un environnement virtuel.

- Téléchargez les poids du modèle .pth dans le dossier weights (le readme du dépôt indique les chemins exacts). Utilisez ensuite le script d’inférence fourni.

Les deux chemins conviennent. Si vous voulez juste suréchantillonner des images sans toucher à Python, ncnn-vulkan est le démarrage le plus serein.

Ce que les nouveaux utilisateurs ratent généralement

Ces points m’ont aussi fait trébucher :

- Placement du modèle : le script Python recherche les modèles dans des dossiers spécifiques. S’il ne trouve pas de fichier .pth, il choisit silencieusement un défaut ou plante.

- Attentes GPU : PyTorch veut une version CUDA qui correspond à votre pilote. Si “torch.cuda.is_available()” est False alors que vous attendiez True, vous n’êtes pas fou, vos versions ne correspondent tout simplement pas.

- Tuiles et mémoire : les suréchantillonnages 4× sur de grandes images peuvent atteindre les limites VRAM. Des tailles de tuiles plus petites aident, même si c’est un peu plus lent.

- Noms de fichiers avec des espaces : le CLI s’en sort bien avec des guillemets, mais je garde quand même les fichiers de test simples jusqu’à ce que tout fonctionne.

Comment exécuter votre premier test

Flux de travail d’entrée d’image

J’ai commencé avec une petite capture d’écran laide. Avec ncnn-vulkan, depuis le dossier extrait :

- Sur Windows ou macOS Terminal :

./realesrgan-ncnn-vulkan -i input.jpg -o output.png

Cela utilise le modèle 4× par défaut. Si cela fonctionne, vous êtes sur la bonne voie.

Avec le script Python (depuis la racine du dépôt) :

python inference_realesrgan.py -n RealESRGAN_x4plus -i path/to/input.jpg -o path/to/output.png --outscale 4

La première exécution m’a pris quelques minutes de bout en bout, surtout parce que j’ai vérifié deux fois que j’utilisais le bon modèle. Après deux ou trois images, j’ai arrêté d’y penser.

Paramètres de sortie pour les débutants

Je garde les choses simples au début :

- Échelle : 2× pour les images de réseaux sociaux que vous compresserez à nouveau ; 4× quand vous avez besoin de plus d’espace pour recadrer.

- Format : PNG quand vous allez éditer davantage ; JPEG quand vous avez terminé et que vous voulez des fichiers plus petits.

- Modèle : x4plus pour les photos générales et les interfaces ; le modèle anime pour l’art au trait, les icônes ou l’art de style manga.

Si le résultat semble un peu “plastique”, j’essaie 2× au lieu de 4× et j’affine légèrement dans un éditeur. Et si les petits textes restent flous, j’accepte la limite et remplace le texte manuellement. Ce n’est pas un échec, c’est simplement la frontière honnête du modèle.

Problèmes courants de configuration et solutions

Dépendances manquantes

- PyTorch ne voit pas votre GPU : réinstallez PyTorch avec la version CUDA exacte que votre pilote supporte (utilisez le sélecteur officiel). Si vous êtes sur un GPU de laptop, mettez d’abord les pilotes à jour.

- Runtime Visual C++ sur Windows : si le binaire se plaint de DLL manquantes, installez le dernier Microsoft Visual C++ Redistributable.

- Permissions macOS : si l’application vient d‘“un développeur non identifié”, faites un clic droit Ouvrir une fois pour la mettre en liste blanche.

Problèmes de chemin / fichier de modèle

- Route Python : assurez-vous que les fichiers .pth se trouvent dans le dossier weights que le script attend. Utilisez l’indicateur de nom de modèle exact (par exemple,

-n RealESRGAN_x4plus). - ncnn-vulkan : exécutez depuis le dossier avec l’exécutable et les modèles, ou fournissez des chemins complets. S’il dit qu’il ne peut pas charger le modèle, vous avez probablement déplacé l’exe sans les modèles.

- Espaces dans les chemins : mettez-les entre guillemets. Je préfère toujours des chemins courts et simples pour les scripts répétables.

Problèmes GPU ou de performances

- Erreurs VRAM : réduisez la taille des tuiles (les deux implémentations prennent en charge le tuilage). C’est plus lent mais plus stable.

- Problèmes avec le backend Vulkan : mettez à jour les pilotes GPU. Sur les anciens iGPU Intel, je l’ai vu échouer silencieusement : essayer une autre machine m’a fait gagner du temps.

- Thermique sur les laptops : les longs lots feront throttler. Je règle un nombre de threads plus doux ou je prends des pauses entre les chunks. Lent vaut mieux qu’un crash à 95%.

Real-ESRGAN dans un vrai flux de travail

Quand il suffit seul

Real-ESRGAN gagne sa place sur les tâches tranquilles et répétables :

- Rafraîchir les anciennes captures d’écran pour la documentation sans recapturer les flux

- Rendre de petites photos de produits utilisables pour une newsletter, ou même transformer des photos de produits en courtes vidéos IA, ce que certains créateurs font désormais avec des outils comme Seedance.

- Suréchantillonner les icônes et les graphiques simples avant une passe de design

Dans mes tests de mars, un lot de 40 captures d’écran a pris environ 8 à 10 minutes sur le 3060 avec ncnn-vulkan. Pas plus rapide que certaines interfaces graphiques, mais moins exigeant pour mon attention. Lancer, vérifier une fois, passer à autre chose.

Quand les utilisateurs passent à Topaz ou aux enveloppes

Si vous voulez une interface conviviale, des préréglages de lot, ou un générateur d’images IA plus moderne comme Z-Image Turbo, les enveloppes et les applications payantes aident.

- Upscayl et chaiNNer donnent à Real‑ESRGAN une interface simple.

- Topaz Gigapixel AI tend à mieux s’en sortir avec les visages, les cheveux et les textures naturelles chargées. Il gère également les recadrages agressifs avec moins d’halos.

Je reviens quand même à Real-ESRGAN en premier quand j’ai besoin d’un 2×/4× fiable sans chichis. Si l’image résiste — petit texte serif, arrière-plans bruités — j’essaie une seconde passe dans un autre outil. Pas d’héroïsme, juste un coup de pouce là où ça aide.

Une petite note sur “real-esrgan download” : chercher l’expression exacte m’amenait constamment vers des sites agrégateurs. Les liens GitHub officiels restent le chemin le plus propre. Si vous faites face à des contraintes similaires, cela vaut le détour. Je n’ai pas de conclusion nette ici, seulement que l’outil s’est fondu dans l’arrière-plan après un jour, ce qui est généralement mon signe pour le garder.