Qu'est-ce que GPT-5.5 pour les développeurs en 2026 ?

Comprenez ce que GPT-5.5 a officiellement lancé, où il est disponible aujourd'hui, et ce que les développeurs doivent vérifier avant de planifier une adoption en production.

OpenAI a publié GPT-5.5 le 23 avril 2026. Au moment où j’écris ces lignes, le modèle est sorti depuis moins d’un jour.

Si vous gérez un agent de codage, un produit qui enveloppe un modèle, ou tout workflow dépendant d’un accès API, le titre n’est pas « nouveau modèle plus intelligent. » Le titre, c’est où vous pouvez réellement l’utiliser, et où vous ne pouvez pas encore. Ce sont deux histoires différentes, et la plupart des articles de presse les brouillent.

Ce texte est un journal court et daté de ce qui a été livré, de ce qui est encore en attente, et des endroits où j’attendrais avant de réécrire quoi que ce soit.

Ce qu’OpenAI a officiellement publié le 23 avril 2026

D’après l’annonce officielle d’OpenAI, GPT-5.5 est déployé aujourd’hui pour les utilisateurs Plus, Pro, Business et Enterprise dans ChatGPT et Codex. GPT-5.5 Pro est réservé aux utilisateurs Pro, Business et Enterprise dans ChatGPT. Voilà l’étendue complète de la publication d’aujourd’hui.

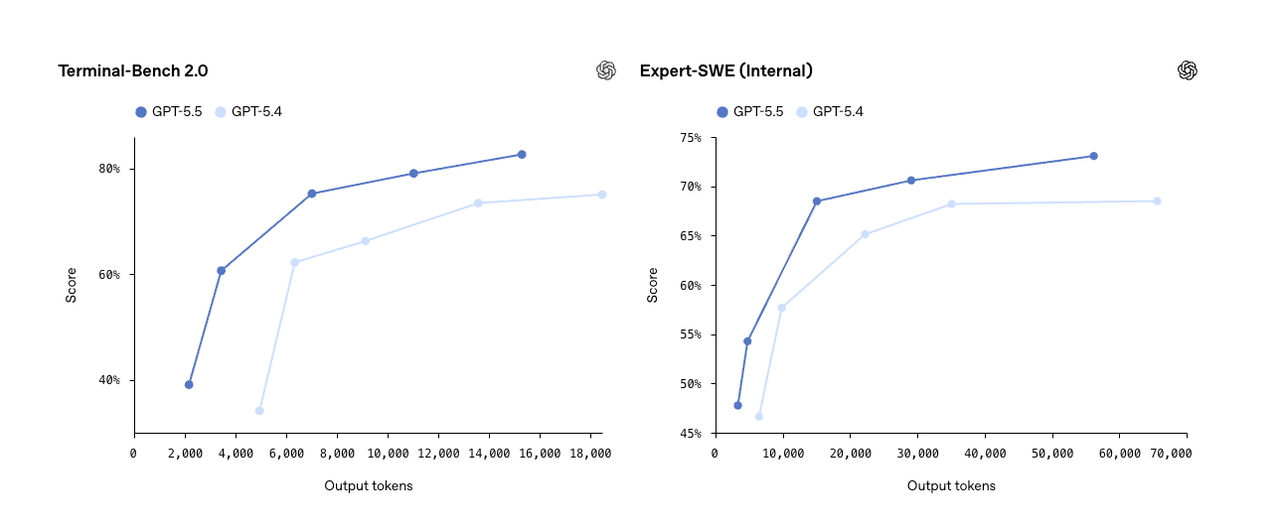

L’argumentaire est « codage agentique, utilisation de l’ordinateur, travail de connaissance, recherche scientifique précoce. » Latence identique à GPT-5.4, moins de tokens par tâche. OpenAI affirme que GPT-5.5 égale GPT-5.4 en latence par token dans des conditions réelles.

GPT-5.5 dans ChatGPT et Codex

Deux variantes sont disponibles aujourd’hui dans ChatGPT : GPT-5.5 Thinking (Plus et supérieur) et GPT-5.5 Pro (Pro / Business / Enterprise).

Dans Codex, GPT-5.5 est disponible pour les plans Plus, Pro, Business, Enterprise, Edu et Go, avec une fenêtre de contexte de 400 000 tokens et un mode Fast qui génère des tokens environ 1,5× plus vite à 2,5× le coût. L’intégration Codex est la partie qui mérite attention. NVIDIA, dans leur propre article d’ingénierie publié le même jour, a indiqué que plus de 10 000 de leurs employés avaient bénéficié d’un accès anticipé via Codex et l’avaient utilisé dans des domaines comme l’ingénierie, le juridique, la finance et les opérations. Pas seulement des ingénieurs. C’est un signal sur la direction que prend ce modèle — vers le travail informatique général, pas seulement la complétion de code.

À noter. On reste cependant en territoire jour zéro.

Ce qu’OpenAI n’a pas encore publié

C’est la partie que les développeurs doivent souligner.

L’API n’est pas disponible. OpenAI a indiqué que le modèle « arrivera très prochainement dans l’API » et que les déploiements API « nécessitent des garde-fous différents. » C’est une citation directe selon la couverture du briefing par CNBC. Pas de date. Pas de fenêtre temporelle.

Le prix de l’API annoncé circule : $5 par million de tokens en entrée, $30 par million de tokens en sortie — soit environ le double de GPT-5.4. J’ai vu ce chiffre dans plusieurs articles secondaires, mais OpenAI ne l’a pas encore publié sur la page de tarification officielle au moment où j’écris. Traitez-le comme nécessitant vérification. Si vous budgétisez, ne planifiez pas sur un chiffre qui ne figure pas dans la documentation.

Les limites de débit, l’éligibilité par niveau, la disponibilité de l’API Responses vs Chat Completions, le comportement des sorties structurées, les schémas d’appel d’outils — rien de tout cela n’est documenté pour GPT-5.5 pour l’instant. Vous aurez ces informations quand l’API sera disponible.

Pourquoi GPT-5.5 compte pour les développeurs et les équipes produit

En bref : si vous êtes développeur, la publication d’aujourd’hui ne change pas votre stack. Elle change votre calendrier de planification.

Implications pour le codage, l’utilisation de l’ordinateur et l’automatisation des workflows

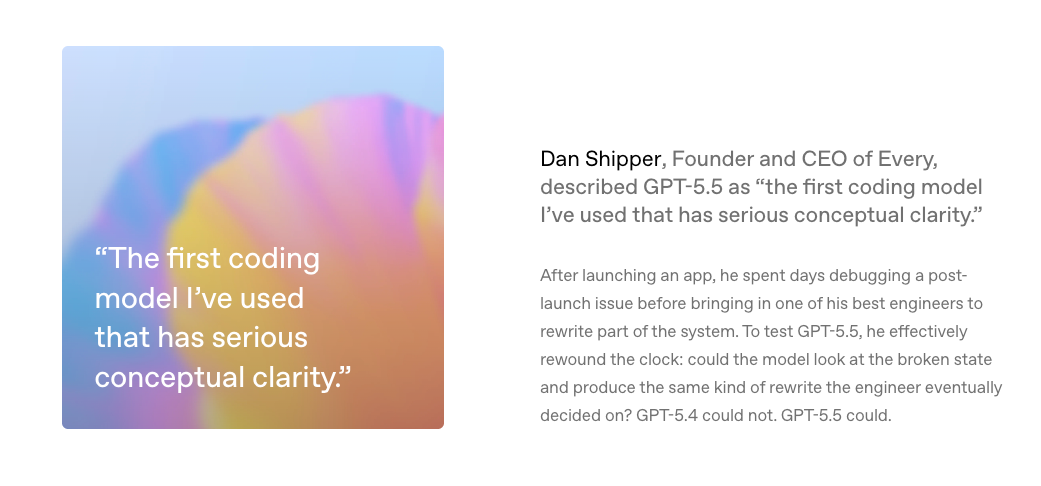

L’histoire des capacités est réelle — en supposant que les benchmarks tiennent hors des propres évaluations d’OpenAI, ce qui est toujours une question distincte. Ce qu’OpenAI revendique, c’est un modèle plus précis à la même latence, avec un comportement plus solide sur les tâches multi-étapes et ambiguës : maintenir le contexte sur une base de code, raisonner face à un échec, vérifier son propre travail, continuer.

Si vous gérez un agent de codage et êtes déjà sur Plus ou Pro, vous pouvez tester cela dans Codex maintenant. C’est le moyen le moins coûteux de former une première impression avant d’écrire du code contre ce modèle.

Si vous gérez un agent d’utilisation d’ordinateur — automatisation de navigateur, RPA de bureau, tout ce qui clique à travers des interfaces — c’est là que je regarderais de près. Le cadrage d’OpenAI autour des « tâches désordonnées et multi-parties » et de la réduction des instructions étape par étape est spécifiquement une affirmation sur l’utilisation de l’ordinateur. Mais les agents d’utilisation d’ordinateur sont là où les benchmarks et le comportement en production divergent le plus. Je ne me formerais pas un jugement uniquement à partir du billet de blog d’OpenAI. J’attendrais des traces tierces.

Pourquoi les équipes axées sur l’API devraient se préoccuper du calendrier de déploiement

Si votre produit appelle l’API, la publication d’aujourd’hui est un catalyseur pour trois questions :

Première : quand votre suite d’évaluation doit-elle être prête ? Si l’API arrive la semaine prochaine, vous voulez que vos évaluations soient déjà pointées dessus, pas écrites dans la précipitation. La cadence récente d’OpenAI — GPT-5.2 a été livré en décembre 2025, GPT-5.4 en mars, GPT-5.5 fin avril — est maintenant un rythme inférieur à deux mois. Vous ne pouvez pas traiter chaque publication comme une intégration ponctuelle.

Deuxième : quel est votre plan de repli si le prix est vraiment 2× plus élevé ? Doubler votre coût par token déplace le seuil de rentabilité pour beaucoup de fonctionnalités. Cela vaut la peine d’être modélisé avant que l’API soit disponible, pas après.

Troisième : en quoi les « garde-fous différents » sont-ils différents ? Cette phrase fait beaucoup de travail. Si la version API est livrée avec des refus par défaut plus stricts que ChatGPT, tout ce qui est orienté consommateur ou à double usage pourrait régresser. Testez avant de déployer.

Je n’ai de réponses à aucune de ces questions pour l’instant. Personne en dehors d’OpenAI non plus. Mais ce sont les questions que j’aurais sur un tableau blanc d’ici lundi.

Ce qui est confirmé vs ce qui nécessite encore vérification

Parce que la couverture du premier jour mélange faits confirmés et attentes, voici la répartition telle que je la dessinerais :

| Élément | Statut |

|---|---|

| Date de publication : 23 avril 2026 | Confirmé — officiel OpenAI |

| Disponible dans ChatGPT (Plus/Pro/Business/Enterprise) | Confirmé — officiel OpenAI |

| Disponible dans Codex (Plus/Pro/Business/Enterprise/Edu/Go) | Confirmé — officiel OpenAI |

| Contexte 400 000 tokens dans Codex | Confirmé — officiel OpenAI |

| GPT-5.5 Pro disponible dans ChatGPT uniquement (Pro/Business/Enterprise) | Confirmé — officiel OpenAI |

| La latence par token égale GPT-5.4 | Affirmé par OpenAI — non vérifié indépendamment |

| Scores de benchmark (SWE-Bench Pro, BrowseComp, etc.) | Rapportés par OpenAI — pas encore de réplication tierce |

| Disponibilité de l’API | Pas encore — « très prochainement », sans date |

| Tarification API (5 $ / 30 $ par million de tokens) | Largement rapporté, non confirmé dans la documentation au 24 avril |

| Limites de débit et éligibilité par niveau pour l’API | Inconnu — nécessite vérification |

| Différences de comportement de refus/sécurité vs déploiement ChatGPT | Inconnu — nécessite vérification |

Si un article cite des chiffres de benchmark sans séparer la première ligne des lignes suivantes, vous lisez du marketing. Gardez la distinction.

Qui devrait surveiller GPT-5.5 de près et qui devrait attendre

Toutes les équipes n’ont pas besoin de tout laisser tomber aujourd’hui.

Surveillez de près maintenant si : vous gérez un agent de codage ou une intégration IDE, vos utilisateurs paient déjà pour Plus ou Pro (vous pouvez tester via la surface existante), ou vous développez des outils d’utilisation d’ordinateur / d’automatisation de navigateur où les affirmations de capacités comptent le plus.

Préparez-vous, mais ne migrez pas : vous livrez un produit basé sur l’API et votre feuille de route dépend de ce modèle. Préparez vos évaluations. Modélisez la tarification. Préparez une fenêtre de test pour quand l’API sera activée.

Attendez : vous êtes une équipe non-codage sans workflow spécifique que cela débloque. Une semaine de benchmarks de personnes qui ne sont pas OpenAI vous en dira plus que toute la couverture d’aujourd’hui. La cadence de publication est suffisamment rapide pour que courir après chaque version soit un travail à plein temps avec un faible ROI.

Ce dernier point mérite réflexion. L’article de TechCrunch a encadré cette publication comme un pas vers l’ambition de « super app » d’OpenAI — l’idée de fusionner ChatGPT, Codex et la navigation en un seul produit. C’est une note stratégique, pas une décision produit que vous devez prendre cette semaine.

FAQ

GPT-5.5 est-il disponible dans l’API ?

Non. Pas au 24 avril 2026. OpenAI dit que l’accès API « arrive très prochainement », sans date. Ne planifiez pas sur un chiffre de tarification ou de limite de débit qui ne figure pas encore dans la documentation officielle.

GPT-5.5 est-il disponible dans ChatGPT et Codex ?

Oui. Dans ChatGPT pour les utilisateurs Plus, Pro, Business, Enterprise. Dans Codex pour les plans Plus, Pro, Business, Enterprise, Edu et Go. GPT-5.5 Pro est exclusif à ChatGPT et réservé au niveau Pro et supérieur.

Que devraient vérifier les équipes avant de planifier l’adoption ?

Trois choses, une fois l’API disponible : la tarification réelle sur la page de tarification officielle, les limites de débit et l’éligibilité par niveau pour votre plan, et le comportement de refus sur les charges de travail à double usage ou agentiques que vous exécutez. OpenAI a explicitement signalé « des garde-fous différents » pour le service API, ce qui mérite d’être testé plutôt que supposé.

GPT-5.5 est-il pertinent pour les équipes non-codage ?

Probablement, mais pas de façon urgente. Les gains de capacités qu’OpenAI annonce sont les plus forts dans le codage agentique et l’utilisation de l’ordinateur. Les gains dans le travail de connaissance sont réels mais progressifs. Si votre équipe n’est pas déjà limitée par la qualité du modèle sur les tâches multi-étapes, GPT-5.4 convient pour l’instant.

Conclusion

GPT-5.5 a été livré aujourd’hui. Il est dans ChatGPT et Codex. Il n’est pas dans l’API. C’est toute l’histoire pour les développeurs en une phrase.

Tout le reste — les benchmarks, la tarification, le cadrage « super app », les comparaisons avec des laboratoires concurrents — est soit non vérifié, soit pas encore actionnable. La chose utile à faire cette semaine est de préparer vos évaluations et de modéliser vos plans de repli, de sorte que lorsque l’API sera activée, vous puissiez former votre propre jugement en quelques heures plutôt que de courir après une semaine de fils de discussion.

C’est là où s’arrêtent mes données. Suite la semaine prochaine, une fois que la surface API sera disponible et que quelqu’un en dehors d’OpenAI aura exécuté de vraies charges de travail dessus.

Articles précédents :

- Claude Opus 4.7 : L’alternative actuelle prête pour l’API

- GLM-5V Turbo vs GPT-4o : Vision + codage UI en pratique

- Patterns de workflow agentique : câblage des outils et modes d’échec

- MCP en production : comment le contexte de modèle fonctionne vraiment

- Comment configurer G0DM0D3 avec OpenRouter (voie API aujourd’hui)