Échange de visage vidéo expliqué : Comment ça fonctionne + Guide API

Comment fonctionne l'échange de visage vidéo en coulisses — et comment l'appeler via API. Couvre le pipeline complet, les exigences d'entrée et les modes d'échec courants.

Bonjour, je suis Dora. Soyons honnêtes — la première fois que j’ai essayé d’appeler une API de face swap vidéo, j’ai obtenu une réponse qui semblait presque correcte. Le visage était là. La synchronisation était décalée d’une demi-seconde. L’éclairage donnait au sujet l’air de luire légèrement de l’intérieur, comme un fantôme bas de gamme.

C’est ça, le problème avec la technologie de face swap vidéo. Ça paraît simple de l’extérieur — remplacer le visage A sur le corps B, terminé — mais dès que vous dépassez les clips de démonstration et essayez de construire quelque chose de réel, vous réalisez combien de rouages sont en jeu sous le capot. Comprendre ces rouages, c’est ce qui fait la différence entre un résultat soigné et un résultat qui fait grimacer vos utilisateurs.

Ce guide explique comment fonctionne réellement le face swap vidéo, les différentes approches disponibles, ce dont votre API a besoin avant de pouvoir faire quoi que ce soit d’utile, et comment gérer les modes d’échec qui vous tomberont dessus tôt ou tard.

Ce que fait réellement le face swap vidéo

Laissez-moi clarifier cela, car beaucoup d’explications sautent la partie qui compte vraiment.

Le face swap vidéo n’est pas un filtre. Ce n’est pas un masque appliqué sur une vidéo. Ce qu’il fait — à un niveau assez profond — c’est détecter un visage dans chaque image d’une vidéo, cartographier sa géométrie, extraire l’identité d’un visage source, et fusionner l’identité source sur la structure faciale de la cible tout en préservant les mouvements, l’éclairage et les expressions de la cible.

Ce sont trois problèmes distincts qui se déroulent en séquence.

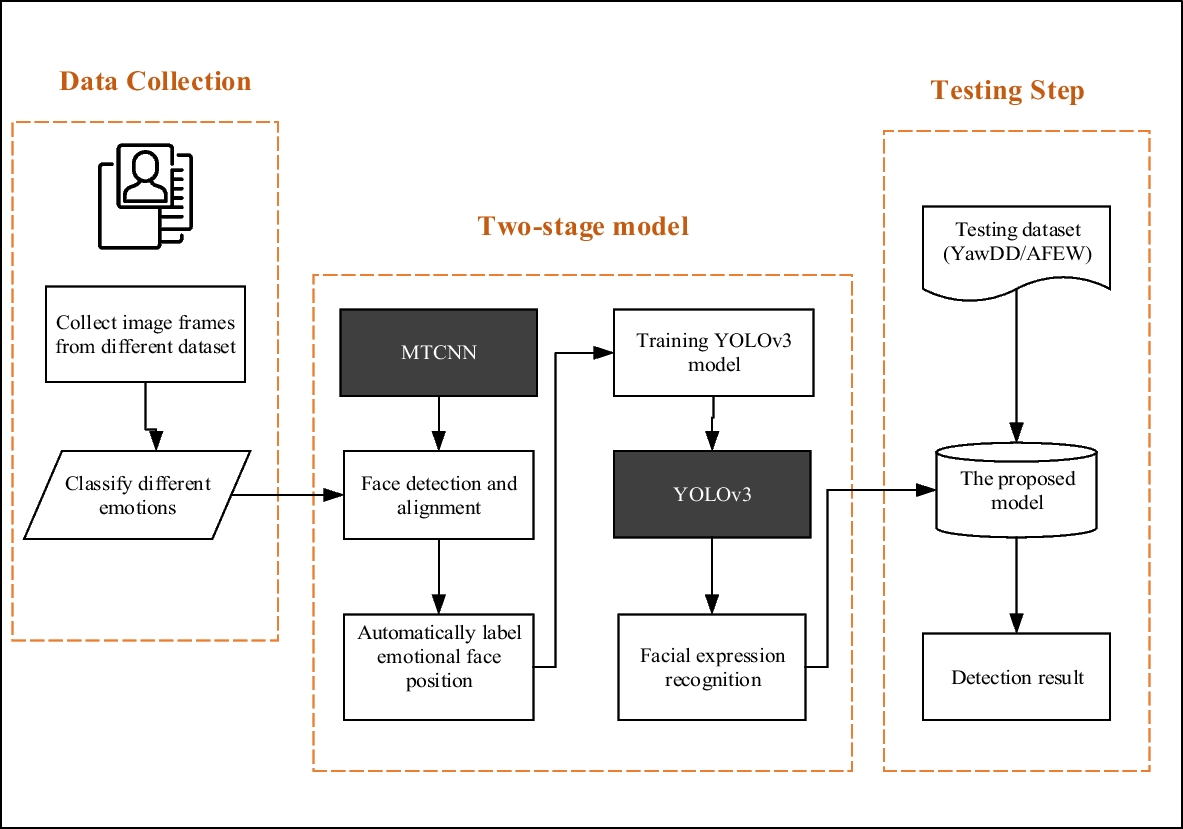

Pipeline : Détection → Alignement → Fusion

La détection est l’étape où le modèle localise les visages dans l’image. Ça semble facile. Ce ne l’est pas. Les visages partiellement occultés, tournés à des angles prononcés ou en mouvement rapide génèrent tous des échecs de détection. La plupart des systèmes de production utilisent des variantes de réseaux de neurones convolutifs en cascade multi-tâches — vous pouvez lire l’approche fondatrice MTCNN dans ce guide sur la détection faciale par deep learning — bien que les architectures plus récentes aient considérablement amélioré ces premiers résultats.

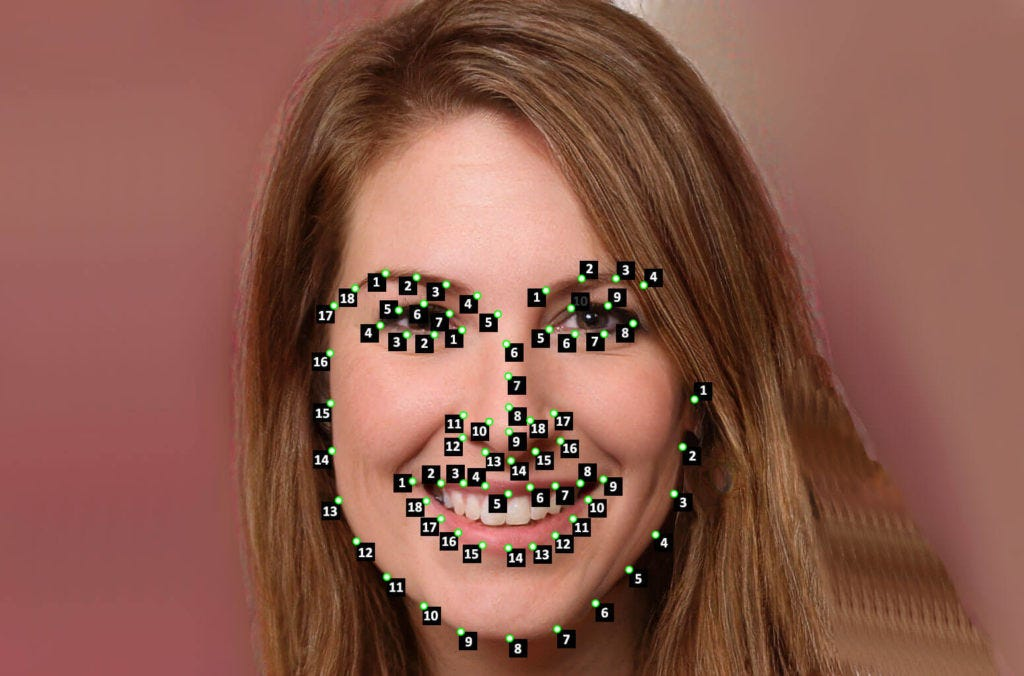

L’alignement est l’étape à laquelle la plupart des gens ne pensent pas, mais elle est véritablement critique. Une fois qu’un visage est détecté, le modèle identifie des repères faciaux — yeux, pointe du nez, coins de la bouche — et les utilise pour normaliser le visage dans une position et une échelle canoniques. Sans cela, le swap donne l’impression que quelqu’un a posé un visage selon un angle légèrement erroné en espérant que personne ne le remarque. On le remarque toujours.

La fusion est là où se produit le véritable transfert d’identité. Le modèle prend les caractéristiques d’identité du visage source, les projette sur la géométrie du visage cible et intègre le résultat dans l’image. Les approches modernes utilisent des réseaux antagonistes génératifs (GAN) pour cela — un générateur qui crée le visage fusionné et un discriminateur qui évalue le réalisme — c’est pourquoi comprendre le fonctionnement de la génération de deepfakes basée sur les GAN est un contexte réellement utile avant de commencer à déboguer vos sorties.

Ce que signifie vraiment la qualité de sortie

Voici quelque chose qui m’a dérouté au début : la « qualité » dans la sortie d’un face swap n’est pas un seul chiffre. C’est au moins trois choses distinctes.

La préservation de l’identité — le résultat ressemble-t-il vraiment au visage source, et pas seulement à une moyenne floue des deux ?

La cohérence temporelle — le visage est-il identique d’une image à l’autre, ou scintille-t-il subtilement ?

Le photoréalisme — le résultat semble-t-il appartenir à la scène, ou donne-t-il l’impression d’être composité ?

Vous pouvez avoir une excellente préservation de l’identité et une cohérence temporelle déplorable. Vous pouvez avoir un beau photoréalisme avec un mauvais transfert d’identité. La plupart des API exposent des paramètres ou des niveaux de qualité qui font des compromis entre ces aspects. Savoir lequel compte pour votre cas d’usage vous évitera beaucoup de confusion.

Types d’approches de face swap vidéo

Tous les modèles de face swap vidéo ne fonctionnent pas de la même manière. Des différences architecturales similaires existent dans les modèles modernes de génération vidéo par IA comme Seedance 2.0, où la cohérence temporelle et la modélisation du mouvement sont gérées très différemment selon l’approche. Il y a deux axes importants à comprendre avant de choisir un outil ou une API.

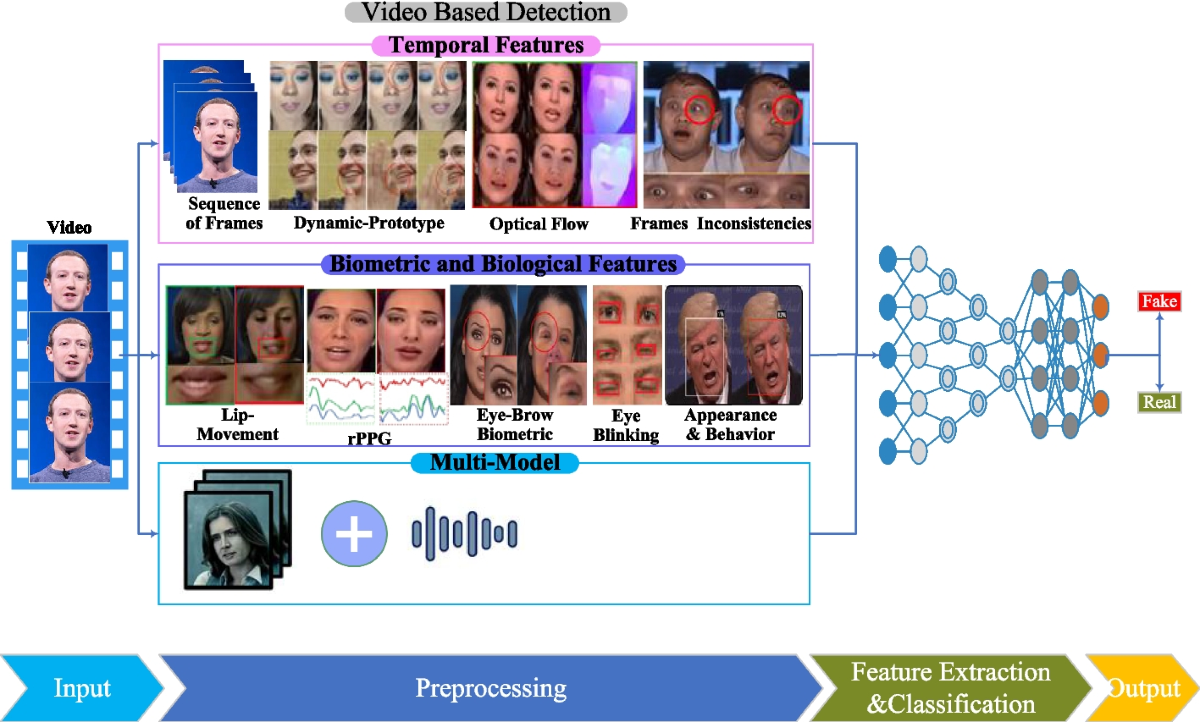

Modèles image par image vs. modèles temporels

Les modèles image par image traitent chaque image de la vidéo indépendamment. Ils sont généralement plus rapides et plus simples à implémenter, mais ils ne tiennent pas compte du fait que la vidéo est une séquence d’images liées. Résultat : un léger scintillement entre les images, notamment autour des contours du visage ou dans des conditions de faible luminosité.

Les modèles temporels traitent les images en tenant compte de ce qui précède et de ce qui suit — comprenant essentiellement le mouvement et maintenant la cohérence tout au long du clip. Des compromis similaires apparaissent dans les comparaisons entre les principaux modèles vidéo par IA, où la stabilité et le réalisme du mouvement sont des différenciateurs majeurs. Le résultat est plus fluide et plus stable, mais ces modèles sont plus lourds et plus lents. Pour tout ce qui dépasse quelques secondes ou est destiné à être visionné en plein écran, la latence supplémentaire en vaut la peine.

Mon expérience honnête : si vous faites du prototypage ou générez des vignettes, le traitement image par image convient. Si vous construisez quelque chose que les gens regarderont sur un grand écran, vous regretterez le scintillement.

Visage unique vs. multi-visages

Les modèles à visage unique sont plus simples et généralement de meilleure qualité pour leur tâche spécifique. Si votre cas d’usage implique un visage clairement visible dans l’image — ce qui couvre la plupart des scénarios de production — c’est le bon point de départ.

Les modèles multi-visages peuvent détecter et remplacer plusieurs visages dans une seule image. Ils sont utiles pour les plans d’ensemble, les séquences de groupe ou les scénarios où vous ne contrôlez pas entièrement la vidéo d’entrée. L’inconvénient est qu’ils sont plus coûteux en calcul et plus sujets à une attribution incorrecte des visages — c’est-à-dire que le modèle swap le mauvais visage sur le mauvais corps. Bon à savoir avant d’envoyer un clip à quatre personnes et d’obtenir quelque chose d’involontairement surréaliste.

Avant d’appeler l’API : ce dont vous avez besoin

C’est là que la plupart des gens perdent du temps. Non pas parce que l’API est difficile, mais parce que les exigences d’entrée sont plus spécifiques que la documentation ne le précise généralement.

Exigences d’entrée (format, résolution, durée du clip)

La plupart des API de face swap vidéo attendent :

- Format vidéo : MP4 avec encodage H.264 est la valeur par défaut la plus sûre. Certaines API acceptent également WebM ou MOV, mais H.264/MP4 est le plus universellement supporté.

- Résolution : 720p est un minimum pratique pour une qualité de swap acceptable. 1080p donne au modèle plus de détails faciaux avec lesquels travailler. En dessous de 480p, la plupart des modèles commencent à produire des artefacts visibles — la région du visage n’a tout simplement pas assez de pixels pour une fusion propre.

- Durée du clip : De nombreuses API plafonnent le traitement synchrone à 30–60 secondes. Les clips plus longs nécessitent une soumission de tâche asynchrone avec des callbacks webhook. Sachez dans quelle catégorie tombent vos clips avant de concevoir votre gestion des requêtes.

- Image source : Pour le visage que vous remplacez, une seule photo frontale bien éclairée est généralement suffisante. Certains modèles acceptent également des sources vidéo, mais une image fixe claire avec un éclairage uniforme produit généralement un transfert d’identité plus cohérent.

Contraintes d’angle et d’éclairage du visage

Un petit contrôle de réalité : les modèles ne sont pas magiques.

Angle du visage : La plupart des modèles fonctionnent bien jusqu’à environ 30–35 degrés hors axe par rapport à une vue frontale. Au-delà, vous commencez à perdre en précision des repères, ce qui entraîne des erreurs d’alignement, qui produisent des artefacts de fusion. Les profils sont généralement non supportés ou produisent des résultats inexploitables. Si votre vidéo source montre des sujets qui regardent fréquemment hors caméra, modérez vos attentes de qualité en conséquence.

Éclairage : Un éclairage directionnel intense — visages éclairés sur le côté, éclairage zénithal fort créant de profondes ombres autour des yeux — est plus difficile à gérer de manière convaincante pour l’étape de fusion. Le modèle doit concilier l’éclairage du visage source avec l’éclairage de l’image cible, et plus ces deux éléments diffèrent, plus la couture est visible.

Je ne dis pas d’éviter les vidéos sombres. Je dis : si vous générez du matériel source et avez un contrôle quelconque sur celui-ci, un éclairage uniforme améliorera sensiblement votre résultat.

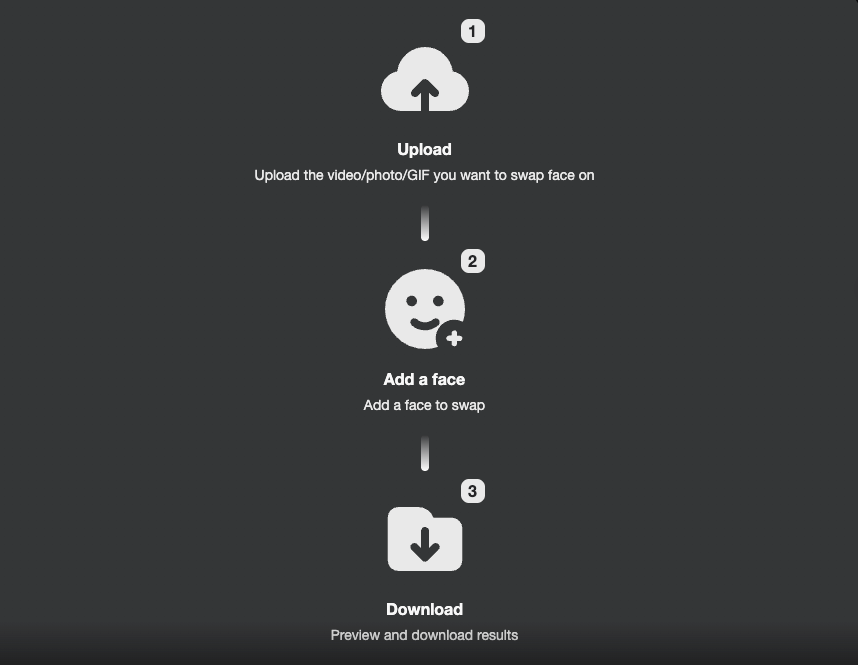

Flux de travail API étape par étape

Passons à la pratique. Voici le flux typique d’un appel API de face swap vidéo.

Authentification

Presque toutes les API de production utilisent l’authentification par jeton bearer. Vous recevrez une clé API à l’inscription, que vous transmettez en tant qu’en-tête :

Authorization: Bearer YOUR_API_KEYC’est une pratique standard conforme aux recommandations de sécurité du OWASP REST Security Cheat Sheet. Quelques bonnes pratiques dès le départ :

- Stockez votre clé API comme variable d’environnement, jamais codée en dur dans votre base de code

- Mettez en place une rotation des clés — la plupart des API vous permettent de régénérer les clés sans perdre l’accès au compte

- Si disponible, utilisez des clés à portée limitée qui n’ont que les permissions réellement nécessaires à votre intégration

Envoi de la requête

Un corps de requête typique ressemble à ceci :

{

"source_image_url": "https://your-storage.com/source-face.jpg",

"target_video_url": "https://your-storage.com/target-video.mp4",

"output_format": "mp4",

"quality": "high"

}Certaines API acceptent les téléchargements de fichiers binaires directement via multipart form-data. D’autres n’acceptent que des URLs pointant vers des fichiers accessibles publiquement. Vérifiez attentivement la documentation de votre API sur ce point — c’est une source courante d’échecs silencieux où l’API retourne 200 mais ne traite rien parce que l’URL du fichier était inaccessible.

Pour les clips plus longs, vous obtiendrez généralement un identifiant de tâche plutôt que la sortie directement :

{

"job_id": "fswap_a3b92f",

"status": "processing",

"estimated_time_seconds": 45

}Gestion des sorties

Interrogez le endpoint de statut de la tâche ou configurez un webhook pour recevoir le résultat à la fin du traitement. La réponse inclura une URL de téléchargement pour la vidéo traitée. Ces URLs sont généralement limitées dans le temps — téléchargez et stockez la sortie dans votre propre espace de stockage avant expiration, généralement entre 1 et 24 heures selon le fournisseur.

Ne supposez pas que la sortie est parfaite simplement parce que le statut est « completed ». Vérifiez toujours quelques images. Le statut completed signifie que le pipeline s’est exécuté sans planter. Ça ne signifie pas que le swap est réussi.

Pour les systèmes de production, construire une intégration REST API solide autour de ces patterns asynchrones — gestion des erreurs appropriée, logique de réessai, vérification des webhooks — vous épargnera une session de débogage pénible plus tard.

Modes d’échec courants et solutions

C’est là que les choses deviennent sérieuses. J’ai rencontré ces trois problèmes.

Glitches de mouvement

Ce à quoi ça ressemble : Le visage swappé tremble ou « saute » entre les images, un problème très similaire aux problèmes abordés dans les guides sur comment les créateurs corrigent le scintillement et les tremblements dans les vidéos générées par IA.

Pourquoi ça arrive : Traitement image par image sans lissage temporel. Chaque image est résolue indépendamment, donc de légères variations dans la détection des repères créent une incohérence.

Solution : Passez à un modèle temporel si disponible. Si vous êtes limité à une API image par image, certains fournisseurs proposent une passe de stabilisation en post-traitement — cherchez cette option dans vos paramètres. Alternativement, pré-traiter votre vidéo d’entrée avec une stabilisation de mouvement avant de l’envoyer à l’API peut aider.

Dérive d’identité

Ce à quoi ça ressemble : Le visage de sortie commence progressivement à ressembler moins au visage source et davantage à une sorte de mélange des deux — ou juste à quelqu’un d’ordinaire.

Pourquoi ça arrive : Généralement un problème de qualité de l’image source. Si la photo du visage source est basse résolution, mal éclairée ou capturée sous un angle non frontal, le modèle ne peut pas extraire des caractéristiques d’identité fiables. Il comble les lacunes avec ce qu’il peut inférer, ce qui tend souvent à dériver vers le visage cible.

Solution : Utilisez une image source de meilleure qualité. Frontale, éclairage uniforme, au moins 512×512px dans la région du visage. Ce seul changement résout la dérive d’identité dans peut-être 80% des cas d’après mon expérience.

Inadéquation d’éclairage

Ce à quoi ça ressemble : Le visage swappé donne l’impression d’être « collé » — la direction de l’éclairage ou la température de couleur du visage ne correspond pas à la scène environnante.

Pourquoi ça arrive : Le modèle de fusion essaie d’harmoniser l’éclairage mais ne peut faire que jusqu’à un certain point. De grandes différences entre l’éclairage de l’image source et de la vidéo cible challengent l’étape de composition.

Solutions :

- Si vous contrôlez l’image source, photographiez-la dans des conditions d’éclairage similaires à votre vidéo cible

- Certaines API proposent une normalisation de l’éclairage explicite en tant que paramètre — activez-la

- Pour les inadéquations sévères, un post-traitement de la sortie avec une passe d’étalonnage colorimétrique peut aider à intégrer le visage dans la scène de manière plus convaincante

Quelle est donc la conclusion ?

Le face swap vidéo est une technologie véritablement puissante lorsque vous comprenez ce dont elle a besoin pour réussir. La plupart des problèmes de qualité ne sont pas mystérieux — ils remontent à la qualité des entrées, au choix du modèle adapté au cas d’usage, et à des attentes réalistes sur ce que le pipeline peut et ne peut pas gérer. Maîtrisez ces aspects, et vous passerez beaucoup moins de temps à déboguer des sorties qui paraissaient bien dans la démo mais se sont effondrées en production.