Meilleurs outils d'échange de visage vidéo par IA (2026)

Nous avons testé les principaux outils d'échange de visage vidéo par IA en 2026. Voici ce qui fonctionne vraiment, ce qui échoue, et comment choisir en fonction de vos besoins réels.

Bonjour, je m’appelle Dora. Voici quelque chose que je remarque constamment : presque tous les classements des “meilleurs outils d’échange de visages vidéo par IA” testent exactement le même clip de démonstration dans des conditions idéales, puis désignent un gagnant. Ce n’est pas ainsi que ces outils sont réellement utilisés.

J’ai passé les dernières semaines à faire tourner de vraies séquences de test sur une sélection d’outils, dont beaucoup sont construits sur ou inspirés par des modèles modernes de génération vidéo par IA comme Seedance 2.0 — différentes configurations d’éclairage, différents niveaux de mouvement, différentes durées de clips. Ce que j’ai trouvé ne correspondait pas toujours à ce que le marketing laissait entendre. Certains outils qui semblent époustouflants dans les aperçus s’effondrent à l’exportation. Certains qui paraissent lents dans le navigateur produisent la sortie la plus stable temporellement. Et quelques-uns qui sont rarement mentionnés s’avèrent être le choix le plus fiable pour les développeurs ayant besoin d’un comportement d’API reproductible.

Ce guide explique comment j’ai évalué ces outils, à quoi ressemble réellement la comparaison, et quel outil convient à quelle situation. Pas de classements d’affiliation. Pas de formule “tous ces outils sont excellents !”.

Comment Nous Avons Évalué Ces Outils

Clips de Test Utilisés

J’ai fait passer trois catégories de vidéos sources dans chaque outil :

Type de clip A — Éclairage contrôlé, faible mouvement : Séquences de type “tête parlante” filmées sous une lumière uniforme et diffuse. Sujets face à la caméra, mouvements de tête minimaux. C’est le test en “mode facile” — tout outil à peu près correct devrait s’en sortir de manière acceptable.

Type de clip B — Éclairage mixte, mouvement modéré : Séquences portables avec un mélange de lumière naturelle de fenêtre et d’éclairage d’appoint en hauteur. Sujets se déplaçant naturellement — hochant la tête, se tournant légèrement. C’est là que les problèmes de cohérence temporelle commencent à apparaître.

Type de clip C — Mouvement dynamique, éclairage dur ou directionnel : Rotations rapides de la tête, expressions animées, sujets éclairés latéralement ou à contre-jour. C’est là que la plupart des outils commencent à avoir du mal et où les vraies différences apparaissent.

La durée des clips variait de 8 à 45 secondes. Visage source : un unique portrait frontal bien éclairé à une résolution de visage de 1080 px.

Grille d’Évaluation

Chaque outil a été noté sur quatre dimensions :

| Dimension | Ce que j’ai mesuré |

|---|---|

| Réalisme | Préservation de l’identité, correspondance du teint, qualité de fusion des bords |

| Cohérence Temporelle | Stabilité image par image, scintillement, dérive sous mouvement |

| Vitesse | Temps entre la soumission et la sortie téléchargeable |

| Rapport Qualité-Prix | Prix par minute de vidéo traitée, générosité du niveau gratuit |

Aucune dimension ne l’emporte par défaut — une réalité qui apparaît également dans les comparaisons entre les principaux modèles de génération vidéo par IA, où la vitesse, le réalisme et la stabilité se font souvent des compromis. Un outil qui s’affiche en 20 secondes mais produit une sortie scintillante n’est “rapide” d’aucune manière qui compte.

Comprendre pourquoi la stabilité temporelle est si difficile à obtenir dans la vidéo vaut le détour — cela se résume au défi de maintenir une identité cohérente sur des images séquentielles, que les recherches sur la synthèse vidéo basée sur les GAN sur arXiv couvrent en profondeur utile si vous voulez les bases techniques.

Date de Test et Instantané des Prix

Tous les tests ont été effectués de février à mars 2026. Les prix reflètent les tarifs publiés actuels au moment des tests — ceux-ci changent fréquemment, vérifiez donc avant de vous engager.

Meilleurs Outils d’Échange de Visages Vidéo par IA

Meilleure Qualité de Sortie Globale : DeepSwap

Pour le réalisme pur de la sortie sur les trois types de clips, DeepSwap a constamment produit les résultats les plus convaincants. La préservation de l’identité était solide même sur le Type de clip C (mouvement dynamique, éclairage dur), où la plupart des concurrents montraient une dérive visible après la marque des 15 secondes.

Ce qui s’est démarqué : l’approche multi-moteurs. DeepSwap exécute plusieurs modèles d’IA simultanément et renvoie plusieurs versions de sortie pour comparaison. Pour les échanges difficiles — angles de source inhabituels, éclairage directionnel fort — cela compte énormément. Un moteur gère mieux les ombres profondes ; un autre préserve plus précisément les détails fins du visage comme la texture et l’asymétrie.

Le compromis est la complexité et la vitesse. DeepSwap n’est pas une expérience en un clic. Et pour les échanges simples de type “tête parlante”, le temps de traitement supplémentaire ne justifie pas toujours le delta de qualité par rapport aux outils plus simples.

Idéal pour : La production, le contenu marketing, tout ce qui sera visionné de près sur de grands écrans.

Tarification : Basé sur des crédits, paiement à l’usage. Pas de niveau gratuit permanent.

Meilleur pour l’Intégration d’API pour Développeurs : Magic Hour

Si vous construisez quelque chose plutôt que de simplement générer du contenu, Magic Hour est l’option la plus conviviale pour les développeurs que j’ai testée. L’API est bien documentée, renvoie des réponses structurées prévisibles et gère proprement la gestion des tâches asynchrones — ce qui compte beaucoup quand vous intégrez l’échange de visages dans un pipeline plus large.

Les modèles sous-jacents sont également solides. La cohérence temporelle sur le Type de clip B (mouvement modéré) était parmi les meilleures que j’ai vues, et la qualité de sortie sur les clips de type “tête parlante” était véritablement impressionnante. C’est également l’un des rares outils qui intègre l’échange de visages avec la synchronisation labiale et la génération image-vers-vidéo dans une surface d’API unifiée — utile si votre cas d’utilisation implique plus que le simple remplacement de visage.

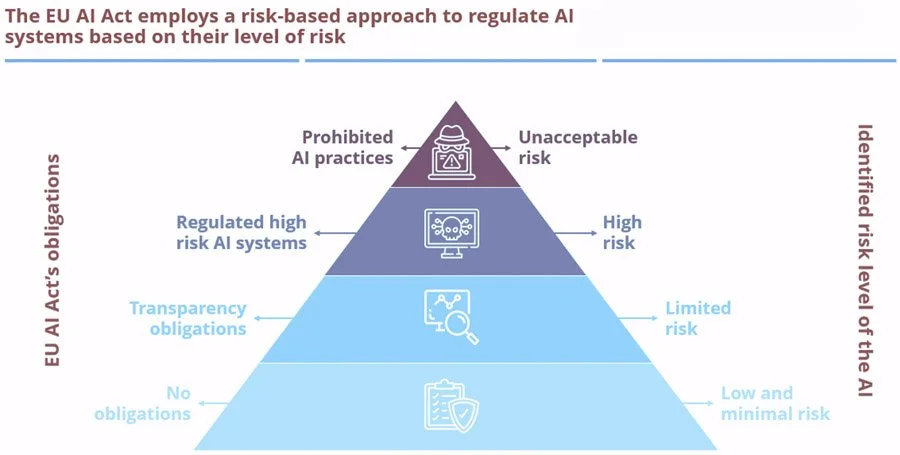

Il convient de noter que l’environnement réglementaire autour des médias synthétiques se resserre. En vertu de l’article 50 de la loi européenne sur l’IA, les fournisseurs de systèmes d’IA générant du contenu audio, image ou vidéo synthétique doivent s’assurer que les sorties sont marquées dans un format lisible par machine et détectables comme artificiellement générées ou manipulées. Magic Hour inclut le filigranage de contenu par défaut, ce qui facilite la conformité si vous créez des produits qui seront distribués sur des marchés réglementés. Pour un aperçu plus large de ce que ces obligations signifient en pratique, le résumé du Parlement européen sur la loi européenne sur l’IA vaut la peine d’être lu avant de lancer quoi que ce soit destiné aux consommateurs.

Idéal pour : Les développeurs créant des applications, les flux de travail d’automatisation par lots, les équipes ayant besoin de fiabilité d’API dans le temps.

Tarification : Niveaux d’abonnement avec accès API. Essai gratuit disponible.

Meilleur pour les Clips Multi-Visages : Reface

L’échange multi-visages est véritablement plus difficile que l’échange à visage unique. Le modèle doit détecter, assigner et traiter indépendamment plusieurs visages par image — et si l’assignation des visages se trompe, le résultat est visuellement chaotique d’une manière difficile à expliquer à un client.

Reface gère les scénarios multi-visages plus fiablement que tout ce que j’ai testé. L’assignation des visages est restée correcte sur des clips avec deux à trois sujets, même quand les visages se chevauchaient brièvement dans le cadre. La sortie ne remportera pas de prix pour son photoréalisme, mais elle est cohérente — et pour le contenu de groupe destiné aux réseaux sociaux, la cohérence bat la perfection.

L’architecture GAN qui alimente la plupart des outils modernes d’échange de visages — où un réseau générateur et un réseau discriminateur s’affrontent de manière itérative pour améliorer le réalisme — est fondamentalement la même sur la plupart de ces plateformes. Ce qui différencie les performances multi-visages, c’est généralement la façon dont l’outil gère la détection et le suivi des visages en amont de l’étape générative, et non le modèle génératif lui-même.

Idéal pour : Les clips de groupe, les séquences d’ensemble, le contenu destiné aux réseaux sociaux avec plusieurs sujets.

Tarification : Abonnement à partir de 3,99 $/mois. Niveau gratuit avec filigrane.

Meilleure Option Gratuite : FaceFusion

FaceFusion est open-source, fonctionne localement et produit une qualité de sortie qui n’a aucune raison d’être gratuite. Ce n’est pas une application web — la configuration nécessite un peu de patience technique — mais une fois qu’il est en marche, vous avez un contrôle total sur les paramètres du modèle, pas de filigranes et pas de frais par crédit.

Pour les utilisateurs soucieux de leur vie privée, l’architecture locale signifie que vos images sources et vos vidéos ne quittent jamais votre machine. C’est un vrai facteur différenciant pour quiconque travaille avec des séquences de personnes identifiables, surtout alors que les politiques de conservation des données des outils basés sur le cloud font l’objet d’un examen de plus en plus attentif.

Le hic : il ne vous tient pas la main. Les messages d’erreur sont laconiques. Les paramètres de traitement nécessitent un réglage manuel. Et contrairement aux outils cloud, il ne s’étend pas horizontalement si vous devez traiter de nombreux clips en parallèle.

Idéal pour : Les développeurs qui expérimentent, les utilisateurs soucieux de leur vie privée, toute personne prête à échanger des frictions de configuration contre zéro coût continu.

Tarification : Gratuit et open-source.

Tableau Comparatif

| Outil | Réalisme | Cohérence Temporelle | Multi-Visages | Accès API | Prix de Départ |

|---|---|---|---|---|---|

| DeepSwap | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ | Limité | Paiement à l’usage |

| Magic Hour | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ✅ | ✅ Complet | Abonnement |

| Reface | ⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ Fort | ❌ | 3,99 $/mois |

| FaceFusion | ⭐⭐⭐⭐ | ⭐⭐⭐ | ✅ | Auto-hébergé | Gratuit |

Les scores reflètent les tests sur le Type de clip B (éclairage mixte, mouvement modéré). Les résultats varient selon le type de clip.

Ce que la Plupart des Avis Manquent

L’Écart entre Qualité de l’Aperçu et Qualité de l’Export

C’est celui qui m’a eu en premier. Plusieurs outils affichent un aperçu haute qualité dans le navigateur qui semble véritablement impressionnant. Le fichier exporté — à la résolution et au débit binaire dont vous avez réellement besoin — a l’air sensiblement différent.

L’écart se manifeste généralement de deux façons : des artefacts de compression autour de la ligne des cheveux et des bords du visage, et une douceur dans la sortie finale qui n’était pas visible dans l’aperçu. Téléchargez et examinez toujours un export en pleine résolution avant de prendre une décision d’outil basée sur des aperçus. Ce que vous voyez dans un lecteur de navigateur à 720p n’est pas ce que verra votre audience.

Pourquoi la Vitesse de Rendu Seule ne Prédit pas le Réalisme

J’ai vu cette affirmation à maintes reprises : “traite en moins de 10 secondes.” C’est soit un clip très court, soit une sortie à très basse résolution, soit un chemin très rapide vers une qualité médiocre.

La cohérence temporelle — ce qui rend les échanges de visages vidéo réalistes dans le temps — est étroitement liée aux problèmes abordés dans les guides sur comment les créateurs corrigent le scintillement et les à-coups dans la vidéo générée par IA. Pas seulement dans une seule image — elle nécessite que le modèle comprenne le mouvement entre les images. L’aperçu technique d’IBM sur le fonctionnement des GAN explique pourquoi ce processus itératif demande un effort computationnel : les réseaux générateur et discriminateur s’affrontent effectivement à travers de nombreux cycles pour produire une sortie réaliste. Les outils qui livrent des résultats en quelques secondes sur des clips longs sacrifient presque toujours ce raisonnement temporel. La vitesse est un signal, pas une fonctionnalité. Un traitement rapide sur une vidéo de plus de 15 secondes signifie généralement que quelque chose a été sauté.

Recommandation par Cas d’Utilisation

Créateurs Occasionnels

Optez pour Reface. C’est rapide, compatible mobile, gère bien les clips de groupe, et le niveau gratuit est véritablement utilisable pour les clips courts. Vous n’obtiendrez pas un réalisme de niveau production, mais vous obtiendrez une sortie partageable en moins d’une minute avec une friction de configuration minimale.

Développeurs Ayant Besoin d’une Sortie d’API Reproductible

Magic Hour. La documentation de l’API est claire, la gestion asynchrone est fiable, et la sortie est suffisamment cohérente pour créer des produits orientés utilisateurs. Si votre intégration implique des marchés réglementés, le filigranage intégré simplifie également votre posture de conformité dans le cadre d’exigences telles que les exigences de transparence de l’article 50 de la loi européenne sur l’IA.

Utilisateurs Ayant Besoin du Support Multi-Visages

Reface pour le contenu réseaux sociaux, DeepSwap pour la production. Si vous faites des clips de groupe rapides pour les réseaux sociaux, la rapidité de Reface et son assignation fiable des visages l’emportent. Si vous faites du travail multi-visages pour le marketing ou la vidéo professionnelle où la qualité compte, l’approche multi-moteurs de DeepSwap produit des résultats plus propres, surtout quand les visages ne sont pas tous éclairés de face.

Alors, quel est vraiment le meilleur outil d’échange de visages vidéo par IA en 2026 ? Cela dépend de ce que vous entendez par “meilleur”.

Meilleur réalisme dans des conditions difficiles : DeepSwap. Meilleure API pour créer des produits : Magic Hour. Meilleur pour les groupes : Reface. Meilleur gratuitement : FaceFusion. Tout classement qui choisit un seul gagnant pour tout le monde optimise pour la simplicité, pas pour l’exactitude.

Testez vos vrais clips. L’outil qui fonctionne le mieux sur les séquences de quelqu’un d’autre ne fonctionnera pas nécessairement sur les vôtres.