Meilleurs outils de remplacement de visage vidéo en ligne

Comparez les meilleurs outils de remplacement de visage vidéo en ligne et trouvez la bonne option pour la vitesse, la qualité ou l'édition multi-visages.

Bonjour, je m’appelle Dora. Je teste des outils vidéo IA depuis plus d’un an, principalement pour comprendre ce qui est réellement utilisable par rapport à ce qui se contente de bien paraître en capture d’écran. Il y a quelques mois, j’ai commencé à appliquer un cadre d’évaluation cohérent aux outils de remplacement de visage en vidéo — mêmes clips sources, mêmes conditions de test, même processus de révision des résultats. Ce n’est pas un environnement de laboratoire, mais suffisamment structuré pour comparer les outils avec une certaine confiance.

Ce guide porte sur la sélection. Si vous explorez également d’autres outils vidéo IA au-delà du remplacement de visage, il vaut la peine de voir comment Seedance, Kling et Sora se comparent dans des workflows réels de génération vidéo IA. Si vous essayez de décider quel outil de remplacement de visage en vidéo en ligne correspond à votre workflow, je veux vous donner une base de décision plus claire que ce que proposent la plupart des avis.

Ce Qui Rend un Outil de Remplacement de Visage en Ligne Meilleur qu’un Autre

La plupart des comparaisons condensent tout en un vague « score de qualité ». Ce n’est pas utile pour choisir un outil. Voici les quatre dimensions que j’ai suivies séparément. Pour les créateurs qui évaluent également des modèles vidéo plus récents, cette présentation explique ce qu’est SkyReels V4 et pourquoi certains créateurs l’utilisent pour la génération vidéo IA.

Qualité de sortie

La qualité dans le remplacement de visage en vidéo comporte deux composantes à évaluer indépendamment. Premièrement : la qualité spatiale — à quel point le mélange des bords autour de la ligne des cheveux, de la mâchoire et du cou est propre dans une seule image. Deuxièmement, et c’est plus difficile : la cohérence temporelle — à quel point l’identité reste stable d’une image à l’autre lorsque le sujet bouge.

Les recherches sur les métriques de qualité vidéo confirment que les artefacts temporels — les distorsions qui apparaissent dans les séquences d’images plutôt qu’à l’intérieur d’une seule image — nécessitent des méthodes de mesure dédiées que la plupart des scores de qualité spatiale ne capturent pas. Cette distinction a une importance pratique : un outil qui produit une image fixe propre mais montre une dérive d’identité ou un flou sur un clip de 10 secondes n’est pas un outil de haute qualité pour la vidéo, indépendamment de l’apparence de l’aperçu.

Dans mes tests, j’ai utilisé deux clips par outil : un plan parlant face caméra de 10 secondes, et un clip de 12 secondes avec un mouvement de tête modéré et un pivotement à 45 degrés. Le second clip est celui où la plupart des outils divergent significativement.

Vitesse

Pour un travail itératif — tester des photos sources, comparer des résultats — le temps de rendu s’accumule rapidement. J’ai mesuré le temps réel du téléversement jusqu’au téléchargement du résultat, pas seulement le temps de traitement annoncé. Les temps d’attente en file d’attente du niveau gratuit sont inclus dans ce chiffre, ce qui compte.

Les résultats entre les outils allaient de moins de 60 secondes à plus de 9 minutes sur le même clip. Ce n’est pas une différence mineure quand vous faites tourner cinq variantes.

Support multi-visages

C’est une capacité distincte, pas une extension de fonctionnalité. Le remplacement de visage en vidéo nécessite de résoudre à la fois les problèmes de détection et d’optimisation temporelle — suivre chaque visage indépendamment d’une image à l’autre tout en maintenant un remplacement d’identité cohérent tout au long de la séquence. Les clips multi-visages multiplient cette complexité. La plupart des niveaux gratuits ne supportent que la détection d’un seul visage, et même les niveaux payants varient significativement dans leur façon de gérer les plans de groupe où les visages se chevauchent partiellement ou bougent à des vitesses différentes.

J’ai testé le support multi-visages avec un clip de 3 personnes. Lorsque les outils revendiquaient une capacité multi-visages, j’ai évalué chaque remplacement individuel indépendamment.

Facilité d’utilisation

Paradoxalement, la facilité d’utilisation importe davantage à l’extrémité supérieure du spectre de qualité. Les outils basiques sont simples parce qu’ils offrent peu de contrôles. Les outils avec des plafonds plus élevés — sélection de région du visage, ajustement du réalisme, ancrage des expressions — exposent plus de configuration, ce qui augmente la complexité de l’interface. Le niveau de complexité approprié dépend entièrement de ce que vous devez contrôler.

Meilleurs Outils de Remplacement de Visage en Vidéo en Ligne

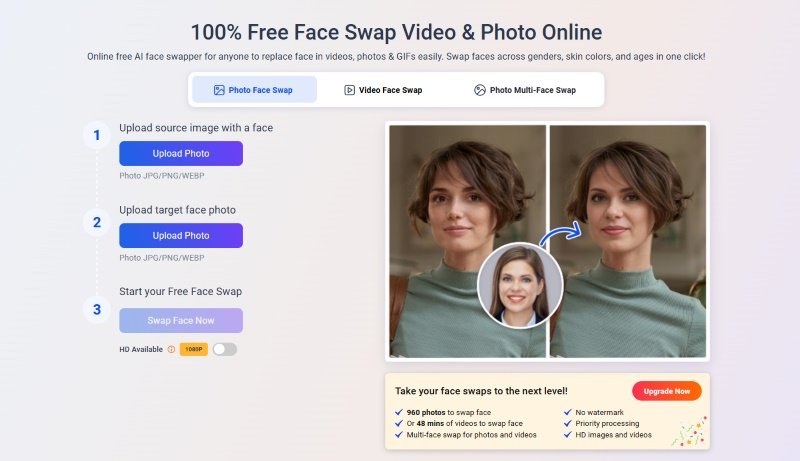

Meilleur globalement : Magic Hour

L’outil de remplacement de visage en vidéo de Magic Hour est l’outil que j’enverrais à la plupart des gens en premier. Aucun compte requis pour les trois premiers remplacements vidéo — c’est une vraie offre d’essai sans engagement, pas un minuteur. La résolution de sortie va de 512px sur le plan gratuit jusqu’à 4K pour les utilisateurs professionnels, avec des contrôles de qualité intégrés pour l’éclairage et les traits du visage.

Dans mon test de plan parlant face caméra, le mélange des bords était le plus propre que j’ai vu parmi tous les outils — en particulier les transitions au niveau de la ligne des cheveux. Sur le clip en mouvement, l’alignement facial est resté stable pendant le mouvement de tête, ce qui est un point de défaillance courant pour les outils moins performants, le rendant particulièrement adapté aux vidéos parlantes face caméra et aux courts clips marketing où le réalisme est important.

Le filigrane du niveau gratuit et la limite de 10 secondes sont de vraies contraintes. Pour les plans payants, les tarifs commencent à 12 $/mois et les rendus sur les courts clips se terminent généralement en moins de 2 minutes. Les mises à jour fin 2025 ont ajouté la détection multi-visages en vidéo et amélioré la précision de la synchronisation labiale — les deux ont été notablement meilleurs lors des tests par rapport aux versions antérieures.

Meilleure option gratuite : Vidwud

Vidwud occupe une position inhabituelle : vraiment aucun filigrane sur les exportations gratuites, et aucun compte requis pour commencer. Sur mon test de plan parlant face caméra, la qualité de sortie était compétitive avec le niveau gratuit de Magic Hour — mélange des bords net, cohérence des tons de peau raisonnable.

Les lacunes sont apparues sur le clip en mouvement. Le pivotement à 45 degrés a produit un saut d’identité visible lors d’un test sur trois — le visage remplacé est brièvement revenu à la géométrie du visage source pendant le pivotement avant de se rétablir. Pas constant, mais présent. Les temps d’attente en file d’attente aux heures de pointe ont été de 7 à 9 minutes dans mes tests, ce qui vaut la peine d’être pris en compte si vous itérez.

Pour quiconque travaille principalement avec des images face caméra et peut planifier autour de la file d’attente, Vidwud offre la meilleure qualité de sortie par euro dépensé — spécifiquement zéro euro.

Meilleur pour les clips multi-visages : Remaker

Remaker est l’outil que j’utiliserais spécifiquement lorsque le clip comporte plus d’un sujet. La résolution de la cohérence temporelle pour la vidéo multi-visages nécessite que chaque visage soit suivi et remplacé indépendamment d’une image à l’autre — et l’interface de Remaker est conçue autour de ce workflow. Vous pouvez sélectionner, configurer et évaluer chaque remplacement de visage indépendamment avant le rendu.

Sur mon clip de test à 3 personnes, la qualité individuelle du remplacement était solide — pas au niveau de Magic Hour pour les détails faciaux en gros plan, mais cohérente tout au long de la séquence sans dérive d’identité pour aucun des trois sujets. Le niveau gratuit fonctionne sur un système de crédits quotidiens qui limite le volume, mais couvre quelques clips de test avant d’atteindre un plafond.

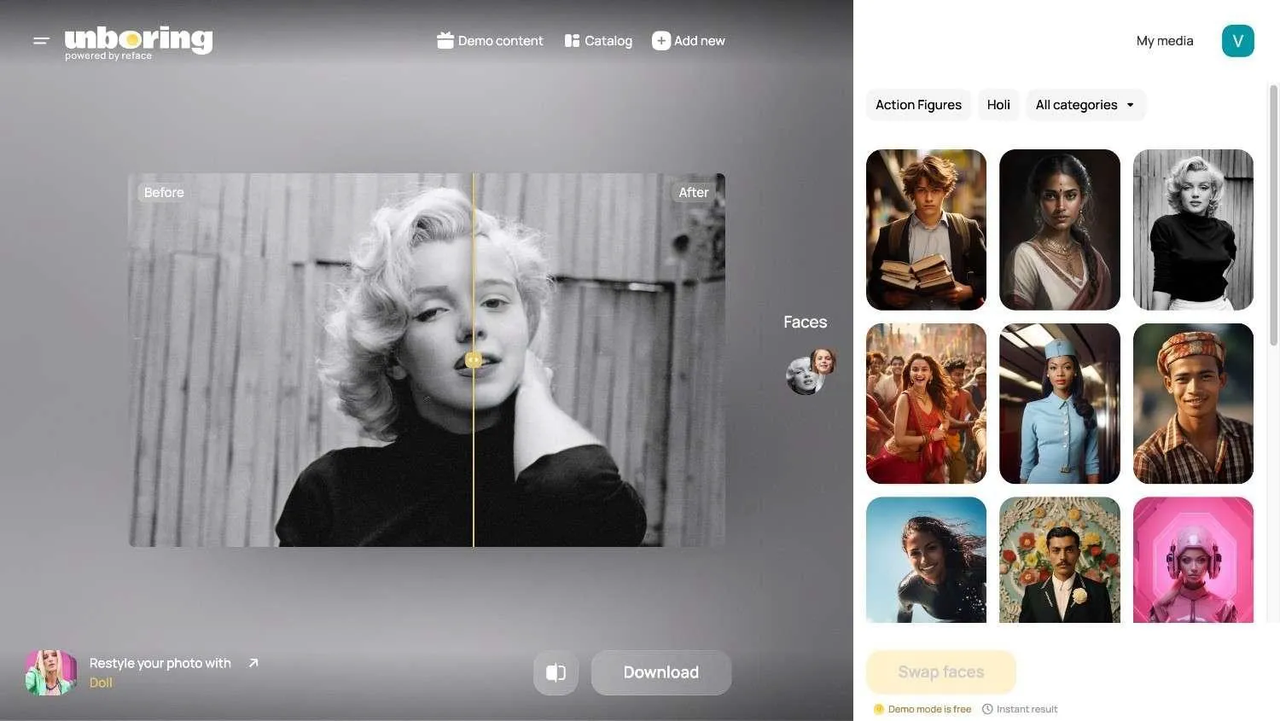

Meilleur pour le rendu rapide : Reface

Reface n’optimise pas pour le réalisme. Il optimise pour la vitesse et le partage, et il réussit les deux. Du téléversement au résultat en moins de 30 secondes, de manière constante. La sortie penche vers la qualité de divertissement — le mélange des bords est plus doux et la correspondance des tons de peau est approximative plutôt que précise.

Je ne l’utiliserais pas pour quoi que ce soit où la précision d’identité importe. Mais pour vérifier si un concept fonctionne avant de consacrer du temps de rendu à un outil plus lent, c’est la boucle de rétroaction la plus rapide disponible. La qualité des modèles varie substantiellement entre les anciennes et les nouvelles additions à la bibliothèque.

Tableau de Comparaison Rapide

Deux remarques sur ce tableau : la qualité spatiale et la cohérence temporelle sont notées séparément car elles divergent significativement entre les outils sur les clips en mouvement. Et « temps de rendu (gratuit) » inclut l’attente en file d’attente — c’est le chiffre qui affecte réellement votre workflow.

Quel Outil Correspond à Quel Type d’Utilisateur

Créateurs occasionnels

Commencez par Magic Hour. Trois remplacements gratuits, aucun compte, rendu rapide. Vous saurez dès votre premier test si la qualité de sortie dépasse votre seuil. Si c’est le cas, c’est tout. Sinon, passez à Vidwud pour des tentatives gratuites illimitées — plus lent, mais sans filigrane.

Éditeurs de mèmes et de formats courts

Reface pour la vitesse quand vous testez des idées. Vidwud pour la qualité quand vous êtes prêt à publier. Le compromis est clair : 30 secondes contre 7 minutes, qualité de divertissement contre sortie propre. Choisissez en fonction de l’étape où vous vous trouvez dans le workflow, pas comme un choix permanent.

Utilisateurs qui accordent plus d’importance au réalisme

Voici la partie que la plupart des avis omettent : un réalisme constant sur un clip vidéo complet — identité stable, transitions d’éclairage naturelles, pas d’artefacts temporels — nécessite une qualité de modèle qui est directement corrélée à la puissance de calcul. Les niveaux gratuits sont des démonstrations, pas des environnements de production. Les plans payants de Magic Hour, avec une sortie jusqu’à 4K et un suivi de précision image par image, représentent la voie la plus claire de « test » à « qualité de sortie constante » parmi les outils que j’ai évalués. Si ce plafond n’est toujours pas suffisant pour votre cas d’usage, les outils de bureau comme DeepFaceLab offrent un contrôle plus granulaire au prix d’une complexité de configuration significative.

Ce que la Plupart des Avis Ne Mentionnent Pas

Pourquoi « gratuit » signifie souvent des limites de file d’attente ou de filigrane

Le problème des niveaux gratuits ne concerne pas principalement les limitations de fonctionnalités — il s’agit de la priorisation du calcul. Les utilisateurs gratuits obtiennent un rendu de priorité inférieure. « Utilisation gratuite illimitée » signifie parfois des temps d’attente de 45 minutes un après-midi chargé. Dans mes tests, la file d’attente aux heures de pointe de Vidwud était de 7 à 9 minutes ; hors pointe, elle tombait à 2 à 3 minutes. Cette variance compte quand vous itérez. Testez sur votre emploi du temps réel, pas à 2h du matin un mardi.

Pourquoi la qualité d’exportation importe plus que la qualité d’aperçu

Les outils compressent les aperçus dans le navigateur. Le fichier que vous téléchargez est ce que vous publiez, et les deux sont souvent différents. Les artefacts de distorsion temporelle dans la vidéo compressée — le genre produit par des pipelines d’exportation de moindre qualité — interagissent avec la qualité spatiale d’une manière qui rend le résultat final pire que ce que suggère n’importe quelle image individuelle. Téléchargez toujours une exportation de test et examinez-la en pleine résolution avant de construire un workflow autour d’un outil. L’aperçu est du marketing. Le téléchargement est le produit.

Une Note sur le Contexte Juridique

Le paysage juridique entourant le contenu facial synthétique a évolué de manière significative et récemment. Le TAKE IT DOWN Act, promulgué le 19 mai 2025, criminalise la publication non consensuelle d’images intimes incluant les deepfakes générés par IA, avec des plateformes concernées tenues de supprimer le contenu signalé dans les 48 heures — et des interdictions pénales entrant en vigueur immédiatement. Le dossier législatif complet est disponible sur le résumé officiel du TAKE IT DOWN Act de Congress.gov.

Dans l’UE, la situation est différente mais tout aussi spécifique. L’article 50 du règlement européen sur l’IA oblige les fournisseurs de systèmes IA générant du contenu vidéo synthétique à s’assurer que les sorties sont marquées dans un format lisible par machine et détectables comme artificiellement générées. Ces obligations entrent en vigueur en août 2026, selon les exigences officielles de transparence de l’article 50 du règlement européen sur l’IA. Si vous publiez publiquement du contenu avec remplacement de visage en Europe, cette exigence s’applique aux outils générant le contenu — et par extension à la façon dont vous le labelisez et le distribuez.

Tous les outils de ce guide sont destinés à un usage créatif consensuel avec du contenu sur lequel vous avez des droits. Cette formulation n’est pas un avertissement juridique générique — c’est le périmètre réel dans lequel ces outils sont utilisables sans exposition légale.

Recommandation Finale

Si vous n’avez besoin que d’expériences rapides

Magic Hour d’abord — trois vrais remplacements gratuits, rendu rapide, sans friction. Puis Vidwud si vous avez besoin de plus de tentatives gratuites et pouvez composer avec les temps d’attente. Entre les deux, vous aurez une idée claire de si la qualité de sortie répond à votre cas d’usage avant de dépenser quoi que ce soit.

Si vous avez besoin d’une qualité reproductible

Une qualité reproductible signifie une sortie constante sur plusieurs clips dans des conditions variables — rendus stables, timing prévisible, cohérence temporelle fiable. Cela nécessite un niveau payant quelque part. Les mises à jour fin 2025 de Magic Hour ont amélioré la détection multi-visages en vidéo et réduit le décalage de synchronisation labiale, avec une vitesse de traitement cloud sur les courts clips maintenant plus rapide et plus stable que les versions antérieures. Pour quiconque construit un workflow de contenu plutôt que d’effectuer des tests ponctuels, cette trajectoire compte autant que la qualité de sortie actuelle.

Fixez votre seuil de qualité minimum. Téléchargez une vraie exportation de test, pas un aperçu. Comparez en pleine résolution. C’est la seule évaluation qui correspond réellement à ce que vous publierez. Si vous souhaitez aller au-delà de l’édition de clips et commencer à générer des vidéos IA from scratch, ce tutoriel explique comment créer des vidéos avec Seedance 2.0 sur Wavespeed. Au revoir, mes chers~