Real-ESRGAN Download: Installations- und Nutzungsanleitung

Erfahren Sie, wie Sie Real-ESRGAN herunterladen, sicher installieren und für das Upscaling verwenden – mit weniger Einrichtungsfehlern.

Hallo, ich bin Dora. Als ich zum ersten Mal „real-esrgan download” eintippte, jagte ich keinem Wunder nach. Ich wollte einfach einen unscharfen Produktfoto bereinigen, ohne ein Dutzend Tabs zu öffnen oder mit einer GUI zu kämpfen, die versucht, hilfreich zu sein. Ich hatte Real-ESRGAN seit Jahren erwähnt gesehen, hatte es aber immer übersprungen, weil jede Anleitung lauter klang als das Tool selbst. Anfang März 2026 setzte ich mich endlich mit einem klaren Ziel hin: es sicher installieren, ein paar Bilder verarbeiten und herausfinden, wo es passt.

Hier ist, was ich gelernt habe, was Real-ESRGAN noch gut kann, wo man es ohne Drama herunterladen kann, und die kleinen Einrichtungsprobleme, über die ich gestolpert bin, bevor sie zur Routine wurden.

Wofür Real-ESRGAN am besten geeignet ist

Grundlagen des Bild-Upscalings

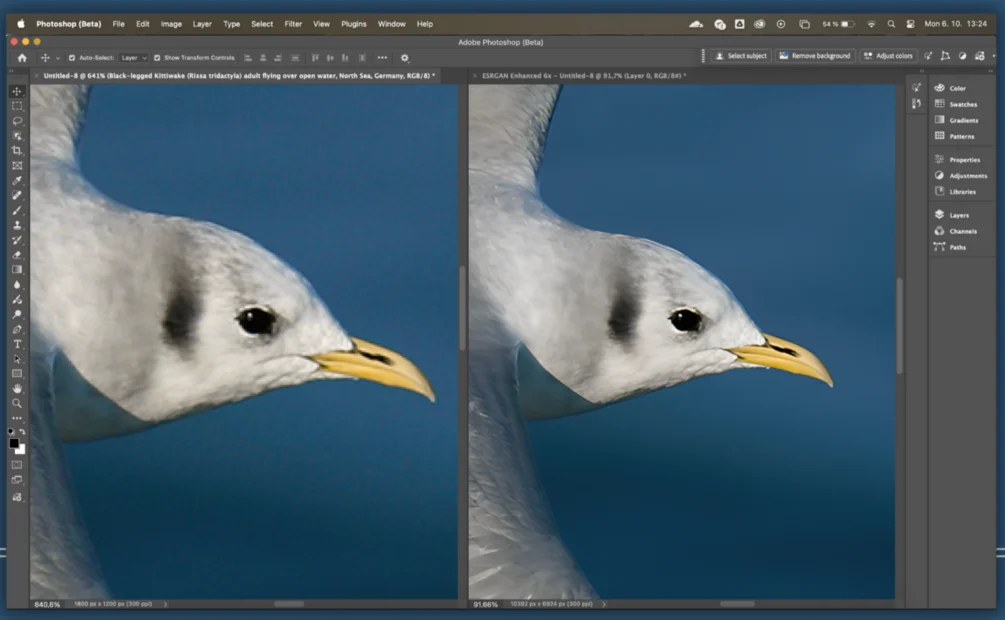

Ich betrachte Upscaling eher als Reparatur denn als Magie. Real-ESRGAN nimmt ein Bild mit niedriger Auflösung und sagt fehlende Details voraus, sodass man es mit 2× oder 4× Skalierung nutzen kann, ohne knusprige Kanten zu erhalten. Es wurde auf realen Degradierungen trainiert (nicht nur auf sauberem Laborrauschen), was wichtig ist, wenn die Quelle ein Screenshot aus einem Blog von 2017 oder ein komprimiertes WhatsApp-Foto ist, das man nicht neu aufnehmen kann.

Als ich im März 2026 auf einem Windows-11-Laptop (RTX 3060) und einem MacBook Air (M2) testete, lieferte Real-ESRGAN solide, gleichmäßige Ergebnisse bei:

- Alten UI-Screenshots und Foliengrafiken

- Produktetiketten, Verpackungen und einfachen Texturen

- Logos ohne winzigen Text

Es ist kein „Wow”-Tool, sondern ein verlässliches. Das ist ein Kompliment.

Wo es sich noch bewährt

Ich habe es mit einigen kostenpflichtigen Optionen und Wrappern verglichen, die ich bereits nutze. Real-ESRGAN hält sich gut, wenn:

- Der Eingabe sauber, aber klein ist. Es füllt die Kanten, ohne auffällige Details zu erfinden.

- Konsistenz über eine Charge hinweg wichtiger ist (Social-Banner, Dokumentationsbilder) als pro-Bild-Perfektion.

- Man einen skriptfähigen Weg möchte, der nicht jeden Monat seine Meinung ändert. Entwickler, die API-Pipelines bevorzugen, erkunden oft Anleitungen zur Verwendung der Z-Image Turbo API für automatisierte Bildgenerierungs-Workflows.

Wo es an Grenzen stößt: sehr feiner Text, Gesichter und lebhafte natürliche Szenen (Laub, Haare). Man kann es mit einem Gesichts-Fixer kombinieren, aber ich halte lieber die Erwartungen einfach: erst skalieren, dann entscheiden, ob eine zweite Bearbeitung woanders nötig ist.

Wo man Real-ESRGAN sicher herunterladen kann

Offizielle oder vertrauenswürdige Quellen

Dieser Teil ist wichtig. Suchergebnisse sind laut, und gespiegelte Builds können Überraschungen enthalten. Was bei mir funktioniert hat:

- Offizielles Repository: Real-ESRGAN auf GitHub (xinntao)

- Gut für die Python/PyTorch-Implementierung, Dokumentation und das Inferenz-Skript.

- Vorkompilierte CLI (schnell, kein Python): realesrgan-ncnn-vulkan-Releases und das gepflegte Binär-Repo von nihui, das dort verlinkt ist. Das sind kleine Befehlszeilentools für Windows, macOS und Linux.

- PyPI (wenn man pip bevorzugt): realesrgan auf PyPI, den Betreuer und die Versionshinweise mit der GitHub-Readme abgleichen, bevor man ihm in einer Produktionsumgebung vertraut.

- Für CUDA/PyTorch-Spezifika: vom offiziellen PyTorch-Website installieren, um die GPU-Treiber abzugleichen.

Eine einfache Regel, der ich folge: Wenn eine Seite nicht auf das Haupt-GitHub-Repo oder das Profil des Betreuers zurückverlinkt, gehe ich zurück.

Dateien, die man tatsächlich benötigt

Dies hängt vom gewählten Weg ab:

- ncnn-vulkan-Binärdateien (Schnellstart): Das Archiv für das eigene Betriebssystem von der Releases-Seite herunterladen. Es enthält ausführbare Datei und Modelldateien. An einem kontrollierten Ort entpacken (z. B. ein Tools-Ordner, nicht Downloads).

- Python/PyTorch-Route: Das Repo von GitHub klonen, dann die Modellgewichte herunterladen. Die üblichen sind:

- RealESRGAN_x4plus.pth (allgemein 4×)

- RealESRGAN_x4plus_anime_6B.pth (Anime/Linienzeichnungen)

Wenn ein Download nach einem Installer mit systemweiten Änderungen für eine einfache CLI fragt, halte ich inne. Die portablen Zips und geklonten Repos haben mir bisher gereicht.

So installiert man Real-ESRGAN

Grundlegender Einrichtungsweg

Ich habe im März 2026 zwei Wege ausprobiert:

- ncnn-vulkan (kein Python, schnellstes Erstergebnis)

- Den neuesten realesrgan-ncnn-vulkan-Zip für das eigene Betriebssystem herunterladen.

- Nach etwas wie C:/tools/realesrgan oder ~/tools/realesrgan entpacken.

- Optional: Den Ordner zum PATH hinzufügen, um den Befehl von überall ausführen zu können. Ich habe das anfangs nicht gemacht: Ich bin einfach in den Ordner gewechselt. Beides funktioniert.

- Python/PyTorch (flexibler, skriptfähig)

- PyTorch mit der richtigen CUDA-Version (unter Windows mit NVIDIA) vom offiziellen Selektor installieren. Meine 3060 brauchte CUDA-12.x-Treiber: Inkompatibilitäten verursachen kryptische Fehler.

- Das Real-ESRGAN-Repo von GitHub klonen.

- Abhängigkeiten mit pip innerhalb einer virtuellen Umgebung installieren.

- Die .pth-Modellgewichte in den Weights-Ordner herunterladen (die Repo-Readme zeigt genaue Pfade). Dann das bereitgestellte Inferenz-Skript verwenden.

Beide Wege funktionieren gut. Wenn man Bilder einfach hochskalieren möchte, ohne Python anzufassen, ist ncnn-vulkan der ruhigste Einstieg.

Was Erstbenutzer oft übersehen

Das hat mich auch erwischt:

- Modell-Platzierung: Das Python-Skript sucht nach Modellen in bestimmten Ordnern. Wenn es kein .pth findet, wählt es still ein Standard-Modell oder gibt einen Fehler aus.

- GPU-Erwartungen: PyTorch benötigt einen CUDA-Build, der zum Treiber passt. Wenn

torch.cuda.is_available()False ist, obwohl man True erwartet, ist man nicht verrückt – die Versionen passen einfach nicht zusammen. - Kacheln und Arbeitsspeicher: 4×-Upscales bei großen Bildern können VRAM-Grenzen erreichen. Kleinere Kachelgrößen helfen, auch wenn es etwas langsamer wird.

- Dateinamen mit Leerzeichen: Die CLI kommt mit Anführungszeichen klar, aber ich halte Testdateien trotzdem einfach, bis alles funktioniert.

So führt man den ersten Test durch

Bild-Eingabe-Workflow

Ich begann mit einem kleinen, hässlichen Screenshot. Mit ncnn-vulkan, aus dem entpackten Ordner:

- Unter Windows oder macOS Terminal:

./realesrgan-ncnn-vulkan -i input.jpg -o output.png

Dies verwendet das Standard-4×-Modell. Wenn es läuft, ist man schon fast am Ziel.

Mit dem Python-Skript (vom Repo-Stammverzeichnis):

python inference_realesrgan.py -n RealESRGAN_x4plus -i path/to/input.jpg -o path/to/output.png --outscale 4

Der erste Durchlauf dauerte bei mir insgesamt ein paar Minuten, hauptsächlich weil ich sichergestellt habe, das richtige Modell zu verwenden. Nach zwei oder drei Bildern hörte ich auf, darüber nachzudenken.

Ausgabeeinstellungen für Einsteiger

Ich halte es anfangs einfach:

- Skalierung: 2× für Social-Bilder, die man wieder komprimiert; 4× wenn mehr Platz zum Zuschneiden benötigt wird.

- Format: PNG wenn man weiter bearbeitet; JPEG wenn man fertig ist und kleinere Dateien möchte.

- Modell: x4plus für allgemeine Fotos und UI; das Anime-Modell für Linienzeichnungen, Icons oder Manga-Stil-Kunst.

Wenn das Ergebnis etwas „plastisch” aussieht, versuche ich 2× statt 4× und schärfe leicht in einem Editor nach. Und wenn winziger Text noch unscharf bleibt, akzeptiere ich die Grenze und ersetze den Text manuell. Das ist kein Versagen, sondern einfach die ehrliche Grenze des Modells.

Häufige Einrichtungsprobleme und Lösungen

Fehlende Abhängigkeiten

- PyTorch erkennt die GPU nicht: PyTorch mit dem exakten CUDA-Build neu installieren, den der Treiber unterstützt (offiziellen Selektor verwenden). Bei einem Laptop-GPU zuerst die Treiber aktualisieren.

- Visual-C++-Laufzeit unter Windows: Wenn die Binärdatei über fehlende DLLs klagt, das neueste Microsoft Visual C++ Redistributable installieren.

- macOS-Berechtigungen: Wenn die App „von einem unbekannten Entwickler” stammt, einmal per Rechtsklick öffnen, um sie auf die Whitelist zu setzen.

Pfad-/Modelldatei-Probleme

- Python-Route: Sicherstellen, dass die .pth-Dateien im Weights-Ordner liegen, den das Skript erwartet. Das genaue Modellnamen-Flag verwenden (z. B.

-n RealESRGAN_x4plus). - ncnn-vulkan: Aus dem Ordner mit der ausführbaren Datei und den Modellen ausführen oder vollständige Pfade angeben. Wenn es meldet, das Modell nicht laden zu können, wurde die Exe wahrscheinlich ohne die Modelle verschoben.

- Leerzeichen in Pfaden: Diese in Anführungszeichen setzen. Ich bevorzuge immer noch kurze, einfache Pfade für wiederholbare Skripts.

GPU- oder Leistungsprobleme

- VRAM-Fehler: Kachelgröße reduzieren (beide Implementierungen unterstützen Kachelung). Es ist langsamer, aber stabiler.

- Vulkan-Backend-Probleme: GPU-Treiber aktualisieren. Bei älteren Intel-iGPUs habe ich gesehen, dass es lautlos fehlschlägt: der Versuch auf einem anderen Gerät hat mir Zeit gespart.

- Wärmeentwicklung bei Laptops: Lange Chargen werden gedrosselt. Ich setze eine niedrigere Thread-Anzahl oder mache Pausen zwischen den Teilen. Langsamer ist besser als ein Absturz bei 95%.

Real-ESRGAN in einem echten Workflow

Wann es allein ausreicht

Real-ESRGAN verdient seinen Platz bei ruhigen, wiederholbaren Aufgaben:

- Alte Screenshots für Dokumentationen auffrischen, ohne Abläufe neu aufzunehmen

- Kleine Produktfotos für einen Newsletter verwendbar machen, oder sogar Produktfotos in kurze KI-Videos umwandeln, was einige Creator jetzt mit Tools wie Seedance tun.

- Icons und einfache Grafiken vor einem Design-Durchgang hochskalieren

In meinen März-Tests dauerte eine Charge von 40 Screenshots etwa 8–10 Minuten auf der 3060 mit ncnn-vulkan. Nicht schneller als einige GUIs, aber weniger aufmerksamkeitsintensiv. Starten, einmal prüfen, weitermachen.

Wann Nutzer zu Topaz oder Wrappern wechseln

Wenn man eine benutzerfreundliche Oberfläche, Chargen-Voreinstellungen oder einen moderneren KI-Bildgenerator wie Z-Image Turbo möchte, helfen Wrapper und kostenpflichtige Apps.

- Upscayl und chaiNNer geben Real-ESRGAN eine einfache Oberfläche.

- Topaz Gigapixel AI schneidet tendenziell besser bei Gesichtern, Haaren und lebhaften natürlichen Texturen ab. Es verarbeitet auch aggressive Ausschnitte mit weniger Halos.

Ich greife immer noch zuerst zu Real-ESRGAN, wenn ich ein verlässliches 2×/4× ohne Aufwand benötige. Wenn das Bild sich sperrt – winziger Serifentext, verrauschte Hintergründe – versuche ich einen zweiten Durchgang in einem anderen Tool. Keine Heldengeschichten, nur ein kleiner Schubs, wo er hilft.

Eine kleine Anmerkung zu „real-esrgan download”: Die Suche nach dem genauen Begriff brachte mich immer wieder auf Aggregator-Seiten. Die offiziellen GitHub-Links bleiben der sauberste Weg. Wenn man mit ähnlichen Einschränkungen zu tun hat, lohnt sich ein Blick. Ich habe kein ordentliches Ende hier, nur dass das Tool nach einem Tag im Hintergrund verschwand – was für mich normalerweise das Zeichen ist, es zu behalten.