Video Face Swap erklärt: Wie es funktioniert + API-Leitfaden

Wie Video Face Swap unter der Haube funktioniert – und wie man es über eine API aufruft. Behandelt die gesamte Pipeline, Eingabeanforderungen und häufige Fehlerquellen.

Hallo, ich bin Dora. Ich gebe es ehrlich zu — als ich zum ersten Mal eine Video-Face-Swap-API aufrief, bekam ich eine Antwort zurück, die fast richtig aussah. Das Gesicht war da. Das Timing war um eine halbe Sekunde verschoben. Die Beleuchtung ließ das Motiv so aussehen, als würde es leicht von innen leuchten, wie ein Discount-Geist.

Das ist das Problem mit der Video-Face-Swap-Technologie. Von außen wirkt sie einfach — Gesicht A auf Körper B tauschen, fertig — aber sobald man über Demo-Clips hinausgeht und versucht, etwas Echtes zu bauen, erkennt man, wie viele bewegliche Teile tatsächlich unter der Haube ablaufen. Diese Teile zu verstehen ist der Unterschied zwischen einem Ergebnis, das poliert aussieht, und einem, das die Nutzer erschaudern lässt.

Dieser Leitfaden erklärt, wie Video-Face-Swap tatsächlich funktioniert, welche verschiedenen Ansätze es gibt, was die API braucht, bevor sie etwas Sinnvolles tun kann, und wie man mit den Fehlerszenarien umgeht, die einem früher oder später unweigerlich begegnen werden.

Was Video-Face-Swap tatsächlich macht

Lass mich das klar aufschlüsseln, denn viele Erklärungen überspringen den Teil, der wirklich wichtig ist.

Video-Face-Swap ist kein Filter. Es ist keine Maske, die über das Filmmaterial gelegt wird. Was es tut — auf einer ziemlich tiefen Ebene — ist, ein Gesicht in jedem Frame eines Videos zu erkennen, seine Geometrie zu kartieren, die Identität eines Quellgesichts zu extrahieren und die Quellidentität auf die Gesichtsstruktur des Ziels zu mischen, während die Bewegung, Beleuchtung und Mimik des Ziels erhalten bleibt.

Das sind drei verschiedene Probleme, die nacheinander ablaufen.

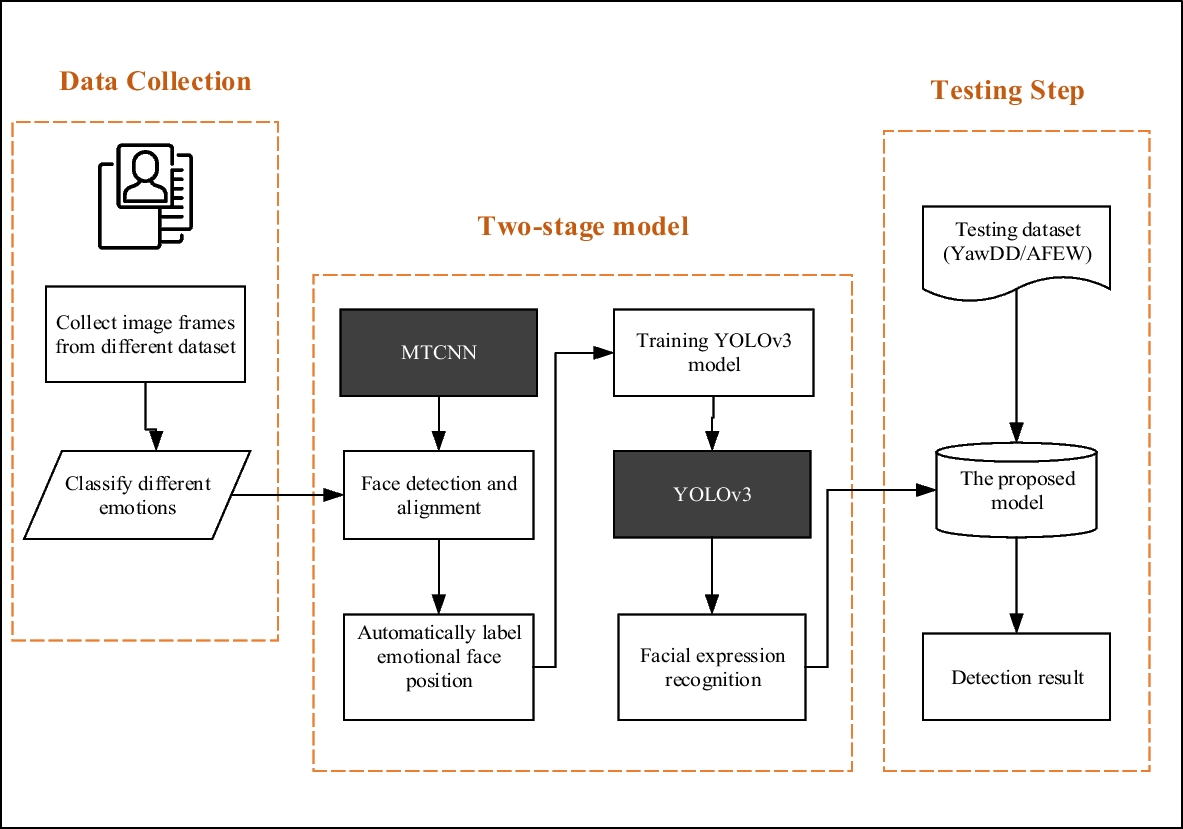

Erkennungs- → Ausrichtungs- → Mischungs-Pipeline

Erkennung ist der Schritt, bei dem das Modell Gesichter im Frame findet. Das klingt einfach. Ist es nicht. Gesichter, die teilweise verdeckt sind, sich in steilen Winkeln befinden oder sich schnell bewegen, erzeugen allesamt Erkennungsfehler. Die meisten Produktionssysteme verwenden Varianten von Multi-Task-Cascaded-Convolutional-Networks — über den grundlegenden MTCNN-Ansatz kann man in diesem Deep-Learning-Leitfaden zur Gesichtserkennung nachlesen — obwohl neuere Architekturen diese frühen Benchmarks erheblich verbessert haben.

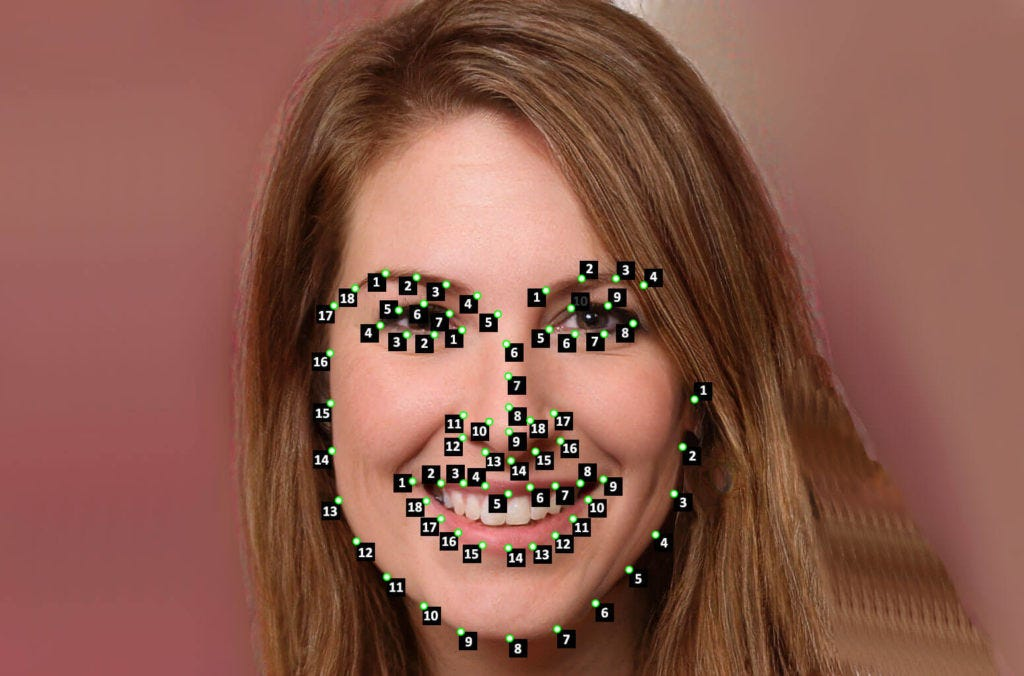

Ausrichtung ist der Schritt, über den die meisten Menschen nicht nachdenken, der aber wirklich kritisch ist. Sobald ein Gesicht erkannt wurde, identifiziert das Modell Gesichtslandmarken — Augen, Nasenspitze, Mundwinkel — und verwendet sie, um das Gesicht in eine kanonische Position und Skalierung zu normalisieren. Ohne diesen Schritt sieht der Swap so aus, als hätte jemand ein Gesicht in einem leicht falschen Winkel aufgesetzt und gehofft, dass es niemand merkt. Es merkt immer jemand.

Mischung ist der Schritt, bei dem die eigentliche Identitätsübertragung stattfindet. Das Modell nimmt die Identitätsmerkmale des Quellgesichts, projiziert sie auf die Zielgesichtsgeometrie und setzt das Ergebnis zurück in den Frame ein. Moderne Ansätze verwenden dafür generative adversarielle Netzwerke (GANs) — ein Generator, der das gemischte Gesicht erstellt, und ein Diskriminator, der den Realismus bewertet — weshalb das Verständnis, wie GAN-basierte Deepfake-Generierung funktioniert, ein wirklich nützlicher Kontext ist, bevor man beginnt, Ausgaben zu debuggen.

Was Ausgabequalität tatsächlich bedeutet

Hier ist etwas, das mich anfangs verwirrt hat: „Qualität” bei Face-Swap-Ausgaben ist keine einzelne Zahl. Es sind mindestens drei separate Dinge.

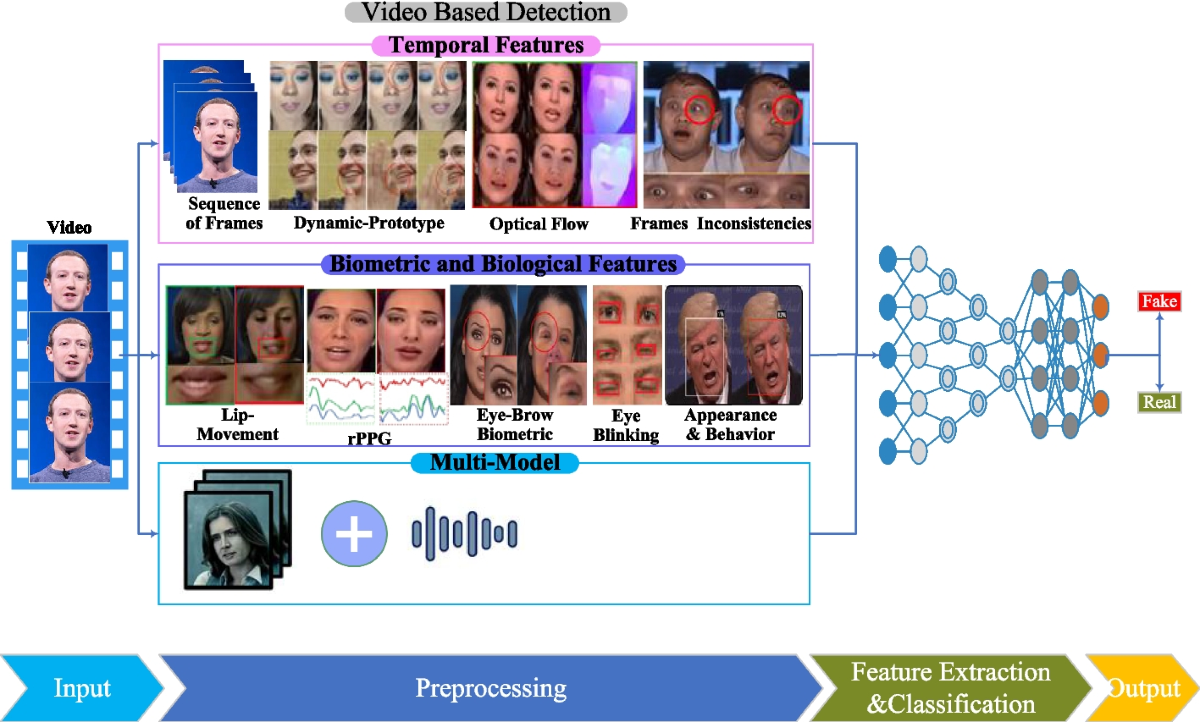

Identitätserhaltung — sieht die Ausgabe tatsächlich wie das Quellgesicht aus, und nicht nur wie ein unscharfer Durchschnitt beider?

Zeitliche Konsistenz — sieht das Gesicht frame-übergreifend gleich aus, oder flackert es subtil?

Fotorealismus — sieht das Ergebnis so aus, als gehöre es in die Szene, oder wirkt es wie eine Compositing-Arbeit?

Man kann eine exzellente Identitätserhaltung und eine schreckliche zeitliche Konsistenz haben. Man kann wunderschönen Fotorealismus mit schlechter Identitätsübertragung haben. Die meisten APIs bieten Einstellungen oder Qualitätsstufen an, die zwischen diesen abwägen. Zu wissen, welche für den eigenen Anwendungsfall wichtig ist, spart viel Verwirrung.

Typen von Video-Face-Swap-Ansätzen

Nicht alle Video-Face-Swap-Modelle funktionieren auf die gleiche Weise. Ähnliche architektonische Unterschiede finden sich bei modernen KI-Videogenerierungsmodellen wie Seedance 2.0, wo zeitliche Konsistenz und Bewegungsmodellierung je nach Ansatz sehr unterschiedlich gehandhabt werden. Es gibt zwei wichtige Dimensionen, die man verstehen sollte, bevor man ein Werkzeug oder eine API auswählt.

Frame-für-Frame vs. zeitlich-bewusste Modelle

Frame-für-Frame-Modelle behandeln jeden Frame des Videos unabhängig. Sie sind generell schneller und einfacher zu implementieren, berücksichtigen aber nicht, dass Video eine Sequenz zusammenhängender Bilder ist. Das Ergebnis: subtiles Flackern zwischen Frames, besonders an den Rändern des Gesichts oder bei schlechten Lichtverhältnissen.

Zeitlich-bewusste Modelle verarbeiten Frames mit dem Wissen darüber, was davor und danach kommt — sie verstehen im Wesentlichen die Bewegung und erhalten die Konsistenz über den Clip hinweg. Ähnliche Kompromisse zeigen sich beim Vergleich führender KI-Videomodelle, wo Stabilität und Bewegungsrealismus wichtige Differenzierungsmerkmale sind. Die Ausgabe ist glatter und stabiler, aber diese Modelle sind schwerer und langsamer. Für alles, was länger als ein paar Sekunden ist oder für die Betrachtung auf einem großen Bildschirm gedacht ist, sind die Latenzkosten zeitlich-bewusster Modelle es wert.

Meine ehrliche Erfahrung: Wenn man prototypisiert oder Thumbnails generiert, ist Frame-für-Frame in Ordnung. Wenn man etwas baut, das Menschen auf einem Vollbildschirm ansehen werden, wird man das Flackern bereuen.

Einzelgesicht vs. Mehrfachgesicht

Einzelgesicht-Modelle sind einfacher und generell von höherer Qualität für ihre spezifische Aufgabe. Wenn der Anwendungsfall ein klar sichtbares Gesicht im Frame beinhaltet — was die meisten Produktionsszenarien abdeckt — ist dies der richtige Ausgangspunkt.

Mehrfachgesicht-Modelle können mehrere Gesichter in einem einzelnen Frame erkennen und austauschen. Sie sind nützlich für Ensemble-Aufnahmen, Gruppenvideos oder Szenarien, in denen man nicht vollständig die Kontrolle über das Eingabevideo hat. Der Kompromiss besteht darin, dass sie rechnerisch aufwendiger sind und anfälliger für falsche Gesichtszuordnung — d.h. das Modell tauscht das falsche Gesicht auf den falschen Körper. Das sollte man wissen, bevor man einen Vier-Personen-Clip einsendet und etwas unbeabsichtigt Surreales zurückbekommt.

Vor dem API-Aufruf: Was man braucht

Hier verschwenden die meisten Menschen Zeit. Nicht weil die API schwierig wäre, sondern weil die Eingabeanforderungen spezifischer sind, als die Dokumentation üblicherweise klar macht.

Eingabeanforderungen (Format, Auflösung, Cliplänge)

Die meisten Video-Face-Swap-APIs erwarten:

- Videoformat: MP4 mit H.264-Kodierung ist der sicherste Standard. Einige APIs akzeptieren auch WebM oder MOV, aber H.264/MP4 wird am universellsten unterstützt.

- Auflösung: 720p ist ein praktisches Minimum für akzeptable Swap-Qualität. 1080p gibt dem Modell mehr Gesichtsdetails zum Arbeiten. Unter 480p beginnen die meisten Modelle, sichtbare Artefakte zu produzieren — der Gesichtsbereich hat schlicht nicht genug Pixel für sauberes Mischen.

- Cliplänge: Viele APIs begrenzen die synchrone Verarbeitung auf 30–60 Sekunden. Längere Clips erfordern die asynchrone Job-Einreichung mit Webhook-Callbacks. Man sollte wissen, in welche Kategorie die eigenen Clips fallen, bevor man die Anfragenverarbeitung entwirft.

- Quellbild: Für das einzutauschende Gesicht reicht in der Regel ein einzelnes gut beleuchtetes Frontalbild. Einige Modelle akzeptieren auch Videoquellen, aber ein klares Standbild mit gleichmäßiger Beleuchtung produziert typischerweise eine konsistentere Identitätsübertragung.

Gesichtswinkel- und Beleuchtungsbeschränkungen

Kurzer Realitätscheck: Die Modelle sind keine Zauberei.

Gesichtswinkel: Die meisten Modelle funktionieren gut bis zu etwa 30–35 Grad von einer Frontalansicht abweichend. Darüber hinaus verliert man die Landmarkengenauigkeit, was zu Ausrichtungsfehlern führt, die wiederum Mischungsartefakte produzieren. Profile werden generell nicht unterstützt oder produzieren unbrauchbare Ausgaben. Wenn das Quellmaterial Personen zeigt, die häufig von der Kamera wegschauen, sollte man die Qualitätserwartungen entsprechend dämpfen.

Beleuchtung: Hartes gerichtetes Licht — seitlich beleuchtete Gesichter, starkes Overhead-Licht, das tiefe Augenschatten erzeugt — ist für den Mischungsschritt schwieriger überzeugend zu handhaben. Das Modell muss die Beleuchtung im Quellgesicht mit der Beleuchtung im Zielframe in Einklang bringen, und je weniger diese übereinstimmen, desto sichtbarer ist die Naht.

Ich sage nicht, dunkles Material zu vermeiden. Ich sage: Wenn man Quellmaterial generiert und irgendeine Kontrolle darüber hat, wird gleichmäßige Beleuchtung die Ausgabe deutlich verbessern.

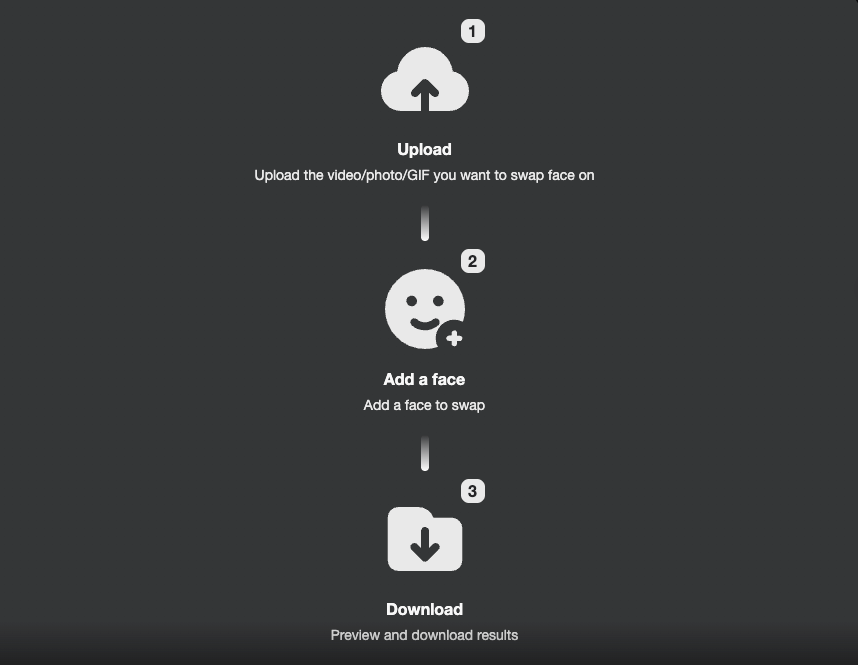

API-Workflow Schritt für Schritt

Werden wir praktisch. Hier ist der typische Ablauf für einen Video-Face-Swap-API-Aufruf.

Authentifizierung

Fast jede Produktions-API verwendet Bearer-Token-Authentifizierung. Man erhält einen API-Schlüssel bei der Registrierung und übergibt ihn als Header:

Authorization: Bearer YOUR_API_KEYDas ist gängige Praxis und stimmt mit den Sicherheitsrichtlinien des OWASP REST Security Cheat Sheet überein. Ein paar Dinge, die man zu Beginn erledigen sollte:

- Den API-Schlüssel als Umgebungsvariable speichern, niemals fest im Code

- Schlüsselrotation einrichten — die meisten APIs ermöglichen das Regenerieren von Schlüsseln ohne Verlust des Kontozugangs

- Falls verfügbar, bereichsbegrenzte Schlüssel verwenden, die nur die Berechtigungen haben, die die Integration tatsächlich benötigt

Senden der Anfrage

Ein typischer Anfrage-Body sieht ungefähr so aus:

{

"source_image_url": "https://your-storage.com/source-face.jpg",

"target_video_url": "https://your-storage.com/target-video.mp4",

"output_format": "mp4",

"quality": "high"

}Einige APIs akzeptieren direkte binäre Datei-Uploads über Multipart-Formulardaten. Andere akzeptieren nur URLs, die auf öffentlich zugängliche Dateien verweisen. Hier sollte man die API-Dokumentation sorgfältig prüfen — das ist eine häufige Quelle stiller Fehler, bei denen die API 200 zurückgibt, aber nichts verarbeitet, weil die Datei-URL nicht zugänglich war.

Bei längeren Clips bekommt man typischerweise eine Job-ID zurück statt der Ausgabe direkt:

{

"job_id": "fswap_a3b92f",

"status": "processing",

"estimated_time_seconds": 45

}Ausgabenverarbeitung

Den Job-Status-Endpunkt abfragen oder einen Webhook konfigurieren, um das Ergebnis nach Abschluss der Verarbeitung zu erhalten. Die Antwort enthält eine Download-URL für das verarbeitete Video. Diese URLs sind typischerweise zeitlich begrenzt — die Ausgabe sollte innerhalb des Ablaufzeitraums heruntergeladen und in eigenem Speicher gesichert werden, was je nach Anbieter üblicherweise 1–24 Stunden beträgt.

Man sollte nicht davon ausgehen, dass die Ausgabe perfekt ist, nur weil der Status „abgeschlossen” ist. Immer stichprobenartig einige Frames prüfen. Status „abgeschlossen” bedeutet, dass die Pipeline ohne Absturz durchgelaufen ist. Es bedeutet nicht, dass der Swap gut aussieht.

Für Produktionssysteme spart der Aufbau einer soliden REST-API-Integration rund um diese asynchronen Muster — ordentliche Fehlerbehandlung, Wiederholungslogik, Webhook-Verifizierung — eine schmerzhafte Debugging-Session später.

Häufige Fehlerszenarien und Lösungen

Hier wird es ernst. Ich bin auf alle drei gestoßen.

Bewegungsartefakte

Wie es aussieht: Das ausgetauschte Gesicht zittert oder „springt” zwischen Frames — ein Problem, das dem sehr ähnlich ist, das in Leitfäden darüber diskutiert wird, wie Ersteller Flackern und Zittern in KI-generiertem Video beheben.

Warum es passiert: Frame-für-Frame-Verarbeitung ohne zeitliche Glättung. Jeder Frame wird unabhängig gelöst, sodass leichte Variationen bei der Landmarkenerkennung Inkonsistenz erzeugen.

Lösung: Falls verfügbar, zu einem zeitlich-bewussten Modell wechseln. Wenn man auf eine Frame-für-Frame-API angewiesen ist, bieten einige Anbieter einen Post-Processing-Stabilisierungsdurchlauf an — danach in den Optionen suchen. Alternativ kann die Vorverarbeitung des Eingabevideos mit Bewegungsstabilisierung vor dem Senden an die API helfen.

Identitätsdrift

Wie es aussieht: Das Ausgabegesicht beginnt allmählich, weniger wie das Quellgesicht auszusehen und mehr wie eine Mischung aus Quelle und Ziel — oder einfach wie eine durchschnittlich aussehende Person.

Warum es passiert: Üblicherweise ein Problem mit der Quellbildqualität. Wenn das Quellgesichtsfoto niedrig aufgelöst ist, schlecht beleuchtet oder in einem nicht-frontalen Winkel aufgenommen wurde, kann das Modell keine zuverlässigen Identitätsmerkmale extrahieren. Es füllt die Lücken mit dem, was es ableiten kann, was oft in Richtung des Zielgesichts abdriftet.

Lösung: Ein qualitativ hochwertigeres Quellbild verwenden. Frontal, gleichmäßige Beleuchtung, mindestens 512×512px im Gesichtsbereich. Diese einzelne Änderung löst in meiner Erfahrung in etwa 80 % der Fälle den Identitätsdrift.

Beleuchtungsunstimmigkeit

Wie es aussieht: Das ausgetauschte Gesicht wirkt „aufgeklebt” — die Beleuchtungsrichtung oder Farbtemperatur des Gesichts stimmt nicht mit der umgebenden Szene überein.

Warum es passiert: Das Mischungsmodell versucht, die Beleuchtung zu harmonisieren, kann aber nur begrenzt viel tun. Große Unterschiede zwischen der Beleuchtung im Quellbild und dem Zielvideo fordern den Compositing-Schritt heraus.

Lösungen:

- Wenn man Kontrolle über das Quellbild hat, es unter Beleuchtungsbedingungen ähnlich dem Zielmaterial aufnehmen

- Einige APIs bieten explizite Beleuchtungsnormalisierung als Parameter an — einschalten

- Bei starken Unstimmigkeiten kann die Nachbearbeitung der Ausgabe mit einem Color-Grading-Durchlauf helfen, das Gesicht überzeugender in die Szene einzufügen

Was ist also das Fazit?

Video-Face-Swap ist wirklich leistungsstarke Technologie, wenn man versteht, was sie zum Erfolg braucht. Die meisten Qualitätsprobleme sind nicht mysteriös — sie lassen sich auf Eingabequalität, Modellauswahl für den Anwendungsfall und realistische Erwartungen darüber zurückführen, was die Pipeline kann und was nicht. Wenn man das richtig hinbekommt, verbringt man viel weniger Zeit damit, Ausgaben zu debuggen, die in der Demo gut aussahen, aber in der Produktion auseinandergefallen sind.