GPT-5.4 Leak: Was Entwickler wissen sollten

GPT-5.4 tauchte kurzzeitig in OpenAI Codex-Repositories auf, bevor es entfernt wurde. Was die Leak-Signale für Entwickler bedeuten könnten.

Hallo, ich bin Dora. Ich war nicht auf der Suche nach einem neuen Modell. Ich räumte gerade eine Build-Pipeline auf, als ich in einem Thread Screenshots eines Commits sah, der „GPT 5.4” erwähnte. Kein großes Tamtam, nur eine kleine Zeile in einem Pull Request. Ich hielt inne – nicht weil ich ein weiteres Akronym in meinem Tag brauchte, sondern weil stille, zufällige Hinweise oft mehr sagen als pompöse Launches.

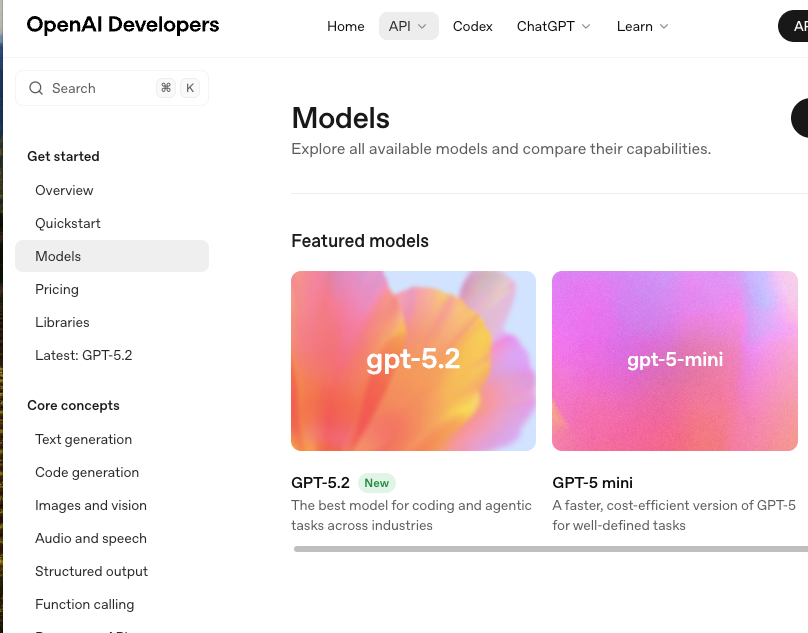

Auf WaveSpeedAI verfügbar — Pro-Token-Abrechnung, OpenAI-kompatibler Endpunkt. GPT-5.4 API → · GPT-5.5 API → · Playground öffnen →

In der ersten Märzwoche 2026 folgte ich den Brotkrumen: gecachte Diffs, Entwicklergespräche und ein PR, der kurz auftauchte und wieder verschwand. Ich habe GPT 5.4 nicht getestet (es gibt nichts Offizielles zum Testen), aber ich schaute genau hin, was der Code zu referenzieren schien und wie damit umgegangen wurde. Der Ton der Spur war fast so bedeutsam wie der Inhalt selbst.

Wie GPT-5.4 in freier Wildbahn auftauchte

Die Codex-PR-Referenzen

Ich bemerkte erstmals Erwähnungen von GPT 5.4 in Verbindung mit einer kurzlebigen Änderung in einem Repository, das offenbar „Codex”-Kontexte berührte – entweder eine veraltete Benennung oder ein interner Pfad, der noch immer „codex” als Bucket für Coding-Flows verwendet. Der kursierende Ausschnitt zeigte ein paar Dinge, die man rund um Model-Routing und Feature-Flags erwarten würde – nichts, das nach „Launch” schrie, eher wie Klempnerarbeit. Wer schon mal mit Model-Wechseln zu tun hatte, weiß: Diese Zeilen sind meistens langweilig und wichtig.

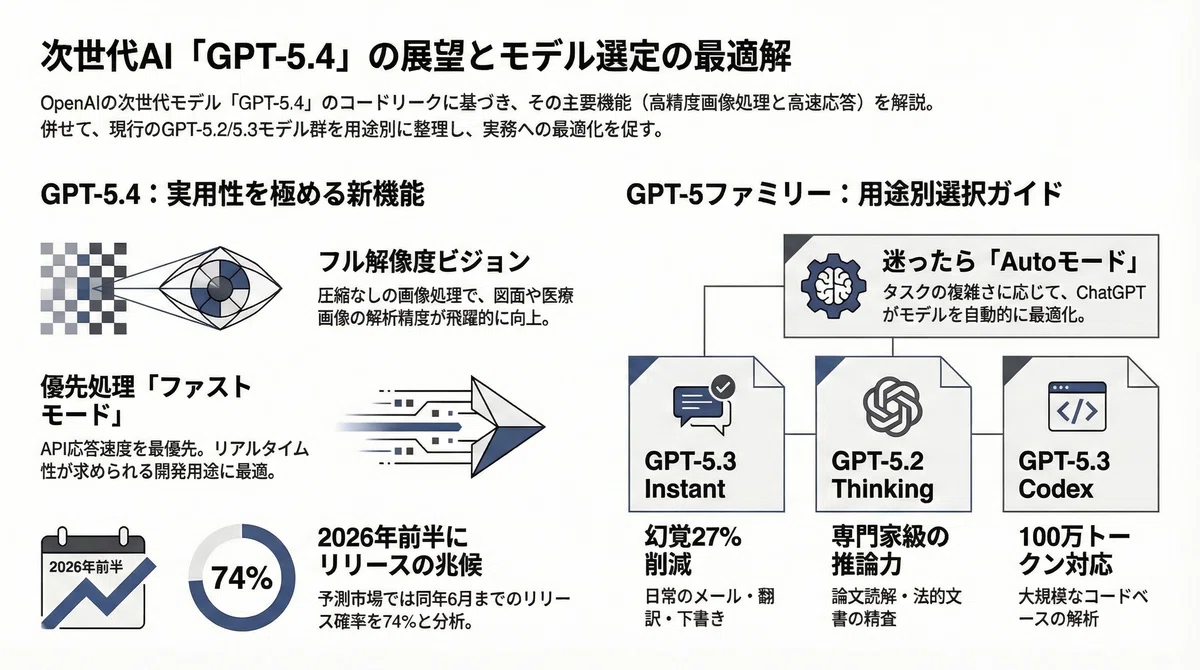

Zwei Dinge stachen in diesen Ausschnitten hervor: eine Referenz auf einen „/fast”-Schalter in einem Chat- oder Agent-Befehlslayer sowie eine Fähigkeitsbezeichnung, die wie Full-Resolution-Vision klang. Ich bin hier bewusst präzise, weil es darauf ankommt. Labels stimmen nicht immer mit der Realität überein, aber sie sind selten zufällig.

Warum der Code schnell entfernt wurde

Der Commit hielt nicht lange. Soweit ich sehen konnte, wurde der Branch neu geschrieben und das Diff des PR bereinigt. Das ist üblich, wenn ein Team eine Referenz zu früh einbaut oder aus Versehen interne und externe Configs vermischt. Mit anderen Worten: Es sah aus wie routinemäßiges Aufräumen unter Druck – kein gezieltes Löschen.

Ich habe dasselbe schon in kleineren Teams getan: einen Flag entdecken, den ich nicht hätte exponieren sollen, force-pushen und weitermachen. Die Schnelligkeit der Korrektur deutete darauf hin, dass jemand weiter oben das Gemurmel bemerkt und beschlossen hatte, die Lücke zu schließen. Kein Skandal. Nur Schadensbegrenzung.

Was Force-Push-Löschungen typischerweise signalisieren

Ein Force-Push beweist nichts Spektakuläres. Er signalisiert meistens Dringlichkeit und den Wunsch, das Repository in einen bekannten Zustand zurückzuversetzen. Die Haltung von Git zum Umschreiben der Historie ist in der Dokumentation nachzulesen – nützliches, scharfes Werkzeug, mit dem man sich leicht schneiden kann. Sieht man mitten in einem Leak einen Force-Push, bedeutet das oft, dass das Team den Leak als Störgeräusch und nicht als koordinierte Enthüllung behandelt.

Zur Einordnung (kein Beweis): eine neutrale Referenz zu Force Pushing und dem Umschreiben der History. Andere Welt, gleiches Muster.

Was der geleakte Code tatsächlich zeigt

Fast-Mode-Befehl (/fast)

Die Zeile, die einen „/fast”-Befehl erwähnte, las sich für mich wie ein Nutzer- oder Agent-Level-Override. Praktisch gesprochen deutet das auf einen Modus hin, der etwas Tiefe gegen Geschwindigkeit tauscht – ein vertrauter Regler in Model-Routern. Wenn das mit GPT 5.4 zusammenhängt, würde ich schnellere erste Token erwarten, vielleicht aggressiveres Caching, vielleicht lockerere Tool-Calling-Schwellenwerte. Nichts Spektakuläres, aber nützlich, wenn man in einer Schleife läuft, die Dutzende kleiner Prüfungen ausführt.

Das klang nicht wie ein Demo-Winner-Feature. Es klang nach etwas, das man während Deployments oder CI-Schritten aktiviert, wenn Latenz wichtiger ist als Eloquenz – zum Beispiel bei Docstring-Normalisierung, kleinen Refactorings oder Schema-Diffs, die keine perfekte Prosa brauchen.

Referenz auf Full-Resolution-Vision

„Full-res Vision” ist ein aufgeladener Begriff. In der Praxis könnte das höhere Input-Limits bedeuten, bessere Verarbeitung dichter UI-Screenshots oder weniger aggressives Downscaling, bevor das Modell Pixel sieht. Wenn das stimmt, tendiert das in Richtung Workflows, bei denen Detailtreue wichtig ist – Code in Screenshots lesen, UI-Zustände prüfen oder Struktur aus Diagrammen extrahieren, ohne Details zu verwischen.

Ich arbeite viel mit Produktnotizen, die in Bilder gepackt sind: Mocks mit winzigen Anmerkungen, Redlines, solches Zeug. Wenn GPT 5.4 diese nativ bei höherer Auflösung verarbeitet, würde das eine stille, aber konstante Last entfernen: den Vorbereitungsschritt, bei dem ich Bilder zuschneiden oder neu kodieren muss, damit ein Modell sieht, was ich sehe.

Coding-Agent-Signale im Codex-Kontext

Die Codex-Referenzen fühlten sich nach Gerüst für Coding-Agents an. Nicht „bau mir eine App”-Magie, sondern eher die kleinen Muskeln: Tool-Auswahl, Funktionsaufrufe, Retry-Policies und Fallbacks, wenn ein Aufruf etwas Unerwartetes zurückgibt. Die Hinweise, die ich sah, deuteten auf diese Schicht hin – nicht auf die Schlagzeile.

Wenn diese Lesart stimmt, könnte GPT 5.4 auf agentische Coding-Flows zugeschnitten sein, die das Chaos realer Repositories überstehen: unvollständige Tests, unzuverlässige Umgebungen, gemischte Dependency-Manager. Weniger „Genie-Programmierer”, mehr „zuverlässiger Kollege, der nach dem zweiten Fehler nicht aufgibt.” Damit kann ich arbeiten.

Wofür GPT-5.4 wahrscheinlich gebaut ist

KI-Coding-Workflows

Ich glaube nicht, dass GPT 5.4 Neuheit jagt. Die Spur deutet auf ruhigere Hände bei gängigen Schleifen hin: Code lesen, kleine Änderungen vornehmen, validieren und ohne Drama erneut versuchen. Wenn man Features unter realen Einschränkungen ausliefert, ist dieser Rhythmus wichtiger als einmalige Brillanz.

Eine Vermutung, gegründet auf das, was ich sah, und was immer wieder in Teams auftaucht, mit denen ich arbeite: GPT 5.4 soll wahrscheinlich näher am Code sitzen als an der Präsentation. Es zielt vermutlich auf schnelle Diffs, konsistente Dokumentationsaktualisierungen, sicherere Refactorings und pragmatische Vorschläge ab, die die Ausführungsphase überstehen.

Optimierung von Agent-Loops

Agent-Loops sind aus langweiligen Gründen fragil – Timeouts, Tool-Fehler, Kontext-Drift und Versuche, die nie konvergieren. Der „/fast”-Hinweis liest sich wie eine Möglichkeit, Loops flink zu halten, während die Vision-Referenz darauf hindeutet, dass der Agent lesen kann, was Menschen tatsächlich weitergeben (Screenshots, Logs, Terminal-Fotos) – ohne zusätzlichen Aufwand.

Wenn das stimmt, könnten zwei Lebensqualitätsgewinne auftauchen:

- Weniger manuelle Wiederholungen: Klareres Error-Typing und ruhigere Backoff-Logik reduzieren Reibung.

- Engere Tool-Aufrufe: Günstigere, schnellere Hops, wenn ein Schritt keine vollständige Überlegung benötigt.

Das hat mir anfangs keine Zeit gespart – einem Leak zu folgen tut das nie –, aber die Form davon fühlte sich nach weniger mentalem Aufwand für Teams an, die die langweiligen Teile der Code-Wartung automatisieren.

Integrationen in Entwickler-Tooling

Die Art und Weise, wie die Referenzen in Routing-Hinweisen versteckt waren, lässt mich vermuten, dass GPT 5.4 so verpackt sein könnte, dass es in bestehende Entwickler-Stacks passt. Zum Beispiel:

- CI/CD-Hooks, die pro Schritt Geschwindigkeit oder Tiefe wählen.

- Editor-Erweiterungen, die Bilder mit höherer Detailtreue lesen können, ohne externe Vorverarbeitung.

- Agent-Frameworks, die weniger auf maßgeschneidbaren Klebecode angewiesen sind.

Wenn das der Weg ist, den GPT 5.4 geht, liegt der Wert nicht in einer Demo: Er liegt in weniger fragilen Adaptern. Das ist die Art von Upgrade, die man drei Wochen später bemerkt, wenn nichts kaputt geht und man erkennt, dass man den Agent an einem Freitag nicht beaufsichtigen musste.

Was wir noch nicht wissen

Keine bestätigten Benchmarks

Ich habe keine glaubwürdigen Benchmarks gesehen, die mit GPT 5.4 verknüpft sind. Keine Eval-Sheets, keine standardisierten Aufgaben, keine Direktvergleiche mit aktuellen Modellen. Ohne Zahlen haben wir nur Eindrücke und Labels. Falls und wenn das erscheint, werde ich zuerst nach kleinen, praktischen Tests suchen: Zeit bis zur Behebung eines fehlschlagenden Tests, Genauigkeit beim Lesen dichter Screenshots oder Anzahl der Wiederholungen pro gelöster Issue.

Keine Preis- oder API-Details

Es gibt nichts Öffentliches über Preise oder Kontingente. Für die Planung ist das wichtiger als Hype. Ein großartiges Modell, das sich schwer budgetieren lässt, schafft es nicht in die Produktion. Wenn Sie heute Szenarien planen, halten Sie Platzhalter in Ihren Tabellen bereit und gleichen Sie mit der aktuellen OpenAI-Modelldokumentation ab, anstatt sich auf geleakte Labels zu verlassen.

Release-Zeitplan unklar

Ich habe kein Datum, kein Quartal, nicht einmal eine Jahreszeit. Das schnelle Entfernen deutet auf interne Bewegung hin, nicht auf Market-Timing. Wenn GPT 5.4 erscheint, könnte es still in Routing-Tabellen oder als Flag in Agent-Frameworks auftauchen, bevor ein großes Banner aufgestellt wird. Oder es ändert den Namen und wird öffentlich nie „GPT 5.4” genannt.

Aktueller Status & Haftungsausschluss (Modell nicht offiziell veröffentlicht)

Stand Anfang März 2026 wurde GPT 5.4 weder angekündigt noch dokumentiert. Ich teile Beobachtungen aus kurzlebigen Code-Referenzen und der Art, wie damit umgegangen wurde – nicht mehr. Das ist keine Empfehlung, irgendetwas neu zu architektieren. Wenn Sie neugierig sind, behalten Sie stabile Docs im Blick, keine Screenshots. Und wenn Sie eine weitere verirrte Referenz entdecken: Atmen Sie durch. Die meisten Leaks sind ruhiger – und nützlicher – als die Schlagzeilen vermuten lassen.

Ich lasse es dabei: Was mich wirklich erwischt hat, war nicht die Versionsnummer. Es waren die kleinen Zeichen der Sorgfalt rund um Loops und Latenz. Wenn das die Richtung ist, in die es geht, bin ich gut damit, weniger Spektakel zu haben.