Die besten KI-Video-Face-Swap-Tools (2026)

Wir haben die führenden KI-Video-Face-Swap-Tools im Jahr 2026 getestet. Hier erfahren Sie, was wirklich funktioniert, was nicht, und wie Sie das Richtige für Ihre Anforderungen auswählen.

Hi, ich bin Dora. Hier ist etwas, das mir immer wieder auffällt: Fast jede „best ai video face swap”-Zusammenfassung testet exakt denselben Demo-Clip unter idealen Bedingungen und erklärt dann einen Gewinner. So wird das in der Praxis aber nicht genutzt.

Ich habe die letzten Wochen damit verbracht, echtes Testmaterial durch eine Auswahl von Tools zu laufen – viele davon basieren auf oder wurden inspiriert von modernen KI-Videogenerierungsmodellen wie Seedance 2.0 – mit unterschiedlichen Lichtverhältnissen, verschiedenen Bewegungsgraden und unterschiedlichen Cliplängen. Was ich herausfand, entsprach nicht immer dem, was das Marketing versprach. Manche Tools, die in der Vorschau beeindruckend aussehen, fallen beim Export auseinander. Manche, die im Browser langsam wirken, liefern die zeitlich stabilste Ausgabe. Und einige, die selten erwähnt werden, erweisen sich als zuverlässigste Wahl für Entwickler, die ein konsistentes API-Verhalten benötigen.

Dieser Leitfaden beschreibt, wie ich diese Tools bewertet habe, wie der Vergleich wirklich aussieht und welches Tool für welche Situation geeignet ist. Keine Affiliate-Rankings. Kein „alle sind großartig!”-Abschwächen.

So haben wir diese Tools bewertet

Verwendete Testclips

Ich habe drei Kategorien von Quellvideos durch jedes Tool laufen lassen:

Clip-Typ A – Kontrollierte Beleuchtung, geringe Bewegung: Talking-Head-Aufnahmen unter gleichmäßigem, diffusem Licht. Personen frontal zur Kamera, minimale Kopfbewegung. Das ist der „Easy Mode”-Test – jedes halbwegs ordentliche Tool sollte hier akzeptable Ergebnisse liefern.

Clip-Typ B – Gemischte Beleuchtung, moderate Bewegung: Handkameraaufnahmen mit einer Mischung aus natürlichem Fensterlicht und künstlicher Aufhellung. Personen bewegen sich natürlich – nicken, drehen sich leicht. Hier beginnen Probleme mit der zeitlichen Konsistenz sichtbar zu werden.

Clip-Typ C – Dynamische Bewegung, hartes oder gerichtetes Licht: Schnelle Kopfdrehungen, ausdrucksstarke Mimik, seitlich oder gegenlicht beleuchtete Personen. Hier beginnen die meisten Tools zu kämpfen, und hier zeigen sich die echten Unterschiede.

Cliplängen reichten von 8 bis 45 Sekunden. Quellgesicht: ein einzelnes, gut beleuchtetes Frontporträt mit 1080px Gesichtsauflösung.

Bewertungsschema

Jedes Tool wurde in vier Dimensionen bewertet:

| Dimension | Was ich gemessen habe |

|---|---|

| Realismus | Identitätserhaltung, Hauttonfähigkeit, Kantenübergangsqualität |

| Zeitliche Konsistenz | Frame-zu-Frame-Stabilität, Flimmern, Drift bei Bewegung |

| Geschwindigkeit | Zeit von der Einreichung bis zum herunterladbaren Ergebnis |

| Kosteneffizienz | Preis pro Minute verarbeitetem Video, Großzügigkeit des Gratisangebots |

Keine einzelne Dimension gewinnt standardmäßig – eine Realität, die auch bei Vergleichen zwischen führenden KI-Videogenerierungsmodellen deutlich wird, wo Geschwindigkeit, Realismus und Stabilität oft gegeneinander abgewogen werden müssen. Ein Tool, das in 20 Sekunden rendert, aber flimmernde Ausgaben produziert, ist in keiner relevanten Hinsicht „schnell”.

Es lohnt sich, einen Moment zu verstehen, warum zeitliche Stabilität in Videos so schwer zu erreichen ist – es läuft auf die Herausforderung hinaus, eine konsistente Identität über aufeinanderfolgende Frames hinweg aufrechtzuerhalten. Die Forschung zur GAN-basierten Videosynthese auf arXiv behandelt das in nützlicher Tiefe, falls man den technischen Hintergrund möchte.

Testdatum und Preisübersicht

Alle Tests wurden Februar–März 2026 durchgeführt. Die Preise entsprechen den zum Testzeitpunkt veröffentlichten Tarifen – diese ändern sich häufig, also bitte vor einer Entscheidung verifizieren.

Die besten KI-Video-Face-Swap-Tools

Beste Gesamtausgabequalität: DeepSwap

Für reine Ausgangsrealistik über alle drei Clip-Typen hinweg lieferte DeepSwap konsistent die überzeugendsten Ergebnisse. Die Identitätserhaltung war selbst bei Clip-Typ C (dynamische Bewegung, hartes Licht) stark, wo die meisten Konkurrenten nach der 15-Sekunden-Marke sichtbaren Drift zeigten.

Was auffiel: der Multi-Engine-Ansatz. DeepSwap führt mehrere KI-Modelle gleichzeitig aus und gibt mehrere Ausgabeversionen zum Vergleich zurück. Bei schwierigen Swaps – ungewöhnliche Quellwinkel, starkes Richtungslicht – ist das enorm wichtig. Eine Engine verarbeitet tiefe Schatten besser; eine andere bewahrt feine Gesichtsdetails wie Textur und Asymmetrie genauer.

Der Kompromiss ist Komplexität und Geschwindigkeit. DeepSwap ist kein Ein-Klick-Erlebnis. Und bei unkomplizierten Talking-Head-Swaps rechtfertigt die zusätzliche Verarbeitungszeit nicht immer das Qualitätsgefälle gegenüber einfacheren Tools.

Am besten geeignet für: Produktionsarbeit, Marketinginhalte, alles, was auf großen Bildschirmen genau betrachtet wird.

Preisgestaltung: Kreditbasiert, Pay-as-you-go. Kein dauerhaftes Gratisangebot.

Beste Developer-API-Integration: Magic Hour

Wenn man etwas baut, statt nur Inhalte zu generieren, ist Magic Hour die entwicklerfreundlichste Option, die ich getestet habe. Die API ist gut dokumentiert, liefert vorhersagbare strukturierte Antworten und verwaltet asynchrone Jobs sauber – was bei der Integration von Face Swap in eine größere Pipeline sehr wichtig ist.

Die zugrunde liegenden Modelle sind ebenfalls solide. Die zeitliche Konsistenz bei Clip-Typ B (moderate Bewegung) war unter den besten, die ich sah, und die Ausgabequalität bei Talking-Head-Clips war wirklich beeindruckend. Es ist auch eines der wenigen Tools, das Face Swap mit Lippensynchronisation und Bild-zu-Video-Generierung auf einer einheitlichen API-Oberfläche integriert – nützlich, wenn der Anwendungsfall mehr als nur Gesichtsaustausch beinhaltet.

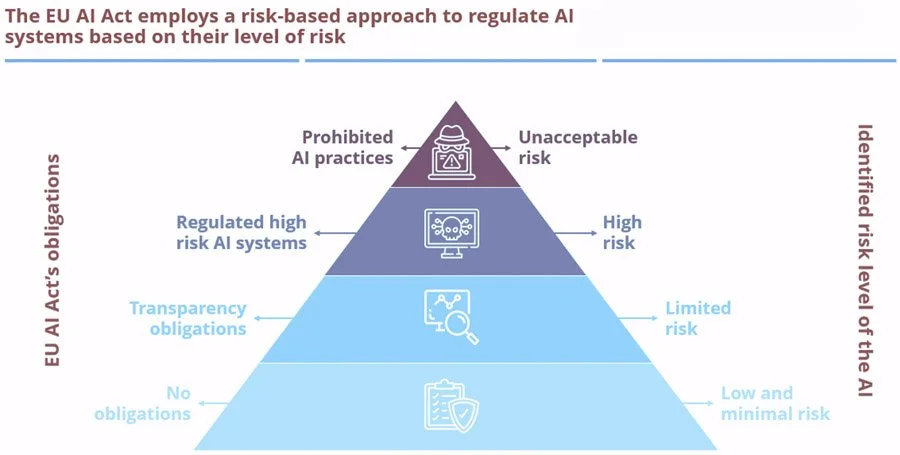

Es ist erwähnenswert, dass das regulatorische Umfeld rund um synthetische Medien sich verschärft. Gemäß Artikel 50 des EU-KI-Gesetzes müssen Anbieter von KI-Systemen, die synthetische Audio-, Bild- oder Videoinhalte generieren, sicherstellen, dass Ausgaben in einem maschinenlesbaren Format markiert und als künstlich erzeugt oder manipuliert erkennbar sind. Magic Hour enthält standardmäßig Content-Wasserzeichen, was die Compliance erleichtert, wenn man Produkte baut, die in regulierten Märkten vertrieben werden. Für einen umfassenderen Überblick darüber, was diese Verpflichtungen in der Praxis bedeuten, lohnt es sich, die Zusammenfassung des EU-KI-Gesetzes des Europäischen Parlaments zu lesen, bevor man etwas für Verbraucher veröffentlicht.

Am besten geeignet für: Entwickler, die Anwendungen bauen, Batch-Automatisierungs-Workflows, Teams, die langfristig auf API-Zuverlässigkeit angewiesen sind.

Preisgestaltung: Abonnement-Stufen mit API-Zugang. Kostenlose Testversion verfügbar.

Beste Lösung für Clips mit mehreren Gesichtern: Reface

Das gleichzeitige Austauschen mehrerer Gesichter ist deutlich schwieriger als ein einzelnes Gesicht. Das Modell muss mehrere Gesichter pro Frame erkennen, zuordnen und unabhängig voneinander verarbeiten – und wenn die Gesichtszuweisung falsch läuft, ist das Ergebnis visuell chaotisch auf eine Weise, die schwer zu erklären ist.

Reface verarbeitet Multi-Gesicht-Szenarien zuverlässiger als alles andere, das ich getestet habe. Die Gesichtszuweisung blieb in Clips mit zwei bis drei Personen korrekt, selbst wenn sich Gesichter kurz überschnitten. Die Ausgabe wird keine Preise für Fotorealismus gewinnen, aber sie ist konsistent – und für Gruppeninhalte für soziale Medien schlägt Konsistenz Perfektion.

Die GAN-Architektur, die die meisten modernen Face-Swap-Tools antreibt – bei der ein Generator-Netzwerk und ein Diskriminator-Netzwerk iterativ konkurrieren, um den Realismus zu verbessern – ist bei den meisten dieser Plattformen grundsätzlich gleich. Was die Multi-Gesicht-Leistung differenziert, ist in der Regel, wie das Tool Gesichtserkennung und -verfolgung vor dem generativen Schritt handhabt, nicht das generative Modell selbst.

Am besten geeignet für: Gruppenclips, Ensemble-Aufnahmen, social-first-Inhalte mit mehreren Personen.

Preisgestaltung: Abonnement ab 3,99 $/Monat. Gratisstufe mit Wasserzeichen.

Beste kostenlose Option: FaceFusion

FaceFusion ist Open-Source, läuft lokal und produziert Ausgabequalität, die für ein kostenloses Tool keine Selbstverständlichkeit ist. Es ist keine Web-App – die Einrichtung erfordert etwas technische Geduld – aber sobald es läuft, hat man volle Kontrolle über Modellparameter, keine Wasserzeichen und keine Kosten pro Verarbeitung.

Für datenschutzbewusste Nutzer bedeutet die lokale Architektur, dass Quellbilder und Videos nie das eigene Gerät verlassen. Das ist ein echter Vorteil für alle, die mit Aufnahmen identifizierbarer Personen arbeiten, insbesondere da die Datenaufbewahrungsrichtlinien cloud-basierter Tools zunehmend unter die Lupe genommen werden.

Der Haken: Es nimmt einen nicht an die Hand. Fehlermeldungen sind knapp. Verarbeitungsparameter müssen manuell eingestellt werden. Und anders als Cloud-Tools skaliert es nicht horizontal, wenn viele Clips parallel verarbeitet werden müssen.

Am besten geeignet für: Experimentierende Entwickler, datenschutzbewusste Nutzer, alle, die bereit sind, Einrichtungsaufwand gegen null laufende Kosten zu tauschen.

Preisgestaltung: Kostenlos und Open-Source.

Vergleichstabelle

| Tool | Realismus | Zeitliche Konsistenz | Multi-Gesicht | API-Zugang | Einstiegspreis |

|---|---|---|---|---|---|

| DeepSwap | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ | Begrenzt | Pay-per-use |

| Magic Hour | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ✅ | ✅ Vollständig | Abonnement |

| Reface | ⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ Stark | ❌ | 3,99 $/Monat |

| FaceFusion | ⭐⭐⭐⭐ | ⭐⭐⭐ | ✅ | Self-hosted | Kostenlos |

Bewertungen basieren auf Tests mit Clip-Typ B (gemischte Beleuchtung, moderate Bewegung). Ergebnisse variieren je nach Clip-Typ.

Was die meisten Bewertungen übersehen

Lücke zwischen Vorschauqualität und Exportqualität

Das ist das Erste, das mich erwischt hat. Mehrere Tools zeigen eine hochwertige Vorschau im Browser, die wirklich beeindruckend aussieht. Die exportierte Datei – in der Auflösung und Bitrate, die man tatsächlich benötigt – sieht merklich anders aus.

Die Lücke zeigt sich meist auf zwei Arten: Kompressionsartefakte an Haarlinie und Gesichtskanten sowie eine Unschärfe im Endprodukt, die in der Vorschau nicht sichtbar war. Immer einen Export in voller Auflösung herunterladen und prüfen, bevor man eine Tool-Entscheidung auf Basis von Vorschauen trifft. Was man in einem Browser-Player bei 720p sieht, ist nicht das, was das Publikum sehen wird.

Warum Rendergeschwindigkeit allein keinen Realismus vorhersagt

Ich habe diese Aussage immer wieder gesehen: „Verarbeitung in unter 10 Sekunden.” Das ist entweder ein sehr kurzer Clip, eine sehr niedrig aufgelöste Ausgabe oder ein sehr schneller Weg zu mittelmäßiger Qualität.

Zeitliche Konsistenz – das, was Video-Face-Swaps über die Zeit hinweg real erscheinen lässt – hängt eng mit Problemen zusammen, die in Anleitungen zum Beheben von Flimmern und Jitter in KI-generierten Videos besprochen werden. Nicht nur in einem einzelnen Frame – das Modell muss Bewegung über Frames hinweg verstehen. IBMs technischer Überblick über die Funktionsweise von GANs erklärt, warum dieser iterative Prozess Rechenaufwand erfordert: Die Generator- und Diskriminator-Netzwerke konkurrieren effektiv durch viele Zyklen, um realistische Ausgaben zu erzeugen. Tools, die bei langen Clips in Sekunden Ergebnisse liefern, verzichten fast immer auf dieses zeitliche Denken. Geschwindigkeit ist ein Signal, kein Feature. Schnelle Verarbeitung bei Videos länger als 15 Sekunden bedeutet meist, dass etwas übersprungen wurde.

Empfehlung nach Anwendungsfall

Gelegenheitsnutzer

Reface ist die richtige Wahl. Es ist schnell, mobilfreundlich, verarbeitet Gruppenclips gut, und die Gratisstufe ist für kurze Clips wirklich nutzbar. Man bekommt keine produktionsreife Realistik, aber in unter einer Minute teilbares Material mit minimalem Einrichtungsaufwand.

Entwickler, die reproduzierbare API-Ausgaben benötigen

Magic Hour. Die API-Dokumentation ist übersichtlich, das asynchrone Handling ist zuverlässig, und die Ausgabe ist konsistent genug, um nutzerorientierte Produkte darauf aufzubauen. Wenn die Integration regulierte Märkte betrifft, vereinfacht auch das integrierte Wasserzeichen die Compliance-Position gemäß Rahmenbedingungen wie den Transparenzanforderungen des Artikels 50 des EU-KI-Gesetzes.

Nutzer, die Multi-Gesicht-Unterstützung benötigen

Reface für Social-Content, DeepSwap für Produktionsarbeit. Bei schnellen Gruppenclips für soziale Medien gewinnt Refaces Geschwindigkeit und zuverlässige Gesichtszuweisung. Bei Multi-Gesicht-Arbeit für Marketing oder professionelles Video, wo Qualität zählt, liefert DeepScaps Multi-Engine-Ansatz sauberere Ergebnisse, insbesondere wenn die Gesichter nicht alle frontal beleuchtet und nach vorne gerichtet sind.

Was ist also tatsächlich das beste KI-Video-Face-Swap-Tool 2026? Das hängt davon ab, was man unter „bestes” versteht.

Bester Realismus unter schwierigen Bedingungen: DeepSwap. Beste API zum Produktbauen: Magic Hour. Bestes für Gruppen: Reface. Bestes kostenlos: FaceFusion. Jede Zusammenfassung, die einen einzigen Gewinner für alle wählt, optimiert für Einfachheit, nicht für Genauigkeit.

Die eigenen Clips testen. Das Tool, das bei fremdem Material am besten aussieht, funktioniert nicht zwangsläufig mit dem eigenen.