2026年的GPT Image 2:值得整合嗎?

一份以開發者為優先的GPT Image 2指南,涵蓋API存取、定價、速率限制、編輯支援,以及其是否已準備好用於生產工作流程。

我是 Dora。上週末,我在一個已使用舊版模型的工作流程中接入了 gpt-image-2。相同的提示詞、相同的參考圖片、相同的批次大小。目的不是為了感嘆它多厲害,而是要搞清楚更換模型 ID 之後究竟會改變什麼。我是 Dora,這正是我在向團隊推薦任何東西之前會做的事。

測試了三天,我有足夠的內容可以記錄下來。還不足以給出最終評價,但足以標記出開發者在整合之前應該檢查的地方。

這篇文章是為那些已經透過 API 輸出圖片的人寫的。如果你正在評估是否要將 gpt-image-2 加入生產工作流程——與你目前使用的任何模型並行——以下是我希望有人事先告訴我的事情。模型是真實可用的,API 已上線,如果你不先閱讀文件,速率限制會讓你措手不及。

GPT Image 2 是什麼,以及 OpenAI 官方發布了哪些內容

確認的模型 ID、端點和發布時間

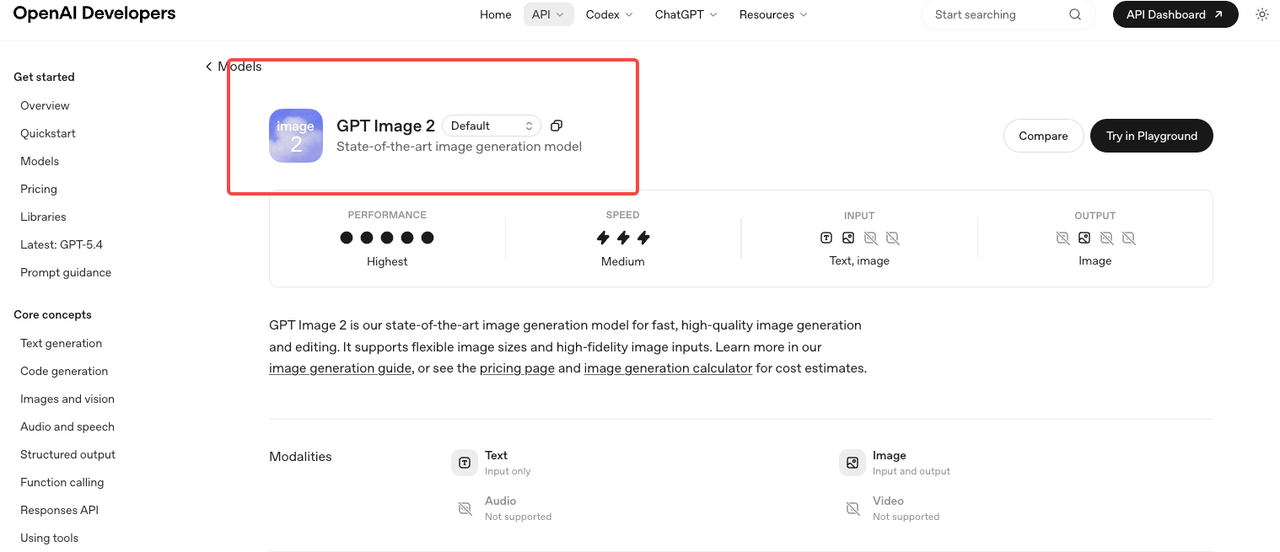

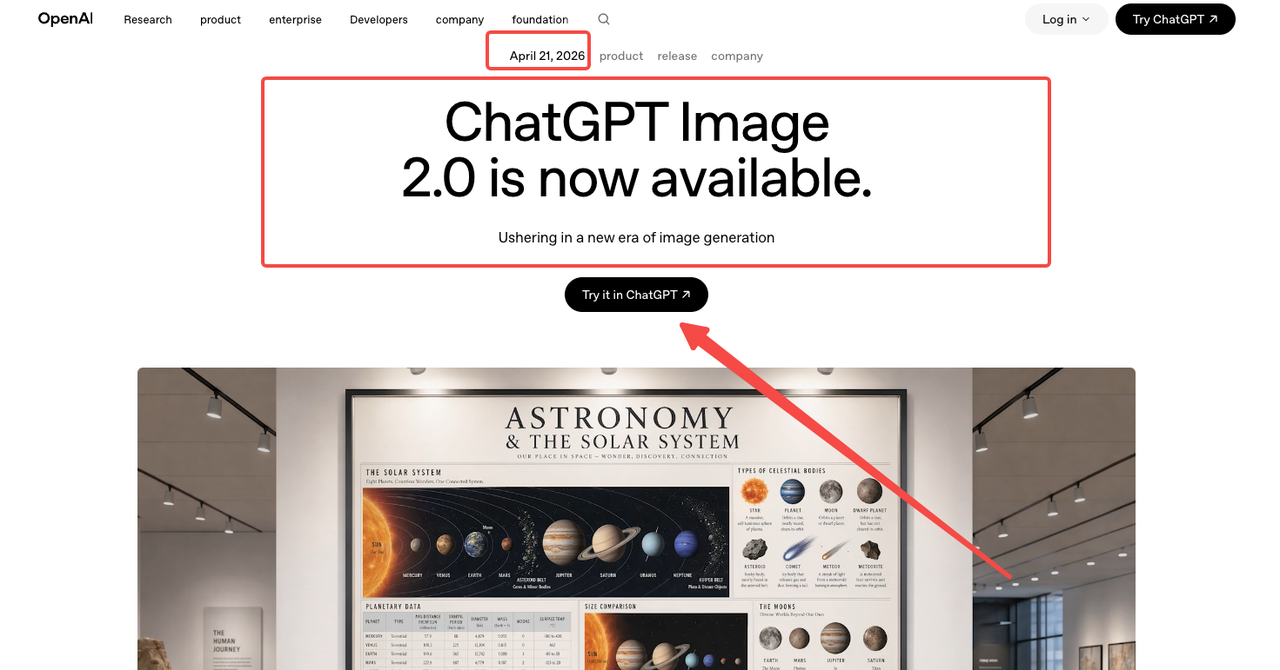

OpenAI 於 2026 年 4 月 21 日發布了 gpt-image-2,同時推出了面向消費者的「ChatGPT Images 2.0」品牌重塑。模型 ID 為 gpt-image-2,目前的快照版本固定為 gpt-image-2-2026-04-21,詳見 GPT Image 2 官方模型頁面。它透過 v1/images/generations、v1/images/edits、v1/responses 和 v1/chat/completions 運行。

以上是已驗證的範圍。任何聲稱更早獲得 API 存取的說法,要麼是 ChatGPT 內部的 A/B 測試流量,要麼是純粹的推測。在生產程式碼中請使用快照 ID——當 OpenAI 發布新版本時,別名會自動向前滾動,而這不是你希望在批次執行中途自動更改的行為。

以上是已驗證的範圍。任何聲稱更早獲得 API 存取的說法,要麼是 ChatGPT 內部的 A/B 測試流量,要麼是純粹的推測。在生產程式碼中請使用快照 ID——當 OpenAI 發布新版本時,別名會自動向前滾動,而這不是你希望在批次執行中途自動更改的行為。

與早期 GPT Image 模型相比有什麼變化

對開發者而言,有兩件事很重要。第一,gpt-image-2 是首個內建推理功能的 OpenAI 圖片模型——他們稱之為「思考模式」,記錄於 ChatGPT Images 2.0 發布公告。在生成之前,模型可以規劃版面配置、搜尋網路參考資料,並自我檢查輸出結果。第二,文字渲染改善到了混合文字版面配置可用的程度——這類版面配置曾讓所有之前的商業模型崩潰——如 維基百科 GPT Image 條目 中涵蓋模型譜系的記錄所確認。

我兩項都測試了。推理模式是真實存在的。但也更慢。

GPT Image 2 為何對生產團隊重要

編輯支援、彈性尺寸與工作流程影響

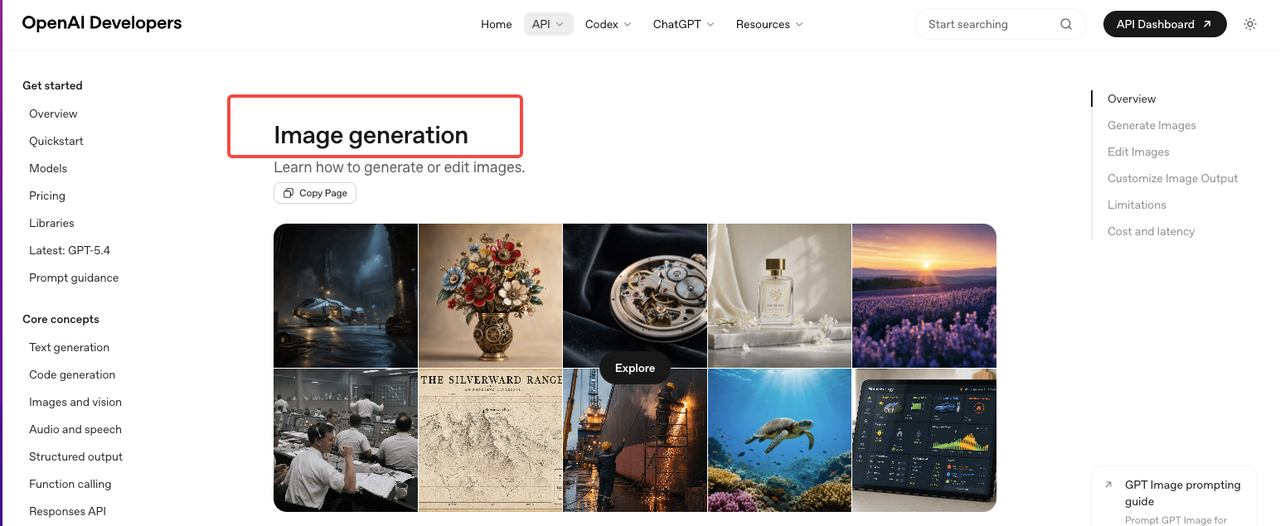

API 同時提供生成和編輯功能,這意味著你可以在一次呼叫中傳遞參考圖片和指令——無需另外建立修補(inpainting)流程。官方圖片生成指南 涵蓋了尺寸、品質、格式、壓縮和背景選項。

有一個細節讓我碰壁:目前透過 Responses 圖片生成工具選項不支援透明背景。 我在第二天才發現,當時我已處理了半批次的工作,誤以為與舊版模型功能相同。輸出結果回傳的是白色填充,而非 alpha 通道。整批次的結果在後續合成步驟中完全無法使用。如果你的流程依賴 alpha 輸出,在切換模型之前,請先針對你實際的程式碼路徑驗證這一點。我為此浪費了一個小時,加上失敗批次的費用。

對於執行多步驟素材工作流程的團隊——生成、編輯、精修、匯出——統一介面節省了實際的交接成本。不是因為每個步驟更快,而是因為少了一個需要維護的整合環節。生產環境中的活動部件越少,日後出問題的地方就越少。

品質、延遲與團隊應詢問的推出問題

速度是「中等」,這是 OpenAI 自己的模型說明書所述。實際上,思考模式會增加明顯的延遲——對於一次性行銷素材來說可以接受,對於批次作業來說則很痛苦。非思考模式更接近 gpt-image-1.5 的水準。

決策不應是「因為更聰明所以永遠使用思考模式」,而應是「當版面配置很重要時使用思考模式,當速度重要時略過它」。對於包含文字和空間限制的模型稿,多花幾秒鐘可以讓你在第一次嘗試就得到可用的結果。對於一批背景變體,你希望走更快的路徑。

我還沒有執行足夠多的批次來給出精確的延遲數字。三天還不夠。我能確認的是:第一層(Tier 1)上的冷路徑請求會很快被限流。 每分鐘 5 張圖片的上限聽起來很寬裕,直到失敗的重試和並行測試運行消耗掉相同的配額。這不是模型問題,這是層級問題,它決定了這對你而言是否已準備好用於生產環境。

開發者整合前需要驗證的事項

定價、速率限制與不支援的功能

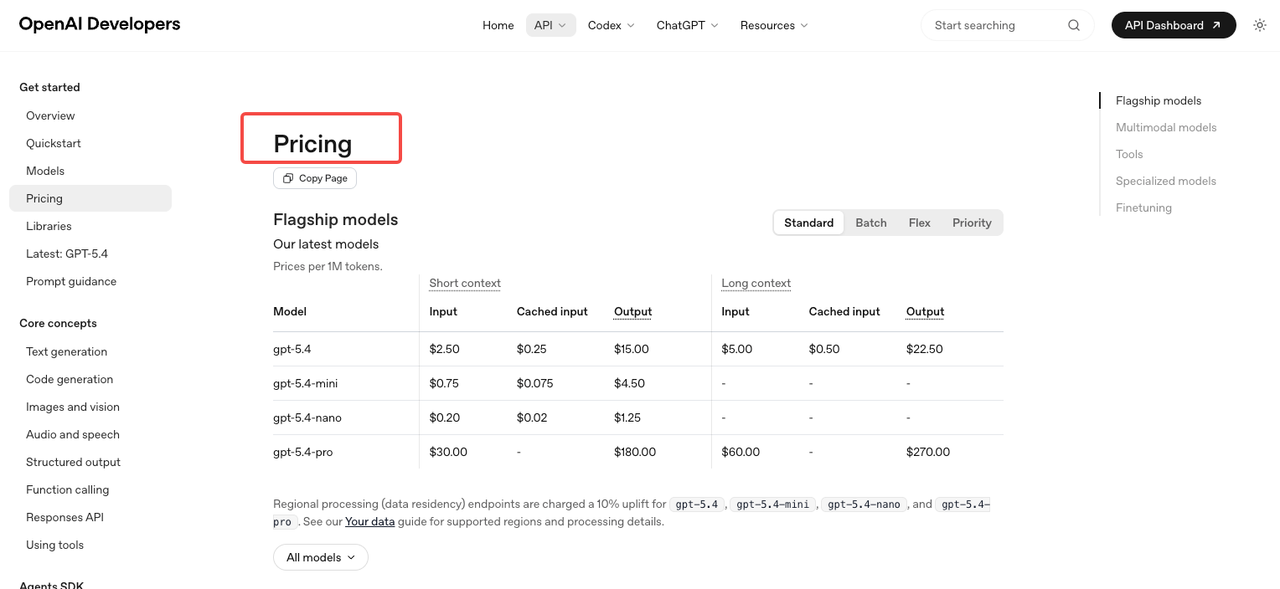

根據 OpenAI 定價頁面 的基於 Token 定價:圖片輸入為每百萬 Token $8,快取圖片輸入 $2,圖片輸出 $30。文字輸入 $5,快取 $1.25,文字輸出 $10。批次層級將這些價格減半。計算器中公佈的每張圖片估算約為 $0.006(低品質)、$0.053(中等)和 $0.211(高品質),以 1024×1024 為例。

速率限制是團隊容易踩坑的地方。第一層每分鐘上限為 5 張圖片。第二層跳至 20 張,第三層 50 張,第五層 250 張——但達到第五層需要花費 $1,000 且帳號存在超過 30 天,詳見 OpenAI 速率限制指南。如果你的產品預期會有突發流量,在上線之前就要規劃好層級提升計畫。

生產使用的操作問題

在整合之前,我會針對自己的工作流程驗證以下五件事:

- 你的流程是否需要透明背景(目前透過 Responses 工具不支援)

- 在實際負載下,你的峰值每分鐘圖片數量是多少

- 你是否在執行帶參考圖片的編輯(這些會增加圖片輸入 Token——不要只從輸出估算)

- 你的提示詞策略是否受益於推理模式,還是非思考模式已足夠

- 當生成失敗時會發生什麼——你會重試、回退還是排隊

REST 圖片生成 API 參考文件 記錄了請求/回應的結構。在撰寫你的封裝函式之前請先閱讀。

GPT Image 2 的強項情境與弱項情境

強項情境: 圖片中包含文字的產品(UI 模型稿、資訊圖表、選單、帶有文案的社群圖片)、非拉丁文字的在地化行銷活動、受益於單一 API 同時處理生成和編輯的工作流程,以及已在 OpenAI 計費體系內的團隊。

目前的弱項情境: 第一層或第二層帳號的大量批次流程、透過 Responses 工具需要透明背景的產品、思考模式延遲開銷很重要的延遲敏感應用,以及現有模型已經調整完善且切換成本超過邊際品質提升的團隊。

這不是「用它或落後」的情況,而是「針對你自己的限制條件進行驗證」的情況。模型很好。它是否對你有利,取決於上述五個問題。

常見問題

GPT Image 2 是否可在 OpenAI API 中使用?

可以。模型 ID 為 gpt-image-2,快照版本為 gpt-image-2-2026-04-21。它可透過標準的圖片生成、圖片編輯和 Responses 端點存取。免費層不受支援——你需要付費帳號,速率限制依使用層級擴展。

GPT Image 2 最適合哪些圖片任務?

任何涉及圖片內文字的情況(選單、模型稿、資訊圖表、多語言圖形)、參考驅動的編輯,以及需要空間推理的版面配置。文字渲染是最具實際意義的升級。對於純粹的寫實圖片生成(不含文字),相較於 gpt-image-1.5 的提升幅度較小。

團隊應首先檢查哪些限制?

三個具體問題:透明背景不透過 Responses 圖片生成工具選項支援、第一層每分鐘限制 5 張圖片,以及推理模式會增加延遲。此外值得注意的是——模型頁面上列出串流、函式呼叫和結構化輸出均為不支援的功能。

它是否已準備好用於大量生產?

可以,但不能在全新帳號上。達到第三層(每分鐘 50 張)需要花費 $100 且帳號至少存在 7 天。第五層(每分鐘 250 張)需要花費 $1,000 且帳號歷史達 30 天。如果你從第一天就需要高並發,請規劃層級進程,或使用具有更高共享限制的提供商。

與 GPT Image 1.5 相比,定價如何?

gpt-image-2 使用基於 Token 的計費:圖片輸入 $8/M,圖片輸出 $30/M。每張圖片估算(1024×1024)約為低品質 $0.006、中等 $0.053、高品質 $0.211。帶參考圖片的編輯會增加圖片輸入 Token,因此實際成本高於僅輸出的估算。在假設與 1.5 版本持平之前,請先將你的實際工作負載放入計算器中試算。

結論

三天的測試不足以對長期可靠性給出最終評價。但足以說明模型是真實可用的,API 是穩定的,整合問題大多是操作層面而非技術層面——定價層級、速率限制、你的工作流程可能依賴的缺失功能。在做出承諾之前,請先用你實際的提示詞和實際的並發量執行小型試驗。 這是我目前能確認的全部。其餘的你需要在自己的環境中驗證。

下週將繼續更新批次延遲數字,等我有足夠可信的數據之後。

往期文章: