2026年GPT Image 2:值得集成吗?

面向开发者的GPT Image 2全面指南,涵盖API访问、定价、速率限制、编辑支持,以及它是否已准备好用于生产工作流。

我叫 Dora。上周发布后,我花了一个周末把 gpt-image-2 接入一个已在上一代模型上运行的工作流。相同的提示词、相同的参考图、相同的批量大小。目的不是被它打动——而是弄清楚换个模型 ID 之后到底会有什么变化。我是 Dora,这是我在向团队推荐任何东西之前的一贯做法。

三天下来,我积累了足够多的内容可以写下来。还不足以给出结论,但已经足够指出开发者在集成之前应该核查哪些问题。

这篇文章面向已经在通过 API 交付图像的人。如果你在评估是否要把 gpt-image-2 加入生产工作流——与你目前运行的模型并列使用——以下就是我希望有人提前告诉我的内容。这个模型是真实的,API 已上线,如果你不提前读文档,限速会让你措手不及。

GPT Image 2 是什么,以及 OpenAI 官方发布了什么

已确认的模型 ID、端点和发布时间

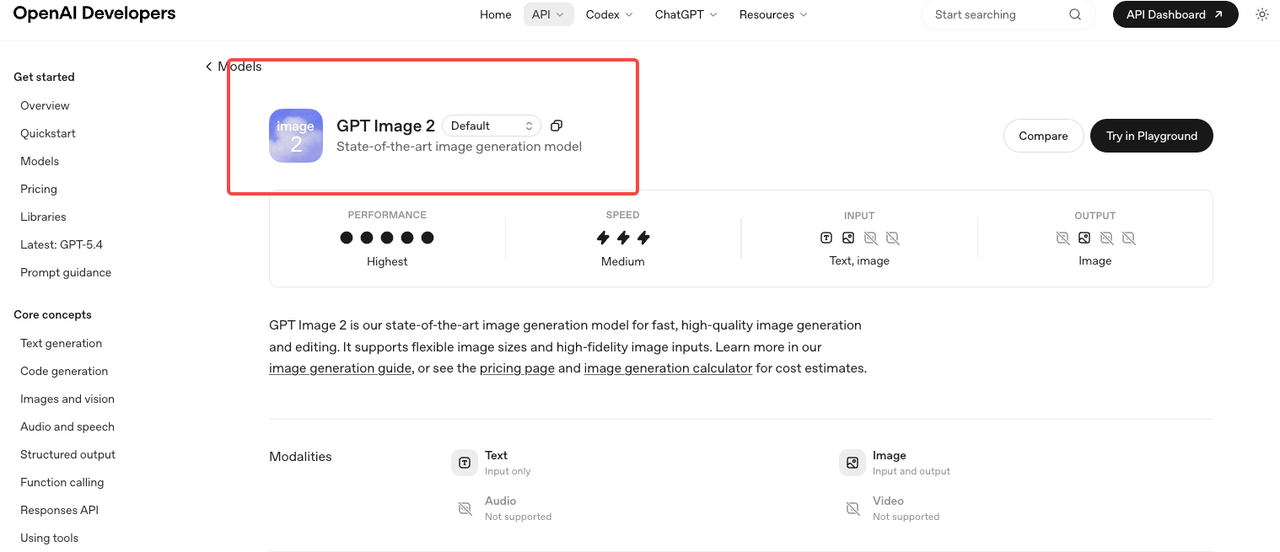

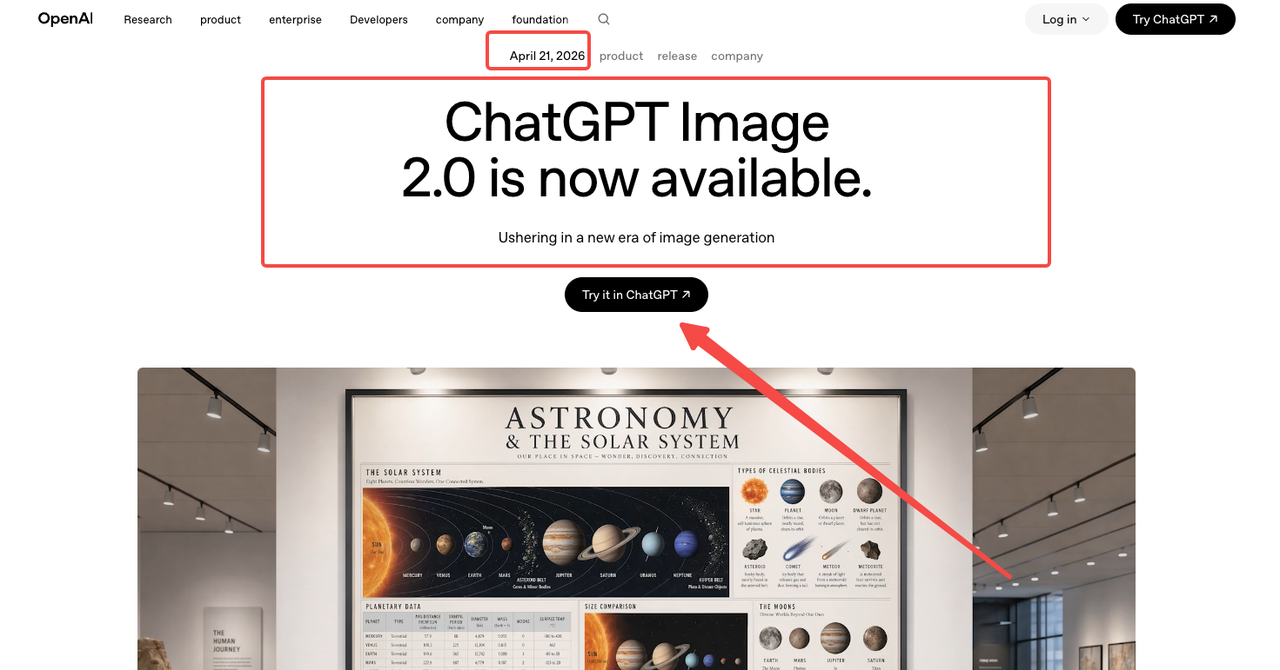

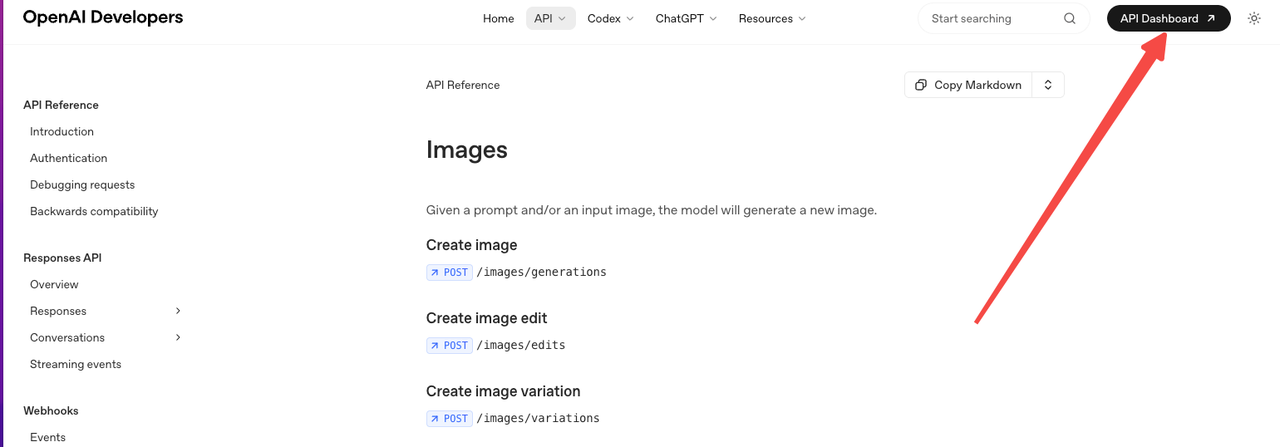

OpenAI 于 2026 年 4 月 21 日发布了 gpt-image-2,同步推出了面向消费者的”ChatGPT Images 2.0”品牌重塑。模型 ID 为 gpt-image-2,当前快照版本为 gpt-image-2-2026-04-21,详见官方 GPT Image 2 模型页面。它通过 v1/images/generations、v1/images/edits、v1/responses 和 v1/chat/completions 运行。

这是已验证的接口范围。任何声称更早获得 API 访问权限的说法,要么是 ChatGPT 内部的 A/B 测试流量,要么是猜测。在生产代码中使用快照 ID——当 OpenAI 发布新版本时,别名会向前滚动,而这种行为不应该在批处理中途悄悄改变。

这是已验证的接口范围。任何声称更早获得 API 访问权限的说法,要么是 ChatGPT 内部的 A/B 测试流量,要么是猜测。在生产代码中使用快照 ID——当 OpenAI 发布新版本时,别名会向前滚动,而这种行为不应该在批处理中途悄悄改变。

与早期 GPT Image 模型相比有何变化

有两点对开发者来说很重要。第一,gpt-image-2 是首个内置推理能力的 OpenAI 图像模型——也就是他们所称的”思考模式”,记录在ChatGPT Images 2.0 发布公告中。在生成之前,模型可以规划布局、在网络上搜索参考资料,并对输出进行自检。第二,文字渲染有了明显提升——以前每个商业模型都会搞砸的混合文字布局,现在能产出可用的结果,这在涵盖模型谱系的维基百科 GPT Image 词条中也有相关确认。

两点我都测试过了。推理模式是真实存在的。但也更慢。

GPT Image 2 对生产团队意味着什么

编辑支持、灵活尺寸及工作流影响

API 同时暴露了生成和编辑接口,这意味着你可以在一次调用中传入参考图和指令——无需单独的修复绘制管道。官方图像生成指南涵盖了尺寸、质量、格式、压缩和背景选项。

有一个细节让我吃了亏:透明背景目前不支持通过 Responses 图像生成工具选项实现。 我在第二天发现了这个问题,当时已经跑了半批任务,我之前以为它与上一代模型保持了一致。输出结果用白色填充代替了 alpha 通道。整批图像对下游合成步骤来说全部报废。如果你的管道依赖 alpha 输出,请在换模型之前对照你的实际代码路径验证这一点。我为此损失了一个小时,外加失败批次的 credits。

对于运行多步骤资产工作流的团队——生成、编辑、精修、导出——统一接口节省了真实的交接成本。不是因为每一步更快,而是因为少维护一个集成。生产中的活动部件越少,后续出问题的地方就越少。

质量、延迟和团队应该问的部署问题

速度是”中等”,这是 OpenAI 自己模型卡上的描述。实际上,思考模式会带来明显的延迟——对一次性营销素材来说可以接受,对批处理任务来说就很痛苦。非思考模式更接近 gpt-image-1.5 的水平。

决策不是”永远用思考模式,因为它更聪明”。而是”当布局重要时用思考模式,当速度重要时跳过它”。对于包含文字和空间约束的样机,那几秒钟换来的是第一次就能用的结果。对于一批背景变体,你会想走更快的路径。

我还没有跑足够多的批次来给出干净的延迟数据。三天不够。我能确认的是:Tier 1 上的冷路径请求很快就会被限速。 每分钟 5 张图的上限听起来还算宽裕,直到失败重试和并行测试运行耗尽相同的配额。这不是模型的问题。这是套餐层级的问题,它决定了这个模型对你是否已经适合生产使用。

开发者在集成前需要验证的内容

定价、限速和不支持的功能

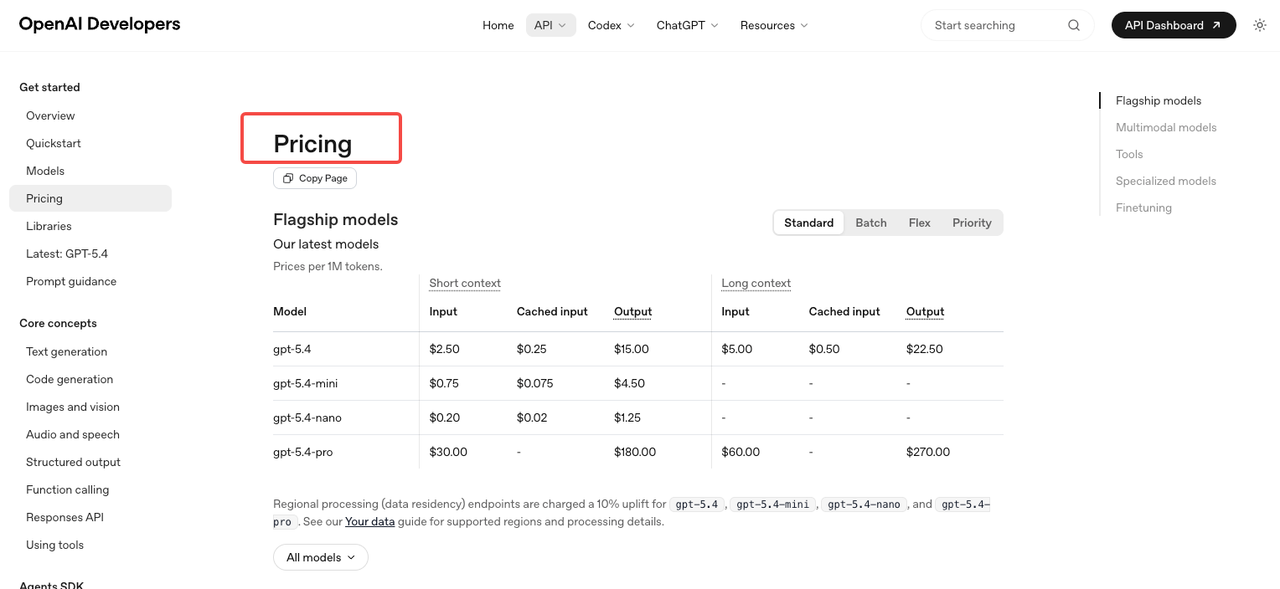

基于 token 的定价详见OpenAI 定价页面:图像输入每百万 token $8,缓存图像输入 $2,图像输出 $30。文字输入 $5,缓存 $1.25,文字输出 $10。批量层级半价。计算器中发布的单张图像估算约为 $0.006(低质量)、$0.053(中等)和 $0.211(高质量),尺寸 1024×1024。

限速是团队容易踩坑的地方。Tier 1 上限为每分钟 5 张。Tier 2 跳到 20 张,Tier 3 到 50 张,Tier 5 到 250 张——但要达到 Tier 5,需要累计消费 $1,000 且账户已有 30 天历史,详见OpenAI 限速指南。如果你的产品预期会有突发流量,请在上线前规划好套餐层级的提升路径。

生产使用的运营问题

在集成之前,我会针对自己的工作流核查以下五件事:

- 你的管道是否需要透明背景(目前 Responses 工具不支持)

- 在实际负载下,你的峰值每分钟图像数是多少

- 你是否在运行带参考图的编辑(这会增加图像输入 token——不要仅凭输出估算成本)

- 你的提示策略是否受益于推理模式,还是非思考模式已经足够

- 生成失败时会发生什么——你是重试、回退,还是排队

REST 图像生成 API 参考文档记录了请求/响应结构。在编写你的封装层之前先读一遍。

GPT Image 2 适合什么场景,不适合什么场景

强适配: 图像内包含文字的产品(UI 样机、信息图、菜单、带文案的社交图),非拉丁文字的本地化活动,受益于单一 API 同时处理生成和编辑的工作流,以及已在 OpenAI 计费关系内的团队。

目前较弱的适配: Tier 1 或 Tier 2 账户上的大批量管道,通过 Responses 工具需要透明背景的产品,思考模式开销敏感的延迟敏感型应用,以及现有模型已经调优到位、切换成本超过边际质量收益的团队。

这不是”用它否则就会落后”的情况。这是”对照自身约束条件验证”的情况。这个模型很好。它是否对你好,取决于上面五个问题的答案。

常见问题

GPT Image 2 在 OpenAI API 中可用吗?

可以。模型 ID 是 gpt-image-2,快照为 gpt-image-2-2026-04-21。可通过标准图像生成、图像编辑和 Responses 端点访问。免费套餐不支持——你需要付费账户,限速随使用层级扩展。

GPT Image 2 最适合哪类图像任务?

任何涉及图像内文字的任务(菜单、样机、信息图、多语言图形),基于参考图的编辑,以及需要空间推理的布局。文字渲染是最具实际意义的升级。对于纯写实照片生成且不含文字的场景,相比 gpt-image-1.5 的提升幅度较小。

团队应该首先检查哪些限制?

三个具体的:透明背景不支持通过 Responses 图像生成工具选项实现,Tier 1 每分钟最多生成 5 张图,推理模式会增加延迟。另外值得检查的是——模型页面上列出了流式传输、函数调用和结构化输出均不支持。

它适合高并发生产使用吗?

可以,但不适用于新账户。达到 Tier 3(50 张/分钟)需要累计消费 $100 且账户至少 7 天。Tier 5(250 张/分钟)需要累计消费 $1,000 且账户历史至少 30 天。如果你从第一天起就需要高并发,请提前规划套餐层级提升,或使用具有更高池化限额的服务商。

与 GPT Image 1.5 相比定价如何?

gpt-image-2 使用按 token 计费:图像输入 $8/M,图像输出 $30/M。单张图像估算(1024×1024)约为低质量 $0.006,中等 $0.053,高质量 $0.211。带参考图的编辑会增加图像输入 token,因此实际成本高于仅凭输出估算的数字。在假设与 1.5 版本价格相当之前,先把你的实际工作量跑一遍计算器。

结论

三天的测试不足以对长期可靠性给出结论。但足以说明这个模型是真实的,API 是稳定的,集成问题大多是运营层面的而非技术层面的——定价层级、限速、你的工作流可能依赖的缺失功能。在正式提交之前,用你的实际提示词和实际并发量跑一个小规模试点。 这是我目前能确认的全部。其余的你需要在自己的环境中验证。

下周继续,等我有足够可信的数据后,会补上批量延迟数据。

往期文章: