GPT Image 2 в 2026 году: стоит ли интегрировать?

Руководство для разработчиков по GPT Image 2: доступ к API, ценообразование, ограничения запросов, поддержка редактирования и готовность к производственным рабочим процессам.

Привет, я Дора. Я провела выходные после релиза, встраивая gpt-image-2 в рабочий процесс, который уже использовал предыдущую модель. Те же промпты, те же референсные изображения, те же объёмы батчей. Цель была не в том, чтобы восхититься, — а в том, чтобы выяснить, что реально меняется при замене идентификатора модели. Я Дора, и именно так я поступаю, прежде чем что-либо рекомендовать команде.

Три дня спустя мне есть что записать. Не достаточно для вынесения вердикта, но достаточно, чтобы обозначить, что разработчики должны проверить перед интеграцией.

Эта статья для тех, кто уже отправляет изображения через API. Если вы оцениваете, стоит ли добавить gpt-image-2 в производственный рабочий процесс — наряду с тем, что у вас уже работает, — вот что я бы хотела, чтобы мне кто-нибудь рассказал. Модель реальна, API работает, а ограничения по частоте запросов застанут вас врасплох, если не прочитать документацию заранее.

Что такое GPT Image 2 и что OpenAI официально выпустил

Подтверждённые идентификаторы моделей, эндпоинты и сроки запуска

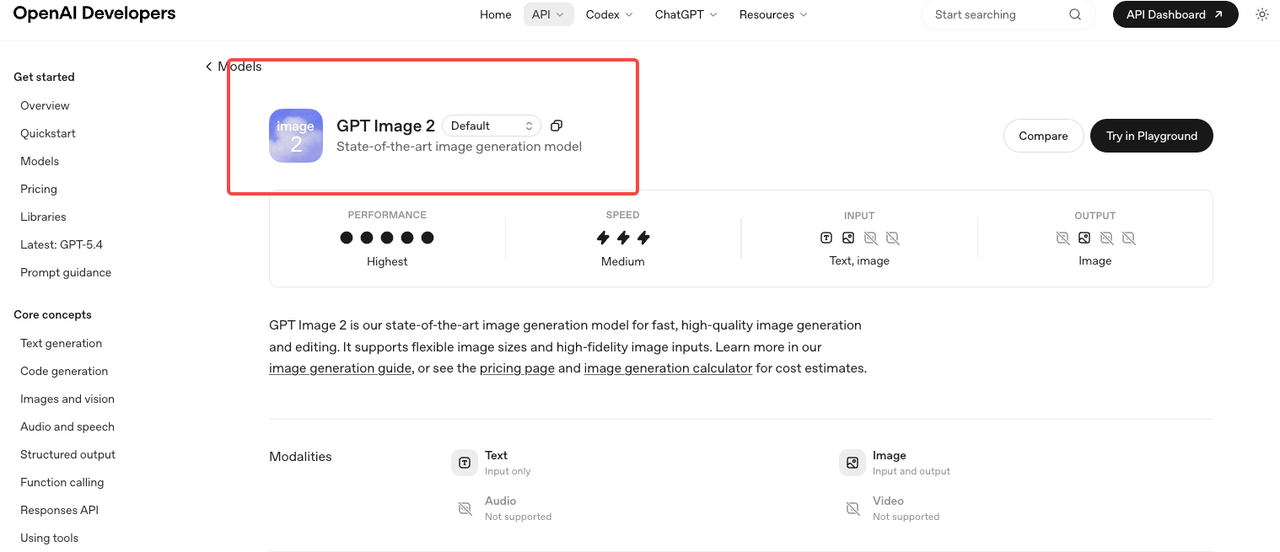

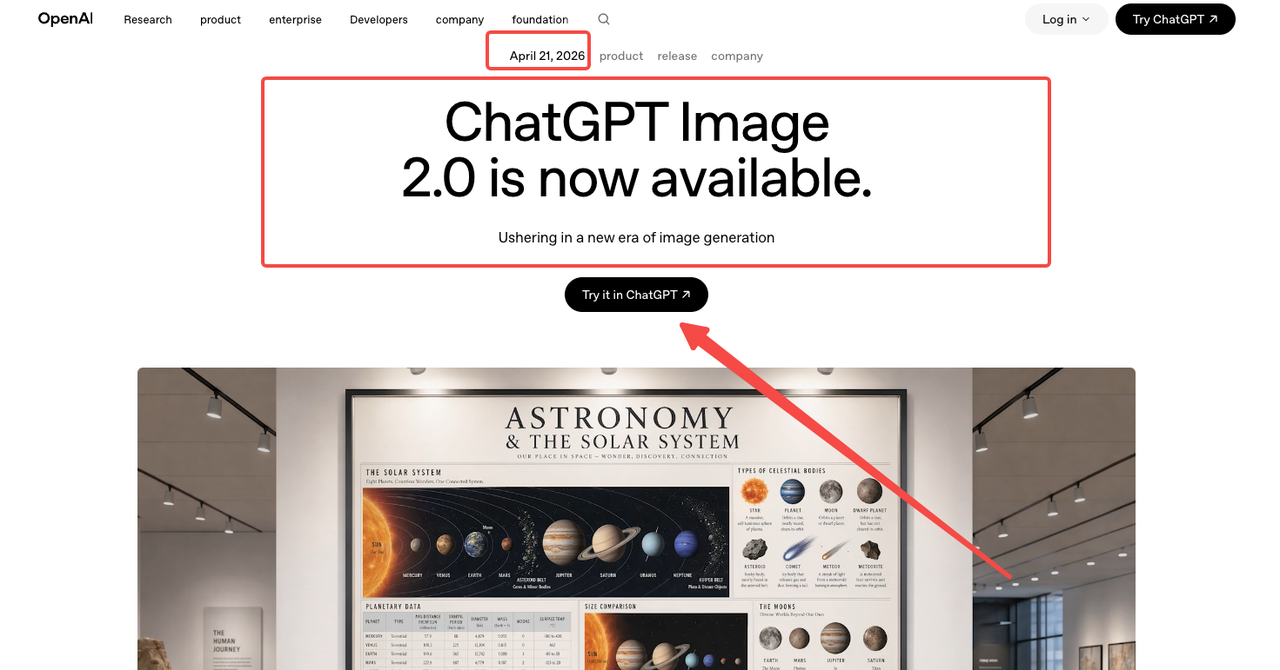

OpenAI запустил gpt-image-2 21 апреля 2026 года, одновременно с ребрендингом пользовательского интерфейса в «ChatGPT Images 2.0». Идентификатор модели — gpt-image-2, текущий снимок закреплён как gpt-image-2-2026-04-21 согласно официальной странице модели GPT Image 2. Модель работает через v1/images/generations, v1/images/edits, v1/responses и v1/chat/completions.

Это проверенная поверхность. Любые заявления о более раннем доступе к API были либо A/B-тестовым трафиком внутри ChatGPT, либо домыслами. Используйте идентификатор снимка в производственном коде — псевдоним будет обновлён, когда OpenAI опубликует новую версию, а это не то поведение, которое вы хотите изменить прямо в середине батч-задачи.

Это проверенная поверхность. Любые заявления о более раннем доступе к API были либо A/B-тестовым трафиком внутри ChatGPT, либо домыслами. Используйте идентификатор снимка в производственном коде — псевдоним будет обновлён, когда OpenAI опубликует новую версию, а это не то поведение, которое вы хотите изменить прямо в середине батч-задачи.

Что изменилось по сравнению с более ранними моделями GPT Image

Для разработчиков важны два момента. Во-первых, gpt-image-2 — это первая модель генерации изображений OpenAI со встроенным рассуждением — то, что они называют «режимом мышления», задокументированным в анонсе представления ChatGPT Images 2.0. Перед генерацией модель может планировать компоновку, искать референсы в интернете и проверять результаты. Во-вторых, рендеринг текста улучшился настолько, что макеты со смешанными шрифтами — такие, которые ломали все предыдущие коммерческие модели, — теперь дают пригодные результаты, что подтверждается в записи о GPT Image на Wikipedia, охватывающей линейку моделей.

Я проверила оба аспекта. Режим рассуждения реален. И он медленнее.

Почему GPT Image 2 важен для производственных команд

Поддержка редактирования, гибкие размеры и последствия для рабочих процессов

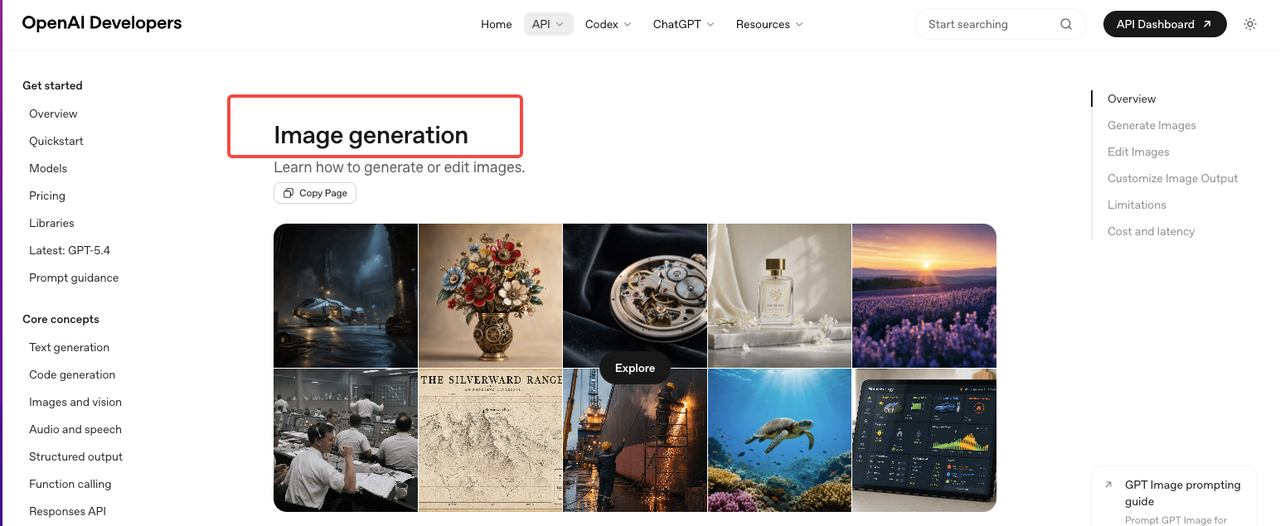

API предоставляет как генерацию, так и редактирование, что означает возможность передать референсное изображение и инструкцию в одном вызове — без отдельного пайплайна для инпейнтинга. В официальном руководстве по генерации изображений рассматриваются размер, качество, формат, сжатие и параметры фона.

Одна деталь, которая меня подвела: прозрачный фон в настоящее время не поддерживается через инструмент генерации изображений Responses. Я обнаружила это на второй день, в середине батча, где предполагала полное соответствие предыдущей модели. Вместо альфа-канала результат вернулся с белой заливкой. Весь батч оказался непригодным для последующего шага композитинга. Если ваш пайплайн зависит от альфа-вывода, проверьте это в своём реальном коде, прежде чем менять модели. Я потеряла час на это плюс кредиты за неудавшийся батч.

Для команд, выполняющих многоэтапные рабочие процессы с ресурсами — генерация, редактирование, доработка, экспорт, — единая поверхность экономит реальные затраты на передачу данных. Не потому что каждый шаг быстрее, а потому что на одну интеграцию меньше для поддержки. Меньше движущихся частей в продакшене означает меньше мест, где что-то может сломаться позже.

Вопросы о качестве, задержке и развёртывании, которые должны задать команды

Скорость «средняя» — по собственной карточке модели OpenAI. На практике режим мышления добавляет заметную задержку — приемлемо для разовых маркетинговых материалов, болезненно для батч-задач. Режим без мышления ближе к уровню gpt-image-1.5.

Решение — не «всегда использовать режим мышления, потому что он умнее». Это «использовать режим мышления, когда важна компоновка, пропускать его, когда важна скорость». Для макета с текстом и пространственными ограничениями дополнительные секунды дают пригодный результат с первой попытки. Для батча вариаций фона нужен более быстрый путь.

У меня недостаточно батчей, чтобы дать точные цифры задержки. Трёх дней недостаточно. Что я могу подтвердить: холодные запросы на Tier 1 быстро ограничиваются. Лимит в 5 изображений в минуту кажется щедрым, пока неудавшиеся повторные попытки и параллельные тестовые прогоны не съедают ту же квоту. Это не проблема модели. Это проблема уровня, и она определяет, готово ли это к продакшену именно для вас.

Что разработчики должны проверить перед интеграцией

Цены, ограничения частоты запросов и неподдерживаемые функции

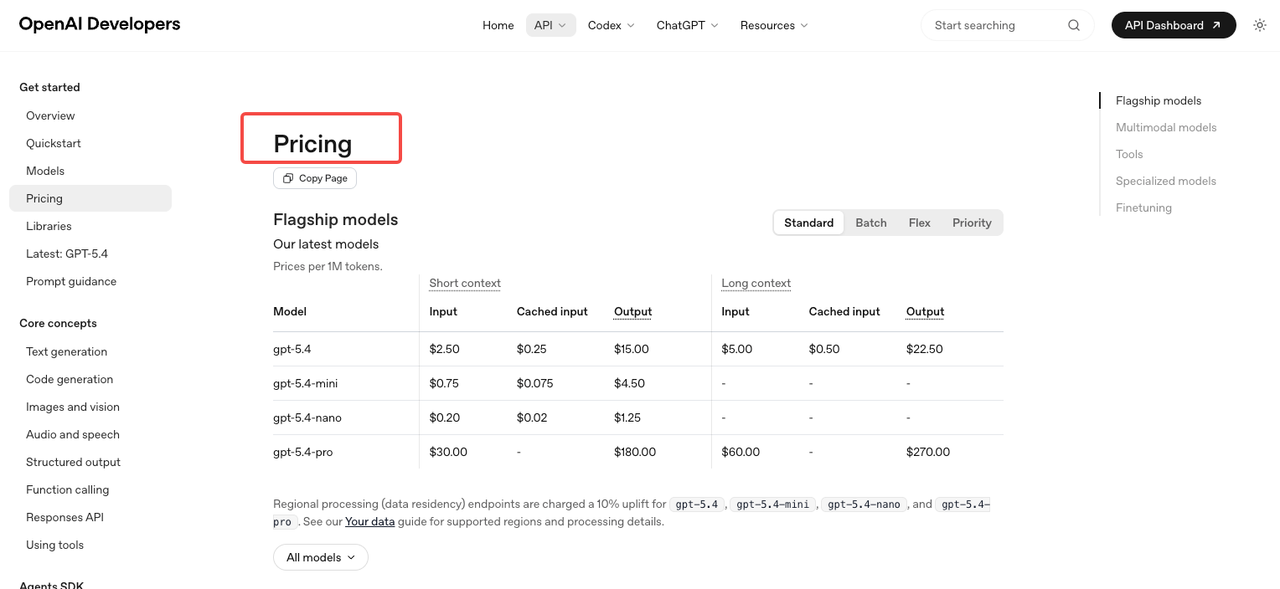

Тарификация на основе токенов согласно странице цен OpenAI: входное изображение — $8 за миллион токенов, кэшированное входное изображение — $2, выходное изображение — $30. Текстовый ввод — $5, кэшированный — $1,25, текстовый вывод — $10. Батч-уровень делит эти цены пополам. Оценки стоимости на изображение, опубликованные в калькуляторе: около $0,006 (низкое качество), $0,053 (среднее) и $0,211 (высокое) для 1024×1024.

Ограничения частоты запросов — вот где команды попадают впросак. Tier 1 ограничен 5 изображениями в минуту. Tier 2 — 20, Tier 3 — 50, Tier 5 — 250, но достижение Tier 5 требует потраченных $1 000 и аккаунта старше 30 дней, как задокументировано в руководстве по ограничениям частоты запросов OpenAI. Если ваш продукт ожидает пиковый трафик, планируйте переход между уровнями до запуска.

Операционные вопросы для производственного использования

Пять вещей, которые я бы проверила в своём рабочем процессе перед интеграцией:

- Нужен ли вашему пайплайну прозрачный фон (в настоящее время не поддерживается через инструмент Responses)

- Каков ваш пиковый показатель изображений в минуту при реалистичной нагрузке

- Выполняете ли вы редактирование с референсными изображениями (они добавляют токены входного изображения — не оценивайте только по выводу)

- Выигрывает ли ваша стратегия промптов от режима рассуждения или достаточно режима без мышления

- Что происходит при сбое генерации — повторяете попытку, переключаетесь на резервный вариант или ставите в очередь

Справочник по REST API генерации изображений документирует формы запросов и ответов. Прочитайте его перед написанием обёртки.

Когда GPT Image 2 хорошо подходит и когда нет

Хорошо подходит: продукты, где текст появляется внутри изображения (макеты UI, инфографика, меню, социальная графика с текстом), локализованные кампании на нелатинских шрифтах, рабочие процессы, которым выгоден единый API как для генерации, так и для редактирования, и команды, уже находящиеся в биллинговых отношениях с OpenAI.

Слабее подходит в данный момент: высокообъёмные батч-пайплайны на аккаунтах Tier 1 или Tier 2, продукты, требующие прозрачного фона через инструмент Responses, приложения с высокой чувствительностью к задержке, где накладные расходы режима мышления имеют значение, и команды, чья существующая модель уже отлажена и где стоимость переключения превышает предельный выигрыш в качестве.

Это не ситуация «используй или отстанешь». Это ситуация «проверь на своих реальных ограничениях». Модель хороша. Подходит ли она вам — зависит от пяти вопросов выше.

Часто задаваемые вопросы

Доступен ли GPT Image 2 в OpenAI API?

Да. Идентификатор модели — gpt-image-2, снимок — gpt-image-2-2026-04-21. Доступен через стандартные эндпоинты генерации изображений, редактирования изображений и Responses. Бесплатный уровень не поддерживается — нужен платный аккаунт, при этом ограничения частоты запросов масштабируются по уровню использования.

Для каких задач с изображениями GPT Image 2 лучше всего подходит?

Всё, что включает текст внутри изображения (меню, макеты, инфографика, многоязычная графика), редактирование на основе референсов и макеты, требующие пространственного рассуждения. Улучшение рендеринга текста — наиболее практически значимое обновление. Для чисто фотореалистичной генерации без текста выигрыш по сравнению с gpt-image-1.5 меньше.

Какие ограничения команды должны проверить в первую очередь?

Три конкретных: прозрачный фон не поддерживается через инструмент генерации изображений Responses, Tier 1 ограничивает генерацию 5 изображениями в минуту, а режим рассуждения добавляет задержку. Также стоит проверить — потоковая передача, вызов функций и структурированные выводы перечислены как неподдерживаемые на странице модели.

Готово ли это к высокообъёмному производственному использованию?

Может быть, но не на новом аккаунте. Достижение Tier 3 (50 изображений/мин) требует потраченных $100 и аккаунта старше 7 дней. Tier 5 (250 изображений/мин) требует $1 000 и 30-дневной истории аккаунта. Если вам нужна высокая параллельность с первого дня, планируйте прогрессию уровней или используйте провайдера с более высокими суммарными лимитами.

Как цены соотносятся с GPT Image 1.5?

gpt-image-2 использует тарификацию по токенам: входное изображение $8/М, выходное изображение $30/М. Оценки стоимости на изображение (1024×1024): около $0,006 низкое качество, $0,053 среднее, $0,211 высокое. Редактирование с референсными изображениями добавляет токены входного изображения, поэтому стоимость выше, чем предполагают оценки только по выводу. Прогоните свою реальную нагрузку через калькулятор, прежде чем предполагать паритет с 1.5.

Заключение

Три дня тестирования недостаточно для вынесения вердикта о долгосрочной надёжности. Но достаточно, чтобы сказать: модель реальна, API стабилен, а вопросы интеграции по большей части операционные, а не технические — ценовые уровни, ограничения частоты запросов, отсутствующие функции, от которых может зависеть ваш рабочий процесс. Проведите небольшой пилот на своих реальных промптах и реальной параллельностью, прежде чем делать выводы. Это всё, что я могу подтвердить отсюда. Остальное вам нужно проверить в вашей собственной среде.

На следующей неделе продолжу с данными о задержке батчей, как только накоплю достаточно данных для доверия им.

Предыдущие посты: