Объяснение замены лиц в видео: как это работает + руководство по API

Как работает замена лиц в видео изнутри — и как вызвать её через API. Охватывает полный конвейер обработки, требования к входным данным и распространённые ошибки.

Привет, меня зовут Дора. Честно признаюсь — когда я впервые попробовала вызвать API для замены лиц в видео, я получила ответ, который выглядел почти правильно. Лицо было на месте. Тайминг сбился на полсекунды. Освещение делало объект съёмки слегка светящимся изнутри, как дешёвое привидение.

В этом и есть суть технологии замены лиц в видео. Снаружи всё кажется простым — замени лицо A на тело B, и готово — но стоит выйти за рамки демо-роликов и попытаться создать что-то настоящее, как понимаешь, сколько движущихся частей на самом деле задействовано под капотом. Понимание этих частей — это разница между полированным результатом и тем, от чего ваши пользователи будут морщиться.

В этом руководстве рассматривается, как на самом деле работает замена лиц в видео, какие подходы существуют, что нужно вашему API перед тем, как он сможет сделать что-то полезное, и как справляться со сбоями, которые рано или поздно вас настигнут.

Что на самом деле делает замена лиц в видео

Позвольте объяснить это чётко, потому что многие руководства пропускают то, что действительно важно.

Замена лиц в видео — это не фильтр. Это не маска, наложенная поверх footage. На достаточно глубоком уровне она обнаруживает лицо в каждом кадре видео, отображает его геометрию, извлекает идентичность исходного лица и накладывает исходную идентичность на лицевую структуру объекта, сохраняя движения, освещение и мимику объекта.

Это три отдельные задачи, решаемые последовательно.

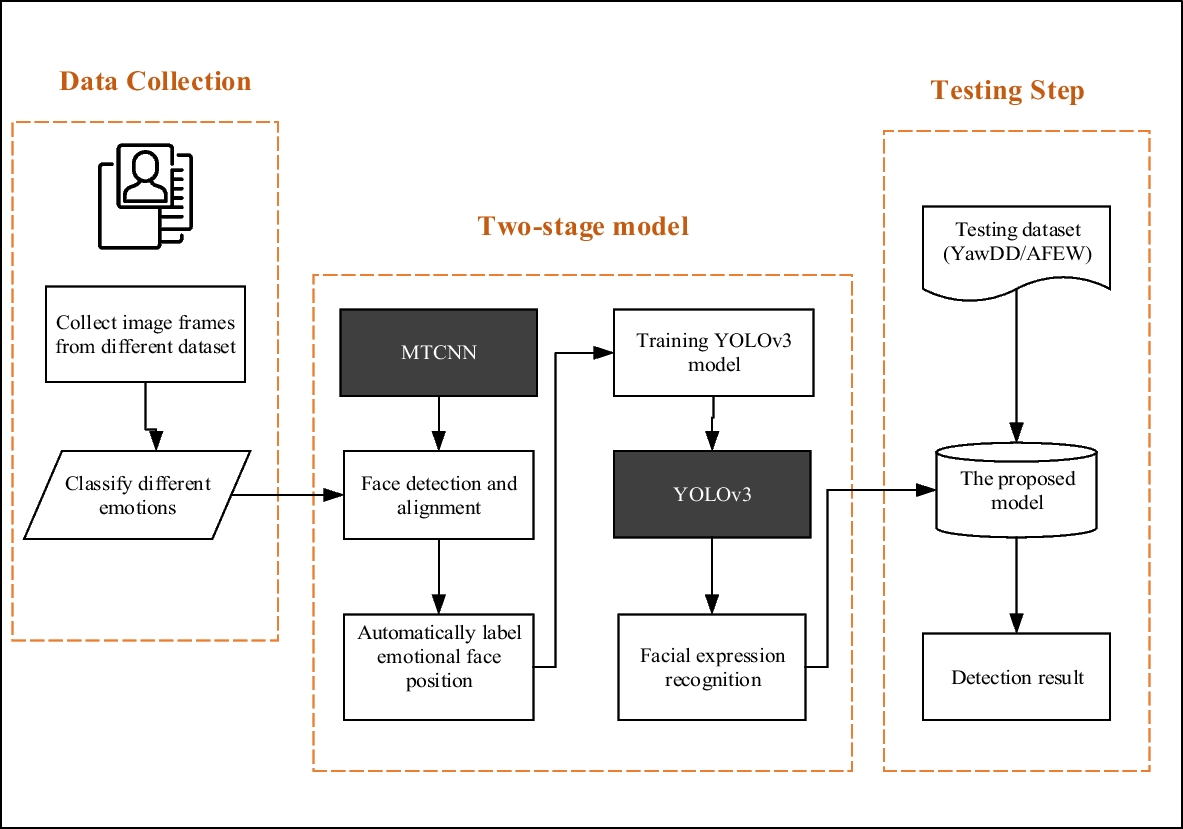

Конвейер: обнаружение → выравнивание → наложение

Обнаружение — это этап, на котором модель находит лица в кадре. Звучит просто. Но это не так. Частично перекрытые лица, повёрнутые под острым углом или быстро движущиеся — всё это создаёт ошибки обнаружения. Большинство производственных систем используют варианты многозадачных каскадных свёрточных сетей — вы можете прочитать о фундаментальном подходе MTCNN в этом руководстве по обнаружению лиц с помощью глубокого обучения — хотя более новые архитектуры значительно улучшили эти ранние показатели.

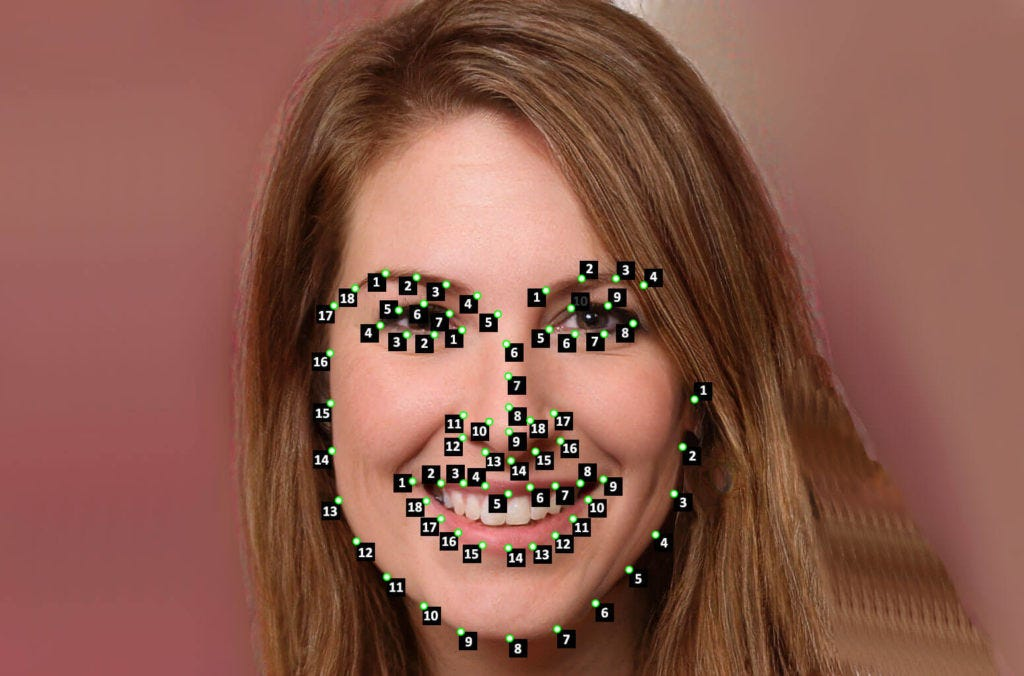

Выравнивание — это шаг, о котором большинство людей не думает, но он по-настоящему критичен. После обнаружения лица модель определяет ориентиры лица — глаза, кончик носа, уголки рта — и использует их для нормализации лица в каноническое положение и масштаб. Без этого замена выглядит так, будто кто-то поместил лицо под немного неправильным углом и надеялся, что никто не заметит. Замечают всегда.

Наложение — это этап, на котором происходит фактический перенос идентичности. Модель берёт идентификационные признаки исходного лица, проецирует их на геометрию целевого лица и компонует результат обратно в кадр. Современные подходы используют для этого генеративно-состязательные сети (GAN) — генератор, создающий наложенное лицо, и дискриминатор, оценивающий реалистичность — поэтому понимание того, как работает генерация дипфейков на основе GAN, действительно полезно перед тем, как вы начнёте отлаживать результат.

Что на самом деле означает качество результата

Вот что меня поначалу вводило в заблуждение: «качество» результата замены лиц — это не одно число. Это как минимум три отдельные вещи.

Сохранение идентичности — действительно ли результат похож на исходное лицо, а не просто на размытое среднее между двумя?

Временная согласованность — выглядит ли лицо одинаково во всех кадрах, или оно слегка мерцает?

Фотореализм — выглядит ли результат органично в сцене, или кажется склеенным?

Вы можете получить отличное сохранение идентичности и ужасную временную согласованность. Можно добиться прекрасного фотореализма при плохом переносе идентичности. Большинство API предоставляют настройки или уровни качества, которые позволяют балансировать между этими параметрами. Знание того, что важно для вашего конкретного случая, сэкономит вам немало времени на разбор полётов.

Типы подходов к замене лиц в видео

Не все модели замены лиц в видео работают одинаково. Аналогичные архитектурные различия существуют и в современных моделях генерации AI-видео, таких как Seedance 2.0, где временная согласованность и моделирование движения обрабатываются очень по-разному в зависимости от подхода. Есть два важных измерения, которые нужно понять, прежде чем выбирать инструмент или API.

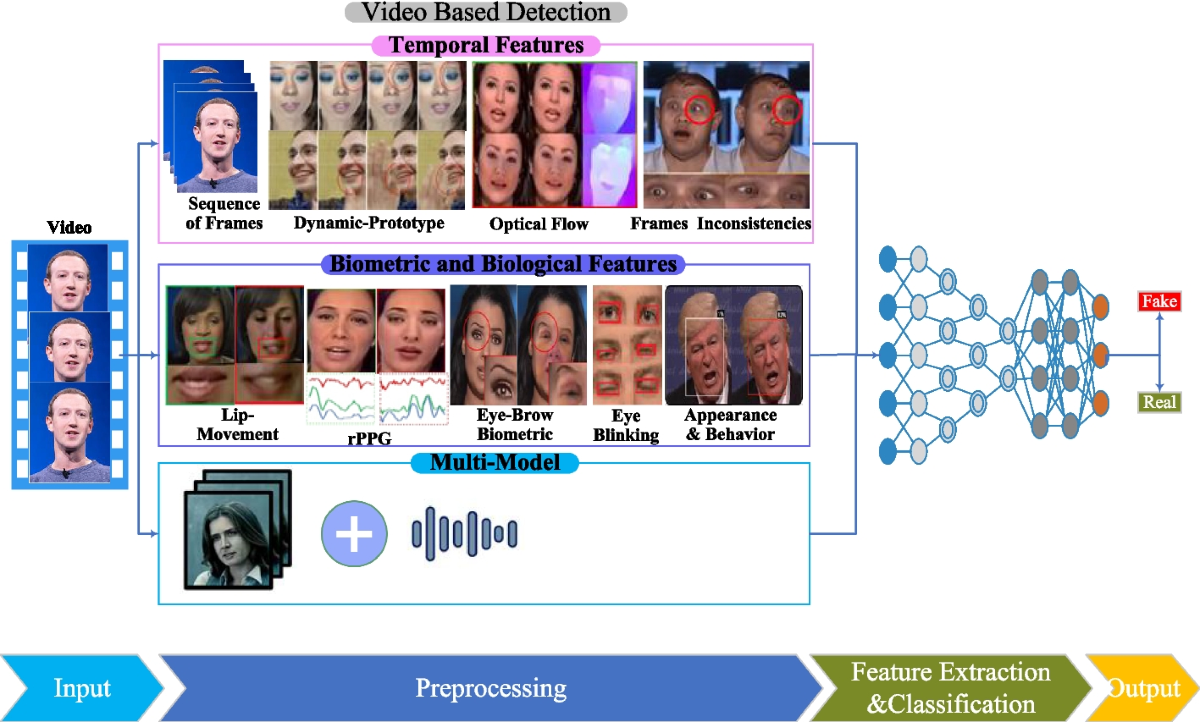

Покадровые модели против моделей с учётом временно́го контекста

Покадровые модели обрабатывают каждый кадр видео независимо. Они, как правило, быстрее и проще в реализации, но не учитывают тот факт, что видео — это последовательность связанных изображений. Результат: едва заметное мерцание между кадрами, особенно по краям лица или в условиях слабого освещения.

Модели с учётом временно́го контекста обрабатывают кадры с учётом предыдущих и последующих — по сути понимая движение и поддерживая согласованность по всему клипу. Аналогичные компромиссы встречаются в сравнениях ведущих AI-видеомоделей, где стабильность и реалистичность движения являются ключевыми отличиями. Результат более плавный и стабильный, но такие модели тяжелее и медленнее. Для любых клипов длиннее нескольких секунд или предназначенных для просмотра на полноэкранном дисплее дополнительная задержка окупается.

Мой честный опыт: если вы создаёте прототип или генерируете миниатюры, покадровая обработка вполне подойдёт. Если вы создаёте что-то, что люди будут смотреть на полноразмерном экране, мерцание вас разочарует.

Одно лицо против нескольких лиц

Модели для одного лица проще и, как правило, обеспечивают более высокое качество для своей конкретной задачи. Если ваш сценарий использования предполагает одно чётко видимое лицо в кадре — что охватывает большинство производственных случаев — это правильная отправная точка.

Модели для нескольких лиц могут обнаруживать и заменять несколько лиц в одном кадре. Они полезны для ансамблевых сцен, групповых съёмок или сценариев, где у вас нет полного контроля над входным видео. Компромисс в том, что они требуют больше вычислительных ресурсов и более склонны к неправильному сопоставлению лиц — то есть модель заменяет не то лицо не на то тело. Стоит помнить об этом, прежде чем отправлять клип с четырьмя людьми и получить обратно что-то непреднамеренно сюрреалистическое.

Перед вызовом API: что вам нужно

Именно здесь большинство людей теряет время. Не потому что API сложен, а потому что требования к входным данным более конкретны, чем обычно даётся понять в документации.

Требования к входным данным (формат, разрешение, длина клипа)

Большинство API для замены лиц в видео ожидают:

- Формат видео: MP4 с кодировкой H.264 — самый безопасный выбор по умолчанию. Некоторые API также принимают WebM или MOV, но H.264/MP4 имеет наиболее универсальную поддержку.

- Разрешение: 720p — практический минимум для приемлемого качества замены. 1080p даёт модели больше деталей лица для работы. Ниже 480p большинство моделей начинают производить видимые артефакты — область лица просто не содержит достаточно пикселей для чистого наложения.

- Длина клипа: Многие API ограничивают синхронную обработку 30–60 секундами. Более длинные клипы требуют асинхронной отправки задания с обратными вызовами через webhook. Знайте, к какой категории относятся ваши клипы, прежде чем проектировать обработку запросов.

- Исходное изображение: Для лица, которое вы подставляете, обычно достаточно одной хорошо освещённой фронтальной фотографии. Некоторые модели также принимают видеоисточники, но чёткое статичное изображение с равномерным освещением, как правило, обеспечивает более стабильный перенос идентичности.

Ограничения по углу лица и освещению

Небольшая проверка реальностью: модели — не магия.

Угол лица: Большинство моделей хорошо работают при отклонении до примерно 30–35 градусов от фронтального ракурса. За этими пределами начинается потеря точности ориентиров, что каскадно приводит к ошибкам выравнивания и артефактам наложения. Профили, как правило, не поддерживаются или дают непригодный результат. Если в ваших исходных материалах объекты часто смотрят в сторону от камеры, умерьте ожидания по качеству.

Освещение: Жёсткое направленное освещение — боковая подсветка лица, сильный верхний свет, создающий глубокие тени под глазами — сложнее обрабатывать на этапе наложения убедительно. Модели необходимо согласовать освещение исходного лица с освещением в целевом кадре, и чем больше они расходятся, тем заметнее шов.

Я не говорю избегать тёмных кадров. Я говорю: если вы создаёте исходные материалы и имеете над ними хоть какой-то контроль, равномерное освещение значительно улучшит результат.

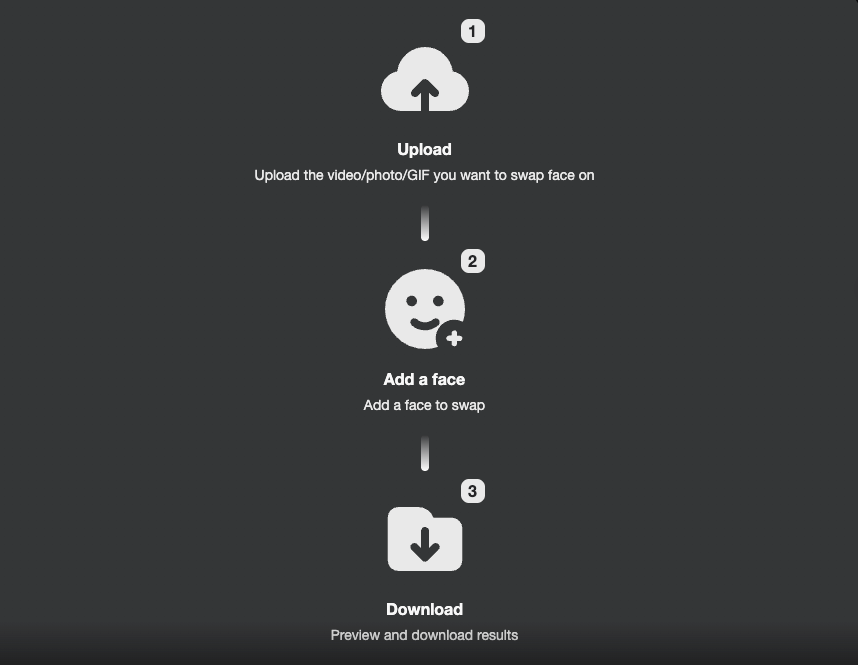

Рабочий процесс API шаг за шагом

Перейдём к практике. Вот типичный поток вызова API для замены лиц в видео.

Аутентификация

Практически каждый производственный API использует аутентификацию на основе Bearer-токена. Вы получите API-ключ при регистрации и передаёте его в заголовке:

Authorization: Bearer YOUR_API_KEYЭто стандартная практика, соответствующая рекомендациям по безопасности из таких ресурсов, как шпаргалка OWASP по безопасности REST. С самого начала стоит сделать несколько вещей:

- Храните API-ключ как переменную окружения, никогда не прописывайте его непосредственно в коде

- Настройте ротацию ключей — большинство API позволяют перегенерировать ключи без потери доступа к аккаунту

- Если доступно, используйте ограниченные ключи, которые имеют только те разрешения, которые действительно нужны вашей интеграции

Отправка запроса

Типичное тело запроса выглядит примерно так:

{

"source_image_url": "https://your-storage.com/source-face.jpg",

"target_video_url": "https://your-storage.com/target-video.mp4",

"output_format": "mp4",

"quality": "high"

}Некоторые API принимают бинарные файлы напрямую через multipart form-data. Другие принимают только URL, указывающие на общедоступные файлы. Внимательно изучите документацию по этому вопросу — это распространённый источник «тихих» ошибок, когда API возвращает 200, но ничего не обрабатывает, потому что URL файла был недоступен.

Для более длинных клипов вы обычно получаете ID задания, а не сразу результат:

{

"job_id": "fswap_a3b92f",

"status": "processing",

"estimated_time_seconds": 45

}Обработка результата

Опрашивайте конечную точку статуса задания или настройте webhook для получения результата по завершении обработки. Ответ будет содержать URL для загрузки обработанного видео. Эти URL, как правило, имеют ограниченный срок действия — загрузите и сохраните результат в собственное хранилище в течение срока действия, который обычно составляет от 1 до 24 часов в зависимости от провайдера.

Не считайте результат идеальным только потому, что статус «завершено». Всегда проверяйте несколько кадров вручную. Статус «завершено» означает, что конвейер отработал без сбоев. Это не означает, что замена выглядит хорошо.

Для производственных систем создание надёжной интеграции REST API вокруг этих асинхронных паттернов — правильная обработка ошибок, логика повторных попыток, верификация webhook — избавит вас от болезненной отладки в будущем.

Распространённые сбои и способы их устранения

Вот где всё становится по-настоящему сложным. Я сталкивалась со всеми тремя.

Артефакты движения

Как выглядит: Заменённое лицо дёргается или «прыгает» между кадрами — проблема, очень похожая на ту, что обсуждается в руководствах по устранению мерцания и дрожания в AI-генерируемом видео.

Почему происходит: Покадровая обработка без временно́го сглаживания. Каждый кадр решается независимо, поэтому небольшие вариации в обнаружении ориентиров создают несогласованность.

Решение: Переключитесь на модель с учётом временно́го контекста, если это возможно. Если вы ограничены покадровым API, некоторые провайдеры предлагают проход постобработки для стабилизации — поищите это в настройках. В качестве альтернативы предварительная стабилизация входного видео перед отправкой в API может помочь.

Дрейф идентичности

Как выглядит: Лицо в результате постепенно становится всё менее похожим на исходное и всё больше напоминает смешение исходного и целевого — или просто какое-то среднестатистическое лицо.

Почему происходит: Обычно это проблема качества исходного изображения. Если исходная фотография лица низкого разрешения, плохо освещена или снята не в фронтальный ракурс, модель не может извлечь надёжные идентификационные признаки. Она заполняет пробелы тем, что может вывести, что нередко уводит в сторону целевого лица.

Решение: Используйте исходное изображение более высокого качества. Фронтальный ракурс, равномерное освещение, не менее 512×512 пикселей в области лица. По моему опыту, одно это изменение устраняет дрейф идентичности примерно в 80% случаев.

Несоответствие освещения

Как выглядит: Заменённое лицо выглядит «вклеенным» — направление света или цветовая температура лица не совпадает с окружающей сценой.

Почему происходит: Модель наложения пытается гармонизировать освещение, но её возможности ограничены. Большие различия между освещением в исходном изображении и целевом видео создают трудности на этапе компоновки.

Решения:

- Если у вас есть контроль над исходным изображением, снимайте его в условиях освещения, схожих с условиями целевых материалов

- Некоторые API предлагают явную нормализацию освещения как параметр — включайте её

- При серьёзных несоответствиях постобработка результата с помощью цветокоррекции может помочь органично вписать лицо в сцену

Итак, каков итог?

Замена лиц в видео — поистине мощная технология, когда вы понимаете, что ей нужно для успешной работы. Большинство проблем с качеством не являются загадочными — они восходят к качеству входных данных, выбору модели под конкретный случай использования и реалистичным ожиданиям относительно того, что конвейер может и не может сделать. Правильно справьтесь с этим, и вы потратите значительно меньше времени на отладку результатов, которые выглядели хорошо на демо, но разваливались в production.