Лучшие инструменты для замены лиц в видео с помощью ИИ (2026)

Мы протестировали ведущие инструменты на основе ИИ для замены лиц в видео в 2026 году. Вот что действительно работает, что не справляется и как выбрать инструмент исходя из ваших реальных требований.

Привет, я Дора. Вот что я постоянно замечаю: почти в каждом обзоре «лучших AI-инструментов для замены лиц в видео» тестируется один и тот же демо-ролик в идеальных условиях, после чего объявляется победитель. Но в реальности никто так не работает.

Последние несколько недель я гоняла реальные тестовые видео через список отобранных инструментов, многие из которых построены на основе или вдохновлены современными моделями генерации видео, такими как Seedance 2.0 — с разным освещением, разным уровнем движения, разной длиной клипов. То, что я обнаружила, не всегда совпадало с тем, что обещает маркетинг. Некоторые инструменты, выглядящие потрясающе в превью, разваливаются при экспорте. Некоторые, работающие медленно в браузере, дают наиболее стабильный по времени результат. А несколько редко упоминаемых инструментов оказываются самым надёжным выбором для разработчиков, которым нужно предсказуемое поведение API.

Это руководство охватывает методологию оценки, реальное сравнение и то, какой инструмент подходит для каких задач. Без аффилированных рейтингов. Без уклончивого «все они хороши!».

Как мы оценивали эти инструменты

Использованные тестовые клипы

Я прогнала три категории исходных видео через каждый инструмент:

Тип клипа A — Контролируемое освещение, минимальное движение: Видео «говорящей головы», снятое при равномерном рассеянном свете. Субъекты смотрят в камеру, минимальные движения головы. Это тест «лёгкого режима» — любой мало-мальски приличный инструмент должен справиться приемлемо.

Тип клипа B — Смешанное освещение, умеренное движение: Видео с рук, сочетание естественного оконного и накладного света. Субъекты движутся естественно — кивают, слегка поворачиваются. Здесь начинают проявляться проблемы с временно́й согласованностью.

Тип клипа C — Динамичное движение, жёсткое или направленное освещение: Быстрые повороты головы, активная мимика, боковое или контровое освещение. Здесь большинство инструментов начинают давать сбои — и здесь проявляются настоящие различия.

Длина клипов — от 8 до 45 секунд. Исходное лицо: один хорошо освещённый фронтальный портрет с разрешением лица 1080 пикселей.

Критерии оценки

Каждый инструмент оценивался по четырём параметрам:

| Параметр | Что измерялось |

|---|---|

| Реализм | Сохранение идентичности, соответствие тона кожи, качество смешивания краёв |

| Временна́я согласованность | Стабильность между кадрами, мерцание, смещение при движении |

| Скорость | Время от отправки до загружаемого результата |

| Эффективность по стоимости | Цена за минуту обработанного видео, щедрость бесплатного уровня |

Ни один параметр не побеждает по умолчанию — это реальность, которая проявляется и в сравнениях ведущих моделей генерации видео, где скорость, реализм и стабильность часто обменивают одно на другое. Инструмент, рендерящий за 20 секунд, но дающий мерцающий результат, не является «быстрым» ни в каком значимом смысле.

Стоит уделить момент пониманию того, почему временна́я стабильность в видео так сложна — всё сводится к задаче сохранения единой идентичности в последовательных кадрах, что исследование GAN-синтеза видео на arXiv подробно разбирает, если вам нужно техническое обоснование.

Дата тестирования и снимок цен

Всё тестирование проводилось в феврале–марте 2026 года. Цены отражают актуальные опубликованные тарифы на момент тестирования — они часто меняются, поэтому проверяйте перед принятием решений.

Лучшие инструменты для замены лиц в видео с помощью ИИ

Лучшее качество вывода в целом: DeepSwap

По чистому реализму результата во всех трёх типах клипов DeepSwap неизменно давал наиболее убедительные результаты. Сохранение идентичности оставалось высоким даже на клипах типа C (динамичное движение, жёсткое освещение), где большинство конкурентов показывали заметное смещение после 15-секундной отметки.

Что выделилось: многомоторный подход. DeepSwap запускает несколько ИИ-моделей одновременно и возвращает несколько версий вывода для сравнения. Для сложных замен — нестандартные углы исходного лица, сильное направленное освещение — это имеет огромное значение. Один движок лучше справляется с глубокими тенями; другой точнее сохраняет тонкие детали лица — текстуру и асимметрию.

Компромисс — сложность и скорость. DeepSwap — не опыт «в один клик». И для простых замен «говорящих голов» дополнительное время обработки не всегда оправдывает разницу в качестве по сравнению с более простыми инструментами.

Лучше всего подходит для: Продакшн-работы, маркетинговых материалов, всего, где вывод будет просматриваться вблизи на больших экранах.

Цены: На основе кредитов, по мере использования. Нет постоянного бесплатного уровня.

Лучший для интеграции через API разработчиками: Magic Hour

Если вы что-то создаёте, а не просто генерируете контент, Magic Hour — самый дружелюбный к разработчику вариант из всех, что я тестировала. API хорошо задокументирован, возвращает предсказуемые структурированные ответы и чисто обрабатывает асинхронное управление задачами — что очень важно при интеграции замены лиц в более крупный пайплайн.

Базовые модели тоже крепкие. Временна́я согласованность на клипах типа B (умеренное движение) была одной из лучших, что я видела, а качество вывода на клипах «говорящей головы» было по-настоящему впечатляющим. Это также один из немногих инструментов, который объединяет замену лиц, синхронизацию губ и генерацию видео из изображений в единой поверхности API — полезно, если ваш сценарий использования предполагает больше, чем просто замену лица.

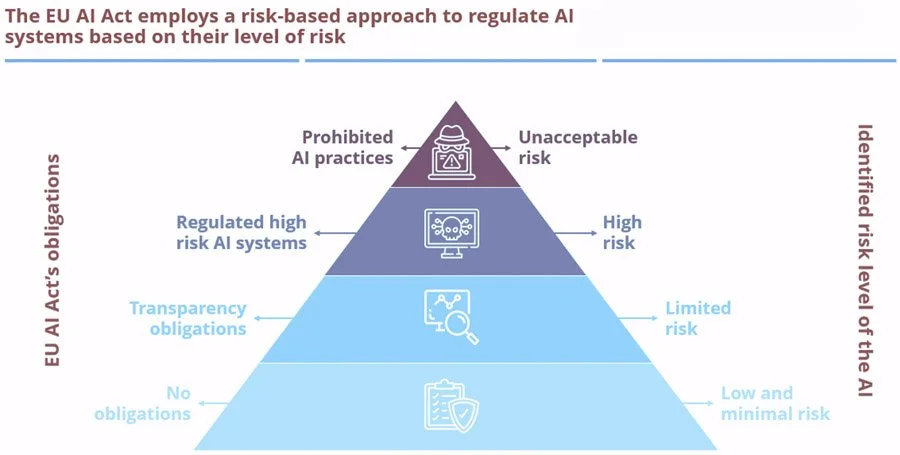

Стоит отметить, что регуляторная среда вокруг синтетических медиа ужесточается. Согласно статье 50 Закона ЕС об ИИ, провайдеры ИИ-систем, генерирующих синтетический аудио-, фото- или видеоконтент, должны обеспечить маркировку вывода в машиночитаемом формате и его определяемость как искусственно созданного или изменённого. Magic Hour по умолчанию включает водяной знак на контент, что упрощает соответствие требованиям, если вы создаёте продукты для регулируемых рынков. Для более широкого обзора того, что эти обязательства означают на практике, резюме Европейского парламента по Закону ЕС об ИИ стоит прочитать перед выпуском чего-либо, ориентированного на потребителей.

Лучше всего подходит для: Разработчиков, создающих приложения, рабочих процессов пакетной автоматизации, команд, которым нужна надёжность API со временем.

Цены: Уровни подписки с доступом к API. Доступна бесплатная пробная версия.

Лучший для клипов с несколькими лицами: Reface

Замена нескольких лиц по-настоящему сложнее, чем одного. Модель должна обнаружить, назначить и независимо обработать несколько лиц на каждом кадре — и если назначение лиц пойдёт не так, результат будет визуально хаотичным, что трудно объяснить клиенту.

Reface справляется со сценариями с несколькими лицами надёжнее, чем что-либо другое из протестированного. Назначение лиц оставалось корректным в клипах с двумя-тремя субъектами, даже когда лица кратковременно перекрывались в кадре. Вывод не получит наград за фотореализм, но он согласован — а для группового контента, предназначенного для социальных сетей, согласованность важнее совершенства.

Архитектура GAN, лежащая в основе большинства современных инструментов замены лиц — где генераторная сеть и сеть-дискриминатор итеративно соревнуются для улучшения реализма — принципиально одинакова на большинстве платформ. Что отличает производительность при работе с несколькими лицами — обычно то, как инструмент обрабатывает обнаружение и отслеживание лиц до генеративного шага, а не сама генеративная модель.

Лучше всего подходит для: Групповых клипов, ансамблевых съёмок, контента для социальных сетей с несколькими субъектами.

Цены: Подписка от $3,99/месяц. Бесплатный уровень с водяным знаком.

Лучший бесплатный вариант: FaceFusion

FaceFusion — с открытым исходным кодом, работает локально и даёт качество вывода, которому нечего делать среди бесплатных. Это не веб-приложение — установка требует технического терпения — но после запуска вы получаете полный контроль над параметрами модели, без водяных знаков и без оплаты за кредиты.

Для заботящихся о конфиденциальности пользователей локальная архитектура означает, что исходные изображения и видео никогда не покидают вашу машину. Это реальное преимущество для тех, кто работает с материалами с идентифицируемыми людьми, особенно по мере того, как политики хранения данных в облачных инструментах становятся более пристально scrutinized.

Подвох: он не ведёт за руку. Сообщения об ошибках лаконичны. Параметры обработки требуют ручной настройки. И в отличие от облачных инструментов, он не масштабируется горизонтально, если вам нужно параллельно обрабатывать много клипов.

Лучше всего подходит для: Разработчиков-экспериментаторов, пользователей, заботящихся о конфиденциальности, тех, кто готов обменять сложность настройки на нулевые текущие расходы.

Цены: Бесплатно и с открытым исходным кодом.

Таблица сравнения

| Инструмент | Реализм | Временна́я согласованность | Несколько лиц | Доступ к API | Начальная цена |

|---|---|---|---|---|---|

| DeepSwap | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ | Ограниченный | По мере использования |

| Magic Hour | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ✅ | ✅ Полный | Подписка |

| Reface | ⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ Надёжный | ❌ | $3,99/мес |

| FaceFusion | ⭐⭐⭐⭐ | ⭐⭐⭐ | ✅ | Самостоятельный хостинг | Бесплатно |

Оценки отражают тестирование на клипах типа B (смешанное освещение, умеренное движение). Результаты варьируются в зависимости от типа клипа.

Что упускает большинство обзоров

Разрыв между качеством превью и качеством экспорта

Это первое, что застало меня врасплох. Несколько инструментов показывают высококачественный превью в браузере, который выглядит по-настоящему впечатляюще. Экспортированный файл — в том разрешении и битрейте, которые вам действительно нужны — выглядит заметно иначе.

Разрыв обычно проявляется двумя способами: артефакты сжатия по линии волос и краям лица, а также размытость финального вывода, невидимая в превью. Всегда скачивайте и изучайте экспорт в полном разрешении перед принятием решения об инструменте на основе превью. То, что вы видите в браузерном плеере при 720p, — не то, что увидит ваша аудитория.

Почему скорость рендеринга сама по себе не предсказывает реализм

Я неоднократно встречала это утверждение: «обрабатывает менее чем за 10 секунд». Это либо очень короткий клип, либо очень низкое разрешение вывода, либо очень быстрый путь к посредственному качеству.

Временна́я согласованность — то, что делает замену лиц в видео реалистичной во времени — тесно связана с проблемами, обсуждаемыми в руководствах по тому, как создатели исправляют мерцание и дрожание в видео, сгенерированном ИИ. Не только в одном кадре — это требует понимания движения между кадрами. Технический обзор IBM о том, как работают GAN, объясняет, почему этот итеративный процесс требует вычислительных усилий: генераторная сеть и сеть-дискриминатор эффективно соревнуются через множество циклов для получения реалистичного вывода. Инструменты, дающие результаты в секундах для длинных клипов, почти всегда жертвуют этим временным рассуждением. Скорость — это сигнал, а не функция. Быстрая обработка видео длиннее 15 секунд обычно означает, что что-то было пропущено.

Рекомендации по сценарию использования

Casual-создатели

Выбирайте Reface. Он быстрый, удобный для мобильных устройств, хорошо справляется с групповыми клипами, а бесплатный уровень действительно пригоден для коротких клипов. Вы не получите реализм производственного уровня, но получите контент для публикации менее чем за минуту с минимальными трудностями при настройке.

Разработчикам, которым нужен воспроизводимый вывод API

Magic Hour. Документация API чистая, асинхронная обработка надёжная, а вывод достаточно согласованный для создания пользовательских продуктов. Если ваша интеграция затрагивает регулируемые рынки, встроенная маркировка водяными знаками также упрощает соответствие требованиям в рамках таких регуляций, как требования прозрачности статьи 50 Закона ЕС об ИИ.

Пользователям, которым нужна поддержка нескольких лиц

Reface для контента в социальных сетях, DeepSwap для продакшн-работы. Если вы делаете быстрые групповые клипы для социальных сетей, скорость Reface и надёжное назначение лиц побеждают. Если вы делаете работу с несколькими лицами для маркетинга или профессионального видео, где качество имеет значение, многомоторный подход DeepSwap даёт более чистые результаты, особенно когда лица не все фронтально освещены и смотрят вперёд.

Так что же на самом деле является лучшим инструментом для замены лиц в видео с ИИ в 2026 году? Это зависит от того, что вы подразумеваете под «лучшим».

Лучший реализм в сложных условиях: DeepSwap. Лучший API для создания продуктов: Magic Hour. Лучший для групп: Reface. Лучший бесплатный: FaceFusion. Любой обзор, выбирающий одного победителя для всех, оптимизирует простоту, а не точность.

Тестируйте свои реальные клипы. Инструмент, который выглядит лучше на чужих материалах, не обязательно сработает на ваших.