SeedVR2 Online: Como Usar

Aprenda como o SeedVR2 online funciona, quais fluxos de trabalho ele suporta e o que esperar antes de usá-lo para tarefas de upscaling.

Olá, sou a Dora. Alguém mencionou o SeedVR2 numa thread do Discord que eu estava acompanhando. Disseram que tinham “usado online”. Então fui pesquisar. E imediatamente me deparei com uma parede de demos do Gradio, wrappers de terceiros, playgrounds de API e pelo menos um site de aparência suspeita que definitivamente não tinha nada a ver com a equipe de pesquisa da ByteDance.

O que ninguém diz logo de cara: não existe um único produto “SeedVR2 Online”. Essa frase significa pelo menos três coisas diferentes dependendo de onde você chega. E se você não sabe qual delas está realmente usando, seus resultados — e suas expectativas — estarão errados.

Deixa eu desembaraçar isso.

O Que “SeedVR2 Online” Geralmente Significa

SeedVR2 é um modelo de restauração de vídeo desenvolvido pela equipe ByteDance Seed. Foi aceito no ICLR 2026 e o código de pesquisa está disponível publicamente. É um Diffusion Transformer de um único passo projetado para restauração genérica de vídeo, capaz de lidar com entradas de alta resolução por meio de um mecanismo de atenção de janela adaptativa. Isso é a coisa em si.

Mas “SeedVR2 online” como frase de busca traz algo diferente do modelo em si. Uma confusão semelhante acontece com modelos mais recentes de geração de vídeo com IA como o Seedance 2.0, onde as pessoas frequentemente buscam uma “versão online” em vez do modelo subjacente. Aparece pontos de acesso ao modelo. E eles não são a mesma coisa.

Demo Hospedada, Wrapper ou Serviço de Workflow

Quando alguém diz que usou o SeedVR2 online, provavelmente quer dizer uma destas opções:

Uma demo Gradio hospedada. A ByteDance publicou uma demo oficial no Hugging Face Spaces. Ela roda o modelo SeedVR2-3B e suporta entradas de imagem e vídeo através de uma interface estilo API. Isso é a coisa mais próxima de uma versão “oficial” online — mas é uma demo de pesquisa, não um produto. Os tempos de fila podem ser longos. A disponibilidade não é garantida.

Um wrapper de terceiros. Desenvolvedores criaram nós para ComfyUI, implantações no Replicate e ferramentas independentes em torno do mesmo modelo subjacente. Esses rodam na infraestrutura de outra pessoa, às vezes gratuitamente, às vezes com créditos ou paywalls. Podem parecer polidos. Não são produtos da ByteDance.

Uma integração de plataforma. Algumas plataformas de geração com IA adicionaram o SeedVR2 como uma opção em seu catálogo de modelos. Você está rodando os mesmos pesos do modelo, mas através da interface e sistema de cobrança de outra pessoa.

Por Que os Usuários se Confundem Sobre o Que É “Oficial”

A confusão é compreensível. Uma incerteza semelhante aparece quando as pessoas leem comparações entre modelos modernos de vídeo com IA e assumem que cada um tem uma única interface oficial. O modelo é open-source sob a licença Apache 2.0. Isso significa que qualquer pessoa pode hospedá-lo, envolve-lo e chamá-lo de SeedVR2. Não há portão de marca registrada ou processo de certificação.

Então quando você pesquisa “SeedVR2 online”, você pode chegar em:

- O verdadeiro Hugging Face Space mantido pela ByteDance-Seed

- Uma implantação ComfyUI da comunidade

- Um serviço de upscaling de vídeo de terceiros que por acaso usa SeedVR2 como motor

- Algo que tem SeedVR2 no nome mas não tem relação

Antes de fazer upload de footage, vale a pena gastar 30 segundos verificando em qual você realmente está.

Quando o SeedVR2 Online Vale a Pena Tentar

Vou ser direta. O acesso online ao SeedVR2 faz sentido em situações específicas. Fora delas, pode frustrar mais do que ajudar.

Testes Rápidos

Se você viu exemplos de output e quer saber se o estilo do modelo se encaixa no seu footage — tente online primeiro. Você não precisa instalar nada. Você não precisa de uma GPU. Você pode fazer upload de um clipe curto e ver o que volta.

Isso é genuinamente útil. Testei a demo do Hugging Face em um trecho curto de footage degradado que eu queria limpar há um tempo. O tempo de retorno foi lento, mas o resultado me disse tudo que eu precisava saber antes de me comprometer com uma configuração local.

Sem Necessidade de Configuração Local

Rodar o SeedVR2 localmente requer hardware sério. A documentação oficial observa que uma GPU H100-80GB pode lidar com vídeos 720p de até 100 quadros, e quatro GPUs H100-80GB são necessárias para resolução 1080p ou 2K. A maioria das pessoas não tem isso. O acesso online preenche essa lacuna — ao custo de flexibilidade, velocidade e controle.

Se você é um criador que precisa de limpeza ocasional de vídeo sem construir um pipeline local, as opções online são razoáveis de explorar.

Como Usar o SeedVR2 Online

Noções Básicas de Entrada e Saída

A maioria dos pontos de acesso online segue o mesmo padrão geral:

- Faça upload do seu vídeo de origem (geralmente MP4, às vezes quadros)

- Defina uma resolução alvo ou multiplicador de upscale

- Envie e aguarde

O output é uma versão restaurada do seu clipe — mais nítida, com ruído e artefatos de compressão reduzidos, escalada para a sua resolução alvo.

O que você provavelmente não vai controlar online: tamanho do batch, tamanho da janela de atenção, variante do modelo (3B vs 7B) ou opções de pós-processamento como correção de cor wavelet. Essas configurações existem nas ferramentas locais.

Configurações a Prestar Atenção

Se a interface te oferecer opções, algumas valem a pena entender:

Resolução alvo. O modelo é projetado para output de alta resolução. Não insira uma resolução menor que a sua fonte — você terá processamento desnecessário sem ganho visual.

Modo de correção de cor. Alguns wrappers expõem isso. A implementação do ComfyUI oferece várias opções de correspondência de cores, incluindo um modo “lab” descrito como correspondência de cor perceptual completa para maior fidelidade ao original, e um modo “wavelet” para cores naturais baseadas em frequência. Se você ver essas opções, “wavelet” geralmente é a escolha mais segura para footage desconhecido.

Duração do clipe. Mantenha seus clipes de teste curtos — menos de 30 segundos se possível. Clipes longos deixam a fila mais lenta para todos e são mais difíceis de solucionar se algo parecer errado.

O Que Você Pode e Não Pode Esperar Dele

Limites de Desempenho

Ferramentas online têm limitações. Especialmente as gratuitas. Se você está em uma demo compartilhada hospedada em computação limitada, espere:

- Filas nos horários de pico

- Tempos de processamento de vários minutos mesmo para clipes curtos

- Timeouts ocasionais ou tarefas perdidas

Esse é um problema de fila e infraestrutura, não um problema do modelo.

Expectativas de Qualidade

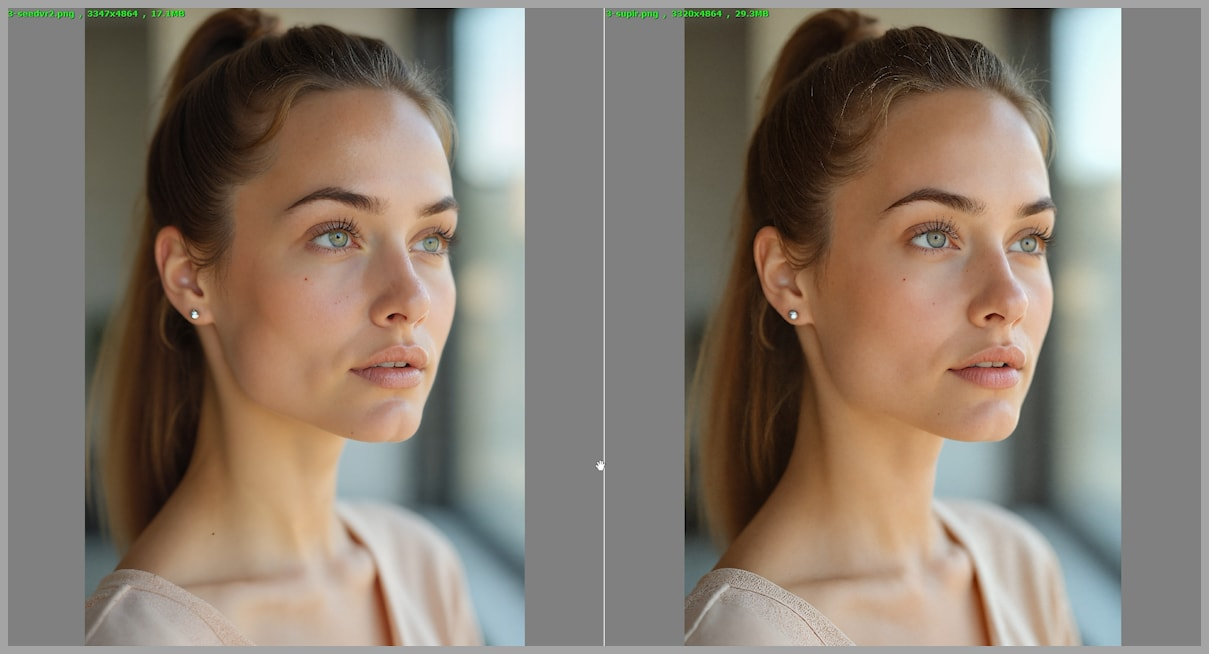

O modelo em si é capaz. O próprio card de modelo da ByteDance-Seed observa que às vezes pode gerar detalhes em excesso em entradas com degradações muito leves — por exemplo, vídeos AIGC em 720p — levando a resultados excessivamente nítidos ocasionalmente. Artefatos de movimento também podem aparecer em pipelines de vídeo generativo, por isso muitos criadores aprendem como corrigir flicker e jitter em vídeos gerados por IA ao trabalhar com modelos de restauração. Essa é uma limitação real que vale conhecer antes de processar qualquer coisa que você se importe.

Para footage com degradação genuína — ruído, desfoque, artefatos de compressão — os resultados costumam ser notavelmente melhores. Para footage já limpo, o modelo pode realmente tornar as coisas menos naturais.

Por Que o Uso Online Não É o Mesmo Que o Uso em Workflow Completo

A diferença é significativa. Implantações locais via ComfyUI, por exemplo, permitem controlar o tamanho do batch, alternar entre as variantes de modelo 3B e 7B, habilitar quantização GGUF para menor uso de VRAM e encadear o SeedVR2 com outros nós em um pipeline. Esse nível de controle não existe na maioria das interfaces online.

Se você está construindo um processo repetível — digamos, processar footage de uma gravação regular — o acesso online atingirá seu limite rapidamente.

SeedVR2 Online vs API vs Configuração de Workflow

| Categoria | Demo Online | API / Plataforma | Workflow Local |

|---|---|---|---|

| Configuração necessária | Nenhuma | Mínima | Significativa |

| Velocidade | Lenta (compartilhada) | Média | Rápida (sua GPU) |

| Controle | Baixo | Médio | Alto |

| Custo | Gratuito / Créditos | Por uso | Custo de hardware |

| Confiabilidade | Variável | Mais estável | Estável |

| Processamento em lote | Não | Às vezes | Sim |

Melhor para Uso Rápido

Demos online e plataformas hospedadas fazem sentido para testes pontuais, comparações rápidas e situações onde você não tem acesso a uma máquina local capaz. O SeedVR2-3B Hugging Face Space hospedado pela ByteDance-Seed é a coisa mais próxima de um ponto de contato oficial se você quiser experimentar o modelo sem se comprometer com nada.

Melhor para Uso em Produção Repetível

Se você processa footage regularmente, o nó ComfyUI-SeedVR2_VideoUpscaler é a ferramenta que a maioria dos criadores adotou. É construído pela comunidade, mas ativamente mantido, com suporte a quantização GGUF que o torna acessível em GPUs de consumidor. Como referência, os pesos oficiais do modelo e detalhes da arquitetura estão documentados no repositório ByteDance-Seed/SeedVR no GitHub.

Veredicto Pessoal

Já rodei o SeedVR2 tanto através da demo do Hugging Face quanto localmente via ComfyUI. Não são a mesma experiência.

A demo online é útil para exatamente uma coisa: decidir se o SeedVR2 vale o seu tempo. Ela respondeu essa pergunta para mim em uma sessão. Mas eu não a usaria para nada que eu precisasse realmente entregar.

Quem Deve Experimentar

Você, se:

- Quer testar se o modelo é adequado para o seu footage antes de instalar qualquer coisa

- Restaura um clipe ocasionalmente e não precisa de um pipeline repetível

- Não tem recursos de GPU local e está bem com um retorno mais lento

Quem Deve Pular

Você, se:

- Está processando mais do que alguns clipes por semana

- Precisa de resultados consistentes que você possa reproduzir

- Se importa em controlar nitidez do output, correspondência de cores ou tamanho do modelo

Para qualquer pessoa seriamente interessada em onde esse modelo se situa no panorama de pesquisa, o artigo original do SeedVR2 no arXiv (2506.05301) vale a leitura — é mais acessível do que a maioria dos artigos acadêmicos e explica claramente a abordagem de restauração em um único passo.

A frase “SeedVR2 online” provavelmente continuará confundindo pessoas por um tempo. Não há um único produto para apontar. Há um modelo, algumas demos oficiais e um número crescente de ferramentas da comunidade construídas em torno dele. Isso não é uma coisa ruim — significa apenas que você precisa saber por qual porta está realmente entrando antes de decidir se vale o seu tempo. Até mais, queridos~