O Que É o Qwen3.5-Omni: Capacidades, Variantes e Acesso à API

O Qwen3.5-Omni acaba de ser lançado com as variantes Plus, Flash e Light. Veja o que os desenvolvedores precisam saber sobre capacidades, acesso à API e uso em produção.

Olá a todos! Aqui é a Dora de volta novamente! Estava no meio da edição de um projeto de vídeo quando a notificação chegou: Qwen3.5-Omni acabou de ser lançado. Tenho usado a família Qwen3-Omni em alguns fluxos de trabalho de produção há meses, então soube imediatamente que não era uma atualização menor. Uma janela de contexto de 256K, clonagem de voz, interrupção semântica e 113 idiomas para reconhecimento de fala — tudo em um único modelo. Precisei parar o que estava fazendo.

Se você cria agentes de voz, pipelines de legendagem, ou qualquer coisa que precise lidar com áudio e vídeo humano real juntos, este lançamento é diretamente relevante para você. Deixe-me explicar o que ele realmente faz, o que as três variantes significam na prática e como obter acesso — incluindo o que ainda não está claro até hoje.

O Que o Qwen3.5-Omni Realmente Faz

Texto, Imagem, Áudio e Vídeo em uma Única Chamada de Inferência

Aqui está o que continua sendo subestimado nos anúncios de IA: processamento multimodal nativo e processamento multimodal de pipeline costurado não são a mesma coisa.

Quando um modelo não-omnimodal como o ChatGPT 5.4 recebe um vídeo, ele precisa extrair quadros por meio de um modelo de visão, processar o áudio por algo como o Whisper para transcrição, e aplicar OCR para ler legendas embutidas — três processos separados costurados para aproximar o que um verdadeiro modelo omni faz em uma única passagem. Em condições ideais, com um clipe bem iluminado e áudio limpo, isso levou nove minutos em um teste real.

O Qwen3.5-Omni lida com a mesma entrada em uma única chamada. Você envia o vídeo. Você recebe uma resposta. Sem pipeline intermediário. Sem sobrecarga de conversão de formato. Sem um modelo de áudio que não sabe o que está acontecendo na tela e um modelo de visão que não consegue ouvir nada.

O modelo suporta compreensão de texto, imagem, áudio e áudio-vídeo, com os componentes Thinker e Talker usando uma arquitetura Hybrid-Attention MoE. Essa última parte importa mais do que parece, o que abordarei na seção de arquitetura abaixo.

O Que “Omnimodal” Significa na Prática vs. Pipelines Costurados

A diferença aparece em cenários genuinamente difíceis para sistemas costurados. Pense em: uma gravação de tela onde alguém está codificando e narrando ao mesmo tempo. Ou uma ligação de atendimento ao cliente onde o contexto é metade verbal e metade na tela. Ou um fluxo de trabalho de legendagem para acessibilidade onde o áudio ambiente e a ação visual carregam significado de forma independente.

A equipe Qwen demonstrou o que eles chamam de “Audio-Visual Vibe Coding” — o modelo pode assistir a uma gravação de tela de uma tarefa de codificação e escrever código funcional com base puramente no que vê e ouve, sem necessidade de prompt de texto.

É um nome estranho para uma demo, mas é uma lacuna de capacidade real em comparação com modelos baseados em texto com áudio adicionado por fora. Quando o raciocínio e a percepção acontecem dentro do mesmo modelo ao mesmo tempo, coisas que exigem contexto cross-modal realmente funcionam.

Três Variantes: Plus, Flash e Light

Plus — Líder em Benchmarks, Quando Vale o Custo

O Qwen3.5-Omni-Plus alcançou 215 resultados SOTA em tarefas de compreensão de áudio e áudio-vídeo, raciocínio e interação. É um número expressivo, e os benchmarks da Alibaba tendem a contar de forma agressiva — mas as comparações independentes estão confirmando isso nas categorias que importam.

Em benchmarks padrão, o Qwen3.5-Omni Plus superou o Gemini 3.1 Pro em compreensão geral de áudio, raciocínio e tarefas de tradução, e empatou em compreensão áudio-visual. Na estabilidade de voz multilíngue em 20 idiomas, superou ElevenLabs, GPT-Audio e Minimax.

A clonagem de voz está disponível no Plus e no Flash via API — você envia uma amostra de voz de 10 a 30 segundos, e o modelo a clona para a saída.

Quando vale a pena pagar pelo Plus? Quando a qualidade da saída é o que seus usuários realmente notam. Produtos de agentes de voz onde a naturalidade da voz é um valor central. Transcrição de alto risco onde a precisão em idiomas raros importa. Qualquer coisa onde você esteja comparando diretamente com Gemini ou GPT-Audio e precise vencer em qualidade.

Flash — Trade-offs de Throughput e Latência

O Flash é a recomendação padrão para uso em produção segundo a documentação da API. Os IDs do modelo são qwen3.5-omni-flash para a variante padrão, e o Flash é descrito como o padrão ao equilibrar latência, qualidade e resposta para a maioria dos cenários de produção.

Para criadores que constroem fluxos de trabalho assistidos por IA — pipelines de legendagem automática, transcrição de entrevistas em tempo real, sumarização de vídeo em escala — o Flash é quase certamente seu ponto de partida. Você faz testes em lote comparando com o Plus para ver se o delta de qualidade vale a diferença de custo para seu caso de uso específico.

O predecessor Qwen3-Omni Flash já tinha respostas de voz em streaming com latência tão baixa quanto 234 milissegundos. Espere que o Qwen3.5-Omni Flash esteja em um intervalo semelhante, embora benchmarks de latência exatos publicados para o 3.5 especificamente não sejam confirmados nas notas de lançamento iniciais.

Light — Casos de Uso de Borda e Orçamento Reduzido

O Light é a menor variante da família. As contagens de parâmetros para a série 3.5-Omni não foram totalmente confirmadas no momento da escrita, mas o modelo 30B-A3B do predecessor funcionou razoavelmente bem em hardware de consumidor com a quantização correta, e a variante Light aqui pode seguir um padrão semelhante.

Se você está prototipando, construindo algo para um cliente com custos de inferência reduzidos, ou genuinamente executando na borda, o Light é por onde você começa. Não o descarte como “o ruim” — para muitos fluxos de trabalho de ferramentas para criadores (pense em: legendagem automática de miniaturas, Q&A simples sobre áudio carregado), provavelmente é mais do que suficiente.

O Que Há de Novo vs. Qwen3-Omni

Janela de Contexto: 256K Tokens, 10+ Horas de Áudio

Esta é a mudança que mais me importa do ponto de vista prático de produção.

A janela de contexto de 256K tokens se traduz em mais de 10 horas de áudio, ou aproximadamente 400 segundos de vídeo 720p com áudio. É um salto significativo. O modo de raciocínio do predecessor Qwen3-Omni atingia o máximo em 65.536 tokens com cadeias de raciocínio de 32.768 tokens — útil, mas limitado a mídias de formato mais longo.

Para análise de podcasts, processamento de entrevistas de longa duração, sumarização estendida de chamadas de clientes — esta janela de contexto muda o que é realmente viável em uma única chamada de API.

Cobertura de Idiomas: 113 de Reconhecimento, 36 de Geração

O reconhecimento de fala agora cobre 113 idiomas e dialetos, acima de 19 no predecessor. A geração de fala expandiu de 10 idiomas para 36.

Uma observação honesta aqui: a Alibaba conta dialetos regionais de uma forma que infla esses números em comparação com como, digamos, a OpenAI contaria a mesma cobertura. Mesmo descontando isso, o salto é real. Se você está construindo para mercados do Sudeste Asiático, conteúdo em árabe, ou qualquer fluxo de trabalho de voz multilíngue, esta é uma melhoria prática significativa.

Thinker-Talker com Hybrid-Attention MoE

A arquitetura Thinker-Talker foi introduzida pela primeira vez no Qwen2.5-Omni. A atualização importante no 3.5-Omni é que ambos os componentes agora usam um design Hybrid-Attention MoE (Mixture-of-Experts), alinhando-se com a mudança da família Qwen3.5 em direção a arquiteturas esparsas.

Por que isso importa para desenvolvedores: a divisão Thinker-Talker permite que sistemas externos — pipelines RAG, filtros de segurança, chamadas de função — intervenham entre os dois estágios antes do início da síntese de fala. Isso não é apenas um detalhe arquitetural. Significa que você pode inserir sua própria lógica entre o que o modelo raciocina e o que ele diz em voz alta. Para agentes de voz em produção, isso é genuinamente útil.

Interrupção Semântica e Clonagem de Voz

Qualquer pessoa que já implantou um bot de voz conhece o problema: o usuário tosse, um cachorro late, alguém diz “hm-hm,” e o bot para no meio da resposta achando que está sendo interrompido.

O Qwen3.5-Omni adiciona interrupção semântica, que tenta distinguir entre um usuário genuinamente querendo intervir e ruído de fundo ambiente ou comentários passageiros. Este é um daqueles recursos que parece menor em um changelog, mas é na verdade a diferença entre um assistente de voz que as pessoas acham frustrante e um que continuam usando.

Clonagem de voz e controle de voz em tempo real para velocidade, volume e emoção também são novidades. A equipe menciona um recurso chamado ARIA que melhora a estabilidade e naturalidade da saída de voz — os detalhes técnicos do que o ARIA faz internamente não foram detalhados no lançamento inicial.

Como Acessar o Qwen3.5-Omni

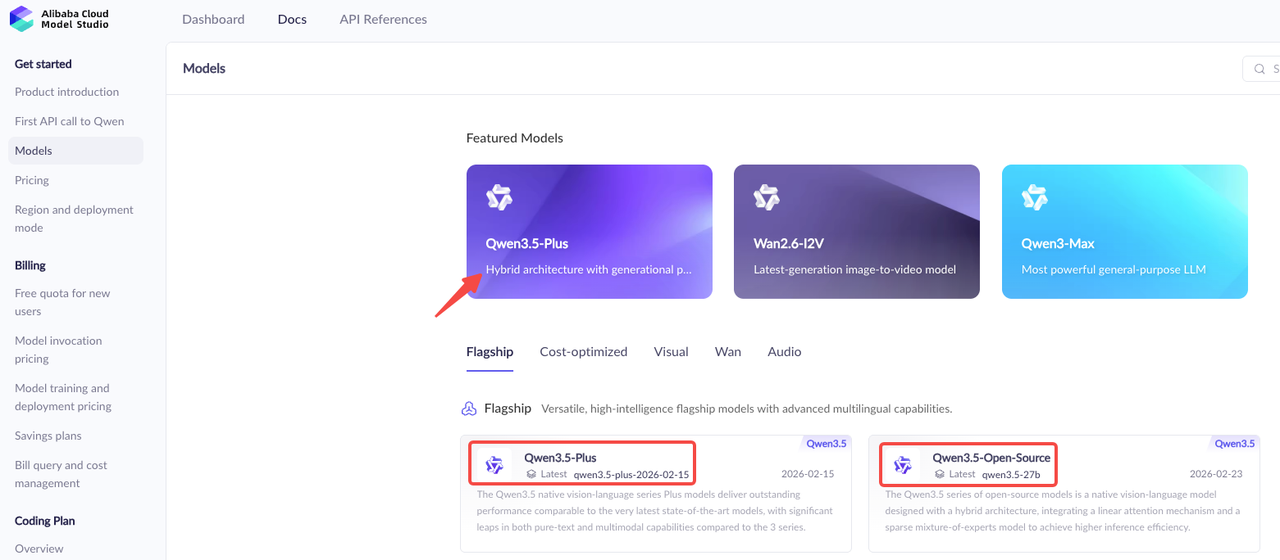

API DashScope (Alibaba Cloud)

O principal caminho de acesso à produção é pela API DashScope da Alibaba Cloud. Ela usa uma interface compatível com OpenAI, o que significa que se você já está usando GPT-4o ou Claude via SDK da OpenAI, a migração é direta.

O DashScope suporta múltiplas regiões: Singapura (internacional), EUA Virgínia, China Pequim e Hong Kong, com URLs de endpoint diferentes para cada uma. Para a maioria das equipes fora da China, o endpoint internacional de Singapura é seu padrão: dashscope-intl.aliyuncs.com.

Os IDs de modelo para as três variantes seguem o padrão qwen3.5-omni-plus, qwen3.5-omni-flash e qwen3.5-omni-light. A estrutura da API segue o formato padrão /v1/chat/completions com um parâmetro modalities para especificar se você deseja texto, áudio ou ambos na resposta.

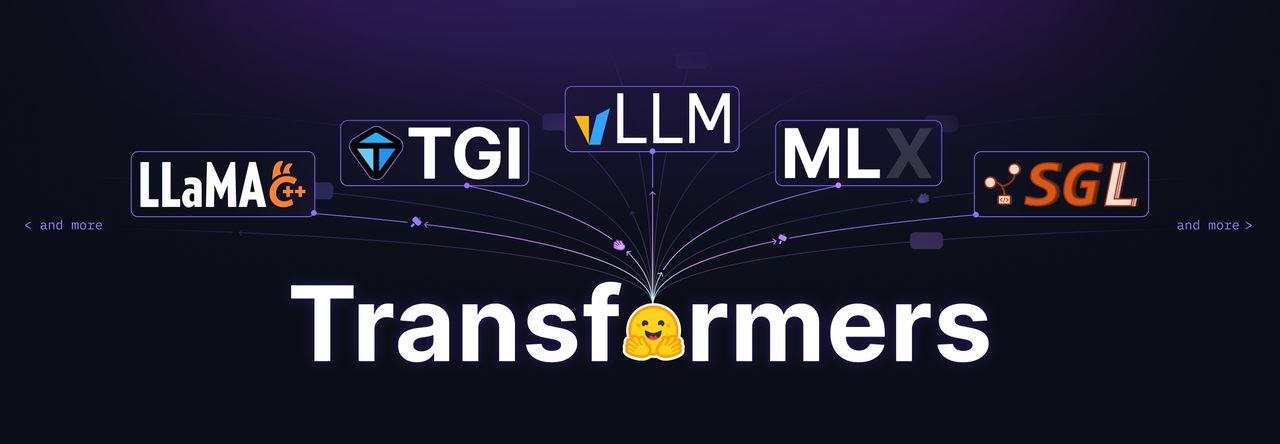

Opção de Auto-Hospedagem com vLLM

A equipe Qwen recomenda fortemente o vLLM para inferência e implantação dos modelos da série Qwen-Omni, fornecendo uma imagem Docker que inclui um ambiente de execução completo para HuggingFace Transformers e vLLM.

A ressalva é que a velocidade de inferência com HuggingFace Transformers em modelos MoE pode ser muito lenta, portanto, para requisitos de grande escala ou baixa latência, o vLLM ou a API DashScope é o caminho recomendado.

Se você está auto-hospedando, planeje em torno do vLLM 0.13.0 especificamente — essa é a versão referenciada na documentação oficial de configuração. A arquitetura MoE significa que os requisitos de memória são menores do que um modelo denso comparável no mesmo nível de qualidade, mas você ainda precisará validar a alocação de GPU antes de iniciar uma implantação de produção.

Status de Pesos Abertos: O Que Está Confirmado vs. Pendente

Este é o ponto onde quero ter cuidado e não especular além do que está confirmado.

O Qwen3-Omni (o predecessor) foi lançado sob Apache 2.0 no GitHub e HuggingFace. Se os pesos do Qwen3.5-Omni seguirão o mesmo caminho de licenciamento Apache 2.0 não foi confirmado no anúncio inicial. Os pesos do predecessor estão disponíveis publicamente — os pesos do 3.5 podem seguir, mas a partir da data de lançamento de 30 de março, essa confirmação está pendente.

Não construa seus planos de implantação de pesos abertos em torno disso até que o repositório oficial do GitHub ou o cartão de modelo do HuggingFace confirme o licenciamento. Verifique o QwenLM GitHub para atualizações.

Quem Deve Prestar Atenção a Este Lançamento

Construtores de Agentes de Voz e Conversação em Tempo Real

Se você está construindo aplicações centradas em voz — bots de atendimento ao cliente, companheiros de IA, ferramentas de voz interativas — o Qwen3.5-Omni merece avaliação séria. A interrupção semântica sozinha aborda um ponto de dor conhecido que todo desenvolvedor de agente de voz já enfrentou. Adicione chamadas de função nativas e pesquisa na web, e isso começa a parecer infraestrutura real em vez de um lançamento de pesquisa.

O post do blog Qwen destaca suporte nativo a pesquisa na web e chamadas de função integrado diretamente ao modelo omni, o que o posiciona menos como um artefato de pesquisa e mais como infraestrutura para aplicações centradas em voz.

Fluxos de Trabalho de Produção Áudio-Visual e Legendagem

Para ferramentas de criadores, automação de produção de vídeo e legendagem em escala — este é o lançamento mais convincente no espaço multimodal de pesos abertos no momento. O contexto de áudio de 10+ horas significa que você pode processar conteúdo de duração completa em uma única chamada. A cobertura expandida de idiomas significa que o conteúdo multilíngue não é mais um caso especial.

A combinação de compreensão de áudio e análise de quadros de vídeo em uma única chamada de inferência também torna isso genuinamente útil para coisas como: extração automática de destaques, legendagem de B-roll, transcrição de voice-over com correlação de texto na tela.

Equipes Já Executando Qwen3-Omni em Produção

Se o Qwen3-Omni já está no seu stack, atualizar para o Qwen3.5-Omni é direto. A estrutura da API é consistente. A atualização da janela de contexto por si só torna isso digno de teste em suas cargas de trabalho existentes — especialmente qualquer coisa que estava atingindo o limite de 65K tokens.

O Que Ele Não Cobre

Não é um Modelo de Geração de Imagens

Vale dizer claramente porque “omnimodal” cria alguma confusão: o Qwen3.5-Omni gera texto e fala. Ele não gera imagens ou vídeo. Ele compreende imagens e vídeo como entrada — essa é uma capacidade completamente diferente. Se geração de imagens é o que você precisa, consulte as linhas separadas de modelos VL e de geração de imagens do Qwen, ou o modelo qwen-image-plus no catálogo DashScope.

Velocidade de Inferência em MoE: vLLM vs. HuggingFace Transformers

Isso tropeçou muitas pessoas com o Qwen3-Omni e vai tropeçar pessoas com o 3.5-Omni também. Como o Qwen3-Omni emprega uma arquitetura MoE, a velocidade de inferência com HuggingFace Transformers em modelos MoE pode ser muito lenta. Para invocação em grande escala ou requisitos de baixa latência, o vLLM ou a API DashScope é fortemente recomendado.

Não faça benchmarks no HuggingFace Transformers e conclua que o modelo é lento. Teste no vLLM ou na API gerenciada antes de formar uma opinião sobre a viabilidade em produção.

FAQ

O Qwen3.5-Omni é open source ou de pesos abertos?

A partir do lançamento de 30 de março de 2026, o status de pesos abertos do Qwen3.5-Omni não foi oficialmente confirmado. O predecessor Qwen3-Omni era de pesos abertos Apache 2.0 e disponível no HuggingFace. Espere um cadência de lançamento semelhante para o 3.5-Omni, mas verifique no GitHub oficial do QwenLM antes de depender disso.

Posso auto-hospedar o Qwen3.5-Omni-Plus?

A API DashScope é o caminho de produção confirmado hoje. A auto-hospedagem via vLLM é suportada para o Qwen3-Omni e provavelmente será suportada para o 3.5-Omni assim que os pesos forem lançados. A arquitetura MoE da variante Plus significa que os requisitos de parâmetros ativos são menores do que um modelo denso comparável, mas você precisará de uma configuração multi-GPU para a variante Plus completa.

Ele suporta chamadas de função e pesquisa na web nativamente?

Sim. O post do blog Qwen destaca explicitamente o suporte nativo a pesquisa na web e chamadas de função integrado ao modelo omni. As chamadas de função seguem o formato padrão de ferramentas OpenAI via API DashScope. Este é um diferencial significativo — você pode construir agentes de voz que consultam dados ao vivo sem rotear por uma camada de orquestração separada.

Posts Anteriores: