Troca de Rosto em Vídeo Explicada: Como Funciona + Guia de API

Como a troca de rosto em vídeo funciona por baixo dos panos — e como chamá-la via API. Abrange o pipeline completo, requisitos de entrada e modos de falha comuns.

Olá, meu nome é Dora. Sendo honesta — na primeira vez que tentei chamar uma API de troca de rosto em vídeo, recebi uma resposta que parecia quase certa. O rosto estava lá. O tempo estava errado em meio segundo. A iluminação fazia o sujeito parecer que estava brilhando levemente por dentro, como um fantasma de desconto.

Esse é o problema com a tecnologia de troca de rosto em vídeo. Parece simples por fora — trocar o rosto A pelo corpo B, pronto — mas no momento em que você vai além dos clipes de demonstração e tenta construir algo real, percebe quantas peças em movimento estão acontecendo sob o capô. Entender essas peças é a diferença entre um resultado que parece polido e um resultado que faz seus usuários torcerem o nariz.

Este guia aborda como a troca de rosto em vídeo realmente funciona, as diferentes abordagens disponíveis, o que sua API precisa antes de poder fazer algo útil e como lidar com os modos de falha que certamente vão aparecer eventualmente.

O Que a Troca de Rosto em Vídeo Realmente Faz

Deixe-me explicar isso claramente, porque muitos guias pulam a parte que realmente importa.

Troca de rosto em vídeo não é um filtro. Não é uma máscara colocada sobre a filmagem. O que ela faz — em um nível bastante profundo — é detectar um rosto em cada quadro de um vídeo, mapear sua geometria, extrair a identidade de um rosto de origem e misturar a identidade da fonte na estrutura facial do alvo, preservando o movimento, a iluminação e a expressão do alvo.

São três problemas distintos acontecendo em sequência.

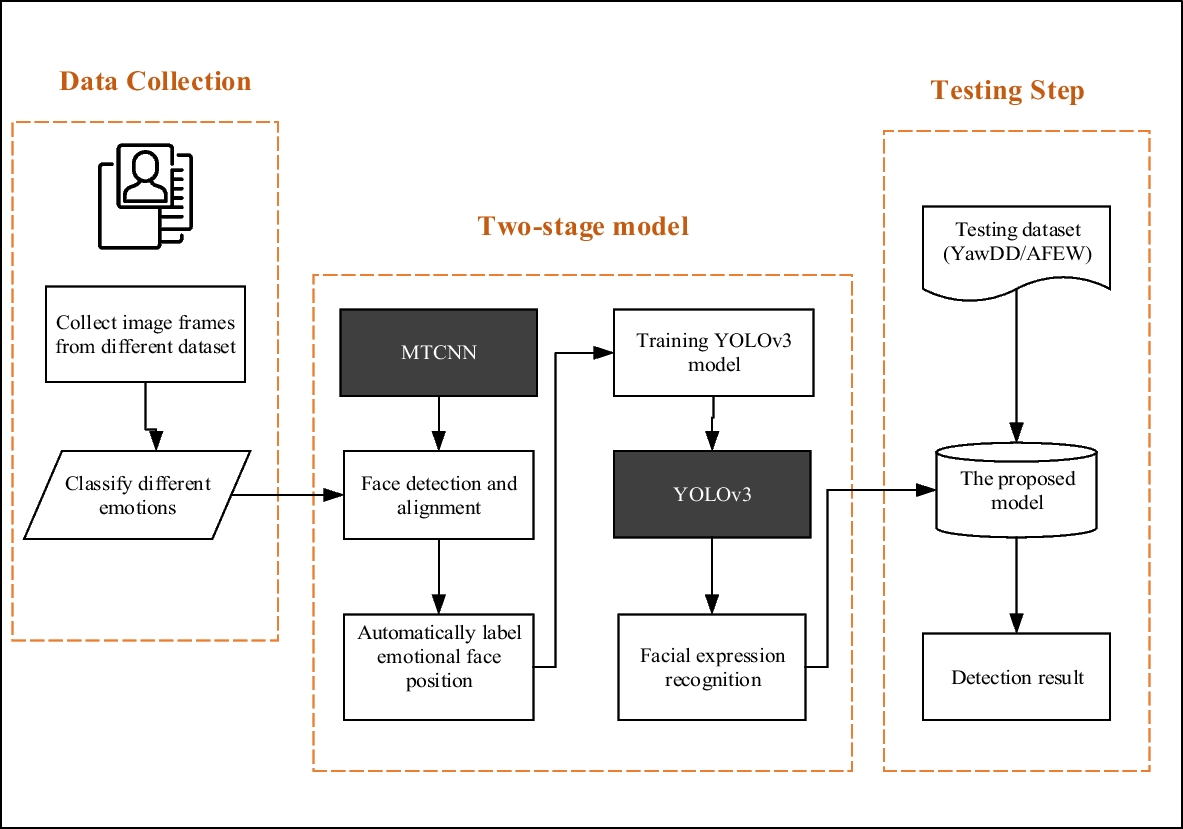

Pipeline de Detecção → Alinhamento → Mesclagem

Detecção é onde o modelo encontra rostos no quadro. Parece fácil. Não é. Rostos parcialmente ocluídos, virados em ângulos acentuados ou se movendo rapidamente criam falhas de detecção. A maioria dos sistemas de produção usa variantes de redes convolucionais em cascata multitarefa — você pode ler sobre a abordagem MTCNN fundamental neste guia de aprendizado profundo para detecção de rostos — embora arquiteturas mais recentes tenham melhorado significativamente em relação a esses benchmarks iniciais.

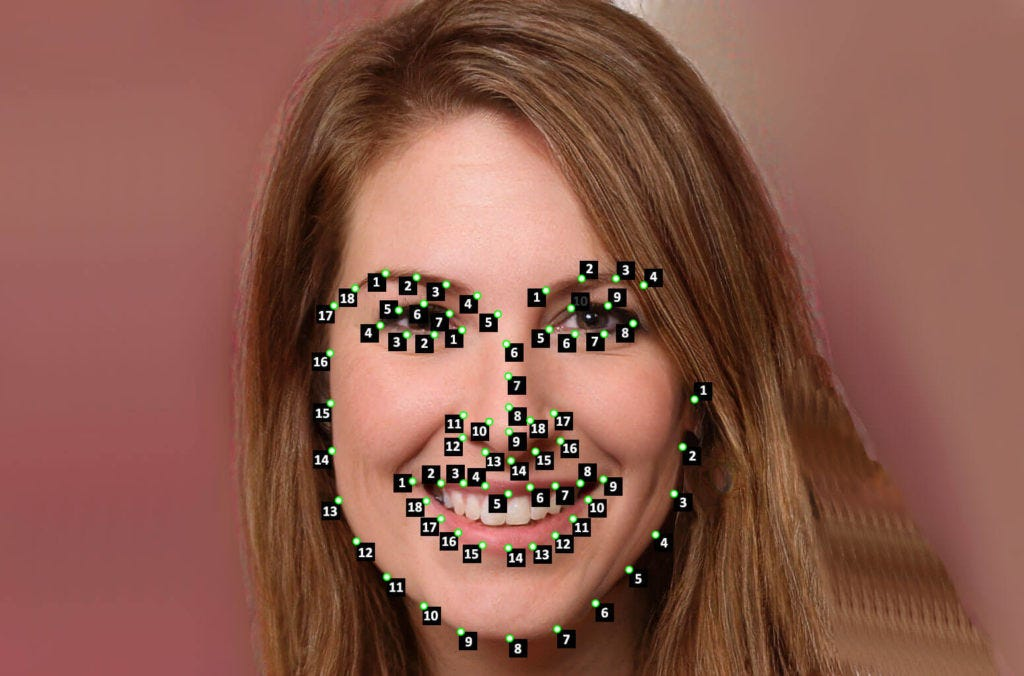

Alinhamento é o passo em que a maioria das pessoas não pensa, mas é genuinamente crítico. Uma vez que um rosto é detectado, o modelo identifica marcos faciais — olhos, ponta do nariz, cantos da boca — e os usa para normalizar o rosto em uma posição e escala canônicas. Sem isso, a troca parece que alguém colocou um rosto em um ângulo ligeiramente errado e esperou que ninguém notasse. Eles sempre notam.

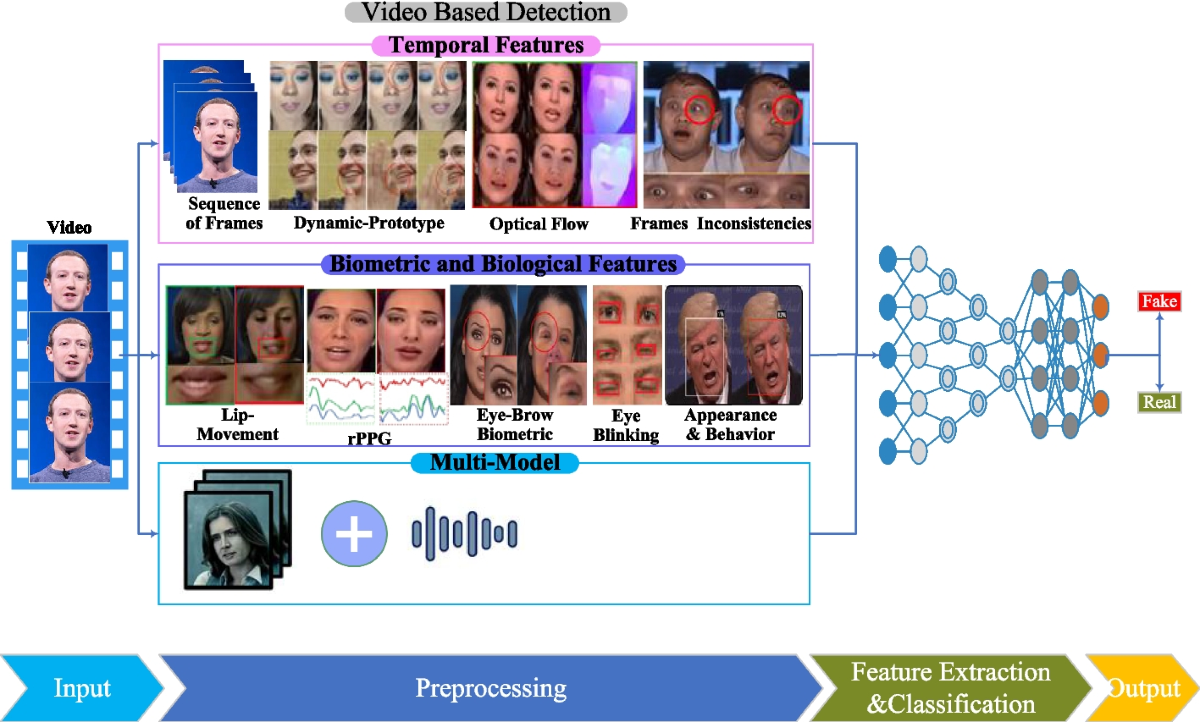

Mesclagem é onde a transferência de identidade real acontece. O modelo pega as características de identidade do rosto de origem, as projeta na geometria do rosto alvo e compõe o resultado de volta no quadro. As abordagens modernas usam redes adversariais generativas (GANs) para isso — um gerador que cria o rosto mesclado e um discriminador que avalia o realismo — razão pela qual entender como funciona a geração de deepfake baseada em GAN é um contexto genuinamente útil antes de você começar a depurar a saída.

O Que Qualidade de Saída Realmente Significa

Aqui está algo que me confundiu no início: “qualidade” na saída de troca de rosto não é um único número. São pelo menos três coisas separadas.

Preservação de identidade — a saída realmente parece o rosto de origem, e não apenas uma média desfocada de ambos?

Consistência temporal — o rosto parece igual em todos os quadros, ou pisca sutilmente?

Fotorrealismo — o resultado parece que pertence à cena, ou parece composto?

Você pode ter excelente preservação de identidade e péssima consistência temporal. Você pode ter fotorrealismo bonito com transferência de identidade ruim. A maioria das APIs expõe configurações ou níveis de qualidade que fazem trocas entre esses aspectos. Saber qual deles importa para o seu caso de uso vai economizar muita confusão.

Tipos de Abordagens de Troca de Rosto em Vídeo

Nem todos os modelos de troca de rosto em vídeo funcionam da mesma forma. Diferenças arquitetônicas semelhantes existem em modelos modernos de geração de vídeo com IA como o Seedance 2.0, onde a consistência temporal e a modelagem de movimento são tratadas de maneiras muito diferentes dependendo da abordagem. Há dois eixos importantes a entender antes de escolher uma ferramenta ou API.

Modelos Quadro a Quadro vs. com Consciência Temporal

Modelos quadro a quadro tratam cada quadro do vídeo de forma independente. Eles são geralmente mais rápidos e mais simples de implementar, mas não levam em conta o fato de que o vídeo é uma sequência de imagens relacionadas. O resultado: oscilações sutis entre quadros, especialmente nas bordas do rosto ou em condições de pouca luz.

Modelos com consciência temporal processam quadros com conhecimento do que veio antes e depois — essencialmente entendendo o movimento e mantendo a consistência ao longo do clipe. Trocas semelhantes aparecem em comparações entre os principais modelos de vídeo com IA, onde estabilidade e realismo de movimento são grandes diferenciais — essencialmente entendendo o movimento e mantendo a consistência ao longo do clipe. A saída é mais suave e mais estável, mas esses modelos são mais pesados e mais lentos. Para qualquer coisa com mais de alguns segundos ou destinada a visualização em tela cheia, a consciência temporal vale o custo de latência.

Minha experiência honesta: se você está prototipando ou gerando miniaturas, quadro a quadro está bem. Se você está construindo algo que as pessoas vão assistir em uma tela de tamanho completo, você vai se arrepender das oscilações.

Rosto Único vs. Múltiplos Rostos

Modelos de rosto único são mais simples e geralmente de maior qualidade para sua tarefa específica. Se o seu caso de uso envolve um rosto claramente visível no quadro — o que abrange a maioria dos cenários de produção — este é o ponto de partida correto.

Modelos de múltiplos rostos podem detectar e trocar vários rostos em um único quadro. Eles são úteis para cenas de conjunto, filmagens em grupo ou cenários onde você não controla totalmente o vídeo de entrada. A desvantagem é que são mais computacionalmente caros e mais propensos a atribuição incorreta de rostos — ou seja, o modelo troca o rosto errado pelo corpo errado. Vale saber antes de enviar um clipe com quatro pessoas e receber de volta algo involuntariamente surreal.

Antes de Chamar a API: O Que Você Precisa

É aqui que a maioria das pessoas perde tempo. Não porque a API seja difícil, mas porque os requisitos de entrada são mais específicos do que a documentação geralmente deixa claro.

Requisitos de Entrada (Formato, Resolução, Duração do Clipe)

A maioria das APIs de troca de rosto em vídeo espera:

- Formato de vídeo: MP4 com codificação H.264 é o padrão mais seguro. Algumas APIs também aceitam WebM ou MOV, mas H.264/MP4 é o mais amplamente suportado.

- Resolução: 720p é o mínimo prático para qualidade de troca aceitável. 1080p fornece ao modelo mais detalhes faciais para trabalhar. Abaixo de 480p, a maioria dos modelos começa a produzir artefatos visíveis — a região do rosto simplesmente não tem pixels suficientes para uma mesclagem limpa.

- Duração do clipe: Muitas APIs limitam o processamento síncrono a 30–60 segundos. Clipes mais longos requerem envio de trabalho assíncrono com callbacks de webhook. Saiba em qual categoria seus clipes se enquadram antes de arquitetar seu tratamento de solicitações.

- Imagem de origem: Para o rosto que você está trocando, uma única foto frontal bem iluminada geralmente é suficiente. Alguns modelos também aceitam fontes de vídeo, mas uma imagem estática clara com iluminação uniforme normalmente produz transferência de identidade mais consistente.

Restrições de Ângulo e Iluminação do Rosto

Uma verificação rápida da realidade aqui: os modelos não são mágica.

Ângulo do rosto: A maioria dos modelos funciona bem até cerca de 30–35 graus fora do eixo de uma visão frontal. Além disso, você começa a perder precisão nos marcos, o que se transforma em erros de alinhamento, que produzem artefatos de mesclagem. Perfis geralmente não são suportados ou produzem saída inutilizável. Se sua filmagem de origem tem sujeitos frequentemente olhando para longe da câmera, modere suas expectativas de qualidade.

Iluminação: Iluminação direcional intensa — rostos iluminados lateralmente, iluminação forte de cima que cria sombras profundas nos olhos — é mais difícil para o passo de mesclagem lidar de forma convincente. O modelo precisa reconciliar a iluminação no rosto de origem com a iluminação no quadro alvo, e quanto menos eles corresponderem, mais visível será a costura.

Não estou dizendo para evitar filmagens escuras. Estou dizendo: se você está gerando material de origem e tem algum controle sobre ele, iluminação uniforme vai melhorar significativamente sua saída.

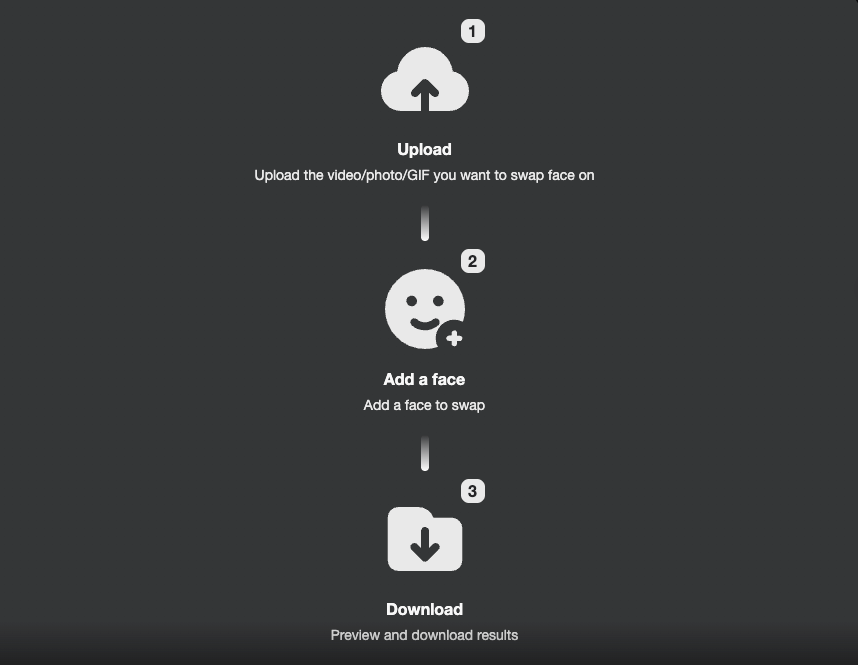

Fluxo de Trabalho da API Passo a Passo

Vamos ser práticos. Aqui está o fluxo típico para uma chamada de API de troca de rosto em vídeo.

Autenticação

Quase toda API de produção usa autenticação por token bearer. Você receberá uma chave de API no registro e a passará como cabeçalho:

Authorization: Bearer YOUR_API_KEYEsta é uma prática padrão e está alinhada com as diretrizes de segurança de recursos como o OWASP REST Security Cheat Sheet. Algumas coisas que vale fazer no início:

- Armazene sua chave de API como uma variável de ambiente, nunca codificada em seu código-fonte

- Configure a rotação de chaves — a maioria das APIs permite regenerar chaves sem perder o acesso à conta

- Se disponível, use chaves com escopo que tenham apenas as permissões que sua integração realmente precisa

Enviando a Solicitação

Um corpo de solicitação típico se parece com algo assim:

{

"source_image_url": "https://seu-armazenamento.com/rosto-origem.jpg",

"target_video_url": "https://seu-armazenamento.com/video-alvo.mp4",

"output_format": "mp4",

"quality": "high"

}Algumas APIs aceitam uploads de arquivos binários diretamente via multipart form-data. Outras só aceitam URLs apontando para arquivos publicamente acessíveis. Verifique cuidadosamente a documentação da sua API sobre isso — é uma fonte comum de falhas silenciosas onde a API retorna 200, mas não processa nada porque a URL do arquivo estava inacessível.

Para clipes mais longos, você normalmente receberá de volta um ID de trabalho em vez da saída diretamente:

{

"job_id": "fswap_a3b92f",

"status": "processing",

"estimated_time_seconds": 45

}Tratamento de Saída

Consulte o endpoint de status do trabalho ou configure um webhook para receber o resultado quando o processamento for concluído. A resposta incluirá uma URL de download para o vídeo processado. Essas URLs geralmente têm prazo limitado — baixe e armazene a saída em seu próprio armazenamento dentro do prazo de validade, que geralmente é de 1 a 24 horas dependendo do provedor.

Não presuma que a saída está perfeita só porque o status está como concluído. Sempre verifique alguns quadros manualmente. Status concluído significa que o pipeline rodou sem travar. Não significa que a troca ficou boa.

Para sistemas de produção, construir uma integração sólida de API REST em torno desses padrões assíncronos — tratamento adequado de erros, lógica de nova tentativa, verificação de webhook — vai te salvar de uma sessão de depuração dolorosa mais tarde.

Modos de Falha Comuns e Correções

É aqui que as coisas ficam reais. Já passei por todos os três.

Falhas de Movimento

Como parece: O rosto trocado treme ou “pula” entre quadros, um problema muito semelhante aos problemas discutidos em guias sobre como criadores corrigem oscilações e tremores em vídeos gerados por IA.

Por que acontece: Processamento quadro a quadro sem suavização temporal. Cada quadro é resolvido independentemente, então pequenas variações na detecção de marcos criam inconsistência.

Correção: Mude para um modelo com consciência temporal, se disponível. Se você está limitado a uma API quadro a quadro, alguns provedores oferecem uma passagem de estabilização de pós-processamento — procure isso nas suas opções. Alternativamente, pré-processar seu vídeo de entrada com estabilização de movimento antes de enviá-lo para a API pode ajudar.

Deriva de Identidade

Como parece: O rosto de saída começa gradualmente a parecer menos com a origem e mais com alguma mistura de origem e alvo — ou apenas uma pessoa de aparência mediana.

Por que acontece: Geralmente é um problema de qualidade da imagem de origem. Se a foto do rosto de origem tem baixa resolução, iluminação ruim ou foi capturada em um ângulo não frontal, o modelo não consegue extrair características de identidade confiáveis. Ele preenche as lacunas com o que pode inferir, o que muitas vezes se aproxima do rosto alvo.

Correção: Use uma imagem de origem de maior qualidade. Frontal, iluminação uniforme, pelo menos 512×512px na região do rosto. Essa única mudança resolve a deriva de identidade em talvez 80% dos casos na minha experiência.

Incompatibilidade de Iluminação

Como parece: O rosto trocado parece “colado” — a direção da iluminação ou a temperatura de cor do rosto não corresponde à cena ao redor.

Por que acontece: O modelo de mesclagem tenta harmonizar a iluminação, mas só consegue fazer até certo ponto. Grandes diferenças entre a iluminação na imagem de origem e o vídeo alvo desafiam o passo de composição.

Correções:

- Se você tem controle sobre a imagem de origem, fotografe-a em condições de iluminação semelhantes às da sua filmagem alvo

- Algumas APIs oferecem normalização de iluminação explícita como parâmetro — ative-a

- Para incompatibilidades graves, pós-processar a saída com uma passagem de gradação de cores pode ajudar a misturar o rosto na cena de forma mais convincente

Então, qual é a conclusão?

A troca de rosto em vídeo é uma tecnologia genuinamente poderosa quando você entende o que ela precisa para ter sucesso. A maioria dos problemas de qualidade não é misteriosa — eles remontam à qualidade de entrada, seleção de modelo para o caso de uso e expectativas realistas sobre o que o pipeline pode e não pode lidar. Acerte esses pontos e você vai gastar muito menos tempo depurando saídas que pareciam boas na demonstração, mas se desintegraram na produção.