Melhores Ferramentas de Troca de Rosto em Vídeo com IA (2026)

Testamos as principais ferramentas de troca de rosto em vídeo com IA em 2026. Veja o que realmente funciona, o que falha e como escolher com base nas suas necessidades reais.

Olá, eu sou a Dora. Aqui está algo que continuo percebendo: quase todo ranking de “melhor troca de rosto em vídeo com IA” testa exatamente o mesmo clipe de demonstração em condições ideais e depois declara um vencedor. Não é assim que nada disso realmente é usado.

Passei as últimas semanas rodando footage de teste real por uma lista de ferramentas, muitas das quais são construídas sobre ou inspiradas em modelos modernos de geração de vídeo com IA como o Seedance 2.0 — diferentes configurações de iluminação, diferentes níveis de movimento, diferentes durações de clipe. O que encontrei nem sempre foi o que o marketing sugeria. Algumas ferramentas que parecem impressionantes nas visualizações desmoronam na exportação. Algumas que parecem lentas no navegador produzem a saída temporalmente mais estável. E algumas que raramente são mencionadas acabam sendo a escolha mais confiável para desenvolvedores que precisam de comportamento de API repetível.

Este guia cobre como avaliei essas ferramentas, como a comparação realmente ficou, e qual ferramenta se encaixa em qual situação. Sem rankings de afiliados. Sem o evasivo “todas são ótimas!”.

Como Avaliamos Essas Ferramentas

Clipes de Teste Utilizados

Rodei três categorias de vídeo de origem em cada ferramenta:

Tipo de Clipe A — Iluminação controlada, baixo movimento: Footage de cabeça falante gravada sob luz uniforme e difusa. Sujeitos de frente para a câmera, movimento mínimo da cabeça. Este é o teste no “modo fácil” — qualquer ferramenta razoável deve ter desempenho aceitável aqui.

Tipo de Clipe B — Iluminação mista, movimento moderado: Footage com câmera na mão com uma mistura de luz natural de janela e preenchimento de teto. Sujeitos se movendo naturalmente — acenando com a cabeça, virando levemente. É aqui que os problemas de consistência temporal começam a aparecer.

Tipo de Clipe C — Movimento dinâmico, iluminação severa ou direcional: Viradas rápidas de cabeça, expressão animada, sujeitos iluminados lateralmente ou contra a luz. É aqui que a maioria das ferramentas começa a ter dificuldades e onde as diferenças reais aparecem.

As durações dos clipes variaram de 8 a 45 segundos. Rosto de origem: um único retrato frontal bem iluminado com resolução de rosto de 1080px.

Rubrica de Pontuação

Cada ferramenta foi pontuada em quatro dimensões:

| Dimensão | O Que Medi |

|---|---|

| Realismo | Preservação de identidade, correspondência de tom de pele, qualidade de mesclagem de bordas |

| Consistência Temporal | Estabilidade quadro a quadro, cintilação, desvio sob movimento |

| Velocidade | Tempo do envio até a saída disponível para download |

| Eficiência de Custo | Preço por minuto de vídeo processado, generosidade do nível gratuito |

Nenhuma dimensão vence por padrão — uma realidade que também aparece em comparações entre os principais modelos de geração de vídeo com IA, onde velocidade, realismo e estabilidade frequentemente se compensam. Uma ferramenta que renderiza em 20 segundos mas produz saída com cintilação não é “rápida” de nenhuma forma que importe.

Vale a pena um momento para entender por que a estabilidade temporal é difícil de acertar em vídeo — resume-se ao desafio de manter identidade consistente em quadros sequenciais, que a pesquisa sobre síntese de vídeo baseada em GAN do arXiv cobre com profundidade útil se você quiser o embasamento técnico.

Data do Teste e Instantâneo de Preços

Todos os testes realizados em fevereiro–março de 2026. Os preços refletem as tarifas publicadas atuais no momento do teste — essas mudam frequentemente, então verifique antes de se comprometer.

Melhores Ferramentas de Troca de Rosto em Vídeo com IA

Melhor Qualidade Geral de Saída: DeepSwap

Para puro realismo de saída nos três tipos de clipe, o DeepSwap produziu consistentemente os resultados mais convincentes. A preservação de identidade foi forte mesmo no Tipo de Clipe C (movimento dinâmico, iluminação severa), onde a maioria dos concorrentes mostrou desvio visível após a marca dos 15 segundos.

O que se destacou: a abordagem multi-motor. O DeepSwap roda vários modelos de IA simultaneamente e retorna múltiplas versões de saída para comparação. Para trocas difíceis — ângulos de origem incomuns, iluminação direcional forte — isso importa enormemente. Um motor lida melhor com sombras profundas; outro preserva detalhes faciais finos como textura e assimetria com mais precisão.

A contrapartida é complexidade e velocidade. O DeepSwap não é uma experiência de um clique. E para trocas simples de cabeça falante, o tempo de processamento extra nem sempre justifica a diferença de qualidade em relação a ferramentas mais simples.

Melhor para: Trabalho de produção, conteúdo de marketing, qualquer coisa onde a saída será visualizada de perto em telas grandes.

Preços: Baseado em créditos, pague conforme usar. Sem nível gratuito permanente.

Melhor para Integração de API para Desenvolvedores: Magic Hour

Se você está construindo algo em vez de apenas gerar conteúdo, o Magic Hour é a opção mais amigável para desenvolvedores que testei. A API está bem documentada, retorna respostas estruturadas previsíveis e gerencia trabalhos assíncronos de forma limpa — o que importa muito quando você está integrando troca de rosto em um pipeline maior.

Os modelos subjacentes também são sólidos. A consistência temporal no Tipo de Clipe B (movimento moderado) estava entre as melhores que vi, e a qualidade de saída em clipes de cabeça falante foi genuinamente impressionante. É também uma das poucas ferramentas que integra troca de rosto com sincronização labial e geração de imagem para vídeo em uma superfície de API unificada — útil se seu caso de uso envolve mais do que apenas substituição de rosto.

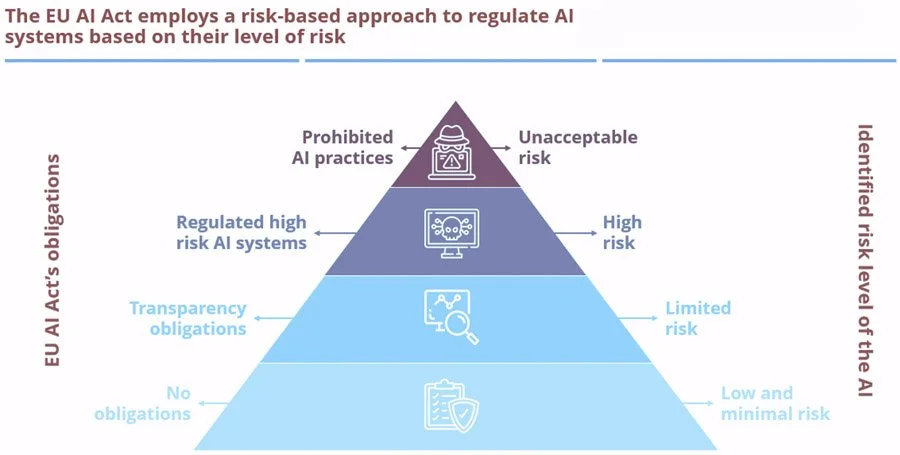

Vale notar que o ambiente regulatório em torno de mídia sintética está se tornando mais rígido. Sob o Artigo 50 da Lei de IA da UE, os provedores de sistemas de IA que geram conteúdo sintético de áudio, imagem ou vídeo devem garantir que as saídas sejam marcadas em formato legível por máquina e detectáveis como geradas ou manipuladas artificialmente. O Magic Hour inclui marca d’água de conteúdo por padrão, o que facilita a conformidade se você está construindo produtos que serão distribuídos em mercados regulamentados. Para uma visão geral mais ampla do que essas obrigações significam na prática, o resumo da Lei de IA da UE pelo Parlamento Europeu vale a leitura antes de lançar qualquer coisa voltada ao consumidor.

Melhor para: Desenvolvedores construindo aplicações, fluxos de trabalho de automação em lote, equipes que precisam de confiabilidade de API ao longo do tempo.

Preços: Planos de assinatura com acesso à API. Teste gratuito disponível.

Melhor para Clipes com Múltiplos Rostos: Reface

A troca de múltiplos rostos é genuinamente mais difícil do que a de um único rosto. O modelo precisa detectar, atribuir e processar independentemente múltiplos rostos por quadro — e se a atribuição de rosto der errado, o resultado é visualmente caótico de uma forma difícil de explicar a um cliente.

O Reface lida com cenários de múltiplos rostos de forma mais confiável do que qualquer outra coisa que testei. A atribuição de rostos permaneceu correta em clipes com dois a três sujeitos, mesmo quando os rostos se sobrepuseram brevemente no quadro. A saída não vai ganhar prêmios de fotorrealismo, mas é consistente — e para conteúdo de grupo destinado a redes sociais, consistência supera perfeição.

A arquitetura GAN que alimenta a maioria das ferramentas modernas de troca de rosto — onde uma rede geradora e uma rede discriminadora competem iterativamente para melhorar o realismo — é fundamentalmente a mesma na maioria dessas plataformas. O que diferencia o desempenho de múltiplos rostos é geralmente como a ferramenta lida com detecção e rastreamento de rostos antes da etapa generativa, não o modelo generativo em si.

Melhor para: Clipes de grupo, footage de conjunto, conteúdo voltado para redes sociais com múltiplos sujeitos.

Preços: Assinatura a partir de $3,99/mês. Nível gratuito com marca d’água.

Melhor Opção Gratuita: FaceFusion

O FaceFusion é open-source, roda localmente e produz qualidade de saída que não tem nada a ver com ser gratuito. Não é um aplicativo web — a configuração requer alguma paciência técnica — mas uma vez em execução, você tem controle total sobre os parâmetros do modelo, sem marcas d’água e sem cobranças por crédito.

Para usuários preocupados com privacidade, a arquitetura local significa que suas imagens de origem e vídeo nunca saem da sua máquina. Isso é um diferencial real para qualquer pessoa que trabalha com footage de pessoas identificáveis, especialmente à medida que as políticas de retenção de dados em ferramentas baseadas em nuvem se tornam mais escrutinadas.

O problema: não segura sua mão. As mensagens de erro são concisas. Os parâmetros de processamento precisam de ajuste manual. E ao contrário das ferramentas em nuvem, não escala horizontalmente se você precisar processar muitos clipes em paralelo.

Melhor para: Desenvolvedores experimentando, usuários preocupados com privacidade, qualquer pessoa disposta a trocar o atrito de configuração por zero custo contínuo.

Preços: Gratuito e open-source.

Tabela Comparativa

| Ferramenta | Realismo | Consistência Temporal | Múltiplos Rostos | Acesso à API | Preço Inicial |

|---|---|---|---|---|---|

| DeepSwap | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ | Limitado | Pague por uso |

| Magic Hour | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ✅ | ✅ Completo | Assinatura |

| Reface | ⭐⭐⭐ | ⭐⭐⭐⭐ | ✅ Forte | ❌ | $3,99/mês |

| FaceFusion | ⭐⭐⭐⭐ | ⭐⭐⭐ | ✅ | Hospedagem própria | Gratuito |

As pontuações refletem testes no Tipo de Clipe B (iluminação mista, movimento moderado). Os resultados variam por tipo de clipe.

O Que a Maioria das Avaliações Perde

Lacuna entre Qualidade de Visualização e Qualidade de Exportação

Esse foi o primeiro que me pegou. Várias ferramentas mostram uma visualização de alta qualidade no navegador que parece genuinamente impressionante. O arquivo exportado — na resolução e taxa de bits que você realmente precisa — parece visivelmente diferente.

A lacuna geralmente aparece de duas formas: artefatos de compressão ao redor da linha do cabelo e bordas do rosto, e uma suavidade na saída final que não era visível na visualização. Sempre baixe e examine uma exportação em resolução completa antes de tomar uma decisão de ferramenta com base em visualizações. O que você vê em um player de navegador a 720p não é o que seu público verá.

Por Que a Velocidade de Renderização Sozinha Não Prevê o Realismo

Já vi essa afirmação repetidamente: “processa em menos de 10 segundos.” Isso é ou um clipe muito curto, uma saída de resolução muito baixa, ou um caminho muito rápido para qualidade medíocre.

Consistência temporal — a coisa que faz as trocas de rosto em vídeo parecerem reais ao longo do tempo — está intimamente relacionada a questões discutidas em guias sobre como criadores corrigem cintilação e tremulação em vídeo gerado por IA. Não apenas em um único quadro — requer que o modelo entenda o movimento ao longo dos quadros. A visão geral técnica da IBM sobre como os GANs funcionam explica por que esse processo iterativo exige esforço computacional: as redes geradora e discriminadora estão efetivamente competindo através de muitos ciclos para produzir saída realista. Ferramentas que entregam resultados em segundos em clipes longos quase sempre estão sacrificando esse raciocínio temporal. Velocidade é um sinal, não uma característica. Processamento rápido em vídeos com mais de 15 segundos geralmente significa que algo foi pulado.

Recomendação por Caso de Uso

Criadores Casuais

Use o Reface. É rápido, amigável para dispositivos móveis, lida bem com clipes de grupo, e o nível gratuito é genuinamente utilizável para clipes curtos. Você não vai obter realismo de nível de produção, mas obterá saída compartilhável em menos de um minuto com mínimo atrito de configuração.

Desenvolvedores que Precisam de Saída de API Repetível

Magic Hour. A documentação da API é limpa, o tratamento assíncrono é confiável, e a saída é consistente o suficiente para construir produtos voltados ao usuário. Se sua integração envolve mercados regulamentados, a marcação d’água integrada também simplifica sua postura de conformidade sob frameworks como os requisitos de transparência do Artigo 50 da Lei de IA da UE.

Usuários que Precisam de Suporte a Múltiplos Rostos

Reface para conteúdo de redes sociais, DeepSwap para trabalho de produção. Se você está fazendo clipes de grupo rápidos para redes sociais, a velocidade e a atribuição confiável de rostos do Reface vence. Se você está fazendo trabalho com múltiplos rostos para marketing ou vídeo profissional onde a qualidade importa, a abordagem multi-motor do DeepSwap produz resultados mais limpos, especialmente quando os rostos não estão todos iluminados frontalmente e voltados para frente.

Então, qual é realmente a melhor ferramenta de troca de rosto em vídeo com IA em 2026? Depende do que você entende por melhor.

Melhor realismo em condições difíceis: DeepSwap. Melhor API para construir produtos: Magic Hour. Melhor para grupos: Reface. Melhor gratuitamente: FaceFusion. Qualquer ranking que escolhe um único vencedor para todos está otimizando para simplicidade, não para precisão.

Teste seus clipes reais. A ferramenta que parece melhor no footage de outra pessoa não vai necessariamente funcionar no seu.