Melhores Ferramentas de Troca de Rosto em Vídeo Online

Compare as melhores ferramentas de troca de rosto em vídeo online e encontre a opção certa para velocidade, qualidade ou edição com múltiplos rostos.

Olá, sou a Dora. Tenho testado ferramentas de vídeo com IA há mais de um ano, principalmente para entender o que é genuinamente utilizável versus o que apenas parece bem em capturas de tela. Há alguns meses, comecei a aplicar um framework de avaliação consistente a ferramentas de troca de rosto em vídeo — mesmos clipes de origem, mesmas condições de teste, mesmo processo de revisão de saída. Não é um ambiente de laboratório, mas é estruturado o suficiente para comparar ferramentas com alguma confiança.

Este guia é sobre seleção. Se você também está explorando outras ferramentas de vídeo com IA além da troca de rosto, vale a pena ver como Seedance, Kling e Sora se comparam em fluxos de trabalho reais de geração de vídeo com IA. Se você está tentando decidir qual ferramenta online de troca de rosto em vídeo se encaixa no seu fluxo de trabalho, quero oferecer uma base mais clara para essa decisão do que a maioria das avaliações faz.

O Que Torna uma Ferramenta Online de Troca de Rosto Melhor que Outra

A maioria das comparações resume tudo em uma vaga “pontuação de qualidade”. Isso não é útil para escolher uma ferramenta. Aqui estão as quatro dimensões que acompanhei separadamente. Para criadores que também avaliam modelos de vídeo mais recentes, esta visão geral explica o que é o SkyReels V4 e por que alguns criadores o usam para geração de vídeo com IA.

Qualidade de saída

A qualidade na troca de rosto em vídeo tem dois componentes que precisam ser avaliados de forma independente. Primeiro: qualidade espacial — quão limpa é a mistura de bordas ao redor da linha do cabelo, mandíbula e pescoço em qualquer quadro único. Segundo, e mais difícil: consistência temporal — quão estável a identidade permanece entre os quadros quando o sujeito se move.

Pesquisas sobre métricas de qualidade de vídeo confirmam que artefatos temporais — distorções que aparecem em sequências de quadros em vez de dentro de um único quadro — requerem métodos de medição dedicados que a maioria das pontuações de qualidade espacial não captura. Essa distinção importa na prática: uma ferramenta que produz um quadro estático limpo, mas mostra deriva de identidade ou borrão em um clipe de 10 segundos, não é uma ferramenta de alta qualidade para vídeo, independentemente de como a prévia parece.

Nos meus testes, usei dois clipes por ferramenta: um plano de cabeça falante frontal de 10 segundos, e um clipe de 12 segundos com movimento moderado de cabeça e uma virada de 45 graus. O segundo clipe é onde a maioria das ferramentas diverge significativamente.

Velocidade

Para trabalho iterativo — testar fotos de origem, comparar saídas — o tempo de renderização se acumula rapidamente. Medi o tempo total de relógio do upload até a saída disponível para download, não apenas o tempo de processamento declarado. As esperas na fila do plano gratuito estão incluídas nesse número, o que importa.

Os resultados entre as ferramentas variaram de menos de 60 segundos a mais de 9 minutos no mesmo clipe. Essa não é uma diferença menor quando você está executando cinco variantes.

Suporte a múltiplos rostos

Esta é uma capacidade separada, não uma extensão de recurso. A troca de rosto em vídeo requer resolver tanto problemas de detecção quanto de otimização temporal — rastreando cada rosto de forma independente entre os quadros enquanto mantém a substituição de identidade consistente ao longo da sequência. Clipes com múltiplos rostos multiplicam essa complexidade. A maioria dos planos gratuitos suporta apenas detecção de rosto único, e mesmo os planos pagos variam significativamente em como lidam com tomadas em grupo onde os rostos se sobrepõem parcialmente ou se movem em taxas diferentes.

Testei o suporte a múltiplos rostos com um clipe de 3 pessoas. Onde as ferramentas alegavam capacidade de múltiplos rostos, avaliei cada troca individual de forma independente.

Facilidade de uso

Contraintuitivamente, a facilidade de uso importa mais na extremidade de maior qualidade do espectro. Ferramentas básicas são simples porque oferecem poucos controles. Ferramentas com tetos mais altos — seleção de região facial, ajuste de realismo, ancoragem de expressão — expõem mais configuração, o que aumenta a complexidade da interface. O nível certo de complexidade depende inteiramente do que você precisa controlar.

Melhores Ferramentas Online de Troca de Rosto em Vídeo

Melhor no geral: Magic Hour

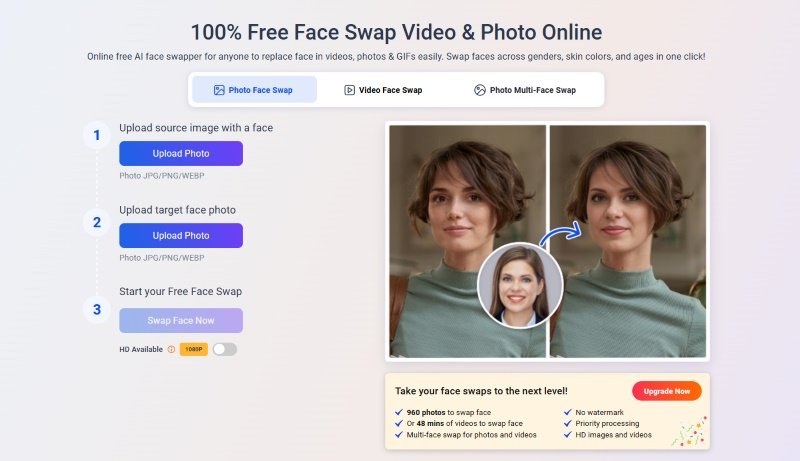

A ferramenta de troca de rosto em vídeo do Magic Hour é a ferramenta que eu enviaria para a maioria das pessoas primeiro. Nenhuma conta necessária para as primeiras três trocas de vídeo — essa é uma oferta genuína de experimentar antes de se comprometer, não um temporizador de contagem regressiva. A resolução de saída vai de 512px no plano gratuito até 4K para usuários empresariais, com controles de qualidade integrados para iluminação e características faciais.

No meu teste de plano de cabeça falante, a mistura de bordas foi a mais limpa que vi entre todas as ferramentas — especialmente as transições na linha do cabelo. No clipe de movimento, o alinhamento facial permaneceu estável durante o movimento da cabeça, o que é um ponto de falha comum para ferramentas mais baratas, tornando-o especialmente adequado para vídeos de cabeça falante e clipes de marketing curtos onde o realismo importa.

A marca d’água do plano gratuito e o limite de clipes de 10 segundos são limitações reais. Para planos pagos, os preços começam em $12/mês e as renderizações em clipes curtos geralmente são concluídas em menos de 2 minutos. As atualizações do final de 2025 adicionaram detecção de múltiplos rostos em vídeo e melhoraram a precisão da sincronização labial — ambas testaram notavelmente melhor do que as versões anteriores.

Melhor opção gratuita: Vidwud

O Vidwud ocupa uma posição incomum: genuinamente sem marca d’água nas exportações gratuitas, e sem necessidade de conta para começar. No meu teste de plano de cabeça falante frontal, a qualidade de saída era competitiva com o plano gratuito do Magic Hour — mistura de bordas nítida, consistência razoável de tom de pele.

As lacunas apareceram no clipe de movimento. A virada de 45 graus produziu um salto de identidade visível em uma de três execuções de teste — o rosto trocado brevemente reverteu para a geometria do rosto de origem durante a virada antes de se recuperar. Não foi consistente, mas estava presente. Os tempos de fila durante os horários de pico chegaram a 7–9 minutos nos meus testes, o que vale a pena considerar se você está iterando.

Para qualquer pessoa que trabalha principalmente com filmagens frontais e está disposta a planejar em torno da fila, o Vidwud oferece a maior qualidade de saída por dinheiro gasto — especificamente zero dólares.

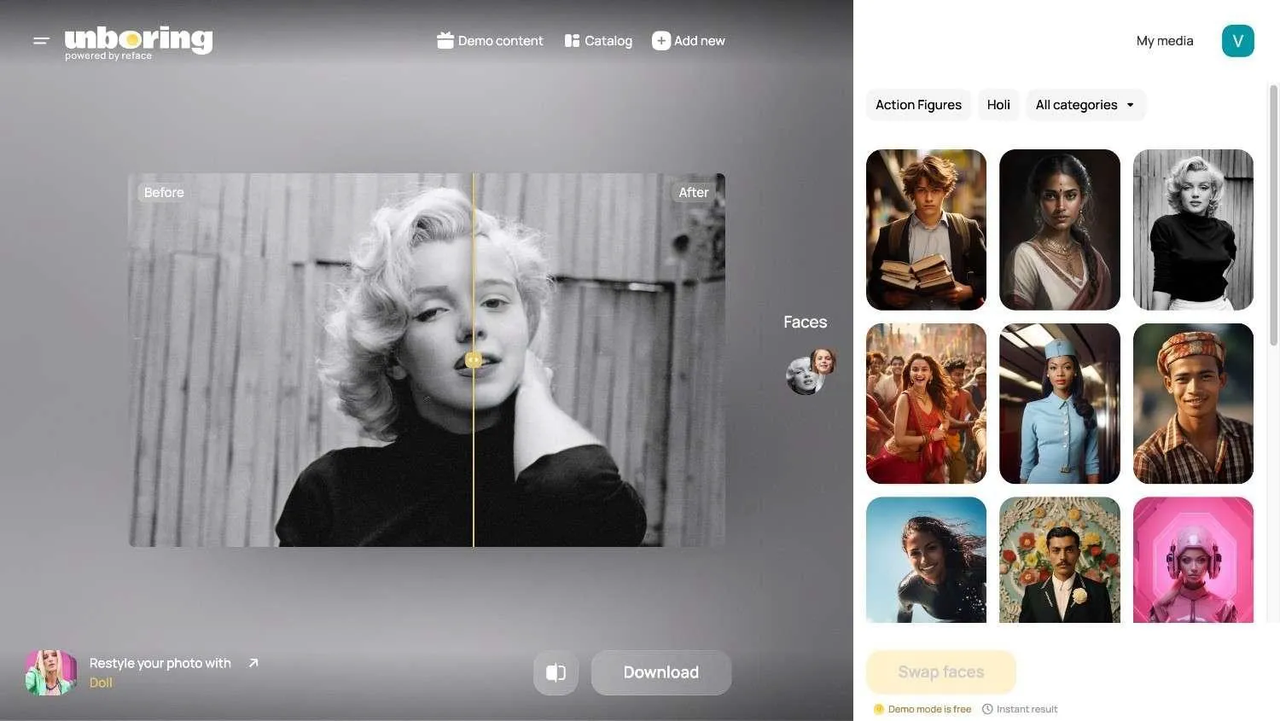

Melhor para clipes com múltiplos rostos: Remaker

O Remaker é a ferramenta que eu escolheria especificamente quando o clipe tem mais de um sujeito. Resolver a consistência temporal para vídeo com múltiplos rostos requer que cada rosto seja rastreado e substituído de forma independente entre os quadros — e a interface do Remaker é projetada em torno desse fluxo de trabalho. Você pode selecionar, configurar e avaliar cada troca de rosto de forma independente antes de renderizar.

No meu clipe de teste com 3 pessoas, a qualidade da troca individual foi sólida — não no nível do Magic Hour em detalhes faciais de close-up, mas consistente ao longo da sequência sem deriva de identidade em nenhum dos três sujeitos. O plano gratuito funciona em um sistema de crédito diário que limita o volume, mas cobre alguns clipes de teste antes de atingir um limite.

Melhor para renderização rápida: Reface

O Reface não está otimizando para realismo. Está otimizando para velocidade e compartilhabilidade, e tem sucesso em ambos. Upload para resultado em menos de 30 segundos, consistentemente. A saída tende ao nível de entretenimento — a mistura de bordas é mais suave e a correspondência de tom de pele é aproximada em vez de precisa.

Eu não o usaria para nada onde a precisão de identidade importa. Mas para verificar se um conceito funciona antes de comprometer tempo de renderização com uma ferramenta mais lenta, é o ciclo de feedback mais rápido disponível. A qualidade dos modelos varia substancialmente entre adições mais antigas e mais novas à biblioteca.

Tabela de Comparação Rápida

Duas observações sobre esta tabela: a qualidade espacial e a consistência temporal são pontuadas separadamente porque divergem significativamente entre as ferramentas nos clipes de movimento. E “tempo de renderização (gratuito)” inclui espera na fila — esse é o número que realmente afeta seu fluxo de trabalho.

Qual Ferramenta Se Encaixa em Qual Tipo de Usuário

Criadores casuais

Comece com o Magic Hour. Três trocas gratuitas, sem conta, renderização rápida. Você saberá dentro do seu primeiro teste se a qualidade de saída supera sua expectativa. Se sim, pronto. Se não, vá para o Vidwud para tentativas gratuitas ilimitadas — mais lento, mas sem marca d’água.

Editores de memes e conteúdo de formato curto

Reface para velocidade quando você está testando ideias. Vidwud para qualidade quando você está pronto para publicar. A troca é clara: 30 segundos versus 7 minutos, nível de entretenimento versus saída limpa. Escolha com base em onde você está no fluxo de trabalho, não como uma escolha permanente.

Usuários que se importam mais com realismo

Aqui está a parte que a maioria das avaliações pula: realismo consistente em um clipe de vídeo completo — identidade estável, transições de iluminação naturais, sem artefatos temporais — requer qualidade de modelo que se correlaciona diretamente com capacidade computacional. Os planos gratuitos são demonstrações, não ambientes de produção. Os planos pagos do Magic Hour, com saída de até 4K e rastreamento de precisão quadro a quadro, representam o caminho mais claro de “testando” para “qualidade de saída consistente” entre as ferramentas que avaliei. Se esse teto ainda não for suficiente para seu caso de uso, ferramentas de desktop como DeepFaceLab oferecem controle mais granular ao custo de complexidade de configuração significativa.

O Que a Maioria das Avaliações Não Menciona

Por que “gratuito” frequentemente significa fila ou limites de marca d’água

O problema do plano gratuito não é principalmente sobre limitações de recursos — é sobre priorização de capacidade computacional. Usuários gratuitos recebem renderização de menor prioridade. “Uso gratuito ilimitado” às vezes significa tempos de espera de 45 minutos em uma tarde movimentada. Nos meus testes, a fila nos horários de pico do Vidwud era de 7–9 minutos; fora dos horários de pico caía para 2–3 minutos. Essa variância importa quando você está iterando. Teste no seu horário real, não às 2h da manhã de uma terça-feira.

Por que a qualidade de exportação importa mais do que a qualidade da prévia

As ferramentas comprimem as prévias no navegador. O arquivo que você baixa é o que você publica, e os dois são frequentemente diferentes. Artefatos de distorção temporal em vídeo comprimido — o tipo produzido por pipelines de exportação de menor qualidade — interagem com a qualidade espacial de maneiras que fazem a saída final parecer pior do que qualquer quadro individual sugere. Sempre baixe uma exportação de teste e revise-a em resolução total antes de construir um fluxo de trabalho em torno de qualquer ferramenta. A prévia é marketing. O download é o produto.

Uma Nota sobre o Contexto Legal

O cenário legal em torno do conteúdo facial sintético mudou significativamente e recentemente. O TAKE IT DOWN Act, sancionado em 19 de maio de 2025, criminaliza a publicação não consensual de imagens íntimas, incluindo deepfakes gerados por IA, com plataformas cobertas obrigadas a remover conteúdo sinalizado dentro de 48 horas — e proibições criminais entrando em vigor imediatamente. O registro legislativo completo está disponível no resumo oficial do TAKE IT DOWN Act do Congress.gov.

Na UE, o cenário é diferente, mas igualmente específico. O Artigo 50 da Lei de IA da UE exige que os fornecedores de sistemas de IA que geram conteúdo de vídeo sintético garantam que as saídas sejam marcadas em um formato legível por máquina e detectáveis como geradas artificialmente. Essas obrigações entram em vigor em agosto de 2026, de acordo com os requisitos oficiais de transparência do Artigo 50 da Lei de IA da UE. Se você está publicando conteúdo com troca de rosto publicamente na Europa, esse requisito se aplica às ferramentas que geram o conteúdo — e, por extensão, à forma como você o rotula e distribui.

Todas as ferramentas neste guia são para uso criativo consensual com conteúdo sobre o qual você tem direitos. Esse enquadramento não é um texto jurídico genérico — é o escopo real dentro do qual essas ferramentas são utilizáveis sem exposição legal.

Recomendação Final

Se você só precisa de experimentos rápidos

Magic Hour primeiro — três trocas gratuitas reais, renderização rápida, sem fricção. Depois Vidwud se você precisar de mais tentativas gratuitas e puder trabalhar em torno dos tempos de fila. Entre os dois, você terá uma leitura clara sobre se a qualidade de saída atende ao seu caso de uso antes de gastar qualquer coisa.

Se você precisa de qualidade repetível

Qualidade repetível significa saída consistente em múltiplos clipes sob condições variadas — renderizações estáveis, temporização previsível, consistência temporal confiável. Isso requer um plano pago em algum momento. As atualizações do final de 2025 para o Magic Hour melhoraram a detecção de múltiplos rostos em vídeo e reduziram o atraso na sincronização labial, com a velocidade de processamento em nuvem em clipes curtos agora mais rápida e estável do que nas versões anteriores. Para qualquer pessoa construindo um fluxo de trabalho de conteúdo em vez de executar testes únicos, essa trajetória importa tanto quanto a qualidade de saída atual.

Defina seu critério mínimo de qualidade. Baixe uma exportação de teste real, não uma prévia. Compare em resolução total. Essa é a única avaliação que realmente mapeia para o que você vai publicar. Se você quiser ir além de editar clipes e começar a gerar vídeos com IA do zero, este tutorial mostra como criar vídeos com Seedance 2.0 no Wavespeed. Até logo, queridos~