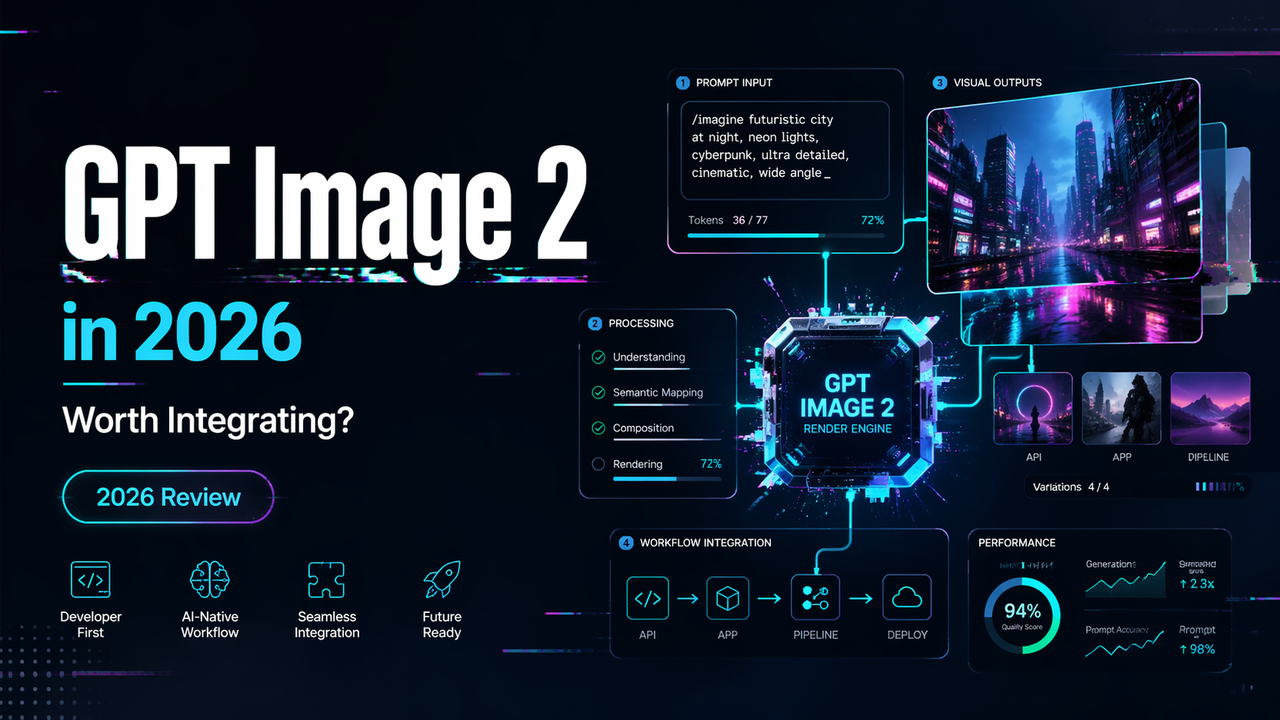

GPT Image 2 2026년: 통합할 가치가 있나?

GPT Image 2에 대한 개발자 중심 가이드로, API 액세스, 가격, 속도 제한, 편집 지원, 그리고 프로덕션 워크플로우에 사용할 준비가 되어 있는지를 다룹니다.

안녕하세요, Dora입니다. 저는 이전 모델에서 이미 운영 중이던 워크플로우에 gpt-image-2를 연결하면서 출시 이후 주말을 보냈습니다. 동일한 프롬프트, 동일한 레퍼런스 이미지, 동일한 배치 크기로 테스트했습니다. 목표는 감탄을 받으려는 게 아니었습니다. 모델 ID를 교체했을 때 실제로 무엇이 달라지는지 알아내는 것이었습니다. 저는 Dora이고, 팀에 무언가를 추천하기 전에 이런 식으로 검증하는 편입니다.

3일이 지난 지금, 기록해둘 만한 내용이 생겼습니다. 최종 평가를 내리기엔 부족하지만, 개발자들이 통합 전에 확인해야 할 사항들을 짚기엔 충분합니다.

이 글은 이미 API를 통해 이미지를 서비스 중인 분들을 위한 것입니다. 현재 운영 중인 워크플로우와 함께 gpt-image-2를 프로덕션에 추가할지 평가하고 있다면, 제가 미리 누군가에게 들었으면 했던 내용을 정리했습니다. 모델은 실재하고, API는 라이브 상태이며, 문서를 먼저 읽지 않으면 레이트 리밋에 놀랄 수 있습니다.

GPT Image 2란 무엇이며 OpenAI가 공식 출시한 것은 무엇인가

확인된 모델 ID, 엔드포인트, 출시 시점

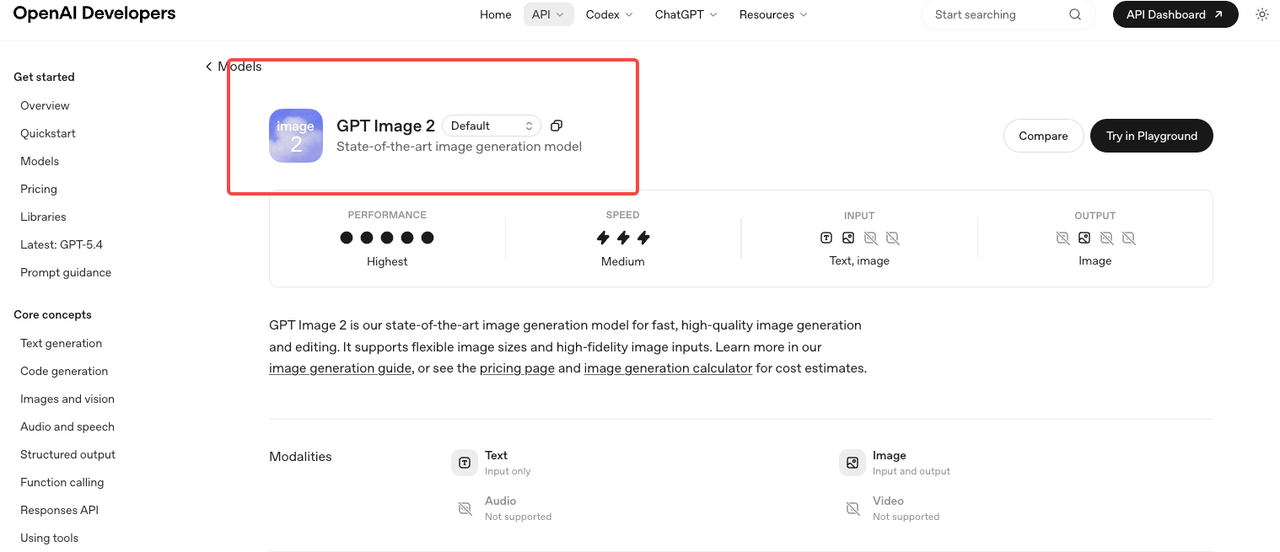

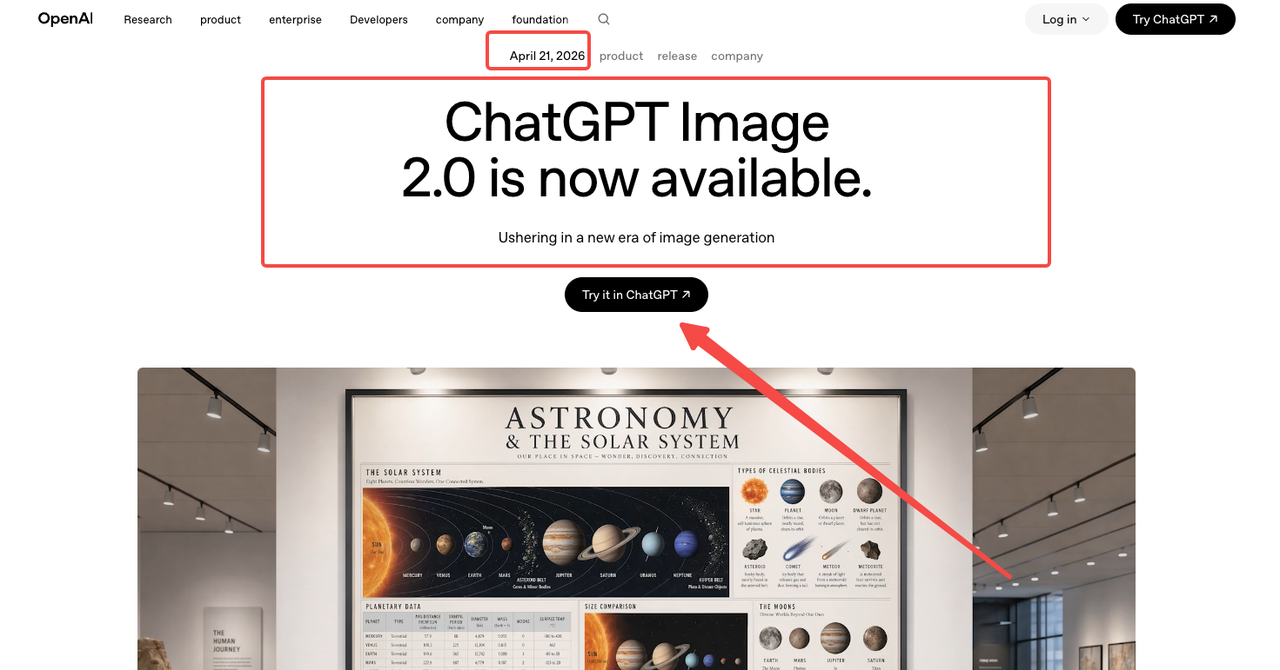

OpenAI는 2026년 4월 21일, 소비자용 “ChatGPT Images 2.0” 리브랜딩과 함께 gpt-image-2를 출시했습니다. 모델 ID는 gpt-image-2이며, 공식 GPT Image 2 모델 페이지에 따르면 현재 스냅샷은 gpt-image-2-2026-04-21로 고정되어 있습니다. v1/images/generations, v1/images/edits, v1/responses, v1/chat/completions를 통해 실행됩니다.

이것이 검증된 내용입니다. 더 이른 API 접근을 주장하는 것은 ChatGPT 내부의 A/B 테스트 트래픽이었거나 추측이었습니다. 프로덕션 코드에는 스냅샷 ID를 사용하세요 — OpenAI가 새 버전을 출시하면 별칭은 앞으로 롤링되는데, 배치 처리 도중 그런 동작이 바뀌는 건 원치 않을 것입니다.

이것이 검증된 내용입니다. 더 이른 API 접근을 주장하는 것은 ChatGPT 내부의 A/B 테스트 트래픽이었거나 추측이었습니다. 프로덕션 코드에는 스냅샷 ID를 사용하세요 — OpenAI가 새 버전을 출시하면 별칭은 앞으로 롤링되는데, 배치 처리 도중 그런 동작이 바뀌는 건 원치 않을 것입니다.

이전 GPT Image 모델에서 변경된 점

개발자에게 중요한 두 가지가 있습니다. 첫째, gpt-image-2는 추론 기능이 내장된 최초의 OpenAI 이미지 모델로, ChatGPT Images 2.0 소개 공지에서 “thinking mode(사고 모드)“라고 문서화되어 있습니다. 생성 전에 모델이 레이아웃을 계획하고, 레퍼런스를 위해 웹을 검색하며, 출력을 자체 검토할 수 있습니다. 둘째, 텍스트 렌더링이 충분히 개선되어 이전 모든 상업 모델에서 깨지던 혼합 스크립트 레이아웃이 이제 사용 가능한 결과를 생성합니다. 이는 모델 계보를 다루는 Wikipedia의 GPT Image 항목에서 확인할 수 있습니다.

두 가지 모두 직접 테스트했습니다. 추론 모드는 실재합니다. 그리고 더 느립니다.

GPT Image 2가 프로덕션 팀에 중요한 이유

편집 지원, 유연한 크기, 워크플로우 영향

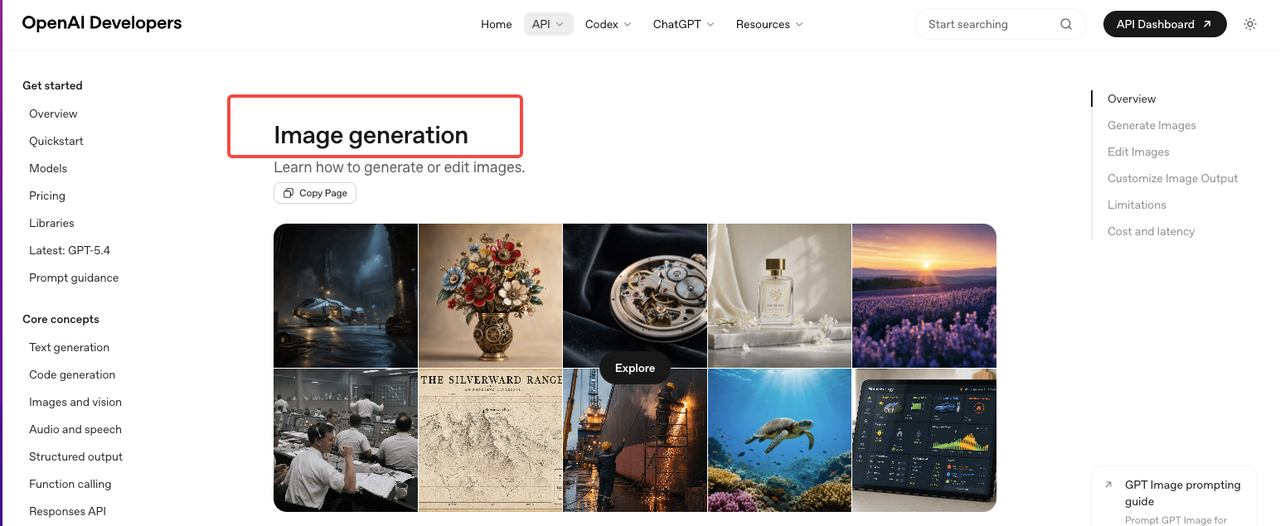

API는 생성과 편집 모두를 제공하므로, 레퍼런스 이미지와 지시사항을 한 번의 호출로 전달할 수 있습니다. 별도의 인페인팅 파이프라인이 필요 없습니다. 공식 이미지 생성 가이드에서 크기, 품질, 형식, 압축, 배경 옵션을 다루고 있습니다.

저를 곤란하게 만든 세부 사항이 하나 있습니다. 투명 배경은 현재 Responses 이미지 생성 도구 옵션을 통해서는 지원되지 않습니다. 이전 모델과 동등하다고 가정하고 배치 처리를 절반쯤 진행했을 때 이틀째 되던 날 발견했습니다. 출력이 알파 채널 대신 흰색 채우기로 돌아왔습니다. 배치 전체가 다운스트림 합성 단계에서 사용 불가능했습니다. 파이프라인이 알파 출력에 의존한다면, 모델을 교체하기 전에 실제 코드 경로에서 이를 확인하세요. 한 시간을 낭비했고, 실패한 배치에 사용된 크레딧도 날렸습니다.

생성, 편집, 정제, 내보내기의 다단계 에셋 워크플로우를 운영하는 팀에게 통합된 표면은 실질적인 핸드오프를 절약해 줍니다. 각 단계가 더 빠르기 때문이 아니라, 유지 관리할 통합이 하나 줄어들기 때문입니다. 프로덕션에서 움직이는 부품이 적을수록 나중에 문제가 발생할 곳도 줄어듭니다.

팀이 물어봐야 할 품질, 레이턴시, 롤아웃 질문

OpenAI 자체 모델 카드에 따르면 속도는 “medium(중간)“입니다. 실제로 thinking mode는 눈에 띄는 레이턴시를 추가합니다. 일회성 마케팅 에셋에는 괜찮지만, 배치 작업에는 고통스럽습니다. Non-thinking mode는 gpt-image-1.5 수준에 가깝습니다.

결정은 “더 똑똑하니까 항상 thinking mode를 사용하자”가 아닙니다. “레이아웃이 중요할 때 thinking mode를 사용하고, 속도가 중요할 때는 건너뛰자”입니다. 텍스트와 공간적 제약이 있는 목업이라면 추가적인 시간이 첫 번째 시도에서 사용 가능한 결과를 가져다 줍니다. 배경 변형 배치라면 더 빠른 경로를 원할 것입니다.

깔끔한 레이턴시 수치를 제공할 만큼 충분한 배치를 실행하지 못했습니다. 3일로는 부족합니다. 확인할 수 있는 것은: Tier 1의 콜드 패스 요청은 빠르게 스로틀링됩니다. 분당 5개의 이미지 한도는 관대하게 들리지만, 실패한 재시도와 병렬 테스트 실행이 동일한 할당량을 잠식할 때까지만 그렇습니다. 이건 모델 문제가 아닙니다. 티어 문제이며, 이것이 여러분에게 프로덕션 준비가 되었는지를 결정합니다.

통합 전에 개발자가 확인해야 할 사항

가격, 레이트 리밋, 지원되지 않는 기능

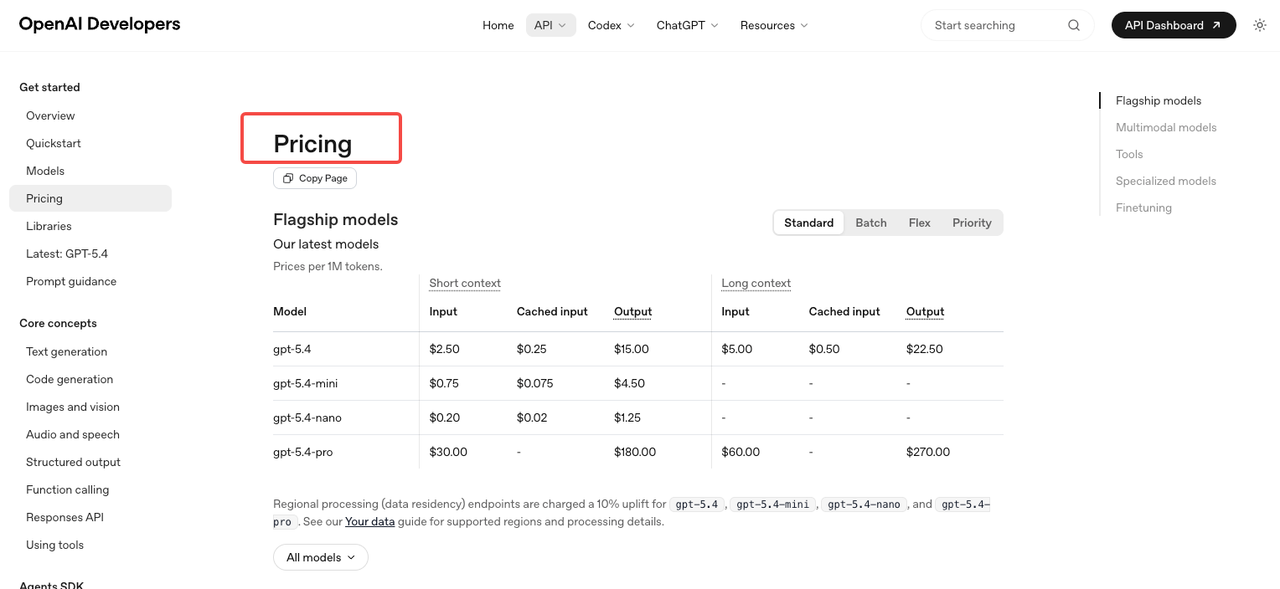

OpenAI 가격 페이지에 따른 토큰 기반 가격: 이미지 입력은 백만 토큰당 $8, 캐시된 이미지 입력은 $2, 이미지 출력은 $30입니다. 텍스트 입력은 $5, 캐시된 텍스트는 $1.25, 텍스트 출력은 $10입니다. 배치 티어는 이 가격을 절반으로 줄입니다. 계산기에서 공개된 이미지당 추정치는 1024×1024 기준으로 약 $0.006(낮은 품질), $0.053(중간), $0.211(높은 품질)입니다.

레이트 리밋은 팀들이 걸리는 부분입니다. Tier 1은 분당 5개 이미지로 제한됩니다. Tier 2는 20개, Tier 3은 50개, Tier 5는 250개로 늘어납니다. 하지만 Tier 5에 도달하려면 OpenAI 레이트 리밋 가이드에 문서화된 것처럼 $1,000 사용과 30일 이상 된 계정이 필요합니다. 제품이 버스티한 트래픽을 예상한다면, 출시 전에 티어 램프 업을 계획하세요.

프로덕션 사용을 위한 운영 질문

통합 전에 자체 워크플로우에서 확인해야 할 다섯 가지:

- 파이프라인이 투명 배경이 필요한지 (현재 Responses 도구를 통해서는 미지원)

- 현실적인 부하에서 최대 분당 이미지 수는 얼마인지

- 레퍼런스 이미지를 사용한 편집을 실행하는지 (이미지 입력 토큰이 추가됩니다 — 출력만으로 추정하지 마세요)

- 프롬프트 전략이 추론 모드의 혜택을 받는지, 아니면 non-thinking으로 충분한지

- 생성이 실패하면 어떻게 되는지 — 재시도, 폴백, 또는 큐

REST 이미지 생성 API 레퍼런스에 요청/응답 구조가 문서화되어 있습니다. 래퍼를 작성하기 전에 읽어보세요.

GPT Image 2가 강력히 적합한 경우와 그렇지 않은 경우

강력히 적합: 이미지 안에 텍스트가 나타나는 제품 (UI 목업, 인포그래픽, 메뉴, 카피가 포함된 소셜 그래픽), 비 라틴 문자의 현지화 캠페인, 생성과 편집 모두에 단일 API의 혜택을 받는 워크플로우, 이미 OpenAI 청구 관계 안에 있는 팀.

현재 약한 적합: Tier 1 또는 Tier 2 계정의 대용량 배치 파이프라인, Responses 도구를 통한 투명 배경이 필요한 제품, thinking mode 오버헤드가 중요한 레이턴시 민감 애플리케이션, 기존 모델이 이미 잘 조정되어 있고 교체 비용이 한계 품질 향상을 능가하는 팀.

이것은 “사용하지 않으면 뒤처진다”는 상황이 아닙니다. “자체 제약 조건에서 검증하라”는 상황입니다. 모델은 좋습니다. 여러분에게 좋은지는 위의 다섯 가지 질문에 달려 있습니다.

FAQ

GPT Image 2는 OpenAI API에서 사용 가능한가요?

네. 모델 ID는 gpt-image-2이며, 스냅샷은 gpt-image-2-2026-04-21입니다. 표준 이미지 생성, 이미지 편집, Responses 엔드포인트를 통해 접근 가능합니다. 무료 티어는 지원되지 않습니다. 유료 계정이 필요하며, 레이트 리밋은 사용 티어에 따라 확장됩니다.

GPT Image 2는 어떤 이미지 작업에 가장 적합한가요?

이미지 안에 텍스트가 포함된 모든 것 (메뉴, 목업, 인포그래픽, 다국어 그래픽), 레퍼런스 기반 편집, 공간적 추론이 필요한 레이아웃에 적합합니다. 텍스트 렌더링이 가장 실질적으로 의미 있는 업그레이드입니다. 텍스트 없는 순수 사실적 생성의 경우 gpt-image-1.5 대비 향상 폭이 작습니다.

팀이 먼저 확인해야 할 제한 사항은 무엇인가요?

세 가지 구체적인 사항: 투명 배경이 Responses 이미지 생성 도구 옵션을 통해 지원되지 않으며, Tier 1은 분당 5개 이미지로 생성을 제한하고, 추론 모드는 레이턴시를 추가합니다. 또한 확인할 가치가 있는 것은 스트리밍, 함수 호출, 구조화된 출력이 모델 페이지에서 지원되지 않는 것으로 나열되어 있다는 점입니다.

대용량 프로덕션 사용에 준비되어 있나요?

가능하지만, 새 계정에서는 아닙니다. Tier 3(분당 50개 이미지)에 도달하려면 $100 사용과 최소 7일 이상 된 계정이 필요합니다. Tier 5(분당 250개)는 $1,000 사용과 30일 계정 이력이 필요합니다. 첫날부터 높은 동시성이 필요하다면, 티어 진행을 계획하거나 더 높은 풀링 한도를 가진 제공업체를 사용하세요.

GPT Image 1.5와 가격을 어떻게 비교하나요?

gpt-image-2는 토큰당 청구를 사용합니다: 이미지 입력 $8/M, 이미지 출력 $30/M. 이미지당 추정치(1024×1024)는 낮은 품질 $0.006, 중간 $0.053, 높은 품질 $0.211 수준입니다. 레퍼런스 이미지를 사용한 편집은 이미지 입력 토큰을 추가하므로, 출력만의 추정치보다 비용이 높습니다. 1.5와 동등하다고 가정하기 전에 실제 워크로드를 계산기에서 실행해 보세요.

결론

3일간의 테스트로는 장기적인 신뢰성에 대한 평가를 내리기에 충분하지 않습니다. 하지만 모델이 실재하고, API가 안정적이며, 통합 질문이 기술적이기보다는 운영적이라고 말하기엔 충분합니다. 가격 티어, 레이트 리밋, 워크플로우가 의존할 수 있는 누락된 기능들이 그것입니다. 커밋하기 전에 실제 프롬프트와 실제 동시성으로 소규모 파일럿을 실행하세요. 이것이 여기서 확인할 수 있는 전부입니다. 나머지는 자체 환경에서 검증해야 합니다.

데이터를 신뢰할 수 있을 만큼 충분히 쌓이면 다음 주에 배치 레이턴시 수치를 이어서 공유하겠습니다.

이전 포스트: