SeedVR2 Online: Cómo Usarlo

Aprende cómo funciona SeedVR2 online, qué flujos de trabajo admite y qué esperar antes de usarlo para tareas de escalado.

Hola, soy Dora. Alguien mencionó SeedVR2 en un hilo de Discord que estaba siguiendo. Dijeron que lo habían “usado en línea”. Así que busqué. E inmediatamente me topé con una pared de demos de Gradio, wrappers de terceros, playgrounds de API, y al menos un sitio de aspecto sospechoso que definitivamente no tenía relación con el equipo de investigación de ByteDance.

Aquí está lo que nadie dice de entrada: no existe un único producto “SeedVR2 Online”. Esa frase significa al menos tres cosas diferentes según dónde aterrices. Y si no sabes cuál estás usando realmente, tus resultados —y tus expectativas— estarán desencaminados.

Déjame aclarar esto.

Qué Significa Normalmente “SeedVR2 Online”

SeedVR2 es un modelo de restauración de vídeo desarrollado por el equipo ByteDance Seed. Fue aceptado en ICLR 2026 y el código de investigación está disponible públicamente. Es un Diffusion Transformer de un solo paso diseñado para restauración genérica de vídeo, capaz de manejar entradas de alta resolución mediante un mecanismo de atención de ventana adaptativa. Eso es lo real.

Pero “SeedVR2 online” como frase de búsqueda arroja algo diferente al modelo en sí. Una confusión similar ocurre con los modelos de generación de vídeo con IA más nuevos como Seedance 2.0, donde la gente frecuentemente busca una “versión online” en lugar del modelo subyacente. Arroja puntos de acceso al modelo. Y no son lo mismo.

Demo Alojado, Wrapper o Servicio de Flujo de Trabajo

Cuando alguien dice que usó SeedVR2 online, probablemente se refiere a uno de estos:

Un demo de Gradio alojado. ByteDance publicó un demo oficial en Hugging Face Spaces. Ejecuta el modelo SeedVR2-3B y admite tanto imágenes como entradas de vídeo a través de una interfaz estilo API. Esto es lo más cercano a una versión “oficial” en línea — pero es un demo de investigación, no un producto. Los tiempos de cola pueden ser largos. La disponibilidad no está garantizada.

Un wrapper de terceros. Los desarrolladores han creado nodos de ComfyUI, despliegues en Replicate y herramientas independientes alrededor del mismo modelo subyacente. Estos se ejecutan en la infraestructura de otra persona, a veces gratis, a veces con créditos o paywalls. Pueden parecer pulidos. No son productos de ByteDance.

Una integración en plataforma. Algunas plataformas de generación con IA han añadido SeedVR2 como una opción en su catálogo de modelos. Estás ejecutando los mismos pesos del modelo, pero a través de la interfaz y el sistema de facturación de otra persona.

Por Qué los Usuarios Se Confunden Sobre lo que es “Oficial”

La confusión es comprensible. Una incertidumbre similar aparece cuando la gente lee comparaciones entre modelos modernos de vídeo con IA y asume que cada uno tiene una única interfaz oficial. El modelo es de código abierto bajo Apache 2.0. Eso significa que cualquiera puede alojarlo, envolverlo y llamarlo SeedVR2. No existe ninguna barrera de marca registrada ni proceso de certificación.

Así que cuando buscas “SeedVR2 online”, podrías llegar a:

- El Hugging Face Space real gestionado por ByteDance-Seed

- Un despliegue de ComfyUI de la comunidad

- Un servicio de mejora de vídeo de terceros que resulta usar SeedVR2 como motor

- Algo que tiene SeedVR2 en el nombre pero no está relacionado

Antes de subir tu material, vale la pena invertir 30 segundos comprobando en cuál de estos estás realmente.

Cuándo Vale la Pena Probar SeedVR2 Online

Seré directa. El acceso en línea a SeedVR2 tiene sentido en situaciones específicas. Fuera de ellas, puede frustrar más de lo que ayuda.

Pruebas Rápidas

Si has visto ejemplos de resultados y quieres saber si el estilo del modelo encaja con tu material de vídeo, pruébalo en línea primero. No necesitas instalar nada. No necesitas una GPU. Puedes subir un clip corto y ver qué devuelve.

Esto es genuinamente útil. Probé el demo de Hugging Face con un fragmento corto de material degradado que tenía pendiente de limpiar. El tiempo de respuesta fue lento, pero el resultado me dio toda la información que necesitaba antes de comprometerme con una configuración local.

Sin Necesidad de Configuración Local

Ejecutar SeedVR2 localmente requiere hardware serio. La documentación oficial señala que una GPU H100-80GB puede manejar vídeos a 720p de hasta 100 fotogramas, y se necesitan cuatro tarjetas H100-80GB para resolución 1080p o 2K. La mayoría de la gente no tiene eso. El acceso en línea salva esa brecha —a costa de flexibilidad, velocidad y control.

Si eres un creador que solo necesita limpieza ocasional de vídeo sin construir un pipeline local, las opciones en línea son razonables de explorar.

Cómo Usar SeedVR2 Online

Conceptos Básicos de Entrada y Salida

La mayoría de los puntos de acceso en línea siguen el mismo patrón general:

- Sube tu vídeo fuente (normalmente MP4, a veces fotogramas)

- Establece una resolución objetivo o multiplicador de escala

- Envía y espera

El resultado es una versión restaurada de tu clip —más nítida, con ruido y artefactos de compresión reducidos, escalada a tu resolución objetivo.

Lo que probablemente no podrás controlar en línea: el tamaño de lote, el tamaño de la ventana de atención, la variante del modelo (3B vs 7B), ni las opciones de postprocesado como la corrección de color wavelet. Esas configuraciones viven en las herramientas locales.

Ajustes a los que Prestar Atención

Si la interfaz te ofrece opciones, algunas merecen ser comprendidas:

Resolución objetivo. El modelo está diseñado para salida de alta resolución. No introduzcas un objetivo inferior a tu fuente —obtendrás un procesado innecesario sin ganancia visual.

Modo de corrección de color. Algunos wrappers exponen esto. La implementación de ComfyUI ofrece varias opciones de coincidencia de color, incluyendo un modo “lab” descrito como coincidencia de color perceptual completa para mayor fidelidad al original, y un modo “wavelet” para colores naturales basados en frecuencia. Si ves estas opciones, “wavelet” suele ser la elección más segura para material desconocido.

Duración del clip. Mantén tus clips de prueba cortos —menos de 30 segundos si puedes. Los clips largos ralentizan la cola para todos y son más difíciles de depurar si algo parece incorrecto.

Qué Puedes y No Puedes Esperar de Él

Límites de Rendimiento

Las herramientas en línea tienen restricciones. Especialmente las gratuitas. Si estás en un demo compartido alojado en cómputo limitado, espera:

- Colas durante las horas pico

- Tiempos de procesado de varios minutos incluso para clips cortos

- Tiempos de espera ocasionales o trabajos perdidos

Esto es un problema de cola e infraestructura, no del modelo.

Expectativas de Calidad

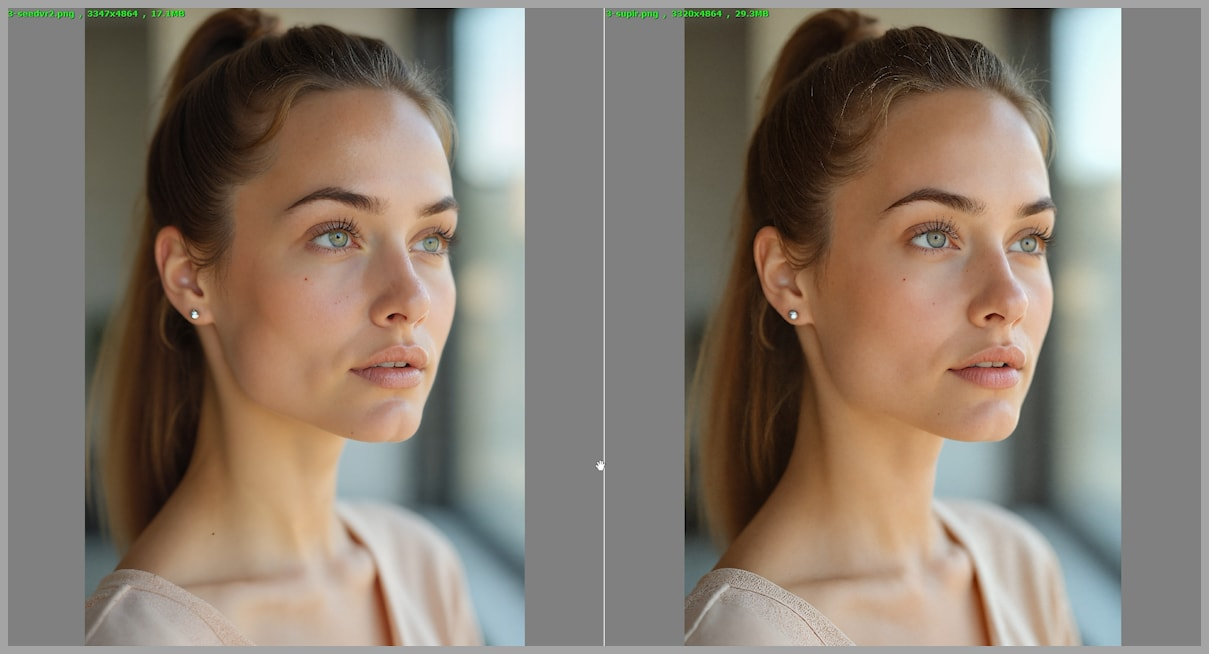

El modelo en sí es capaz. La propia ficha del modelo de ByteDance-Seed señala que a veces puede generar detalles en exceso en entradas con degradaciones muy leves —por ejemplo, vídeos AIGC a 720p—, lo que conduce ocasionalmente a resultados con sobrenitidez. Los artefactos de movimiento también pueden aparecer en los pipelines de vídeo generativo, razón por la que muchos creadores aprenden cómo los creadores corrigen el parpadeo y el jitter en el vídeo generado con IA cuando trabajan con modelos de restauración. Esa es una limitación real que vale la pena conocer antes de procesar cualquier cosa que te importe.

Para material con degradación genuina —ruido, desenfoque, artefactos de compresión— los resultados suelen ser notablemente mejores. Para material ya limpio, el modelo podría hacer que las cosas luzcan menos naturales.

Por Qué el Uso Online No Es lo Mismo que el Uso en Flujo de Trabajo Completo

La brecha es significativa. Los despliegues locales a través de ComfyUI, por ejemplo, te permiten controlar el tamaño de lote, cambiar entre las variantes de modelo 3B y 7B, habilitar la cuantización GGUF para menor uso de VRAM, y encadenar SeedVR2 con otros nodos en un pipeline. Ese nivel de control no existe en la mayoría de las interfaces en línea.

Si estás construyendo un proceso repetible —digamos, procesar material de una sesión de grabación regular— el acceso en línea llegará rápidamente a su límite.

SeedVR2 Online vs API vs Configuración de Flujo de Trabajo

| Categoría | Demo Online | API / Plataforma | Flujo de Trabajo Local |

|---|---|---|---|

| Configuración requerida | Ninguna | Mínima | Significativa |

| Velocidad | Lenta (compartida) | Media | Rápida (tu GPU) |

| Control | Bajo | Medio | Alto |

| Coste | Gratis / Créditos | Pago por uso | Coste de hardware |

| Fiabilidad | Variable | Más estable | Estable |

| Procesado por lotes | No | A veces | Sí |

Mejor para Uso Rápido

Los demos en línea y las plataformas alojadas tienen sentido para pruebas puntuales, comparaciones rápidas y situaciones en las que no tienes acceso a una máquina local capaz. El SeedVR2-3B Hugging Face Space alojado por ByteDance-Seed es lo más cercano a un punto de contacto oficial si quieres probar el modelo sin comprometerte con nada.

Mejor para Uso en Producción Repetible

Si procesas material de vídeo regularmente, el nodo ComfyUI-SeedVR2_VideoUpscaler es la herramienta con la que más creadores han terminado. Está construido por la comunidad pero se mantiene activamente, con soporte de cuantización GGUF que lo hace accesible en GPUs de consumidor. Como referencia, los pesos oficiales del modelo y los detalles de arquitectura están documentados en el repositorio ByteDance-Seed/SeedVR en GitHub.

Veredicto de Primera Mano

He ejecutado SeedVR2 tanto a través del demo de Hugging Face como localmente a través de ComfyUI. No son la misma experiencia.

El demo en línea es útil para exactamente una cosa: decidir si SeedVR2 vale tu tiempo. Respondió esa pregunta en una sola sesión. Pero no lo usaría para nada que realmente necesite publicar.

Quién Debería Probarlo

Tú, si:

- Quieres probar si el modelo se adapta a tu material antes de instalar nada

- Restauras un clip de vez en cuando y no necesitas un pipeline repetible

- No tienes recursos GPU locales y estás bien con tiempos de respuesta más lentos

Quién Debería Saltárselo

Tú, si:

- Procesas más de un puñado de clips por semana

- Necesitas resultados consistentes que puedas reproducir

- Te importa controlar la nitidez de salida, la coincidencia de color o el tamaño del modelo

Para cualquiera que esté seriamente interesado en dónde se sitúa este modelo en el panorama de investigación, el artículo original de SeedVR2 en arXiv (2506.05301) merece una lectura —es más accesible que la mayoría de los artículos académicos y explica claramente el enfoque de restauración en un solo paso.

La frase “SeedVR2 online” probablemente seguirá confundiendo a la gente durante un tiempo. No hay un único producto al que señalar. Hay un modelo, algunos demos oficiales y un número creciente de herramientas de la comunidad construidas a su alrededor. Eso no es malo —simplemente significa que necesitas saber por qué puerta estás entrando realmente antes de decidir si vale tu tiempo. ¡Hasta pronto, queridos!~