GLM-5V-Turbo: Was Entwickler 2026 wissen sollten

GLM-5V-Turbo ist das Vision-Coding-Modell von Z.ai. Hier erfahren Entwickler alles Wichtige über API, Preise, Limits und reale Anwendungsfälle im Jahr 2026.

Ein Kollege schickte mir letzte Woche einen Screenshot — links ein Design-Mockup, rechts eine nahezu pixelgenaue HTML-Reproduktion. „GLM-5V-Turbo hat das in einem Durchlauf gemacht”, stand in der Bildunterschrift. Ich habe es zur Kenntnis genommen und weitergemacht. Dann sah ich das Modell immer wieder im Zusammenhang mit agentischen Workflow-Tools erwähnt und beschloss, mir tatsächlich anzusehen, was dieses Modell ist und was nicht.

Das habe ich herausgefunden — geschrieben für Entwickler, die multimodale Modelle für agentische Coding-Anwendungsfälle evaluieren, nicht für jemanden, der eine Produktempfehlung sucht.

Was ist GLM-5V-Turbo?

Z.ai (Zhipu AI) und die GLM-Modellfamilie

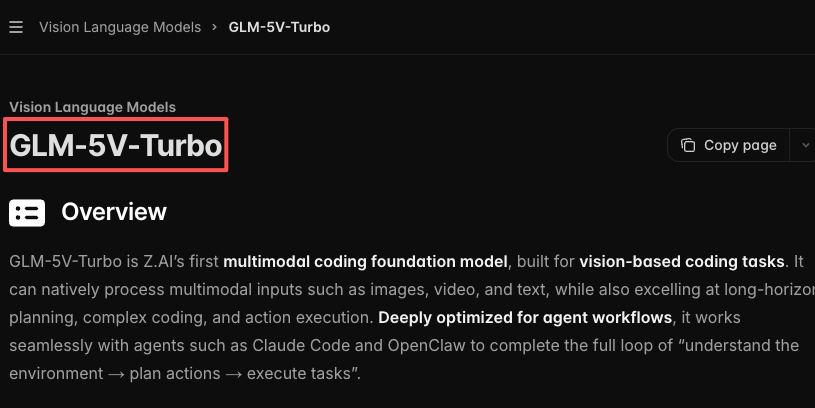

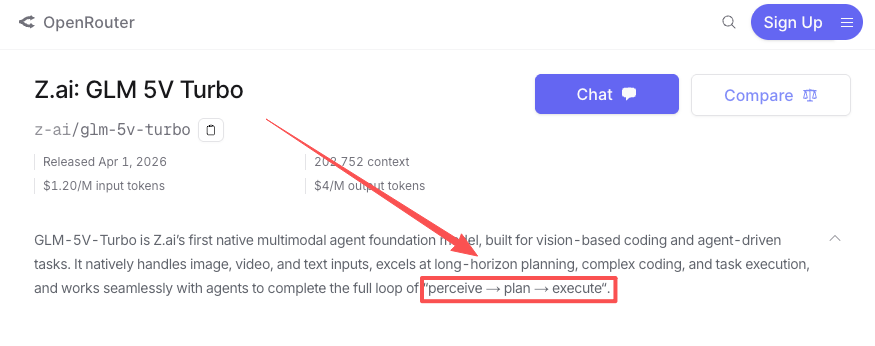

GLM-5V-Turbo ist ein Vision-Language-Modell, das am 1. April 2026 von Zhipu AI veröffentlicht wurde und international unter der Marke Z.ai agiert. Zhipu ist ein in Peking ansässiges KI-Labor — seit Januar 2026 an der Hongkonger Börse notiert — und einer der produktivsten Anbieter von Foundation Models in China. Ihre GLM-Serie hat sich schnell weiterentwickelt: GLM-4.5 im Juli 2025, GLM-4.7 im Dezember, GLM-5 im Februar 2026 und nun eine multimodale Variante im April.

GLM-5V-Turbo ist das erste Modell der Familie, das als nativer multimodaler Agent konzipiert wurde — das bedeutet, Vision wurde nicht nachträglich hinzugefügt, sondern war von Anfang an Teil der Architektur. Diese Unterscheidung ist entscheidend dafür, wofür das Modell tatsächlich geeignet ist.

Wie sich GLM-5V-Turbo von GLM-4V und GLM-5 unterscheidet

GLM-4V verarbeitete Bildeingaben. GLM-5 verbesserte Text-Coding und Reasoning. GLM-5V-Turbo kombiniert multimodale Eingaben (Bild, Video, Text) mit agentenorientierter Ausgabe: Tool-Calling, Aufgabenzerlegung und GUI-Interaktion. Es basiert auf einem neuen visuellen Encoder namens CogViT, verwendet Reinforcement Learning über 30+ Aufgabentypen und nutzt INT8-Quantisierung für schnellere Inferenz.

Die Positionierung ist bewusst eng. Dies ist kein allgemeines Upgrade von GLM-5. Es handelt sich um ein spezialisiertes Modell für Aufgaben, die mit visuellem Input beginnen und mit Code oder strukturierten Aktionen enden.

Kernfähigkeiten

Design-to-Code und UI-Generierung

Die Hauptfähigkeit ist die Reproduktion von UI-Designs als funktionierenden Frontend-Code. Geben Sie dem Modell ein Mockup — Screenshot, Figma-Export, handgezeichnete Skizze — und es generiert HTML, CSS und manchmal JavaScript. In Z.ais eigenen Tests erzielte GLM-5V-Turbo 94,8 auf dem Design2Code-Benchmark gegenüber Claude Opus 4.6’s 77,3. Das ist ein bedeutsamer Unterschied, wenn der Benchmark unabhängigen Tests standhält (dazu weiter unten mehr).

In der Praxis ist dies am nützlichsten für Frontend-Scaffolding: Design-Spezifikationen in initialen Komponenten-Code umwandeln, bestehende UI-Layouts für Migrationsprojekte reproduzieren oder Variationen aus einem Referenzbild generieren.

GUI-Agent und Unterstützung agentischer Workflows

Über die statische Design-Reproduktion hinaus unterstützt das Modell GUI-Agent-Aufgaben — Navigation in Browser-Oberflächen, Extraktion strukturierter Daten von Bildschirmen und Ausführung mehrstufiger Workflows mit visuellem Zustand. Die Modellseite von OpenRouter beschreibt es als gebaut, um „den vollständigen Kreislauf von Wahrnehmen → Planen → Ausführen abzuschließen”, und die von Z.ai zitierten AndroidWorld- und WebVoyager-Benchmark-Ergebnisse deuten darauf hin, dass es reale GUI-Navigation bewältigen kann, nicht nur synthetische Tests.

Für Teams, die agentische Workflows mit einer visuellen Ebene aufbauen — Formularausfüllungsautomatisierung, UI-Test-Agenten, Screen-to-Action-Pipelines — liegt hier der praktische Anspruch des Modells. Die Tool-Calling-Verbesserungen in GLM-5V-Turbo (von GLM-5-Turbo geerbt und erweitert) sind explizit darauf ausgelegt, fehlgeschlagene Aufrufe in Agent-Loops zu reduzieren.

Multimodale Eingabeverarbeitung

Das Modell akzeptiert Bilder, kurze Videoclips und Text im gleichen Kontext. Video-Eingaben erweitern die Anwendungsfälle auf Bildschirmaufzeichnungen und Produkt-Walkthroughs — das Modell kann visuell mitverfolgen und Dokumentation oder Aktionspläne aus dem Gesehenen generieren. Das Kontextfenster beträgt 202.752 Token mit einer maximalen Ausgabe von 131.072 Token, bestätigt auf der offiziellen Preisseite von Z.ai.

API-Zugang und Preise

Wie man auf GLM-5V-Turbo über die API zugreift

Das Modell ist über Z.ais API mit einer OpenAI-kompatiblen Schnittstelle verfügbar. Die Authentifizierung folgt Standard-API-Key-Mustern — bei z.ai registrieren, einen Schlüssel generieren, ihn in Ihrem vorhandenen Tooling konfigurieren.

Die API unterstützt Function Calling, Streaming und strukturierte Ausgabe — dieselbe Funktionspalette wie GLM-5-Turbo, erweitert um visuelle Eingaben.

Preise: Kosten für Input- und Output-Token

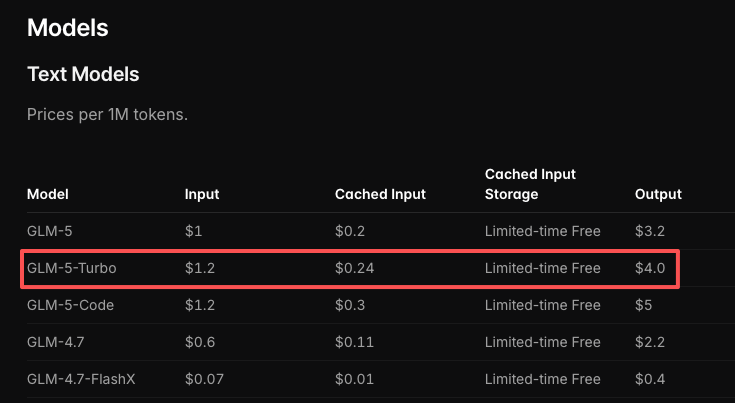

| GLM-5V-Turbo | GLM-5-Turbo | GLM-5 | |

|---|---|---|---|

| Eingabe (pro 1M Token) | $1,20 | $1,20 | $1,00 |

| Ausgabe (pro 1M Token) | $4,00 | $4,00 | $3,20 |

| Gecachte Eingabe | $0,24 | $0,24 | $0,20 |

Zahlen entnommen von der offiziellen Z.ai-Preisseite Stand April 2026. Vor der Planung von Produktionsbudgets direkt verifizieren — Z.ai hat die Preise bei früheren Modell-Launches angepasst.

Zum Vergleich: Claude Opus 4.6 kostet $5/M Eingabe und $25/M Ausgabe. GPT-4o ist $2,50/$10. Bei $1,20/$4 ist GLM-5V-Turbo für vision-intensive Workloads mit bescheidenem Ausgabevolumen deutlich günstiger.

Kontextfenster und Ausgabelimits

- Kontextfenster: 202.752 Token

- Maximale Ausgabe: 131.072 Token

Beide sind großzügig bemessen. Für die meisten Design-to-Code- oder GUI-Agent-Aufgaben werden Sie diese Limits nicht erreichen. Lange Videosequenzen oder sehr große Design-Dateien könnten es jedoch — daher lohnt es sich, mit Ihren tatsächlichen Eingaben zu testen, bevor Sie sich festlegen.

Wo es passt (und wo nicht)

Stärken: Visuelles Coding, Design-Reproduktion

GLM-5V-Turbos praktischer Vorteil ist spezifisch: Aufgaben, bei denen man etwas ansehen und daraus Code produzieren muss. Frontend-Scaffolding aus Design-Assets, UI-Komponentenextraktion, Screenshot-to-HTML, Analyse von Bildschirmaufzeichnungen. Wenn Ihre Pipeline mit einem visuellen Artefakt beginnt und mit Code endet, lohnt es sich, dieses Modell gegen Ihre aktuelle Lösung zu benchmarken.

Die Unterstützung agentischer Workflows ist ein echter Mehrwert. Die Stabilität des Tool-Callings ist in Produktions-Agent-Loops wichtig — fehlgeschlagene Aufrufe unterbrechen Ketten und erfordern Wiederholungen. Z.ais erklärter Fokus darauf in GLM-5V-Turbo ist ein Zeichen dafür, dass sie denselben Fehlermodus gesehen haben, den jeder beobachtet, der Agenten baut.

Einschränkungen: Reines Text-Backend-Coding, Allgemeines Reasoning

Das ist der Teil, bei dem Klarheit wichtig ist. GLM-5V-Turbo ist kein direkter Konkurrent zu Claude oder GPT-4o für Backend-Coding, Repository-Erkundung oder allgemeine Reasoning-Aufgaben. In diesen Kategorien führt Claude Opus 4.6 laut Z.ais eigenen Vergleichen übergreifend — und das ist das Unternehmen, das den günstigen Fall für ihr Modell macht.

Wenn Ihre Coding-Arbeit primär Text-ein, Text-aus ist — Debugging-Logik, Schreiben von API-Integrationen, Refactoring von Backend-Code — wird Ihnen ein reines Textmodell wie GLM-5 oder GLM-5-Turbo zum gleichen Preis besser dienen. Das Hinzufügen eines visuellen Encoders hilft nicht bei Problemen, die keine visuelle Eingabe beinhalten.

Wer sollte es nutzen und wer sollte es überspringen

Lohnt sich die Evaluierung, wenn Sie:

- Frontend-Tooling aufbauen, das von Design-Assets ausgeht

- GUI-Agent-Workflows mit visuellem Zustand betreiben

- Eine günstigere Alternative zu GPT-4V oder Claude für Image-to-Code-Aufgaben suchen

- Multimodale Eingaben in einer Agent-Pipeline testen

Wahrscheinlich überspringen, wenn Sie:

- An reinem Text-Coding arbeiten — Backend, CLI-Tooling, API-Entwicklung

- Starkes allgemeines Reasoning neben der Code-Generierung benötigen

- Unter Datenschutzanforderungen operieren (Z.ai ist ein chinesisches Unternehmen; prüfen Sie deren Datenschutzrichtlinie gegen Ihre Compliance-Anforderungen)

Benchmark-Behauptungen — Was ernst zu nehmen ist

Design2Code-Leistung

Z.ai berichtet, dass GLM-5V-Turbo 94,8 auf Design2Code gegenüber Claude Opus 4.6‘s 77,3 erzielt hat. Das sind Z.ais eigene Messungen. Kein unabhängiges Evaluierungslabor hat zum Zeitpunkt des Schreibens bestätigende Ergebnisse veröffentlicht. Das bedeutet nicht, dass die Zahlen falsch sind — es bedeutet, dass sie noch nicht einem Stresstest unterzogen wurden.

Design2Code als Benchmark misst, wie genau das generierte HTML/CSS ein Referenz-Mockup reproduziert, pixel- und strukturmäßig. Es ist ein vernünftiger Proxy für die spezifische Aufgabe der UI-Reproduktion. Es ist kein Proxy für allgemeine Coding-Qualität, architektonisches Urteilsvermögen oder reale Produktionsreife.

Der Unterschied ist groß genug, um als Richtungssignal glaubwürdig zu sein. Betrachten Sie es als Grund zum Testen, nicht als Schlussfolgerung.

Vorbehalte beim Vergleich mit reinem Text-Coding

Z.ais Dokumentation räumt ein, dass GLM-5V-Turbo Claude in reinen Text-Coding-Benchmarks hinterherhinkt. Diese Offenheit ist nützlich. Sie bedeutet, dass die Positionierung des Modells ehrlich ist: Dies ist ein visuell-erstes Werkzeug, kein allgemeines Coding-Upgrade. Jeder Vergleich, der GLM-5V-Turbo als generell wettbewerbsfähig mit Frontier-Textmodellen darstellt, liest falsch, was das Unternehmen tatsächlich behauptet.

FAQ

F: Ist GLM-5V-Turbo über eine API verfügbar?

Ja. Über Z.ais native API (OpenAI-kompatibel) und über OpenRouter. Standard-API-Key-Einrichtung, unterstützt Function Calling und Streaming.

F: Was kostet GLM-5V-Turbo?

$1,20 pro Million Eingabe-Token, $4,00 pro Million Ausgabe-Token, Stand April 2026. Vor dem Produktionseinsatz unter docs.z.ai/guides/overview/pricing verifizieren.

F: Wie vergleicht sich GLM-5V-Turbo mit GPT-4o und Claude beim Coding?

Für Design-to-Code und visuelle UI-Aufgaben: Z.ais Benchmarks (selbst berichtet) zeigen es vor beiden. Für reines Text-Coding und Backend-Arbeit: Claude Opus 4.6 führt. Der Vergleich gilt nur im visuellen Bereich.

F: Unterstützt GLM-5V-Turbo Video-Eingaben?

Ja — kurze Videoclips zusammen mit Bildern und Text im gleichen Kontext. Nützlich für Bildschirmaufzeichnungen und walkthrough-basierte Dokumentationsgenerierung.

F: Was sind die Rate Limits und das Kontextfenster?

Das Kontextfenster beträgt 202.752 Token, maximale Ausgabe 131.072 Token. Rate Limits sind in der offiziellen Dokumentation nicht veröffentlicht — Z.ai hatte bei früheren Modell-Launches Kapazitätsprobleme, also testen Sie den Durchsatz unter realer Last, bevor Sie sich auf eine Produktionsarchitektur festlegen.

Design-to-Code ist eine wirklich nützliche Aufgabenkategorie, und ein Modell zu haben, das es als erstklassiges Problem behandelt — statt als Nebenfähigkeit eines allgemeinen Modells — ist eine vernünftige Engineering-Entscheidung. Ob GLM-5V-Turbo das in Ihrer spezifischen Pipeline erfüllt, können nur Ihre eigenen Testdaten beantworten.

Die Benchmark-Zahlen sind einen Blick wert. Die unabhängige Verifizierung steht noch aus.

Preise und Spezifikationen wurden gegen die offizielle Z.ai-Dokumentation Stand 2. April 2026 verifiziert. Alle Benchmark-Zahlen sind selbst gemeldete Daten von Z.ai, sofern nicht anders angegeben — als vorläufig behandeln, bis unabhängig validiert.

Vorherige Beiträge: