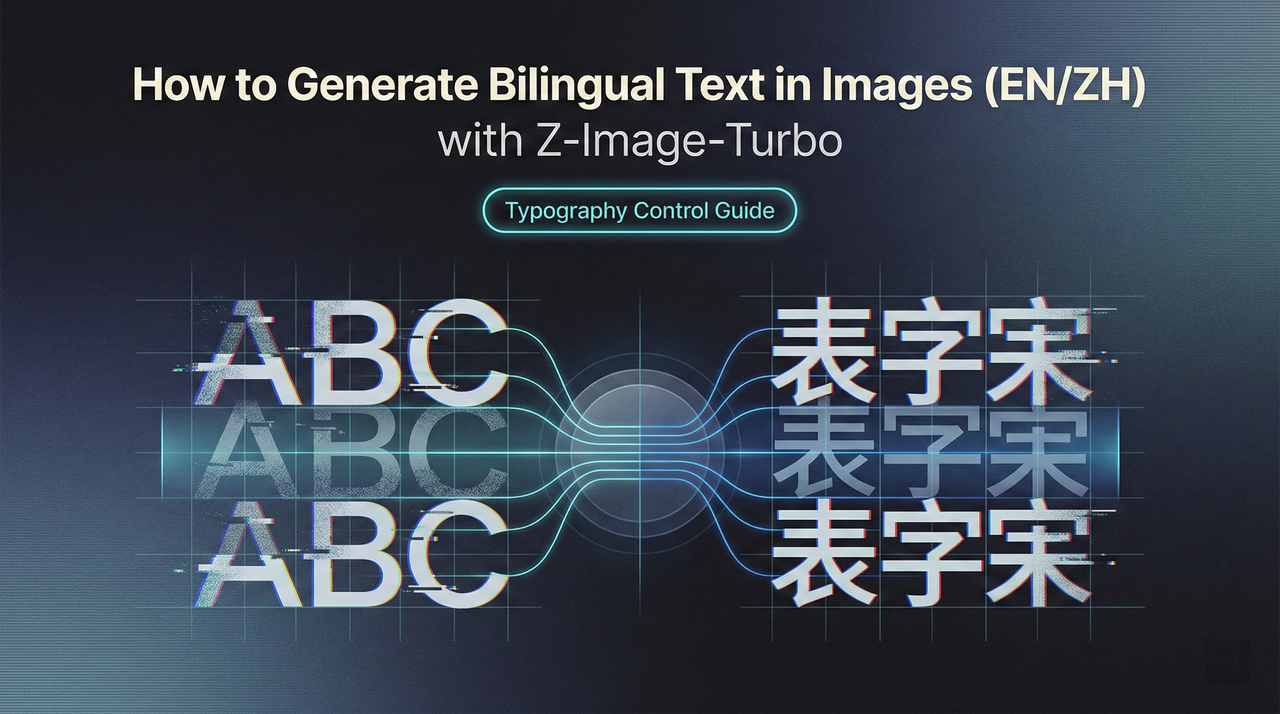

So generieren Sie zweisprachigen Text in Bildern (EN/ZH) mit Z-Image-Turbo

Z-Image-Turbo rendert nativ englischen und chinesischen Text in Bildern. Lernen Sie Prompting-Techniken für Poster, Produktetiketten und Marketingmaterialien mit präziser Typografie.

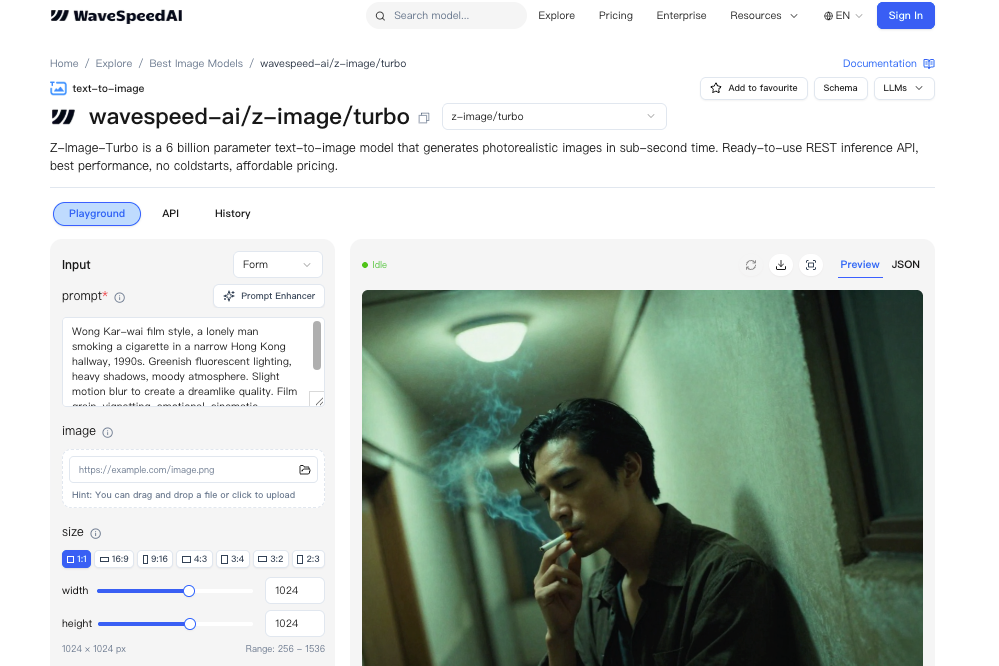

Hey, ich bin Dora. Diese Woche brauchte ich ein sauberes Produkt-Mockup mit einem kleinen zweisprachigen Label – zwei Wörter auf Englisch, zwei auf Chinesisch – und ich wollte Figma nicht zum fünften Mal an diesem Morgen öffnen. Also habe ich Z-Image-Turbo erneut ausprobiert. Ich hatte es schon für schnelle Konzeptbilder verwendet, war aber neugierig: Könnte es echten, lesbaren EN/ZH-Text in ein Bild einfügen, ohne die Buchstaben in Buchstabensuppe zu verwandeln?

Kurze Antwort: oft ja. Nicht immer. Aber wenn es klappt, spart es überraschend viel mentale Energie. Unten sind meine Notizen aus einer Handvoll Sitzungen: Was bei mir zuverlässig funktioniert hat, wo es ins Stolpern geraten ist, und die Prompts, die den Unterschied gemacht haben, wenn man zweisprachigen Text in Bildern mit Z-Image-Turbo generieren möchte.

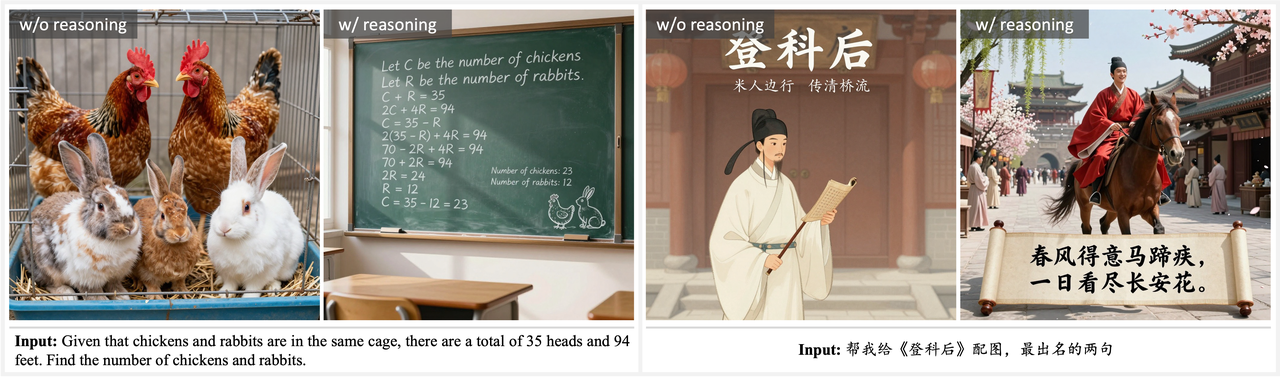

Z-Image-Turbos Textwiedergabe-Fähigkeit

Zweisprachiges Prompt-Verständnis

Was mir zuerst auffiel: Ich musste die Sprachmischung nicht übermäßig erklären. Z-Image-Turbo versteht Prompts auf Englisch und Chinesisch und kann mehrsprachigen Text direkt im Bild rendern. Wenn ich einen einzelnen Prompt mit englischen und chinesischen Phrasen in Anführungszeichen schrieb – zum Beispiel „CALM TEA” und „静茶” –, berücksichtigte Z-Image-Turbo in der Regel beide. Es schien jede Phrase als Einheit zu behandeln, nicht als zufällige Zeichen. Wenn ich eine kurze erklärende Klammer wie (Englisch + Vereinfachtes Chinesisch) hinzufügte, verbesserten sich die Treffer etwas. Ich meine keinen dramatischen Sprung, nur genug, um sich weniger vom Glück abhängig zu fühlen.

In der Praxis sah ich weniger unleserliche Striche, wenn ich chinesische Zeichenketten kurz und gebräuchlich hielt. Alltagswörter hielten besser stand als poetische Zeilen oder seltene Schriftzeichen. Zeichensetzung spielte ebenfalls eine Rolle: Typografische Sonderzeichen brachten das Modell manchmal aus dem Takt. Einfache gerade Anführungszeichen funktionierten besser als typografische.

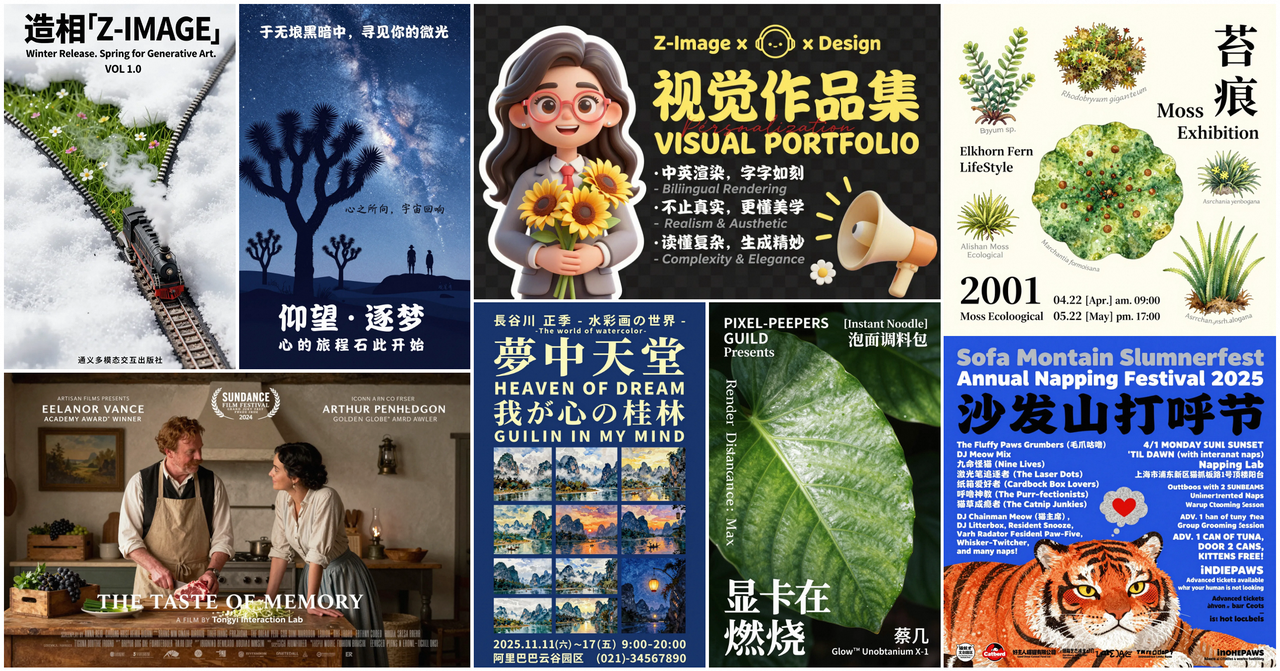

Nativer EN/ZH-Text in Bildern

Wenn es funktioniert, wirkt der Text im Bild wie ein natürlicher Bestandteil. Ich testete Produktetiketten, Poster und Social-Media-Grafiken. Englisch blieb häufiger scharf als Chinesisch, aber Z-Image-Turbo verarbeitete viele gängige chinesische Schriftzeichen bei kleinen bis mittleren Größen sauber. Bei gemischtem EN/ZH in einem Bild erhielt ich bei kurzen Phrasen etwa 7 von 10 Malen lesbaren Output. Das ist keine allgemeingültige Aussage – es ist das, was ich in ~30 Renderdurchläufen beobachtet habe. Ich hielt Seed und Komposition konstant und änderte nur den Text, wodurch sich die Erfolge absichtlich und nicht zufällig anfühlten.

Das Schönste ist die Platzierung. Das Modell klebt den Text nicht einfach ein: Es versucht, ihn zu komponieren. Auf einer Teedose hat es das Etikett leicht gebogen, um der Dosenoberfläche zu entsprechen. Auf einem Banner respektierte es den Links-nach-rechts- und Oben-nach-unten-Fluss. Das ist nicht perfekt. Kanten können unscharf werden, und das Kerning kann abweichen. Aber für schnelle Konzepte oder Social Posts besteht der native Look oft einen flüchtigen Blick, ohne ein zweites Hinsehen zu erfordern.

Wann die Textwiedergabe am besten funktioniert

Kurzer Text (1–5 Wörter)

Kurze Phrasen sind der Sweet Spot. Ein bis fünf Wörter pro Sprache funktionierte bei mir am besten. Ein einfaches Paar wie „CALM TEA” und „静茶” hielt weit besser stand als ein ganzer Satz. Je mehr Zeichen, desto höher die Wahrscheinlichkeit von Fehlern – fehlende Radikale, vertauschte Reihenfolge oder dieses unheimliche Fast-richtig-Gefühl, das sich dennoch falsch liest. Kurz zu bleiben sparte nicht immer Zeit, reduzierte aber die Anzahl der Wiederholungsversuche.

Gängige Typografie-Stile

Ich hatte mehr Erfolg mit klaren serifenlosen oder einfachen Display-Schriften. Wenn ich nach hochkontrastigem Didone oder strukturierten Pinselskripten fragte, nahm das Modell kreative Freiheiten – manchmal schön, aber weniger lesbar. Wenn Ihr Ziel Klarheit ist, empfehle ich: fette Grotesk, geometrische Sans-Serif oder minimale Grotesk. Serifen sind machbar, wenn man nach „lesbarer Serifenschrift” fragt und die Größen größer wählt. Für Chinesisch war Sans-Serif mit gleichmäßigen Strichstärken meist am sichersten.

Poster- und Banner-Layouts

Flache, grafische Layouts begünstigen guten Text. Z-Image-Turbo scheint am glücklichsten zu sein, wenn es Schrift wie eine wichtige Form behandeln kann. Poster, Banner, Hero-Images – diese halfen ihm, Ausrichtung und Kontrast zu treffen. Wenn ich versuchte, kleine zweisprachige Bildunterschriften über belebten Fotos zu platzieren, stolperte es öfter. Als ich ein Poster mit Farbblöcken mockupte und EN als Überschrift sowie ZH als Unterüberschrift anforderte, blieben beide öfter lesbar als in einer unruhigen Szene.

Prompting für Text

Explizite Textanweisungen

Direkt zu sein half. Ich formatiere den Prompt mit expliziten Anführungszeichen und Rollen:

- Überschrift: „CALM TEA”

- Unterüberschrift (Vereinfachtes Chinesisch): „静茶”

- Beide Zeilen als echten Text einbeziehen, nicht als dekorative Formen

Ich füge außerdem hinzu: zweisprachiger Text (Englisch + Vereinfachtes Chinesisch), korrekte Schreibweise. Wenn das Modell abwich, fügte ich hinzu: exakte Zeichen beibehalten. Das ist keine Magie, aber es reduziert das Rätselraten.

Den Rest des Prompts halte ich schlank: eine kurze Stilphrase, Grundfarben und die Oberfläche oder das Format (Poster, Etikett, Banner). Je mehr ich hinzufügte – Stimmung, Metaphern, zusätzliche Objekte –, desto mehr litten die Buchstaben.

Schriftstil angeben

Ich nenne keine echten Schriften: Ich beschreibe Eigenschaften: „fette Sans-Serif, gleichmäßiger Strich, hohe Lesbarkeit” oder „minimale Serife, großzügiger Buchstabenabstand”. Für Chinesisch füge ich hinzu: „klare chinesische Sans-Serif, ausgewogene Striche”. Wenn das Ergebnis zu künstlerisch aussieht, füge ich hinzu: verzerrte oder abstrakte Glyphen vermeiden. Eine kleine Anmerkung: Abstands-Begriffe helfen – enges Tracking für Überschriften, normales Tracking für Etiketten. Kerning wird nicht immer berücksichtigt, aber diese Hinweise lenken das Modell in die richtige Richtung.

Text im Bild positionieren

Ich erzielte stabilere Ergebnisse, wenn ich Platz für den Text reservierte. Phrasen wie: zentrierter Überschriftenbereich: Badge oben links: Etikettenfeld auf der Vorderseite einer Dose. Bei gebogenen Oberflächen füge ich hinzu: Text der Oberfläche anpassen, Lesbarkeit erhalten. Und wenn der Kontrast nachlässt, half ein schneller Folge-Prompt mit: Kontrast zwischen Text und Hintergrund erhöhen beim nächsten Render meist.

Wenn die Platzierung wirklich wichtig ist, füge ich Layout-Hinweise hinzu: A/B-Blöcke, einen ruhigen Rand oder „gitterbasiertes Layout”. Das klingt pedantisch, reduzierte aber meine Wiederholungsversuche bei einigen Bannern von fünf auf zwei.

Praktische Beispiele

Produktetiketten (EN + ZH)

Ich mockupte ein Teedosen-Etikett mit zwei Zeilen: EN oben, ZH unten. Prompt-Teile, die wichtig waren: frontale zylindrische Dose, mattes Etikettenfeld, fette englische Überschrift „CALM TEA”, Vereinfachte Chinesische Unterüberschrift „静茶”, hoher Kontrast, exakte Zeichen beibehalten. Von drei Durchläufen waren zwei sauber genug, um als Konzeptgrafik verwendet zu werden. Der dritte tauschte das zweite Schriftzeichen aus – nah dran, aber falsch. Ein schneller neuer Durchlauf mit exakte Zeichen beibehalten behoben das Problem.

Bei Flaschen mit Glanzlack trübten Reflexionen manchmal die Striche. Die Anforderung nach mattem Etikett oder weichem diffusem Licht half.

Social-Media-Grafiken

Für quadratische Beiträge beschränkte ich den Text auf eine Überschrift auf EN und einen kleinen ZH-Tag. Ein Prompt, der funktionierte: minimalistischer Poster-Stil, zentriertes Raster, Überschrift „FOCUS”, Vereinfachter Chinesischer Tag „专注”, fette Sans-Serif, hohe Lesbarkeit, keine dekorative Verzerrung. Ich erhielt in der Regel in 1–2 Versuchen lesbaren Output. Wenn ich Verläufe oder strukturierte Hintergründe forderte, begann der Text sich einzufügen. Das Hinzufügen von: einfarbiger Block hinter dem Text oder klarer Rand brachte ihn zurück.

Ich taktete eine Charge von sechs Variationen. Mit einem konstanten Seed produzierte ich in etwa 15 Minuten einen akzeptablen Satz – wo Figma mich mit Schriftsuche 25–30 Minuten gekostet hätte. Kein riesiger Zeitgewinn, aber leichter für den Kopf.

Marketing-Banner

Breitere Leinwände begünstigten zweisprachige Zeilen nebeneinander: EN links, ZH rechts. Kurze Handlungsaufforderungen wie „START HERE” / „从这里开始” funktionierten bei mittlerer Größe gut. Wenn ich nach kleinem Fußzeilen-Kleingedruckten fragte, sank die Genauigkeit schnell. Mein Fallback: den Hero-Text im Modell generieren, das Rechtliche dann in einem Design-Tool hinzufügen. Diese Aufteilung hielt das Banner optisch kohärent und respektierte gleichzeitig das Schwierige – tatsächliche Lesbarkeit bei kleinen Größen.

Einschränkungen & Workarounds

Herausforderungen bei langem Text

Alles über fünf Wörter pro Zeile erhöht die Fehlerwahrscheinlichkeit, besonders auf Chinesisch. Striche verschmelzen, oder ein Schriftzeichen nimmt künstlerischen Urlaub. Wenn ich eine Phrase einschließen muss, teile ich sie: zwei kurze Zeilen, jeweils in separaten Durchläufen validiert. Ich vermeide auch ungewöhnliche Satzzeichen und seltene Glyphen, es sei denn, ich bin bereit für mehrere Wiederholungsversuche.

Wann Text nach der Generierung hinzufügen

Ich ziehe eine Grenze basierend auf dem Einsatz. Wenn es ein Konzept oder ein Social Post ist, bei dem die Stimmung mehr zählt als buchstabengetreue Genauigkeit, lasse ich Z-Image-Turbo den Text rendern. Wenn es Verpackung, UI oder etwas rechtlich Sensibles ist, füge ich Text nach der Generierung hinzu. Das Modell gibt mir Komposition und Stimmung – mein Design-Tool gibt mir Kontrolle und Sicherheit. Es ist eine ruhige Arbeitsteilung, die mich vor pixelgenauer Frustration bewahrt.

Kombination mit Inpainting

Wenn das Layout stimmt, aber der Text um ein Zeichen abweicht, hilft Inpainting. Falls Sie es noch nicht ausprobiert haben: Dieser kurze Z-Image-Turbo-Inpaint-Leitfaden führt durch Maskierungs- und Neu-Prompting-Strategien, die Textkorrekturen deutlich sauberer machen.

Ich definiere eine kleine Maske über dem fehlerhaften Wort und promte erneut mit der exakten Zeichenkette in Anführungszeichen, plus exakte Zeichen beibehalten, hohe Lesbarkeit. Die Maske eng zu halten und den Hintergrund einfach zu gestalten, bewahrt die Textur und behebt gleichzeitig die Glyphen. Bei Postern rettete das etwa die Hälfte meiner Beinahe-Treffer, ohne das gesamte Bild neu erstellen zu müssen.

Eine letzte Anmerkung: Ich behandle jeden Erfolg als lokal, nicht global. Verschiedene Szenen und Beleuchtungen verändern die Chancen. Wenn Sie zum ersten Mal versuchen, zweisprachigen Text in Bildern (EN/ZH) mit Z-Image-Turbo zu generieren, beginnen Sie mit kurzen Wörtern, einfacher Typografie und einem klaren Layout. Wenn es sich gut verhält, strecken Sie sich etwas. Wenn es sich sperrt, kämpfen Sie nicht dagegen an – fügen Sie den Text danach hinzu. So oder so fühlt sich die Arbeit leichter an.

Ich ertappe mich immer noch dabei, wie ich einen Bogen oder ein Radikal zusammenkneife und prüfe, ob es wirklich da ist. An den meisten Tagen ist diese kleine Pause es wert.