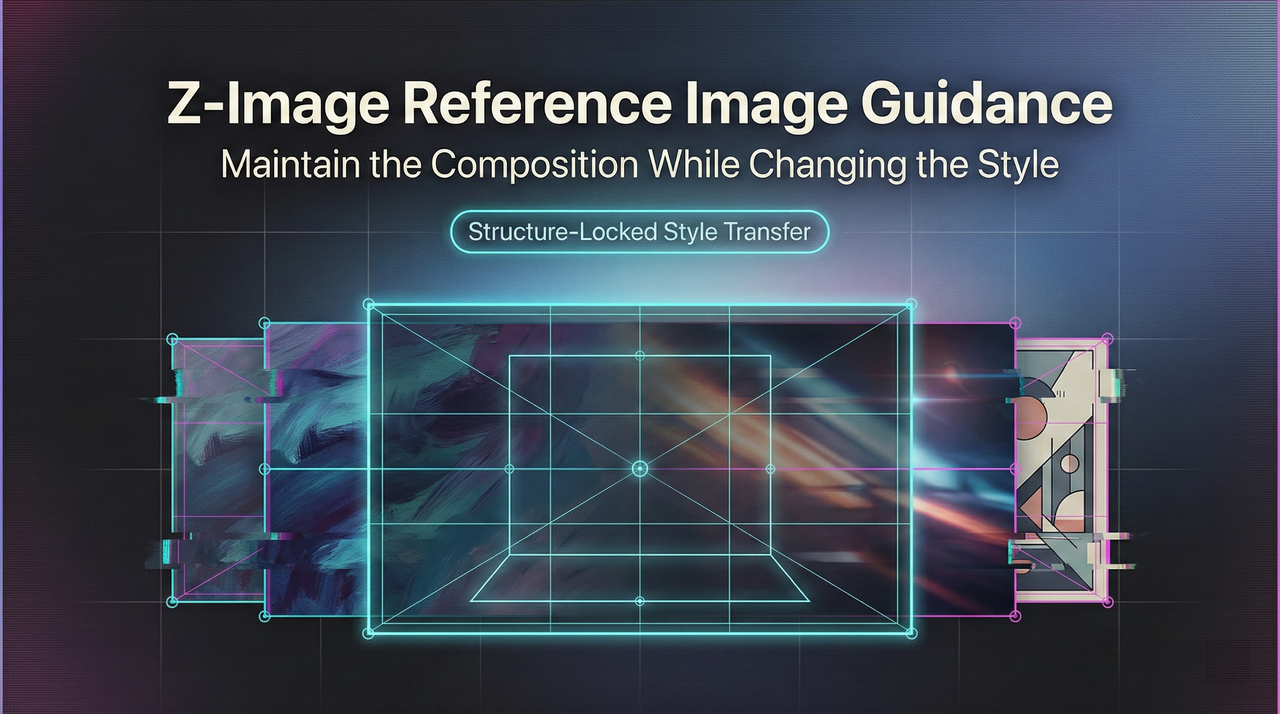

Z-Image Referenzbild-Führung: Komposition beibehalten bei gleichzeitiger Stiländerung

Z-Image-Base Referenzhandbuch mit vollständigen Anweisungen: Detaillierte Erklärung des 'Stärke'-Parameters (Starke Führung: 0,2 - 0,4 vs. Schwache Führung: 0,6 - 0,8), Stilübertragungsworkflow, Techniken zur Kompositionserhaltung.

Hey, ich bin Dora. Weißt du was? Ich konnte einmal ein tolles Bild generieren und es danach nicht mehr reproduzieren. Gleicher Prompt, leicht andere Anforderung, völlig anderes Feeling. Ich wollte mehr Kontrolle, kein Template – nur ein paar Leitplanken.

Da habe ich eine Woche damit verbracht, mich intensiv mit der Z-Image Referenzbildführung zu beschäftigen. Nicht weil sie besonders spektakulär ist, sondern weil sie etwas Einfaches verspricht: Das Wesentliche eines Ausgangsbilds beibehalten, während das Modell weiter explorieren kann. Unten sind die Notizen, die ich gerne am Anfang gehabt hätte – wie es sich wirklich anfühlt, wo es hakt und welche stillen Einstellungen den größten Unterschied gemacht haben.

Was ist Referenzbildführung

Referenzbildführung (manchmal auch img2img Conditioning oder Reference Conditioning genannt) ermöglicht es, einem Modell zusammen mit dem Text-Prompt ein echtes Bild zu übergeben. Das Modell nutzt dieses Eingabebild als Ankerpunkt: Stil, Komposition, Farbpalette oder Struktur – je nachdem, wie man die Regler einstellt – und folgt dabei trotzdem den Textanweisungen.

In der Praxis nutze ich das Z-Image Referenzbild als „Stimmungssetzer”. Ich verlange nicht, dass es alles macht. Ich setze es ein, um Varianz dort zu reduzieren, wo es mir wichtig ist (Pose, Palette, Layout), und überlasse dem Prompt den Rest.

Unterschied zur reinen Text-zu-Bild-Generierung

Ich habe denselben Prompt auf zwei Arten getestet: einmal ohne Bild, einmal mit Referenz. Ohne Bild erhielt ich eine bunte Auswahl an Ergebnissen: manche stimmungsvoll, manche flach, einige unbrauchbar. Als ich ein Referenzbild hinzufügte (eine schlichte Schreibtischszene, die ich mit dem Handy fotografiert hatte), behielt das Modell das Tischlayout, das weiche Tageslicht und sogar das Holzmaserungsgefühl bei – und tauschte trotzdem die gewünschten Objekte aus. Es fühlte sich nicht „eingesperrt” an – eher höflich eingeschränkt.

Reiner Text eignet sich hervorragend zur Erkundung. Aber wenn man Reproduzierbarkeit braucht (Kampagnenvarianten, Produktperspektiven, Foliengrafiken), reduziert das Referenzbild die Zufälligkeit. Meine geistige Belastung sank hier am deutlichsten: weniger Neuanfänge, weniger Prompt-Verrenkungen.

Einflussbereich des Referenzbilds

Das Referenzbild kann verschiedene Ebenen beeinflussen:

- Globale Komposition: Kamerawinkel, Platzierung des Motivs, Negativraum.

- Stilhinweise: Beleuchtung, Texturdichte, Farbtemperatur.

- Lokale Struktur: Silhouette, Pose, Produktumriss.

Was mich überraschte: Der Einfluss des Referenzbilds zeigt sich auch dann, wenn ich diese Details nicht im Text beschreibe. Hat das Referenzbild hartes Oberlicht, kann das auf die Ergebnisse übertragen werden – es sei denn, man gleicht es im Prompt aus (z. B. „weiches Seitenlicht, gedämpfte Highlights”).

Detaillierte Erklärung des „Strength”-Parameters

Verschiedene Systeme nennen ihn unterschiedlich (strength, fidelity, guidance scale for image usw.). Die Bedeutung ist ähnlich: Niedrigere Werte klammern sich ans Referenzbild; höhere Werte lockern den Griff. Wer auch den Texteinfluss anpassen möchte, findet in dieser Übersicht der Z-Image CFG Best Settings eine gute Ergänzung zu Strength-Anpassungen.

Im Folgenden beschreibe ich, wie sich diese Bereiche bei mir über etwa 60 Generierungen verhalten haben. Die eigenen Ergebnisse können abweichen, Modelle unterscheiden sich – aber die Form der Kurve bleibt tendenziell gleich.

0,2–0,4: Starke Referenzführung (Originalbild beibehalten)

Bei 0,2–0,4 wirkt das Z-Image Referenzbild wie frischer Zement. Das Modell behält Komposition, Beleuchtung und sogar kleine Texturen bei. Wenn ich im Text „Notizbuch gegen Tablet tauschen” angebe, wird es das meistens tun – aber das Tablet landet genau dort, wo das Notizbuch war. Ideal für:

- Produktfarbwechsel

- Kleinere Requisitenwechsel

- Label- oder Verpackungsauffrischungen

Probleme: Artefakte schleichen sich ein, wenn der Text strukturelle Änderungen verlangt, die das Referenzbild nicht unterstützen kann. Beispiel: Ein geschlossenes Laptop in ein geöffnetes in derselben Pose zu verwandeln, ergab bei 0,3 verzerrte Geometrie. Wenn ich an diese Grenze stoße, erhöhe ich entweder die Strength oder wechsle zu einer Referenz mit einer kompatiblen Pose.

0,4–0,6: Ausgewogener Bereich

Das war mein Alltagsbereich. Bei 0,5 behält das Modell das Grundgerüst der Szene bei, schreibt aber die Details mit weniger Widerstand um. Die Komposition bleibt erhalten: Objekte können sich etwas verschieben, die Beleuchtung kann weicher oder wärmer werden. Es bietet genug Konsistenz für eine Reihe zusammengehöriger Bilder, ohne dass alles wie geklont wirkt.

Was geholfen hat: Ansagen, was beibehalten werden soll. Sauberere Ergebnisse erhielt ich mit Prompts wie „Schreibtischwinkel und Tageslicht beibehalten: Tasse durch Glasbecher ersetzen: Pflanze hinzufügen, geringe Schärfentiefe.” Die Kombination aus mittlerer Strength und expliziten Beibehaltungsangaben schlug vage Adjektive deutlich.

0,6–0,8: Schwache Führung (mehr Kreativität)

Hier wird die Referenz zum Vorschlag, nicht zur Regel. Das Modell verschiebt frei den Kamerawinkel, fügt Elemente hinzu oder entfernt sie und aktualisiert manchmal den Stil. Ich nutzte 0,7 für Moodboard-Erweiterungen: gleiche Stimmung, neue Räume. Etwa 30–40 % der Ergebnisse griffen noch die ursprüngliche Palette auf.

Vorsicht: In diesem Bereich werden kleine Produktmerkmale (Anschlüsse, Nahtmuster) eher falsch erkannt, es sei denn, man verstärkt sie im Text oder liefert eine höher aufgelöste Referenz. Ich entdeckte seltsame Nähte an Taschen und falsche Abschrägungen an Geräten. Behebbar, aber der Überprüfung wert.

0,8–1,0: Referenzbild fast ignorieren

Über ~0,8 behandle ich die Referenz als Hinweis aus einem früheren Meeting. Das Modell erkennt vielleicht Farben oder eine grobe Silhouette, aber nicht viel mehr. Manchmal reicht das: Wenn ich nur „warm und holzbetont” möchte, erreiche ich das mit 0,85, während neue Winkel möglich bleiben.

Für Produktionsarbeiten bleibe ich hier aber nicht lange. Es ist näher an reiner Textgenerierung mit einem winzigen Anstoß. Wenn ich bei 0,9 lande, liegt es daran, dass ich die falsche Referenz für den Zweck gewählt habe und nur die Palette herausholen möchte. Meist ist es besser, eine bessere Referenz zu wählen und auf 0,5 zurückzugehen.

API-Implementierung

Ich testete API-Aufrufe mit einem einfachen Requests-Setup und einem kleinen Wrapper. Ich bevorzuge den Start mit rohem HTTP, weil es zeigt, was wirklich erforderlich ist – und was optionales Rauschen ist.

Wer neu in der Referenz-Konditionierung ist, sollte die Anbieterdokumentation nach der Definition von Strength und den verwendeten Standardwerten durchsuchen. Für den Hintergrund zu ähnlichen Workflows fand ich die Hugging Face Diffusers-Guides zu image-to-image und ControlNet hilfreich. Die Namen unterscheiden sich, die Idee ist dieselbe.

Methode zur Übergabe des „image”-Parameters

In den meisten APIs, die ich ausprobierte, kann das Referenzbild auf eine dieser Arten übergeben werden:

- Eine öffentliche URL (am schnellsten für Prototypen, auf Komprimierung achten)

- Ein base64-kodiertes Data-URI (zuverlässig, etwas ausführlich)

- Multipart-Upload (gut für lokale Dateien, EXIF/Qualität unter eigener Kontrolle)

Ich sende normalerweise PNG oder hochwertiges JPEG mit etwa 1024 px auf der langen Seite. Zu klein, und Details verschwimmen; zu groß, und man zahlt für Bandbreite ohne bessere Ergebnisse. Wenn die A PI mehrere Referenzbilder unterstützt, fange mit einem an. Zu viele gleichzeitig können das Signal auslöschen.

PI mehrere Referenzbilder unterstützt, fange mit einem an. Zu viele gleichzeitig können das Signal auslöschen.

Python-Codebeispiel

Hier ist ein minimales Muster, das ich verwendet habe. Es ist bewusst schlicht gehalten, damit du es anpassen kannst. Ersetze den Endpunkt und den Schlüssel durch die Angaben deines Anbieters.

暂时无法在飞书文档外展示此内容

Praktische Anwendungsszenarien

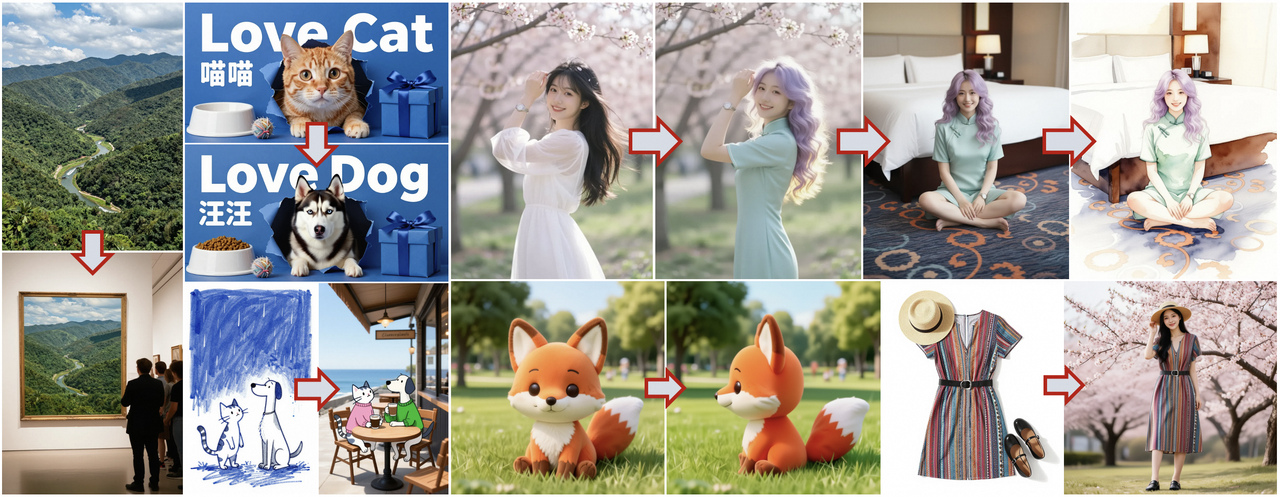

Stiltransfer

Ich verwendete einen klaren Produktshot als Referenz und fragte nach „Studioporträt im Stil von weichem Film, Halation, sanftem Lichtabfall.” Bei 0,45 behielt das Modell die Silhouette des Produkts bei und machte die Beleuchtung kinematografisch, ohne die Kanten zu verzerren. Als ich auf 0,25 drückte, klammerte es sich an den originalen Studioglanz – schön, aber weniger stilisiert. Wer einen kühnerem Stil möchte, sollte Richtung 0,6 gehen und 2–3 spezifische Stilangaben verstärken. Mehr davon wird zu Rauschen.

Produktbildvarianten

Für einen Landing-Page-Refresh brauchte ich acht Perspektiven, die wie Geschwister wirken sollten – nicht wie Klone. Ich stellte ein ordentliches Setup ein und verwendete es als Z-Image Referenzbild für alle Prompts. Strength bei 0,5 gab mir konsistentes Korn und Weißabgleich über alle Aufnahmen hinweg, während ich das Objekt drehen, eine Hand hinzufügen oder eine Hintergrundrequisite wechseln konnte. Die Zeitersparnis war pro Bild nicht riesig (vielleicht zwei Minuten), aber die geistige Entlastung, das „Warum ist dieses hier so anders?” zu vermeiden, war real.

Konzeptdiagramm-Verfeinerung

Diagramme sind der Bereich, wo Referenzführung still und leise glänzt. Ich skizzierte ein Layout in Figma – Boxen, Pfeile, lose Beschriftungen –, exportierte ein PNG und verwendete es als Referenz. Mit Strength bei 0,4 konnte ich den Stil beschreiben („minimal, weiche graue Linien, helle Akzentfarbe”) und das Modell bewahrte die Struktur. Das ersparte mir eine Runde Hin-und-her-Bearbeitung. Wenn eine Beschriftung falsch ausgerichtet war, passte ich die ursprüngliche Figma-Datei an und startete neu, anstatt mit dem Prompt zu kämpfen.

Best Practices

- Beginne mit einer sauberen Referenz. Begradigen, Unordnung entfernen, Belichtung normalisieren. Das Modell kopiert mehr, als man denkt.

- Strength dem Zweck anpassen. 0,5 ist ein sicherer erster Stopp: nach unten für Treue, nach oben für Erkundung.

- Ansagen, was beibehalten werden soll. Kurze, explizite Angaben („Winkel und Palette beibehalten”) reduzieren Abweichungen.

- Auflösung dem Bedarf anpassen. Rund 1024 px lange Seite ist ein pragmatischer Standard für die meisten APIs.

- In kleinen Schritten iterieren. Immer nur eine Sache ändern (Prompt-Anpassung oder Strength), um Ursache und Wirkung zu erkennen.

- Beim Tunen einen Seed setzen. Später weglassen für Abwechslung.

- Auf kumulierende Verzerrung achten. Wenn ein Output immer wieder als nächste Referenz verwendet wird, kann der Stil erstarren. Gelegentlich zur Originalreferenz oder einer neutralen Basis zurückkehren.

- Für Teams das Trio speichern: Referenzbild, Prompttext und numerische Strength. Das zukünftige Ich wird dem vergangenen danken.

Inmitten von Tools, die Magie versprechen, ist das hier die stillere Art. Sie macht keine Geschmacksentscheidungen für dich. Sie stabilisiert nur deine Hand. Das fiel mir bei einem späten Nachmittagsdurchlauf auf: gleicher Schreibtisch, gleiches Licht, weniger Zweifel. Kein großer Moment – aber er blieb hängen.