So behalten Sie die Charakterkonsistenz in Seedance 2.0 (Referenzpaket + Regeln)

Reduzieren Sie Identitätsdrift mit einem Referenzpaket, strikten Einschränkungen und einer QA-Checkliste, die Ihnen sagt, was als Nächstes zu ändern ist.

Möchten Sie kinematografische Videos wie Seedance 2.0 erstellen? Probieren Sie den WaveSpeed Cinematic Video Generator aus, um jetzt sofort Seedance 2.0-würdige kinematografische Videos zu erstellen.

Ich hatte nicht vor, Identitätsdrift zu beheben. Ich wollte einfach, dass derselbe Charakter zweimal einen Raum durchquert, ohne sich in einen Cousin zu verwandeln. Der erste Durchlauf sah in Miniaturansicht gut aus. Dann scrollte ich durch und bemerkte, dass die Kieferlinie weicher wurde, das Haar eine Locke verlor, und bis zur letzten Sekunde hatten die Augen eine andere Neigung. Nicht unheimlich, nur … seltsam. Seedance 2.0 ist schnell und kompetent, aber bei der Charakterkonsistenz kann es ins Wanken geraten.

Ich bin Dora. Ich habe diesen Monat ein paar späte Nächte damit verbracht, kleine Schleifen zu testen und zu notieren, was standhielt. Hier ist, was mich tatsächlich stabilisiert hat und was nicht, wenn mir die Seedance 2.0 Charakterkonsistenz mehr als alles andere am Herzen lag.

Warum ID-Drift passiert (was das Modell „vergisst”)

Seedance 2.0 jongliert gleichzeitig mit zwei Aufgaben: ein wiedererkennbares Gesicht zu bewahren und Bewegung zu liefern, die lebendig wirkt. Wenn es wählen muss, wählt es oft die Bewegung. Genau dort schleicht sich die ID-Drift ein.

Was ich immer wieder beobachtete, Durchlauf für Durchlauf:

- Zunächst trifft es die grobe Silhouette (Haarvolumen, Größe, allgemeinen Körperbau).

- Dann wandern Mikromerkmale unter Druck: Augenabstand, Philtrum-Länge, Ohrform, Haaransatzecken. Bei kurzen Clips zeigt sich das bei Übergängen und Kopfdrehungen.

- Lichtwechsel wirken wie sanfte Bearbeitungen der Identität. Ein seitliches Gegenlicht verwandelte meinen Charakter in eine leicht andere Person.

Unter der Haube (praktisch gesprochen, ohne so zu tun, als könnte ich die Gewichte sehen): Textprompts drängen zu Kategorieübereinstimmungen („junge Frau, lockiger Bob, Jeansjacke”), während Referenzen die genaue Person verankern. Wenn Ihr Prompt zu viel beschreibt, gewinnt die Kategorie. Wenn Referenzen schwach oder inkonsistent sind, „mittelt” das Modell das Gesicht.

Ich bemerkte auch, dass das Modell an vorhersehbaren Stellen „vergisst”:

- Wenn Hände das Gesicht überqueren, behandelt es den nächsten Frame wie ein Mini-Neustart.

- Schnelle Giehdrehungen brechen die Ohr-/Schläfentreue.

- Kleidungstexturen mit sich wiederholenden Mustern lenken die Aufmerksamkeit manchmal von Gesichtslandmarken ab.

Drift ist also nicht zufällig. Es ist ein langsames Abtriften vom Spezifischen zum Typischen. Dieses Wissen veränderte, wie ich Eingaben vorbereite und Prompts schreibe. Wenn Sie auch mit subtiler Frame-Instabilität kämpfen, geht dieser kurze Leitfaden zur Behebung von Flimmern und Zittern in Seedance 2.0 Hand in Hand mit der Identitätskontrolle.

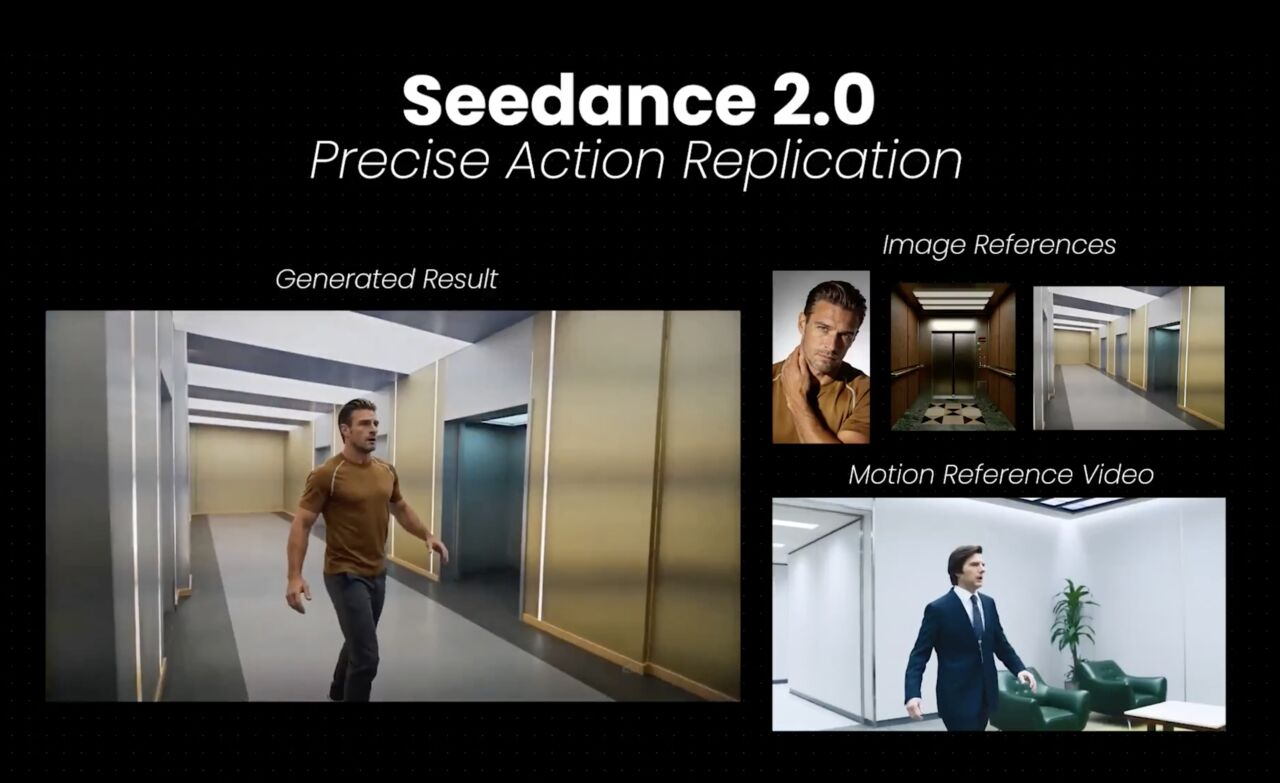

Ein Referenzpaket erstellen (Bilder + kurzer Clip + Style-Anker)

Mein größter Gewinn kam durch einen unspektakulären Schritt: Ich erstellte ein kleines, diszipliniertes Referenzpaket. ByteDances offizielle Ankündigung hebt hervor, dass Seedance 2.0 „bei der Befolgung von Anweisungen glänzt und eine präzise Reproduktion und stabile Subjektkonsistenz selbst bei komplexen Geschichten mit reichen Charakterinteraktionen ermöglicht.” Als ich Seedance 2.0 weniger, klarere Anker gab, hielt mein Charakter besser zusammen.

Hier ist, was für mich am besten funktionierte:

- Maximal drei Standbilder, nicht zehn. Ich wähle: eins frontal, eins im Dreiviertelprofil, eins im Profil. Gleiche Session, gleiche Beleuchtung. Ich vermeide ein lächelndes und ein neutrales Bild, denn zu viel Ausdrucksvielfalt lässt das Modell ein Mittelgesicht wählen.

- Ein 2–3 Sekunden langer Referenzclip mit einem neutralen Kopfnicken oder einem langsamen Blinzeln. Ich schneide tote Frames heraus und halte den Hintergrund schlicht. Das gab dem Modell eine bewegte Grundlinie für Kiefer- und Augenverhalten.

- Ein Style-Anker: ein visuelles Element, das Farbgebung und Kontrast festlegt. Ich verwendete einen Standrahmen aus einem früheren Export, den ich mochte. Wenn ich diesen wegließ, hielt die Identität, aber die Atmosphäre driftete ab; mit ihm blieb beides näher beisammen.

Was nicht half:

- Collagen. Sie sehen für mich organisiert aus, aber das Modell scheint sie wie eine belebte Szene zu behandeln.

- Gemischte Beleuchtung. Ich hatte eine warme Innenaufnahme und eine kühle Außenaufnahme: das Modell mittelte sie zu einem Neutral, was Hautton und wahrgenommenes Alter leicht veränderte.

- Nur hochauflösende Porträtaufnahmen. Seltsamerweise half das Einfügen eines mittelauflösenden Frames unter zwei scharfen, vielleicht weil es das Overfitting auf Poren abschwächte und die Form bewahrte.

Ich bewahre dieses Paket in einem einzigen Ordner mit einfachen Namen auf (front.jpg, threequarter.jpg, profile.jpg, ref.mp4, look.jpg). Es reduziert die Einrichtungszeit auf eine Minute, und ich zweifle nicht daran, was ich einschließen soll. Diese kleine Reduktion der mentalen Reibung ist wichtig, wenn ich viel iteriere.

Prompt-Regeln, die die Identität stabilisieren (was festhalten, was vermeiden)

Ich hörte auf, ausgefeilte Prompts zu schreiben. Je mehr ich versuchte, das Modell zu beeindrucken, desto mehr ignorierte es meine Person und jagte Ästhetik nach. Hier ist der ruhigere Ansatz, der die Seedance 2.0 Charakterkonsistenz für mich aufrechterhalten hat.

Was ich festhalte:

- Den Charakter als einzelne Einheit benennen, auch wenn er fiktiv ist: „Gleicher Charakter wie Referenzen: eine konsistente Identität.” Es klingt redundant, aber es hinderte das Modell daran, „Typvarianten” abzutasten.

- Altersbereich, Haardetails und ein oder zwei entscheidende Merkmale für die Wiedererkennung festlegen: „Ende 20, enge dunkle Locken in Ohrlänge, kleiner silberner Ring im linken Ohr.” Zu wenige Details, und es verallgemeinert. Zu viele, und es wählt selektiv aus.

- Aufnahmeabsicht und Tempo: „Langsame Gehschleife durch den Frame, subtiler Ausdruck, keine dramatischen Drehungen.” Bewegungsdisziplin ist Identitätsdisziplin.

Was ich vermeide:

- Vage Stilwörter, die mit dem Anker kämpfen: „kinematografisch”, „verträumt”, „grobkörnig”. Wenn ich einen Look brauche, setze ich ihn mit der Stilreferenz statt mit Adjektiven.

- Kostüm-Mikromanagement, das die Silhouette mid-clip verändert (Schals, weite Jacken im Wind). Wenn Kleidung spezifisch sein muss, halte ich sie eng anliegend und statisch.

- Komplexe Aktionen. Jeder zusätzliche Beat ist eine Chance für ein neues Gesicht. Ich fange einfach an: gehen, sitzen, 15 Grad drehen, blinzeln.

Zwei Formulierungstricks, die halfen:

„Gesichtsportionen in allen Frames identisch zur Referenz halten.” Es klingt bestimmend. Es funktionierte öfter als nicht.

„Kein neuer Schmuck, keine Make-up-Veränderungen, keine Haarbewegung über natürliches Schwingen hinaus.” Diese kleinen Schalter schlossen seltsame Lücken, die ich gar nicht zu benennen dachte.

Nach fünf Durchläufen bemerkte ich etwas Kleines: Meine Prompts um ein Drittel zu kürzen hielt die Ausgaben näher. Meine Vermutung: Weniger lose Token, die das Modell in Richtung eines Stimmungsbuffets ziehen.

QA-Checkliste vor dem erneuten Ausführen (Gesicht, Hände, Logos, Garderobe)

Früher führte ich Neustarts aus dem Bauchgefühl heraus durch. Jetzt mache ich einen 60–90 Sekunden langen Durchgang mit derselben Checkliste jedes Mal. Das spart Zeit, indem es blinde Wiederholungen verhindert.

Gesicht

- Auf Frame 1, Mittelpunkt und letztem Frame einfrieren. Augenabstand und Kieferwinkel mit front.jpg vergleichen. Wenn beides um mehr als „eine Pixelbreite in Miniaturansicht” abweicht, führe ich einen Neustart durch.

- Langsames Scrubbing über Blinzelmomente beobachten. Wenn die Lidkante während des Blinzelns an Dicke variiert, ist die Identität gefährdet.

Hände

- Jeden Moment prüfen, in dem eine Hand das Gesicht überquert. Wenn das Gesicht schmaler oder mit anderem Nasenrücken wieder erscheint, werte ich das als hartes Scheitern, nicht als Vielleicht.

- Fingerartefakte zählen. Ein Fehler sagt oft einen zweiten Identitätsausrutscher 10–15 Frames später voraus.

Logos und kleine Markierungen

- Wenn ein kleines Logo auf einem Shirt spiegelt oder weicher wird, erwarte ich, dass auch Gesichts-Mikromerkmale wackeln. Es ist eine gute Frühwarnung.

- Muttermale oder Sommersprossen: Wenn sie wandern, bekämpfe ich das nicht beim Grading. Ich korrigiere stattdessen Eingabe oder Bewegung.

Garderobe

- Musterschleifen (Moiré) können die Aufmerksamkeit dominieren. Wenn ich das sehe, tausche ich das Oberteil gegen ein einfarbiges aus oder ändere die Belichtung im Style-Anker.

- Ausschnitte, die sich verschieben, zeigen Schlüsselbeine unterschiedlich: Das kann die wahrgenommene Gesichtsbreite subtil verändern.

Ich bewerte jeden Durchlauf locker: 0 (Neustart), 1 (für Cutaways verwendbar), 2 (gut genug, um eine Sequenz zu verankern). Wenn ich zwei „2”en hintereinander lande, höre ich auf zu tüfteln. Nicht perfekt, aber stabil genug, damit die Geschichte es trägt.

Reparaturleiter bei anhaltender Drift (Referenzen tauschen, Einschränkungen verschärfen, Bewegung verkürzen)

Als die Identität auch nach sauberen Eingaben und sorgfältigen Prompts noch wegrutscht, hörte ich auf zu raten und stieg eine einfache Leiter hoch. Ich versuche eine Sprosse nach der anderen und führe einen 2–3 Sekunden langen Test durch.

- Referenzen tauschen, nicht alles

- Nur das Profil oder nur das Dreiviertelbild durch ein näheres in der Beleuchtung ersetzen. Den Rest beibehalten. Vollständige Überarbeitungen löschten Fortschritte, die ich nicht leicht wiedergewinnen konnte.

- Wenn Ausdruck variiert, normalisieren: neutral über alle Standbilder. Ein einzelnes breites Lächeln hat das Wangenvolumen für den gesamten Clip breiter gemacht.

- Einschränkungen in kleinen, klaren Worten verschärfen

- Pro Durchlauf eine Einschränkung hinzufügen: „keine Kopfdrehungen über 10°”, dann „keine Verdeckungen über das Gesicht”, dann „Haare am Kopf halten: kein Wind.” Diese schrittweise Stapelung funktionierte besser als alles auf einmal hineinwerfen.

- Wenn das Modell Widerstand leistet, zu Negativen wechseln: „dramatische Drehungen vermeiden: Haarheben vermeiden: Zubehörveränderungen vermeiden.” Negative schienen strenger respektiert zu werden.

- Bewegung verkürzen, dann neu aufbauen

- Das Aktionsfenster auf 1,5–2 Sekunden kürzen und Beats entfernen: nur ein Gang, nur ein Blick. Sobald das Gesicht hält, einen Beat wieder hinzufügen.

- Bei Schleifen vermeide ich perfekte zyklische Überlappungen: Sie können einen Gesichts-„Reset” an der Naht begünstigen.

- Visuelle Entropie reduzieren

- Den Hintergrund vereinfachen und den Kontrast im Style-Anker etwas senken. Als die Szene ruhiger wurde, wandte Seedance 2.0 mehr „Aufmerksamkeit” auf das Gesicht auf.

- Haut im Anker leicht entsättigen, wenn der Ton zwischen Aufnahmen immer wieder abweicht. Das schien plötzliche Warm/Kalt-Wechsel zu entmutigen.

- Letzter Ausweg: der Silhouette nachgeben

- Wenn ein einzigartiger Kieferwinkel nicht hält, stütze ich mich auf Haarform, Ohrschmuck und Kleidungsschnitt. Zuschauer lesen Identität aus der Distanz stärker ab, als wir zugeben. Das ist kein Schummeln: Es ist Schnitt.

Über acht kurze Tests hinweg reduzierte diese Leiter meine Neustarts um etwa ein Drittel. Wichtiger noch, sie senkte das mentale Rauschen. Ich hatte nicht das Gefühl, bei jedem Render zu würfeln.

Für wen das hilfreich ist: Wenn Ihnen Seedance 2.0 Charakterkonsistenz mehr als ausgefallene Kamerabewegungen am Herzen liegt, wird dieser langsamere, stetigere Weg wahrscheinlich natürlich wirken. Wenn Sie große Bögen, Schwenks oder ausdrucksstarke Monologe in einem Durchgang wollen, stoßen Sie schnell an die Grenzen. Sie können es immer noch erreichen, bauen Sie es einfach in Schichten auf.

Möchten Sie kinematografische Videos wie Seedance 2.0 erstellen? Probieren Sie den WaveSpeed Cinematic Video Generator aus, um jetzt sofort Seedance 2.0-würdige kinematografische Videos zu erstellen.