SeedVR2 在线版:使用指南

了解 SeedVR2 在线版的工作原理、支持的工作流程,以及在用于超分辨率任务之前需要了解的注意事项。

你好,我是 Dora。我在关注的一个 Discord 讨论串里,有人提到了 SeedVR2,说他们”在网上用过”。于是我去搜索了一下,结果立刻撞上了一堵墙——Gradio 演示、第三方封装、API 试验场,还有至少一个看起来可疑的网站,明显与 ByteDance 研究团队毫无关系。

没有人提前说清楚的一件事是:“SeedVR2 Online” 并不是一个单一的产品。根据你最终落地的地方,这个词至少有三种不同的含义。如果你不清楚自己实际在用哪一种,你的结果——以及你的预期——都会出偏差。

让我来帮你理清楚。

“SeedVR2 Online”通常指什么

**SeedVR2 是由 ByteDance Seed 团队开发的视频修复模型。**它已被 ICLR 2026 收录,研究代码已公开发布。这是一个专为通用视频修复设计的单步扩散 Transformer,能够通过自适应窗口注意力机制处理高分辨率输入。这才是它本来的面貌。

但是,把”SeedVR2 online”作为搜索词,搜出来的结果与模型本身不同。类似的混淆也发生在更新的 AI 视频生成模型如 Seedance 2.0 上,人们经常搜索”在线版本”,而不是底层模型。搜出来的是访问模型的入口,而这两者并不相同。

托管演示、封装工具或工作流服务

当有人说他们”在线使用了 SeedVR2”,他们指的很可能是以下几种之一:

托管的 Gradio 演示。 ByteDance 在 Hugging Face Spaces 上发布了官方演示,运行 SeedVR2-3B 模型,通过类 API 界面支持图像和视频输入。这是最接近”官方”在线版本的东西——但它是一个研究演示,而非产品。队列等待时间可能很长,可用性也没有保障。

第三方封装工具。 开发者们基于同一底层模型构建了 ComfyUI 节点、Replicate 部署和独立工具。这些运行在别人的基础设施上,有时免费,有时需要积分或付费。它们可能看起来很精致,但它们不是 ByteDance 的产品。

平台集成。 一些 AI 生成平台已将 SeedVR2 作为其模型目录中的一个选项。你运行的是同样的模型权重,但使用的是别人的界面和计费系统。

为什么用户会混淆”官方”的概念

这种混淆是可以理解的。当人们阅读**现代 AI 视频模型对比**时,也会出现类似的不确定性,他们以为每个模型都有一个单一的官方界面。**该模型基于 Apache 2.0 开源协议。**这意味着任何人都可以托管它、封装它,并称之为 SeedVR2,没有商标门槛或认证流程。

因此,当你搜索”SeedVR2 online”时,可能会落在:

- ByteDance-Seed 运营的真正 Hugging Face Space

- 社区搭建的 ComfyUI 部署

- 恰好以 SeedVR2 为引擎的第三方视频放大服务

- 名字里带有 SeedVR2 但毫不相关的东西

在上传素材之前,花 30 秒确认一下你实际在用哪个,是值得的。

SeedVR2 Online 值得尝试的场景

直说吧。在线访问 SeedVR2 在特定情况下是合理的。在这些情况之外,它带来的挫败感可能多于帮助。

快速测试

如果你看过输出示例,想知道该模型的风格是否适合你的素材——先在线试试。你不需要安装任何东西,不需要 GPU。你可以上传一段短片,看看结果如何。

这真的很有用。我在 Hugging Face 演示上测试了一段我一直想修复的降质素材。等待时间很慢,但结果告诉了我在决定本地部署之前所需要知道的一切。

无需本地部署

在本地运行 SeedVR2 需要强悍的硬件。 官方文档指出,一张 H100-80GB GPU 可以处理最长 100 帧的 720p 视频,而处理 1080p 或 2K 分辨率需要四张 H100-80GB 显卡。大多数人没有这些硬件。在线访问弥补了这一差距——代价是灵活性、速度和控制权。

如果你是一个只需要偶尔清理视频、不想搭建本地工作流的创作者,在线选项是值得探索的。

如何在线使用 SeedVR2

输入与输出基础

大多数在线访问入口遵循相同的基本流程:

- 上传源视频(通常是 MP4,有时是帧序列)

- 设置目标分辨率或放大倍数

- 提交并等待

输出是你片段的修复版本——更清晰,噪点和压缩伪影减少,缩放至目标分辨率。

你在线上可能无法控制的内容:批次大小、注意力窗口大小、模型变体(3B vs 7B),以及小波颜色校正等后处理选项。这些设置只存在于本地工具中。

值得注意的设置

如果界面提供了选项,有几个值得了解:

目标分辨率。 该模型专为高分辨率输出设计。不要输入低于源素材的目标分辨率——这只会带来不必要的处理,而没有任何视觉提升。

颜色校正模式。 部分封装工具会暴露这个选项。ComfyUI 实现提供了几种颜色匹配选项,包括被描述为”对原始图像进行完整感知颜色匹配以获得最高保真度”的”lab”模式,以及用于”基于频率的自然颜色”的”wavelet”模式。如果你看到这些选项,对于不熟悉的素材,“wavelet”通常是更安全的选择。

片段时长。 测试片段要保持简短——如果可以的话,控制在 30 秒以内。长片段会拖慢所有人的队列,如果出了问题也更难排查。

你能期待什么,不能期待什么

性能限制

在线工具会有节流。尤其是免费的那些。如果你使用的是在有限算力上托管的共享演示,请预期:

- 高峰时段需要排队

- 即使是短片段也需要几分钟的处理时间

- 偶发的超时或任务丢失

这是队列和基础设施问题,而非模型问题。

质量预期

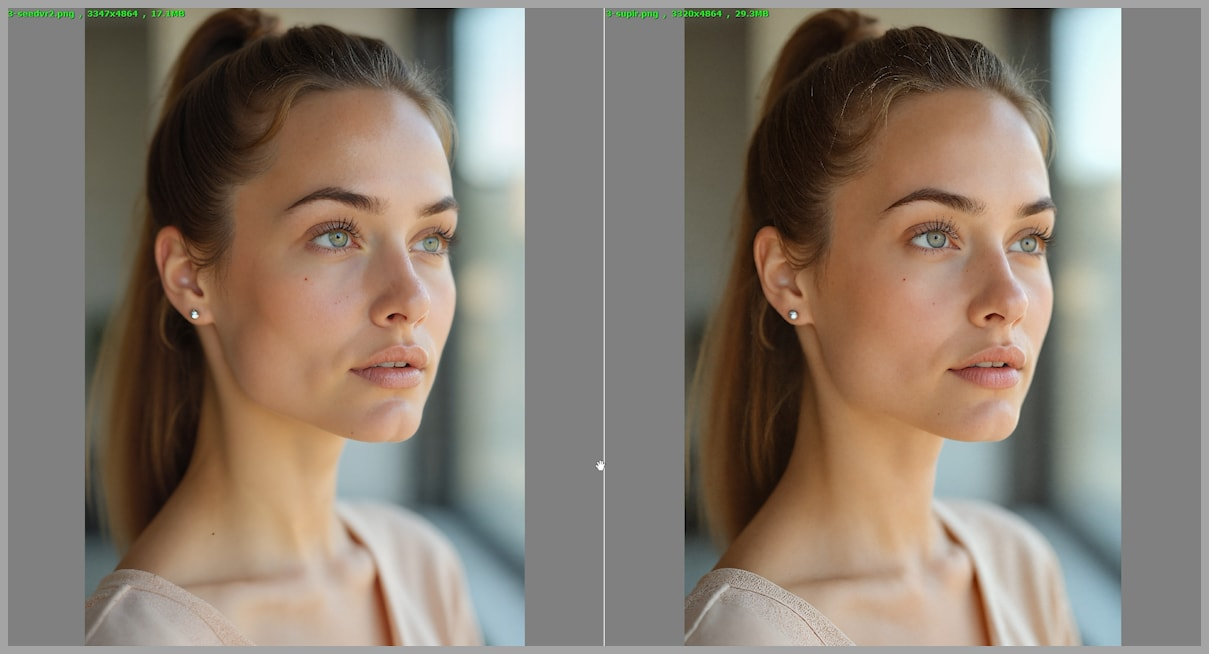

模型本身是有能力的。ByteDance-Seed 自己的模型说明指出,对于降质程度非常轻微的输入(例如 720p AIGC 视频),它有时会过度生成细节,偶尔导致过度锐化的结果。在生成式视频工作流中也可能出现运动伪影,这就是为什么许多创作者在使用修复模型时会学习**如何修复 AI 生成视频中的闪烁和抖动**。这是一个真实存在的局限,在处理你重视的素材之前值得了解。

对于有真实降质问题的素材——噪点、模糊、压缩伪影——结果通常会明显更好。对于已经很干净的素材,该模型实际上可能会让画面看起来不那么自然。

为什么在线使用与完整工作流使用不同

差距是显著的。例如,通过 ComfyUI 进行本地部署,让你可以控制批次大小、在 3B 和 7B 模型变体之间切换、启用 GGUF 量化以降低显存使用,并将 SeedVR2 与工作流中的其他节点串联。这种级别的控制在大多数在线界面中并不存在。

如果你在构建一个可重复的流程——比如处理定期拍摄的素材——在线访问很快就会触及瓶颈。

SeedVR2 Online vs API vs 工作流部署对比

| 类别 | 在线演示 | API / 平台 | 本地工作流 |

|---|---|---|---|

| 所需配置 | 无 | 极少 | 较多 |

| 速度 | 慢(共享) | 中等 | 快(你的 GPU) |

| 控制力 | 低 | 中等 | 高 |

| 费用 | 免费 / 积分 | 按量付费 | 硬件成本 |

| 稳定性 | 不稳定 | 较稳定 | 稳定 |

| 批量处理 | 不支持 | 有时支持 | 支持 |

适合快速使用的场景

在线演示和托管平台适合一次性测试、快速对比,以及没有本地高性能机器的情况。由 ByteDance-Seed 托管的 SeedVR2-3B Hugging Face Space 是最接近官方入口的东西,如果你想在不做任何承诺的情况下试用该模型。

适合可重复生产使用的场景

如果你需要定期处理素材,ComfyUI-SeedVR2_VideoUpscaler 节点是大多数创作者的选择。它由社区构建,但仍在积极维护,支持 GGUF 量化,使其在消费级 GPU 上也可使用。官方模型权重和架构细节记录在 GitHub 上的 ByteDance-Seed/SeedVR 仓库中。

亲身评测结论

我通过 Hugging Face 演示和本地 ComfyUI 两种方式都运行过 SeedVR2,体验截然不同。

在线演示只适合做一件事:判断 SeedVR2 是否值得你花时间。它在一次使用中就回答了这个问题。但我不会用它来处理任何需要实际交付的内容。

谁应该尝试

如果你:

- 想在安装任何东西之前测试该模型是否适合你的素材

- 偶尔需要修复一段视频,不需要可重复的工作流

- 没有本地 GPU 资源,可以接受较慢的处理速度

谁应该跳过

如果你:

- 每周需要处理超过几段视频

- 需要可以复现的一致结果

- 在乎控制输出锐度、颜色匹配或模型大小

对于对这个模型在研究领域所处位置感兴趣的人,arXiv 上的 SeedVR2 原始论文(2506.05301)值得一读——它比大多数学术论文更易读,清晰地解释了单步修复方法。

“SeedVR2 online”这个词可能还会让人困惑一段时间。没有单一的产品可以指向。有的是一个模型、几个官方演示,以及越来越多围绕它构建的社区工具。这并不是坏事——只是意味着你需要在决定是否值得花时间之前,搞清楚你实际上走进的是哪扇门。再见,亲爱的们~