GLM-5V-Turbo vs GPT-4o Vision:哪款模型在UI编码方面更胜一筹?

GLM-5V-Turbo与GPT-4o Vision在设计转代码任务中的对比。比较2026年的功能、API访问、定价及实际用例适配性。

上周我团队里有人问我:“我们的设计转代码流水线应该从 GPT-4o 换成 GLM-5V-Turbo 吗?“我的第一反应是说”两个都测试一下”。第二反应是先做点研究,让测试有个假设作为起点。

以下是我的发现——专注于从视觉输入生成 UI 代码和前端代码这一具体任务。不是通用编程,不是推理基准,不是泛泛的模型评测。只是一个具体问题:当输入是设计稿、输出是代码时,你应该选哪个?

简短结论

如果你的主要任务是大规模将视觉设计转换为前端代码,GLM-5V-Turbo 价格更低,且声称在 Design2Code 性能上更强。如果你需要通用多模态推理、后端编程支持,或者需要一个在生产环境中有较长使用记录的模型,GPT-4o 是更稳妥的默认选择。

只有在明确你要构建什么的时候,这个比较才会变得有意思。

各模型的优化方向

GLM-5V-Turbo 是 Z.ai(智谱 AI)推出的原生多模态智能体模型,于 2026 年 4 月 1 日发布。它围绕视觉优先的编程任务设计——设计还原、GUI 导航和屏幕转动作工作流。视觉能力不是附加功能,而是架构的核心。

GPT-4o 是 OpenAI 的多模态模型,于 2024 年 5 月发布,目前仍广泛用于生产视觉任务。它支持图像、文本和音频。这是一个通用模型,擅长视觉推理,但并非专门针对设计转代码任务进行优化。到 2025 年底,它已是一个广为人知的模型——经过充分测试,稳定可靠,拥有广泛的生态支持。

这两个模型解决的是相邻但不同的问题。这实际上是比较它们之前最值得理解的事情。

能力对比

设计转代码与 UI 还原

这是差距最明显的地方。Z.ai 报告称 GLM-5V-Turbo 在 Design2Code 基准测试中得分 94.8,而 Claude Opus 4.6 得分 77.3,GPT-4o 的表现在相近范围内。Design2Code 衡量生成的 HTML/CSS 与参考原型图的还原程度——像素精度、结构保真度和视觉完整性。

再次强调:这些是 Z.ai 自己的数据。差距足够大,值得认真对待,但在用自己的设计资产进行独立验证之前,还不足以直接作出决定。

实际上,这意味着 GLM-5V-Turbo 在以下场景值得测试:Figma 转代码流水线、截图转组件生成、跨断点的设计规范还原,以及存在视觉参考的 UI 迁移工作流。适用于以”看起来像原型图”为成功标准的任务。

GUI 智能体任务

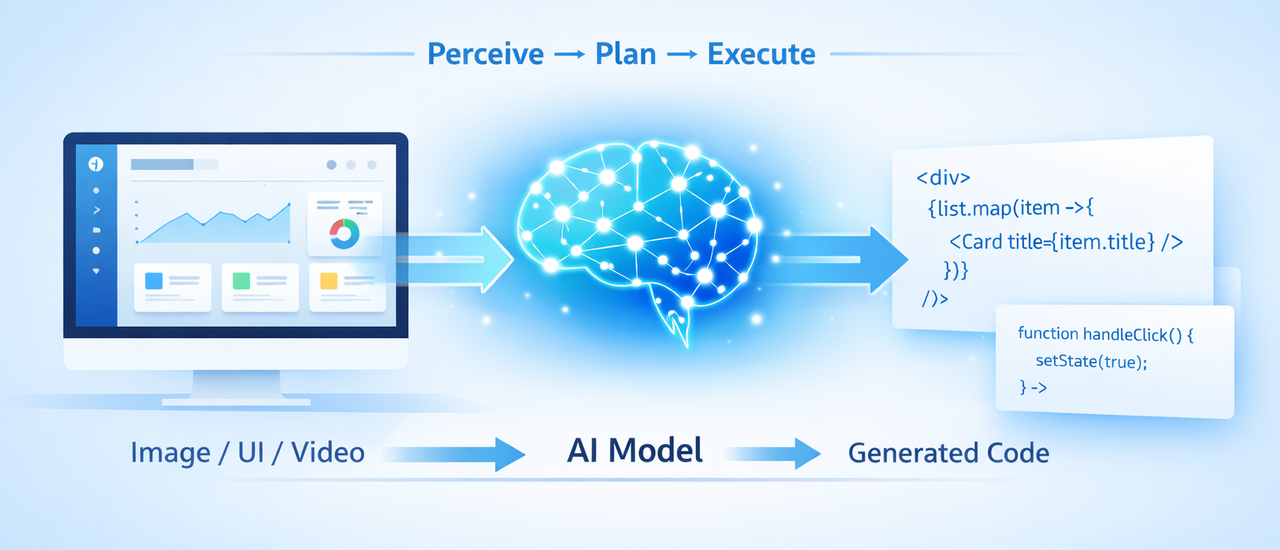

两个模型都支持 GUI 智能体工作流,但原生集成程度不同。GLM-5V-Turbo 从设计之初就考虑了智能体应用——模型处理完整的”感知 → 规划 → 执行”循环,并支持工具调用,Z.ai 表示其调用稳定性有所提升(智能体链中工具调用失败次数更少)。Z.ai 的文档将此定位为核心设计目标,而非附加功能。

GPT-4o 可用于 GUI 智能体工作流,但需通过 OpenAI 的函数调用和 Responses API 基础设施来实现。截至 2026 年初,GPT-4o 已不是 GUI 智能体的前沿选择——在 OpenAI 的产品线中,配备原生 Computer Use API 的 GPT-5.4 已取代其地位。GPT-4o 够用,但并非领先。

通用编程与后端任务

这是比较明显倾向 GPT-4o 的地方。GLM-5V-Turbo 是视觉专用模型。Z.ai 承认它在纯文本编程类别上落后于 Claude 和 GPT-4o——后端逻辑、多文件仓库工作、API 集成、无视觉上下文的调试。该模型不在这个领域竞争,Z.ai 也没有声称它能做到。

GPT-4o 能很好地处理通用编程任务,尽管即使在 OpenAI 自己的产品线中,它也不是当前市场上最强的选择。对于纯文本编程工作,你可能会比较 GPT-4.1 或 GPT-5.4,而不是 GPT-4o。

实际结论:不要将 GLM-5V-Turbo 用于不以视觉输入为起点的任务。它不适合这类场景。

多模态理解(图像、视频)

GLM-5V-Turbo 在同一上下文中支持图像、短视频片段和文本。视频输入支持屏幕录制分析、产品演示文档和时序 UI 状态追踪。上下文窗口为 202,752 个 token,最大输出 131,072 个 token——对于多图像或视频帧密集型提示来说相当充裕。

GPT-4o 支持图像输入(包括每次请求多张图像),上下文窗口为 128K。图像根据分辨率消耗 token——在高细节模式下,一张 1024×1024 的图像大约消耗 765 个 token,OpenAI 的视觉指南中有相关说明。GPT-4o 不原生支持连续视频输入;视频分析需要在你这端进行帧提取。

对于涉及屏幕录制或多帧视觉序列的流水线,GLM-5V-Turbo 在结构上更有优势。

并排对比

| 维度 | GLM-5V-Turbo | GPT-4o |

|---|---|---|

| API 可用性 | Z.ai 原生 API + OpenRouter | OpenAI API |

| 输入定价 | $1.20 / 百万 token | $2.50 / 百万 token |

| 输出定价 | $4.00 / 百万 token | $10.00 / 百万 token |

| 缓存输入 | $0.24 / 百万 token | $1.25 / 百万 token |

| 上下文窗口 | 202,752 token | 128,000 token |

| 最大输出 | 131,072 token | 约 16,384 token |

| Design2Code | 94.8(Z.ai 自报) | 未针对此任务进行独立基准测试 |

| 纯文本编程 | 较弱——落后于前沿文本模型 | 稳定的通用性能 |

| 智能体工作流 | 原生设计,专注工具调用 | 可通过函数调用实现;非当前前沿 |

| 视频输入 | 支持——原生 | 不支持——需帧提取 |

| 使用记录 | 2026 年 4 月发布 | 2024 年 5 月起投入生产 |

GPT-4o 定价来自 OpenAI 官方 API 定价页面。GLM-5V-Turbo 定价来自 Z.ai 官方定价文档。在制定生产预算之前,请务必核实两者的最新价格——每代模型发布时定价都可能有所调整。

API 与定价对比

GLM-5V-Turbo 定价与访问

每百万输入 token $1.20,每百万输出 token $4.00。可通过 Z.ai 的 OpenAI 兼容 API 访问,或通过 OpenRouter 进行多供应商路由。标准 API 密钥设置,支持函数调用,支持流式传输。

值得注意的一点:Z.ai 在之前的模型发布中曾遭遇基础设施压力。GLM-4.7 发布时出现过容量限制;GLM-5 发布时在算力压力警告的同时价格上涨了 30%。GLM-5V-Turbo 刚刚发布——在将生产流水线绑定到它之前,请在实际负载下测试吞吐量。

GPT-4o 定价与访问

每百万输入 token $2.50,每百万输出 token $10.00,缓存输入每百万 token $1.25。可通过 OpenAI 的 API 访问,具备完善的速率限制文档、企业协议以及两年的生产稳定性。这里的基础设施成熟度很高——你清楚自己会得到什么。

UI 编程工作流的单任务成本估算

对于一个典型的设计转代码任务(输入约 1,500 个图像 + 提示 token,输出约 2,000 个 token):

- GLM-5V-Turbo: 每任务约 $0.004

- GPT-4o: 每任务约 $0.027

差距大约在 6–7 倍。每月 10,000 个任务:约 $40 vs 约 $270。规模化时差异显著;低量评估时无关紧要。

何时使用 GLM-5V-Turbo

设计 → 前端代码流水线

如果你的工作流从设计产物开始——Figma 导出、截图、线框图——并以 HTML、CSS 或组件脚手架结束,GLM-5V-Turbo 值得与你当前方案进行基准测试。Design2Code 数字是自报的,但方向上可信。单任务成本明显更低。而且该架构专为此用例构建,而非从通用模型改造而来。

低成本视觉编程任务

对于运行高量级图像输入转代码输出流水线的团队——设计系统生成、批量 UI 还原、从截图中提取样式——成本差异会累积叠加。以 $1.20/$4.00 的价格,GLM-5V-Turbo 在输入和输出两端均比 GPT-4o 更便宜。

何时使用 GPT-4o Vision

通用多模态推理

当视觉编程只是更广泛工作流的一部分时,GPT-4o 是更好的选择——图像分析、混合推理、文档理解,或视觉输入是上下文而非主要对象的任务。它更通用,在设计转代码这一特定领域之外更可靠。

成熟的 API 生态与稳定性

两年的生产使用意味着经过充分测试的速率限制、完善的错误处理模式,以及大量社区知识积累。如果你的团队已与 OpenAI 生态深度集成——使用其 SDK、监控工具或合规基础设施——继续在视觉任务上使用 GPT-4o,迁移成本可能比看起来要低。

决策框架

按任务选择,而非按基准排名

大多数团队在比较模型时犯的错误,是将基准排名作为适用性的替代指标。GLM-5V-Turbo 的 Design2Code 得分并不意味着它是更好的模型——它意味着它在那种特定任务类型上更好。如果你的流水线纯粹是视觉转前端,GPT-4o 更广泛的能力并不能让它更适合你的流水线。

决策树比看起来简单:

你的任务是否以视觉输入为起点、以代码为终点?

- 是,且量级有意义 → 先测试 GLM-5V-Turbo。成本方面优势明显,基准数字方向有利。

- 是,但量级较低 → 两者皆可;如果你已在使用 OpenAI,GPT-4o 的接入摩擦更小。

你的任务是否涉及任何非视觉编程、推理或后端工作?

- 是 → GPT-4o,或者考虑完全使用纯文本模型。

你是否需要生产基础设施的稳定性?

- 是,且即将上线 → GPT-4o。GLM-5V-Turbo 才发布三天。

常见问题

问:GLM-5V-Turbo 在设计转代码方面是否优于 GPT-4o? 根据 Z.ai 自报的 Design2Code 基准(94.8 vs GPT-4o 范围的可比得分),在该特定任务上——是的。这些数字尚未经过独立验证。在将其视为定论之前,请用你自己的设计资产进行测试。

问:GLM-5V-Turbo 与 GPT-4o 的费用对比如何? GLM-5V-Turbo:每百万输入/输出 token $1.20/$4.00。GPT-4o:$2.50/$10.00。输入端大约便宜 2 倍,输出端大约便宜 2.5 倍。对于典型的 UI 编程任务,差距约为每任务 $0.004 vs $0.027。预算规划前请在 docs.z.ai 和 openai.com/api/pricing 确认当前价格。

问:GLM-5V-Turbo 能处理视频输入吗? 可以——在同一上下文中支持短视频片段、图像和文本。GPT-4o 不原生接受连续视频;它需要在你这端进行逐帧提取。

问:哪个模型更适合生产 UI 编程流水线? 取决于你的时间线。GLM-5V-Turbo 在此用例上具有更好的成本结构和基准声称,但于 2026 年 4 月 1 日发布——尚无生产使用记录。对于近期上线的任何项目,GPT-4o 是风险更低的选择。等到独立评估出炉后(60–90 天),再重新评估 GLM-5V-Turbo。

问:我在哪里可以通过 API 访问 GLM-5V-Turbo? 可通过 Z.ai 的原生 API(OpenAI 兼容格式)在 z.ai 访问,或通过 OpenRouter 作为备选路由层。需要标准 API 密钥注册。

“哪个模型胜出”的诚实答案是:取决于胜出意味着单任务最低成本、特定测试中最强基准,还是生产系统中最低风险。GLM-5V-Turbo 在设计转代码类别的前两点上提出了可信的主张。GPT-4o 在第三点上提出了可信的主张。

两个答案都不是永久性的。Z.ai 发布模型很快,OpenAI 也是。真正重要的比较,是你用自己的数据、自己的设计资产、对照自己的质量标准运行的那个。

所有价格均以 2026 年 4 月 2 日为准核实。GLM-5V-Turbo 基准数据为 Z.ai 自报;截至本文撰写时,尚无独立第三方评估发布。在生产预算决策前,请在官方渠道核实当前价格。

往期文章: