Что такое Qwen3.5-Omni: возможности, варианты и доступ к API

Qwen3.5-Omni только что вышел в вариантах Plus, Flash и Light. Вот что нужно знать разработчикам о возможностях, доступе к API и использовании в production.

Всем привет! Это снова Дора! Я была на полпути в редактировании видеопроекта, когда пришло уведомление: Qwen3.5-Omni только что вышел. Я использую семейство Qwen3-Omni в нескольких производственных рабочих процессах уже несколько месяцев, поэтому сразу поняла — это не просто незначительный патч. Контекстное окно на 256K токенов, клонирование голоса, семантическое прерывание и 113 языков для распознавания речи — всё в одной модели. Мне пришлось бросить то, чем я занималась.

Если вы создаёте голосовых агентов, конвейеры субтитрирования или что-либо, что должно обрабатывать реальный человеческий аудио- и видеоконтент вместе, этот релиз непосредственно касается вас. Позвольте мне рассказать, что он реально умеет, что означают три варианта на практике и как получить доступ — включая то, что пока остаётся неясным на сегодняшний день.

Что на самом деле делает Qwen3.5-Omni

Текст, изображение, аудио и видео в одном инференс-вызове

Вот что постоянно недооценивается в анонсах ИИ: нативная мультимодальная обработка и мультимодальная обработка через сшитый конвейер — это не одно и то же.

Когда немультимодальная модель вроде ChatGPT 5.4 получает видео, ей приходится извлекать кадры через модель зрения, прогонять аудио через что-то вроде Whisper для транскрипции и применять OCR для считывания встроенных субтитров — три отдельных процесса, сшитых воедино для приближения к тому, что настоящая omni-модель делает за один проход. В идеальных условиях, с хорошо освещённым клипом и чистым звуком, в одном реальном тесте это заняло девять минут.

Qwen3.5-Omni обрабатывает тот же входной контент за один вызов. Вы отправляете видео. Вы получаете ответ. Никакого промежуточного конвейера. Никаких накладных расходов на преобразование форматов. Никакой аудиомодели, которая не знает, что происходит на экране, и никакой модели зрения, которая ничего не слышит.

Модель поддерживает понимание текста, изображений, аудио и аудио-видео, причём компоненты Thinker и Talker оба используют архитектуру Hybrid-Attention MoE. Последнее важнее, чем может показаться, — к этому я вернусь в разделе об архитектуре ниже.

Что означает «омнимодальность» на практике в сравнении со сшитыми конвейерами

Разница проявляется в сценариях, которые действительно сложны для сшитых систем. Представьте: запись экрана, где кто-то одновременно пишет код и комментирует его вслух. Или звонок в службу поддержки, где контекст наполовину вербальный, наполовину экранный. Или рабочий процесс субтитрирования для специальных нужд, где фоновый звук и визуальное действие независимо несут смысл.

Команда Qwen продемонстрировала то, что они называют «Audio-Visual Vibe Coding» — модель может смотреть запись экрана с задачей по программированию и писать функциональный код, основываясь исключительно на том, что видит и слышит, без текстового запроса.

Странное название для демонстрации, но это реальный разрыв в возможностях по сравнению с моделями, ориентированными на текст, с прикреплённым аудио. Когда рассуждение и восприятие происходят внутри одной модели одновременно, задачи, требующие межмодального контекста, действительно работают.

Три варианта: Plus, Flash и Light

Plus — лидер по бенчмаркам, когда затраты оправданы

Qwen3.5-Omni-Plus достиг 215 результатов SOTA в задачах понимания аудио и аудио-видео, рассуждения и взаимодействия. Это большое число, и бенчмарки Alibaba имеют тенденцию считаться агрессивно — но независимые сравнения подтверждают это в важных категориях.

На стандартных бенчмарках Qwen3.5-Omni Plus превзошёл Gemini 3.1 Pro по общему пониманию аудио, рассуждению и задачам перевода, и сравнялся с ним по аудиовизуальному пониманию. По стабильности многоязычного голоса в 20 языках он обошёл ElevenLabs, GPT-Audio и Minimax.

Клонирование голоса доступно в Plus и Flash через API — вы отправляете образец голоса продолжительностью 10–30 секунд, и модель клонирует его для вывода.

Когда платить за Plus? Когда качество вывода — это то, что ваши пользователи реально замечают. Голосовые агентные продукты, где естественность голоса является ключевым ценностным предложением. Высококритичная транскрипция, где точность для редких языков имеет значение. Всё, где вы напрямую сравниваете с Gemini или GPT-Audio и вам нужно выиграть по качеству.

Flash — компромисс между пропускной способностью и задержкой

Flash является рекомендацией по умолчанию для использования в производственной среде согласно документации API. Идентификаторы модели — qwen3.5-omni-flash для стандартного варианта, и Flash описывается как значение по умолчанию при балансировании задержки, качества и ответа для большинства производственных сценариев.

Для создателей, строящих рабочие процессы с поддержкой ИИ — конвейеры автоматического субтитрирования, транскрипция интервью в реальном времени, суммаризация видео в масштабе — Flash почти наверняка станет вашей отправной точкой. Вы тестируете партиями в сравнении с Plus, чтобы увидеть, стоит ли разница в качестве разницы в цене для вашего конкретного случая использования.

Предшественник Qwen3-Omni Flash уже имел потоковые голосовые ответы с задержкой всего 234 миллисекунды. Ожидайте, что Qwen3.5-Omni Flash будет в схожем диапазоне, хотя точные опубликованные бенчмарки задержки для версии 3.5 конкретно не подтверждены в первоначальных примечаниях к выпуску.

Light — для периферийных и бюджетных сценариев

Light — наименьший вариант в семействе. Количество параметров для серии 3.5-Omni на момент написания не было полностью подтверждено, но модель предшественника с 30B-A3B параметрами работала достаточно хорошо на потребительском оборудовании с правильной квантизацией, и вариант Light здесь может следовать схожей схеме.

Если вы создаёте прототип, строите что-то для клиента с жёсткими затратами на инференс или реально работаете на периферии, Light — это ваша отправная точка. Не списывайте его как «плохой» — для многих рабочих процессов инструментов для создателей контента (например: автоматическое субтитрирование миниатюр, простые вопросы и ответы по загруженному аудио), он, вероятно, более чем достаточен.

Что нового по сравнению с Qwen3-Omni

Контекстное окно: 256K токенов, более 10 часов аудио

Это изменение, которое меня больше всего волнует с практической производственной точки зрения.

Контекстное окно в 256K токенов соответствует более чем 10 часам аудио или примерно 400 секундам видео 720p со звуком. Это значительный скачок. Режим мышления предшественника Qwen3-Omni ограничивался 65 536 токенами с цепочками рассуждений в 32 768 токенов — полезно, но ограничено для медиаконтента большей длины.

Для анализа подкастов, обработки длинных интервью, расширенного суммаризации звонков клиентов — это контекстное окно меняет то, что реально осуществимо в одном вызове API.

Языковое покрытие: 113 для распознавания, 36 для генерации

Распознавание речи теперь охватывает 113 языков и диалектов, по сравнению с 19 у предшественника. Генерация речи расширилась с 10 языков до 36.

Честное замечание: Alibaba считает региональные диалекты таким образом, что эти числа завышены по сравнению с тем, как, скажем, OpenAI считал бы то же покрытие. Даже с поправкой на это, скачок реален. Если вы строите для рынков Юго-Восточной Азии, арабоязычного контента или любого многоязычного голосового рабочего процесса, это значительное практическое улучшение.

Thinker-Talker с Hybrid-Attention MoE

Архитектура Thinker-Talker была впервые представлена в Qwen2.5-Omni. Важное обновление в 3.5-Omni заключается в том, что оба компонента теперь используют дизайн Hybrid-Attention MoE (Mixture-of-Experts), соответствующий переходу более широкого семейства Qwen3.5 к разреженным архитектурам.

Почему это важно для разработчиков: разделение Thinker-Talker позволяет внешним системам — конвейерам RAG, фильтрам безопасности, вызовам функций — вмешиваться между двумя этапами до начала синтеза речи. Это не просто архитектурная деталь. Это означает, что вы можете вставить свою собственную логику между тем, что модель рассуждает, и тем, что она говорит вслух. Для производственных голосовых агентов это действительно полезно.

Семантическое прерывание и клонирование голоса

Любой, кто развёртывал голосового бота, знает эту боль: пользователь кашляет, собака лает, кто-то говорит «угу», и бот останавливается на середине ответа, думая, что его прерывают.

Qwen3.5-Omni добавляет семантическое прерывание, которое пытается различить, действительно ли пользователь хочет вставить слово, и окружающий фоновый шум или случайные комментарии. Это одна из тех функций, которые звучат незначительно в журнале изменений, но на деле являются разницей между голосовым помощником, который пользователи находят раздражающим, и тем, которым они продолжают пользоваться.

Клонирование голоса и управление голосом в реальном времени по скорости, громкости и эмоции также являются новыми. Команда упоминает функцию под названием ARIA, которая улучшает стабильность и естественность голосового вывода — технические подробности того, что ARIA делает внутри, не были детализированы в первоначальном выпуске.

Как получить доступ к Qwen3.5-Omni

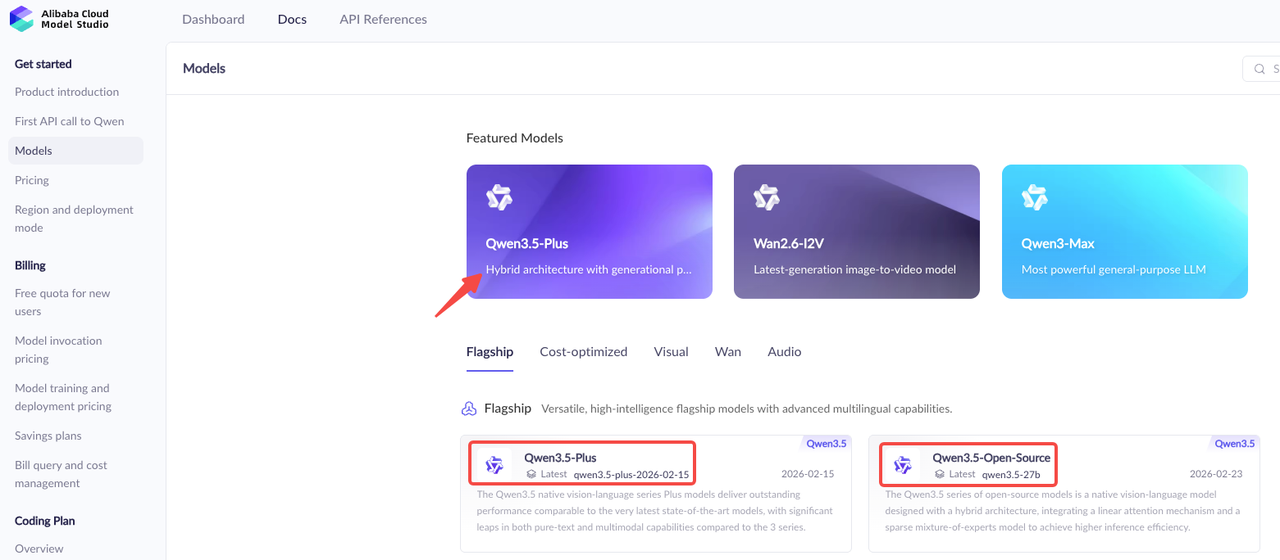

API DashScope (Alibaba Cloud)

Основной путь доступа в производственной среде — через API DashScope от Alibaba Cloud. Он использует совместимый с OpenAI интерфейс, что означает: если вы уже обращаетесь к GPT-4o или Claude через OpenAI SDK, миграция проста.

DashScope поддерживает несколько регионов: Сингапур (международный), US Вирджиния, Китай Пекин и Гонконг, с разными URL-адресами конечных точек для каждого. Для большинства команд вне Китая международная конечная точка Сингапура является значением по умолчанию: dashscope-intl.aliyuncs.com.

Идентификаторы моделей для трёх вариантов следуют шаблону qwen3.5-omni-plus, qwen3.5-omni-flash и qwen3.5-omni-light. Структура API следует стандартному формату /v1/chat/completions с параметром modalities для указания того, хотите ли вы текст, аудио или и то, и другое в ответе.

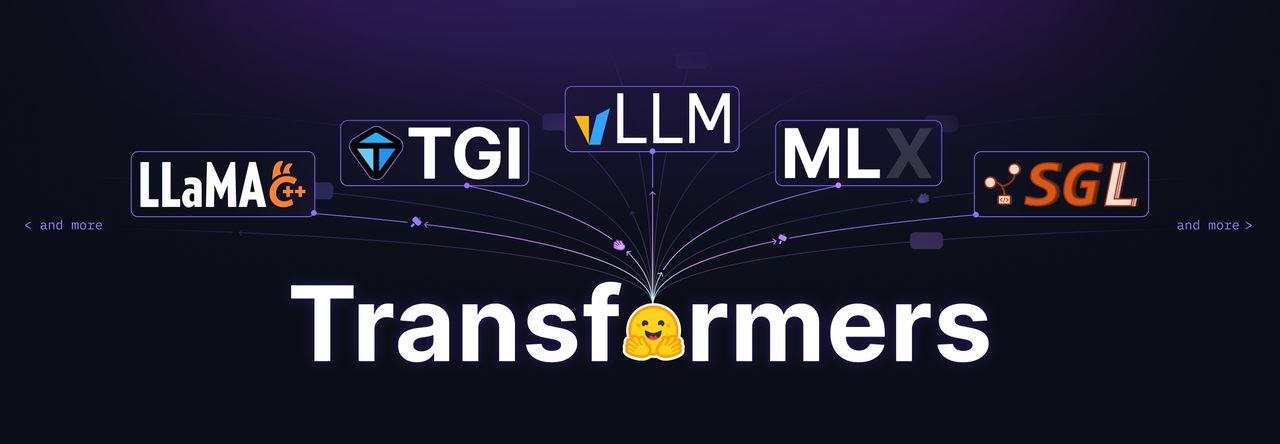

Вариант самостоятельного хостинга через vLLM

Команда Qwen настоятельно рекомендует vLLM для инференса и развёртывания моделей серии Qwen-Omni, предоставляя образ Docker, включающий полную среду выполнения как для HuggingFace Transformers, так и для vLLM.

Предостережение: скорость инференса с HuggingFace Transformers на моделях MoE может быть очень медленной, поэтому для крупномасштабных или низкозадержечных требований рекомендуемым путём является vLLM или API DashScope.

Если вы занимаетесь самостоятельным хостингом, планируйте именно под vLLM 0.13.0 — это версия, на которую ссылается официальная документация по настройке. Архитектура MoE означает, что требования к памяти ниже, чем у сопоставимой плотной модели того же уровня качества, но вам всё равно нужно будет проверить выделение GPU перед запуском производственного развёртывания.

Статус открытых весов: что подтверждено, а что ожидается

Здесь я хочу быть осторожна и не строить догадок сверх того, что подтверждено.

Qwen3-Omni (предшественник) был выпущен под лицензией Apache 2.0 на GitHub и HuggingFace. Будут ли веса Qwen3.5-Omni следовать тому же пути лицензирования Apache 2.0, не было подтверждено в первоначальном анонсе. Веса предшественника общедоступны — веса версии 3.5 могут последовать, но по состоянию на дату выпуска 30 марта это подтверждение ожидается.

Не стройте свои планы по развёртыванию с открытыми весами на этом, пока официальный репозиторий GitHub или карточка модели HuggingFace не подтвердят лицензирование. Следите за обновлениями на QwenLM GitHub.

Кому стоит обратить внимание на этот релиз

Создатели голосовых агентов и систем разговора в реальном времени

Если вы создаёте приложения с голосом в качестве основного интерфейса — боты для обслуживания клиентов, ИИ-компаньоны, интерактивные голосовые инструменты — Qwen3.5-Omni заслуживает серьёзного рассмотрения. Одно только семантическое прерывание решает известную болевую точку, с которой сталкивается каждый разработчик голосовых агентов. Добавьте нативный вызов функций и веб-поиск, и это начинает выглядеть как реальная инфраструктура, а не исследовательский выпуск.

В блоге Qwen выделяется нативный веб-поиск и поддержка вызова функций, встроенные непосредственно в omni-модель, что позиционирует её меньше как исследовательский артефакт и больше как инфраструктуру для приложений с голосовым интерфейсом.

Рабочие процессы аудиовизуального производства и субтитрирования

Для инструментов для создателей контента, автоматизации видеопроизводства и субтитрирования в масштабе — это самый привлекательный выпуск в пространстве мультимодальных моделей с открытыми весами прямо сейчас. Аудиоконтекст более 10 часов означает, что вы можете обработать полнометражный контент за один вызов. Расширенное языковое покрытие означает, что многоязычный контент больше не является особым случаем.

Сочетание понимания аудио и анализа видеокадров в одном инференс-вызове также делает это действительно полезным для таких задач, как: автоматическое извлечение основных моментов, субтитрирование B-roll, транскрипция закадрового голоса с корреляцией экранного текста.

Команды, уже использующие Qwen3-Omni в производстве

Если Qwen3-Omni уже есть в вашем стеке, переход на Qwen3.5-Omni прост. Структура API последовательна. Одно только обновление контекстного окна делает это стоящим для тестирования на ваших существующих рабочих нагрузках — особенно для всего, что упиралось в потолок в 65K токенов.

Чего он не охватывает

Не модель генерации изображений

Стоит сказать прямо, потому что «омнимодальность» создаёт некоторую путаницу: Qwen3.5-Omni генерирует текст и речь. Он не генерирует изображения или видео. Он понимает изображения и видео как входные данные — это совершенно другая возможность. Если вам нужна генерация изображений, смотрите на отдельные линейки VL и моделей генерации изображений Qwen или на модель qwen-image-plus в каталоге DashScope.

Скорость инференса на MoE: vLLM против HuggingFace Transformers

Это поставило многих в тупик с Qwen3-Omni, и поставит с 3.5-Omni тоже. Поскольку Qwen3-Omni использует архитектуру MoE, скорость инференса с HuggingFace Transformers на моделях MoE может быть очень медленной. Для крупномасштабных вызовов или низкозадержечных требований настоятельно рекомендуется vLLM или API DashScope.

Не делайте бенчмарки на HuggingFace Transformers и не делайте вывод, что модель медленная. Тестируйте на vLLM или управляемом API, прежде чем составлять мнение о производственной жизнеспособности.

Часто задаваемые вопросы

Является ли Qwen3.5-Omni открытым исходным кодом или открытыми весами?

По состоянию на выпуск от 30 марта 2026 года статус открытых весов Qwen3.5-Omni официально не подтверждён. Предшественник Qwen3-Omni имел открытые веса Apache 2.0 и был доступен на HuggingFace. Ожидайте схожего темпа выпуска для 3.5-Omni, но проверьте на официальном QwenLM GitHub перед тем, как полагаться на это.

Могу ли я самостоятельно хостить Qwen3.5-Omni-Plus?

API DashScope — это подтверждённый производственный путь на сегодняшний день. Самостоятельный хостинг через vLLM поддерживается для Qwen3-Omni и, вероятно, будет поддерживаться для 3.5-Omni после выпуска весов. Архитектура MoE варианта Plus означает, что требования к активным параметрам ниже, чем у сопоставимой плотной модели, но для полного варианта Plus вам понадобится многогпу-настройка.

Поддерживает ли он вызов функций и веб-поиск нативно?

Да. В блоге Qwen явно выделяется нативная поддержка веб-поиска и вызова функций, встроенная в omni-модель. Вызов функций следует стандартному формату инструментов OpenAI через API DashScope. Это значимый дифференциатор — вы можете создавать голосовых агентов, которые запрашивают живые данные без маршрутизации через отдельный уровень оркестрации.

Предыдущие публикации: