GLM-5V-Turbo: O Que Desenvolvedores Precisam Saber em 2026

GLM-5V-Turbo é o modelo de visão e codificação da Z.ai. Saiba o que desenvolvedores precisam conhecer sobre sua API, preços, limites e casos de uso reais em 2026.

Um colega me enviou uma captura de tela na semana passada — um mockup de design à esquerda, uma reprodução HTML quase pixel-perfeita à direita. “GLM-5V-Turbo fez isso em uma única passagem”, dizia a legenda. Guardei a informação e segui em frente. Mas continuei vendo o modelo mencionado no mesmo contexto que ferramentas de fluxo de trabalho agêntico, e decidi investigar de verdade o que esse modelo é e o que não é.

Isto é o que encontrei — escrito para desenvolvedores avaliando modelos multimodais para casos de uso de codificação agêntica, não para quem busca uma recomendação de produto.

O Que É o GLM-5V-Turbo?

Z.ai (Zhipu AI) e a Família de Modelos GLM

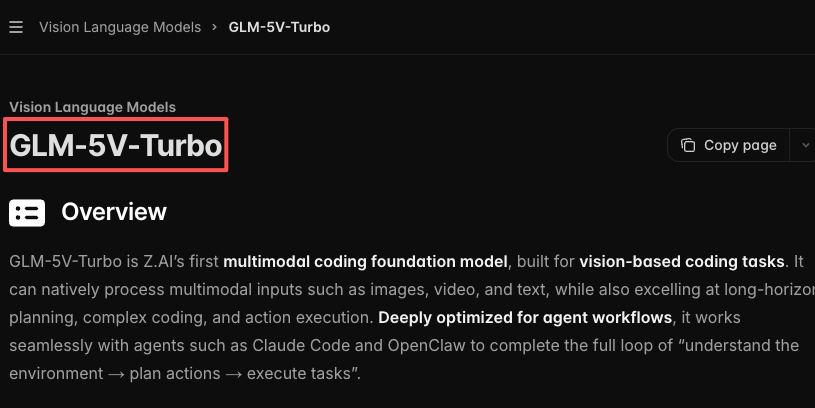

GLM-5V-Turbo é um modelo de linguagem visual lançado em 1º de abril de 2026 pela Zhipu AI, que atua internacionalmente sob a marca Z.ai. A Zhipu é um laboratório de IA sediado em Pequim — com capital aberto na Bolsa de Hong Kong desde janeiro de 2026 — e um dos produtores de modelos fundacionais mais ativos da China. Sua série GLM evoluiu rapidamente: GLM-4.5 em julho de 2025, GLM-4.7 em dezembro, GLM-5 em fevereiro de 2026 e agora uma variante multimodal em abril.

O GLM-5V-Turbo é o primeiro modelo da família construído como um agente multimodal nativo — ou seja, a visão não foi adicionada posteriormente, fazia parte da arquitetura desde o início. Essa distinção importa para entender em quais tarefas o modelo realmente se destaca.

Como o GLM-5V-Turbo Difere do GLM-4V e do GLM-5

O GLM-4V processava entrada de imagem. O GLM-5 melhorou codificação e raciocínio em texto. O GLM-5V-Turbo combina entrada multimodal (imagem, vídeo, texto) com saída orientada a agentes: chamada de ferramentas, decomposição de tarefas e interação com interfaces gráficas. É construído em torno de um novo codificador visual chamado CogViT, usa aprendizado por reforço em mais de 30 tipos de tarefas e executa quantização INT8 para inferência mais rápida.

O posicionamento é estreito por design. Não se trata de uma atualização de uso geral do GLM-5. É um modelo especializado para tarefas que começam com entrada visual e terminam em código ou ação estruturada.

Capacidades Principais

Design para Código e Geração de UI

A capacidade principal é reproduzir designs de UI como código frontend funcional. Forneça ao modelo um mockup — captura de tela, exportação do Figma, esboço desenhado à mão — e ele gera HTML, CSS e às vezes JavaScript. Nos próprios testes da Z.ai, o GLM-5V-Turbo obteve 94,8 no benchmark Design2Code contra 77,3 do Claude Opus 4.6. É uma diferença significativa se o benchmark se sustentar em testes independentes (mais sobre isso abaixo).

Na prática, isso é mais útil para estruturação de frontend: transformar especificações de design em código inicial de componentes, reproduzir layouts de UI existentes em projetos de migração ou gerar variações a partir de uma imagem de referência.

Agente de GUI e Suporte a Fluxos de Trabalho Agênticos

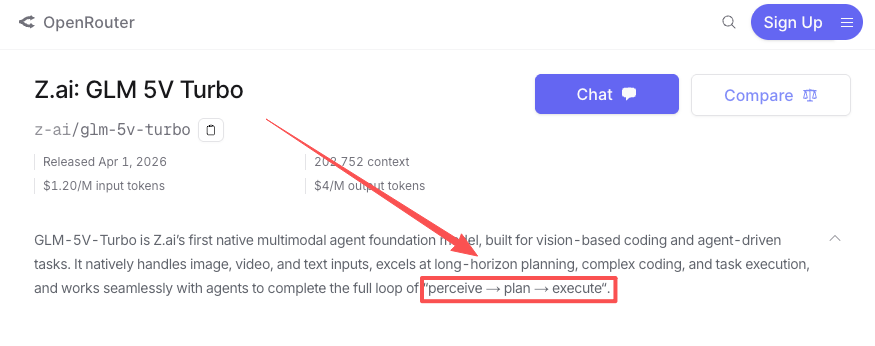

Além da reprodução estática de designs, o modelo suporta tarefas de agente de GUI — navegação em interfaces de browser, extração de dados estruturados de telas e execução de fluxos de trabalho em múltiplas etapas que envolvem estado visual. A página do modelo no OpenRouter descreve-o como construído para “completar o ciclo completo de perceber → planejar → executar”, e os resultados dos benchmarks AndroidWorld e WebVoyager citados pela Z.ai sugerem que ele consegue lidar com navegação de GUI no mundo real, não apenas testes sintéticos.

Para equipes construindo fluxos de trabalho agênticos que incluem uma camada visual — automação de preenchimento de formulários, agentes de teste de UI, pipelines de tela para ação — é aqui que o modelo tem uma reivindicação prática. As melhorias na chamada de ferramentas do GLM-5V-Turbo (herdadas e estendidas do GLM-5-Turbo) são explicitamente projetadas para reduzir invocações com falha em loops de agentes.

Tratamento de Entrada Multimodal

O modelo aceita imagens, clipes de vídeo curtos e texto no mesmo contexto. A entrada de vídeo estende os casos de uso para gravações de tela e walkthroughs de produtos — o modelo pode acompanhar visualmente e gerar documentação ou planos de ação a partir do que vê. A janela de contexto é de 202.752 tokens com saída máxima de 131.072 tokens, confirmado na página oficial de preços da Z.ai.

Acesso à API e Preços

Como Acessar o GLM-5V-Turbo via API

O modelo está disponível através da API da Z.ai com uma interface compatível com OpenAI. A autenticação segue padrões padrão de chave de API — registre-se em z.ai, gere uma chave e configure-a nas suas ferramentas existentes.

A API suporta chamada de funções, streaming e saída estruturada — a mesma superfície de capacidades do GLM-5-Turbo, estendida com entrada visual.

Preços: Custos de Tokens de Entrada e Saída

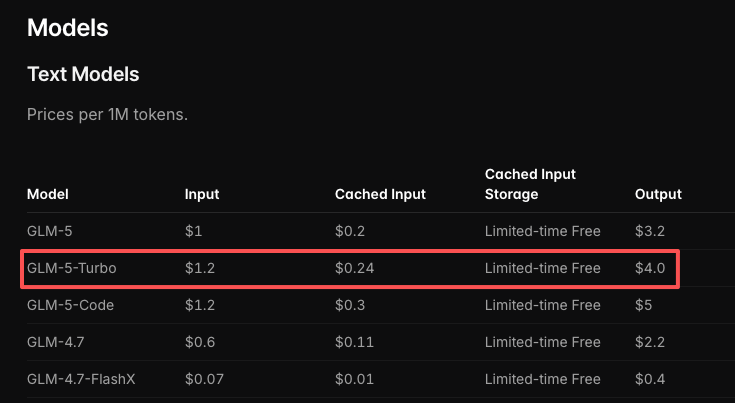

| GLM-5V-Turbo | GLM-5-Turbo | GLM-5 | |

|---|---|---|---|

| Entrada (por 1M tokens) | $1,20 | $1,20 | $1,00 |

| Saída (por 1M tokens) | $4,00 | $4,00 | $3,20 |

| Entrada em cache | $0,24 | $0,24 | $0,20 |

Valores obtidos da página oficial de preços da Z.ai em abril de 2026. Verifique diretamente antes de planejar orçamentos de produção — a Z.ai ajustou preços em lançamentos anteriores de modelos.

Para referência: Claude Opus 4.6 custa $5/M de entrada e $25/M de saída. GPT-4o é $2,50/$10. A $1,20/$4, o GLM-5V-Turbo é consideravelmente mais barato para cargas de trabalho com grande volume visual onde o volume de saída é modesto.

Janela de Contexto e Limites de Saída

- Janela de contexto: 202.752 tokens

- Saída máxima: 131.072 tokens

Ambos são generosos. Para a maioria das tarefas de design para código ou agente de GUI, você não atingirá esses limites. Sequências de vídeo longas ou arquivos de design muito grandes podem atingir, então vale testar com suas entradas reais antes de se comprometer.

Onde Se Encaixa (e Onde Não Se Encaixa)

Pontos Fortes: Codificação Visual, Reprodução de Design

A vantagem prática do GLM-5V-Turbo é específica: tarefas que exigem observar algo e produzir código a partir disso. Estruturação de frontend a partir de assets de design, extração de componentes de UI, captura de tela para HTML, análise de gravações de tela. Se seu pipeline começa com um artefato visual e termina em código, vale a pena comparar esse modelo com sua solução atual.

O suporte a fluxos de trabalho agênticos é uma adição real. A estabilidade na chamada de ferramentas importa em loops de agentes de produção — invocações com falha quebram cadeias e exigem novas tentativas. O foco declarado da Z.ai nisso no GLM-5V-Turbo é um sinal de que eles enfrentaram o mesmo modo de falha que todos os que constroem agentes enfrentam.

Limitações: Codificação Backend em Texto Puro, Raciocínio Geral

Esta é a parte que vale ser explícita. O GLM-5V-Turbo não é um concorrente direto do Claude ou do GPT-4o para codificação de backend, exploração de repositórios ou tarefas de raciocínio geral. Nessas categorias, o Claude Opus 4.6 lidera em todas as frentes de acordo com as próprias comparações da Z.ai — e isso é a empresa fazendo o argumento favorável para seu próprio modelo.

Se seu trabalho de codificação é principalmente texto de entrada, texto de saída — depuração de lógica, escrita de integrações de API, refatoração de código backend — um modelo somente texto como GLM-5 ou GLM-5-Turbo servirá melhor pelo mesmo preço. Adicionar um codificador visual não ajuda em problemas que não envolvem entrada visual.

Quem Deve Usá-lo e Quem Deve Ignorá-lo

Vale avaliar se você está:

- Construindo ferramentas de frontend que partem de assets de design

- Executando fluxos de trabalho de agente de GUI com estado visual

- Buscando uma alternativa mais barata ao GPT-4V ou Claude para tarefas de imagem para código

- Testando entradas multimodais em um pipeline de agentes

Provavelmente ignore se você está:

- Trabalhando com codificação de texto puro — backend, ferramentas de CLI, desenvolvimento de API

- Precisando de raciocínio geral forte junto com geração de código

- Operando sob restrições de residência de dados (Z.ai é uma empresa chinesa; revise sua política de privacidade em relação aos seus requisitos de conformidade)

Alegações de Benchmark — O Que Levar a Sério

Desempenho no Design2Code

A Z.ai reporta que o GLM-5V-Turbo obteve 94,8 no Design2Code versus 77,3 do Claude Opus 4.6. Essas são as próprias medições da Z.ai. Nenhum laboratório de avaliação independente publicou resultados corroborativos até o momento desta escrita. Isso não significa que os números estão errados — significa que ainda não foram submetidos a testes rigorosos.

O Design2Code como benchmark mede com que precisão o HTML/CSS gerado reproduz um mockup de referência, em termos de pixels e estrutura. É um proxy razoável para a tarefa específica de reprodução de UI. Não é um proxy para qualidade geral de codificação, julgamento arquitetural ou prontidão para produção no mundo real.

A diferença é grande o suficiente para ser crível como sinal direcional. Trate-a como motivo para testar, não como conclusão.

Ressalvas sobre Comparação de Codificação em Texto Puro

A documentação da Z.ai reconhece que o GLM-5V-Turbo fica atrás do Claude em benchmarks de codificação em texto puro. Essa candura é útil. Significa que o posicionamento do modelo é honesto: esta é uma ferramenta com foco visual, não uma atualização geral de codificação. Qualquer comparação que enquadre o GLM-5V-Turbo como amplamente competitivo com modelos de texto de fronteira está interpretando erroneamente o que a empresa está realmente alegando.

FAQ

P: O GLM-5V-Turbo está disponível via API?

Sim. Através da API nativa da Z.ai (compatível com OpenAI) e pelo OpenRouter. Configuração padrão de chave de API, suporta chamada de funções e streaming.

P: Qual é o preço do GLM-5V-Turbo?

$1,20 por milhão de tokens de entrada, $4,00 por milhão de tokens de saída, em abril de 2026. Verifique em docs.z.ai/guides/overview/pricing antes do uso em produção.

P: Como o GLM-5V-Turbo se compara ao GPT-4o e ao Claude para codificação?

Para design para código e tarefas visuais de UI: os benchmarks da Z.ai (auto-reportados) mostram-no à frente de ambos. Para codificação de texto puro e trabalho de backend: o Claude Opus 4.6 lidera. A comparação só se sustenta no domínio visual.

P: O GLM-5V-Turbo suporta entrada de vídeo?

Sim — clipes de vídeo curtos junto com imagens e texto no mesmo contexto. Útil para gravações de tela e geração de documentação baseada em walkthroughs.

P: Quais são os limites de taxa e a janela de contexto?

A janela de contexto é de 202.752 tokens, saída máxima de 131.072 tokens. Os limites de taxa não são publicados na documentação oficial — a Z.ai teve problemas de capacidade em lançamentos anteriores de modelos, então teste o throughput sob carga real antes de se comprometer com uma arquitetura de produção.

Design para código é uma categoria de tarefas genuinamente útil, e ter um modelo que a trata como problema de primeira classe — em vez de capacidade secundária de um modelo geral — é uma decisão de engenharia razoável. Se o GLM-5V-Turbo entrega resultados no seu pipeline específico é algo que apenas seus próprios dados de teste responderão.

Os números do benchmark merecem atenção. A verificação independente ainda está pendente.

Preços e especificações verificados na documentação oficial da Z.ai em 2 de abril de 2026. Todos os dados de benchmark são informações auto-reportadas pela Z.ai, salvo indicação em contrário — trate como preliminares até validação independente.

Posts Anteriores: