GLM-5V-Turbo vs GPT-4o Vision: UI 코딩에서 어떤 모델이 더 뛰어날까?

디자인-to-코드 작업을 위한 GLM-5V-Turbo vs GPT-4o Vision 비교. 2026년 기능, API 접근성, 가격, 실제 사용 사례 적합성을 비교합니다.

지난주에 팀원 중 한 명이 이런 질문을 했습니다: “디자인-to-코드 파이프라인에 GPT-4o 대신 GLM-5V-Turbo를 써야 할까요?” 저의 첫 번째 본능은 “둘 다 테스트해봐”였습니다. 두 번째 본능은 테스트에 가설을 세우기 위해 먼저 실제로 조사를 해보는 것이었습니다.

제가 발견한 내용을 공유합니다 — 시각적 입력에서 UI 코딩과 프론트엔드 생성이라는 특정 작업에 초점을 맞췄습니다. 일반 코딩이나 추론 벤치마크, 광범위한 모델 리뷰가 아닙니다. 입력이 디자인이고 출력이 코드일 때 어느 것을 선택해야 하는지에 대한 좁은 질문만 다룹니다.

간단한 답변

시각적 디자인을 프론트엔드 코드로 대규모로 변환하는 것이 주요 작업이라면, GLM-5V-Turbo가 더 저렴한 옵션이며 더 강력한 Design2Code 성능을 주장합니다. 범용 멀티모달 추론, 백엔드 코딩 지원, 또는 프로덕션에서 더 긴 실적을 가진 모델이 필요하다면 GPT-4o가 더 안전한 기본 선택입니다.

무엇을 만들고 있는지 구체적으로 알 때만 비교가 흥미로워집니다.

각 모델이 최적화된 부분

GLM-5V-Turbo는 Z.ai (Zhipu AI)의 네이티브 멀티모달 에이전트 모델로, 2026년 4월 1일에 출시되었습니다. 디자인 재현, GUI 탐색, 화면-to-액션 워크플로우와 같은 시각 우선 코딩 작업을 중심으로 설계되었습니다. 비전은 추가된 기능이 아니라 아키텍처의 중심입니다.

GPT-4o는 OpenAI의 멀티모달 모델로, 2024년 5월에 출시되어 프로덕션 비전 워크로드에 여전히 널리 사용됩니다. 이미지, 텍스트, 오디오를 처리합니다. 시각적 추론에 능숙하지만 디자인-to-코드 작업에 특별히 최적화되지는 않은 범용 모델입니다. 2025년 말에는 잘 테스트되고 안정적이며 광범위한 에코시스템 지원을 갖춘 검증된 모델이 되었습니다.

두 모델은 인접하지만 서로 다른 문제를 해결하고 있습니다. 이것이 비교하기 전에 이해해야 할 가장 유용한 점입니다.

기능 비교

디자인-to-코드 및 UI 재현

여기서 격차가 가장 두드러집니다. Z.ai에 따르면 GLM-5V-Turbo는 Design2Code 벤치마크에서 94.8점을 기록했으며, 이는 Claude Opus 4.6의 77.3과 비슷한 범위의 GPT-4o 성능과 비교됩니다. Design2Code는 생성된 HTML/CSS가 참조 목업을 얼마나 정확하게 재현하는지 측정합니다 — 픽셀 정확도, 구조적 충실도, 시각적 완성도.

다시 말씀드리지만, 이것은 Z.ai 자체 수치입니다. 격차가 충분히 커서 진지하게 받아들일 만하지만, 자체 디자인 자산으로 독립적인 검증을 건너뛸 만큼 크지는 않습니다.

실제로 이는 GLM-5V-Turbo가 테스트할 가치가 있다는 의미입니다: Figma-to-코드 파이프라인, 스크린샷-to-컴포넌트 생성, 브레이크포인트에 걸친 디자인 스펙 재현, 시각적 참조가 있는 UI 마이그레이션 워크플로우. “목업처럼 보였는가”가 성공 지표인 작업에 적합합니다.

GUI 에이전트 작업

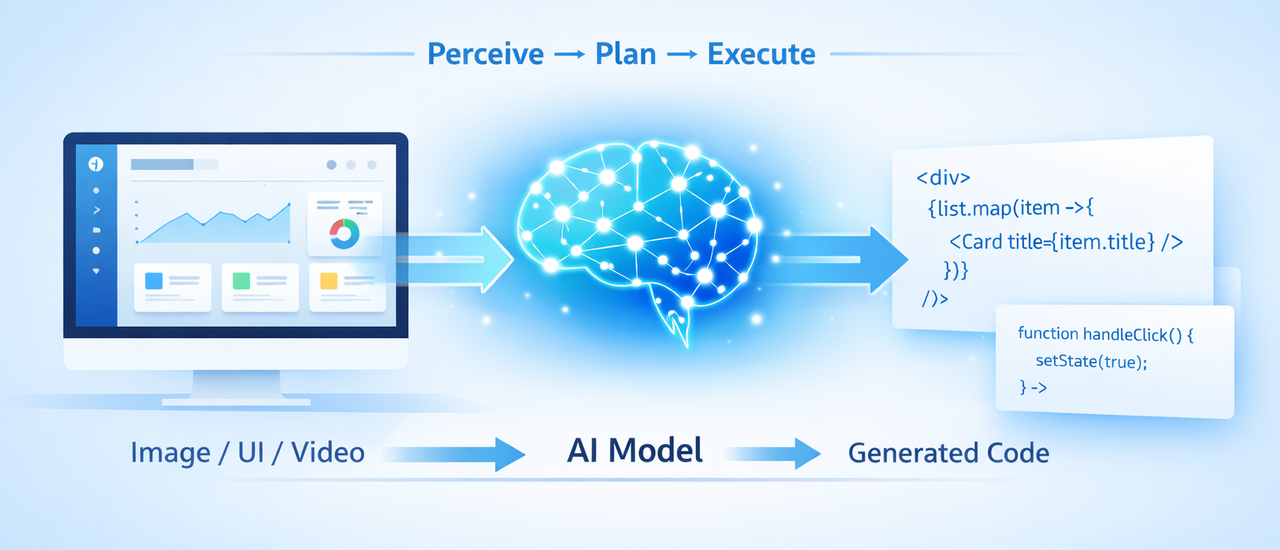

두 모델 모두 GUI 에이전트 워크플로우를 지원하지만 네이티브 통합 수준이 다릅니다. GLM-5V-Turbo는 에이전트 사용을 염두에 두고 만들어졌습니다 — 모델이 완전한 “인식 → 계획 → 실행” 루프를 처리하고 Z.ai가 향상된 호출 안정성(에이전트 체인에서 실패한 도구 호출 감소)이라고 설명하는 도구 호출을 지원합니다. Z.ai의 문서는 이를 기능 추가가 아닌 핵심 설계 목표로 제시합니다.

GPT-4o는 GUI 에이전트 워크플로우에 사용될 수 있지만 OpenAI의 함수 호출 및 Responses API 인프라를 통해 이루어집니다. 2026년 초 현재, GPT-4o는 GUI 에이전트의 최전선 선택이 아닙니다 — 네이티브 Computer Use API를 갖춘 GPT-5.4가 OpenAI 라인업 내에서 그 위치를 차지했습니다. GPT-4o는 적절하지만 선도적이지는 않습니다.

일반 코딩 및 백엔드 작업

여기서는 비교가 GPT-4o 쪽으로 명확하게 기울어집니다. GLM-5V-Turbo는 비전 특화 모델입니다. Z.ai는 순수 텍스트 코딩 범주 — 백엔드 로직, 다중 파일 저장소 작업, 시각적 컨텍스트 없는 API 통합, 디버깅 — 에서 Claude와 GPT-4o에 뒤처진다고 인정합니다. 모델은 이 분야에서 경쟁하지 않으며, Z.ai도 그렇다고 주장하지 않습니다.

GPT-4o는 일반 코딩 작업을 잘 처리하지만, OpenAI 자체 라인업에서도 현재 시장에서 가장 강력한 옵션은 아닙니다. 텍스트 전용 코딩 작업이라면 어차피 GPT-4.1이나 GPT-5.4와 비교하게 될 것입니다.

실용적인 결론: 시각적 입력으로 시작하지 않는 작업에는 GLM-5V-Turbo를 사용하지 마세요. 잘못된 도구입니다.

멀티모달 이해 (이미지, 비디오)

GLM-5V-Turbo는 동일한 컨텍스트에서 이미지, 짧은 비디오 클립, 텍스트를 받아들입니다. 비디오 입력은 화면 녹화 분석, 제품 둘러보기 문서화, 시간적 UI 상태 추적이 가능합니다. 컨텍스트 창은 202,752 토큰, 최대 출력 131,072 토큰 — 다중 이미지 또는 비디오 프레임이 많은 프롬프트에 넉넉합니다.

GPT-4o는 이미지 입력(요청당 여러 이미지 포함)을 128K 컨텍스트 창으로 지원합니다. 이미지는 해상도에 따라 토큰을 소비합니다 — OpenAI의 비전 가이드에 문서화된 대로 고해상도 모드에서 1024×1024 이미지는 약 765 토큰이 필요합니다. GPT-4o는 비디오를 연속 입력으로 네이티브 처리하지 않습니다; 비디오 분석은 사용자 측에서 프레임 추출이 필요합니다.

화면 녹화 또는 다중 프레임 시각 시퀀스를 포함한 파이프라인의 경우, GLM-5V-Turbo가 구조적 이점을 가집니다.

나란히 비교

| 항목 | GLM-5V-Turbo | GPT-4o |

|---|---|---|

| API 가용성 | Z.ai 네이티브 API + OpenRouter | OpenAI API |

| 입력 가격 | $1.20 / 1M 토큰 | $2.50 / 1M 토큰 |

| 출력 가격 | $4.00 / 1M 토큰 | $10.00 / 1M 토큰 |

| 캐시된 입력 | $0.24 / 1M 토큰 | $1.25 / 1M 토큰 |

| 컨텍스트 창 | 202,752 토큰 | 128,000 토큰 |

| 최대 출력 | 131,072 토큰 | ~16,384 토큰 |

| Design2Code | 94.8 (Z.ai 자체 보고) | 이 작업에 대한 독립 벤치마크 없음 |

| 순수 텍스트 코딩 | 약함 — 최전선 텍스트 모델에 뒤처짐 | 견고한 범용 성능 |

| 에이전트 워크플로우 | 네이티브 설계, 도구 호출 중심 | 함수 호출로 가능; 현재 최전선은 아님 |

| 비디오 입력 | 예 — 네이티브 | 아니오 — 프레임 추출 필요 |

| 실적 | 2026년 4월 출시 | 2024년 5월부터 프로덕션 운영 |

GPT-4o 가격은 OpenAI 공식 API 가격 페이지에서 확인. GLM-5V-Turbo 가격은 Z.ai 공식 가격 문서에서 확인. 프로덕션 예산 계획 전에 두 가지 모두 확인하세요 — 두 플랫폼 모두 각 모델 세대마다 가격이 변동되었습니다.

API 및 가격 비교

GLM-5V-Turbo 가격 및 접근

백만 입력 토큰당 $1.20, 백만 출력 토큰당 $4.00. Z.ai의 OpenAI 호환 API 또는 다중 공급자 라우팅을 위한 OpenRouter를 통해 접근 가능합니다. 표준 API 키 설정, 함수 호출 지원, 스트리밍 지원.

한 가지 주목할 점: Z.ai는 이전 모델 출시 시 인프라 부담이 있었습니다. GLM-4.7 출시 시 용량 제한이 발생했고, GLM-5는 컴퓨팅 압박 경고와 함께 30% 가격 인상으로 출시되었습니다. GLM-5V-Turbo는 새로 출시된 모델입니다 — 프로덕션 파이프라인에 투입하기 전에 현실적인 부하 하에서 처리량을 테스트하세요.

GPT-4o 가격 및 접근

백만 입력 토큰당 $2.50, 백만 출력 토큰당 $10.00, 캐시된 입력은 백만당 $1.25. OpenAI의 API를 통해 강력한 속도 제한 문서, 엔터프라이즈 계약, 2년간의 프로덕션 안정성으로 이용 가능합니다. 여기서 인프라 스토리는 성숙합니다 — 무엇을 얻게 될지 알 수 있습니다.

UI 코딩 워크플로우에 대한 작업당 비용 추정

일반적인 디자인-to-코드 작업 (입력 약 1,500 이미지 + 프롬프트 토큰, 출력 약 2,000 토큰) 기준:

- GLM-5V-Turbo: 작업당 약 $0.004

- GPT-4o: 작업당 약 $0.027

약 6~7배 차이입니다. 월 10,000 작업 기준: 약 $40 vs 약 $270. 대규모에서는 상당하지만, 소량 평가에서는 무관합니다.

GLM-5V-Turbo를 사용해야 할 때

디자인 → 프론트엔드 코드 파이프라인

워크플로우가 Figma 내보내기, 스크린샷, 와이어프레임 같은 디자인 아티팩트로 시작해서 HTML, CSS, 또는 컴포넌트 스캐폴드로 끝난다면, GLM-5V-Turbo를 현재 솔루션과 벤치마킹해볼 가치가 있습니다. Design2Code 수치는 자체 보고이지만 방향적으로 신뢰할 수 있습니다. 작업당 비용은 의미 있게 낮습니다. 그리고 아키텍처는 범용 모델에서 적용된 것이 아니라 이 사용 사례를 위해 목적 구축되었습니다.

저비용 시각 코딩 작업

대량의 이미지-입력-코드-출력 파이프라인을 운영하는 팀 — 디자인 시스템 생성, 일괄 UI 재현, 스크린샷에서 스타일 추출 — 에게는 비용 차이가 쌓입니다. $1.20/$4.00으로 GLM-5V-Turbo는 양쪽에서 GPT-4o보다 저렴합니다.

GPT-4o 비전을 사용해야 할 때

범용 멀티모달 추론

GPT-4o는 시각 코딩이 더 넓은 워크플로우의 일부일 때 더 나은 선택입니다 — 이미지 분석, 혼합 추론, 문서 이해, 또는 시각 입력이 주요 주제가 아닌 컨텍스트인 작업. 더 범용적이고 특정 디자인-to-코드 틈새 밖에서 더 안정적입니다.

확립된 API 에코시스템 및 안정성

2년간의 프로덕션 사용은 잘 테스트된 속도 제한, 확립된 오류 처리 패턴, 그리고 방대한 커뮤니티 지식으로 이어집니다. 팀이 이미 OpenAI의 에코시스템 — SDK, 모니터링 도구, 또는 컴플라이언스 인프라 — 과 통합되어 있다면, 비전 작업에 GPT-4o를 유지하는 것이 보일 수 있는 것보다 낮은 전환 비용을 가집니다.

의사결정 프레임워크

벤치마크 순위가 아닌 작업으로 선택하세요

모델을 비교할 때 대부분의 팀이 저지르는 실수는 벤치마크 순위를 적합성의 대리 지표로 취급하는 것입니다. GLM-5V-Turbo의 Design2Code 점수는 더 나은 모델이라는 의미가 아닙니다 — 그 특정 작업 유형에 더 나은 모델이라는 의미입니다. GPT-4o의 더 넓은 기능이 파이프라인이 순전히 시각-to-프론트엔드인 경우 파이프라인에 더 낫게 만들지는 않습니다.

의사결정 트리는 보이는 것보다 더 단순합니다:

작업이 시각적 입력으로 시작해서 코드로 끝나나요?

- 예, 그리고 볼륨이 의미 있음 → GLM-5V-Turbo를 먼저 테스트하세요. 비용 케이스가 강력하고 벤치마크 수치가 방향적으로 유리합니다.

- 예, 하지만 볼륨이 낮음 → 둘 다 작동합니다; 이미 OpenAI에 있다면 GPT-4o가 설정 마찰이 낮습니다.

작업이 비시각적 코딩, 추론, 또는 백엔드 작업을 포함하나요?

- 예 → GPT-4o, 또는 완전히 텍스트 전용 모델을 고려하세요.

프로덕션 인프라 안정성이 필요한가요?

- 예, 곧 출시 → GPT-4o. GLM-5V-Turbo는 출시된 지 3일밖에 되지 않았습니다.

FAQ

Q: GLM-5V-Turbo가 디자인-to-코드에서 GPT-4o보다 낫나요? Z.ai의 자체 보고 Design2Code 벤치마크 (94.8 vs 유사 GPT-4o 범위 점수) 기준으로, 그 특정 작업에서는 그렇습니다. 이 수치는 아직 독립적으로 검증되지 않았습니다. 이것을 확정된 사실로 취급하기 전에 자체 디자인 자산으로 테스트하세요.

Q: GLM-5V-Turbo와 GPT-4o의 비용은 어떻게 되나요? GLM-5V-Turbo: 백만 입력/출력 토큰당 $1.20/$4.00. GPT-4o: $2.50/$10.00. 입력에서 약 2배, 출력에서 약 2.5배 저렴합니다. 일반적인 UI 코딩 작업의 경우 차이는 작업당 약 $0.004 vs 약 $0.027입니다. 예산 책정 전에 docs.z.ai와 openai.com/api/pricing에서 현재 가격을 확인하세요.

Q: GLM-5V-Turbo는 비디오 입력을 처리할 수 있나요? 예 — 동일한 컨텍스트에서 이미지 및 텍스트와 함께 짧은 비디오 클립을 처리합니다. GPT-4o는 연속 비디오를 네이티브로 받아들이지 않으며, 사용자 측에서 프레임별 추출이 필요합니다.

Q: 프로덕션 UI 코딩 파이프라인에 어느 모델이 더 나은가요? 타임라인에 따라 다릅니다. GLM-5V-Turbo는 이 사용 사례에서 더 나은 비용 구조와 벤치마크 주장을 가지지만, 2026년 4월 1일에 출시되어 아직 프로덕션 실적이 없습니다. GPT-4o는 가까운 미래에 출시되는 것에 대한 낮은 위험 선택입니다. 독립적인 평가가 나온 후 60~90일 후에 GLM-5V-Turbo를 재검토하세요.

Q: API를 통해 GLM-5V-Turbo에 어떻게 접근할 수 있나요? z.ai에서 Z.ai의 네이티브 API (OpenAI 호환 형식)를 통해, 또는 대안적인 라우팅 레이어로 OpenRouter를 통해 접근할 수 있습니다. 표준 API 키 등록이 필요합니다.

“어느 모델이 이기는가”에 대한 솔직한 답변은: 이기는 것이 작업당 최저 비용을 의미하는지, 특정 테스트에서의 강력한 벤치마크를 의미하는지, 아니면 프로덕션 시스템에서의 최저 위험을 의미하는지에 달려 있습니다. GLM-5V-Turbo는 디자인-to-코드 범주에서 처음 두 가지에 대해 신뢰할 수 있는 케이스를 제시합니다. GPT-4o는 세 번째에 대해 신뢰할 수 있는 케이스를 제시합니다.

어떤 답변도 영구적이지 않습니다. Z.ai는 빠르게 모델을 출시합니다. OpenAI도 마찬가지입니다. 중요한 비교는 자체 데이터, 자체 디자인 자산, 자체 품질 기준을 가지고 실행하는 것입니다.

모든 가격은 2026년 4월 2일 기준으로 확인되었습니다. GLM-5V-Turbo 벤치마크 데이터는 Z.ai 자체 보고이며, 작성 시점에 독립적인 제3자 평가가 발표되지 않았습니다. 프로덕션 예산 결정 전에 공식 출처에서 현재 가격을 확인하세요.

이전 게시물: