GLM-5V-Turbo vs GPT-4o Vision: UIコーディングで勝つのはどちらのモデル?

デザインからコードへのタスクにおけるGLM-5V-TurboとGPT-4o Visionの比較。2026年の機能、APIアクセス、料金、実際のユースケース適合性を徹底検証。

先週、チームのメンバーからこう聞かれた。「デザインからコードへのパイプラインをGPT-4oからGLM-5V-Turboに切り替えるべきか?」最初の直感は「両方テストしてみて」だった。次の直感は、テストに仮説を持って臨めるよう、まず実際にリサーチすることだった。

以下が調べた結果だ。ビジュアル入力からのUIコーディングとフロントエンド生成という特定タスクに絞っている。一般的なコーディングでも、推論ベンチマークでも、広範なモデルレビューでもない。入力がデザインで出力がコードという場面でどちらを使うべきか、という狭い問いだけに絞った。

短い答え

デザインをフロントエンドコードに大規模変換することが主なタスクなら、GLM-5V-Turboはより安価で、Design2Codeのパフォーマンスも優れていると主張している。汎用マルチモーダル推論、バックエンドコーディングのサポート、あるいは本番環境での実績が長いモデルが必要なら、GPT-4oの方が安全なデフォルト選択だ。

何を構築しているかを具体的にしたときに初めて、比較が面白くなる。

各モデルの最適化対象

GLM-5V-Turboは、Z.ai(智谱AI)のネイティブマルチモーダルエージェントモデルで、2026年4月1日にリリースされた。ビジュアルファーストのコーディングタスク——デザイン再現、GUIナビゲーション、スクリーン→アクションワークフロー——を中心に設計されている。ビジョンは後付けの機能ではなく、アーキテクチャの中核だ。

GPT-4oはOpenAIのマルチモーダルモデルで、2024年5月にリリースされ、本番ビジョンワークロードで今も広く使われている。画像、テキスト、音声を処理する。ビジュアル推論が得意な汎用モデルだが、デザインからコードへのタスクに特化して最適化されているわけではない。2025年末時点では既知の存在——十分にテストされ、安定しており、幅広いエコシステムサポートがある。

この2つのモデルは隣接しているが異なる問題を解いている。比較する前に理解しておくべき最も重要なことは、実はそこだ。

機能比較

デザインからコードへ・UIの再現

ここで差が最も顕著になる。Z.aiの報告によると、GLM-5V-TurboはDesign2Codeベンチマークで94.8を記録し、Claude Opus 4.6の77.3やGPT-4oの同様の範囲のパフォーマンスを上回っている。Design2Codeは、生成されたHTML/CSSがリファレンスモックアップをどれだけ忠実に再現するかを測定する——ピクセル精度、構造的忠実度、ビジュアル完全性だ。

繰り返すが、これらはZ.ai自身の数値だ。差は真剣に受け止める価値があるほど大きいが、コミットする前に自分のデザインアセットで独立した検証を省略するほど大きくはない。

実際には、GLM-5V-Turboはこのような場面でテストする価値がある:Figma→コードパイプライン、スクリーンショット→コンポーネント生成、ブレークポイントをまたいだデザイン仕様の再現、ビジュアルリファレンスが存在するUIマイグレーションワークフロー。「モックアップに見えた」が成功指標になるタスクだ。

GUIエージェントタスク

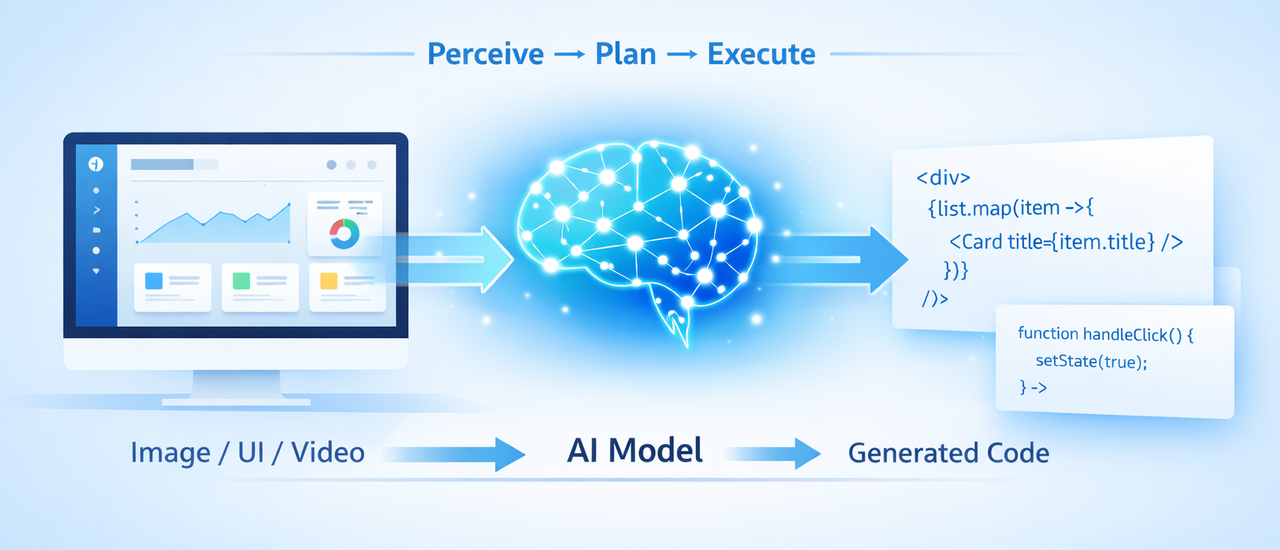

両モデルともGUIエージェントワークフローをサポートしているが、ネイティブ統合のレベルが異なる。GLM-5V-Turboはエージェント的な使用を念頭に構築されており、モデルが「認識→計画→実行」のループ全体を処理し、Z.aiが改善された呼び出し安定性(エージェントチェーンでのツール呼び出し失敗が少ない)と説明するツール呼び出しをサポートしている。Z.aiのドキュメントでは、これを機能追加ではなくコア設計目標として位置付けている。

GPT-4oはGUIエージェントワークフローで使用できるが、OpenAIの関数呼び出しとResponses APIインフラを通じて行う。2026年初頭時点で、GPT-4oはGUIエージェントの最前線の選択肢ではなく、ネイティブComputer Use APIを持つGPT-5.4がOpenAIのラインアップ内でその地位を占めている。GPT-4oは十分だが、最先端ではない。

一般的なコーディングとバックエンドタスク

ここで比較はGPT-4oに明確に傾く。GLM-5V-Turboはビジョン特化型モデルだ。Z.aiは、純粋なテキストコーディングカテゴリ——バックエンドロジック、複数ファイルのリポジトリ作業、API統合、ビジュアルコンテキストなしのデバッグ——でClaudeとGPT-4oに劣ることを認めている。モデルはこの分野で競合しておらず、Z.aiもそう主張していない。

GPT-4oは一般的なコーディングタスクをうまく処理するが、OpenAI自身のラインアップにおいても現在の市場で最強の選択肢ではない。テキストのみのコーディング作業には、いずれにせよGPT-4.1やGPT-5.4と比較することになるだろう。

実践的なポイント:ビジュアル入力から始まらないタスクにGLM-5V-Turboを使わないこと。それは間違ったツールだ。

マルチモーダル理解(画像、動画)

GLM-5V-Turboは同じコンテキスト内で画像、短い動画クリップ、テキストを受け付ける。動画入力により、画面録画分析、製品ウォークスルードキュメント、時系列UIステート追跡が可能になる。コンテキストウィンドウは202,752トークン、最大出力131,072トークン——複数画像や動画フレームの多いプロンプトには十分な量だ。

GPT-4oは画像入力(リクエストあたり複数画像を含む)を128Kコンテキストウィンドウでサポートする。画像は解像度に応じてトークンを消費する——1024×1024の画像を高精細モードで使うと約765トークンかかる(OpenAIのビジョンガイドに記載)。GPT-4oは動画を連続入力としてネイティブに処理しない。動画分析には手元でフレーム抽出が必要だ。

画面録画やマルチフレームの視覚シーケンスを含むパイプラインでは、GLM-5V-Turboに構造的な優位性がある。

並列比較

| 比較項目 | GLM-5V-Turbo | GPT-4o |

|---|---|---|

| API利用可能性 | Z.aiネイティブAPI + OpenRouter | OpenAI API |

| 入力価格 | $1.20 / 100万トークン | $2.50 / 100万トークン |

| 出力価格 | $4.00 / 100万トークン | $10.00 / 100万トークン |

| キャッシュ入力 | $0.24 / 100万トークン | $1.25 / 100万トークン |

| コンテキストウィンドウ | 202,752トークン | 128,000トークン |

| 最大出力 | 131,072トークン | 約16,384トークン |

| Design2Code | 94.8(Z.ai自己申告) | このタスクで独立したベンチマークなし |

| 純テキストコーディング | 弱い——フロンティアテキストモデルに劣る | 堅実な汎用性能 |

| エージェントワークフロー | ネイティブ設計、ツール呼び出し重視 | 関数呼び出し経由で可能。現在の最前線ではない |

| 動画入力 | あり——ネイティブ | なし——フレーム抽出が必要 |

| 実績 | 2026年4月リリース | 2024年5月から本番稼働中 |

GPT-4oの価格はOpenAIの公式API価格ページより。GLM-5V-Turboの価格はZ.aiの公式価格ドキュメントより。本番予算計画前に両方を確認すること——価格は両プラットフォームでモデル世代ごとに変動している。

APIと価格の比較

GLM-5V-Turboの価格とアクセス

入力100万トークンあたり$1.20、出力100万トークンあたり$4.00。Z.aiのOpenAI互換APIまたはマルチプロバイダールーティング用のOpenRouter経由でアクセス可能。標準APIキーセットアップ、関数呼び出しサポート、ストリーミングサポートあり。

注目すべき点がある:Z.aiは過去のモデルリリースでインフラの負荷に悩まされている。GLM-4.7のリリースでは容量の絞り込みが見られ、GLM-5はコンピュート負荷の警告とともに30%の値上げを伴ってリリースされた。GLM-5V-Turboは新しくリリースされたばかり——本番パイプラインをコミットする前に、現実的な負荷でのスループットをテストすること。

GPT-4oの価格とアクセス

入力100万トークンあたり$2.50、出力100万トークンあたり$10.00、キャッシュ入力は100万あたり$1.25。OpenAIのAPIを通じて利用可能で、充実したレート制限ドキュメント、企業契約、2年間の本番安定性がある。インフラの話は成熟している——何が得られるかがわかっている。

UIコーディングワークフローのタスクあたりコスト見積もり

典型的なデザインからコードへのタスク(入力:約1,500画像+プロンプトトークン、出力:約2,000トークン)では:

- GLM-5V-Turbo: タスクあたり約$0.004

- GPT-4o: タスクあたり約$0.027

これはおよそ6〜7倍の差だ。月10,000タスクで:約$40 vs 約$270。スケールでは大きな差があるが、少量評価では無関係だ。

GLM-5V-Turboを使うべき場面

デザイン → フロントエンドコードのパイプライン

ワークフローがデザインアーティファクト——Figmaエクスポート、スクリーンショット、ワイヤーフレーム——から始まり、HTML、CSS、またはコンポーネントの骨格で終わるなら、GLM-5V-Turboは現在のソリューションに対してベンチマークする価値がある。Design2Codeの数値は自己申告だが方向性は信頼できる。タスクあたりのコストは意味のある差がある。そしてアーキテクチャは汎用モデルから適応されたものではなく、このユースケースのために目的を持って構築されている。

低コストのビジュアルコーディングタスク

大量のimage-in→code-outパイプラインを運用するチーム——デザインシステム生成、バッチUI再現、スクリーンショットからのスタイル抽出——にはコスト差が積み上がる。$1.20/$4.00で、GLM-5V-TurboはGPT-4oより両端で安い。

GPT-4oビジョンを使うべき場面

汎用マルチモーダル推論

ビジュアルコーディングがより広いワークフローの一部である場合——画像分析、混合推論、ドキュメント理解、またはビジュアル入力がメインではなくコンテキストとなるタスク——GPT-4oがより良い選択だ。より汎用的で、特定のデザインからコードへのニッチ以外でも信頼性が高い。

確立されたAPIエコシステムと安定性

2年間の本番使用は、十分にテストされたレート制限、確立されたエラーハンドリングパターン、そして豊富なコミュニティ知識に変換される。チームがすでにOpenAIのエコシステムに統合している場合——SDK、モニタリングツール、またはコンプライアンスインフラを使用している場合——ビジョンタスクのためにGPT-4oに留まることは、見かけよりも低い切り替えコストになる。

意思決定フレームワーク

ベンチマークランキングではなくタスクで選ぶ

モデル比較で多くのチームが犯す間違いは、ベンチマークランキングを適合性の代替指標として扱うことだ。GLM-5V-TurboのDesign2Codeスコアは、より優れたモデルであることを意味しない——その特定のタスクタイプにおいてより優れたモデルであることを意味する。GPT-4oの幅広い機能は、パイプラインが純粋にビジュアルからフロントエンドへのものであれば、パイプラインにとってより良いものにはしない。

意思決定ツリーは見かけよりシンプルだ:

タスクはビジュアル入力から始まり、コードで終わるか?

- はい、かつ量が意味のある規模→ GLM-5V-Turboを最初にテスト。コストの観点が強く、ベンチマーク数値も方向性として有利だ。

- はい、ただし量は少ない→ どちらでも機能する。OpenAIにすでに対応しているなら、GPT-4oの方がセットアップのフリクションが少ない。

タスクにビジュアル以外のコーディング、推論、またはバックエンド作業が含まれるか?

- はい→ GPT-4o、またはテキストのみのモデルの検討も。

本番インフラの安定性が必要か?

- はい、かつ近日中にローンチ→ GPT-4o。GLM-5V-Turboはリリースされてから3日だ。

よくある質問

Q: GLM-5V-TurboはデザインからコードへにおいてGPT-4oより優れているか? Z.aiの自己申告によるDesign2Codeベンチマーク(94.8 vs GPT-4oに匹敵するスコア)に基づくと、その特定のタスクでは——はい。これらの数値はまだ独立して検証されていない。決定を下す前に、自分のデザインアセットでテストすること。

Q: GLM-5V-TurboとGPT-4oのコストはどのくらい違うか? GLM-5V-Turbo:入力/出力それぞれ$1.20/$4.00(100万トークンあたり)。GPT-4o:$2.50/$10.00。入力で約2倍、出力で約2.5倍安い。典型的なUIコーディングタスクでの差は、タスクあたり約$0.004 vs 約$0.027。予算策定前に現在の価格をdocs.z.aiとopenai.com/api/pricingで確認すること。

Q: GLM-5V-Turboは動画入力を処理できるか? はい——同じコンテキスト内で画像やテキストと並べて短い動画クリップを処理できる。GPT-4oは連続した動画をネイティブに受け付けない。フレームごとの抽出が手元で必要だ。

Q: 本番UIコーディングパイプラインにはどちらのモデルが優れているか? タイムラインによる。GLM-5V-Turboはこのユースケースでより良いコスト構造とベンチマークの主張を持っているが、2026年4月1日にリリースされたばかりで——まだ本番実績がない。近日中にローンチするものには、GPT-4oがリスクの低い選択だ。独立した評価が出てくる60〜90日後にGLM-5V-Turboを再評価すること。

Q: GLM-5V-TurboにAPIからアクセスするにはどうすればよいか? z.aiのZ.aiネイティブAPI(OpenAI互換フォーマット)、または代替ルーティングレイヤーとしてOpenRouter経由でアクセス可能。標準のAPIキー登録が必要だ。

「どちらのモデルが勝つか」への正直な答えは:タスクあたりの最低コストを意味するのか、特定のテストでの最強ベンチマークを意味するのか、それとも本番システムでの最低リスクを意味するのかによる。GLM-5V-Turboはデザインからコードへのカテゴリで最初の2つについて信頼できる主張をしている。GPT-4oは3つ目について信頼できる主張をしている。

どちらの答えも永続的ではない。Z.aiはモデルを素早くリリースする。OpenAIもそうだ。重要な比較は、自分のデータで、自分のデザインアセットで、自分の品質基準に対して行うものだ。

すべての価格は2026年4月2日時点で確認済み。GLM-5V-Turboのベンチマークデータはz.aiの自己申告。執筆時点で独立したサードパーティ評価は発表されていない。本番予算決定前に公式ソースで現在の価格を確認すること。

関連記事: