Apa Itu Qwen3.5-Omni: Kemampuan, Varian, dan Akses API

Qwen3.5-Omni baru saja diluncurkan dengan varian Plus, Flash, dan Light. Berikut yang perlu diketahui para pengembang tentang kemampuan, akses API, dan penggunaan di lingkungan produksi.

Halo semua! Ini Dora yang kembali lagi! Saya sedang mengedit proyek video ketika notifikasi muncul: Qwen3.5-Omni baru saja dirilis. Saya sudah menjalankan keluarga Qwen3-Omni di beberapa alur kerja produksi selama berbulan-bulan, jadi saya langsung tahu ini bukan pembaruan kecil. Jendela konteks 256K, kloning suara, interupsi semantik, dan 113 bahasa untuk pengenalan suara — semuanya dalam satu model. Saya harus berhenti dari pekerjaan yang sedang saya lakukan.

Jika Anda membangun agen suara, pipeline kaptioning, atau apa pun yang harus menangani audio dan video manusia nyata secara bersamaan, rilis ini langsung relevan bagi Anda. Izinkan saya memandu apa yang sebenarnya dilakukannya, apa arti tiga varian dalam praktik, dan cara mendapatkan akses — termasuk hal-hal yang masih belum jelas hingga hari ini.

Apa yang Sebenarnya Dilakukan Qwen3.5-Omni

Teks, Gambar, Audio, dan Video dalam Satu Panggilan Inferensi

Inilah hal yang terus diremehkan dalam pengumuman AI: pemrosesan multimodal native dan pemrosesan multimodal stitched-pipeline bukanlah hal yang sama.

Ketika model non-omnimodal seperti ChatGPT 5.4 diberi video, ia harus mengekstrak frame melalui model visi, menjalankan audio melalui sesuatu seperti Whisper untuk transkripsi, dan menerapkan OCR untuk membaca subtitle yang tertanam — tiga proses terpisah yang disambungkan untuk memperkirakan apa yang dilakukan model omni sejati dalam satu kali proses. Dalam kondisi ideal, dengan klip yang terang dan audio yang jernih, itu memakan waktu sembilan menit dalam satu pengujian nyata.

Qwen3.5-Omni menangani input yang sama dalam satu panggilan. Anda mengirim video. Anda mendapatkan respons. Tidak ada pipeline perantara. Tidak ada overhead konversi format. Tidak ada model audio yang tidak tahu apa yang terjadi di layar dan model visi yang tidak bisa mendengar apa pun.

Model ini mendukung pemahaman teks, gambar, audio, dan audio-video, dengan komponen Thinker dan Talker keduanya menggunakan arsitektur Hybrid-Attention MoE. Bagian terakhir itu lebih penting dari kedengarannya, yang akan saya bahas di bagian arsitektur di bawah.

Apa Arti “Omnimodal” dalam Praktik vs. Pipeline Stitched

Perbedaannya muncul dalam skenario yang memang sulit bagi sistem stitched. Bayangkan: rekaman layar di mana seseorang sedang coding dan bernarasi pada saat yang sama. Atau panggilan layanan pelanggan di mana konteksnya setengah verbal dan setengah di layar. Atau alur kerja kaptioning aksesibilitas di mana audio ambient dan aksi visual keduanya membawa makna secara independen.

Tim Qwen mendemonstrasikan apa yang mereka sebut “Audio-Visual Vibe Coding” — model dapat menonton rekaman layar dari tugas coding dan menulis kode fungsional berdasarkan murni apa yang dilihat dan didengarnya, tanpa prompt teks yang diperlukan.

Itu nama demo yang aneh, tetapi ini adalah celah kemampuan nyata dibandingkan dengan model berbasis teks dengan audio yang ditambahkan. Ketika penalaran dan persepsi terjadi di dalam model yang sama pada saat yang sama, hal-hal yang memerlukan konteks lintas-modal benar-benar berfungsi.

Tiga Varian: Plus, Flash, dan Light

Plus — Pemimpin Benchmark, Ketika Nilainya Sebanding dengan Biayanya

Qwen3.5-Omni-Plus mencapai 215 hasil SOTA di seluruh tugas pemahaman audio dan audio-video, penalaran, dan interaksi. Itu angka yang besar, dan benchmark Alibaba cenderung menghitung secara agresif — tetapi perbandingan independen mendukungnya dalam kategori yang penting.

Pada benchmark standar, Qwen3.5-Omni Plus mengungguli Gemini 3.1 Pro dalam tugas pemahaman audio umum, penalaran, dan terjemahan, serta menyamainya dalam pemahaman audio-visual. Dalam stabilitas suara multibahasa di 20 bahasa, ia mengalahkan ElevenLabs, GPT-Audio, dan Minimax.

Kloning suara tersedia di Plus dan Flash melalui API — Anda mengirim sampel suara 10–30 detik, dan model mengkloningnya untuk output.

Kapan Anda membayar untuk Plus? Ketika kualitas output adalah hal yang benar-benar diperhatikan pengguna Anda. Produk agen suara di mana naturalitas suara adalah proposisi nilai inti. Transkripsi berisiko tinggi di mana akurasi pada bahasa langka sangat penting. Apa pun di mana Anda membandingkan langsung dengan Gemini atau GPT-Audio dan Anda perlu menang dalam kualitas.

Flash — Kompromi Throughput dan Latensi

Flash adalah rekomendasi default untuk penggunaan produksi menurut dokumentasi API. ID model untuk varian standar adalah qwen3.5-omni-flash, dan Flash digambarkan sebagai default saat menyeimbangkan latensi, kualitas, dan respons untuk sebagian besar skenario produksi.

Bagi kreator yang membangun alur kerja berbantuan AI — pipeline kaptioning otomatis, transkripsi wawancara real-time, ringkasan video skala besar — Flash hampir pasti menjadi titik awal Anda. Anda menguji batch terhadap Plus untuk melihat apakah delta kualitas sebanding dengan perbedaan biaya untuk kasus penggunaan spesifik Anda.

Pendahulunya Qwen3-Omni Flash sudah memiliki respons suara streaming dengan latensi serendah 234 milidetik. Harapkan Qwen3.5-Omni Flash berada dalam rentang yang serupa, meskipun benchmark latensi yang dipublikasikan secara tepat untuk 3.5 secara spesifik belum dikonfirmasi dalam catatan rilis awal.

Light — Kasus Penggunaan Edge dan Anggaran Terbatas

Light adalah varian terkecil dalam keluarga ini. Jumlah parameter untuk seri 3.5-Omni belum sepenuhnya dikonfirmasi pada saat penulisan ini, tetapi model 30B-A3B pendahulunya berjalan cukup baik pada perangkat keras konsumen dengan kuantisasi yang tepat, dan varian Light di sini bisa mengikuti pola serupa.

Jika Anda membuat prototipe, membangun sesuatu untuk klien dengan biaya inferensi yang ketat, atau benar-benar menjalankan di edge, Light adalah tempat Anda memulai. Jangan mencoretnya sebagai “yang buruk” — untuk banyak alur kerja alat kreator (bayangkan: kaptioning thumbnail otomatis, Q&A sederhana atas audio yang diunggah), kemungkinan besar sudah lebih dari cukup.

Yang Baru vs. Qwen3-Omni

Jendela Konteks: 256K Token, 10+ Jam Audio

Ini adalah perubahan yang paling saya pedulikan dari sudut pandang produksi praktis.

Jendela konteks 256K token diterjemahkan menjadi lebih dari 10 jam audio, atau sekitar 400 detik video 720p dengan audio. Itu adalah lompatan yang berarti. Mode berpikir Qwen3-Omni pendahulunya maksimal di 65.536 token dengan rantai penalaran 32.768 token — berguna, tetapi terbatas untuk media format panjang.

Untuk analisis podcast, pemrosesan wawancara format panjang, ringkasan panggilan pelanggan yang diperpanjang — jendela konteks ini mengubah apa yang sebenarnya layak dalam satu panggilan API.

Cakupan Bahasa: 113 Pengenalan, 36 Generasi

Pengenalan suara sekarang mencakup 113 bahasa dan dialek, naik dari 19 pada pendahulunya. Generasi suara diperluas dari 10 bahasa menjadi 36.

Catatan jujur di sini: Alibaba memang menghitung dialek regional dengan cara yang menggelembungkan angka-angka ini dibandingkan dengan cara, misalnya, OpenAI menghitung cakupan yang sama. Bahkan dengan diskon untuk itu, lompatannya nyata. Jika Anda membangun untuk pasar Asia Tenggara, konten Arab, atau alur kerja suara multibahasa apa pun, ini adalah peningkatan praktis yang signifikan.

Thinker-Talker dengan Hybrid-Attention MoE

Arsitektur Thinker-Talker pertama kali diperkenalkan di Qwen2.5-Omni. Peningkatan penting di 3.5-Omni adalah bahwa kedua komponen sekarang menggunakan desain Hybrid-Attention MoE (Mixture-of-Experts), mengikuti pergeseran keluarga Qwen3.5 yang lebih luas menuju arsitektur sparse.

Mengapa ini penting bagi developer: pemisahan Thinker-Talker memungkinkan sistem eksternal — pipeline RAG, filter keamanan, pemanggilan fungsi — untuk mengintervensi antara dua tahap sebelum sintesis suara dimulai. Itu bukan sekadar detail arsitektur. Ini berarti Anda dapat menyisipkan logika Anda sendiri antara apa yang dipikirkan model dan apa yang dikatakannya dengan lantang. Untuk agen suara produksi, itu benar-benar berguna.

Interupsi Semantik dan Kloning Suara

Siapa pun yang pernah men-deploy bot suara tahu rasa sakitnya: pengguna batuk, anjing menggonggong, seseorang berkata “mm-hmm,” dan bot berhenti di tengah respons mengira sedang diinterupsi.

Qwen3.5-Omni menambahkan interupsi semantik, yang mencoba membedakan antara pengguna yang benar-benar ingin menyela dan kebisingan latar belakang ambient atau komentar yang lewat. Ini adalah salah satu fitur yang terdengar minor dalam changelog tetapi sebenarnya adalah perbedaan antara asisten suara yang membuat orang frustrasi dan yang terus mereka gunakan.

Kloning suara dan kontrol suara real-time untuk kecepatan, volume, dan emosi juga baru. Tim menyebutkan fitur bernama ARIA yang meningkatkan stabilitas dan naturalitas output suara — spesifikasi teknis tentang apa yang dilakukan ARIA secara internal belum dirinci dalam rilis awal.

Cara Mengakses Qwen3.5-Omni

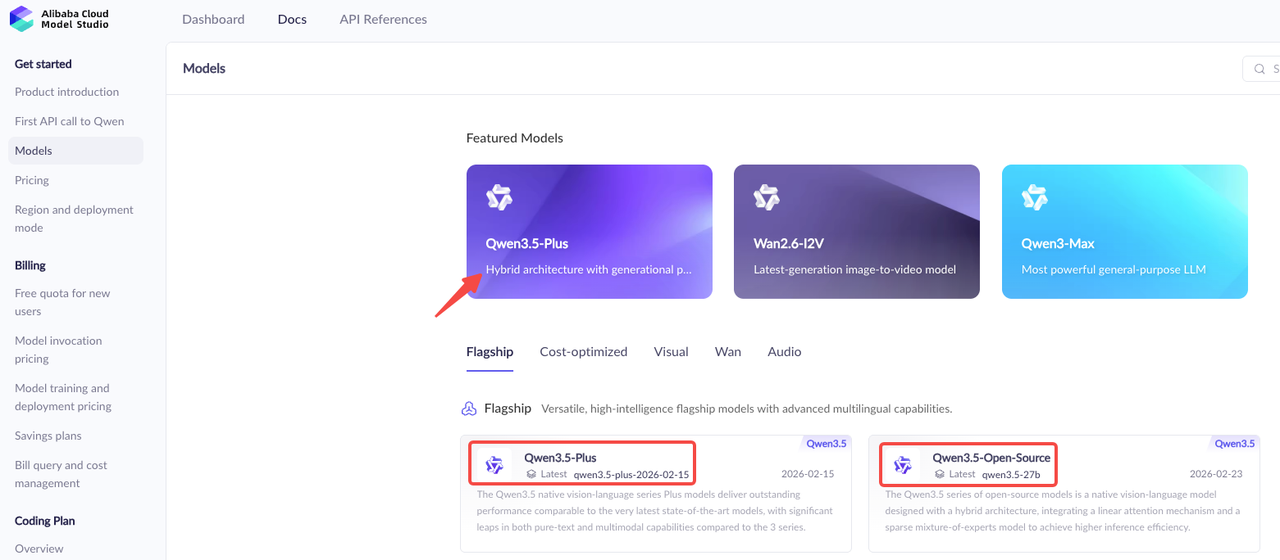

DashScope API (Alibaba Cloud)

Jalur akses produksi utama adalah melalui DashScope API Alibaba Cloud. Ini menggunakan antarmuka yang kompatibel dengan OpenAI, yang berarti jika Anda sudah menggunakan GPT-4o atau Claude melalui OpenAI SDK, migrasinya mudah.

DashScope mendukung beberapa wilayah: Singapura (internasional), US Virginia, China Beijing, dan Hong Kong, dengan URL endpoint yang berbeda untuk masing-masing. Untuk sebagian besar tim di luar China, endpoint internasional Singapura adalah default Anda: dashscope-intl.aliyuncs.com.

ID model untuk ketiga varian mengikuti pola qwen3.5-omni-plus, qwen3.5-omni-flash, dan qwen3.5-omni-light. Struktur API mengikuti format standar /v1/chat/completions dengan parameter modalities untuk menentukan apakah Anda menginginkan teks, audio, atau keduanya dalam respons.

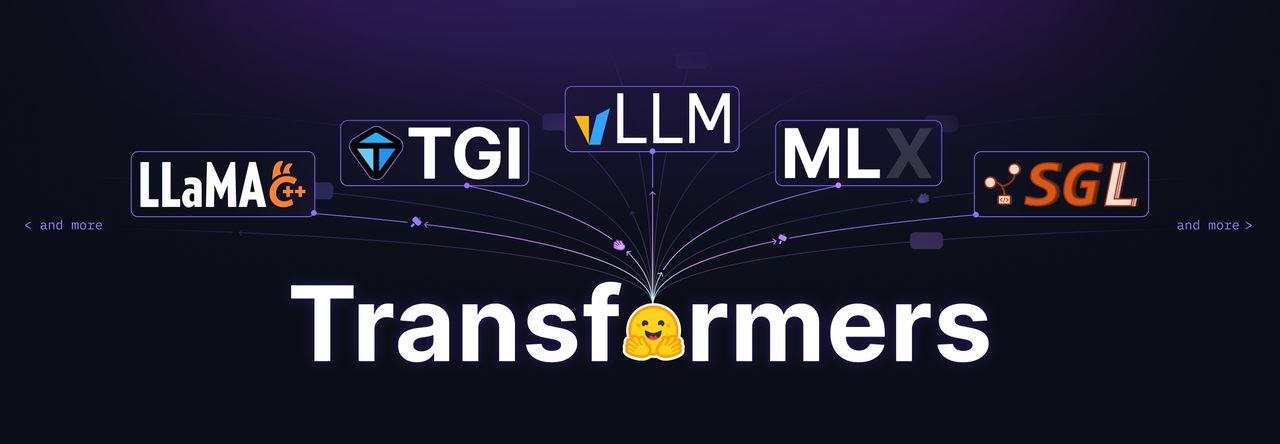

Opsi Self-Hosting vLLM

Tim Qwen sangat merekomendasikan vLLM untuk inferensi dan deployment model seri Qwen-Omni, menyediakan image Docker yang mencakup lingkungan runtime lengkap untuk HuggingFace Transformers dan vLLM.

Peringatannya adalah bahwa kecepatan inferensi dengan HuggingFace Transformers pada model MoE bisa sangat lambat, jadi untuk persyaratan skala besar atau latensi rendah, vLLM atau DashScope API adalah jalur yang direkomendasikan.

Jika Anda melakukan self-hosting, rencanakan di sekitar vLLM 0.13.0 secara spesifik — itulah versi yang direferensikan dalam dokumentasi pengaturan resmi. Arsitektur MoE berarti persyaratan memori lebih rendah dari model dense yang sebanding pada tingkat kualitas yang sama, tetapi Anda tetap ingin memvalidasi alokasi GPU sebelum menjalankan deployment produksi.

Status Open-Weight: Apa yang Dikonfirmasi vs. Tertunda

Di sinilah saya ingin berhati-hati dan tidak berspekulasi di luar apa yang dikonfirmasi.

Qwen3-Omni (pendahulunya) dirilis di bawah Apache 2.0 di GitHub dan HuggingFace. Apakah bobot Qwen3.5-Omni akan mengikuti jalur lisensi Apache 2.0 yang sama belum dikonfirmasi dalam pengumuman awal. Bobot pendahulunya tersedia untuk umum — bobot 3.5 mungkin mengikuti, tetapi pada tanggal rilis 30 Maret, konfirmasi itu masih tertunda.

Jangan membangun rencana deployment open-weight Anda di sekitar ini sampai repo GitHub resmi atau kartu model HuggingFace mengonfirmasi lisensi. Periksa QwenLM GitHub untuk pembaruan.

Siapa yang Harus Memperhatikan Rilis Ini

Pembangun Agen Suara dan Percakapan Real-Time

Jika Anda membangun aplikasi berbasis suara — bot layanan pelanggan, pendamping AI, alat suara interaktif — Qwen3.5-Omni layak dievaluasi dengan serius. Interupsi semantik saja sudah mengatasi titik nyeri yang diketahui yang pernah dialami setiap developer agen suara. Tambahkan pemanggilan fungsi native dan pencarian web, dan ini mulai terlihat seperti infrastruktur nyata daripada rilis penelitian.

Posting blog Qwen menyoroti dukungan pencarian web native dan pemanggilan fungsi yang langsung terpasang ke dalam model omni, yang memposisikannya kurang sebagai artefak penelitian dan lebih sebagai infrastruktur untuk aplikasi berbasis suara.

Alur Kerja Produksi Audio-Visual dan Kaptioning

Untuk alat kreator, otomatisasi produksi video, dan kaptioning skala besar — ini adalah rilis paling menarik dalam ruang multimodal open-weight saat ini. Konteks audio 10+ jam berarti Anda dapat memproses konten berdurasi penuh dalam satu panggilan. Cakupan bahasa yang diperluas berarti konten multibahasa bukan lagi kasus khusus.

Kombinasi pemahaman audio dan analisis frame video dalam satu panggilan inferensi juga membuat ini benar-benar berguna untuk hal-hal seperti: ekstraksi highlight otomatis, kaptioning B-roll, transkripsi sulih suara dengan korelasi teks di layar.

Tim yang Sudah Menjalankan Qwen3-Omni dalam Produksi

Jika Qwen3-Omni sudah ada dalam tumpukan Anda, peningkatan ke Qwen3.5-Omni mudah dilakukan. Struktur API konsisten. Peningkatan jendela konteks saja sudah cukup membuat ini layak diuji pada beban kerja Anda yang ada — terutama apa pun yang menabrak batas token 65K.

Apa yang Tidak Dicakupnya

Bukan Model Generasi Gambar

Penting untuk dikatakan dengan jelas karena “omnimodal” menciptakan kebingungan: Qwen3.5-Omni menghasilkan teks dan ucapan. Ia tidak menghasilkan gambar atau video. Ia memahami gambar dan video sebagai input — itu adalah kemampuan yang sepenuhnya berbeda. Jika generasi gambar yang Anda butuhkan, lihat lini model VL dan generasi gambar Qwen yang terpisah, atau model qwen-image-plus dalam katalog DashScope.

Kecepatan Inferensi pada MoE: vLLM vs. HuggingFace Transformers

Ini menjebak banyak orang dengan Qwen3-Omni dan akan menjebak orang dengan 3.5-Omni juga. Karena Qwen3-Omni menggunakan arsitektur MoE, kecepatan inferensi dengan HuggingFace Transformers pada model MoE bisa sangat lambat. Untuk invokasi skala besar atau persyaratan latensi rendah, vLLM atau DashScope API sangat direkomendasikan.

Jangan melakukan benchmark pada HuggingFace Transformers dan menyimpulkan bahwa modelnya lambat. Uji pada vLLM atau API terkelola sebelum membentuk pandangan tentang kelayakan produksi.

FAQ

Apakah Qwen3.5-Omni open source atau open weight?

Per rilis 30 Maret 2026, status open-weight Qwen3.5-Omni belum dikonfirmasi secara resmi. Pendahulunya Qwen3-Omni adalah Apache 2.0 open-weight dan tersedia di HuggingFace. Harapkan jadwal rilis yang serupa untuk 3.5-Omni, tetapi verifikasi di QwenLM GitHub resmi sebelum bergantung padanya.

Bisakah saya melakukan self-host Qwen3.5-Omni-Plus?

DashScope API adalah jalur produksi yang dikonfirmasi saat ini. Self-hosting melalui vLLM didukung untuk Qwen3-Omni dan kemungkinan akan didukung untuk 3.5-Omni setelah bobot dirilis. Arsitektur MoE varian Plus berarti persyaratan parameter aktif lebih rendah dari model dense yang sebanding, tetapi Anda akan membutuhkan pengaturan multi-GPU untuk varian Plus penuh.

Apakah mendukung pemanggilan fungsi dan pencarian web secara native?

Ya. Posting blog Qwen secara eksplisit menyoroti dukungan pencarian web native dan pemanggilan fungsi yang dibangun ke dalam model omni. Pemanggilan fungsi mengikuti format alat OpenAI standar melalui DashScope API. Ini adalah pembeda yang berarti — Anda dapat membangun agen suara yang mengkueri data langsung tanpa merutekan melalui lapisan orkestrasi terpisah.

Posting Sebelumnya: