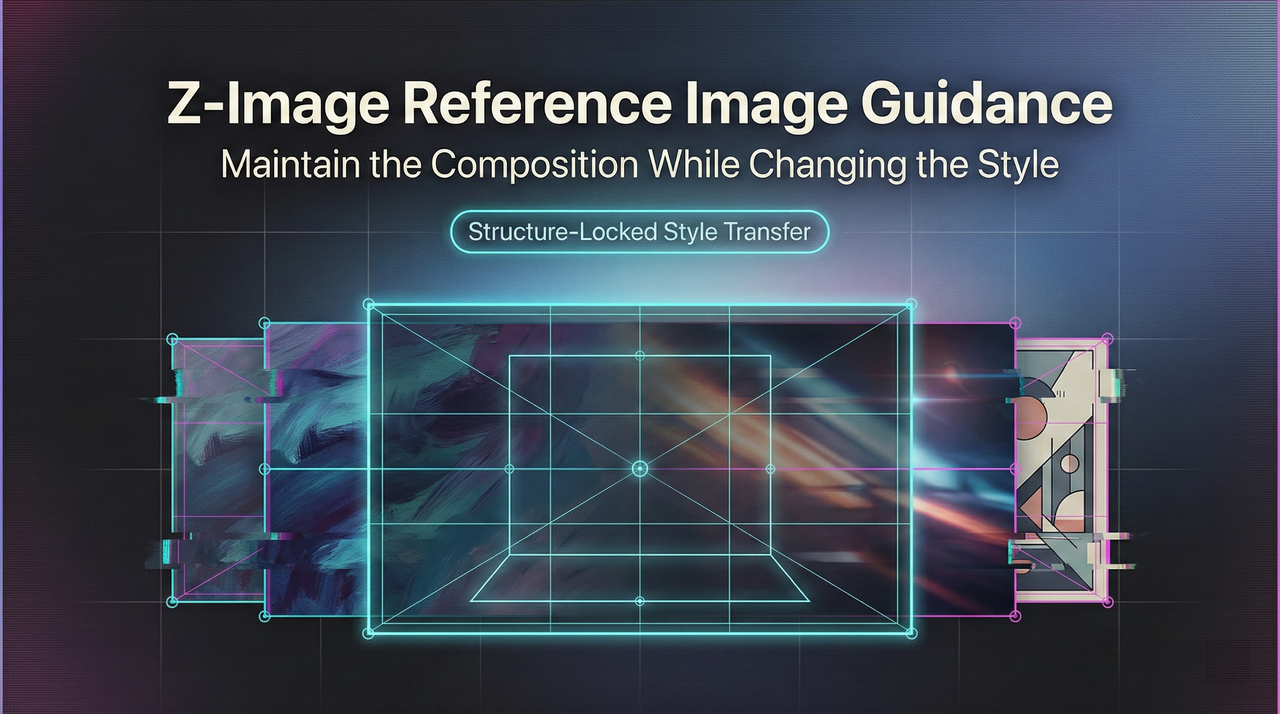

Guide de référence d'image Z-Image : Maintenir la composition tout en changeant le style

Guide de référence complet Z-Image-Base : Explication détaillée du paramètre « Force » (Guidage fort : 0,2 - 0,4 vs. Guidage faible : 0,6 - 0,8), Flux de travail de transfert de style, Techniques de rétention de composition.

Bonjour, je m’appelle Dora. Vous savez quoi ? Je générais une belle image une fois, puis j’échouais à la reproduire plus tard. Même prompt, besoin légèrement différent, ambiance totalement différente. Je voulais plus de stabilité, pas un modèle figé, juste quelques garde-fous.

C’est alors que j’ai passé une semaine à explorer le guidage par image de référence de Z-Image. Non pas parce que c’est spectaculaire, mais parce que cela promettait quelque chose de simple : conserver ce qui compte d’une image de départ tout en laissant le modèle explorer. Voici les notes que j’aurais aimé avoir dès le départ, comment ça se ressent en pratique, où ça dérape, et les réglages discrets qui ont le plus pesé dans la balance.

Qu’est-ce que le guidage par image de référence

Le guidage par image de référence (parfois appelé conditionnement img2img ou reference conditioning) vous permet de fournir à un modèle une image réelle en plus de votre prompt textuel. Le modèle utilise cette image d’entrée comme ancre : style, composition, palette de couleurs ou structure, selon les réglages choisis, tout en restant attentif à vos mots.

En pratique, je traite l’image de référence Z-Image comme un « définisseur de tonalité ». Je ne lui demande pas de tout faire. Je l’utilise pour réduire la variance là où ça compte (pose, palette, mise en page) et je laisse le prompt gérer le reste.

Différence avec la génération purement texte-vers-image

J’ai lancé le même prompt de deux façons : une fois sans image, une fois avec une référence. Sans image, j’ai obtenu un éventail de résultats variés : certains avec de l’atmosphère, d’autres plats, quelques-uns inutilisables. Quand j’ai ajouté une image de référence (une simple scène de bureau photographiée avec mon téléphone), le modèle a conservé la disposition du bureau, la lumière douce du jour, même la sensation du grain du bois, tout en remplaçant les objets que je demandais. Ça ne semblait pas « verrouillé ». Ça semblait poliment contraint.

Le texte pur est excellent pour l’exploration. Mais quand vous avez besoin de reproductibilité (variantes de campagne, angles de produits, visuels de diapositives), l’image de référence réduit l’aléatoire. C’est là que ma charge mentale a le plus diminué : moins de redémarrages, moins de contorsions de prompt.

Portée d’influence de l’image de référence

La référence peut influencer différentes couches :

- Composition globale : angle de caméra, placement du sujet, espace négatif.

- Indices de style : éclairage, densité de texture, température de couleur.

- Structure locale : silhouette, pose, contour du produit.

Ce qui m’a surpris : l’influence de l’image de référence se manifeste même quand je ne décris pas ces détails dans le texte. Si votre référence a un éclairage dur par le dessus, vos résultats peuvent en hériter, sauf si vous contrebalancez dans le prompt (ex. : « éclairage latéral doux, reflets atténués »).

Explication détaillée du paramètre « Strength »

Les systèmes le nomment différemment (strength, fidelity, guidance scale pour l’image, etc.). La signification est similaire : les valeurs faibles s’accrochent à la référence, les valeurs élevées desserrent la prise. Si vous ajustez aussi l’influence du texte, cette analyse des meilleurs réglages CFG de Z-Image se combine bien avec les ajustements de strength.

Voici comment ces plages se sont comportées pour moi sur environ 60 générations. Votre expérience peut varier, les modèles diffèrent, mais la forme de la courbe tend à se maintenir.

0,2–0,4 : Guidage par référence fort (maintien de l’image originale)

Entre 0,2 et 0,4, l’image de référence Z-Image agit comme du ciment frais. Le modèle conserve la composition, l’éclairage et même les petites textures. Si je change le texte comme « remplacer le carnet par une tablette », il le fera généralement, mais la tablette se retrouvera exactement là où était le carnet. Idéal pour :

- Les changements de couleur de produit

- Les modifications mineures d’accessoires

- Le rafraîchissement d’étiquettes ou d’emballages

Friction : des artefacts apparaissent si le texte demande des changements structurels que la référence ne peut pas soutenir. Exemple : transformer un ordinateur portable fermé en ouvert dans la même pose m’a donné une géométrie déformée à 0,3. Quand je me heurte à ce mur, soit j’augmente légèrement la strength, soit je change la référence pour une avec une pose compatible.

0,4–0,6 : Zone équilibrée

C’était mon réglage quotidien. À 0,5, le modèle conserve la structure de la scène mais réécrit les détails avec moins de résistance. La composition tient : les objets peuvent se déplacer légèrement : l’éclairage peut s’adoucir ou se réchauffer. C’est suffisamment cohérent pour un ensemble d’images liées sans que tout se ressemble comme des clones.

Ce qui a aidé : indiquer ce qu’il faut conserver. J’ai obtenu de meilleurs résultats avec des prompts comme « conserver l’angle du bureau et la lumière du jour : remplacer la tasse par un verre : ajouter une plante, faible profondeur de champ ». La combinaison strength moyenne + garde-fous explicites a surpassé les adjectifs vagues.

0,6–0,8 : Guidage faible (plus créatif)

Ici, la référence devient une suggestion, pas une règle. Le modèle change librement l’angle de caméra, ajoute ou supprime des éléments, et parfois met à jour le style. J’ai utilisé 0,7 pour l’expansion de moodboard : même ambiance, nouvelles pièces. Environ 30 à 40 % des résultats faisaient encore un clin d’œil à la palette originale.

Mise en garde : cette plage est plus susceptible de mal interpréter les petits détails de produit (ports, motifs de coutures) sauf si vous les renforcez dans le texte ou fournissez une référence en plus haute résolution. J’ai remarqué des coutures étranges sur des sacs et de mauvais biseaux sur des appareils. Corrigeable, mais ça mérite vérification.

0,8–1,0 : Ignorer presque l’image de référence

Au-delà de ~0,8, je traite la référence comme un indice d’une réunion précédente. Elle peut reconnaître des couleurs ou une silhouette approximative, mais pas grand-chose d’autre. Parfois c’est suffisant : si tout ce que je veux, c’est « garder un aspect chaud et orienté bois », 0,85 m’y amène tout en invitant de nouveaux angles.

Mais pour un travail de production, je ne reste pas longtemps ici. C’est plus proche d’une génération purement textuelle avec un léger coup de pouce. Quand j’arrive à 0,9, c’est parce que j’ai choisi la mauvaise référence pour le travail et que j’essaie d’en extraire uniquement la palette. Il vaut généralement mieux choisir une meilleure référence et redescendre à 0,5.

Implémentation API

J’ai testé les appels API avec une configuration simple utilisant requests et un petit wrapper. Je préfère partir du HTTP brut parce que ça montre ce qui est réellement requis, et ce qui est du bruit facultatif.

Si vous débutez avec le reference conditioning, il vaut la peine de parcourir la documentation du fournisseur pour comprendre comment il définit la strength et quelles valeurs par défaut il utilise. Pour les workflows similaires, j’ai trouvé les guides Hugging Face Diffusers sur image-to-image et ControlNet utiles. Les noms diffèrent, l’idée est la même.

Méthode de passage du paramètre « image »

Dans la plupart des API que j’ai testées, l’image de référence peut être passée sous l’une de ces formes :

- Une URL publique (plus rapide pour le prototypage, attention à la compression)

- Un URI de données encodé en base64 (fiable, un peu verbeux)

- Un upload multipart (idéal pour les fichiers locaux, garde l’EXIF/qualité sous votre contrôle)

J’envoie généralement un PNG ou JPEG de haute qualité d’environ 1024 px sur le grand côté. Trop petit, et les détails se perdent : trop grand, et vous payez la bande passante sans meilleurs résultats. Si l’A PI supporte plusieurs images de référence, commencez par une seule. En empiler trop à la fois peut annuler le signal.

PI supporte plusieurs images de référence, commencez par une seule. En empiler trop à la fois peut annuler le signal.

Exemple de code Python

Voici un pattern minimal que j’ai utilisé. Il est intentionnellement simple pour que vous puissiez l’adapter. Remplacez l’endpoint et la clé par ceux de votre fournisseur.

暂时无法在飞书文档外展示此内容

Scénarios d’application pratique

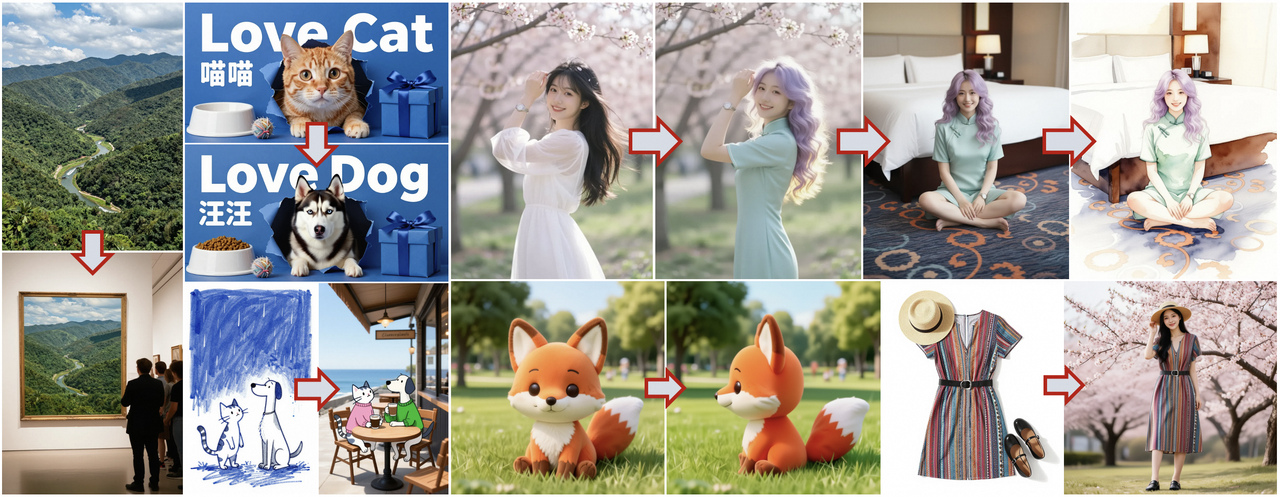

Transfert de style

J’ai utilisé une photo de produit nette comme référence et demandé « portrait studio dans le style film doux, halation, dégradé subtil ». À 0,45, le modèle a conservé la silhouette du produit et rendu l’éclairage cinématique sans déformer les bords. Quand j’ai descendu à 0,25, il s’est accroché à l’éclat studio original, agréable, mais moins stylisé. Si vous voulez un style plus marqué, montez vers 0,6 et renforcez avec 2 à 3 indices de style spécifiques. Au-delà, ça devient du bruit.

Variantes d’images de produits

Pour le rafraîchissement d’une page d’accueil, j’avais besoin de huit angles qui se ressemblent comme des frères et sœurs, pas des clones. J’ai fait une mise en scène soignée et l’ai utilisée comme image de référence Z-Image pour tous les prompts. Une strength à 0,5 m’a donné un grain cohérent et une balance des blancs uniforme sur toutes les prises tout en me permettant de faire pivoter l’objet, ajouter une main, ou changer un accessoire en arrière-plan. Le temps économisé n’était pas énorme par image (peut-être deux minutes), mais le soulagement mental d’éviter « pourquoi celle-ci est si différente ? » était bien réel.

Raffinement de diagrammes conceptuels

Les diagrammes sont l’endroit où le guidage par référence brille discrètement. J’ai esquissé une mise en page dans Figma, des boîtes, des flèches, des étiquettes approximatives, j’ai exporté un PNG et l’ai utilisé comme référence. Avec une strength à 0,4, je pouvais décrire le style (« minimal, lignes gris doux, couleur d’accent légère ») et le modèle préservait la structure. Ça a supprimé un tour d’édition aller-retour. Si une étiquette était mal alignée, je retouchais le fichier Figma original et relançais au lieu de me battre avec le prompt.

Bonnes pratiques

- Commencez avec une référence propre. Redressez, supprimez le désordre et normalisez l’exposition. Le modèle copie plus que vous ne le pensez.

- Choisissez la strength selon le besoin. 0,5 est un bon premier arrêt : descendez pour la fidélité, montez pour l’exploration.

- Indiquez ce qu’il faut conserver. Des garde-fous courts et explicites (« conserver l’angle et la palette ») réduisent la dérive.

- Adaptez la résolution au besoin. Environ 1024 px sur le grand côté est un défaut pragmatique pour la plupart des API.

- Itérez par petites étapes. Changez une chose à la fois (ajustement du prompt ou de la strength) pour voir les causes et les effets.

- Fixez un seed pendant le réglage. Abandonnez-le ensuite pour la variété.

- Surveillez le biais cumulatif. Si vous réutilisez continuellement un résultat comme prochaine référence, le style peut se figer. Revenez de temps en temps à votre original ou à une base neutre.

- Pour les équipes, sauvegardez le triptyque : image de référence, texte du prompt et valeur numérique de strength. Votre futur vous remerciera votre passé vous.

Si vous êtes entouré d’outils qui promettent de la magie, celui-ci est du genre plus discret. Il ne fera pas votre travail de goût. Il stabilise juste votre main. Je l’ai remarqué lors d’une session en fin d’après-midi : même bureau, même lumière, moins de remises en question. Pas un grand moment, mais ça m’a marqué.