Comment maintenir la cohérence des personnages dans Seedance 2.0 (Pack de référence + Règles)

Réduisez la dérive d'identité grâce à un pack de référence, des contraintes strictes et une checklist QA qui vous indique quoi modifier ensuite.

Vous voulez créer des vidéos cinématographiques comme Seedance 2.0 ? Essayez le WaveSpeed Cinematic Video Generator pour créer dès maintenant des vidéos cinématographiques de qualité Seedance 2.0.

Je n’avais pas prévu de corriger la dérive d’identité. Je voulais juste que le même personnage traverse une pièce deux fois sans se transformer en cousin éloigné. Le premier passage semblait correct en vignette. Puis j’ai scruté la vidéo et j’ai remarqué que la mâchoire s’était adoucie, que les cheveux avaient perdu une boucle, et qu’à la dernière seconde les yeux avaient une inclinaison différente. Pas vraiment étrange, juste… décalé. Seedance 2.0 est rapide et compétent, mais la cohérence des personnages est là où il peut vaciller.

Je m’appelle Dora. J’ai passé quelques nuits tardives ce mois-ci à faire tourner de petites boucles et à noter ce qui tenait. Voici ce qui m’a réellement stabilisé, et ce qui n’a pas fonctionné, quand la cohérence des personnages dans Seedance 2.0 était ma priorité absolue.

Pourquoi la dérive d’identité se produit (ce que le modèle « oublie »)

Seedance 2.0 jongle avec deux tâches à la fois : conserver un visage reconnaissable et produire un mouvement qui paraît vivant. Quand il doit choisir, il choisit souvent le mouvement. C’est là que la dérive d’identité s’infiltre.

Ce que j’observais constamment, run après run :

- Il maîtrise d’abord la silhouette générale (volume des cheveux, hauteur, morphologie globale).

- Puis les micro-détails dérivent sous la pression : espacement des yeux, longueur du philtrum, forme des oreilles, coins de la ligne capillaire. Sur les clips courts, cela se manifeste autour des transitions et des rotations de tête.

- Les changements d’éclairage se comportent comme des retouches douces de l’identité. Une lumière latérale a transformé mon personnage en une personne légèrement différente.

En coulisses (en pratique, sans prétendre voir les poids) : les prompts textuels poussent vers des correspondances de catégories (« jeune femme, carré bouclé, veste en jean »), tandis que les références ancrent la personne exacte. Si votre prompt surdécrit, la catégorie l’emporte. Si les références sont faibles ou incohérentes, le modèle « fait la moyenne » du visage.

J’ai également remarqué que le modèle « oublie » à des endroits prévisibles :

- Quand les mains croisent le visage, il traite l’image suivante comme un mini-remaniement.

- Les rotations rapides en lacet brisent la fidélité oreille/tempe.

- Les textures de vêtements avec des motifs répétitifs détournent parfois l’attention des repères du visage.

La dérive n’est donc pas aléatoire. C’est un glissement progressif du particulier vers le type. Comprendre cela a changé ma façon de préparer les entrées et d’écrire les prompts. Si vous luttez aussi contre une instabilité subtile des images, ce court guide sur la correction du scintillement et des à-coups dans Seedance 2.0 va de pair avec le contrôle d’identité.

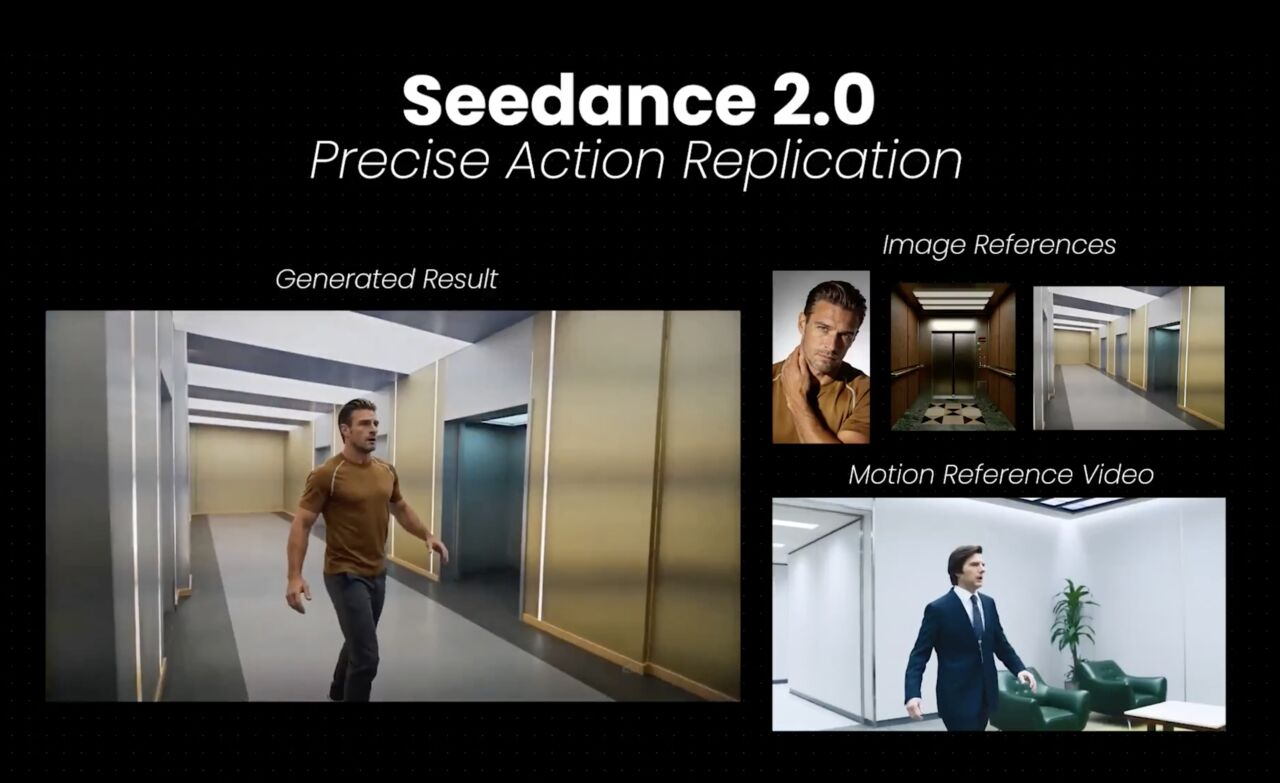

Construire un pack de références (images + clip court + ancre de style)

Ma plus grande avancée est venue d’une démarche simple : j’ai constitué un petit pack de références discipliné et restreint. L’annonce officielle de ByteDance souligne que Seedance 2.0 « excelle dans le suivi des instructions, permettant une reproduction précise et une cohérence stable des sujets, même pour des histoires complexes avec de riches interactions entre personnages. » Quand j’ai fourni à Seedance 2.0 des ancres moins nombreuses mais plus claires, mon personnage est resté cohérent.

Voici ce qui a le mieux fonctionné pour moi :

- Trois photos fixes maximum, pas dix. Je choisis : une de face, une en trois-quarts, une de profil. Même session, même éclairage. J’évite de sourire sur l’une et d’être neutre sur l’autre — trop de variété d’expression pousse le modèle à choisir un visage intermédiaire.

- Un clip de référence de 2 à 3 secondes avec un hochement de tête neutre ou un clignement lent. Je coupe les images mortes et garde le fond uni. Cela a donné au modèle une base de référence animée pour le comportement de la mâchoire et des yeux.

- Une ancre de style : un visuel qui fixe le rendu et le contraste. J’ai utilisé une image fixe d’un export précédent que j’aimais. Si je l’omettais, l’identité tenait mais l’ambiance dérivait ; avec elle, les deux restaient plus proches.

Ce qui n’a pas aidé :

- Les collages. Ils me semblent organisés, mais le modèle les traite apparemment comme une scène chargée.

- L’éclairage mixte. J’avais une prise de vue intérieure chaude et une prise de vue extérieure froide : le modèle les a moyennées en un ton neutre, ce qui a légèrement modifié le teint et l’âge apparent.

- Uniquement des portraits haute résolution. Curieusement, insérer une image en résolution moyenne parmi deux images nettes a aidé — peut-être parce que cela atténuait le surajustement aux pores et préservait la forme.

Je conserve ce pack dans un seul dossier avec des noms simples (front.jpg, threequarter.jpg, profile.jpg, ref.mp4, look.jpg). Cela réduit le temps de configuration à une minute, et je ne me pose plus de questions sur ce qu’il faut inclure. Cette légère réduction de friction mentale compte quand j’itère beaucoup.

Règles de prompt qui stabilisent l’identité (ce qu’il faut fixer, ce qu’il faut éviter)

J’ai arrêté d’écrire des prompts élaborés. Plus j’essayais d’impressionner le modèle, plus il ignorait mon personnage et courait après l’esthétique. Voici l’approche plus sobre qui a maintenu la cohérence des personnages dans Seedance 2.0 pour moi.

Ce que je fixe :

- Nommer la personne comme une entité unique, même fictive : « Même personnage que les références : une identité cohérente. » Cela semble redondant, mais cela empêchait le modèle de prélever des « variantes de type ».

- Verrouiller la tranche d’âge, les spécificités des cheveux et un ou deux traits distinctifs essentiels à la reconnaissance : « fin de vingtaine, boucles sombres serrées à hauteur des oreilles, petit anneau argenté dans l’oreille gauche. » Trop peu de détails, et le modèle généralise. Trop, et il fait son marché.

- L’intention du plan et le tempo : « boucle de marche lente à travers le cadre, expression subtile, pas de rotations dramatiques. » La discipline de mouvement est une discipline d’identité.

Ce que j’évite :

- Les mots de style vagues qui entrent en conflit avec l’ancre : « cinématographique », « onirique », « brut ». Si j’ai besoin d’un rendu, je le définis avec la référence de style plutôt qu’avec des adjectifs.

- La gestion minutieuse des costumes qui change la silhouette en cours de clip (écharpes, vestes amples dans le vent). Si la tenue doit être spécifique, je la garde ajustée et statique.

- Les actions complexes. Chaque battement supplémentaire est une occasion d’un nouveau visage. Je commence simplement : marcher, s’asseoir, tourner de 15 degrés, cligner des yeux.

Deux astuces de formulation qui ont aidé :

« Gardez les proportions du visage identiques à la référence sur toutes les images. » Cela semble autoritaire. Cela a fonctionné plus souvent que non.

« Pas de nouveaux bijoux, pas de changements de maquillage, pas de mouvement des cheveux au-delà du balancement naturel. » Ces petits paramètres ont comblé des lacunes bizarres que je n’aurais pas pensé à nommer.

Après cinq runs, j’ai remarqué quelque chose de subtil : raccourcir mes prompts d’un tiers maintenait les sorties plus proches. Mon intuition : moins de tokens parasites tirant le modèle vers un buffet d’ambiances.

Liste de contrôle QA avant de relancer (visage, mains, logos, tenue)

J’avais l’habitude de relancer à l’instinct. Maintenant je fais une vérification de 60 à 90 secondes avec la même checklist à chaque fois. Cela fait gagner du temps en évitant des retours à l’aveugle.

Visage

- Figer sur l’image 1, le milieu et la dernière image. Comparer la distance entre les yeux et l’angle de la mâchoire avec front.jpg. Si les deux dérivent de plus d’« une largeur de pixel à l’échelle de la vignette », je relance.

- Observer un défilement lent à travers les clignements. Si le bord de la paupière change d’épaisseur en milieu de clignement, l’identité est menacée.

Mains

- Vérifier chaque moment où une main croise le visage. Si le visage réapparaît plus mince ou avec un arête nasale différente, je le considère comme un échec net, pas un peut-être.

- Compter les artéfacts de doigts. Un défaut prédit souvent un second glissement d’identité 10 à 15 images plus tard.

Logos et petites marques

- Si un petit logo sur une chemise se retourne ou s’estompe, je m’attends à ce que les micro-détails du visage vacillent aussi. C’est un bon signal d’alerte précoce.

- Grains de beauté ou taches de rousseur : s’ils migrent, je ne lutte pas en étalonnage. Je corrige plutôt les entrées ou le mouvement.

Tenue

- L’effet de moiré peut dominer l’attention. Si je le vois, je remplace le haut par un uni ou modifie l’exposition dans l’ancre de style.

- Les encolures qui bougent révèlent différemment les clavicules : cela peut subtilement modifier la largeur perçue du visage.

Je note chaque passage de façon souple : 0 (recommencer), 1 (utilisable pour des plans de coupe), 2 (suffisamment bon pour ancrer une séquence). Si j’obtiens deux « 2 » de suite, j’arrête de peaufiner. Pas parfait, juste assez stable pour que l’histoire le porte.

Échelle de correction si la dérive persiste (changer les références, resserrer les contraintes, raccourcir le mouvement)

Quand l’identité dérivait encore malgré des entrées propres et des prompts soignés, j’ai arrêté de deviner et j’ai gravi une échelle simple. J’essaie un échelon à la fois et relance un test de 2 à 3 secondes.

- Changer les références, pas tout

- Remplacer uniquement le profil ou uniquement le trois-quarts par une correspondance plus proche en termes d’éclairage. Garder le reste. Les remplacements complets effaçaient des progrès que je ne pouvais pas facilement regagner.

- Si l’expression varie, la normaliser : neutre sur toutes les photos. Un seul grand sourire a poussé le volume des joues plus large sur tout le clip.

- Resserrer les contraintes en langage simple et précis

- Ajouter une contrainte par run : « pas de rotations de tête au-delà de 10° », puis « pas d’occlusions sur le visage », puis « garder les cheveux contre la tête : pas de vent ». Les empiler progressivement a mieux fonctionné que les ajouter toutes en même temps.

- Si le modèle résiste, passer aux négations : « éviter les rotations dramatiques : éviter le soulèvement des cheveux : éviter les changements d’accessoires. » Les négations semblaient être respectées plus strictement.

- Raccourcir le mouvement, puis reconstruire

- Réduire la fenêtre d’action à 1,5-2 secondes et supprimer des beats : juste une marche, juste un regard. Une fois que le visage tient, rajouter un beat.

- Pour les boucles, j’évite les chevauchements cycliques parfaits : ils peuvent encourager une « réinitialisation » du visage sur la jonction.

- Réduire l’entropie visuelle

- Simplifier l’arrière-plan et baisser légèrement le contraste dans l’ancre de style. Quand la scène s’est calmée, Seedance 2.0 a consacré davantage de son « attention » au visage.

- Désaturer légèrement la peau dans l’ancre si le teint continue de dériver entre les plans. Cela semblait décourager les brusques alternances chaud/froid.

- En dernier recours : se soumettre à la silhouette

- Si une mâchoire particulière ne tient pas, je m’appuie sur la forme des cheveux, les bijoux aux oreilles et la coupe des vêtements. Les spectateurs lisent l’identité de loin plus qu’on ne l’admet. Ce n’est pas de la triche : c’est du montage.

Sur huit courts tests, cette échelle a réduit mes relances d’environ un tiers. Plus important encore, elle a diminué le bruit mental. Je n’avais plus l’impression de parier sur chaque rendu.

Pour qui est-ce utile : si vous accordez plus d’importance à la cohérence des personnages dans Seedance 2.0 qu’aux mouvements de caméra sophistiqués, ce chemin plus lent et plus régulier vous semblera probablement naturel. Si vous voulez de grands arcs, des whips ou des monologues expressifs en une seule prise, vous heurterez vite les limites. Vous pouvez y arriver quand même, construisez simplement par couches.

Vous voulez créer des vidéos cinématographiques comme Seedance 2.0 ? Essayez le WaveSpeed Cinematic Video Generator pour créer dès maintenant des vidéos cinématographiques de qualité Seedance 2.0.