GLM-5V-Turbo vs GPT-4o Vision: ¿Qué modelo gana en codificación de UI?

GLM-5V-Turbo vs GPT-4o Vision para tareas de diseño a código. Compara capacidades, acceso a API, precios y casos de uso reales en 2026.

Alguien de mi equipo me preguntó esto la semana pasada: “¿Deberíamos cambiar de GPT-4o a GLM-5V-Turbo para nuestro pipeline de diseño a código?” Mi primer instinto fue decir “prueba ambos.” Mi segundo instinto fue hacer la investigación primero, para que la prueba tenga una hipótesis desde el principio.

Esto es lo que encontré — cubriendo la tarea específica de codificación de UI y generación de frontend a partir de entrada visual. No codificación general, no benchmarks de razonamiento, no una revisión amplia del modelo. Solo la pregunta concreta de cuál deberías elegir cuando la entrada es un diseño y la salida es código.

La Respuesta Corta

Si tu tarea principal es convertir diseños visuales en código frontend a escala, GLM-5V-Turbo es la opción más económica y afirma tener un mejor rendimiento en Design2Code. Si necesitas razonamiento multimodal de propósito general, soporte de codificación backend o un modelo con un historial más largo en producción, GPT-4o es el predeterminado más seguro.

La comparación solo se vuelve interesante cuando eres específico sobre lo que estás construyendo.

Para qué está optimizado cada modelo

GLM-5V-Turbo es un modelo de agente multimodal nativo de Z.ai (Zhipu AI), lanzado el 1 de abril de 2026. Fue diseñado en torno a tareas de codificación con visión como prioridad — reproducción de diseños, navegación de GUI y flujos de trabajo de pantalla a acción. La visión no es una capacidad añadida; es el centro de la arquitectura.

GPT-4o es el modelo multimodal de OpenAI, lanzado en mayo de 2024 y aún ampliamente utilizado para cargas de trabajo de visión en producción. Maneja imagen, texto y audio. Es un modelo de propósito general que destaca en el razonamiento visual, pero no está optimizado específicamente para tareas de diseño a código. A finales de 2025 es algo conocido — bien probado, estable, con amplio soporte del ecosistema.

Estos dos modelos resuelven problemas adyacentes pero distintos. Eso es en realidad lo más útil que hay que entender antes de compararlos.

Comparación de Capacidades

Diseño a Código y Reproducción de UI

Aquí es donde la brecha es más pronunciada. Z.ai informa que GLM-5V-Turbo obtuvo 94.8 en el benchmark Design2Code, en comparación con 77.3 de Claude Opus 4.6 y el rendimiento de GPT-4o en un rango similar. Design2Code mide qué tan fielmente el HTML/CSS generado reproduce una maqueta de referencia — precisión de píxeles, fidelidad estructural y completitud visual.

De nuevo: estos son los propios números de Z.ai. La brecha es lo suficientemente grande como para tomarse en serio, pero no lo suficientemente grande como para omitir la validación independiente con tus propios activos de diseño antes de comprometerte.

En la práctica, esto significa que GLM-5V-Turbo vale la pena probarlo para: pipelines de Figma a código, generación de capturas de pantalla a componentes, reproducción de especificaciones de diseño en distintos breakpoints y flujos de trabajo de migración de UI donde existe una referencia visual. Tareas donde “se parecía a la maqueta” es la métrica de éxito.

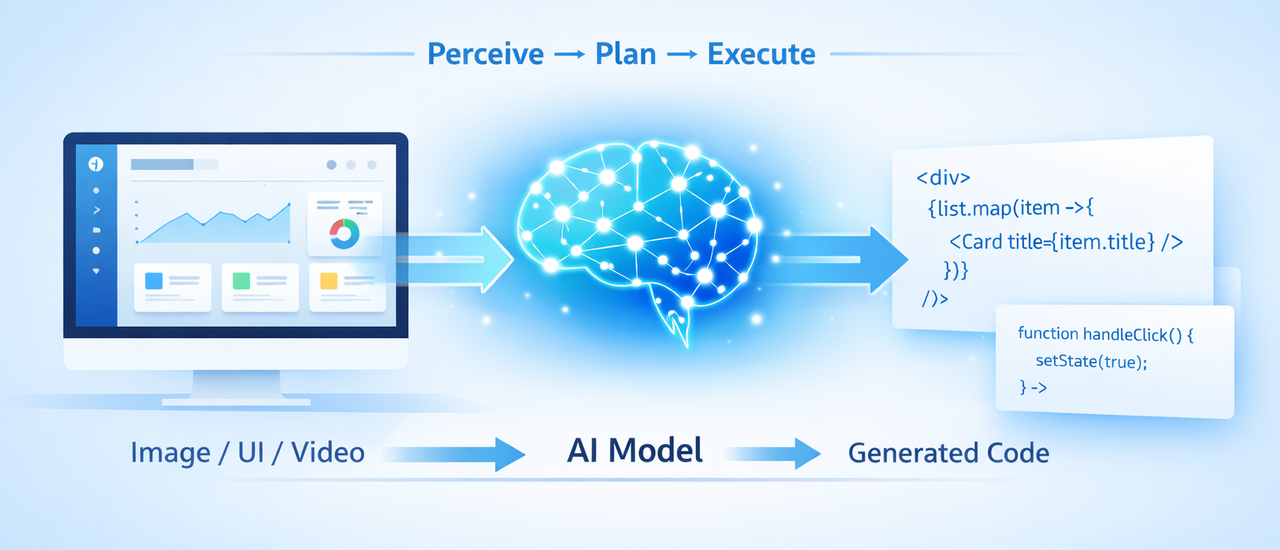

Tareas de Agente GUI

Ambos modelos admiten flujos de trabajo de agente GUI, pero con diferentes niveles de integración nativa. GLM-5V-Turbo fue construido con uso agéntico en mente — el modelo maneja el ciclo completo de “percibir → planificar → ejecutar” y admite llamadas a herramientas con lo que Z.ai describe como una mejor estabilidad de invocación (menos llamadas fallidas en cadenas de agentes). La documentación de Z.ai posiciona esto como un objetivo de diseño central, no como una función añadida.

GPT-4o puede usarse en flujos de trabajo de agente GUI, pero lo hace a través de la infraestructura de llamadas a funciones y la API de Responses de OpenAI. A principios de 2026, GPT-4o no es la opción de vanguardia para agentes GUI — GPT-5.4 con su API nativa de Computer Use ha tomado esa posición dentro de la línea de OpenAI. GPT-4o es adecuado, no líder.

Codificación General y Tareas de Backend

Aquí es donde la comparación se inclina claramente a favor de GPT-4o. GLM-5V-Turbo es un modelo especializado en visión. Z.ai reconoce que queda por detrás de Claude y GPT-4o en categorías de codificación de texto puro — lógica de backend, trabajo en repositorios de múltiples archivos, integración de API, depuración sin contexto visual. El modelo no compite en este espacio, y Z.ai no afirma que lo haga.

GPT-4o maneja bien las tareas de codificación general, aunque no es la opción más sólida del mercado actual, incluso dentro de la propia línea de OpenAI. Para trabajo de codificación solo de texto, probablemente estarías comparando GPT-4.1 o GPT-5.4 en lugar de GPT-4o de todas formas.

La conclusión práctica: no uses GLM-5V-Turbo para una tarea que no comience con entrada visual. Es la herramienta incorrecta.

Comprensión Multimodal (Imagen, Vídeo)

GLM-5V-Turbo acepta imágenes, clips de vídeo cortos y texto en el mismo contexto. La entrada de vídeo abre el análisis de grabaciones de pantalla, la documentación de recorridos de productos y el seguimiento temporal del estado de la UI. La ventana de contexto es de 202.752 tokens, con una salida máxima de 131.072 tokens — generosa para prompts con muchas imágenes o fotogramas de vídeo.

GPT-4o admite entrada de imágenes (incluyendo múltiples imágenes por solicitud) con una ventana de contexto de 128K. Las imágenes consumen tokens según la resolución — una imagen de 1024×1024 en modo de alta definición cuesta aproximadamente 765 tokens, según la documentación de la guía de visión de OpenAI. GPT-4o no maneja vídeo de forma nativa como entrada continua; el análisis de vídeo requiere extracción de fotogramas de tu parte.

Para pipelines que involucran grabaciones de pantalla o secuencias visuales de múltiples fotogramas, GLM-5V-Turbo tiene una ventaja estructural aquí.

Comparación Lado a Lado

| Dimensión | GLM-5V-Turbo | GPT-4o |

|---|---|---|

| Disponibilidad API | API nativa de Z.ai + OpenRouter | API de OpenAI |

| Precio de entrada | $1.20 / 1M tokens | $2.50 / 1M tokens |

| Precio de salida | $4.00 / 1M tokens | $10.00 / 1M tokens |

| Entrada en caché | $0.24 / 1M tokens | $1.25 / 1M tokens |

| Ventana de contexto | 202.752 tokens | 128.000 tokens |

| Salida máxima | 131.072 tokens | ~16.384 tokens |

| Design2Code | 94.8 (autoreportado por Z.ai) | No evaluado de forma independiente para esta tarea |

| Codificación de texto puro | Más débil — queda por detrás de modelos de texto de vanguardia | Buen rendimiento de propósito general |

| Flujo de trabajo agéntico | Diseño nativo, enfoque en llamadas a herramientas | Capaz mediante llamadas a funciones; no es la vanguardia actual |

| Entrada de vídeo | Sí — nativa | No — requiere extracción de fotogramas |

| Historial | Lanzado en abril de 2026 | En producción desde mayo de 2024 |

Precios de GPT-4o de la página oficial de precios de la API de OpenAI. Precios de GLM-5V-Turbo de la documentación oficial de precios de Z.ai. Verifica ambos antes de planificar el presupuesto de producción — los precios han cambiado con cada generación de modelos en ambas plataformas.

Comparación de API y Precios

Precios y Acceso a GLM-5V-Turbo

$1.20 por millón de tokens de entrada, $4.00 por millón de tokens de salida. Accesible a través de la API compatible con OpenAI de Z.ai o mediante OpenRouter para enrutamiento multi-proveedor. Configuración estándar de clave API, llamadas a funciones admitidas, streaming admitido.

Algo que vale la pena señalar: Z.ai ha tenido tensiones de infraestructura con lanzamientos anteriores de modelos. El lanzamiento de GLM-4.7 experimentó limitación de capacidad; GLM-5 se lanzó con un aumento de precio del 30% junto con advertencias de presión de cómputo. GLM-5V-Turbo es de lanzamiento reciente — prueba el rendimiento bajo carga realista antes de comprometer un pipeline de producción.

Precios y Acceso a GPT-4o

$2.50 por millón de tokens de entrada, $10.00 por millón de tokens de salida, entrada en caché a $1.25 por millón. Disponible a través de la API de OpenAI con documentación sólida de límites de velocidad, acuerdos empresariales y dos años de estabilidad en producción. La historia de infraestructura aquí es madura — sabes lo que obtienes.

Estimación de Costo por Tarea para Flujos de Trabajo de Codificación de UI

Para una tarea típica de diseño a código (~1.500 tokens de imagen + prompt de entrada, ~2.000 tokens de salida):

- GLM-5V-Turbo: ~$0.004 por tarea

- GPT-4o: ~$0.027 por tarea

Eso es aproximadamente una diferencia de 6–7x. A 10.000 tareas por mes: ~$40 vs ~$270. Significativo a escala; irrelevante para evaluación de bajo volumen.

Cuándo Usar GLM-5V-Turbo

Pipelines de Diseño → Código Frontend

Si tu flujo de trabajo comienza con un artefacto de diseño — exportación de Figma, captura de pantalla, wireframe — y termina con HTML, CSS o un scaffold de componente, GLM-5V-Turbo vale la pena compararlo con tu solución actual. Los números de Design2Code son autoreportados pero direccionalmente creíbles. El costo por tarea es significativamente menor. Y la arquitectura está diseñada específicamente para este caso de uso en lugar de adaptada desde un modelo general.

Tareas de Codificación Visual de Bajo Costo

Para equipos que ejecutan pipelines de alto volumen con imagen de entrada y código de salida — generación de sistemas de diseño, reproducción masiva de UI, extracción de estilos desde capturas de pantalla — la diferencia de costo se acumula. A $1.20/$4.00, GLM-5V-Turbo es más barato que GPT-4o en ambos extremos.

Cuándo Usar GPT-4o Vision

Razonamiento Multimodal de Propósito General

GPT-4o es la mejor opción cuando la codificación visual es una parte de un flujo de trabajo más amplio — análisis de imágenes, razonamiento mixto, comprensión de documentos o tareas donde la entrada visual es contexto en lugar del tema principal. Es más general y más confiable fuera del nicho específico de diseño a código.

Ecosistema de API Establecido y Estabilidad

Dos años de uso en producción se traducen en límites de velocidad bien probados, patrones de manejo de errores establecidos y un gran cuerpo de conocimiento comunitario. Si tu equipo ya está integrado con el ecosistema de OpenAI — usando sus SDK, herramientas de monitorización o infraestructura de cumplimiento — mantenerse en GPT-4o para tareas de visión conlleva un costo de cambio menor de lo que podría parecer.

Marco de Decisión

Elige según la Tarea, No según el Ranking de Benchmark

El error que cometen la mayoría de los equipos al comparar modelos es tratar los rankings de benchmark como un proxy de idoneidad. La puntuación de Design2Code de GLM-5V-Turbo no significa que sea un mejor modelo — significa que es un mejor modelo para ese tipo de tarea específico. Las capacidades más amplias de GPT-4o no lo hacen mejor para tu pipeline si tu pipeline es puramente visual a frontend.

El árbol de decisión es más simple de lo que parece:

¿Tu tarea comienza con entrada visual y termina con código?

- Sí, y el volumen es significativo → Prueba GLM-5V-Turbo primero. El argumento de costo es sólido y los números del benchmark son direccionalmente favorables.

- Sí, pero el volumen es bajo → Cualquiera funciona; GPT-4o tiene menor fricción para configurar si ya estás en OpenAI.

¿Tu tarea involucra alguna codificación no visual, razonamiento o trabajo de backend?

- Sí → GPT-4o, o considera un modelo solo de texto.

¿Necesitas estabilidad de infraestructura de producción?

- Sí, y lanzas pronto → GPT-4o. GLM-5V-Turbo tiene tres días de antigüedad.

Preguntas Frecuentes

P: ¿Es GLM-5V-Turbo mejor que GPT-4o para diseño a código? Según el benchmark de Design2Code autoreportado por Z.ai (94.8 vs puntuaciones en el rango comparable de GPT-4o), sí — en esa tarea específica. Estos números aún no han sido verificados de forma independiente. Prueba con tus propios activos de diseño antes de considerar esto como definitivo.

P: ¿Cuánto cuesta GLM-5V-Turbo vs GPT-4o? GLM-5V-Turbo: $1.20/$4.00 por millón de tokens de entrada/salida. GPT-4o: $2.50/$10.00. Aproximadamente 2x más barato en entrada, 2.5x en salida. Para una tarea típica de codificación de UI, la diferencia es ~$0.004 vs ~$0.027 por tarea. Confirma los precios actuales en docs.z.ai y openai.com/api/pricing antes de presupuestar.

P: ¿Puede GLM-5V-Turbo manejar entrada de vídeo? Sí — clips de vídeo cortos junto con imágenes y texto en el mismo contexto. GPT-4o no acepta vídeo continuo de forma nativa; requiere extracción fotograma a fotograma de tu parte.

P: ¿Qué modelo es mejor para pipelines de codificación de UI en producción? Depende de tu cronograma. GLM-5V-Turbo tiene la mejor estructura de costos y afirmaciones de benchmark para este caso de uso, pero fue lanzado el 1 de abril de 2026 — aún no tiene historial de producción. GPT-4o es la opción de menor riesgo para cualquier cosa que se lance en el corto plazo. Revisa GLM-5V-Turbo en 60–90 días una vez que estén disponibles evaluaciones independientes.

P: ¿Dónde puedo acceder a GLM-5V-Turbo a través de API? A través de la API nativa de Z.ai (formato compatible con OpenAI) en z.ai, o mediante OpenRouter como capa alternativa de enrutamiento. Se requiere registro estándar de clave API.

La respuesta honesta a “qué modelo gana” es: depende de si ganar significa el menor costo por tarea, el benchmark más sólido en una prueba específica o el menor riesgo en un sistema de producción. GLM-5V-Turbo presenta un argumento creíble para los dos primeros en la categoría de diseño a código. GPT-4o presenta un argumento creíble para el tercero.

Ninguna respuesta es permanente. Z.ai lanza modelos rápido. OpenAI también. La comparación que importa es la que ejecutas con tus propios datos, con tus propios activos de diseño, contra tu propio estándar de calidad.

Todos los precios verificados al 2 de abril de 2026. Los datos de benchmark de GLM-5V-Turbo son autoreportados por Z.ai; no se ha publicado ninguna evaluación independiente de terceros en el momento de redactar este artículo. Verifica los precios actuales en las fuentes oficiales antes de tomar decisiones de presupuesto de producción.

Publicaciones Anteriores:

- GLM-5V-Turbo: Lo que los Desarrolladores Deben Saber en 2026

- Construye un Pipeline Creativo de IA con GLM-5 + WaveSpeed

- Inicio Rápido de la API de GLM-5 en WaveSpeed (Ejemplos de Código)

- GLM-5 vs DeepSeek V3 vs GPT-5: Velocidad y Costo para Desarrolladores

- GLM-5 para Orquestación de Prompts de Imagen y Vídeo con IA