GLM-5V-Turbo: Lo que los desarrolladores deben saber en 2026

GLM-5V-Turbo es el modelo de visión y codificación de Z.ai. Aquí está lo que los desarrolladores necesitan saber sobre su API, precios, límites y casos de uso reales en 2026.

Un colega me envió una captura de pantalla la semana pasada — un mockup de diseño a la izquierda, una reproducción HTML casi pixel-perfecta a la derecha. “GLM-5V-Turbo hizo esto en un solo intento”, decía el pie de foto. Lo archivé y seguí adelante. Luego seguí viéndolo mencionado en el mismo contexto que las herramientas de flujos de trabajo agénticos, y decidí investigar realmente qué es y qué no es este modelo.

Esto es lo que encontré — escrito para desarrolladores que evalúan modelos multimodales para casos de uso de codificación agéntica, no para quienes buscan una recomendación de producto.

¿Qué es GLM-5V-Turbo?

Z.ai (Zhipu AI) y la familia de modelos GLM

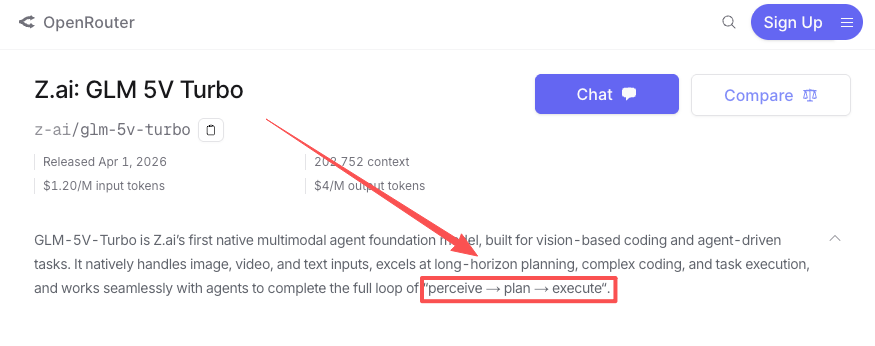

GLM-5V-Turbo es un modelo de visión-lenguaje lanzado el 1 de abril de 2026 por Zhipu AI, que opera internacionalmente bajo la marca Z.ai. Zhipu es un laboratorio de IA con sede en Pekín — que cotiza en la Bolsa de Valores de Hong Kong desde enero de 2026 — y uno de los productores de modelos fundacionales más activos de China. Su serie GLM ha iterado rápidamente: GLM-4.5 en julio de 2025, GLM-4.7 en diciembre, GLM-5 en febrero de 2026, y ahora una variante multimodal en abril.

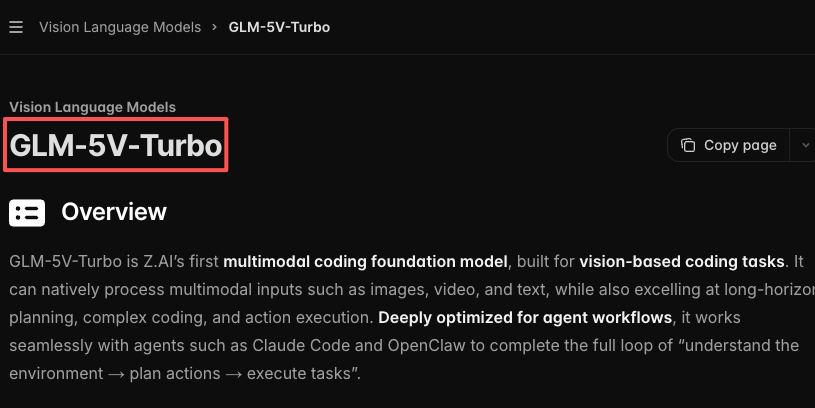

GLM-5V-Turbo es el primer modelo de la familia construido como agente multimodal nativo — lo que significa que la visión no fue añadida posteriormente, sino que formó parte de la arquitectura desde el principio. Esa distinción importa para entender en qué es realmente bueno el modelo.

Cómo se diferencia GLM-5V-Turbo de GLM-4V y GLM-5

GLM-4V manejaba entrada de imágenes. GLM-5 mejoró la codificación y el razonamiento de texto. GLM-5V-Turbo combina entrada multimodal (imagen, video, texto) con salida orientada a agentes: llamadas a herramientas, descomposición de tareas e interacción con interfaces gráficas. Está construido alrededor de un nuevo codificador visual llamado CogViT, utiliza aprendizaje por refuerzo en más de 30 tipos de tareas, y ejecuta cuantización INT8 para inferencia más rápida.

El posicionamiento es intencionalmente específico. No es una actualización de propósito general de GLM-5. Es un modelo especializado para tareas que comienzan con entrada visual y terminan en código o acción estructurada.

Capacidades principales

Diseño a código y generación de interfaces

La capacidad principal es reproducir diseños de UI como código frontend funcional. Dale al modelo un mockup — captura de pantalla, exportación de Figma, boceto a mano — y genera HTML, CSS y a veces JavaScript. En las propias pruebas de Z.ai, GLM-5V-Turbo obtuvo 94.8 en el benchmark Design2Code frente a 77.3 de Claude Opus 4.6. Es una diferencia significativa si el benchmark se sostiene bajo pruebas independientes (más sobre esto a continuación).

En la práctica, esto es más útil para el scaffolding de frontend: convertir especificaciones de diseño en código de componentes inicial, reproducir layouts de UI existentes para proyectos de migración, o generar variaciones a partir de una imagen de referencia.

Agente GUI y soporte para flujos de trabajo agénticos

Más allá de la reproducción estática de diseños, el modelo admite tareas de agente GUI — navegar interfaces de navegador, extraer datos estructurados de pantallas y ejecutar flujos de trabajo de múltiples pasos que involucran estado visual. La página del modelo en OpenRouter lo describe como construido para “completar el ciclo completo de percibir → planificar → ejecutar”, y los resultados de los benchmarks AndroidWorld y WebVoyager que cita Z.ai sugieren que puede manejar navegación GUI del mundo real, no solo pruebas sintéticas.

Para equipos que construyen flujos de trabajo agénticos que incluyen una capa visual — automatización de relleno de formularios, agentes de pruebas de UI, pipelines de pantalla a acción — aquí es donde el modelo tiene una ventaja práctica. Las mejoras en llamadas a herramientas de GLM-5V-Turbo (heredadas y extendidas de GLM-5-Turbo) están diseñadas explícitamente para reducir invocaciones fallidas en bucles de agentes.

Manejo de entrada multimodal

El modelo acepta imágenes, clips de video cortos y texto en el mismo contexto. La entrada de video extiende los casos de uso a grabaciones de pantalla y demostraciones de productos — el modelo puede seguir visualmente y generar documentación o planes de acción a partir de lo que ve. La ventana de contexto es de 202.752 tokens con una salida máxima de 131.072 tokens, confirmado en la página oficial de precios de Z.ai.

Acceso a la API y precios

Cómo acceder a GLM-5V-Turbo vía API

El modelo está disponible a través de la API de Z.ai con una interfaz compatible con OpenAI. La autenticación sigue patrones estándar de clave API — regístrate en z.ai, genera una clave, configúrala en tus herramientas existentes.

La API admite llamadas a funciones, streaming y salida estructurada — la misma superficie de capacidades que GLM-5-Turbo, extendida con entrada visual.

Precios: costos de tokens de entrada y salida

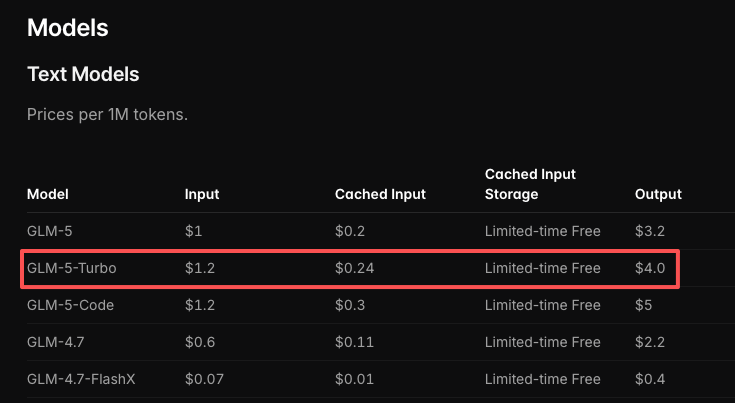

| GLM-5V-Turbo | GLM-5-Turbo | GLM-5 | |

|---|---|---|---|

| Entrada (por 1M tokens) | $1.20 | $1.20 | $1.00 |

| Salida (por 1M tokens) | $4.00 | $4.00 | $3.20 |

| Entrada en caché | $0.24 | $0.24 | $0.20 |

Cifras obtenidas de la página oficial de precios de Z.ai a partir de abril de 2026. Verifica directamente antes de planificar presupuestos de producción — Z.ai ha ajustado los precios con lanzamientos de modelos anteriores.

Para referencia: Claude Opus 4.6 cuesta $5/M de entrada y $25/M de salida. GPT-4o es $2.50/$10. Con $1.20/$4, GLM-5V-Turbo es significativamente más económico para cargas de trabajo con mucho contenido visual donde el volumen de salida es moderado.

Ventana de contexto y límites de salida

- Ventana de contexto: 202.752 tokens

- Salida máxima: 131.072 tokens

Ambos son generosos. Para la mayoría de las tareas de diseño a código o agente GUI, no alcanzarás estos límites. Las secuencias de video largas o los archivos de diseño muy grandes podrían hacerlo, así que vale la pena probar con tus entradas reales antes de comprometerte.

Dónde encaja (y dónde no)

Fortalezas: codificación visual, reproducción de diseños

La ventaja práctica de GLM-5V-Turbo es específica: tareas que requieren mirar algo y producir código a partir de ello. Scaffolding de frontend desde activos de diseño, extracción de componentes de UI, captura de pantalla a HTML, análisis de grabaciones de pantalla. Si tu pipeline comienza con un artefacto visual y termina con código, vale la pena comparar este modelo con tu solución actual.

El soporte para flujos de trabajo agénticos es una adición real. La estabilidad en las llamadas a herramientas importa en los bucles de agentes en producción — las invocaciones fallidas rompen las cadenas y requieren reintentos. El enfoque declarado de Z.ai en esto en GLM-5V-Turbo es una señal de que han visto el mismo modo de fallo que todos los que construyen agentes experimentan.

Limitaciones: codificación backend de texto puro, razonamiento general

Esta es la parte en la que vale la pena ser explícito. GLM-5V-Turbo no es un competidor directo de Claude o GPT-4o para codificación backend, exploración de repositorios o tareas de razonamiento general. En esas categorías, Claude Opus 4.6 lidera en todos los aspectos según las propias comparaciones de Z.ai — y esa es la empresa que presenta el caso favorable para su modelo.

Si tu trabajo de codificación es principalmente texto de entrada, texto de salida — depuración de lógica, escritura de integraciones de API, refactorización de código backend — un modelo solo de texto como GLM-5 o GLM-5-Turbo te servirá mejor al mismo precio. Añadir un codificador visual no ayuda con problemas que no involucran entrada visual.

Quién debería usarlo y quién debería saltárselo

Vale la pena evaluarlo si estás:

- Construyendo herramientas de frontend que parten de activos de diseño

- Ejecutando flujos de trabajo de agente GUI con estado visual

- Buscando una alternativa más económica a GPT-4V o Claude para tareas de imagen a código

- Probando entradas multimodales en un pipeline de agentes

Probablemente omítelo si estás:

- Trabajando en codificación de texto puro — backend, herramientas CLI, desarrollo de API

- Necesitando razonamiento general sólido junto con generación de código

- Operando bajo restricciones de residencia de datos (Z.ai es una empresa china; revisa su política de privacidad frente a tus requisitos de cumplimiento)

Afirmaciones de benchmarks — qué tomar en serio

Rendimiento en Design2Code

Z.ai reporta que GLM-5V-Turbo obtuvo 94.8 en Design2Code frente a 77.3 de Claude Opus 4.6. Estas son las propias mediciones de Z.ai. Ningún laboratorio de evaluación independiente ha publicado resultados corroboradores hasta la fecha de este artículo. Eso no significa que los números sean incorrectos — significa que aún no han sido sometidos a pruebas de estrés.

Design2Code como benchmark mide qué tan fielmente el HTML/CSS generado reproduce un mockup de referencia, tanto en términos de píxeles como estructuralmente. Es un proxy razonable para la tarea específica de reproducción de UI. No es un proxy para la calidad general de codificación, el juicio arquitectónico o la preparación para producción en el mundo real.

La diferencia es suficientemente grande como para ser creíble como señal direccional. Trátala como una razón para probar, no como una conclusión.

Advertencias sobre la comparación de codificación de texto puro

La documentación de Z.ai reconoce que GLM-5V-Turbo queda por detrás de Claude en los benchmarks de codificación de texto puro. Esa franqueza es útil. Significa que el posicionamiento del modelo es honesto: esta es una herramienta visual en primer lugar, no una actualización general de codificación. Cualquier comparación que enmarque a GLM-5V-Turbo como ampliamente competitivo con los modelos de texto de frontera está malinterpretando lo que la empresa realmente afirma.

Preguntas frecuentes

P: ¿Está disponible GLM-5V-Turbo vía API?

Sí. A través de la API nativa de Z.ai (compatible con OpenAI) y a través de OpenRouter. Configuración estándar de clave API, admite llamadas a funciones y streaming.

P: ¿Cuál es el precio de GLM-5V-Turbo?

$1.20 por millón de tokens de entrada, $4.00 por millón de tokens de salida, a partir de abril de 2026. Verifica en docs.z.ai/guides/overview/pricing antes del uso en producción.

P: ¿Cómo se compara GLM-5V-Turbo con GPT-4o y Claude para codificación?

Para tareas de diseño a código y UI visual: los benchmarks de Z.ai (autoreportados) lo muestran por delante de ambos. Para codificación de texto puro y trabajo backend: Claude Opus 4.6 lidera. La comparación solo se sostiene en el dominio visual.

P: ¿Admite GLM-5V-Turbo entrada de video?

Sí — clips de video cortos junto con imágenes y texto en el mismo contexto. Útil para grabaciones de pantalla y generación de documentación basada en tutoriales.

P: ¿Cuáles son los límites de velocidad y la ventana de contexto?

La ventana de contexto es de 202.752 tokens, salida máxima de 131.072 tokens. Los límites de velocidad no están publicados en la documentación oficial — Z.ai ha tenido problemas de capacidad con lanzamientos de modelos anteriores, así que prueba el rendimiento bajo carga real antes de comprometerte con una arquitectura de producción.

El diseño a código es una categoría de tareas genuinamente útil, y tener un modelo que la trate como un problema de primera clase — en lugar de una capacidad secundaria de un modelo general — es una decisión de ingeniería razonable. Si GLM-5V-Turbo cumple con eso en tu pipeline específico es algo que solo tus propios datos de prueba responderán.

Los números del benchmark merecen una mirada. La verificación independiente aún está pendiente.

Precios y especificaciones verificados contra la documentación oficial de Z.ai a partir del 2 de abril de 2026. Todas las cifras de benchmark son datos autoreportados de Z.ai salvo que se indique lo contrario — tratar como preliminares hasta que se validen de forma independiente.

Publicaciones anteriores: