Las mejores herramientas de intercambio de caras en video online

Compara las mejores herramientas de intercambio de caras en video online y encuentra la opción adecuada para velocidad, calidad o edición de múltiples caras.

Hola, soy Dora. Llevo más de un año probando herramientas de video con IA, principalmente para entender qué es genuinamente utilizable frente a lo que simplemente luce bien en capturas de pantalla. Hace unos meses comencé a aplicar un marco de evaluación consistente a las herramientas de intercambio de rostros en video — los mismos clips de origen, las mismas condiciones de prueba, el mismo proceso de revisión de resultados. No es un entorno de laboratorio, pero sí lo suficientemente estructurado como para comparar herramientas con cierta confianza.

Esta guía trata sobre la selección. Si también estás explorando otras herramientas de video con IA más allá del intercambio de rostros, vale la pena ver cómo se comparan Seedance, Kling y Sora en flujos de trabajo reales de generación de video con IA. Si estás tratando de decidir qué herramienta de intercambio de rostros en video online se adapta a tu flujo de trabajo, quiero darte una base más clara para esa decisión que la mayoría de las reseñas.

Qué Hace que una Herramienta de Intercambio de Rostros Online Sea Mejor que Otra

La mayoría de las comparaciones colapsan todo en una vaga “puntuación de calidad”. Eso no es útil para elegir una herramienta. Aquí están las cuatro dimensiones que rastreé por separado. Para los creadores que también evalúan modelos de video más nuevos, este resumen explica qué es SkyReels V4 y por qué algunos creadores lo usan para la generación de video con IA.

Calidad de salida

La calidad en el intercambio de rostros en video tiene dos componentes que deben evaluarse de forma independiente. Primero: calidad espacial — qué tan limpia es la mezcla de bordes alrededor de la línea del cabello, la mandíbula y el cuello en un solo fotograma. Segundo, y más difícil: consistencia temporal — qué tan estable permanece la identidad entre fotogramas cuando el sujeto se mueve.

La investigación sobre métricas de calidad de video confirma que los artefactos temporales — distorsiones que aparecen a través de secuencias de fotogramas en lugar de dentro de un solo fotograma — requieren métodos de medición dedicados que la mayoría de las puntuaciones de calidad espacial no capturan. Esta distinción importa en la práctica: una herramienta que produce una imagen fija limpia pero muestra deriva de identidad o difuminación a lo largo de un clip de 10 segundos no es una herramienta de alta calidad para video, independientemente de cómo se vea la vista previa.

En mis pruebas, usé dos clips por herramienta: un plano de cabeza hablante de frente de 10 segundos, y un clip de 12 segundos con movimiento moderado de cabeza y un giro de 45 grados. El segundo clip es donde la mayoría de las herramientas divergen significativamente.

Velocidad

Para el trabajo iterativo — probar fotos de origen, comparar resultados — el tiempo de renderizado se acumula rápidamente. Medí el tiempo de reloj desde la carga hasta la descarga del resultado, no solo el tiempo de procesamiento indicado. Los tiempos de espera en cola del nivel gratuito están incluidos en ese número, lo que importa.

Los resultados entre herramientas variaron desde menos de 60 segundos hasta más de 9 minutos en el mismo clip. Esa no es una diferencia menor cuando estás ejecutando cinco variantes.

Soporte para múltiples rostros

Esta es una capacidad separada, no una extensión de características. El intercambio de rostros en video requiere resolver tanto los problemas de detección como de optimización temporal — rastrear cada rostro de forma independiente a lo largo de los fotogramas mientras se mantiene un reemplazo de identidad consistente a lo largo de la secuencia. Los clips con múltiples rostros multiplican esa complejidad. La mayoría de los niveles gratuitos solo admiten detección de un solo rostro, e incluso los niveles de pago varían significativamente en qué tan bien manejan tomas grupales donde los rostros se superponen parcialmente o se mueven a diferentes velocidades.

Probé el soporte para múltiples rostros con un clip de 3 personas. Donde las herramientas afirmaban tener capacidad para múltiples rostros, evalué cada intercambio individual de forma independiente.

Facilidad de uso

Contradictoriamente, la facilidad de uso importa más en el extremo de mayor calidad del espectro. Las herramientas básicas son simples porque ofrecen pocos controles. Las herramientas con techos más altos — selección de región facial, ajuste de realismo, anclaje de expresión — exponen más configuración, lo que aumenta la complejidad de la interfaz. El nivel de complejidad adecuado depende completamente de lo que necesites controlar.

Mejores Herramientas de Intercambio de Rostros en Video Online

La mejor en general: Magic Hour

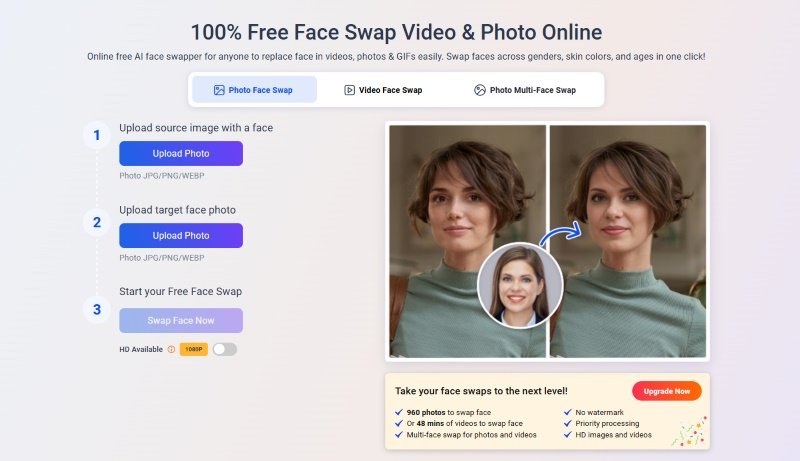

La herramienta de intercambio de rostros en video de Magic Hour es la herramienta a la que enviaría a la mayoría de las personas primero. No se requiere cuenta para los primeros tres intercambios de video — esa es una oferta genuina de prueba sin compromiso, no un temporizador de cuenta regresiva. La resolución de salida va desde 512px en el plan gratuito hasta 4K para usuarios empresariales, con controles de calidad integrados para iluminación y características faciales.

En mi prueba de plano de cabeza hablante, la mezcla de bordes fue la más limpia que vi en todas las herramientas — las transiciones de la línea del cabello en particular. En el clip de movimiento, la alineación facial se mantuvo estable durante el movimiento de la cabeza, que es un punto de fallo común para las herramientas más baratas, lo que la hace especialmente adecuada para videos de cabeza hablante y clips cortos de marketing donde el realismo importa.

La marca de agua del nivel gratuito y el límite de clip de 10 segundos son límites reales. Para los planes de pago, los precios comienzan en $12/mes y los renderizados en clips cortos generalmente se completan en menos de 2 minutos. Las actualizaciones de finales de 2025 añadieron detección de múltiples rostros en video y mejoraron la precisión de la sincronización labial — ambas probadas notablemente mejor que las versiones anteriores.

La mejor opción gratuita: Vidwud

Vidwud ocupa una posición inusual: genuinamente sin marca de agua en las exportaciones gratuitas, y no se requiere cuenta para comenzar. En mi prueba de plano de cabeza hablante de frente, la calidad de salida fue competitiva con el nivel gratuito de Magic Hour — mezcla de bordes nítida, consistencia de tono de piel razonable.

Las diferencias aparecieron en el clip de movimiento. El giro de 45 grados produjo un salto de identidad visible en una de las tres ejecuciones de prueba — el rostro intercambiado revirtió brevemente a la geometría facial de origen durante el giro antes de recuperarse. No fue consistente, pero estuvo presente. Los tiempos de cola durante las horas pico fueron de 7 a 9 minutos en mis pruebas, lo que vale la pena considerar si estás iterando.

Para cualquiera que trabaje principalmente con metraje de frente y esté dispuesto a planificar alrededor de la cola, Vidwud ofrece la mayor calidad de salida por dinero gastado — específicamente cero dólares.

La mejor para clips con múltiples rostros: Remaker

Remaker es la herramienta a la que recurriría específicamente cuando el clip tiene más de un sujeto. Resolver la consistencia temporal para video con múltiples rostros requiere que cada rostro sea rastreado y reemplazado de forma independiente a lo largo de los fotogramas — y la interfaz de Remaker está diseñada en torno a ese flujo de trabajo. Puedes seleccionar, configurar y evaluar cada intercambio de rostros de forma independiente antes de renderizar.

En mi clip de prueba de 3 personas, la calidad de intercambio individual fue sólida — no al nivel de Magic Hour en detalles faciales de primer plano, pero consistente a lo largo de la secuencia sin deriva de identidad en ninguno de los tres sujetos. El nivel gratuito funciona con un sistema de créditos diarios que limita el volumen, pero cubre algunos clips de prueba antes de alcanzar un límite.

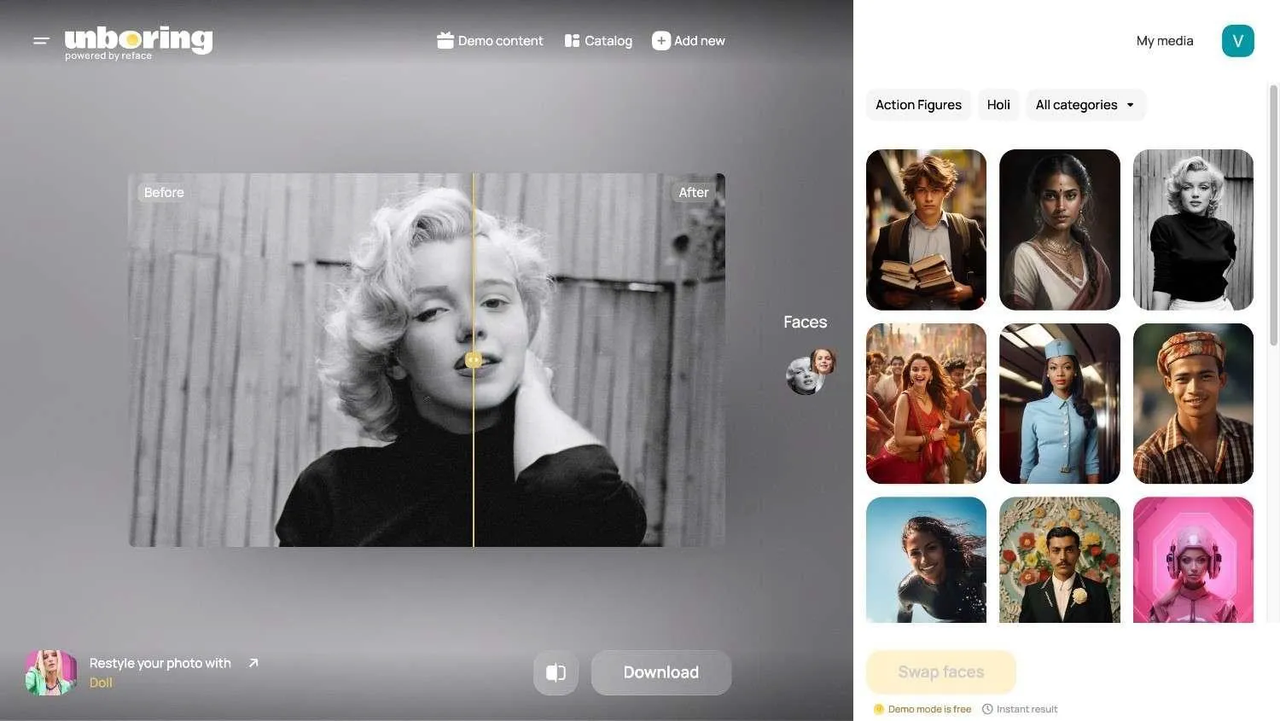

La mejor para renderizado rápido: Reface

Reface no está optimizando para el realismo. Está optimizando para velocidad y capacidad de compartir, y tiene éxito en ambas. De carga a resultado en menos de 30 segundos, de manera consistente. La salida se inclina hacia la calidad de entretenimiento — la mezcla de bordes es más suave y la coincidencia de tono de piel es aproximada en lugar de precisa.

No la usaría para nada donde la precisión de identidad importa. Pero para verificar si un concepto funciona antes de comprometer tiempo de renderizado a una herramienta más lenta, es el ciclo de retroalimentación más rápido disponible. La calidad de las plantillas varía sustancialmente entre las adiciones más antiguas y más nuevas de la biblioteca.

Tabla de Comparación Rápida

Dos notas sobre esta tabla: la calidad espacial y la consistencia temporal se puntúan por separado porque divergen significativamente entre herramientas en los clips de movimiento. Y “tiempo de renderizado (gratuito)” incluye el tiempo de espera en cola — ese es el número que realmente afecta tu flujo de trabajo.

Qué Herramienta Se Adapta a Qué Tipo de Usuario

Creadores ocasionales

Comienza con Magic Hour. Tres intercambios gratuitos, sin cuenta, renderizado rápido. Sabrás en tu primera prueba si la calidad de salida supera tu barrera. Si es así, listo. Si no, pasa a Vidwud para intentos gratuitos ilimitados — más lento, pero sin marca de agua.

Editores de memes y contenido de formato corto

Reface para velocidad cuando estás probando ideas. Vidwud para calidad cuando estás listo para publicar. El intercambio es claro: 30 segundos versus 7 minutos, calidad de entretenimiento versus salida limpia. Elige según dónde estés en el flujo de trabajo, no como una elección permanente.

Usuarios que se preocupan más por el realismo

Aquí está la parte que la mayoría de las reseñas omiten: el realismo consistente a lo largo de un clip de video completo — identidad estable, transiciones de iluminación naturales, sin artefactos temporales — requiere una calidad de modelo que se correlaciona directamente con el cómputo. Los niveles gratuitos son demostraciones, no entornos de producción. Los planes de pago de Magic Hour, con salida hasta 4K y seguimiento de precisión fotograma a fotograma, representan el camino más claro desde “probando” hasta “calidad de salida consistente” entre las herramientas que evalué. Si ese techo todavía no es suficiente para tu caso de uso, las herramientas de escritorio como DeepFaceLab ofrecen un control más granular a costa de una complejidad de configuración significativa.

Lo que la Mayoría de las Reseñas No Mencionan

Por qué “gratuito” a menudo significa límites de cola o marca de agua

El problema del nivel gratuito no se trata principalmente de límites de características — se trata de la priorización del cómputo. Los usuarios gratuitos obtienen renderizado de menor prioridad. “Uso gratuito ilimitado” a veces significa tiempos de espera de 45 minutos en una tarde concurrida. En mis pruebas, la cola en horas pico de Vidwud fue de 7 a 9 minutos; fuera de horas pico bajó a 2 a 3 minutos. Esa varianza importa cuando estás iterando. Prueba en tu horario real, no a las 2am de un martes.

Por qué la calidad de exportación importa más que la calidad de vista previa

Las herramientas comprimen las vistas previas en el navegador. El archivo que descargas es lo que publicas, y los dos suelen ser diferentes. Los artefactos de distorsión temporal en video comprimido — el tipo producido por canalizaciones de exportación de menor calidad — interactúan con la calidad espacial de maneras que hacen que la salida final se vea peor de lo que sugiere cualquier fotograma individual. Siempre descarga una exportación de prueba y revísala en resolución completa antes de construir un flujo de trabajo alrededor de cualquier herramienta. La vista previa es marketing. La descarga es el producto.

Una Nota sobre el Contexto Legal

El panorama legal en torno al contenido facial sintético ha cambiado de manera significativa y recientemente. La Ley TAKE IT DOWN, promulgada el 19 de mayo de 2025, penaliza la publicación no consensual de imágenes íntimas, incluidos los deepfakes generados por IA, con plataformas cubiertas obligadas a eliminar el contenido marcado dentro de las 48 horas — y las prohibiciones penales entrando en vigor de inmediato. El registro legislativo completo está disponible en el resumen oficial de la Ley TAKE IT DOWN de Congress.gov.

En la UE, el panorama es diferente pero igualmente específico. El Artículo 50 de la Ley de IA de la UE requiere que los proveedores de sistemas de IA que generan contenido de video sintético garanticen que las salidas estén marcadas en un formato legible por máquina y detectables como generadas artificialmente. Estas obligaciones entran en vigor en agosto de 2026, según los requisitos oficiales de transparencia del Artículo 50 de la Ley de IA de la UE. Si estás publicando contenido con rostros intercambiados públicamente en Europa, ese requisito se aplica a las herramientas que generan el contenido — y por extensión a cómo lo etiquetas y distribuyes.

Todas las herramientas en esta guía son para uso creativo consensual con contenido sobre el que tienes derechos. Ese encuadre no es texto legal estándar — es el alcance real dentro del cual estas herramientas son utilizables sin exposición legal.

Recomendación Final

Si solo necesitas experimentos rápidos

Magic Hour primero — tres intercambios gratuitos reales, renderizado rápido, sin fricción. Luego Vidwud si necesitas más intentos gratuitos y puedes trabajar alrededor de los tiempos de cola. Entre los dos, tendrás una lectura clara sobre si la calidad de salida satisface tu caso de uso antes de gastar algo.

Si necesitas calidad repetible

La calidad repetible significa salida consistente a través de múltiples clips bajo condiciones variables — renderizados estables, tiempos predecibles, consistencia temporal confiable. Eso requiere un nivel de pago en algún lugar. Las actualizaciones de finales de 2025 de Magic Hour mejoraron la detección de múltiples rostros en video y redujeron el retraso de sincronización labial, con la velocidad de procesamiento en la nube en clips cortos ahora más rápida y estable que las versiones anteriores. Para cualquiera que esté construyendo un flujo de trabajo de contenido en lugar de ejecutar pruebas únicas, esa trayectoria importa tanto como la calidad de salida actual.

Elige tu barra mínima de calidad. Descarga una exportación de prueba real, no una vista previa. Compara en resolución completa. Esa es la única evaluación que realmente mapea lo que publicarás. Si quieres ir más allá de editar clips y comenzar a generar videos con IA desde cero, este tutorial explica cómo crear videos con Seedance 2.0 en Wavespeed. ¡Hasta luego, queridos!