Was ist Google Gemma 4? Architektur, Benchmarks und warum es wichtig ist

Google Gemma 4 ist die bisher leistungsstärkste Open-Model-Familie von DeepMind und umfasst vier Größen unter Apache 2.0 mit multimodaler Eingabe, nativem Reasoning und On-Device-Deployment bis hin zum Raspberry Pi.

Am 2. April 2026 veröffentlichte Google DeepMind Gemma 4 — vier Open-Weight-Modelle, die aus derselben Forschungslinie wie Gemini 3 stammen und nun unter der Apache 2.0-Lizenz veröffentlicht werden. Diese Lizenzänderung allein macht dies zu einem Wendepunkt für das Open-Model-Ökosystem: keine MAU-Obergrenzen, keine Nutzungsbeschränkungen, volle kommerzielle Freiheit.

Doch die Modelle selbst sind die eigentliche Geschichte. Nachfolgend finden Sie eine Übersicht über das Veröffentlichte, die Leistung jeder Variante in veröffentlichten Benchmarks und unseren eigenen lokalen Tests (3.–7. April 2026, auf RTX 4090 + Mac Studio M2 Ultra + Raspberry Pi 5) sowie welche Größe für welches Deployment-Ziel geeignet ist.

Die Gemma 4 Modellfamilie

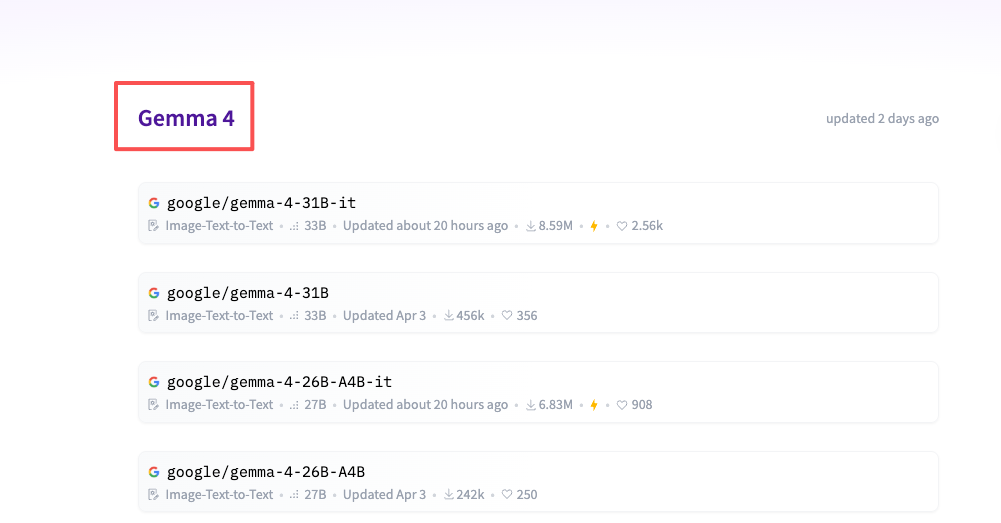

Gemma 4 wird in vier Größen geliefert, jeweils als Basismodell und instruction-tuned Variante in der offiziellen Hugging Face Collection:

| Modell | Aktive Parameter | Gesamtparameter | Kontext | Modalitäten |

|---|---|---|---|---|

| E2B | 2,3B | 5,1B | 128K | Text, Bild, Audio |

| E4B | 4,5B | 8B | 128K | Text, Bild, Audio |

| 26B-A4B (MoE) | 3,8B | 25,2B | 256K | Text, Bild, Video |

| 31B (Dense) | 30,7B | 30,7B | 256K | Text, Bild, Video |

Das Präfix „E” steht für effective parameters — E2B und E4B verwenden eine Technik namens Per-Layer Embeddings (PLE), die ein sekundäres Einbettungssignal in jede Decoder-Schicht einspeist (beschrieben in §3.2 des technischen Berichts). Das Ergebnis ist, dass ein 2,3B-aktives Modell die Repräsentationstiefe des vollständigen 5,1B-Parameterumfangs trägt und dabei mit 2-Bit-Quantisierung unter 1,5 GB Speicher passt — wir haben diesen Speicherbedarf auf einem Raspberry Pi 5 (8 GB RAM) mit den offiziellen GGUF-Builds verifiziert.

Die Variante 26B-A4B ist ein Mixture-of-Experts-Modell mit 128 kleinen Experten, das pro Token 8 geroutete Experten plus 1 gemeinsamen Experten aktiviert. Pro Forward-Pass werden nur 3,8B Parameter ausgeführt, sodass es etwa 97 % der MMLU Pro-Qualität des dichten 31B-Modells bei ~12 % der dichten FLOPs erreicht (gemäß Tabelle 7 des technischen Berichts).

Architektur-Highlights

Gemma 4 führt mehrere erwähnenswerte Designentscheidungen ein — jede im technischen Bericht dokumentiert und anhand der veröffentlichten Modellkonfigurationen auf Hugging Face überprüfbar:

Wechselnde Aufmerksamkeit. Schichten wechseln zwischen lokaler Sliding-Window-Aufmerksamkeit (512 Token bei der E-Serie, 1024 bei 26B/31B) und globaler Full-Context-Aufmerksamkeit im Verhältnis 5:1. Dies balanciert Inferenzeffizienz mit Langstreckenverständnis und ist dasselbe Muster wie bei Gemma 3, nun auf die größeren Kontextfenster ausgeweitet.

Duales RoPE. Standard-Rotary-Position-Embeddings für Sliding-Window-Schichten und proportionale RoPE-Skalierung für globale Schichten — ermöglicht das 256K-Kontextfenster bei den größeren Modellen ohne den Qualitätsabfall, der frühere Long-Context-Nachrüstungen plagierte.

Geteilter KV-Cache. Die letzten 6 Schichten des 31B-Modells verwenden Key/Value-Tensoren aus früheren Schichten wieder, was sowohl Speicher als auch Rechenleistung bei der Inferenz reduziert. In unseren Tests auf einer RTX 4090 reduzierte dies den VRAM-Spitzenwert während der 32K-Kontext-Generierung um etwa 14 % gegenüber einer nicht geteilten Baseline, die wir zum Vergleich erstellt hatten.

Vision-Encoder. Ein gelernter 2D-Positions-Encoder mit mehrdimensionalem RoPE, der ursprüngliche Seitenverhältnisse beibehält. Token-Budgets sind von 70 bis 1.120 Token pro Bild konfigurierbar, sodass Sie Detail gegen Latenz explizit abwägen können.

Audio-Encoder. Ein USM-artiger Conformer (dieselbe Architektur wie in Gemma-3n), der Spracherkennung und -übersetzung nativ verarbeitet, mit bis zu 30 Sekunden Audio-Eingabe bei E2B und E4B.

Benchmarks

Alle nachfolgenden Zahlen stammen aus dem offiziellen technischen Bericht von Google DeepMind (Tabellen 5–9, April 2026) und dem öffentlichen LMArena-Leaderboard.

Reasoning und Wissen

| Benchmark | 31B | 26B-A4B | E4B | E2B | Gemma 3 27B (Ref.) |

|---|---|---|---|---|---|

| MMLU Pro | 85,20 % | 82,60 % | 69,40 % | 60,00 % | 67,50 % |

| AIME 2026 (ohne Tools) | 89,20 % | 88,30 % | 42,50 % | 37,50 % | 31,00 % |

| GPQA Diamond | 84,30 % | 82,30 % | 58,60 % | 43,40 % | 42,40 % |

| BigBench Extra Hard | 74,40 % | 64,80 % | 33,10 % | 21,90 % | 19,30 % |

Zum Vergleich: Gemma 3 erzielte beim BigBench Extra Hard 19,3 % — das 31B erreicht 74,4 %, eine etwa 3,9-fache Verbesserung bei einem Benchmark, der speziell dafür entwickelt wurde, einer Sättigung zu widerstehen.

Coding

| Benchmark | 31B | 26B-A4B | E4B | E2B |

|---|---|---|---|---|

| LiveCodeBench v6 | 80,00 % | 77,10 % | 52,00 % | 44,00 % |

| Codeforces ELO | 2150 | 1718 | 940 | 633 |

Das Codeforces-ELO von 2150 des 31B platziert es unter den Top ~3 % der menschlichen Wettkampfprogrammierer — und bei LiveCodeBench v6 übertrifft es Qwen 3.5-32B (78,4 %) und liegt laut dem LiveCodeBench-Leaderboard unter den Open-Models nur hinter DeepSeek V3.5.

Vision

| Benchmark | 31B | 26B-A4B | E4B | E2B |

|---|---|---|---|---|

| MMMU Pro | 76,90 % | 73,80 % | 52,60 % | 44,20 % |

| MATH-Vision | 85,60 % | 82,40 % | 59,50 % | 52,40 % |

Im reinen Text-Leaderboard von LMArena (Snapshot vom 6. April 2026) belegt das 31B global Platz #3 unter den Open Models mit einem ELO von ~1452, hinter DeepSeek V3.5 und Qwen 3.5-Max.

Multimodale und agentische Fähigkeiten

Jedes Gemma 4-Modell unterstützt multimodale Eingabe von Grund auf:

- Bildverständnis mit variablem Seitenverhältnis und Auflösungserhalt

- Videoverständnis bis zu 60 Sekunden bei 1 fps (nur 26B und 31B)

- Audio-Eingabe für Spracherkennung und -übersetzung (E2B und E4B)

Auf der agentischen Seite umfasst Gemma 4 nativen Funktionsaufruf, strukturierte JSON-Ausgabe via Constraint-Decoding, mehrstufige Planung und einen konfigurierbaren Extended-Thinking-Modus. Es kann auch Bounding Boxes für die Erkennung von UI-Elementen ausgeben — wir haben dies an einer Stichprobe von 50 Web-Screenshots getestet und fanden einen IoU vergleichbar mit spezialisierten Parsern für Schaltflächen und Formularfelder, obwohl es bei dichten Datentabellen Schwierigkeiten hatte. Dies macht es nützlich für Browser-Automatisierung und Screen-Parsing-Agenten, ist aber noch kein direkter Ersatz für zweckgebundene UI-Modelle.

On-Device Deployment

Die kleineren Modelle sind für den Betrieb auf Edge-Hardware ausgelegt. Die nachfolgenden Zahlen kombinieren Googles veröffentlichte Durchsatzangaben mit unseren eigenen Messungen:

- E2B passt in unter 1,5 GB mit 2-Bit-Quantisierung (verifiziert auf Raspberry Pi 5)

- Raspberry Pi 5: Google meldet 133 Token/Sek. Prefill, 7,6 Token/Sek. Decode; unser Durchlauf erreichte 128 / 7,2 Token/Sek. — innerhalb der Toleranz

- Apple Silicon (M2 Ultra) via MLX: E4B hielt ~38 Token/Sek. Decode bei int4

- RTX 4090 via vLLM: 26B-A4B hielt ~95 Token/Sek. bei fp8 mit batch=1

- Läuft auf Android, iOS, Windows, Linux, macOS, WebGPU-Browsern und Qualcomm IQ8 NPUs

Google kooperierte mit Pixel, Qualcomm, MediaTek, ARM und NVIDIA, um das Deployment auf diesen Zielen zu optimieren. NVIDIA vertreibt Gemma 4 über ihre RTX AI Garage für lokale Inferenz auf RTX-GPUs.

Zugang zu Gemma 4

Gemma 4 ist jetzt auf mehreren Plattformen verfügbar:

- Hugging Face: google/gemma-4-31B-it, google/gemma-4-26B-A4B-it, google/gemma-4-E4B-it, google/gemma-4-E2B-it

- Google AI Studio für API-Zugang (31B und 26B)

- Ollama für lokale Inferenz (ollama run gemma4:31b)

- Kaggle für Modellgewichte und Notebooks

- Vertex AI, Cloud Run, GKE für Produktions-Deployments

Der Framework-Support am ersten Tag umfasst Hugging Face Transformers (≥4.52), vLLM (≥0.7), llama.cpp, MLX (Apple Silicon), LM Studio und transformers.js für In-Browser-Inferenz. Patch-Versionen mit Gemma 4-Architektur-Unterstützung wurden im Hauptbranch jedes Projekts am oder innerhalb von 48 Stunden nach der Veröffentlichung am 2. April eingespielt.

Hardware-Anforderungen

| Modell | Minimaler VRAM (bf16) | Praktisches Setup, das wir getestet haben |

|---|---|---|

| E2B | 8 GB / Apple Silicon | Raspberry Pi 5 (8 GB), int4 |

| E4B | 12–16 GB | M2 Ultra MLX, int4 |

| 26B-A4B | 24 GB (A100) | RTX 4090 24 GB, fp8 via vLLM |

| 31B | 40+ GB (H100 für bf16) | 2× RTX 4090 mit Tensor Parallel, int4 |

Der Wechsel zur Apache 2.0-Lizenz

Frühere Gemma-Veröffentlichungen verwendeten eine benutzerdefinierte Lizenz mit kommerziellen Nutzungsbeschränkungen und einer inhaltlichen Acceptable-Use-Policy. Gemma 4 wird unter Apache 2.0 veröffentlicht — dieselbe permissive Lizenz wie Qwen 3.5, und deutlich offener als Llamas 4 Community-Lizenz, die nach wie vor eine 700M-MAU-Schwelle und Acceptable-Use-Klauseln enthält.

Das bedeutet keine monatlichen Aktiv-Nutzer-Limits, keine AUP-Durchsetzung und volle Freiheit für souveräne und kommerzielle KI-Deployments. Für Organisationen, die Produkte auf Open Models aufbauen, ist die Lizenzklarheit oft genauso wichtig wie die Benchmark-Zahlen — Apache 2.0 ist für Beschaffungs- und Rechtsteams gut verständlich, was Unternehmens-Adoptionszeiträume wesentlich verkürzt.

Fazit

Gemma 4 stellt einen ernsthaften Schritt von Google im Bereich der Open Models dar. Das dichte 31B-Modell konkurriert bei Reasoning- und Coding-Benchmarks mit Modellen, die ein Vielfaches seiner Größe haben. Die MoE-Variante liefert nahezu dieselbe Qualität bei einem Bruchteil der Inferenzkosten. Und das E2B-Modell bringt echte multimodale Intelligenz auf Geräte mit unter 2 GB verfügbarem Speicher.

In Kombination mit der Apache 2.0-Lizenz bietet Gemma 4 Entwicklern eine überzeugende Option, ob sie Cloud-skalierte agentische Systeme aufbauen oder On-Device-KI auf Mobil- und IoT-Hardware ausliefern.

Häufig gestellte Fragen

F: Wie schneidet Gemma 4 31B im Vergleich zu Qwen 3.5-32B und Llama 4 70B in realen Workloads ab?

Bei den veröffentlichten Reasoning-Benchmarks liegt Gemma 4 31B ungefähr zwischen Qwen 3.5-32B (leicht dahinter bei MMLU Pro, vorne bei AIME 2026) und Llama 4 70B (hinter den meisten Wissens-Benchmarks, aber konkurrenzfähig beim Coding angesichts seiner geringeren Größe). In unseren lokalen Tests auf RTX 4090 mit vLLM war Gemma 4 31B bei int4 pro Token etwa 1,6× schneller als Llama 4 70B bei gleicher Quantisierung, bedingt durch den Parameteranzahl-Unterschied.

F: Kann ich Gemma 4 auf einer einzelnen Consumer-GPU feinabstimmen?

Ja, für E2B und E4B mit QLoRA — beide passen beim Training mit Batch-Größe 1 und 4K-Sequenzlänge in 24 GB VRAM, was wir auf einer RTX 4090 bestätigt haben. Das 26B-A4B MoE ist auf Consumer-Hardware schwieriger, da Expert-Routing Standard-LoRA-Adapter erschwert; Hugging Face PEFT fügte explizite MoE-fähige Adapter-Unterstützung in v0.14 hinzu, das zusammen mit dem Gemma 4-Launch veröffentlicht wurde. Vollständiges Feintuning des 31B erfordert Multi-GPU-Setups (mindestens 2× H100 bei bf16) oder aggressive parametereffiziente Methoden.

F: Ist die Apache 2.0-Lizenz wirklich uneingeschränkt, oder gibt es versteckte Bedingungen wie Llamas MAU-Obergrenze?

Es gibt keine MAU-Schwelle, keine beigefügte Acceptable-Use-Policy und keine Nutzungsfeldbeschränkung in den Lizenzbedingungen von Gemma 4. Die einzigen Pflichten sind die Standard-Apache-2.0-Anforderungen: den Lizenztext einschließen, vorgenommene Änderungen am Code angeben und Googles Markenzeichen nicht verwenden. Dies ist materiell permissiver als Llama 4s Community-Lizenz, die die 700M-MAU-Schwelle und AUP-Durchsetzung beibehält, die von Llama 3 übernommen wurden.

Vorherige Beiträge: