WAN 2.7: Neue Funktionen, API-Zugang & Upgrade-Pfad

WAN 2.7 ist Alibabas großes Upgrade: Steuerung des ersten/letzten Frames, 9-Raster-I2V, Sprachreferenz und Anweisungsbearbeitung. Was Entwickler wissen müssen.

Hallo zusammen. Hier ist Dora! Ich beobachte die Wan-Modellfamilie schon seit Version 2.1 genau, vor allem weil ein Modell, das in Produktionspipelines Open-Source-Zugkraft gewinnt, sich in der Regel schneller entwickelt als die Berichterstattung darüber. WAN 2.7 ist noch im Anflug – der Start ist für März 2026 geplant – daher ist dies kein Release-Review. Es ist eine Preflight-Checkliste für Teams, die bereits mit 2.5 arbeiten und entscheiden müssen, ob sie ihre Infrastruktur umleiten oder abwarten sollen.

Kein Hype. Nur was bestätigt ist, was noch unklar ist und … was das für eure Build-Queue bedeutet. Wer noch dabei ist, herauszufinden, wo Modelle wie Wan eigentlich in einen Produktions-Stack passen, dem hilft diese Übersicht darüber, wie KI-Videogenerierungstools in echten Workflows eingesetzt werden, bevor man tiefer in die Specs einsteigt.

WAN 2.7 in 60 Sekunden (Die Kurzversion)

Für alle, die aus Produkt- oder Engineering-Perspektive evaluieren: WAN 2.7 entwickelt sich eher zu einer funktionalen Erweiterung als zu einem reinen Qualitätssprung. Die Schlagzeile lautet nicht „besseres Video” – sondern „mehr Steuerflächen”. Verbesserungen erstrecken sich auf visuelle Qualität, Audiogenerierung und Bewegungsdynamik, aber die interessanteren Neuerungen sind struktureller Natur: First/Last-Frame-Steuerung, 9-Raster-Multi-Input-I2V, Subjekt-plus-Sprach-Referenz und instruktionsbasiertes Bearbeiten.

Der Unterschied gegenüber 2.5 liegt nicht primär in der Auflösung. Es ist die Anzahl der Ankereingaben, die das Modell jetzt in einem einzigen Aufruf akzeptiert.

Was ist neu in WAN 2.7

First-Frame & Last-Frame-Videosteuerung

Der First-and-Last-Frame-Ansatz ermöglicht es, sowohl den Anfang als auch das Ende eines Videos anhand von zwei Bildern zu definieren, wobei das Modell den dazwischenliegenden Inhalt automatisch generiert. Dies existierte bereits als eigenständiges Modell in früheren Wan-Releases (siehe Wan2.1-FLF2V-14B), aber 2.7 integriert es direkt ins Modell, statt es als separaten Checkpoint bereitzustellen.

Für Produktionsteams: Das ist am wichtigsten, wenn ihr definierte Keyframes habt – ein Produktfoto in Ruhe, ein Produktfoto in Bewegung – und möchtet, dass das Modell den Übergang interpoliert, ohne einen vollständigen manuellen Animationsdurchlauf. Die Endpunkte sind deterministisch. Was dazwischen passiert, ist weiterhin stochastisch, aber die kompositorischen Leitplanken sind vorhanden.

9-Raster Image-to-Video (3×3 Multi-Input)

WAN 2.7 unterstützt einen 3×3-Rastersynthese-Ansatz, d. h. bis zu neun Referenzbilder können als strukturierter Input für eine einzelne Videogenerierungsaufgabe eingereicht werden. Das unterscheidet sich grundlegend von Single-Frame-I2V.

Die praktische Anwendung: Wenn ihr charakterkonsistente Inhalte über verschiedene Winkel oder Lichtverhältnisse hinweg generiert, könnt ihr jetzt ein Referenzraster einreichen … statt eines einzigen Ankers. Wer vergleichen möchte, wie verschiedene Tools mit Multi-Referenz-Konsistenz umgehen, dem zeigt dieser Leitfaden zu den besten Video-Face-Swap-Tools mit Multi-Gesicht- und Multi-Input-Unterstützung, wo aktuelle Lösungen noch schwächeln. Es reduziert den One-Shot-Glücksfaktor, der I2V-Batch-Jobs bei der Qualitätsprüfung teuer macht. Die genaue API-Parameterstruktur muss beim Launch bestätigt werden – das Endpoint-Schema für Grid-Inputs wurde zum Zeitpunkt dieser Veröffentlichung noch nicht offiziell veröffentlicht.

Subjekt + Sprach-Referenz

WAN 2.7 ermöglicht es, eine visuelle Subjektreferenz mit einer Sprachreferenz zu kombinieren, um Videos zu generieren, in denen sowohl das Erscheinungsbild als auch die Stimme des Charakters mit euren Inputs übereinstimmen. Dies ist eine Erweiterung dessen, was Wan 2.6 mit seinem R2V-Modell eingeführt hat – das es Nutzern ermöglichte, ein Charakter-Referenzvideo mit sowohl Erscheinungsbild als auch Stimme hochzuladen und mithilfe von Text-Prompts lebhafte neue Szenen mit diesem Charakter zu generieren.

In 2.7 wird erwartet, dass dies stärker integriert wird, statt als separater Modell-Endpoint zu fungieren. Für Teams, die charaktergetriebene Kurzinhalte oder Lokalisierungs-Pipelines entwickeln, … ist dies das Feature mit dem klarsten Produktions-ROI – vorausgesetzt, das Sprach-Referenz-Handling ist bei wiederholten Batch-Aufrufen stabil. Zum Kontext: Hier beginnen auch aktuelle KI-Video-Face-Swap-Pipelines im großen Maßstab zu versagen, besonders wenn Identitäts- und Stimmkonsistenz gleichzeitig erforderlich sind.

Instruktionsbasiertes Videobearbeiten

WAN 2.7 unterstützt das Bearbeiten vorhandener Videos mithilfe von natürlichen Sprachanweisungen – Hintergründe ändern, Beleuchtung modifizieren oder das Outfit eines Charakters anpassen, indem man die Änderung beschreibt und das Modell den Rest erledigen lässt.

Das ist ein bedeutender Wandel von Generierung zu Bearbeitung. Für Produktionsteams, die Nachproduktions-Korrekturschleifen betreiben, eröffnet sich damit eine leichtgewichtigere Alternative zu manueller Roto- und Compositing-Arbeit für kleinere Änderungen. Die zentrale Unbekannte ist, wie das Modell die zeitliche Konsistenz über längere Clips hinweg handhabt, wenn Bearbeitungen bewegungsnahe Elemente betreffen (z. B. Kleidung auf einem sich bewegenden Subjekt). Dort haben vergleichbare Tools historisch gesehen nachgelassen.

Die offizielle Alibaba Cloud Model Studio-Dokumentation behandelt bereits verwandte Bearbeitungs-Endpoints im aktuellen Wan-Lineup, was eine gewisse Ausgangsbasis für das API-Muster bietet, das ihr in 2.7 wahrscheinlich sehen werdet.

Videorekonstruktion / Replikation [Verifizierung erforderlich]

Dieses Feature – das Nachbilden oder Replizieren vorhandener Videos mit Stil- oder Subjektänderungen bei gleichzeitiger Beibehaltung der Bewegungsstruktur – ist in Zusammenfassungen von WAN 2.7 durch Dritte aufgetaucht. Es wurde zum Zeitpunkt dieser Veröffentlichung nicht unabhängig in der offiziellen Alibaba-Dokumentation bestätigt. Baut keine Workflow-Abhängigkeiten auf dieser Funktion auf, bis Alibabas offizielle Release-Notes sie bestätigen. Kennzeichnet sie als explorativ, wenn ihr derzeit ein Upgrade-Projekt plant.

Was gleich bleibt (Architekturkontinuität ab 2.6)

Die zugrunde liegende DiT-Architektur (Diffusion Transformer) wird fortgeführt. Die Wan-Serie verwendet eine Transformer-Komponente, die auf der gängigen Video-DiT-Architektur basiert und einen Full-Attention-Mechanismus einsetzt, um langreichweitige raum-zeitliche Abhängigkeiten präzise zu erfassen und so hohe zeitliche und räumliche Konsistenz zu gewährleisten.

Das ist wichtig für Teams, die lokale Inferenz betreiben: Das GPU-Speicherprofil und der Quantisierungsansatz werden sich nicht drastisch ändern. Wenn euer 2.6-Inferenz-Stack optimiert ist (FP8-Ops, Multi-GPU-Sharding), trägt diese Investition weiterhin Früchte. Erwartet keine völlig neue Deployment-Architektur.

API-Zugang & Verfügbarkeit – Was bestätigt ist, was noch offen ist

Offizielle Zugangspfade (DashScope / Wan.video)

Die zwei bestätigten offiziellen Kanäle für frühere Wan-Versionen waren Alibaba Clouds DashScope-Plattform – die API-Key-Bereitstellung und Modellzugang verwaltet – sowie Wan.video für Creator-seitige Workflows. Beide sollen 2.7 zum Launch tragen, obwohl die regionale Verfügbarkeit (insbesondere für internationale Konten gegenüber Festlandchina) zum Release-Zeitpunkt bestätigt werden sollte.

Der DashScope-API-Key wird aus der Umgebungsvariable DASHSCOPE_API_KEY geladen, wobei internationale Nutzer auf dashscope-intl.aliyuncs.com verweisen – das gleiche Muster wird mit an Sicherheit grenzender Wahrscheinlichkeit für 2.7 gelten, angesichts der etablierten Infrastruktur.

Drittanbieter-API-Verfügbarkeit

Zum Zeitpunkt dieser Veröffentlichung ist WAN 2.7 noch nicht auf Drittanbieter-API-Aggregatoren bestätigt. Basierend auf dem Muster ab 2.2 – wo native ComfyUI-Unterstützung am Launch-Tag für Open-Source-Modellgewichte eintraf – ist damit zu rechnen, dass Community-Integrationen schnell folgen, wenn 2.7 mit öffentlichen Gewichten erscheint.

Ob 2.7 als Open-Source erscheint, ist ebenfalls unbestätigt. Siehe FAQ unten.

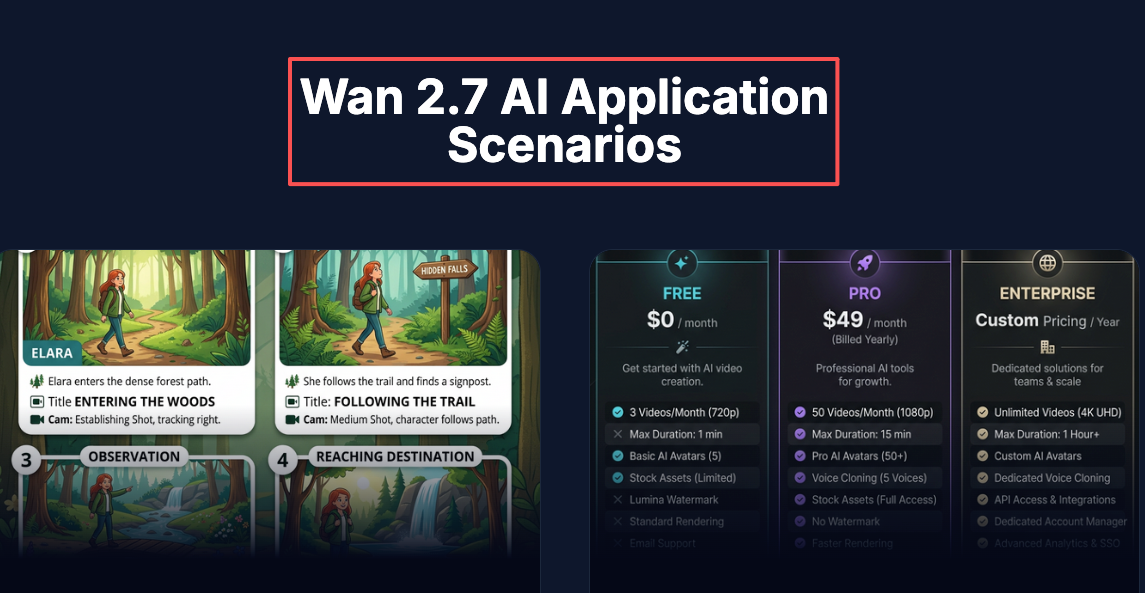

Für wen WAN 2.7 jetzt Priorität haben sollte

Teams mit referenzlastiger Videoproduktion

Wenn eure Pipeline bereits auf Charakterkonsistenz über Aufnahmen hinweg angewiesen ist – und ihr das bisher durch mehrere Generierungsdurchläufe oder ControlNet-Workarounds kompensiert habt – sind die Subjekt + Sprach-Referenz und der Multi-Frame-Grid-Input die zwei Features, die diesen Aufwand am direktesten reduzieren. Ein Upgrade lohnt sich zu prüfen.

Entwickler, die Multi-Input-I2V benötigen

Single-Image-I2V funktioniert, bis ihr Konsistenz braucht. Der 9-Raster-Input verändert die Referenzfläche erheblich. Wenn ihr bisher Workarounds gebündelt habt, um dies zu simulieren, könnte 2.7 mehrere API-Aufrufe in einen konsolidieren.

Creative Teams, die auf WAN 2.5 warten können

Wenn eure 2.5-Workflows stabil sind und die neuen Features nicht auf aktive Produktionsengpässe abbilden, besteht keine Dringlichkeit. Das Modell startet noch. Lasst die ersten zwei Wochen Community-Feedback die Edge Cases aufdecken, bevor ihr etwas umverkabelt.

FAQ

- Wann ist WAN 2.7 offiziell per API verfügbar? Der Start ist für März 2026 geplant. Genaues API-Verfügbarkeitsdatum je Region: noch nicht bestätigt.

- Ist WAN 2.7 Open-Source wie WAN 2.2? Unbestätigt. Wan 2.2 wurde unter Apache 2.0 veröffentlicht, was kommerzielle Nutzung und ComfyUI-Integration ermöglichte. Ob 2.7 der gleichen Lizenz folgt, wurde in den Pre-Launch-Materialien nicht angegeben.

- Unterstützt WAN 2.7 ComfyUI? Noch keine bestätigte Integration. Angesichts früherer Releases – Wan 2.1 und 2.2 hatten beide ComfyUI-Unterstützung am oder nahe am Launch-Tag – ist davon auszugehen, dass Community-Nodes schnell folgen, wenn die Modellgewichte öffentlich sind.

- Wie sind die Preise im Vergleich zu WAN 2.5? Es wurden keine Preise bekannt gegeben. Die Wan-Modellreihe wurde über DashScope typischerweise pro Sekunde oder pro Video abgerechnet. Prüft die Alibaba Cloud Model Studio-Preise zum Launch für aktualisierte Tarife.

- Kann ich WAN 2.7 heute von Drittanbieter-API-Providern abrufen? Noch nicht. Das Modell ist noch nicht gestartet. Verfolgt das offizielle Wan-GitHub und die DashScope-Docs für die Release-Bestätigung und prüft danach die Plattformunterstützung.

Was nach dem Launch zu beobachten ist

Einige Dinge, die es wert sind, in den ersten Wochen nach der Stabilisierung von 2.7 zu verfolgen:

— Zeitliche Konsistenz bei Instruktionsbearbeitungen: Instruktionsbasiertes Bearbeiten ist das Feature, das sich in der Praxis am wahrscheinlichsten anders verhält als in der Vorschau dargestellt. Beobachtet Community-Outputs genau.

— Open-Source-Gewichts-Release: Wenn Gewichte öffentlich erscheinen, sind ComfyUI-Workflows, Diffusers-Integration und quantisierte Varianten innerhalb von Tagen zu erwarten. Wenn nicht, bleibt die DashScope-API der primäre Zugangspfad – und regionale Latenz wird zu einer echten Workflow-Variable.

— Status des Videorekonstruktions-Features: Dieses braucht eine offizielle Quelle. Plant es nicht in irgendetwas ein, bis Alibaba es explizit bestätigt.