SkyReels V4 vs SkyReels V2: Wie viel hat sich das Modell wirklich verbessert?

SkyReels entwickelte sich von unbegrenzt langen Videos (V2) zur gemeinsamen Audio-Video-Generierung (V4). Hier ist genau, was sich verändert hat, was besser wurde und wofür jede Version noch am besten geeignet ist.

Hallo, ich bin Dora. Ich hatte diese Woche eigentlich nicht geplant, SkyReels zu vergleichen. Ich wollte nur einen Loop-Hintergrundclip für ein Landing-Page-Mockup, und mein übliches Setup fühlte sich schwerer an als nötig. Dieses kleine Gewicht – das Durchklicken alter Nodes, das Warten auf Previews, das Rätselraten beim Audio-Timing – gab mir zu denken. Also stellte ich V2 und V4 nebeneinander und ließ dieselben Prompts durch beide laufen. Nicht um einen Sieger zu küren. Nur um zu sehen, wo die Arbeit leichter wirkt.

Wer hier ein einfaches Urteil sucht, wird es nicht finden. SkyReels V2 und V4 lösen unterschiedliche Teile des Puzzles. Dies sind meine Feldnotizen zur „SkyReels V4 vs V2”-Frage, geschrieben nach einer Handvoll echter Durchläufe zwischen Feb–März 2026.

Ein kurzer SkyReels-Familien-Zeitstrahl

V1 (menschenzentriert, Feb 2025) → V2 (unbegrenzte Länge) → V3 (Audio-Experimente) → V4

Ich habe SkyReels zum ersten Mal um V1 herum Anfang 2025 verwendet. Es wirkte wie ein durchdachtes Projekt – Human-in-the-Loop, langsamer, aber stetig. V2 kam und verlagerte leise den Schwerpunkt: „unendliche” Videos per Diffusion Forcing. Nicht unendlich im poetischen Sinne, sondern tatsächlich unbegrenzte Sequenzen, in die man immer weitere Frames einspeisen konnte.

V3 beschäftigte sich ernsthafter mit Audio. Ich erinnere mich an eine ordentliche Ausrichtung auf Sprach-Beats, aber es fühlte sich immer noch an wie zwei Züge auf einem Gleis: Audio auf dem einen, Video auf dem anderen, quer über den Spalt winkend.

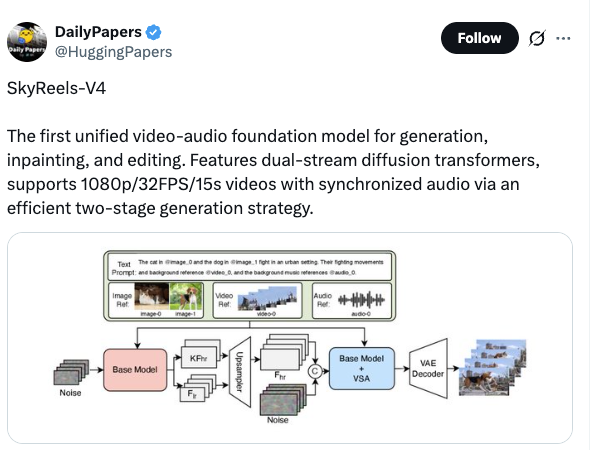

V4 strafft das Ganze. Andere Prioritäten, andere Standardwerte. Es ist weniger ein lineares Upgrade als vielmehr ein Reset dessen, was „eine Ausgabeeinheit” bedeutet. Mit V4 wird ein Clip zu einem kohärenten Artefakt – Audio und Video gemeinsam produziert, in höherer nativer Qualität, mit einer Begrenzung der Länge. Diese Begrenzung ist ein bewusster Tausch.

Was V2 wirklich gut gemacht hat

Diffusion Forcing für unbegrenzte Videos

Als ich V2s Diffusion Forcing zum ersten Mal für Langform einsetzte, schoss ich über das Ziel hinaus. Ich ließ es während der Mittagspause laufen und kam zu vier Minuten bemerkenswert konsistenter Bewegung zurück – wie ein Musikvisualizer, der vergessen hat aufzuhören. Das war sowohl der Reiz als auch das Risiko: Es konnte einfach weitergehen. In der Praxis lernte ich, es wie eine laufende Kamera zu behandeln, bis ich genug natürliche Bewegung zum Schneiden hatte.

Für Hintergrundloops, Texturen, abstrakte Bewegung trug V2 die Last. Die mentale Entlastung kam davon, keine Neustarts oder Zeitstempel jonglieren zu müssen. Ich gab eine Richtung vor und behielt oder kürzte nach Bedarf. Als ich letzten Monat einen 45–60 Sekunden langen Hintergrund für eine Veranstaltungsseite brauchte, schaffte V2 das in einem Durchgang. Kein Zusammenfügen, keine Szenengrenzen.

Open-Source, ComfyUI-kompatibel

Ich schätzte auch, wie nahtlos V2 in meinen bestehenden Workflow passte. ComfyUI-Nodes, Community-Snippets, ein paar kleine eigene Anpassungen – ich konnte meine Zimmerpflanzen an Ort und Stelle lassen, während ich die Möbel umstellte. Wenn man ein zusammengestückeltes Rig hat (ich habe eins) und gelegentlich mit Leuten zusammenarbeitet, die ihre eigenen Graphen mitbringen (auch ich), spielt V2 gut mit. Das zählt mehr, als es klingt. Die gesparte Zeit sind nicht nur Minuten: Es sind weniger mentale Verzweigungen. Weniger „Wo ist dieser Converter-Node geblieben?”

Ich bemerkte auch, dass V2 bei Hardware nachsichtig war. Nicht billig zu betreiben, aber ich konnte die Leistung reduzieren, ohne dass alles zusammenbrach. Wenn jemand mir ein Preset schickte, funktionierte es meistens nach kleinen Anpassungen „einfach so”. Das ist eine langweilige Stärke. Ich mag langweilige Stärken.

Was V4 grundlegend verändert

Audio wird zum First-Class-Bürger

In V4 ist Audio kein Nachgedanke. Es ist eingebaut. Ich testete dies, indem ich am 27. Februar einen kurzen Promo-Clip für einen Podcast-Trailer generierte und am 2. März erneut mit einem leicht anderen Voice-Bett. V4 synchronisierte die visuelle Betonung mit Kick und Snare sauberer als jede V2-Pipeline, die ich zusammengestellt hatte. Nicht perfekt, aber natürlich genug, dass ich nicht nach Keyframes greifen musste.

Die einfache Version: V2 konnte Audio anfügen; V4 komponiert damit. Wenn deine Arbeit von beat-synchronen Visuals oder stimmgeführtem Pacing abhängt, reduziert V4 den manuellen Aufwand.

Einheitliche Architektur statt getrennter Pipelines

Das Gefühl dabei: weniger Schalter im Kopf. In der V2-Welt dachte ich an „Audio-Welt” und „Video-Welt” und verbrachte Zeit damit, Entscheidungen zwischen ihnen zu verbinden. In V4 gebe ich ein einziges Briefing und lasse das Modell den Kontext über beide Streams tragen. Als ich die Betonung des Voiceovers anpasste (eine Zeile weicher, eine Zeile schärfer), gleichte V4 Schnitte und Bewegung daran an. Mit V2 hätte das einen teilweisen Neuaufbau bedeutet.

Weniger sichtbarer Vorteil: Weniger fragile Übergaben. Die Anzahl der Dateien, die ich zwischen den Schritten weitergab, sank. Mein Projektordner sah ruhiger aus – weniger temporäre Exporte, weniger Benennungsrituale. Es ist eine Kleinigkeit, aber solche Kleinigkeiten signalisieren, ob ein Tool die Art respektiert, wie Menschen tatsächlich arbeiten.

Sprung bei Auflösung und Qualität

Der visuelle Sprung in V4 zeigte sich am deutlichsten bei Kanten und Bewegungskonsistenz. Feine Details, Beschriftungen, Stofftexturen, Haare vor einem Fenster – hielten länger stand, bevor sie verschwammen. Bei meinen Durchläufen fühlte sich die native Klarheit bei 1080p zuverlässig an; 4K-Hochskalierungen hielten besser zusammen als mein altes V2-Stack. Ich sah noch leichtes Flimmern bei feinen Diagonalen, aber weniger jener „Ölgemälde”-Frames, die sich in lange V2-Sequenzen einschleichen.

Zwei Vorbehalte, die ich notiert habe:

- Die Qualität des ersten Frames in V4 ist stark, aber frühes Mikro-Jitter kann bei komplexen Szenen auftreten. Es legt sich üblicherweise bis zur dritten oder vierten Sekunde.

- Farbe hält in V4 besser, doch aggressive Farbwechsel in der Mitte eines Clips können das Modell verwirren. Ich erzielte sauberere Ergebnisse, wenn ich nach dem Export statt mitten im Prompt gradete.

Insgesamt: Wenn dein Ergebnis ein kurzes, poliertes Stück mit eingebautem Sound ist, zeigen V4s Standardwerte den Weg dorthin mit weniger Umwegen.

Wofür V2 noch die Nase vorn hat

Videolänge (V4 = max. 15 s, V2 = unbegrenzt)

Das ist die offensichtliche Sache. V4 begrenzt aktuell auf 15 Sekunden. Für Social-Media-Teaser, Intros oder Produkt-Loops ist das in Ordnung. Für Ambient-Leinwände, lange Erklärvideos oder Galeriewände nicht. V2s „einfach laufen lassen”-Modus ergibt für alles über einer halben Minute noch mehr Sinn. Ich muss keine Szenengrenzen vorab planen. Ich kann den Moment in der Mitte entdecken und nach außen schneiden.

Ich versuchte, Länge in V4 durch Verkettung von Ausgaben zu simulieren. Es funktionierte technisch, aber ich konnte die Naht spüren. Der Fluss änderte sich an jedem Übergang – wie das Zusammenfügen zweier Songs in derselben Tonart mit unterschiedlichen Schlagzeugern.

Breitere Hardware-/Integrationsunterstützung heute

V2 hat in der Praxis einen längeren Schwanz. Mehr Beispiele, mehr Community-Nodes, mehr Beiträge von Menschen, die Grenzfälle lösen, auf die man selbst stoßen wird. Wenn man auf gemischten Maschinen arbeitet (ich springe manchmal zwischen einem Studio-Rechner und einem Reise-Laptop), hilft V2s Toleranz für Variationen. Ich lud letzte Woche den V2-Graphen eines Teammitglieds und er lief nach einem Patch. Der entsprechende V4-Workflow wirkte wählerischer in Bezug auf Umgebung und Versionen.

Wenn dein Stack auf ComfyUI-plus-zufällige-Helfer setzt, stellt V2 weniger Fragen. Das kann der Unterschied zwischen heute liefern und einen Nachmittag mit einer Abhängigkeitskette herumstochern sein.

Entscheidungsleitfaden: V2 oder V4?

So würde ich es nach einer Woche Hin-und-Her-Durchläufen und ein paar echten Lieferables formulieren.

Wähle V4, wenn:

- Deine Ausgabe unter 15 Sekunden liegt und direkt fertig wirken soll.

- Audio wichtig ist – Beat-Synchronisierung, stimmgeführtes Pacing oder musikgetriebene Bewegung.

- Du weniger bewegliche Teile bevorzugst, auch wenn das weniger Raum für Langform-Experimente bedeutet.

Wähle V2, wenn:

- Du Sequenzen von mehr als 15 Sekunden ohne offensichtliche Nähte brauchst.

- Dein Workflow bereits stark auf ComfyUI ausgerichtet ist und du Presets mit Mitarbeitern tauschst.

- Du bereit bist, mehr manuellen Feinschliff zu leisten, im Tausch gegen offene Länge und breitere Kompatibilität.

Was mich überrascht hat

- V4 reduzierte mein Projekt-Chaos. Weniger temporäre Dateien, weniger halbfertige Stems. Das ist eine andere Art von Geschwindigkeit – weniger Kontextwechsel.

- V2 fühlte sich noch mehr wie Ton an. Ich konnte es formen und dehnen, ohne dass das Modell mich in eine „Kurzclip”-Denkweise zurückdrängte.

Warum das wichtig ist

Die meisten von uns brauchen kein weiteres Tool. Wir brauchen weniger Schritte und beständigere Ergebnisse. V4 steuert auf „fertig” zu. V2 steuert auf „offen” zu. Keines ist universell besser. Es geht um die Form deines Tages.

Wenn du unter Zeitdruck mit kurzen Formaten arbeitest, ist V4 der ruhigere Weg. Wenn du Ambient-Leinwände, Live-Visuals oder irgendetwas baust, das über 15 Sekunden atmet, hält V2 deine Hände frei.

Das hat für mich funktioniert – deine Erfahrung kann variieren. Ich werde wahrscheinlich beide installiert lassen. Eines zum Fertigstellen mit Sound, eines für wenn ich einfach möchte, dass die Kamera weiterläuft. Die kleine Frage, mit der ich sitze: Wird V4 jemals die Begrenzung aufheben, ohne seine Fassung zu verlieren? Das würde ich begrüßen. Aber ich habe es nicht eilig.